La historia de la inteligencia artificial ( IA ) comenzó en la antigüedad , con mitos, historias y rumores sobre seres artificiales dotados de inteligencia o conciencia por parte de maestros artesanos. Las semillas de la IA moderna fueron plantadas por filósofos que intentaron describir el proceso del pensamiento humano como la manipulación mecánica de símbolos. Este trabajo culminó con la invención de la computadora digital programable en la década de 1940, una máquina basada en la esencia abstracta del razonamiento matemático. Este dispositivo y las ideas detrás de él inspiraron a un puñado de científicos a comenzar a discutir seriamente la posibilidad de construir un cerebro electrónico .

El campo de la investigación de la IA se fundó en un taller celebrado en el campus del Dartmouth College , en Estados Unidos, durante el verano de 1956. [1] Quienes asistieron se convertirían en líderes de la investigación de la IA durante décadas. Muchos de ellos predijeron que una máquina tan inteligente como un ser humano existiría en no más de una generación, y recibieron millones de dólares para hacer realidad esta visión. [2]

Al final, resultó evidente que los investigadores habían subestimado enormemente la dificultad del proyecto. [3] En 1974, en respuesta a las críticas de James Lighthill y a la presión constante del Congreso de los Estados Unidos, los gobiernos estadounidense y británico dejaron de financiar investigaciones no dirigidas sobre inteligencia artificial. Siete años más tarde, una iniciativa visionaria del gobierno japonés inspiró a los gobiernos y a la industria a proporcionar a la IA miles de millones de dólares, pero a finales de la década de 1980 los inversores se desilusionaron y volvieron a retirar la financiación. Los años difíciles que siguieron se conocerían más tarde como el " invierno de la IA ". La IA fue criticada en la prensa y evitada por la industria hasta mediados de la década de 2000, pero la investigación y la financiación continuaron creciendo bajo otros nombres.

En la década de 1990 y principios de la de 2000, el aprendizaje automático se aplicó a muchos problemas en el mundo académico y la industria. El éxito se debió a la disponibilidad de potentes equipos informáticos, la recopilación de inmensos conjuntos de datos y la aplicación de sólidos métodos matemáticos. En 2012, el aprendizaje profundo demostró ser una tecnología innovadora que eclipsó a todos los demás métodos. La arquitectura del transformador debutó en 2017 y se utilizó para producir impresionantes aplicaciones de IA generativa . La inversión en IA se disparó en la década de 2020.

En la mitología griega, Talos era un gigante construido en bronce que actuaba como guardián de la isla de Creta. Lanzaba piedras a los barcos de los invasores y completaba 3 circuitos alrededor del perímetro de la isla diariamente. [4] Según la Bibliotheke del pseudo-Apolodoro , Hefesto forjó Talos con la ayuda de un cíclope y presentó el autómata como regalo a Minos . [5] En la Argonáutica , Jasón y los argonautas lo derrotaron mediante un único tapón cerca de su pie que, una vez retirado, permitió que el icor vital fluyera fuera de su cuerpo y lo dejó inanimado. [6]

Pigmalión fue un rey y escultor legendario de la mitología griega, famoso por su representación en las Metamorfosis de Ovidio . En el décimo libro del poema narrativo de Ovidio, Pigmalión se disgusta con las mujeres cuando presencia la forma en que las Propetides se prostituyen. [7] A pesar de esto, hace ofrendas en el templo de Venus pidiéndole a la diosa que le traiga una mujer igual a una estatua que él talló.

En De la naturaleza de las cosas , escrito por el alquimista suizo Paracelso , describe un procedimiento que, según él, puede fabricar un "hombre artificial". Al colocar el "esperma de un hombre" en estiércol de caballo y alimentarlo con el "Arcano de la sangre del hombre" después de 40 días, el brebaje se convertirá en un bebé vivo. [8]

El relato escrito más antiguo sobre la fabricación de golems se encuentra en los escritos de Eleazar ben Judá de Worms a principios del siglo XIII. [9] [10] Durante la Edad Media, se creía que la animación de un Golem se podía lograr insertando un trozo de papel con cualquiera de los nombres de Dios en la boca de la figura de arcilla. [11] A diferencia de los autómatas legendarios como Brazen Heads , [12] un Golem no podía hablar. [13]

Takwin , la creación artificial de vida, era un tema frecuente enlos manuscritos alquímicos ismaelitas , especialmente los atribuidos a Jabir ibn Hayyan . Los alquimistas islámicos intentaron crear una amplia gama de formas de vida a través de su trabajo, desde plantas hasta animales. [14]

En Fausto: la segunda parte de la tragedia de Johann Wolfgang von Goethe , un homúnculo fabricado alquímicamente , destinado a vivir para siempre en el frasco en el que fue creado, se esfuerza por nacer en un cuerpo humano completo. Sin embargo, al iniciarse esta transformación, el matraz se rompe y el homúnculo muere. [15]

En el siglo XIX, las ideas sobre hombres artificiales y máquinas pensantes se desarrollaron en la ficción, como en Frankenstein de Mary Shelley o en RUR (Robots universales de Rossum) de Karel Čapek , [16] y en especulaciones, como en " Darwin " de Samuel Butler. entre las Máquinas ", [17] y en instancias del mundo real, incluyendo " El jugador de ajedrez de Maelzel " de Edgar Allan Poe . [18] La IA es un tema común en la ciencia ficción hasta el presente. [19]

Autómatas humanoides realistas fueron construidos por artesanos de muchas civilizaciones, incluido Yan Shi , [20] Héroe de Alejandría , [21] Al-Jazari , [22] Haroun al-Rashid , [23] Jacques de Vaucanson , [24] [25] Leonardo Torres y Quevedo , [26] Pierre Jaquet-Droz y Wolfgang von Kempelen . [27] [28]

Los autómatas más antiguos conocidos fueron las estatuas sagradas del antiguo Egipto y Grecia . [29] [30] Los fieles creían que el artesano había imbuido a estas figuras de mentes muy reales, capaces de sabiduría y emoción: Hermes Trismegisto escribió que "al descubrir la verdadera naturaleza de los dioses, el hombre ha podido reproducirla". [31] El erudito inglés Alexander Neckham afirmó que el antiguo poeta romano Virgilio había construido un palacio con estatuas de autómatas. [32]

Durante el período moderno temprano, se decía que estos autómatas legendarios poseían la habilidad mágica de responder las preguntas que se les formulaban. Se decía que el alquimista y protoprotestante de finales de la Edad Media Roger Bacon había fabricado una cabeza de bronce , habiendo desarrollado la leyenda de haber sido un mago. [33] [34] Estas leyendas eran similares al mito nórdico de la Cabeza de Mímir . Según la leyenda, Mímir era conocido por su intelecto y sabiduría, y fue decapitado en la Guerra Æsir-Vanir . Se dice que Odin "embalsamó" la cabeza con hierbas y pronunció encantamientos sobre ella de modo que la cabeza de Mímir seguía siendo capaz de transmitirle sabiduría a Odin. Odín luego mantuvo la cabeza cerca de él para pedirle consejo. [35]

La inteligencia artificial se basa en el supuesto de que el proceso del pensamiento humano puede mecanizarse. El estudio del razonamiento mecánico (o "formal") tiene una larga historia. Los filósofos chinos , indios y griegos desarrollaron métodos estructurados de deducción formal en el primer milenio a.C. Sus ideas fueron desarrolladas a lo largo de los siglos por filósofos como Aristóteles (que dio un análisis formal del silogismo ), Euclides (cuyo Elementos fue un modelo de razonamiento formal), al-Khwārizmī (que desarrolló el álgebra y dio su nombre al " algoritmo "). ) y filósofos escolásticos europeos como Guillermo de Ockham y Duns Escoto . [36]

El filósofo español Ramon Llull (1232-1315) desarrolló varias máquinas lógicas dedicadas a la producción de conocimiento por medios lógicos; [37] Llull describió sus máquinas como entidades mecánicas que podían combinar verdades básicas e innegables mediante operaciones lógicas simples, producidas por la máquina mediante significados mecánicos, de tal manera que produjeran todo el conocimiento posible. [38] La obra de Llull tuvo una gran influencia en Gottfried Leibniz , quien volvió a desarrollar sus ideas. [39]

En el siglo XVII, Leibniz , Thomas Hobbes y René Descartes exploraron la posibilidad de que todo pensamiento racional pudiera volverse tan sistemático como el álgebra o la geometría. [40] Hobbes escribió en Leviatán : "la razón no es más que ajuste de cuentas". [41] Leibniz imaginó un lenguaje universal de razonamiento, el característico universalis , que reduciría la argumentación al cálculo de modo que "no habría más necesidad de disputa entre dos filósofos que entre dos contables. Porque bastaría con tomar sus lápices en la mano". , hasta sus pizarras, y decirse unos a otros (con un amigo como testigo, si querían): Calculemos ". [42] Estos filósofos habían comenzado a articular la hipótesis del sistema de símbolos físicos que se convertiría en la fe rectora de la investigación de la IA.

El estudio de la lógica matemática proporcionó el avance esencial que hizo que la inteligencia artificial pareciera plausible. Las bases se habían sentado con obras como Las leyes del pensamiento de Boole y Begriffsschrift de Frege . Basándose en el sistema de Frege , Russell y Whitehead presentaron un tratamiento formal de los fundamentos de las matemáticas en su obra maestra, los Principia Mathematica en 1913. Inspirados por el éxito de Russell , David Hilbert desafió a los matemáticos de las décadas de 1920 y 1930 a responder esta pregunta fundamental. : "¿Se puede formalizar todo el razonamiento matemático?" [36] Su pregunta fue respondida por la prueba de incompletitud de Gödel , la máquina de Turing y el cálculo Lambda de Church . [36] [un]

Su respuesta fue sorprendente en dos sentidos. Primero, demostraron que, de hecho, había límites a lo que la lógica matemática podía lograr. Pero en segundo lugar (y más importante para la IA) su trabajo sugirió que, dentro de estos límites, cualquier forma de razonamiento matemático podría mecanizarse. La tesis de Church-Turing implicaba que un dispositivo mecánico que mezclara símbolos tan simples como el 0 y el 1 podría imitar cualquier proceso concebible de deducción matemática. [36] La idea clave fue la máquina de Turing , una construcción teórica simple que capturó la esencia de la manipulación de símbolos abstractos. [45] Esta invención inspiraría a un puñado de científicos a comenzar a discutir la posibilidad de máquinas pensantes.

Las máquinas calculadoras fueron diseñadas o construidas en la antigüedad y a lo largo de la historia por muchas personas, entre ellas Gottfried Leibniz , [46] Joseph Marie Jacquard , [47] Charles Babbage , [48] Percy Ludgate , [49] Leonardo Torres Quevedo , [50] Vannevar Bush , [51] y otros. Ada Lovelace especuló que la máquina de Babbage era "una máquina pensante o... razonadora", pero advirtió que "es deseable protegerse contra la posibilidad de que surjan ideas exageradas en cuanto a los poderes" de la máquina. [52] [53]

Las primeras computadoras modernas fueron las máquinas masivas de la Segunda Guerra Mundial (como la Z3 de Konrad Zuse , Heath Robinson y Colossus de Alan Turing , Atanasoff y Berry y ABC y ENIAC de la Universidad de Pensilvania ). [54] ENIAC se basó en los fundamentos teóricos establecidos por Alan Turing y desarrollados por John von Neumann , [55] y demostró ser el más influyente. [54]

Las primeras investigaciones sobre las máquinas pensantes se inspiraron en una confluencia de ideas que prevalecieron a finales de los años treinta, cuarenta y principios de los cincuenta. Investigaciones recientes en neurología habían demostrado que el cerebro era una red eléctrica de neuronas que se disparaban en pulsos de todo o nada. La cibernética de Norbert Wiener describió el control y la estabilidad en las redes eléctricas. La teoría de la información de Claude Shannon describía señales digitales (es decir, señales de todo o nada). La teoría de la computación de Alan Turing demostró que cualquier forma de computación podía describirse digitalmente. La estrecha relación entre estas ideas sugirió que podría ser posible construir un "cerebro electrónico".

En las décadas de 1940 y 1950, un puñado de científicos de diversos campos (matemáticas, psicología, ingeniería, economía y ciencias políticas) exploraron varias direcciones de investigación que serían vitales para la investigación posterior de la IA. [56] Alan Turing fue una de las primeras personas en investigar seriamente la posibilidad teórica de la "inteligencia artificial". [57] El campo de la " investigación en inteligencia artificial " se fundó como disciplina académica en 1956. [58]

En 1950, Turing publicó un artículo histórico " Computing Machinery and Intelligence ", en el que especulaba sobre la posibilidad de crear máquinas que piensen. [60] [b] En el artículo, señaló que "pensar" es difícil de definir e ideó su famosa prueba de Turing : Si una máquina pudiera mantener una conversación (a través de un teleimpresor ) que fuera indistinguible de una conversación con un ser humano. , entonces era razonable decir que la máquina estaba "pensando". [61] Esta versión simplificada del problema permitió a Turing argumentar de manera convincente que una "máquina pensante" era al menos plausible y el artículo respondió a todas las objeciones más comunes a la proposición. [62] La prueba de Turing fue la primera propuesta seria en la filosofía de la inteligencia artificial .

Walter Pitts y Warren McCulloch analizaron redes de neuronas artificiales idealizadas y mostraron cómo podrían realizar funciones lógicas simples en 1943. [63] [64] Fueron los primeros en describir lo que los investigadores posteriores llamarían una red neuronal . [65] El artículo fue influenciado por el artículo de Turing ' Sobre números computables ' de 1936 utilizando 'neuronas' booleanas de dos estados similares, pero fue el primero en aplicarlo a la función neuronal. [57] Uno de los estudiantes inspirados por Pitts y McCulloch fue Marvin Minsky , que en ese momento era un estudiante de posgrado de 24 años. En 1951, Minsky y Dean Edmonds construyeron la primera máquina de red neuronal, la SNARC . [66] Minsky se convertiría más tarde en uno de los líderes e innovadores más importantes en IA.

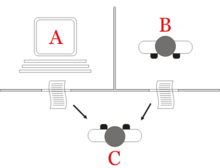

En la década de 1950 se construyeron robots experimentales, como las tortugas de W. Gray Walter y la Bestia de Johns Hopkins . Estas máquinas no utilizaban computadoras, electrónica digital ni razonamiento simbólico; estaban controlados completamente por circuitos analógicos. [67]

En 1951, utilizando la máquina Ferranti Mark 1 de la Universidad de Manchester , Christopher Strachey escribió un programa de damas y Dietrich Prinz escribió uno para ajedrez. [68] El programa de damas de Arthur Samuel , tema de su artículo de 1959 "Algunos estudios sobre aprendizaje automático utilizando el juego de damas", finalmente alcanzó la habilidad suficiente para desafiar a un aficionado respetable. [69] La IA de juegos seguiría utilizándose como una medida del progreso de la IA a lo largo de su historia.

Cuando el acceso a las computadoras digitales fue posible a mediados de los años cincuenta, algunos científicos reconocieron instintivamente que una máquina que podía manipular números también podía manipular símbolos y que la manipulación de símbolos bien podría ser la esencia del pensamiento humano. Este fue un nuevo enfoque para la creación de máquinas pensantes. [70]

En 1955, Allen Newell y el futuro premio Nobel Herbert A. Simon crearon el " Teórico de la Lógica ", con la ayuda de JC Shaw . El programa finalmente demostraría 38 de los primeros 52 teoremas de los Principia Mathematica de Russell y Whitehead , y encontraría demostraciones nuevas y más elegantes para algunos. [71] Simon dijo que habían "resuelto el venerable problema mente/cuerpo , explicando cómo un sistema compuesto de materia puede tener las propiedades de la mente". [72] Esta fue una de las primeras declaraciones de la posición filosófica que John Searle llamaría más tarde " IA fuerte ": que las máquinas pueden contener mentes tal como lo hacen los cuerpos humanos. [73] El paradigma de razonamiento simbólico que introdujeron dominaría la investigación y la financiación de la IA hasta mediados de los años 90, además de inspirar la revolución cognitiva .

El taller de Dartmouth de 1956 fue un evento fundamental que marcó el inicio formal de la IA como disciplina académica. [74] Fue organizado por Marvin Minsky , John McCarthy , con el apoyo de dos científicos de alto nivel, Claude Shannon y Nathan Rochester de IBM . La propuesta para la conferencia decía que tenían la intención de probar la afirmación de que "cada aspecto del aprendizaje o cualquier otra característica de la inteligencia puede describirse con tanta precisión que se puede construir una máquina para simularlo". [75] El término "Inteligencia Artificial" fue introducido por John McCarthy en el taller. [76] [c] Los participantes incluyeron a Ray Solomonoff , Oliver Selfridge , Trenchard More , Arthur Samuel , Allen Newell y Herbert A. Simon , todos los cuales crearían importantes programas durante las primeras décadas de investigación de la IA. [78] En el taller, Newell y Simon debutaron con el " Teórico de la lógica ". [79] El taller fue el momento en que la IA ganó su nombre, su misión, su primer gran éxito y sus actores clave, y es ampliamente considerado el nacimiento de la IA. [80]

En el otoño de 1956, Newell y Simon también presentaron el Teórico de la Lógica en una reunión del Grupo de Interés Especial en Teoría de la Información en el Instituto Tecnológico de Massachusetts (MIT). En la misma reunión, Noam Chomsky discutió su gramática generativa y George Miller describió su artículo histórico " El número mágico siete, más o menos dos ". Miller escribió: "Salí del simposio con la convicción, más intuitiva que racional, de que la psicología experimental, la lingüística teórica y la simulación por computadora de procesos cognitivos eran piezas de un todo mayor". [81]

Esta reunión fue el comienzo de la " revolución cognitiva ", un cambio de paradigma interdisciplinario en psicología, filosofía, informática y neurociencia. Inspiró la creación de los subcampos de la inteligencia artificial simbólica , la lingüística generativa , la ciencia cognitiva , la psicología cognitiva , la neurociencia cognitiva y las escuelas filosóficas del computacionalismo y el funcionalismo . Todos estos campos utilizaron herramientas relacionadas para modelar la mente y los resultados descubiertos en un campo fueron relevantes para los demás.

El enfoque cognitivo permitió a los investigadores considerar "objetos mentales" como pensamientos, planes, metas, hechos o recuerdos, a menudo analizados utilizando símbolos de alto nivel en redes funcionales. Estos objetos habían sido prohibidos por ser "no observables" en paradigmas anteriores como el conductismo . Los objetos mentales simbólicos se convertirían en el principal foco de investigación y financiación de la IA durante las próximas décadas.

Los programas desarrollados en los años posteriores al Taller de Dartmouth fueron, para la mayoría de la gente, simplemente "asombrosos": [82] las computadoras resolvían problemas planteados de álgebra, demostraban teoremas de geometría y aprendían a hablar inglés. Pocos en aquel momento habrían creído que un comportamiento tan "inteligente" por parte de las máquinas fuera posible. [83] Los investigadores expresaron un intenso optimismo en privado y en forma impresa, prediciendo que se construiría una máquina totalmente inteligente en menos de 20 años. [84] Agencias gubernamentales como la Agencia de Proyectos de Investigación Avanzada de Defensa (DARPA, entonces conocida como "ARPA") invirtieron dinero en este campo. [85] Se crearon laboratorios de Inteligencia Artificial en varias universidades británicas y estadounidenses a finales de los años cincuenta y principios de los sesenta. [57]

Hubo muchos programas exitosos y nuevas direcciones a finales de los años cincuenta y sesenta. Entre los más influyentes se encuentran estos:

Muchos de los primeros programas de IA utilizaban el mismo algoritmo básico . Para lograr algún objetivo (como ganar un juego o demostrar un teorema), avanzaban paso a paso hacia él (haciendo un movimiento o una deducción) como si buscaran en un laberinto, retrocediendo cada vez que llegaban a un callejón sin salida.

La principal dificultad fue que, para muchos problemas, el número de caminos posibles a través del "laberinto" era astronómico (situación conocida como " explosión combinatoria "). Los investigadores reducirían el espacio de búsqueda mediante el uso de heurísticas que eliminarían caminos que probablemente no condujeran a una solución. [86]

Newell y Simon intentaron capturar una versión general de este algoritmo en un programa llamado " General Problem Solver ". [87] Otros programas de "búsqueda" fueron capaces de realizar tareas impresionantes como la resolución de problemas de geometría y álgebra, como Geometry Theorem Prover (1958) de Herbert Gelernter y Symbolic Automatic Integrator (SAINT), escrito por el alumno de Minsky, James Slagle, en 1961. [88] Otros programas buscaban a través de metas y submetas para planificar acciones, como el sistema STRIPS desarrollado en Stanford para controlar el comportamiento del robot Shakey . [89]

Un objetivo importante de la investigación de la IA es permitir que las computadoras se comuniquen en lenguajes naturales como el inglés. Uno de los primeros éxitos fue el programa STUDENT de Daniel Bobrow , que podía resolver problemas planteados de álgebra de la escuela secundaria. [90]

Una red semántica representa conceptos (por ejemplo, "casa", "puerta") como nodos, y relaciones entre conceptos como vínculos entre los nodos (por ejemplo, "tiene-a"). El primer programa de IA que utilizó una red semántica fue escrito por Ross Quillian [91] y la versión más exitosa (y controvertida) fue la teoría de la dependencia conceptual de Roger Schank . [92]

ELIZA de Joseph Weizenbaum podía mantener conversaciones tan realistas que en ocasiones los usuarios se engañaban haciéndoles creer que se estaban comunicando con un ser humano y no con un programa de ordenador (ver efecto ELIZA ). Pero, de hecho, ELIZA simplemente dio una respuesta enlatada o repitió lo que se le dijo, reformulando su respuesta con algunas reglas gramaticales. ELIZA fue el primer chatbot . [93]

A finales de los años 60, Marvin Minsky y Seymour Papert, del Laboratorio de IA del MIT, propusieron que la investigación en IA debería centrarse en situaciones artificialmente simples conocidas como micromundos. Señalaron que en ciencias exitosas como la física, los principios básicos a menudo se entendían mejor utilizando modelos simplificados como planos sin fricción o cuerpos perfectamente rígidos. Gran parte de la investigación se centró en un " mundo de bloques ", que consiste en bloques de colores de diversas formas y tamaños dispuestos sobre una superficie plana. [94]

Este paradigma llevó a trabajos innovadores en visión artificial por parte de Gerald Sussman , Adolfo Guzmán, David Waltz (quien inventó la " propagación de restricciones ") y, especialmente, Patrick Winston . Al mismo tiempo, Minsky y Papert construyeron un brazo robótico que podía apilar bloques, dando vida al mundo de los bloques. El SHRDLU de Terry Winograd podía comunicar en frases comunes en inglés sobre el micromundo, planificar operaciones y ejecutarlas. [95]

_(20897323365).jpg/440px-330-PSA-80-60_(USN_710739)_(20897323365).jpg)

En la década de 1960, la revolución cognitiva fue muy influyente y la mayor parte de la financiación se dirigió a laboratorios que investigaban la IA simbólica . Sin embargo, hubo una excepción: el perceptrón , una red neuronal de una sola capa introducida en 1958 por Frank Rosenblatt (que había sido compañero de escuela de Marvin Minsky en la Escuela Secundaria de Ciencias del Bronx ). Como la mayoría de los investigadores de IA, se mostró optimista acerca de su poder y predijo que un perceptrón "con el tiempo podría ser capaz de aprender, tomar decisiones y traducir idiomas". [98]

Rosenblatt fue financiado principalmente por la Oficina de Investigación Naval . [99] Bernard Widrow y su alumno Ted Hoff construyeron ADALINE (1960) y MADALINE (1962), que tenían hasta 1000 pesas ajustables. [100] Un grupo del Instituto de Investigación de Stanford dirigido por Charles A. Rosen y Alfred E. (Ted) Brain construyó dos máquinas de redes neuronales llamadas MINOS I (1960) y II (1963), financiadas principalmente por el Cuerpo de Señales del Ejército de EE. UU . MINOS II [101] tenía 6600 pesos ajustables, [102] y estaba controlado con una computadora SDS 910 en una configuración llamada MINOS III (1968), que podía clasificar símbolos en mapas del ejército y reconocer caracteres impresos a mano en hojas de codificación Fortran . [103] [104] [105]

La mayor parte de la investigación sobre redes neuronales durante este período inicial implicó la construcción y el uso de hardware a medida, en lugar de simulación en computadoras digitales. La diversidad de hardware fue particularmente clara en las diferentes tecnologías utilizadas para implementar los pesos ajustables. Las máquinas perceptrones y el SNARC utilizaban potenciómetros movidos por motores eléctricos. ADALINE utilizó memistores ajustados mediante galvanoplastia , aunque también utilizó simulaciones en una computadora IBM 1620 . Las máquinas MINOS utilizaban núcleos de ferrita con múltiples orificios que podían bloquearse individualmente, y el grado de bloqueo representaba los pesos. [106]

Sin embargo, en parte debido a la falta de resultados y en parte a la competencia de la investigación de IA simbólica , el proyecto MINOS se quedó sin financiación en 1966. Rosenblatt no logró asegurar una financiación continua en la década de 1960. [106] En 1969, la investigación se detuvo repentinamente con la publicación del libro Perceptrons de Minsky y Papert de 1969 . [107] Sugirió que había graves limitaciones a lo que podían hacer los perceptrones y que las predicciones de Rosenblatt habían sido tremendamente exageradas. El efecto del libro fue que prácticamente no se financió ninguna investigación sobre conexionismo durante 10 años. [98] La competencia por la financiación gubernamental terminó con la victoria de los enfoques de IA simbólica sobre las redes neuronales. [105] [106]

Minsky (que había trabajado en SNARC ) se convirtió en un firme objetor de la IA conexionista pura. Widrow (que había trabajado en ADALINE ) recurrió al procesamiento de señales adaptativo. El grupo SRI (que trabajó en MINOS) recurrió a la IA simbólica y la robótica. [105] [106]

El principal problema era la incapacidad de entrenar redes multicapa (ya se habían utilizado versiones de retropropagación en otros campos, pero estos investigadores lo desconocían). Rosenblatt intentó reunir fondos para construir máquinas perceptrones más grandes, pero murió en un accidente de navegación en 1971. [98]

La primera generación de investigadores de IA hizo estas predicciones sobre su trabajo:

En junio de 1963, el MIT recibió una subvención de 2,2 millones de dólares de la recién creada Agencia de Proyectos de Investigación Avanzada (ARPA, más tarde conocida como DARPA ). El dinero se utilizó para financiar el proyecto MAC , que incluía al "Grupo AI" fundado por Minsky y McCarthy cinco años antes. DARPA continuó proporcionando 3 millones de dólares cada año hasta los años 70. [112] DARPA otorgó subvenciones similares al programa de Newell y Simon en la Universidad Carnegie Mellon y al Laboratorio de IA de la Universidad de Stanford , fundado por John McCarthy en 1963. [113] Donald Michie estableció otro importante laboratorio de IA en la Universidad de Edimburgo en 1965. [114] Estas cuatro instituciones continuarían siendo los principales centros de investigación y financiación de la IA en el mundo académico durante muchos años. [115]

El dinero se entregó con pocas condiciones: JCR Licklider , entonces director de ARPA, creía que su organización debería "financiar personas, no proyectos". y permitió a los investigadores seguir cualquier dirección que pudiera interesarles. [116] Esto creó una atmósfera despreocupada en el MIT que dio origen a la cultura hacker , [117] pero este enfoque de "no intervenir" no duró.

En la década de 1970, la IA fue objeto de críticas y reveses financieros. Los investigadores de IA no habían sabido apreciar la dificultad de los problemas que enfrentaban. Su tremendo optimismo había elevado las expectativas del público a niveles increíblemente altos, y cuando los resultados prometidos no se materializaron, la financiación destinada a la IA se redujo drásticamente. [118] La falta de éxito indicó que las técnicas utilizadas por los investigadores de IA en ese momento eran insuficientes para lograr sus objetivos. [119] [120]

Sin embargo, estos reveses no afectaron el crecimiento y progreso del campo. Los recortes de financiación sólo afectaron a un puñado de laboratorios importantes [121] y las críticas fueron en gran medida ignoradas. [122] El interés del público general en el campo continuó creciendo, [121] el número de investigadores aumentó dramáticamente, [121] y se exploraron nuevas ideas en programación lógica , razonamiento de sentido común y muchas otras áreas. El historiador Thomas Haigh sostiene que no hubo invierno, [121] y el investigador de IA Nils Nilsson describió este período como el momento más "emocionante" para trabajar en IA. [123]

A principios de los años setenta, las capacidades de los programas de IA eran limitadas. Incluso los más impresionantes sólo podían manejar versiones triviales de los problemas que se suponía que debían resolver; todos los programas eran, en cierto sentido, "juguetes". [124] Los investigadores de IA habían comenzado a toparse con varios límites que solo se superarían décadas después, y otros que aún obstaculizan el campo en la década de 2020: [125]

Las agencias que financiaron la investigación de la IA, como el gobierno británico , DARPA y el Consejo Nacional de Investigación (NRC), se sintieron frustradas por la falta de progreso y finalmente cortaron casi todos los fondos para la investigación no dirigida de la IA. El patrón comenzó en 1966, cuando el informe del Comité Asesor sobre Procesamiento Automático del Idioma (ALPAC) criticó los esfuerzos de traducción automática. Después de gastar 20 millones de dólares, la NRC puso fin a todo apoyo. [134] En 1973, el informe Lighthill sobre el estado de la investigación de la IA en el Reino Unido criticó el fracaso de la IA para lograr sus "objetivos grandiosos" y condujo al desmantelamiento de la investigación de la IA en ese país. [135] (El informe menciona específicamente el problema de la explosión combinatoria como una razón para las fallas de la IA.) [136] [e] DARPA estaba profundamente decepcionado con los investigadores que trabajaban en el programa de Investigación de Comprensión del Habla en CMU y canceló una subvención anual de $3 millones. [137] [f]

Hans Moravec achacó la crisis a las predicciones poco realistas de sus colegas. "Muchos investigadores quedaron atrapados en una red de exageración cada vez mayor". [138] [g] Sin embargo, había otro problema: desde la aprobación de la Enmienda Mansfield en 1969, DARPA había estado bajo una presión cada vez mayor para financiar "investigación directa orientada a una misión, en lugar de investigación básica no dirigida". La financiación para la exploración creativa y libre que se había llevado a cabo en los años 60 no vendría de DARPA, que en cambio destinó dinero a proyectos específicos con objetivos claros, como tanques autónomos y sistemas de gestión de batalla . [139] [h]

Los principales laboratorios (MIT, Stanford y CMU) habían estado recibiendo un generoso apoyo del ejército estadounidense y, cuando se retiró, estos fueron los únicos lugares que se vieron seriamente afectados por los recortes presupuestarios. Los miles de investigadores fuera de estas instituciones y los muchos miles más que se estaban incorporando al campo no se vieron afectados. [121]

Varios filósofos tuvieron fuertes objeciones a las afirmaciones de los investigadores de IA. Uno de los primeros fue John Lucas , quien argumentó que el teorema de incompletitud de Gödel demostraba que un sistema formal (como un programa de computadora) nunca podría ver la verdad de ciertas afirmaciones, mientras que un ser humano sí podría. [140] Hubert Dreyfus ridiculizó las promesas incumplidas de la década de 1960 y criticó los supuestos de la IA, argumentando que el razonamiento humano en realidad implicaba muy poco "procesamiento de símbolos" y una gran cantidad de " saber hacer " encarnado , instintivo e inconsciente . [141] [142] El argumento de la Habitación China de John Searle , presentado en 1980, intentó mostrar que no se puede decir que un programa "comprende" los símbolos que utiliza (una cualidad llamada " intencionalidad "). Si los símbolos no tienen significado para la máquina, argumentó Searle, entonces la máquina no puede describirse como "pensante". [143]

Los investigadores de IA no tomaron en serio estas críticas. Problemas como la intratabilidad y el conocimiento de sentido común parecían mucho más inmediatos y serios. No estaba claro qué diferencia suponían el " saber hacer " o la " intencionalidad " en un programa informático real. Minsky, del MIT, dijo que Dreyfus y Searle "no entienden y deberían ser ignorados". [144] A Dreyfus, que también enseñaba en el MIT , se le dio la espalda: más tarde dijo que los investigadores de IA "no se atrevían a ser vistos almorzando conmigo". [145] Joseph Weizenbaum , el autor de ELIZA , también fue un crítico abierto de las posiciones de Dreyfus, pero "dejó deliberadamente claro que [el trato que sus colegas de IA dieron a Dreyfus] no era la manera de tratar a un ser humano", [ 146] y era poco profesional e infantil. [147]

Weizenbaum empezó a tener serias dudas éticas sobre la IA cuando Kenneth Colby escribió un "programa informático que puede llevar a cabo un diálogo psicoterapéutico " basado en ELIZA. [148] A Weizenbaum le molestó que Colby viera un programa sin sentido como una herramienta terapéutica seria. Comenzó una disputa y la situación no mejoró cuando Colby no le dio crédito a Weizenbaum por su contribución al programa. En 1976, Weizenbaum publicó Computer Power and Human Reason , en el que argumentaba que el mal uso de la inteligencia artificial tiene el potencial de devaluar la vida humana. [149]

La lógica fue introducida en la investigación de la IA ya en 1959, por John McCarthy en su propuesta Advice Taker . [150] En 1963, J. Alan Robinson había descubierto un método simple para implementar la deducción en computadoras, el algoritmo de resolución y unificación . Sin embargo, las implementaciones sencillas, como las que intentaron McCarthy y sus estudiantes a finales de la década de 1960, eran especialmente difíciles: los programas requerían números astronómicos de pasos para demostrar teoremas simples. [151] Robert Kowalski desarrolló un enfoque más fructífero de la lógica en la década de 1970 , y pronto esto condujo a la colaboración con los investigadores franceses Alain Colmerauer y Philippe Roussel quienes crearon el exitoso lenguaje de programación lógica Prolog . [152] Prolog utiliza un subconjunto de lógica ( cláusulas Horn , estrechamente relacionadas con " reglas " y " reglas de producción ") que permiten un cálculo manejable. Las reglas continuarían siendo influyentes, proporcionando una base para los sistemas expertos de Edward Feigenbaum y el trabajo continuo de Allen Newell y Herbert A. Simon que conduciría a Soar y sus teorías unificadas de la cognición . [153]

Los críticos del enfoque lógico señalaron, como lo había hecho Dreyfus , que los seres humanos rara vez utilizaban la lógica cuando resolvían problemas. Los experimentos de psicólogos como Peter Wason , Eleanor Rosch , Amos Tversky , Daniel Kahneman y otros proporcionaron pruebas de ello. [154] McCarthy respondió que lo que hace la gente es irrelevante. Sostuvo que lo que realmente se necesita son máquinas que puedan resolver problemas, no máquinas que piensen como lo hace la gente. [155]

Entre los críticos del enfoque de McCarthy se encontraban sus colegas de todo el país en el MIT . Marvin Minsky , Seymour Papert y Roger Schank intentaban resolver problemas como "comprensión de historias" y "reconocimiento de objetos" que requerían una máquina para pensar como una persona. Para utilizar conceptos ordinarios como "silla" o "restaurante" tuvieron que hacer las mismas suposiciones ilógicas que la gente normalmente hace. Desafortunadamente, conceptos imprecisos como estos son difíciles de representar en lógica. Gerald Sussman observó que "usar un lenguaje preciso para describir conceptos esencialmente imprecisos no los hace más precisos". [156] Schank describió sus enfoques "antilógicos" como " desaliñados ", en contraposición a los paradigmas " limpios " utilizados por McCarthy , Kowalski , Feigenbaum , Newell y Simon . [157]

En 1975, en un artículo fundamental, Minsky señaló que muchos de sus colegas investigadores estaban utilizando el mismo tipo de herramienta: un marco que captura todas nuestras suposiciones de sentido común sobre algo. Por ejemplo, si utilizamos el concepto de pájaro, hay una constelación de hechos que inmediatamente nos vienen a la mente: podríamos suponer que vuela, come gusanos, etc. Sabemos que estos hechos no siempre son ciertos y que las deducciones que utilicen estos hechos no serán "lógicas", pero estos conjuntos estructurados de suposiciones son parte del contexto de todo lo que decimos y pensamos. A estas estructuras las llamó " marcos ". Schank utilizó una versión de fotogramas que llamó " guiones " para responder con éxito preguntas sobre cuentos en inglés. [158]

Los lógicos aceptaron el desafío. Pat Hayes afirmó que "la mayoría de los 'marcos' son sólo una nueva sintaxis para partes de la lógica de primer orden". Pero señaló que "hay uno o dos detalles aparentemente menores que causan muchos problemas, sobre todo los impagos". [159] Mientras tanto, Ray Reiter admitió que "las lógicas convencionales, como la lógica de primer orden, carecen del poder expresivo para representar adecuadamente el conocimiento requerido para el razonamiento por defecto". [160] Propuso aumentar la lógica de primer orden con una suposición de mundo cerrado de que una conclusión se cumple (por defecto) si no se puede demostrar su contrario. Mostró cómo tal suposición corresponde a la suposición de sentido común formulada al razonar con marcos. También demostró que en Prolog tiene su "equivalente procesal" la negación del fracaso .

El supuesto del mundo cerrado, tal como lo formula Reiter, "no es una noción de primer orden. (Es una metanoción)" [160]. Sin embargo, Keith Clark demostró que la negación como fracaso finito puede entenderse como un razonamiento implícito con definiciones en lógica de primer orden que incluye un supuesto de nombre único de que diferentes términos denotan diferentes individuos. [161]

A finales de los años 1970 y a lo largo de los años 1980, se desarrollaron una variedad de lógicas y extensiones de la lógica de primer orden tanto para la negación como para el fracaso en la programación lógica y para el razonamiento por defecto en general. En conjunto, estas lógicas se conocen como lógicas no monótonas .

En la década de 1980, corporaciones de todo el mundo adoptaron una forma de programa de IA llamado " sistemas expertos " y el conocimiento se convirtió en el foco de la investigación generalizada en IA. Los gobiernos proporcionaron financiación sustancial, como el proyecto informático de quinta generación de Japón y la Iniciativa de Computación Estratégica de Estados Unidos .

Aunque la representación simbólica del conocimiento y el razonamiento lógico produjeron estas útiles aplicaciones en los años 80, todavía no lograban resolver problemas de percepción , robótica , aprendizaje y sentido común . Un pequeño número de científicos e ingenieros comenzaron a dudar de que el enfoque simbólico fuera alguna vez suficiente para estas tareas y desarrollaron otros enfoques, como el conexionismo , la robótica y la computación blanda .

Un sistema experto es un programa que responde preguntas o resuelve problemas sobre un dominio de conocimiento específico, utilizando reglas lógicas que se derivan del conocimiento de los expertos. Los primeros ejemplos fueron desarrollados por Edward Feigenbaum y sus alumnos. Dendral , iniciado en 1965, identificó compuestos a partir de lecturas de espectrómetro. MYCIN , desarrollado en 1972, diagnosticaba enfermedades sanguíneas infecciosas. Demostraron la viabilidad del enfoque. [162]

Los sistemas expertos se restringieron a un pequeño dominio de conocimiento específico (evitando así el problema del conocimiento de sentido común ) y su diseño simple hizo que fuera relativamente fácil construir programas y luego modificarlos una vez que estaban en funcionamiento. En general, los programas demostraron ser útiles : algo que la IA no había podido lograr hasta ese momento. [163]

En 1980, se completó en CMU un sistema experto llamado XCON para Digital Equipment Corporation . Fue un éxito enorme: en 1986 le estaba ahorrando a la empresa 40 millones de dólares anuales. [164] Empresas de todo el mundo comenzaron a desarrollar e implementar sistemas expertos y en 1985 estaban gastando más de mil millones de dólares en IA, la mayor parte en -Departamentos de IA de la casa. [165] Una industria creció para apoyarlos, incluidas empresas de hardware como Symbolics y Lisp Machines y empresas de software como IntelliCorp y Aion . [166]

En 1981, el Ministerio japonés de Industria y Comercio Internacional reservó 850 millones de dólares para el proyecto de computadora de quinta generación . Sus objetivos eran escribir programas y construir máquinas que pudieran mantener conversaciones, traducir idiomas, interpretar imágenes y razonar como seres humanos. [167] Para disgusto de Scruffies , eligieron Prolog como el lenguaje informático principal para el proyecto. [168]

Otros países respondieron con nuevos programas propios. El Reino Unido inició el proyecto Alvey de £350 millones . Un consorcio de empresas estadounidenses formó la Microelectronics and Computer Technology Corporation (o "MCC") para financiar proyectos a gran escala en inteligencia artificial y tecnología de la información. [169] [170] DARPA también respondió, fundando la Strategic Computing Initiative y triplicando su inversión en IA entre 1984 y 1988. [171]

El poder de los sistemas expertos procedía del conocimiento experto que contenían. Formaban parte de una nueva dirección en la investigación de la IA que había ido ganando terreno a lo largo de los años 70. "Los investigadores de IA estaban empezando a sospechar (a regañadientes, porque violaba el canon científico de la parsimonia ) que la inteligencia bien podría basarse en la capacidad de utilizar grandes cantidades de conocimiento diverso de diferentes maneras", [172] escribe Pamela McCorduck . "[L]a gran lección de la década de 1970 fue que el comportamiento inteligente dependía en gran medida de abordar el conocimiento, a veces un conocimiento bastante detallado, de un dominio en el que se encontraba una tarea determinada". [173] Los sistemas basados en el conocimiento y la ingeniería del conocimiento se convirtieron en un foco importante de la investigación de la IA en la década de 1980. [174]

La década de 1980 también vio el nacimiento de Cyc , el primer intento de atacar directamente el problema del conocimiento del sentido común , mediante la creación de una base de datos masiva que contendría todos los hechos mundanos que conoce la persona promedio. Douglas Lenat , quien inició y dirigió el proyecto, argumentó que no hay atajos: la única manera que tienen las máquinas de conocer el significado de los conceptos humanos es enseñándolos, un concepto a la vez, a mano. No se esperaba que el proyecto estuviera terminado hasta dentro de muchas décadas. [175]

Los programas de ajedrez HiTech y Deep Thought derrotaron a los maestros del ajedrez en 1989. Ambos fueron desarrollados por la Universidad Carnegie Mellon ; El desarrollo de Deep Thought allanó el camino para Deep Blue . [176]

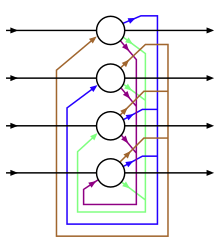

En 1982, el físico John Hopfield pudo demostrar que una forma de red neuronal (ahora llamada " red Hopfield ") podía aprender y procesar información, y probablemente converge después de un tiempo suficiente bajo cualquier condición fija. Fue un gran avance, ya que anteriormente se pensaba que las redes no lineales evolucionarían, en general, de forma caótica. [177] Casi al mismo tiempo, Geoffrey Hinton y David Rumelhart popularizaron un método para entrenar redes neuronales llamado " propagación hacia atrás ". [i] Estos dos descubrimientos ayudaron a reactivar la exploración de las redes neuronales artificiales . [170] [178]

Las redes neuronales, junto con varios otros modelos similares, recibieron amplia atención después de la publicación en 1986 de Parallel Distributed Processing , una colección de artículos en dos volúmenes editada por Rumelhart y el psicólogo James McClelland . El nuevo campo fue bautizado como conexionismo y hubo un considerable debate entre los defensores de la IA simbólica y los "conexionistas".

En 1990, Yann LeCun de Bell Labs utilizó redes neuronales convolucionales para reconocer dígitos escritos a mano. El sistema se utilizó ampliamente en los años 90, leyendo códigos postales y cheques personales. Esta fue la primera aplicación realmente útil de las redes neuronales. [179] [180]

Rodney Brooks , Hans Moravec y otros argumentaron que, para mostrar una inteligencia real, una máquina necesita tener un cuerpo : necesita percibir, moverse, sobrevivir y lidiar con el mundo. [181] Las habilidades sensoriomotoras son esenciales para habilidades de nivel superior, como el razonamiento de sentido común . No se pueden implementar de manera eficiente utilizando razonamiento simbólico abstracto, por lo que la IA debería resolver los problemas de percepción, movilidad, manipulación y supervivencia sin utilizar representación simbólica en absoluto. Estos investigadores de robótica abogaban por construir inteligencia "de abajo hacia arriba". [j]

Un precursor de esta idea fue David Marr , que había llegado al MIT a finales de los años 1970 procedente de una exitosa formación en neurociencia teórica para dirigir el grupo que estudiaba la visión . Rechazó todos los enfoques simbólicos ( tanto la lógica de McCarthy como los marcos de Minsky ), argumentando que la IA necesitaba comprender la maquinaria física de la visión de abajo hacia arriba antes de que tuviera lugar cualquier procesamiento simbólico. (El trabajo de Marr se vería truncado por la leucemia en 1980.) [183]

En su artículo de 1990 "Los elefantes no juegan al ajedrez", [184] el investigador en robótica Brooks apuntó directamente a la hipótesis del sistema de símbolos físicos , argumentando que los símbolos no siempre son necesarios ya que "el mundo es su mejor modelo. Siempre es exactamente actualizado. Siempre tiene todos los detalles que hay que conocer. El truco está en detectarlo de forma adecuada y con la suficiente frecuencia". [185]

En las décadas de 1980 y 1990, muchos científicos cognitivos también rechazaron el modelo de procesamiento de símbolos de la mente y argumentaron que el cuerpo era esencial para el razonamiento, una teoría llamada tesis de la mente encarnada . [186]

La fascinación de la comunidad empresarial por la IA aumentó y disminuyó en la década de 1980 siguiendo el patrón clásico de una burbuja económica . Cuando decenas de empresas fracasaron, la percepción en el mundo empresarial fue que la tecnología no era viable. [187] El daño a la reputación de la IA duraría hasta el siglo XXI. Dentro del campo había poco acuerdo sobre las razones por las que la IA no logró cumplir el sueño de una inteligencia a nivel humano que había capturado la imaginación del mundo en la década de 1960. En conjunto, todos estos factores ayudaron a fragmentar la IA en subcampos competitivos centrados en problemas o enfoques particulares, a veces incluso bajo nuevos nombres que disfrazaban el empañado pedigrí de "inteligencia artificial". [188]

Durante los siguientes 20 años, la IA proporcionó constantemente soluciones funcionales a problemas aislados específicos. A finales de la década de 1990, se utilizaba en toda la industria tecnológica, aunque de forma algo oculta. El éxito se debió al aumento de la potencia informática , a la colaboración con otros campos (como la optimización matemática y la estadística ) y al uso de los más altos estándares de responsabilidad científica. En el año 2000, la IA había logrado algunos de sus objetivos más antiguos. El campo fue más cauteloso y más exitoso que nunca.

El término " invierno de la IA " fue acuñado por investigadores que habían sobrevivido a los recortes de financiación de 1974 cuando les preocupaba que el entusiasmo por los sistemas expertos se hubiera salido de control y que sin duda vendría la decepción. [189] Sus temores estaban bien fundados: a finales de los años 1980 y principios de los años 1990, AI sufrió una serie de reveses financieros.

El primer indicio de un cambio en el clima fue el repentino colapso del mercado de hardware especializado en IA en 1987. Las computadoras de escritorio de Apple e IBM habían ido ganando velocidad y potencia de manera constante y en 1987 se volvieron más poderosas que las más caras máquinas Lisp fabricadas por Simbólicos y otros. Ya no había una buena razón para comprarlos. Toda una industria valorada en 500 millones de dólares fue demolida de la noche a la mañana. [190]

Con el tiempo, los primeros sistemas expertos exitosos, como XCON , resultaron demasiado caros de mantener. Eran difíciles de actualizar, no podían aprender, eran " frágiles " (es decir, podían cometer errores grotescos cuando se les daban entradas inusuales) y caían presa de problemas (como el problema de calificación ) que se habían identificado años antes. Los sistemas expertos resultaron útiles, pero sólo en unos pocos contextos especiales. [191]

A finales de la década de 1980, la Iniciativa de Computación Estratégica recortó "profunda y brutalmente" la financiación para la IA. El nuevo liderazgo en DARPA había decidido que la IA no era "la próxima ola" y dirigió fondos hacia proyectos que parecían tener más probabilidades de producir resultados inmediatos. [192]

En 1991, la impresionante lista de objetivos redactados en 1981 para el Proyecto de Quinta Generación de Japón no se había cumplido. De hecho, algunos de ellos, como "mantener una conversación informal", no se habían cumplido en 2010. [193] Al igual que con otros proyectos de IA, las expectativas habían sido mucho más altas de lo que era realmente posible. [193] [194]

A finales de 1993, más de 300 empresas de IA habían cerrado, quebrado o habían sido adquiridas, poniendo fin de hecho a la primera ola comercial de IA. [195] En 1994, HP Newquist declaró en The Brain Makers que "el futuro inmediato de la inteligencia artificial, en su forma comercial, parece depender en parte del éxito continuo de las redes neuronales". [195]

En la década de 1990, los algoritmos desarrollados originalmente por investigadores de IA comenzaron a aparecer como parte de sistemas más grandes. La IA había resuelto muchos problemas muy difíciles [196] y sus soluciones demostraron ser útiles en toda la industria tecnológica, [197] como minería de datos , robótica industrial , logística, [198] reconocimiento de voz , [199] software bancario, [ 200] diagnóstico médico [200] y motor de búsqueda de Google . [201]

El campo de la IA recibió poco o ningún crédito por estos éxitos en los años 1990 y principios de los 2000. Muchas de las mayores innovaciones de la IA han quedado reducidas a la categoría de un elemento más en el conjunto de herramientas de la informática. [202] Nick Bostrom explica: "Mucha IA de vanguardia se ha filtrado en aplicaciones generales, a menudo sin llamarse IA porque una vez que algo se vuelve lo suficientemente útil y común, ya no se etiqueta como IA". [203]

Muchos investigadores de IA en la década de 1990 llamaron deliberadamente a su trabajo con otros nombres, como informática , sistemas basados en el conocimiento , "sistemas cognitivos" o inteligencia computacional . Esto puede deberse en parte a que consideraban que su campo era fundamentalmente diferente de la IA, pero también los nuevos nombres ayudan a conseguir financiación. Al menos en el mundo comercial, las promesas fallidas de la IA Winter continuaron acechando la investigación de la IA hasta la década de 2000, como informó el New York Times en 2005: "Los científicos informáticos y los ingenieros de software evitaron el término inteligencia artificial por miedo a ser vistos como algo salvaje". -Soñadores de ojos." [204] [205] [206] [207]

El 11 de mayo de 1997, Deep Blue se convirtió en el primer sistema de juego de ajedrez por computadora en vencer al actual campeón mundial de ajedrez, Garry Kasparov . [208] La supercomputadora era una versión especializada de un marco producido por IBM y era capaz de procesar el doble de movimientos por segundo que durante el primer partido (que Deep Blue había perdido), supuestamente 200.000.000 de movimientos por segundo. [209]

En 2005, un robot de Stanford ganó el Gran Desafío DARPA conduciendo de forma autónoma durante 131 millas a lo largo de un sendero desértico no ensayado. [210] Dos años más tarde, un equipo de CMU ganó el DARPA Urban Challenge navegando de forma autónoma 55 millas en un entorno urbano mientras respondía a los peligros del tráfico y respetaba las leyes de tráfico. [211] En febrero de 2011, en Jeopardy! En el concurso de exhibición de concursos , el sistema de respuesta a preguntas de IBM , Watson , derrotó a los dos mejores Jeopardy! campeones, Brad Rutter y Ken Jennings , por un margen significativo. [212]

Estos éxitos no se debieron a algún nuevo paradigma revolucionario, sino principalmente a la tediosa aplicación de habilidades de ingeniería y al tremendo aumento de la velocidad y capacidad de las computadoras en los años 90. [213] De hecho, la computadora de Deep Blue era 10 millones de veces más rápida que el Ferranti Mark 1 que Christopher Strachey enseñó a jugar al ajedrez en 1951. [214] Este dramático aumento se mide mediante la ley de Moore , que predice que la velocidad y la capacidad de memoria de computadoras se duplica cada dos años, como resultado de que el número de transistores semiconductores de óxido metálico (MOS) se duplica cada dos años. Poco a poco se estaba superando el problema fundamental de la "potencia informática bruta".

Durante la década de 1990 se aceptó ampliamente un nuevo paradigma llamado " agentes inteligentes ". [215] Aunque investigadores anteriores habían propuesto enfoques modulares de "divide y vencerás" para la IA, [216] el agente inteligente no alcanzó su forma moderna hasta que Judea Pearl , Allen Newell , Leslie P. Kaelbling y otros trajeron conceptos de la teoría de la decisión y la economía en el estudio de la IA. [217] Cuando la definición del economista de un agente racional se unió a la definición de la informática de un objeto o módulo , el paradigma del agente inteligente estaba completo.

Un agente inteligente es un sistema que percibe su entorno y toma acciones que maximizan sus posibilidades de éxito. Según esta definición, los programas simples que resuelven problemas específicos son "agentes inteligentes", al igual que los seres humanos y las organizaciones de seres humanos, como las empresas . El paradigma de los agentes inteligentes define la investigación de la IA como "el estudio de agentes inteligentes". Ésta es una generalización de algunas definiciones anteriores de IA: va más allá del estudio de la inteligencia humana; estudia todo tipo de inteligencia. [218]

El paradigma dio a los investigadores licencia para estudiar problemas aislados y encontrar soluciones que fueran a la vez verificables y útiles. Proporcionó un lenguaje común para describir problemas y compartir sus soluciones entre sí y con otros campos que también usaban conceptos de agentes abstractos, como la economía y la teoría del control . Se esperaba que una arquitectura de agentes completa (como SOAR de Newell ) algún día permitiera a los investigadores construir sistemas más versátiles e inteligentes a partir de agentes inteligentes que interactúan . [217] [219]

Los investigadores de IA comenzaron a desarrollar y utilizar herramientas matemáticas sofisticadas más que nunca en el pasado. [220] Hubo una comprensión generalizada de que muchos de los problemas que la IA necesitaba resolver ya estaban siendo trabajados por investigadores en campos como matemáticas , ingeniería eléctrica , economía o investigación de operaciones . El lenguaje matemático compartido permitió tanto un mayor nivel de colaboración con campos más establecidos y exitosos como el logro de resultados que eran mensurables y demostrables; La IA se había convertido en una disciplina "científica" más rigurosa.

El influyente libro de Judea Pearl de 1988 [221] introdujo la teoría de la probabilidad y la decisión en la IA. Entre las muchas herramientas nuevas en uso se encuentran las redes bayesianas , los modelos ocultos de Markov , la teoría de la información , el modelado estocástico y la optimización clásica . También se desarrollaron descripciones matemáticas precisas para paradigmas de " inteligencia computacional " como redes neuronales y algoritmos evolutivos . [222]

En las primeras décadas del siglo XXI, el acceso a grandes cantidades de datos (conocidos como " big data "), computadoras más baratas y más rápidas y técnicas avanzadas de aprendizaje automático se aplicaron con éxito a muchos problemas en toda la economía. De hecho, McKinsey Global Institute estimó en su famoso artículo "Big data: La próxima frontera para la innovación, la competencia y la productividad" que "en 2009, casi todos los sectores de la economía estadounidense tenían al menos un promedio de 200 terabytes de datos almacenados". .

En 2016, el mercado de productos, hardware y software relacionados con la IA alcanzó más de 8 mil millones de dólares, y el New York Times informó que el interés en la IA había alcanzado un "frenesí". [223] Las aplicaciones de big data comenzaron a llegar también a otros campos, como modelos de entrenamiento en ecología [224] y para diversas aplicaciones en economía . [225] Los avances en el aprendizaje profundo (particularmente las redes neuronales convolucionales profundas y las redes neuronales recurrentes ) impulsaron el progreso y la investigación en el procesamiento de imágenes y videos, el análisis de texto e incluso el reconocimiento de voz. [226]

La primera Cumbre mundial sobre seguridad de la IA se celebró en Bletchley Park , Reino Unido, en noviembre de 2023 para debatir los riesgos a corto y largo plazo de la IA y la posibilidad de marcos regulatorios obligatorios y voluntarios. [227] Veintiocho países, incluidos Estados Unidos, China y la Unión Europea, emitieron una declaración al comienzo de la cumbre, pidiendo cooperación internacional para gestionar los desafíos y riesgos de la inteligencia artificial. [228] [229]

El aprendizaje profundo es una rama del aprendizaje automático que modela abstracciones de alto nivel en datos mediante el uso de un gráfico profundo con muchas capas de procesamiento. [226] Según el teorema de aproximación universal , la profundidad no es necesaria para que una red neuronal pueda aproximarse a funciones continuas arbitrarias. Aun así, hay muchos problemas que son comunes a las redes superficiales (como el sobreajuste ) que las redes profundas ayudan a evitar. [230] Como tal, las redes neuronales profundas son capaces de generar de manera realista modelos mucho más complejos en comparación con sus contrapartes superficiales.

Sin embargo, el aprendizaje profundo tiene sus propios problemas. Un problema común para las redes neuronales recurrentes es el problema del gradiente de fuga , que es donde los gradientes que pasan entre capas se reducen gradualmente y literalmente desaparecen a medida que se redondean a cero. Se han desarrollado muchos métodos para abordar este problema, como las unidades de memoria a corto plazo .

Las arquitecturas de redes neuronales profundas de última generación a veces pueden incluso rivalizar con la precisión humana en campos como la visión por computadora, específicamente en cosas como la base de datos del Instituto Nacional Modificado de Estándares y Tecnología (MNIST) y el reconocimiento de señales de tráfico. [231]

Los motores de procesamiento de lenguaje impulsados por motores de búsqueda inteligentes pueden vencer fácilmente a los humanos en la respuesta a preguntas de trivia generales (como IBM Watson ), y los desarrollos recientes en el aprendizaje profundo han producido resultados sorprendentes al competir con los humanos, específicamente en juegos como Go y Doom (que, al ser un juego de disparos en primera persona , ha generado cierta controversia). [232] [233] [234] [235]

Big data se refiere a una colección de datos que no pueden capturarse, administrarse ni procesarse mediante herramientas de software convencionales dentro de un período de tiempo determinado. Se trata de una enorme cantidad de capacidades de toma de decisiones, conocimiento y optimización de procesos que requieren nuevos modelos de procesamiento. En el libro "Big Data Era" de Victor Meyer Schonberg y Kenneth Cooke , big data significa que en lugar de un análisis aleatorio (encuesta de muestra), se utilizan todos los datos para el análisis. Las características "5V" del big data, propuestas por IBM, son: Volumen , Velocidad , Variedad , [236] Valor , [237] Veracidad . [238]

La importancia estratégica de la tecnología de big data no es dominar una gran cantidad de información de datos, sino especializarse en datos significativos. En otras palabras, si se compara el big data con una industria, la clave para lograr rentabilidad en esta industria es aumentar la " capacidad de procesamiento " de los datos y obtener el " valor agregado " de los datos mediante el " procesamiento ".

El auge de la IA comenzó con el desarrollo inicial de arquitecturas y algoritmos clave, como la arquitectura transformadora , en 2017, lo que llevó a la ampliación y el desarrollo de grandes modelos de lenguaje que exhiben rasgos de razonamiento, cognición, atención y creatividad similares a los humanos. Se dice que la nueva era de la IA comenzó alrededor de 2022-2023, con el lanzamiento público de modelos de lenguajes grandes (LLM) escalados como ChatGPT . [239] [240] [241] [242] [243]

En 2017, los investigadores de Google propusieron la arquitectura del transformador . Explota un mecanismo de atención y luego se utilizó ampliamente en grandes modelos de lenguaje. [244]

Los modelos básicos , que son grandes modelos de lenguaje entrenados con grandes cantidades de datos sin etiquetar que pueden adaptarse a una amplia gama de tareas posteriores, comenzaron a desarrollarse en 2018.

Modelos como GPT-3 lanzado por OpenAI en 2020 y Gato lanzado por DeepMind en 2022 se han descrito como logros importantes del aprendizaje automático .

En 2023, Microsoft Research probó el modelo de lenguaje grande GPT-4 con una gran variedad de tareas y concluyó que "podría verse razonablemente como una versión temprana (aunque aún incompleta) de un sistema de inteligencia artificial general (AGI)". [245]