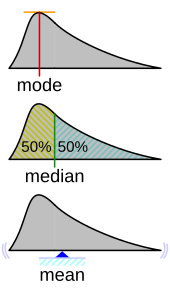

La mediana de un conjunto de números es el valor que separa la mitad superior de la mitad inferior de una muestra de datos , una población o una distribución de probabilidad . Para un conjunto de datos , puede considerarse como el valor "medio". La característica básica de la mediana al describir los datos en comparación con la media (a menudo descrita simplemente como el "promedio") es que no está sesgada por una pequeña proporción de valores extremadamente grandes o pequeños y, por lo tanto, proporciona una mejor representación del centro. La mediana de ingresos , por ejemplo, puede ser una mejor manera de describir el centro de la distribución de ingresos porque los aumentos en los ingresos más altos por sí solos no tienen efecto sobre la mediana. Por esta razón, la mediana es de importancia central en las estadísticas robustas .

La mediana de una lista finita de números es el número "medio", cuando esos números se enumeran en orden del más pequeño al más grande.

Si el conjunto de datos tiene un número impar de observaciones, se selecciona la del medio (después de ordenarlas en orden ascendente). Por ejemplo, la siguiente lista de siete números:

tiene una mediana de 6 , que es el cuarto valor.

Si el conjunto de datos tiene un número par de observaciones, no hay un valor medio definido y la mediana suele definirse como la media aritmética de los dos valores medios. [1] [2] Por ejemplo, este conjunto de datos de 8 números

tiene un valor medio de 4,5 , es decir (en términos más técnicos, esto interpreta la mediana como el rango medio completamente recortado ).

En general, con esta convención, la mediana se puede definir de la siguiente manera: Para un conjunto de datos de elementos, ordenados del menor al mayor,

Formalmente, la mediana de una población es cualquier valor tal que al menos la mitad de la población sea menor o igual a la mediana propuesta y al menos la mitad sea mayor o igual a la mediana propuesta. Como se vio anteriormente, las medianas pueden no ser únicas. Si cada conjunto contiene más de la mitad de la población, entonces una parte de la población es exactamente igual a la mediana única.

La mediana está bien definida para cualquier dato ordenado (unidimensional) y es independiente de cualquier métrica de distancia . Por lo tanto, la mediana se puede aplicar a clases escolares que están clasificadas pero no son numéricas (por ejemplo, calcular una calificación mediana cuando las calificaciones de los exámenes de los estudiantes se califican de F a A), aunque el resultado podría estar a medio camino entre las clases si hay un número par de clases. (Para las clases con números impares, se determina una clase específica como la mediana).

Por otra parte, una mediana geométrica se define en cualquier número de dimensiones. Un concepto relacionado, en el que el resultado se ve obligado a corresponder a un miembro de la muestra, es el medoide .

No existe una notación estándar ampliamente aceptada para la mediana, pero algunos autores representan la mediana de una variable x como med( x ), x͂ , [3] como μ 1/2 , [1] o como M . [3] [4] En cualquiera de estos casos, el uso de estos u otros símbolos para la mediana debe definirse explícitamente cuando se introducen.

La mediana es un caso especial de otras formas de resumir los valores típicos asociados con una distribución estadística : es el segundo cuartil , el quinto decil y el percentil 50 .

La mediana se puede utilizar como medida de ubicación cuando se concede poca importancia a los valores extremos, normalmente porque una distribución está sesgada , los valores extremos no se conocen o los valores atípicos no son confiables, es decir, pueden ser errores de medición o transcripción.

Por ejemplo, considere el multiconjunto

En este caso, la mediana es 2, al igual que la moda , y podría considerarse una mejor indicación del centro que la media aritmética de 4, que es mayor que todos los valores menos uno. Sin embargo, la relación empírica ampliamente citada de que la media se desplaza "más hacia la cola" de una distribución que la mediana no es generalmente cierta. Como máximo, se puede decir que las dos estadísticas no pueden estar "demasiado alejadas"; véase § Desigualdad que relaciona medias y medianas más abajo. [5]

Como la mediana se basa en los datos intermedios de un conjunto, no es necesario conocer el valor de los resultados extremos para calcularla. Por ejemplo, en una prueba de psicología que investiga el tiempo necesario para resolver un problema, si un pequeño número de personas no logra resolverlo en absoluto en el tiempo dado, aún se puede calcular una mediana. [6]

Debido a que la mediana es fácil de entender y calcular, y además es una aproximación robusta a la media , la mediana es una estadística de resumen popular en las estadísticas descriptivas . En este contexto, existen varias opciones para medir la variabilidad : el rango , el rango intercuartil , la desviación absoluta media y la desviación absoluta mediana .

Para fines prácticos, las diferentes medidas de localización y dispersión se comparan a menudo sobre la base de lo bien que se pueden estimar los valores poblacionales correspondientes a partir de una muestra de datos. La mediana, estimada utilizando la mediana de la muestra, tiene buenas propiedades en este sentido. Si bien no suele ser óptima si se supone una distribución poblacional dada, sus propiedades siempre son razonablemente buenas. Por ejemplo, una comparación de la eficiencia de los estimadores candidatos muestra que la media de la muestra es estadísticamente más eficiente cuando, y solo cuando, los datos no están contaminados por datos de distribuciones de cola pesada o de mezclas de distribuciones. [ cita requerida ] Incluso entonces, la mediana tiene una eficiencia del 64% en comparación con la media de varianza mínima (para muestras normales grandes), lo que significa que la varianza de la mediana será ~50% mayor que la varianza de la media. [7] [8]

Para cualquier distribución de probabilidad de valor real con función de distribución acumulativa F , una mediana se define como cualquier número real m que satisface las desigualdades (cf. el dibujo en la definición de valor esperado para variables aleatorias arbitrarias de valor real ). Una redacción equivalente utiliza una variable aleatoria X distribuida según F :

Nótese que esta definición no requiere que X tenga una distribución absolutamente continua (que tiene una función de densidad de probabilidad f ), ni requiere una discreta . En el primer caso, las desigualdades se pueden actualizar a igualdad: una mediana satisface y

Cualquier distribución de probabilidad en el conjunto de números reales tiene al menos una mediana, pero en casos patológicos puede haber más de una mediana: si F es constante 1/2 en un intervalo (de modo que f = 0 allí), entonces cualquier valor de ese intervalo es una mediana.

Las medianas de ciertos tipos de distribuciones se pueden calcular fácilmente a partir de sus parámetros; además, existen incluso para algunas distribuciones que carecen de una media bien definida, como la distribución de Cauchy :

El error absoluto medio de una variable real c con respecto a la variable aleatoria X es

Siempre que la distribución de probabilidad de X sea tal que exista la expectativa anterior, entonces m es una mediana de X si y solo si m es un minimizador del error absoluto medio con respecto a X. [11] En particular, si m es una mediana de muestra , entonces minimiza la media aritmética de las desviaciones absolutas. [12] Nótese, sin embargo, que en los casos donde la muestra contiene un número par de elementos, este minimizador no es único.

De manera más general, una mediana se define como un mínimo de

como se analiza más adelante en la sección sobre medianas multivariadas (específicamente, la mediana espacial ).

Esta definición de la mediana basada en la optimización es útil en el análisis de datos estadísticos, por ejemplo, en la agrupación de k -medianas .

Si la distribución tiene varianza finita, entonces la distancia entre la mediana y la media está limitada por una desviación estándar .

Este límite fue demostrado por Book y Sher en 1979 para muestras discretas, [13] y de manera más general por Page y Murty en 1982. [14] En un comentario sobre una prueba posterior de O'Cinneide, [15] Mallows en 1991 presentó una prueba compacta que utiliza la desigualdad de Jensen dos veces, [16] de la siguiente manera. Usando |·| para el valor absoluto , tenemos

La primera y la tercera desigualdad provienen de la desigualdad de Jensen aplicada a la función de valor absoluto y a la función al cuadrado, que son ambas convexas. La segunda desigualdad proviene del hecho de que la mediana minimiza la función de desviación absoluta .

La prueba de Mallows se puede generalizar para obtener una versión multivariada de la desigualdad [17] simplemente reemplazando el valor absoluto con una norma :

donde m es una mediana espacial , es decir, un minimizador de la función La mediana espacial es única cuando la dimensión del conjunto de datos es dos o más. [18] [19]

Una prueba alternativa utiliza la desigualdad unilateral de Chebyshev; aparece en una desigualdad sobre los parámetros de escala y ubicación . Esta fórmula también se deduce directamente de la desigualdad de Cantelli . [20]

Para el caso de distribuciones unimodales , se puede lograr un límite más preciso en la distancia entre la mediana y la media:

Una relación similar existe entre la mediana y la moda:

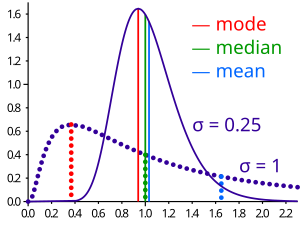

Una heurística típica es que las distribuciones sesgadas positivamente tienen media > mediana. Esto es cierto para todos los miembros de la familia de distribuciones de Pearson . Sin embargo, esto no siempre es cierto. Por ejemplo, la familia de distribuciones de Weibull tiene miembros con media positiva, pero media < mediana. Las violaciones de la regla son particularmente comunes para distribuciones discretas. Por ejemplo, cualquier distribución de Poisson tiene sesgo positivo, pero su media < mediana siempre que . [22] Ver [23] para un esbozo de prueba.

Cuando la distribución tiene una densidad de probabilidad monótonamente decreciente, entonces la mediana es menor que la media, como se muestra en la figura.

La desigualdad de Jensen establece que para cualquier variable aleatoria X con una expectativa finita E [ X ] y para cualquier función convexa f

Esta desigualdad se generaliza también a la mediana. Decimos que una función f : R → R es una función C si, para cualquier t ,

es un intervalo cerrado (permitiendo los casos degenerados de un único punto o un conjunto vacío ). Toda función convexa es una función C, pero lo inverso no se cumple. Si f es una función C, entonces

Si las medianas no son únicas, la afirmación es válida para la suprema correspondiente. [24]

Aunque la ordenación por comparación de n elementos requiere Ω ( n log n ) operaciones, los algoritmos de selección pueden calcular el k -ésimo más pequeño de n elementos con solo Θ( n ) operaciones. Esto incluye la mediana, que es la norte/2estadística de orden n (o para un número par de muestras, la media aritmética de las dos estadísticas de orden medio). [25]

Los algoritmos de selección aún tienen la desventaja de requerir Ω( n ) de memoria, es decir, necesitan tener la muestra completa (o una porción de tamaño lineal de ella) en la memoria. Debido a que esto, así como el requisito de tiempo lineal, puede ser prohibitivo, se han desarrollado varios procedimientos de estimación para la mediana. Uno simple es la regla de la mediana de tres, que estima la mediana como la mediana de una submuestra de tres elementos; esto se usa comúnmente como una subrutina en el algoritmo de ordenamiento quicksort , que usa una estimación de la mediana de su entrada. Un estimador más robusto es el noveno de Tukey , que es la regla de la mediana de tres aplicada con recursión limitada: [26] si A es la muestra dispuesta como una matriz , y

entonces

El remedian es un estimador de la mediana que requiere tiempo lineal pero memoria sublineal, operando en una sola pasada sobre la muestra. [27]

Las distribuciones tanto de la media de la muestra como de la mediana de la muestra se determinaron mediante Laplace . [28] La distribución de la mediana de la muestra de una población con una función de densidad es asintóticamente normal con media y varianza [29]

donde es la mediana de y es el tamaño de la muestra:

A continuación se presenta una demostración moderna. El resultado de Laplace se entiende ahora como un caso especial de la distribución asintótica de cuantiles arbitrarios .

Para muestras normales, la densidad es , por lo tanto, para muestras grandes la varianza de la mediana es igual a [7] (ver también la sección #Eficiencia a continuación).

Suponemos que el tamaño de la muestra es un número impar y que nuestra variable es continua; la fórmula para el caso de variables discretas se proporciona a continuación en § Densidad local empírica. La muestra se puede resumir como "por debajo de la mediana", "en la mediana" y "por encima de la mediana", lo que corresponde a una distribución trinomial con probabilidades , y . Para una variable continua, la probabilidad de que varios valores de la muestra sean exactamente iguales a la mediana es 0, por lo que se puede calcular la densidad de en el punto directamente a partir de la distribución trinomial:

Ahora presentamos la función beta. Para argumentos enteros y , esto se puede expresar como . Además, recuerde que . El uso de estas relaciones y la configuración de y iguales a permite que la última expresión se escriba como

Por lo tanto, la función de densidad de la mediana es una distribución beta simétrica impulsada hacia adelante por . Su media, como esperaríamos, es 0,5 y su varianza es . Por la regla de la cadena , la varianza correspondiente de la mediana de la muestra es

El 2 adicional es despreciable en el límite .

En la práctica, las funciones y anteriores no suelen conocerse ni suponerse. Sin embargo, se pueden estimar a partir de una distribución de frecuencias observada. En esta sección, ofrecemos un ejemplo. Considere la siguiente tabla, que representa una muestra de 3800 observaciones (de valor discreto):

Como las observaciones tienen valores discretos, construir la distribución exacta de la mediana no es una traducción inmediata de la expresión anterior para ; uno puede (y normalmente lo hace) tener múltiples instancias de la mediana en su muestra. Por lo tanto, debemos sumar todas estas posibilidades:

Aquí, i es el número de puntos estrictamente menores que la mediana y k el número estrictamente mayor.

Con estos datos preliminares, es posible investigar el efecto del tamaño de la muestra sobre los errores estándar de la media y la mediana. La media observada es 3,16, la mediana bruta observada es 3 y la mediana interpolada observada es 3,174. La siguiente tabla ofrece algunas estadísticas de comparación.

El valor esperado de la mediana disminuye ligeramente a medida que aumenta el tamaño de la muestra, mientras que, como cabría esperar, los errores estándar tanto de la mediana como de la media son proporcionales a la raíz cuadrada inversa del tamaño de la muestra. La aproximación asintótica es demasiado cautelosa al sobreestimar el error estándar.

Varios autores han estudiado el valor de —el valor asintótico de donde es la mediana de la población—. El método estándar de " eliminar uno" produce resultados inconsistentes . [30] Se ha demostrado que una alternativa —el método de "eliminar k"— donde crece con el tamaño de la muestra es asintóticamente consistente. [31] Este método puede ser computacionalmente costoso para grandes conjuntos de datos. Se sabe que una estimación bootstrap es consistente, [32] pero converge muy lentamente ( orden de ). [33] Se han propuesto otros métodos pero su comportamiento puede diferir entre muestras grandes y pequeñas. [34]

La eficiencia de la mediana de la muestra, medida como la relación entre la varianza de la media y la varianza de la mediana, depende del tamaño de la muestra y de la distribución de la población subyacente. Para una muestra de tamaño de distribución normal , la eficiencia para un N grande es

La eficiencia tiende a medida que tiende a infinito.

En otras palabras, la varianza relativa de la mediana será , o 57% mayor que la varianza de la media – el error estándar relativo de la mediana será , o 25% mayor que el error estándar de la media , (ver también la sección #Distribución de muestreo arriba). [35]

Para distribuciones univariadas que son simétricas respecto de una mediana, el estimador de Hodges-Lehmann es un estimador robusto y altamente eficiente de la mediana de la población. [36]

Si los datos se representan mediante un modelo estadístico que especifica una familia particular de distribuciones de probabilidad , entonces se pueden obtener estimaciones de la mediana ajustando esa familia de distribuciones de probabilidad a los datos y calculando la mediana teórica de la distribución ajustada. La interpolación de Pareto es una aplicación de esto cuando se supone que la población tiene una distribución de Pareto .

Anteriormente, en este artículo se habló de la mediana univariante, cuando la muestra o población tenía una dimensión. Cuando la dimensión es dos o más, hay múltiples conceptos que amplían la definición de la mediana univariante; cada una de esas medianas multivariantes concuerda con la mediana univariante cuando la dimensión es exactamente una. [36] [37] [38] [39]

La mediana marginal se define para vectores definidos con respecto a un conjunto fijo de coordenadas. Una mediana marginal se define como el vector cuyos componentes son medianas univariadas. La mediana marginal es fácil de calcular y sus propiedades fueron estudiadas por Puri y Sen. [36] [40]

La mediana geométrica de un conjunto discreto de puntos de muestra en un espacio euclidiano es el punto [a] que minimiza la suma de las distancias a los puntos de muestra.

A diferencia de la mediana marginal, la mediana geométrica es equivariante con respecto a las transformaciones de similitud euclidiana, como las traslaciones y las rotaciones .

Si las medianas marginales de todos los sistemas de coordenadas coinciden, entonces su ubicación común puede denominarse "mediana en todas las direcciones". [42] Este concepto es relevante para la teoría de la votación debido al teorema del votante mediano . Cuando existe, la mediana en todas las direcciones coincide con la mediana geométrica (al menos para distribuciones discretas).

La mediana condicional se da en el contexto en el que buscamos estimar una variable aleatoria a partir de una variable aleatoria , que es una versión ruidosa de . La mediana condicional en este contexto está dada por

donde es la inversa de la función de distribución acumulativa condicional (es decir, la función cuantil condicional) de . Por ejemplo, un modelo popular es donde es la normal estándar independiente de . La mediana condicional es el estimador bayesiano óptimo:

Se sabe que para el modelo donde es normal estándar independiente de , el estimador es lineal si y sólo si es gaussiano. [43]

Cuando se trabaja con una variable discreta, a veces es útil considerar los valores observados como puntos medios de intervalos continuos subyacentes. Un ejemplo de esto es una escala de Likert , en la que se expresan opiniones o preferencias en una escala con un número determinado de respuestas posibles. Si la escala consta de números enteros positivos, una observación de 3 podría considerarse como la representación del intervalo de 2,50 a 3,50. Es posible estimar la mediana de la variable subyacente. Si, por ejemplo, el 22% de las observaciones tienen un valor de 2 o inferior y el 55,0% tienen un valor de 3 o inferior (por lo que el 33% tiene el valor 3), entonces la mediana es 3, ya que la mediana es el valor más pequeño de para el cual es mayor que la mitad. Pero la mediana interpolada está en algún lugar entre 2,50 y 3,50. Primero sumamos la mitad del ancho del intervalo a la mediana para obtener el límite superior del intervalo de la mediana. Luego restamos esa proporción del ancho del intervalo que es igual a la proporción del 33% que se encuentra por encima de la marca del 50%. En otras palabras, dividimos el ancho del intervalo en proporción a la cantidad de observaciones. En este caso, el 33% se divide en un 28% por debajo de la mediana y un 5% por encima de ella, por lo que restamos 5/33 del ancho del intervalo del límite superior de 3,50 para obtener una mediana interpolada de 3,35. Más formalmente, si se conocen los valores, la mediana interpolada se puede calcular a partir de

Alternativamente, si en una muestra observada hay puntuaciones por encima de la categoría mediana, puntuaciones en ella y puntuaciones por debajo de ella, entonces la mediana interpolada se da por

Para distribuciones univariadas que son simétricas respecto de una mediana, el estimador de Hodges-Lehmann es un estimador robusto y altamente eficiente de la mediana poblacional; para distribuciones no simétricas, el estimador de Hodges-Lehmann es un estimador robusto y altamente eficiente de la pseudomediana poblacional , que es la mediana de una distribución simetrizada y que está cerca de la mediana poblacional. [44] El estimador de Hodges-Lehmann se ha generalizado a distribuciones multivariadas. [45]

El estimador de Theil-Sen es un método de regresión lineal robusta basado en la búsqueda de medianas de pendientes . [46]

El filtro mediano es una herramienta importante de procesamiento de imágenes , que puede eliminar eficazmente cualquier ruido de sal y pimienta de las imágenes en escala de grises .

En el análisis de conglomerados , el algoritmo de agrupamiento de k-medianas proporciona una forma de definir conglomerados, en la que el criterio de maximizar la distancia entre las medias de los conglomerados que se utiliza en el agrupamiento de k-medias se reemplaza por la maximización de la distancia entre las medianas de los conglomerados.

Este es un método de regresión robusta. La idea se remonta a Wald en 1940, quien sugirió dividir un conjunto de datos bivariados en dos mitades dependiendo del valor del parámetro independiente : una mitad izquierda con valores menores que la mediana y una mitad derecha con valores mayores que la mediana. [47] Sugirió tomar las medias de las variables dependientes e independientes de las mitades izquierda y derecha y estimar la pendiente de la línea que une estos dos puntos. La línea podría luego ajustarse para adaptarse a la mayoría de los puntos en el conjunto de datos.

En 1942, Nair y Shrivastava sugirieron una idea similar, pero en su lugar propusieron dividir la muestra en tres partes iguales antes de calcular las medias de las submuestras. [48] En 1951, Brown y Mood propusieron la idea de utilizar las medianas de dos submuestras en lugar de las medias. [49] Tukey combinó estas ideas y recomendó dividir la muestra en tres submuestras de igual tamaño y estimar la línea basándose en las medianas de las submuestras. [50]

Cualquier estimador insesgado a la media minimiza el riesgo ( pérdida esperada ) con respecto a la función de pérdida por error al cuadrado , como observó Gauss . Un estimador insesgado a la mediana minimiza el riesgo con respecto a la función de pérdida por desviación absoluta , como observó Laplace . Otras funciones de pérdida se utilizan en la teoría estadística , particularmente en la estadística robusta .

La teoría de los estimadores medianamente imparciales fue revivida por George W. Brown en 1947: [51]

Se dirá que una estimación de un parámetro unidimensional θ es insesgada respecto de la mediana si, para un valor θ fijo, la mediana de la distribución de la estimación se encuentra en el valor θ; es decir, la estimación subestima con la misma frecuencia con la que sobreestima. Este requisito parece cumplir, para la mayoría de los propósitos, tanto como el requisito de insesgada respecto de la media y tiene la propiedad adicional de que es invariante ante una transformación uno a uno.

— página 584

Se han informado otras propiedades de los estimadores medianamente imparciales. [52] [53] [54] [55]

Existen métodos para construir estimadores insesgados a la mediana que son óptimos (en un sentido análogo a la propiedad de varianza mínima para estimadores insesgados a la media). Tales construcciones existen para distribuciones de probabilidad que tienen funciones de verosimilitud monótonas . [56] [57] Uno de estos procedimientos es un análogo del procedimiento de Rao-Blackwell para estimadores insesgados a la media: el procedimiento se aplica a una clase más pequeña de distribuciones de probabilidad que el procedimiento de Rao-Blackwell, pero a una clase más grande de funciones de pérdida . [58]

Parece que los investigadores científicos del antiguo Oriente Próximo no utilizaron estadísticas resumidas en su totalidad, sino que eligieron valores que ofrecían la máxima coherencia con una teoría más amplia que integraba una amplia variedad de fenómenos. [59] En la comunidad académica mediterránea (y, más tarde, europea), las estadísticas como la media son fundamentalmente un desarrollo medieval y moderno temprano. (La historia de la mediana fuera de Europa y sus predecesoras sigue siendo relativamente poco estudiada.)

La idea de la mediana apareció en el siglo VI en el Talmud , con el fin de analizar de manera justa las valoraciones divergentes . [60] [61] Sin embargo, el concepto no se extendió a la comunidad científica más amplia.

En cambio, el antepasado más cercano de la mediana moderna es el rango medio , inventado por Al-Biruni [62] : 31 [63] La transmisión de su trabajo a los eruditos posteriores no está clara. Aplicó su técnica para ensayar metales monetarios, pero, después de publicar su trabajo, la mayoría de los ensayadores todavía adoptaban el valor más desfavorable de sus resultados, para que no parecieran hacer trampa . [62] : 35–8 [64] Sin embargo, el aumento de la navegación en el mar durante la Era de los Descubrimientos significó que los navegantes de los barcos tenían que intentar cada vez más determinar la latitud en condiciones meteorológicas desfavorables contra costas hostiles, lo que llevó a un renovado interés en las estadísticas resumidas. Ya sea redescubierto o inventado independientemente, el rango medio se recomienda a los navegantes náuticos en "Instrucciones para el viaje de Raleigh a Guayana, 1595" de Harriot. [62] : 45–8

La idea de la mediana puede haber aparecido por primera vez en el libro de Edward Wright de 1599 Certaine Errors in Navigation en una sección sobre navegación con brújula . [65] Wright era reacio a descartar valores medidos, y puede haber sentido que la mediana, que incorpora una mayor proporción del conjunto de datos que el rango medio , tenía más probabilidades de ser correcta. Sin embargo, Wright no dio ejemplos del uso de su técnica, lo que dificulta verificar que describiera la noción moderna de mediana. [59] [63] [b] La mediana (en el contexto de la probabilidad) ciertamente apareció en la correspondencia de Christiaan Huygens , pero como un ejemplo de una estadística que era inapropiada para la práctica actuarial . [59]

La primera recomendación de la mediana data de 1757, cuando Roger Joseph Boscovich desarrolló un método de regresión basado en la norma L 1 y, por lo tanto, implícitamente en la mediana. [59] [66] En 1774, Laplace hizo explícito este deseo: sugirió que la mediana se utilizara como el estimador estándar del valor de una PDF posterior . El criterio específico era minimizar la magnitud esperada del error; donde es la estimación y es el valor verdadero. Con este fin, Laplace determinó las distribuciones tanto de la media de la muestra como de la mediana de la muestra a principios del siglo XIX. [28] [67] Sin embargo, una década después, Gauss y Legendre desarrollaron el método de mínimos cuadrados , que minimiza para obtener la media; la fuerte justificación de este estimador por referencia a la estimación de máxima verosimilitud basada en una distribución normal significa que ha reemplazado en gran medida la sugerencia original de Laplace. [68]

Antoine Augustin Cournot en 1843 fue el primero [69] en utilizar el término mediana ( valeur médiane ) para el valor que divide una distribución de probabilidad en dos mitades iguales. Gustav Theodor Fechner utilizó la mediana ( Centralwerth ) en fenómenos sociológicos y psicológicos. [70] Anteriormente se había utilizado solo en astronomía y campos relacionados. Gustav Fechner popularizó la mediana en el análisis formal de datos, aunque había sido utilizada previamente por Laplace, [70] y la mediana apareció en un libro de texto de FY Edgeworth . [71] Francis Galton utilizó el término mediana en 1881, [72] [73] habiendo utilizado anteriormente los términos valor más intermedio en 1869, y medio en 1880. [74] [75]

{{cite journal}}: CS1 maint: DOI inactive as of November 2024 (link)Este artículo incorpora material de Median de una distribución en PlanetMath , que está licenciada bajo la Licencia Creative Commons Atribución/Compartir-Igual .