En teoría de probabilidad y campos relacionados, un proceso estocástico ( / s t ə ˈ k æ s t ɪ k / ) o aleatorio es un objeto matemático generalmente definido como una familia de variables aleatorias en un espacio de probabilidad , donde el índice de la familia a menudo tiene la interpretación del tiempo . Los procesos estocásticos se utilizan ampliamente como modelos matemáticos de sistemas y fenómenos que parecen variar de manera aleatoria. Los ejemplos incluyen el crecimiento de una población bacteriana , una corriente eléctrica que fluctúa debido al ruido térmico o el movimiento de una molécula de gas . [1] [4] [5] Los procesos estocásticos tienen aplicaciones en muchas disciplinas como biología , [6] química , [7] ecología , [8] neurociencia , [9] física , [10] procesamiento de imágenes , procesamiento de señales , [11] teoría de control , [12] teoría de la información , [13] informática , [14] y telecomunicaciones . [15] Además, los cambios aparentemente aleatorios en los mercados financieros han motivado el uso extensivo de procesos estocásticos en finanzas . [16] [17] [18]

Las aplicaciones y el estudio de los fenómenos han inspirado a su vez la propuesta de nuevos procesos estocásticos. Ejemplos de tales procesos estocásticos incluyen el proceso de Wiener o proceso de movimiento browniano, [a] utilizado por Louis Bachelier para estudiar los cambios de precios en la Bolsa de París , [21] y el proceso de Poisson , utilizado por AK Erlang para estudiar el número de llamadas telefónicas que se producen en un determinado período de tiempo. [22] Estos dos procesos estocásticos se consideran los más importantes y centrales en la teoría de los procesos estocásticos, [1] [4] [23] y fueron inventados repetidamente e independientemente, tanto antes como después de Bachelier y Erlang, en diferentes entornos y países. [21] [24]

El término función aleatoria también se utiliza para referirse a un proceso estocástico o aleatorio, [25] [26] porque un proceso estocástico también puede interpretarse como un elemento aleatorio en un espacio de funciones . [27] [28] Los términos proceso estocástico y proceso aleatorio se utilizan indistintamente, a menudo sin un espacio matemático específico para el conjunto que indexa las variables aleatorias. [27] [29] Pero a menudo estos dos términos se utilizan cuando las variables aleatorias están indexadas por los números enteros o un intervalo de la línea real . [5] [29] Si las variables aleatorias están indexadas por el plano cartesiano o algún espacio euclidiano de dimensión superior , entonces la colección de variables aleatorias generalmente se denomina campo aleatorio . [5] [30] Los valores de un proceso estocástico no siempre son números y pueden ser vectores u otros objetos matemáticos. [5] [28]

Con base en sus propiedades matemáticas, los procesos estocásticos se pueden agrupar en varias categorías, que incluyen caminatas aleatorias , [31] martingalas , [32] procesos de Markov , [33] procesos de Lévy , [34] procesos gaussianos , [35] campos aleatorios, [36] procesos de renovación y procesos de ramificación . [37] El estudio de los procesos estocásticos utiliza conocimientos matemáticos y técnicas de probabilidad , cálculo , álgebra lineal , teoría de conjuntos y topología [38] [39] [40] así como ramas del análisis matemático como análisis real , teoría de la medida , análisis de Fourier y análisis funcional . [41] [42] [43] La teoría de los procesos estocásticos se considera una contribución importante a las matemáticas [44] y continúa siendo un tema activo de investigación tanto por razones teóricas como por aplicaciones. [45] [46] [47]

Un proceso estocástico o aleatorio puede definirse como una colección de variables aleatorias que está indexada por algún conjunto matemático, lo que significa que cada variable aleatoria del proceso estocástico está asociada de forma única con un elemento del conjunto. [4] [5] El conjunto utilizado para indexar las variables aleatorias se denomina conjunto índice . Históricamente, el conjunto índice era algún subconjunto de la línea real , como los números naturales , lo que le daba al conjunto índice la interpretación del tiempo. [1] Cada variable aleatoria en la colección toma valores del mismo espacio matemático conocido como espacio de estados . Este espacio de estados puede ser, por ejemplo, los números enteros, la línea real o el espacio euclidiano dimensional. [1] [5] Un incremento es la cantidad que cambia un proceso estocástico entre dos valores de índice, a menudo interpretados como dos puntos en el tiempo. [48] [49] Un proceso estocástico puede tener muchos resultados , debido a su aleatoriedad, y un solo resultado de un proceso estocástico se denomina, entre otros nombres, función de muestra o realización . [28] [50]

Un proceso estocástico se puede clasificar de diferentes maneras, por ejemplo, por su espacio de estados, su conjunto de índices o la dependencia entre las variables aleatorias. Una forma común de clasificación es por la cardinalidad del conjunto de índices y el espacio de estados. [51] [52] [53]

Cuando se interpreta como tiempo, si el conjunto de índices de un proceso estocástico tiene un número finito o contable de elementos, como un conjunto finito de números, el conjunto de números enteros o los números naturales, entonces se dice que el proceso estocástico está en tiempo discreto . [54] [55] Si el conjunto de índices es algún intervalo de la línea real, entonces se dice que el tiempo es continuo . Los dos tipos de procesos estocásticos se denominan respectivamente procesos estocásticos de tiempo discreto y de tiempo continuo . [48] [56] [57] Los procesos estocásticos de tiempo discreto se consideran más fáciles de estudiar porque los procesos de tiempo continuo requieren técnicas y conocimientos matemáticos más avanzados, en particular debido a que el conjunto de índices es incontable. [58] [59] Si el conjunto de índices son los números enteros, o algún subconjunto de ellos, entonces el proceso estocástico también puede llamarse una secuencia aleatoria . [55]

Si el espacio de estados son los números enteros o naturales, entonces el proceso estocástico se denomina proceso estocástico discreto o de valor entero . Si el espacio de estados es la línea real, entonces el proceso estocástico se denomina proceso estocástico de valor real o proceso con espacio de estados continuo . Si el espacio de estados es un espacio euclidiano de dimensión -, entonces el proceso estocástico se denomina proceso vectorial de dimensión - o proceso vectorial de dimensión - . [51] [52]

La palabra estocástico en inglés se usó originalmente como adjetivo con la definición "relativo a la conjetura", y se deriva de una palabra griega que significa "apuntar a un blanco, adivinar", y el Oxford English Dictionary da el año 1662 como su aparición más temprana. [60] En su trabajo sobre probabilidad Ars Conjectandi , publicado originalmente en latín en 1713, Jakob Bernoulli usó la frase "Ars Conjectandi sive Stochastice", que se ha traducido como "el arte de conjeturar o estocástica". [61] Esta frase fue utilizada, con referencia a Bernoulli, por Ladislaus Bortkiewicz [62] quien en 1917 escribió en alemán la palabra stochastik con un sentido que significa aleatorio. El término proceso estocástico apareció por primera vez en inglés en un artículo de 1934 de Joseph Doob . [60] Para el término y una definición matemática específica, Doob citó otro artículo de 1934, donde el término stochastischer Prozeß fue utilizado en alemán por Aleksandr Khinchin , [63] [64] aunque el término alemán había sido utilizado antes, por ejemplo, por Andrei Kolmogorov en 1931. [65]

Según el Oxford English Dictionary, las primeras apariciones de la palabra random en inglés con su significado actual, que se relaciona con el azar o la suerte, se remontan al siglo XVI, mientras que los usos registrados más tempranos comenzaron en el siglo XIV como un sustantivo que significa "impetuosidad, gran velocidad, fuerza o violencia (al montar, correr, golpear, etc.)". La palabra en sí proviene de una palabra del francés medio que significa "velocidad, prisa", y probablemente se deriva de un verbo francés que significa "correr" o "galopar". La primera aparición escrita del término random process es anterior a stochastic process , que el Oxford English Dictionary también da como sinónimo, y fue utilizado en un artículo de Francis Edgeworth publicado en 1888. [66]

La definición de un proceso estocástico varía, [67] pero un proceso estocástico se define tradicionalmente como una colección de variables aleatorias indexadas por algún conjunto. [68] [69] Los términos proceso aleatorio y proceso estocástico se consideran sinónimos y se usan indistintamente, sin que se especifique con precisión el conjunto índice. [27] [29] [30] [70] [71] [72] Se utilizan tanto "colección", [28] [70] como "familia" [4] [73] mientras que en lugar de "conjunto índice", a veces se utilizan los términos "conjunto de parámetros" [28] o "espacio de parámetros" [30] .

El término función aleatoria también se utiliza para referirse a un proceso estocástico o aleatorio, [5] [74] [75] aunque a veces sólo se utiliza cuando el proceso estocástico toma valores reales. [28] [73] Este término también se utiliza cuando los conjuntos de índices son espacios matemáticos distintos de la línea real, [5] [76] mientras que los términos proceso estocástico y proceso aleatorio se utilizan habitualmente cuando el conjunto de índices se interpreta como tiempo, [5] [76] [77] y se utilizan otros términos como campo aleatorio cuando el conjunto de índices es un espacio euclidiano -dimensional o una variedad . [5] [28] [30]

Un proceso estocástico puede denotarse, entre otras formas, por , [56] , [69] [78] o simplemente como . Algunos autores escriben erróneamente aunque es un abuso de la notación de funciones . [79] Por ejemplo, o se utilizan para referirse a la variable aleatoria con el índice , y no a todo el proceso estocástico. [78] Si el conjunto de índices es , entonces se puede escribir, por ejemplo, para denotar el proceso estocástico. [29]

Uno de los procesos estocásticos más simples es el proceso de Bernoulli , [80] que es una secuencia de variables aleatorias independientes e idénticamente distribuidas (iid), donde cada variable aleatoria toma el valor uno o cero, digamos uno con probabilidad y cero con probabilidad . Este proceso se puede vincular a una idealización de lanzar repetidamente una moneda, donde la probabilidad de obtener cara se toma como y su valor es uno, mientras que el valor de cruz es cero. [81] En otras palabras, un proceso de Bernoulli es una secuencia de variables aleatorias de Bernoulli iid, [82] donde cada lanzamiento de moneda idealizado es un ejemplo de un ensayo de Bernoulli . [83]

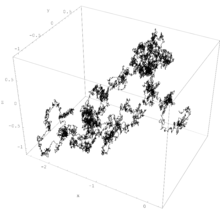

Los paseos aleatorios son procesos estocásticos que se definen habitualmente como sumas de variables aleatorias iid o vectores aleatorios en el espacio euclidiano, por lo que son procesos que cambian en tiempo discreto. [84] [85] [86] [87] [88] Pero algunos también utilizan el término para referirse a procesos que cambian en tiempo continuo, [89] en particular el proceso de Wiener utilizado en modelos financieros, lo que ha llevado a cierta confusión, resultando en su crítica. [90] Hay varios otros tipos de paseos aleatorios, definidos de modo que sus espacios de estados pueden ser otros objetos matemáticos, como redes y grupos, y en general son muy estudiados y tienen muchas aplicaciones en diferentes disciplinas. [89] [91]

Un ejemplo clásico de un paseo aleatorio se conoce como el paseo aleatorio simple , que es un proceso estocástico en tiempo discreto con los números enteros como espacio de estados, y se basa en un proceso de Bernoulli, donde cada variable de Bernoulli toma el valor positivo o negativo. En otras palabras, el paseo aleatorio simple tiene lugar en los números enteros, y su valor aumenta en uno con probabilidad, digamos, , o disminuye en uno con probabilidad , por lo que el conjunto de índices de este paseo aleatorio son los números naturales, mientras que su espacio de estados son los números enteros. Si , este paseo aleatorio se llama paseo aleatorio simétrico. [92] [93]

El proceso de Wiener es un proceso estocástico con incrementos estacionarios e independientes que se distribuyen normalmente en función del tamaño de los incrementos. [2] [94] El proceso de Wiener recibe su nombre de Norbert Wiener , quien demostró su existencia matemática, pero el proceso también se denomina proceso de movimiento browniano o simplemente movimiento browniano debido a su conexión histórica como modelo para el movimiento browniano en líquidos. [95] [96] [97]

El proceso de Wiener, que desempeña un papel central en la teoría de la probabilidad, se considera a menudo el proceso estocástico más importante y estudiado, con conexiones con otros procesos estocásticos. [1] [2] [3] [98] [ 99] [100] [101] Su conjunto de índices y espacio de estados son los números no negativos y los números reales, respectivamente, por lo que tiene un conjunto de índices y un espacio de estados continuos. [102] Pero el proceso se puede definir de forma más general, de modo que su espacio de estados puede ser un espacio euclidiano bidimensional. [91] [99] [103] Si la media de cualquier incremento es cero, se dice que el proceso de movimiento browniano o de Wiener resultante tiene una deriva cero. Si la media del incremento para dos puntos cualesquiera en el tiempo es igual a la diferencia de tiempo multiplicada por alguna constante , que es un número real, se dice que el proceso estocástico resultante tiene una deriva . [104] [105] [106]

Casi con toda seguridad , una trayectoria de muestra de un proceso de Wiener es continua en todas partes pero en ninguna es diferenciable . Puede considerarse como una versión continua del paseo aleatorio simple. [49] [105] El proceso surge como el límite matemático de otros procesos estocásticos como ciertos paseos aleatorios reescalados, [107] [108] que es el tema del teorema de Donsker o principio de invariancia, también conocido como el teorema del límite central funcional. [109] [110] [111]

El proceso de Wiener es miembro de algunas familias importantes de procesos estocásticos, incluidos los procesos de Markov, los procesos de Lévy y los procesos gaussianos. [2] [49] El proceso también tiene muchas aplicaciones y es el principal proceso estocástico utilizado en el cálculo estocástico. [112] [113] Desempeña un papel central en las finanzas cuantitativas, [114] [115] donde se utiliza, por ejemplo, en el modelo Black–Scholes–Merton. [116] El proceso también se utiliza en diferentes campos, incluida la mayoría de las ciencias naturales, así como algunas ramas de las ciencias sociales, como un modelo matemático para varios fenómenos aleatorios. [3] [117] [118]

El proceso de Poisson es un proceso estocástico que tiene diferentes formas y definiciones. [119] [120] Se puede definir como un proceso de conteo, el cual es un proceso estocástico que representa el número aleatorio de puntos o eventos hasta un tiempo determinado. El número de puntos del proceso que se encuentran en el intervalo de cero a un tiempo determinado es una variable aleatoria de Poisson que depende de ese tiempo y de algún parámetro. Este proceso tiene como espacio de estados a los números naturales y como conjunto de índices a los números no negativos. Este proceso también se denomina proceso de conteo de Poisson, ya que se puede interpretar como un ejemplo de proceso de conteo. [119]

Si un proceso de Poisson se define con una única constante positiva, entonces el proceso se denomina proceso de Poisson homogéneo. [119] [121] El proceso de Poisson homogéneo es miembro de clases importantes de procesos estocásticos como los procesos de Markov y los procesos de Lévy. [49]

El proceso homogéneo de Poisson se puede definir y generalizar de diferentes maneras. Se puede definir de modo que su conjunto de índices sea la línea real, y este proceso estocástico también se denomina proceso de Poisson estacionario. [122] [123] Si la constante de parámetro del proceso de Poisson se reemplaza por alguna función integrable no negativa de , el proceso resultante se denomina proceso de Poisson no homogéneo o no homogéneo, donde la densidad promedio de puntos del proceso ya no es constante. [124] El proceso de Poisson, que sirve como un proceso fundamental en la teoría de colas, es un proceso importante para los modelos matemáticos, donde encuentra aplicaciones para modelos de eventos que ocurren aleatoriamente en ciertas ventanas de tiempo. [125] [126]

Definido en la línea real, el proceso de Poisson puede interpretarse como un proceso estocástico, [49] [127] entre otros objetos aleatorios. [128] [129] Pero luego puede definirse en el espacio euclidiano dimensional u otros espacios matemáticos, [130] donde a menudo se interpreta como un conjunto aleatorio o una medida de conteo aleatoria, en lugar de un proceso estocástico. [128] [129] En este contexto, el proceso de Poisson, también llamado proceso puntual de Poisson, es uno de los objetos más importantes en la teoría de la probabilidad, tanto por sus aplicaciones como por razones teóricas. [22] [131] Pero se ha observado que el proceso de Poisson no recibe tanta atención como debería, en parte debido a que a menudo se lo considera solo en la línea real, y no en otros espacios matemáticos. [131] [132]

Un proceso estocástico se define como una colección de variables aleatorias definidas en un espacio de probabilidad común , donde es un espacio muestral , es un -álgebra y es una medida de probabilidad ; y las variables aleatorias, indexadas por algún conjunto , toman todas valores en el mismo espacio matemático , que debe ser medible con respecto a algún -álgebra . [28]

En otras palabras, para un espacio de probabilidad dado y un espacio medible , un proceso estocástico es una colección de variables aleatorias con valores , que se pueden escribir como: [80]

Históricamente, en muchos problemas de las ciencias naturales un punto tenía el significado de tiempo, por lo que es una variable aleatoria que representa un valor observado en el tiempo . [133] Un proceso estocástico también se puede escribir para reflejar que en realidad es una función de dos variables, y . [28] [134]

Hay otras formas de considerar un proceso estocástico, siendo la definición anterior la tradicional. [68] [69] Por ejemplo, un proceso estocástico puede interpretarse o definirse como una variable aleatoria con valor , donde es el espacio de todas las funciones posibles del conjunto en el espacio . [27] [68] Sin embargo, esta definición alternativa como una "variable aleatoria con valor de función" en general requiere que se definan bien supuestos de regularidad adicionales. [135]

El conjunto se denomina conjunto índice [4] [51] o conjunto de parámetros [28] [136] del proceso estocástico. A menudo, este conjunto es algún subconjunto de la recta real , como los números naturales o un intervalo, lo que da al conjunto la interpretación del tiempo. [1] Además de estos conjuntos, el conjunto índice puede ser otro conjunto con un orden total o un conjunto más general, [1] [54] como el plano cartesiano o el espacio euclidiano en -dimensional, donde un elemento puede representar un punto en el espacio. [48] [137] Dicho esto, muchos resultados y teoremas solo son posibles para procesos estocásticos con un conjunto índice totalmente ordenado. [138]

El espacio matemático de un proceso estocástico se denomina espacio de estados . Este espacio matemático se puede definir utilizando números enteros , líneas reales , espacios euclidianos de dos dimensiones , planos complejos o espacios matemáticos más abstractos. El espacio de estados se define utilizando elementos que reflejan los diferentes valores que puede tomar el proceso estocástico. [1] [5] [28] [51] [56]

Una función de muestra es un resultado único de un proceso estocástico, por lo que se forma tomando un único valor posible de cada variable aleatoria del proceso estocástico. [28] [139] Más precisamente, si es un proceso estocástico, entonces para cualquier punto , la función de mapeo

se llama una función de muestra, una realización o, particularmente cuando se interpreta como tiempo, una trayectoria de muestra del proceso estocástico . [50] Esto significa que para un fijo , existe una función de muestra que asigna el conjunto de índices al espacio de estados . [28] Otros nombres para una función de muestra de un proceso estocástico incluyen trayectoria , función de trayectoria [140] o trayectoria . [141]

Un incremento de un proceso estocástico es la diferencia entre dos variables aleatorias del mismo proceso estocástico. Para un proceso estocástico con un conjunto de índices que se puede interpretar como tiempo, un incremento es cuánto cambia el proceso estocástico durante un cierto período de tiempo. Por ejemplo, si es un proceso estocástico con espacio de estados e índice establecido , entonces para dos números no negativos cualesquiera y tales que , la diferencia es una variable aleatoria de valor conocido como incremento. [48] [49] Cuando se está interesado en los incrementos, a menudo el espacio de estados es la línea real o los números naturales, pero puede ser un espacio euclidiano de dimensión dimensional o espacios más abstractos como los espacios de Banach . [49]

Para un proceso estocástico definido en el espacio de probabilidad , la ley del proceso estocástico se define como la medida de la imagen :

donde es una medida de probabilidad, el símbolo denota la composición de la función y es la preimagen de la función medible o, equivalentemente, la variable aleatoria de valor , donde es el espacio de todas las posibles funciones de valor , por lo que la ley de un proceso estocástico es una medida de probabilidad. [27] [68] [142] [143]

Para un subconjunto medible de , la preimagen de da

Por lo tanto, la ley de a se puede escribir como: [28]

La ley de un proceso estocástico o de una variable aleatoria también se denomina ley de probabilidad , distribución de probabilidad o distribución . [133] [142] [144] [145] [146]

Para un proceso estocástico con ley , su distribución de dimensión finita para se define como:

Esta medida es la distribución conjunta del vector aleatorio ; puede verse como una "proyección" de la ley sobre un subconjunto finito de . [27] [147]

Para cualquier subconjunto medible de la potencia cartesiana de pliegues , las distribuciones de dimensión finita de un proceso estocástico se pueden escribir como: [28]

Las distribuciones de dimensión finita de un proceso estocástico satisfacen dos condiciones matemáticas conocidas como condiciones de consistencia. [57]

La estacionariedad es una propiedad matemática que tiene un proceso estocástico cuando todas las variables aleatorias de ese proceso estocástico están distribuidas de manera idéntica. En otras palabras, si es un proceso estocástico estacionario, entonces para cualquier variable aleatoria tiene la misma distribución, lo que significa que para cualquier conjunto de valores del conjunto de índices , las variables aleatorias correspondientes

Todos tienen la misma distribución de probabilidad . El conjunto de índices de un proceso estocástico estacionario se interpreta generalmente como tiempo, por lo que pueden ser los números enteros o la línea real. [148] [149] Pero el concepto de estacionariedad también existe para procesos puntuales y campos aleatorios, donde el conjunto de índices no se interpreta como tiempo. [148] [150] [151]

Cuando el conjunto de índices puede interpretarse como tiempo, se dice que un proceso estocástico es estacionario si sus distribuciones de dimensión finita son invariantes bajo traslaciones de tiempo. Este tipo de proceso estocástico se puede utilizar para describir un sistema físico que está en estado estable, pero que aún experimenta fluctuaciones aleatorias. [148] La intuición detrás de la estacionariedad es que a medida que pasa el tiempo, la distribución del proceso estocástico estacionario permanece igual. [152] Una secuencia de variables aleatorias forma un proceso estocástico estacionario solo si las variables aleatorias están distribuidas de manera idéntica. [148]

A veces se dice que un proceso estocástico con la definición anterior de estacionariedad es estrictamente estacionario, pero existen otras formas de estacionariedad. Un ejemplo es cuando se dice que un proceso estocástico de tiempo discreto o de tiempo continuo es estacionario en el sentido amplio, entonces el proceso tiene un segundo momento finito para todos y la covarianza de las dos variables aleatorias y depende solo del número para todos . [152] [153] Khinchin introdujo el concepto relacionado de estacionariedad en el sentido amplio , que tiene otros nombres que incluyen estacionariedad de covarianza o estacionariedad en el sentido amplio . [153] [154]

Una filtración es una secuencia creciente de álgebras sigma definidas en relación con algún espacio de probabilidad y un conjunto de índices que tiene alguna relación de orden total , como en el caso del conjunto de índices que es algún subconjunto de los números reales. Más formalmente, si un proceso estocástico tiene un conjunto de índices con un orden total, entonces una filtración , en un espacio de probabilidad es una familia de álgebras sigma tales que para todo , donde y denota el orden total del conjunto de índices . [51] Con el concepto de una filtración, es posible estudiar la cantidad de información contenida en un proceso estocástico en , que puede interpretarse como tiempo . [51] [155] La intuición detrás de una filtración es que a medida que pasa el tiempo, se conoce o está disponible cada vez más información sobre , que se captura en , lo que resulta en particiones cada vez más finas de . [156] [157]

Una modificación de un proceso estocástico es otro proceso estocástico, que está estrechamente relacionado con el proceso estocástico original. Más precisamente, un proceso estocástico que tiene el mismo conjunto de índices , espacio de estados y espacio de probabilidad que otro proceso estocástico se dice que es una modificación de if para todos los siguientes

se cumple. Dos procesos estocásticos que son modificaciones entre sí tienen la misma ley de dimensión finita [158] y se dice que son estocásticamente equivalentes o equivalentes . [159]

En lugar de modificación, también se utiliza el término versión , [150] [160] [161] [162] sin embargo algunos autores utilizan el término versión cuando dos procesos estocásticos tienen las mismas distribuciones de dimensión finita, pero pueden estar definidos en diferentes espacios de probabilidad, por lo que dos procesos que son modificaciones entre sí, también son versiones entre sí, en el último sentido, pero no a la inversa. [163] [142]

Si un proceso estocástico de valor real en tiempo continuo cumple ciertas condiciones de momento en sus incrementos, entonces el teorema de continuidad de Kolmogorov dice que existe una modificación de este proceso que tiene trayectorias de muestra continuas con probabilidad uno, por lo que el proceso estocástico tiene una modificación o versión continua. [161] [162] [164] El teorema también se puede generalizar a campos aleatorios de modo que el conjunto de índices sea un espacio euclidiano de dimensión 1 [165] así como a procesos estocásticos con espacios métricos como sus espacios de estado. [166]

Se dice que dos procesos estocásticos definidos en el mismo espacio de probabilidad con el mismo conjunto de índices y espacio de conjuntos son indistinguibles si se cumple lo siguiente:

se cumple. [142] [158] Si dos y son modificaciones entre sí y son casi seguramente continuas , entonces y son indistinguibles. [167]

La separabilidad es una propiedad de un proceso estocástico basada en su conjunto de índices en relación con la medida de probabilidad. La propiedad se supone de modo que los funcionales de los procesos estocásticos o los campos aleatorios con conjuntos de índices incontables puedan formar variables aleatorias. Para que un proceso estocástico sea separable, además de otras condiciones, su conjunto de índices debe ser un espacio separable , [b] lo que significa que el conjunto de índices tiene un subconjunto denso contable. [150] [168]

Más precisamente, un proceso estocástico de tiempo continuo de valor real con un espacio de probabilidad es separable si su conjunto de índices tiene un subconjunto contable denso y hay un conjunto de probabilidad cero, por lo que , tal que para cada conjunto abierto y cada conjunto cerrado , los dos eventos y difieren entre sí como máximo en un subconjunto de . [169] [170] [171] La definición de separabilidad [c] también se puede establecer para otros conjuntos de índices y espacios de estados, [174] como en el caso de campos aleatorios, donde el conjunto de índices así como el espacio de estados pueden ser un espacio euclidiano -dimensional. [30] [150]

El concepto de separabilidad de un proceso estocástico fue introducido por Joseph Doob ,. [168] La idea subyacente de la separabilidad es hacer que un conjunto contable de puntos del conjunto de índices determine las propiedades del proceso estocástico. [172] Cualquier proceso estocástico con un conjunto de índices contables ya cumple las condiciones de separabilidad, por lo que los procesos estocásticos de tiempo discreto siempre son separables. [175] Un teorema de Doob, a veces conocido como teorema de separabilidad de Doob, dice que cualquier proceso estocástico de tiempo continuo de valor real tiene una modificación separable. [168] [170] [176] También existen versiones de este teorema para procesos estocásticos más generales con conjuntos de índices y espacios de estados distintos de la línea real. [136]

Se dice que dos procesos estocásticos y definidos en el mismo espacio de probabilidad con el mismo conjunto de índices son independientes si para todas y cada una de las elecciones de épocas , los vectores aleatorios y son independientes. [177] : p. 515

Dos procesos estocásticos y se denominan no correlacionados si su covarianza cruzada es cero para todos los tiempos. [178] : p. 142 Formalmente:

Si dos procesos estocásticos son independientes, entonces tampoco están correlacionados. [178] : p. 151

Dos procesos estocásticos y se denominan ortogonales si su correlación cruzada es cero para todos los tiempos. [178] : p. 142 Formalmente:

Un espacio de Skorokhod , también escrito como espacio de Skorohod , es un espacio matemático de todas las funciones que son continuas por la derecha con límites por la izquierda, definidas en algún intervalo de la línea real como o , y toman valores en la línea real o en algún espacio métrico. [179] [180] [181] Estas funciones se conocen como funciones càdlàg o cadlag, basadas en el acrónimo de la frase francesa continue à droite, limite à gauche . [179] [182] Un espacio de funciones de Skorokhod, introducido por Anatoliy Skorokhod , [181] a menudo se denota con la letra , [179] [180] [181] [182] por lo que el espacio de funciones también se conoce como espacio . [179] [183] [184] La notación de este espacio funcional también puede incluir el intervalo en el que se definen todas las funciones càdlàg, así, por ejemplo, denota el espacio de funciones càdlàg definidas en el intervalo unitario . [182] [184] [185]

Los espacios de funciones de Skorokhod se utilizan con frecuencia en la teoría de procesos estocásticos porque a menudo se supone que las funciones de muestra de los procesos estocásticos de tiempo continuo pertenecen a un espacio de Skorokhod. [181] [183] Dichos espacios contienen funciones continuas, que corresponden a funciones de muestra del proceso de Wiener. Pero el espacio también tiene funciones con discontinuidades, lo que significa que las funciones de muestra de los procesos estocásticos con saltos, como el proceso de Poisson (en la línea real), también son miembros de este espacio. [184] [186]

En el contexto de la construcción matemática de procesos estocásticos, el término regularidad se utiliza cuando se discuten y asumen ciertas condiciones para un proceso estocástico para resolver posibles problemas de construcción. [187] [188] Por ejemplo, para estudiar procesos estocásticos con conjuntos de índices incontables, se asume que el proceso estocástico se adhiere a algún tipo de condición de regularidad, como que las funciones de muestra sean continuas. [189] [190]

Los procesos de Markov son procesos estocásticos, tradicionalmente en tiempo discreto o continuo , que tienen la propiedad de Markov, lo que significa que el siguiente valor del proceso de Markov depende del valor actual, pero es condicionalmente independiente de los valores anteriores del proceso estocástico. En otras palabras, el comportamiento del proceso en el futuro es estocásticamente independiente de su comportamiento en el pasado, dado el estado actual del proceso. [191] [192]

El proceso de movimiento browniano y el proceso de Poisson (en una dimensión) son ambos ejemplos de procesos de Markov [193] en tiempo continuo, mientras que los paseos aleatorios en los números enteros y el problema de la ruina del jugador son ejemplos de procesos de Markov en tiempo discreto. [194] [195]

Una cadena de Markov es un tipo de proceso de Markov que tiene un espacio de estados discreto o un conjunto de índices discretos (que a menudo representan el tiempo), pero la definición precisa de una cadena de Markov varía. [196] Por ejemplo, es común definir una cadena de Markov como un proceso de Markov en tiempo discreto o continuo con un espacio de estados contable (por lo tanto, independientemente de la naturaleza del tiempo), [197] [198] [199] [200] pero también ha sido común definir una cadena de Markov como que tiene tiempo discreto en un espacio de estados contable o continuo (por lo tanto, independientemente del espacio de estados). [196] Se ha argumentado que la primera definición de una cadena de Markov, donde tiene tiempo discreto, ahora tiende a usarse, a pesar de que la segunda definición ha sido utilizada por investigadores como Joseph Doob y Kai Lai Chung . [201]

Los procesos de Markov forman una clase importante de procesos estocásticos y tienen aplicaciones en muchas áreas. [39] [202] Por ejemplo, son la base de un método de simulación estocástica general conocido como Monte Carlo de cadena de Markov , que se utiliza para simular objetos aleatorios con distribuciones de probabilidad específicas, y ha encontrado aplicación en las estadísticas bayesianas . [203] [204]

El concepto de la propiedad de Markov fue originalmente para procesos estocásticos en tiempo continuo y discreto, pero la propiedad ha sido adaptada para otros conjuntos de índices como el espacio euclidiano bidimensional, lo que da como resultado colecciones de variables aleatorias conocidas como campos aleatorios de Markov. [205] [206] [207]

Una martingala es un proceso estocástico de tiempo discreto o de tiempo continuo con la propiedad de que, en cada instante, dado el valor actual y todos los valores pasados del proceso, la expectativa condicional de cada valor futuro es igual al valor actual. En tiempo discreto, si esta propiedad se cumple para el siguiente valor, se cumple para todos los valores futuros. La definición matemática exacta de una martingala requiere otras dos condiciones acopladas al concepto matemático de una filtración, que está relacionada con la intuición de aumentar la información disponible a medida que pasa el tiempo. Las martingalas se definen generalmente como de valor real, [208] [209] [155] pero también pueden ser de valor complejo [210] o incluso más generales. [211]

Un paseo aleatorio simétrico y un proceso de Wiener (con deriva cero) son ambos ejemplos de martingalas, respectivamente, en tiempo discreto y continuo. [208] [209] Para una secuencia de variables aleatorias independientes e idénticamente distribuidas con media cero, el proceso estocástico formado a partir de las sumas parciales sucesivas es una martingala de tiempo discreto. [212] En este aspecto, las martingalas de tiempo discreto generalizan la idea de sumas parciales de variables aleatorias independientes. [213]

Las martingalas también pueden crearse a partir de procesos estocásticos aplicando algunas transformaciones adecuadas, que es el caso del proceso de Poisson homogéneo (en la línea real) que da como resultado una martingala llamada proceso de Poisson compensado . [209] Las martingalas también pueden construirse a partir de otras martingalas. [212] Por ejemplo, existen martingalas basadas en la martingala del proceso de Wiener, que forman martingalas de tiempo continuo. [208] [214]

Las martingalas formalizan matemáticamente la idea de un "juego justo" en el que es posible formar expectativas razonables para los pagos, [215] y se desarrollaron originalmente para mostrar que no es posible obtener una ventaja "injusta" en tal juego. [216] Pero ahora se utilizan en muchas áreas de probabilidad, lo que es una de las principales razones para estudiarlas. [155] [216] [217] Muchos problemas de probabilidad se han resuelto encontrando una martingala en el problema y estudiándola. [218] Las martingalas convergerán, dadas algunas condiciones en sus momentos, por lo que a menudo se utilizan para derivar resultados de convergencia, debido en gran medida a los teoremas de convergencia de martingalas . [213] [219] [220]

Las martingalas tienen muchas aplicaciones en estadística, pero se ha observado que su uso y aplicación no están tan extendidos como podrían estarlo en el campo de la estadística, particularmente en la inferencia estadística. [221] Se han encontrado aplicaciones en áreas de la teoría de la probabilidad como la teoría de colas y el cálculo de Palm [222] y otros campos como la economía [223] y las finanzas. [17]

Los procesos de Lévy son tipos de procesos estocásticos que pueden considerarse como generalizaciones de paseos aleatorios en tiempo continuo. [49] [224] Estos procesos tienen muchas aplicaciones en campos como las finanzas, la mecánica de fluidos, la física y la biología. [225] [226] Las principales características definitorias de estos procesos son sus propiedades de estacionariedad e independencia, por lo que se les conocía como procesos con incrementos estacionarios e independientes . En otras palabras, un proceso estocástico es un proceso de Lévy si para números no negativos, , los incrementos correspondientes

son todos independientes entre sí, y la distribución de cada incremento sólo depende de la diferencia de tiempo. [49]

Un proceso de Lévy puede definirse de modo que su espacio de estados sea un espacio matemático abstracto, como un espacio de Banach , pero los procesos a menudo se definen de modo que tomen valores en el espacio euclidiano. El conjunto de índices son los números no negativos, por lo que , que proporciona la interpretación del tiempo. Los procesos estocásticos importantes, como el proceso de Wiener, el proceso homogéneo de Poisson (en una dimensión) y los subordinadores , son todos procesos de Lévy. [49] [224]

Un campo aleatorio es una colección de variables aleatorias indexadas por un espacio euclidiano de dimensión 1 o alguna variedad. En general, un campo aleatorio puede considerarse un ejemplo de un proceso estocástico o aleatorio, donde el conjunto de índices no es necesariamente un subconjunto de la línea real. [30] Pero existe una convención según la cual una colección indexada de variables aleatorias se denomina campo aleatorio cuando el índice tiene dos o más dimensiones. [5] [28] [227] Si la definición específica de un proceso estocástico requiere que el conjunto de índices sea un subconjunto de la línea real, entonces el campo aleatorio puede considerarse como una generalización del proceso estocástico. [228]

Un proceso puntual es una colección de puntos ubicados aleatoriamente en algún espacio matemático como la línea real, el espacio euclidiano de dimensión 1 o espacios más abstractos. A veces no se prefiere el término proceso puntual , ya que históricamente la palabra proceso denota una evolución de algún sistema en el tiempo, por lo que un proceso puntual también se denomina campo de puntos aleatorios . [229] Existen diferentes interpretaciones de un proceso puntual, como una medida de conteo aleatoria o un conjunto aleatorio. [230] [231] Algunos autores consideran que un proceso puntual y un proceso estocástico son dos objetos diferentes, de modo que un proceso puntual es un objeto aleatorio que surge de un proceso estocástico o está asociado con él, [232] [233] aunque se ha señalado que la diferencia entre procesos puntuales y procesos estocásticos no está clara. [233]

Otros autores consideran un proceso puntual como un proceso estocástico, donde el proceso está indexado por conjuntos del espacio subyacente [d] en el que está definido, como la línea real o el espacio euclidiano -dimensional. [236] [237] Otros procesos estocásticos como los procesos de renovación y conteo se estudian en la teoría de procesos puntuales. [238] [233]

La teoría de la probabilidad tiene sus orígenes en los juegos de azar, que tienen una larga historia, con algunos juegos que se jugaban hace miles de años, [239] pero se realizó muy poco análisis sobre ellos en términos de probabilidad. [240] El año 1654 a menudo se considera el nacimiento de la teoría de la probabilidad cuando los matemáticos franceses Pierre Fermat y Blaise Pascal tuvieron una correspondencia escrita sobre probabilidad, motivada por un problema de juego . [241] [242] Pero hubo un trabajo matemático anterior realizado sobre la probabilidad de los juegos de azar, como Liber de Ludo Aleae de Gerolamo Cardano , escrito en el siglo XVI pero publicado póstumamente más tarde en 1663. [243]

Después de Cardano, Jakob Bernoulli [e] escribió Ars Conjectandi , que se considera un evento significativo en la historia de la teoría de la probabilidad. El libro de Bernoulli fue publicado, también póstumamente, en 1713 e inspiró a muchos matemáticos a estudiar la probabilidad. [245] [246] Pero a pesar de que algunos matemáticos de renombre contribuyeron a la teoría de la probabilidad, como Pierre-Simon Laplace , Abraham de Moivre , Carl Gauss , Siméon Poisson y Pafnuty Chebyshev , [247] [248] la mayor parte de la comunidad matemática [f] no consideró que la teoría de la probabilidad fuera parte de las matemáticas hasta el siglo XX. [247] [249] [250] [251]

En las ciencias físicas, los científicos desarrollaron en el siglo XIX la disciplina de la mecánica estadística , donde los sistemas físicos, como los contenedores llenos de gases, se consideran o tratan matemáticamente como colecciones de muchas partículas en movimiento. Aunque hubo intentos de incorporar la aleatoriedad en la física estadística por parte de algunos científicos, como Rudolf Clausius , la mayor parte del trabajo tenía poca o ninguna aleatoriedad. [252] [253] Esto cambió en 1859 cuando James Clerk Maxwell contribuyó significativamente al campo, más específicamente, a la teoría cinética de los gases, al presentar un trabajo en el que modeló las partículas de gas como moviéndose en direcciones aleatorias a velocidades aleatorias. [254] [255] La teoría cinética de los gases y la física estadística continuaron desarrollándose en la segunda mitad del siglo XIX, con trabajos realizados principalmente por Clausius, Ludwig Boltzmann y Josiah Gibbs , que más tarde tendrían una influencia en el modelo matemático de Albert Einstein para el movimiento browniano . [256]

En el Congreso Internacional de Matemáticos de París en 1900, David Hilbert presentó una lista de problemas matemáticos , donde su sexto problema pedía un tratamiento matemático de la física y la probabilidad involucrando axiomas . [248] A principios del siglo XX, los matemáticos desarrollaron la teoría de la medida, una rama de las matemáticas para estudiar integrales de funciones matemáticas, donde dos de los fundadores fueron los matemáticos franceses Henri Lebesgue y Émile Borel . En 1925, otro matemático francés, Paul Lévy, publicó el primer libro de probabilidad que utilizó ideas de la teoría de la medida. [248]

En la década de 1920, matemáticos como Sergei Bernstein , Aleksandr Khinchin , [g] y Andrei Kolmogorov hicieron contribuciones fundamentales a la teoría de la probabilidad en la Unión Soviética . [251] Kolmogorov publicó en 1929 su primer intento de presentar una base matemática, basada en la teoría de la medida, para la teoría de la probabilidad. [257] A principios de la década de 1930, Khinchin y Kolmogorov organizaron seminarios de probabilidad, a los que asistieron investigadores como Eugene Slutsky y Nikolai Smirnov , [258] y Khinchin dio la primera definición matemática de un proceso estocástico como un conjunto de variables aleatorias indexadas por la línea real. [63] [259] [h]

En 1933, Andrei Kolmogorov publicó en alemán su libro sobre los fundamentos de la teoría de la probabilidad titulado Grundbegriffe der Wahrscheinlichkeitsrechnung [i] , en el que Kolmogorov utilizó la teoría de la medida para desarrollar un marco axiomático para la teoría de la probabilidad. La publicación de este libro se considera hoy en día como el nacimiento de la teoría de la probabilidad moderna, cuando las teorías de la probabilidad y los procesos estocásticos pasaron a formar parte de las matemáticas. [248] [251]

Después de la publicación del libro de Kolmogorov, Khinchin y Kolmogorov, así como otros matemáticos como Joseph Doob , William Feller , Maurice Fréchet , Paul Lévy , Wolfgang Doeblin y Harald Cramér , realizaron trabajos fundamentales adicionales sobre la teoría de la probabilidad y los procesos estocásticos. [248] [251] Décadas más tarde, Cramér se refirió a la década de 1930 como el "período heroico de la teoría matemática de la probabilidad". [251] La Segunda Guerra Mundial interrumpió en gran medida el desarrollo de la teoría de la probabilidad, causando, por ejemplo, la migración de Feller de Suecia a los Estados Unidos de América [251] y la muerte de Doeblin, considerado ahora un pionero en los procesos estocásticos. [261]

Después de la Segunda Guerra Mundial, el estudio de la teoría de la probabilidad y los procesos estocásticos ganó más atención por parte de los matemáticos, con contribuciones significativas en muchas áreas de la probabilidad y las matemáticas, así como la creación de nuevas áreas. [251] [264] A partir de la década de 1940, Kiyosi Itô publicó artículos desarrollando el campo del cálculo estocástico , que involucra integrales estocásticas y ecuaciones diferenciales estocásticas basadas en el proceso de movimiento browniano o de Wiener. [265]

También a partir de la década de 1940, se hicieron conexiones entre los procesos estocásticos, particularmente las martingalas, y el campo matemático de la teoría del potencial , con ideas tempranas de Shizuo Kakutani y luego trabajos posteriores de Joseph Doob. [264] Gilbert Hunt realizó trabajos adicionales, considerados pioneros, en la década de 1950, conectando los procesos de Markov y la teoría del potencial, lo que tuvo un efecto significativo en la teoría de los procesos de Lévy y condujo a un mayor interés en el estudio de los procesos de Markov con métodos desarrollados por Itô. [21] [266] [267]

En 1953, Doob publicó su libro Stochastic processes , que tuvo una fuerte influencia en la teoría de los procesos estocásticos y destacó la importancia de la teoría de la medida en la probabilidad. [264] [263] Doob también desarrolló principalmente la teoría de las martingalas, con posteriores contribuciones sustanciales de Paul-André Meyer . Trabajos anteriores habían sido realizados por Sergei Bernstein , Paul Lévy y Jean Ville , este último adoptando el término martingala para el proceso estocástico. [268] [269] Los métodos de la teoría de las martingalas se hicieron populares para resolver varios problemas de probabilidad. Se desarrollaron técnicas y teorías para estudiar los procesos de Markov y luego se aplicaron a las martingalas. Por el contrario, se establecieron métodos de la teoría de las martingalas para tratar los procesos de Markov. [264]

Se desarrollaron y utilizaron otros campos de probabilidad para estudiar los procesos estocásticos, siendo uno de los enfoques principales la teoría de las grandes desviaciones. [264] La teoría tiene muchas aplicaciones en la física estadística, entre otros campos, y tiene ideas centrales que se remontan al menos a la década de 1930. Más tarde, en las décadas de 1960 y 1970, Alexander Wentzell en la Unión Soviética y Monroe D. Donsker y Srinivasa Varadhan en los Estados Unidos de América realizaron un trabajo fundamental , [270] que más tarde daría como resultado que Varadhan ganara el Premio Abel en 2007. [271] En los años 1990 y 2000 se introdujeron y desarrollaron las teorías de la evolución de Schramm-Loewner [272] y las trayectorias aproximadas [142] para estudiar los procesos estocásticos y otros objetos matemáticos en la teoría de la probabilidad, lo que dio lugar a la concesión de las Medallas Fields a Wendelin Werner [273] en 2008 y a Martin Hairer en 2014 , respectivamente. [274]

La teoría de los procesos estocásticos sigue siendo un foco de investigación, con conferencias internacionales anuales sobre el tema de los procesos estocásticos. [45] [225]

Aunque Khinchin dio definiciones matemáticas de los procesos estocásticos en la década de 1930, [63] [259] ya se habían descubierto procesos estocásticos específicos en diferentes entornos, como el proceso de movimiento browniano y el proceso de Poisson. [21] [24] Algunas familias de procesos estocásticos, como los procesos puntuales o los procesos de renovación, tienen historias largas y complejas, que se remontan a siglos atrás. [275]

El proceso de Bernoulli, que puede servir como modelo matemático para lanzar una moneda al aire, es posiblemente el primer proceso estocástico que se haya estudiado. [81] El proceso es una secuencia de ensayos de Bernoulli independientes, [82] que reciben su nombre de Jacob Bernoulli , quien los utilizó para estudiar juegos de azar, incluidos los problemas de probabilidad propuestos y estudiados anteriormente por Christiaan Huygens. [276] El trabajo de Bernoulli, incluido el proceso de Bernoulli, se publicó en su libro Ars Conjectandi en 1713. [277]

En 1905, Karl Pearson acuñó el término paseo aleatorio al plantear un problema que describía un paseo aleatorio en el plano, que estaba motivado por una aplicación en biología, pero este tipo de problemas que implicaban paseos aleatorios ya se habían estudiado en otros campos. Ciertos problemas de juego que se estudiaron siglos antes pueden considerarse problemas que implican paseos aleatorios. [89] [277] Por ejemplo, el problema conocido como la ruina del jugador se basa en un paseo aleatorio simple, [195] [278] y es un ejemplo de un paseo aleatorio con barreras absorbentes. [241] [279] Pascal, Fermat y Huyens dieron soluciones numéricas a este problema sin detallar sus métodos, [280] y luego Jakob Bernoulli y Abraham de Moivre presentaron soluciones más detalladas . [281]

En 1919 y 1921 , George Pólya publicó un trabajo sobre los recorridos aleatorios en redes enteras de dimensiones numéricas en el que estudiaba la probabilidad de que un recorrido aleatorio simétrico volviera a una posición anterior en la red. Pólya demostró que un recorrido aleatorio simétrico, que tiene la misma probabilidad de avanzar en cualquier dirección en la red, volverá a una posición anterior en la red un número infinito de veces con probabilidad uno en una y dos dimensiones, pero con probabilidad cero en tres o más dimensiones. [282] [283]

El proceso de Wiener o proceso de movimiento browniano tiene su origen en diferentes campos, entre ellos la estadística, las finanzas y la física. [21] En 1880, el astrónomo danés Thorvald Thiele escribió un artículo sobre el método de mínimos cuadrados, donde utilizó el proceso para estudiar los errores de un modelo en el análisis de series temporales. [284] [285] [286] El trabajo se considera ahora como un descubrimiento temprano del método estadístico conocido como filtrado de Kalman , pero el trabajo fue en gran medida pasado por alto. Se cree que las ideas en el artículo de Thiele eran demasiado avanzadas para haber sido entendidas por la comunidad matemática y estadística más amplia de ese momento. [286]

El matemático francés Louis Bachelier utilizó un proceso de Wiener en su tesis de 1900 [287] [288] para modelar los cambios de precios en la Bolsa de París , una bolsa de valores , [289] sin conocer el trabajo de Thiele. [21] Se ha especulado que Bachelier extrajo ideas del modelo de paseo aleatorio de Jules Regnault , pero Bachelier no lo citó, [290] y la tesis de Bachelier ahora se considera pionera en el campo de las matemáticas financieras. [289] [290]

Se piensa comúnmente que el trabajo de Bachelier ganó poca atención y fue olvidado durante décadas hasta que fue redescubierto en la década de 1950 por Leonard Savage , y luego se volvió más popular después de que la tesis de Bachelier fuera traducida al inglés en 1964. Pero el trabajo nunca fue olvidado en la comunidad matemática, ya que Bachelier publicó un libro en 1912 detallando sus ideas, [290] que fue citado por matemáticos como Doob, Feller [290] y Kolmogorov. [21] El libro continuó siendo citado, pero luego, a partir de la década de 1960, la tesis original de Bachelier comenzó a ser citada más que su libro cuando los economistas comenzaron a citar el trabajo de Bachelier. [290]

En 1905, Albert Einstein publicó un artículo en el que estudiaba la observación física del movimiento browniano o movimiento para explicar los movimientos aparentemente aleatorios de partículas en líquidos utilizando ideas de la teoría cinética de los gases . Einstein derivó una ecuación diferencial , conocida como ecuación de difusión , para describir la probabilidad de encontrar una partícula en una determinada región del espacio. Poco después del primer artículo de Einstein sobre el movimiento browniano, Marian Smoluchowski publicó un trabajo en el que citaba a Einstein, pero escribió que había derivado de forma independiente los resultados equivalentes utilizando un método diferente. [291]

El trabajo de Einstein, así como los resultados experimentales obtenidos por Jean Perrin , inspiraron posteriormente a Norbert Wiener en la década de 1920 [292] a utilizar un tipo de teoría de la medida, desarrollada por Percy Daniell , y el análisis de Fourier para demostrar la existencia del proceso de Wiener como un objeto matemático. [21]

El proceso de Poisson debe su nombre a Siméon Poisson , debido a que su definición involucra la distribución de Poisson , pero Poisson nunca estudió el proceso. [22] [293] Hay varias afirmaciones sobre usos o descubrimientos tempranos del proceso de Poisson. [22] [24] A principios del siglo XX, el proceso de Poisson surgiría de forma independiente en diferentes situaciones. [22] [24] En Suecia, en 1903, Filip Lundberg publicó una tesis que contenía un trabajo, ahora considerado fundamental y pionero, donde propuso modelar las reclamaciones de seguros con un proceso de Poisson homogéneo. [294] [295]

Otro descubrimiento se produjo en Dinamarca en 1909, cuando AK Erlang derivó la distribución de Poisson al desarrollar un modelo matemático para el número de llamadas telefónicas entrantes en un intervalo de tiempo finito. Erlang no conocía en ese momento el trabajo anterior de Poisson y supuso que el número de llamadas telefónicas que llegaban en cada intervalo de tiempo eran independientes entre sí. Luego encontró el caso límite, que en realidad es reformular la distribución de Poisson como un límite de la distribución binomial. [22]

En 1910, Ernest Rutherford y Hans Geiger publicaron resultados experimentales sobre el conteo de partículas alfa. Motivado por su trabajo, Harry Bateman estudió el problema del conteo y derivó las probabilidades de Poisson como solución a una familia de ecuaciones diferenciales, lo que dio como resultado el descubrimiento independiente del proceso de Poisson. [22] Después de esta época hubo muchos estudios y aplicaciones del proceso de Poisson, pero su historia temprana es complicada, lo que se ha explicado por las diversas aplicaciones del proceso en numerosos campos por parte de biólogos, ecologistas, ingenieros y varios científicos físicos. [22]

Los procesos de Markov y las cadenas de Markov reciben su nombre de Andrey Markov , quien estudió las cadenas de Markov a principios del siglo XX. Markov estaba interesado en estudiar una extensión de secuencias aleatorias independientes. En su primer artículo sobre cadenas de Markov, publicado en 1906, Markov demostró que, en determinadas condiciones, los resultados medios de la cadena de Markov convergerían a un vector fijo de valores, lo que demuestra una ley débil de los grandes números sin el supuesto de independencia, [296] [297] [298] que se había considerado comúnmente como un requisito para que se mantuvieran tales leyes matemáticas. [298] Más tarde, Markov utilizó las cadenas de Markov para estudiar la distribución de las vocales en Eugene Onegin , escrito por Alexander Pushkin , y demostró un teorema de límite central para tales cadenas.

En 1912, Poincaré estudió las cadenas de Markov en grupos finitos con el objetivo de estudiar el barajado de cartas. Otros usos tempranos de las cadenas de Markov incluyen un modelo de difusión, introducido por Paul y Tatyana Ehrenfest en 1907, y un proceso de ramificación, introducido por Francis Galton y Henry William Watson en 1873, precediendo al trabajo de Markov. [296] [297] Después del trabajo de Galton y Watson, se reveló más tarde que su proceso de ramificación había sido descubierto y estudiado independientemente unas tres décadas antes por Irénée-Jules Bienaymé . [299] A partir de 1928, Maurice Fréchet se interesó en las cadenas de Markov, lo que finalmente lo llevó a publicar en 1938 un estudio detallado sobre las cadenas de Markov. [296] [300]

Andrei Kolmogorov desarrolló en un artículo de 1931 una gran parte de la teoría temprana de los procesos de Markov en tiempo continuo. [251] [257] Kolmogorov se inspiró en parte en el trabajo de 1900 de Louis Bachelier sobre las fluctuaciones en el mercado de valores, así como en el trabajo de Norbert Wiener sobre el modelo de movimiento browniano de Einstein. [257] [301] Introdujo y estudió un conjunto particular de procesos de Markov conocidos como procesos de difusión, donde derivó un conjunto de ecuaciones diferenciales que describen los procesos. [257] [302] Independientemente del trabajo de Kolmogorov, Sydney Chapman derivó en un artículo de 1928 una ecuación, ahora llamada ecuación de Chapman-Kolmogorov , de una manera matemáticamente menos rigurosa que Kolmogorov, mientras estudiaba el movimiento browniano. [303] Las ecuaciones diferenciales ahora se denominan ecuaciones de Kolmogorov [304] o ecuaciones de Kolmogorov-Chapman. [305] Otros matemáticos que contribuyeron significativamente a las bases de los procesos de Markov incluyen a William Feller, a partir de la década de 1930, y luego a Eugene Dynkin, a partir de la década de 1950. [251]

Los procesos de Lévy, como el proceso de Wiener y el proceso de Poisson (en la línea real), reciben su nombre de Paul Lévy, quien comenzó a estudiarlos en la década de 1930, [225] pero tienen conexiones con distribuciones infinitamente divisibles que se remontan a la década de 1920. [224] En un artículo de 1932, Kolmogorov derivó una función característica para variables aleatorias asociadas con los procesos de Lévy. Este resultado fue derivado posteriormente en condiciones más generales por Lévy en 1934, y luego Khinchin dio de forma independiente una forma alternativa para esta función característica en 1937. [251] [306] Además de Lévy, Khinchin y Kolomogrov, las primeras contribuciones fundamentales a la teoría de los procesos de Lévy fueron realizadas por Bruno de Finetti y Kiyosi Itô . [224]

En matemáticas, se necesitan construcciones de objetos matemáticos, lo que también es el caso de los procesos estocásticos, para demostrar que existen matemáticamente. [57] Hay dos enfoques principales para construir un proceso estocástico. Un enfoque implica considerar un espacio medible de funciones, definir una aplicación medible adecuada de un espacio de probabilidad a este espacio medible de funciones y luego derivar las distribuciones de dimensión finita correspondientes. [307]

Otro enfoque implica definir una colección de variables aleatorias para que tengan distribuciones de dimensión finita específicas y luego usar el teorema de existencia de Kolmogorov [j] para demostrar que existe un proceso estocástico correspondiente. [57] [307] Este teorema, que es un teorema de existencia para medidas en espacios de productos infinitos, [311] dice que si alguna distribución de dimensión finita satisface dos condiciones, conocidas como condiciones de consistencia , entonces existe un proceso estocástico con esas distribuciones de dimensión finita. [57]

Al construir procesos estocásticos de tiempo continuo surgen ciertas dificultades matemáticas, debido a los conjuntos de índices incontables, que no ocurren con los procesos de tiempo discreto. [58] [59] Un problema es que es posible tener más de un proceso estocástico con las mismas distribuciones de dimensión finita. Por ejemplo, tanto la modificación continua por la izquierda como la modificación continua por la derecha de un proceso de Poisson tienen las mismas distribuciones de dimensión finita. [312] Esto significa que la distribución del proceso estocástico no especifica, necesariamente, de manera única las propiedades de las funciones de muestra del proceso estocástico. [307] [313]

Otro problema es que las funciones de un proceso de tiempo continuo que dependen de un número incontable de puntos del conjunto de índices pueden no ser mensurables, por lo que las probabilidades de ciertos eventos pueden no estar bien definidas. [168] Por ejemplo, el supremo de un proceso estocástico o campo aleatorio no es necesariamente una variable aleatoria bien definida. [30] [59] Para un proceso estocástico de tiempo continuo , otras características que dependen de un número incontable de puntos del conjunto de índices incluyen: [168]

donde el símbolo ∈ puede leerse "un miembro del conjunto", como en un miembro del conjunto .

Para superar las dos dificultades descritas anteriormente, es decir, "más de uno..." y "funcionales de...", son posibles diferentes supuestos y enfoques. [69]

Un enfoque para evitar problemas de construcción matemática de procesos estocásticos, propuesto por Joseph Doob , es asumir que el proceso estocástico es separable. [314] La separabilidad garantiza que las distribuciones de dimensión infinita determinen las propiedades de las funciones de muestra al requerir que las funciones de muestra estén determinadas esencialmente por sus valores en un conjunto contable denso de puntos en el conjunto de índices. [315] Además, si un proceso estocástico es separable, entonces los funcionales de un número incontable de puntos del conjunto de índices son mensurables y sus probabilidades pueden estudiarse. [168] [315]

Otro enfoque es posible, desarrollado originalmente por Anatoliy Skorokhod y Andrei Kolmogorov , [316] para un proceso estocástico de tiempo continuo con cualquier espacio métrico como su espacio de estado. Para la construcción de un proceso estocástico de este tipo, se supone que las funciones de muestra del proceso estocástico pertenecen a algún espacio de funciones adecuado, que suele ser el espacio de Skorokhod que consiste en todas las funciones continuas por la derecha con límites por la izquierda. Este enfoque se utiliza ahora más que el supuesto de separabilidad, [69] [262] pero un proceso estocástico de este tipo basado en este enfoque será automáticamente separable. [317]

Aunque se utiliza menos, el supuesto de separabilidad se considera más general porque cada proceso estocástico tiene una versión separable. [262] También se utiliza cuando no es posible construir un proceso estocástico en un espacio de Skorokhod. [173] Por ejemplo, se supone la separabilidad al construir y estudiar campos aleatorios, donde la colección de variables aleatorias ahora está indexada por conjuntos distintos de la línea real, como el espacio euclidiano de dimensión 1. [30] [318]

Una de las aplicaciones más famosas de los procesos estocásticos en finanzas es el modelo Black-Scholes para la fijación de precios de opciones. Desarrollado por Fischer Black , Myron Scholes y Robert Solow , este modelo utiliza el movimiento browniano geométrico , un tipo específico de proceso estocástico, para describir la dinámica de los precios de los activos. [319] [320] El modelo supone que el precio de una acción sigue un proceso estocástico de tiempo continuo y proporciona una solución de forma cerrada para la fijación de precios de opciones de estilo europeo. La fórmula Black-Scholes ha tenido un profundo impacto en los mercados financieros, formando la base de gran parte del comercio de opciones moderno.

El supuesto clave del modelo de Black-Scholes es que el precio de un activo financiero, como una acción, sigue una distribución log-normal , con sus rendimientos continuos siguiendo una distribución normal. Aunque el modelo tiene limitaciones, como el supuesto de volatilidad constante, sigue siendo ampliamente utilizado debido a su simplicidad y relevancia práctica.

Otra aplicación importante de los procesos estocásticos en finanzas son los modelos de volatilidad estocástica , que tienen como objetivo capturar la naturaleza variable en el tiempo de la volatilidad del mercado. El modelo de Heston [321] es un ejemplo popular, que permite que la volatilidad de los precios de los activos siga su propio proceso estocástico. A diferencia del modelo de Black-Scholes, que supone una volatilidad constante, los modelos de volatilidad estocástica proporcionan un marco más flexible para modelar la dinámica del mercado, en particular durante períodos de alta incertidumbre o estrés del mercado.

Una de las principales aplicaciones de los procesos estocásticos en biología es la dinámica de poblaciones . A diferencia de los modelos deterministas , que suponen que las poblaciones cambian de formas predecibles, los modelos estocásticos tienen en cuenta la aleatoriedad inherente a los nacimientos, las muertes y la migración. El proceso nacimiento-muerte , [322] un modelo estocástico simple, describe cómo fluctúan las poblaciones a lo largo del tiempo debido a nacimientos y muertes aleatorios. Estos modelos son particularmente importantes cuando se trata de poblaciones pequeñas, donde los eventos aleatorios pueden tener grandes impactos, como en el caso de especies en peligro de extinción o pequeñas poblaciones microbianas.

Otro ejemplo es el proceso de ramificación [323] , que modela el crecimiento de una población en la que cada individuo se reproduce de forma independiente. El proceso de ramificación se utiliza a menudo para describir la extinción o explosión de una población, en particular en epidemiología, donde puede modelar la propagación de enfermedades infecciosas dentro de una población.