La Era de la Información (también conocida como Tercera Revolución Industrial , Era de la Computación , Era Digital , Era del Silicio , Era de los Nuevos Medios , Era de Internet o Revolución Digital [1] ) es un período histórico que comenzó a mediados del siglo XX. Se caracteriza por un rápido cambio de las industrias tradicionales, establecidas durante la Revolución Industrial , a una economía centrada en la tecnología de la información . [2] El inicio de la Era de la Información se ha relacionado con el desarrollo del transistor en 1947 [2] y del amplificador óptico en 1957. [3] Estos avances tecnológicos han tenido un impacto significativo en la forma en que se procesa y transmite la información.

Según la Red de Administración Pública de las Naciones Unidas , la Era de la Información se formó aprovechando los avances en la microminiaturización de las computadoras , [4] que llevaron a la modernización de los sistemas de información y las comunicaciones por Internet como fuerza impulsora de la evolución social . [5]

Muchos debaten si terminó la Tercera Revolución Industrial y cuándo comenzó la Cuarta Revolución Industrial , entre 2000 y 2020. [ cita necesaria ]

La revolución digital convirtió la tecnología del formato analógico al formato digital. Al hacer esto, fue posible hacer copias idénticas al original. En las comunicaciones digitales, por ejemplo, el hardware repetidor podía amplificar la señal digital y transmitirla sin pérdida de información en la señal. De igual importancia para la revolución fue la capacidad de mover fácilmente la información digital entre medios y acceder a ella o distribuirla de forma remota.

Un punto de inflexión de la revolución fue el cambio de la música grabada analógica a la digital. [6] Durante la década de 1980, el formato digital de los discos compactos ópticos reemplazó gradualmente a los formatos analógicos , como los discos de vinilo y las cintas de casete , como medio popular de elección. [7]

Los seres humanos han fabricado herramientas para contar y calcular desde la antigüedad, como el ábaco , el astrolabio , el ecuador y los dispositivos mecánicos de cronometraje. En el siglo XVII comenzaron a aparecer dispositivos más complicados, incluidas la regla de cálculo y las calculadoras mecánicas . A principios del siglo XIX, la Revolución Industrial había producido calculadoras para el mercado masivo como el aritmómetro y la tecnología habilitadora de la tarjeta perforada . Charles Babbage propuso una computadora mecánica de propósito general llamada Motor Analítico , pero nunca se construyó con éxito y fue en gran medida olvidada en el siglo XX y desconocida para la mayoría de los inventores de las computadoras modernas.

La Segunda Revolución Industrial en el último cuarto del siglo XIX desarrolló circuitos eléctricos útiles y el telégrafo . En la década de 1880, Herman Hollerith desarrolló dispositivos electromecánicos de tabulación y cálculo utilizando tarjetas perforadas y equipos de registro unitario , que se generalizaron en las empresas y el gobierno.

Mientras tanto, varios sistemas informáticos analógicos utilizaban sistemas eléctricos, mecánicos o hidráulicos para modelar problemas y calcular respuestas. Estos incluían una máquina de predicción de mareas de 1872 , analizadores diferenciales , máquinas de calendario perpetuo , el Deltar para la gestión del agua en los Países Bajos, analizadores de redes para sistemas eléctricos y varias máquinas para apuntar armas y bombas militares. La construcción de computadoras analógicas para problemas específicos continuó a finales de la década de 1940 y más allá, con FERMIAC para el transporte de neutrones, el Proyecto Cyclone para diversas aplicaciones militares y la Máquina Phillips para el modelado económico.

Aprovechando la complejidad de los modelos Z1 y Z2 , el inventor alemán Konrad Zuse utilizó sistemas electromecánicos para completar en 1941 el Z3 , el primer ordenador digital funcional, programable y totalmente automático del mundo. También durante la Segunda Guerra Mundial, los ingenieros aliados construyeron bombas electromecánicas para romper la codificación de la máquina alemana Enigma . El Harvard Mark I electromecánico de base 10 se completó en 1944 y, hasta cierto punto, se mejoró con la inspiración de los diseños de Charles Babbage.

En 1947, el primer transistor en funcionamiento , el transistor de contacto puntual a base de germanio , fue inventado por John Bardeen y Walter Houser Brattain mientras trabajaban con William Shockley en los Laboratorios Bell . [8] Esto abrió el camino hacia computadoras digitales más avanzadas . Desde finales de la década de 1940, universidades, militares y empresas desarrollaron sistemas informáticos para replicar y automatizar digitalmente cálculos matemáticos que antes se realizaban manualmente, siendo la LEO la primera computadora de propósito general disponible comercialmente.

La comunicación digital se volvió económica y tuvo una adopción generalizada después de la invención de la computadora personal en la década de 1970. A Claude Shannon , un matemático de los Laboratorios Bell , se le atribuye haber sentado las bases de la digitalización en su artículo pionero de 1948, Una teoría matemática de la comunicación . [9]

Otros avances tecnológicos importantes incluyeron la invención del chip de circuito integrado monolítico por Robert Noyce en Fairchild Semiconductor en 1959 [10] (posible gracias al proceso plano desarrollado por Jean Hoerni ), [11] el primer semiconductor de óxido metálico exitoso transistor de efecto (MOSFET o transistor MOS) por Mohamed Atalla y Dawon Kahng en Bell Labs en 1959, [12] y el desarrollo del proceso MOS complementario (CMOS) por Frank Wanlass y Chih-Tang Sah en Fairchild en 1963. [13 ]

En 1962, AT&T implementó el operador T para la transmisión de voz digital con modulación de código de pulso (PCM) de larga distancia . El formato T1 transportaba 24 señales de voz multiplexadas por división de tiempo y moduladas en código de impulsos, cada una codificada en flujos de 64 kbit/s, dejando 8 kbit/s de información de entramado que facilitaba la sincronización y la demultiplexación en el receptor. Durante las décadas siguientes, la digitalización de la voz se convirtió en la norma para todos menos para la última milla (donde lo analógico continuó siendo la norma hasta finales de los años 1990).

Tras el desarrollo de los chips de circuitos integrados MOS a principios de la década de 1960, los chips MOS alcanzaron una mayor densidad de transistores y menores costos de fabricación que los circuitos integrados bipolares en 1964. Los chips MOS aumentaron aún más en complejidad a un ritmo predicho por la ley de Moore , lo que llevó a una integración a gran escala. (LSI) con cientos de transistores en un solo chip MOS a finales de los años 1960. La aplicación de los chips MOS LSI a la informática fue la base de los primeros microprocesadores , cuando los ingenieros comenzaron a reconocer que un solo chip MOS LSI podía contener un procesador de computadora completo. [14] En 1968, el ingeniero de Fairchild, Federico Faggin, mejoró la tecnología MOS con el desarrollo del chip MOS de puerta de silicio , que más tarde utilizó para desarrollar el Intel 4004 , el primer microprocesador de un solo chip. [15] Fue lanzado por Intel en 1971 y sentó las bases para la revolución de las microcomputadoras que comenzó en la década de 1970.

La tecnología MOS también condujo al desarrollo de sensores de imagen semiconductores adecuados para cámaras digitales . [16] El primer sensor de imagen de este tipo fue el dispositivo de carga acoplada , desarrollado por Willard S. Boyle y George E. Smith en Bell Labs en 1969, [17] basado en la tecnología de condensadores MOS . [dieciséis]

El público conoció por primera vez los conceptos que condujeron a Internet cuando se envió un mensaje a través de ARPANET en 1969. Las redes de conmutación de paquetes como ARPANET, Mark I , CYCLADES , Merit Network , Tymnet y Telenet se desarrollaron a finales de los años 1960. y principios de los años 1970 usando una variedad de protocolos . ARPANET en particular condujo al desarrollo de protocolos para la interconexión de redes , en los que se podían unir múltiples redes separadas en una red de redes.

El movimiento Whole Earth de la década de 1960 defendió el uso de nuevas tecnologías. [18]

En la década de 1970 se introdujo el ordenador doméstico , [19] los ordenadores de tiempo compartido , [20] la consola de videojuegos , los primeros videojuegos con monedas, [21] [22] y comenzó la época dorada de los videojuegos arcade. Invasores espaciales . A medida que la tecnología digital proliferó y el cambio del mantenimiento de registros analógicos a digitales se convirtió en el nuevo estándar en los negocios, se popularizó una descripción de trabajo relativamente nueva: el empleado de entrada de datos . El trabajo del empleado de entrada de datos, seleccionado entre las filas de secretarias y mecanógrafos de décadas anteriores, era convertir datos analógicos (registros de clientes, facturas, etc.) en datos digitales.

En los países desarrollados, las computadoras alcanzaron una semiubicuidad durante la década de 1980 cuando se abrieron paso en las escuelas, los hogares, los negocios y la industria. Los cajeros automáticos , los robots industriales , el CGI en el cine y la televisión, la música electrónica , los sistemas de tablones de anuncios y los videojuegos alimentaron lo que se convirtió en el espíritu de la época de los años ochenta. Millones de personas compraron computadoras domésticas, lo que convirtió a los primeros fabricantes de computadoras personales en famosos, como Apple , Commodore y Tandy. Hasta el día de hoy, el Commodore 64 es citado a menudo como el ordenador más vendido de todos los tiempos, habiendo vendido 17 millones de unidades (según algunas cuentas) [23] entre 1982 y 1994.

En 1984, la Oficina del Censo de Estados Unidos comenzó a recopilar datos sobre el uso de computadoras e Internet en Estados Unidos; su primera encuesta mostró que el 8,2% de todos los hogares estadounidenses poseían una computadora personal en 1984, y que los hogares con niños menores de 18 años tenían casi el doble de probabilidades de poseer una, con un 15,3% (los hogares de clase media y media alta eran los más propensos a poseer una). poseer uno, al 22,9%). [24] En 1989, el 15% de todos los hogares estadounidenses poseían una computadora, y casi el 30% de los hogares con niños menores de 18 años poseían una. [ cita necesaria ] A finales de la década de 1980, muchas empresas dependían de las computadoras y la tecnología digital.

Motorola creó el primer teléfono móvil, Motorola DynaTac , en 1983. Sin embargo, este dispositivo utilizaba comunicación analógica: los teléfonos móviles digitales no se vendieron comercialmente hasta 1991, cuando comenzó a abrirse la red 2G en Finlandia para satisfacer la demanda inesperada de teléfonos móviles que haciéndose evidente a finales de los años 1980.

¡Calcular! La revista predijo que el CD-ROM sería la pieza central de la revolución, con múltiples dispositivos domésticos leyendo los discos. [25]

La primera cámara digital auténtica se creó en 1988 y las primeras se comercializaron en diciembre de 1989 en Japón y en 1990 en Estados Unidos. [26] A mediados de la década de 2000, las cámaras digitales habían eclipsado en popularidad a las películas tradicionales.

La tinta digital también se inventó a finales de los años 1980. El sistema CAPS de Disney (creado en 1988) se utilizó para una escena de La Sirenita de 1989 y para todas sus películas de animación entre The Rescuers Down Under de 1990 y Home on the Range de 2004 .

Tim Berners-Lee inventó la World Wide Web en 1989. [27]

La primera transmisión pública de HDTV digital fue la Copa del Mundo de 1990 en junio; Se proyectó en 10 salas de España e Italia. Sin embargo, la HDTV no se convirtió en un estándar hasta mediados de la década de 2000 fuera de Japón.

La World Wide Web pasó a ser de acceso público en 1991, cuando sólo había estado disponible para el gobierno y las universidades. [28] En 1993 Marc Andreessen y Eric Bina introdujeron Mosaic , el primer navegador web capaz de mostrar imágenes en línea [29] y la base para navegadores posteriores como Netscape Navigator e Internet Explorer. Stanford Federal Credit Union fue la primera institución financiera en ofrecer servicios de banca por Internet en línea a todos sus miembros en octubre de 1994. [30] En 1996, OP Financial Group , también un banco cooperativo , se convirtió en el segundo banco en línea del mundo y el primero en Europa. [31] Internet se expandió rápidamente y, en 1996, era parte de la cultura de masas y muchas empresas incluían sitios web en sus anuncios. [ cita necesaria ] En 1999, casi todos los países tenían una conexión y casi la mitad de los estadounidenses y las personas de varios otros países utilizaban Internet de forma regular. [ cita necesaria ] Sin embargo, a lo largo de la década de 1990, "conectarse" implicaba una configuración complicada y el acceso telefónico era el único tipo de conexión asequible para los usuarios individuales; La cultura de masas de Internet actual no era posible.

En 1989, alrededor del 15% de todos los hogares de Estados Unidos poseían una computadora personal. [32] En el caso de los hogares con niños, casi el 30% poseía una computadora en 1989, y en 2000, el 65% poseía una.

Los teléfonos móviles se volvieron tan omnipresentes como las computadoras a principios de la década de 2000, y las salas de cine comenzaron a mostrar anuncios que pedían a la gente que silenciara sus teléfonos. También se volvieron mucho más avanzados que los teléfonos de la década de 1990, la mayoría de los cuales sólo aceptaban llamadas o, como mucho, permitían jugar juegos sencillos.

Los mensajes de texto se utilizaron ampliamente a finales de la década de 1990 en todo el mundo, excepto en los Estados Unidos de América, donde la mensajería de texto no se volvió común hasta principios de la década de 2000. [ cita necesaria ]

La revolución digital también se volvió verdaderamente global en esta época: después de revolucionar la sociedad en el mundo desarrollado en la década de 1990, la revolución digital se extendió a las masas del mundo en desarrollo en la década de 2000.

En el año 2000, la mayoría de los hogares estadounidenses tenían al menos una computadora personal y acceso a Internet al año siguiente. [33] En 2002, la mayoría de los encuestados estadounidenses informaron tener un teléfono móvil . [34]

A finales de 2005, la población de Internet alcanzó los 1.000 millones, [35] y 3.000 millones de personas en todo el mundo utilizaban teléfonos móviles a finales de la década. A finales de la década, la HDTV se convirtió en el formato estándar de transmisión de televisión en muchos países. En septiembre y diciembre de 2006, respectivamente, Luxemburgo y los Países Bajos se convirtieron en los primeros países en realizar la transición completa de la televisión analógica a la digital . En septiembre de 2007, la mayoría de los encuestados estadounidenses informaron tener Internet de banda ancha en casa. [36] Según estimaciones de Nielsen Media Research , aproximadamente 45,7 millones de hogares estadounidenses en 2006 (o aproximadamente el 40 por ciento de aproximadamente 114,4 millones) poseían una consola de videojuegos doméstica dedicada , [37] [38] y en 2015, el 51 por ciento de Los hogares estadounidenses poseían una consola de videojuegos doméstica dedicada, según un informe anual de la industria de la Entertainment Software Association . [39] [40] En 2012, más de 2 mil millones de personas utilizaban Internet, el doble que en 2007. La computación en la nube había entrado en la corriente principal a principios de la década de 2010. En enero de 2013, la mayoría de los encuestados en EE. UU. informaron poseer un teléfono inteligente . [41] En 2016, la mitad de la población mundial estaba conectada [42] y a partir de 2020, ese número ha aumentado al 67%. [43]

A finales de la década de 1980, menos del 1% de la información almacenada tecnológicamente en el mundo estaba en formato digital, mientras que en 2007 era el 94% y en 2014 era más del 99%. [44]

Se estima que la capacidad mundial para almacenar información ha aumentado de 2,6 exabytes (óptimamente comprimidos) en 1986 a unos 5.000 exabytes en 2014 (5 zettabytes ). [44] [45]

.jpg/440px-Rings_of_time_Information_Age_(Digital_Revolution).jpg)

Fremont Rider calculó en 1945 que la ampliación de la biblioteca duplicaría su capacidad cada 16 años cuando hubiera suficiente espacio disponible. [51] Abogó por reemplazar las obras impresas voluminosas y en descomposición con fotografías analógicas en microformas miniaturizadas , que podrían duplicarse a pedido para los usuarios de bibliotecas y otras instituciones.

Rider no previó, sin embargo, la tecnología digital que vendría décadas después para reemplazar la microforma analógica con medios de imagen , almacenamiento y transmisión digitales , mediante la cual se haría posible un gran aumento en la velocidad del crecimiento de la información a través de tecnologías digitales automatizadas y potencialmente sin pérdidas . . En consecuencia, la ley de Moore , formulada hacia 1965, calcularía que el número de transistores en un circuito integrado denso se duplica aproximadamente cada dos años. [52] [53]

A principios de la década de 1980, junto con las mejoras en la potencia informática , la proliferación de computadoras personales más pequeñas y menos costosas permitió el acceso inmediato a la información y la capacidad de compartirla y almacenarla . La conectividad entre computadoras dentro de las organizaciones permitió el acceso a mayores cantidades de información. [ cita necesaria ]

La capacidad tecnológica mundial para almacenar información creció de 2,6 exabytes (EB) (óptimamente comprimidos ) en 1986 a 15,8 EB en 1993; más de 54,5 EB en 2000; y a 295 EB (óptimamente comprimidos) en 2007. [44] [55] Este es el equivalente informativo a menos de un CD-ROM de 730 megabytes (MB) por persona en 1986 (539 MB por persona); aproximadamente cuatro CD-ROM por persona en 1993; doce CD-ROM por persona en el año 2000; y casi sesenta y un CD-ROM por persona en 2007. [44] Se estima que la capacidad mundial para almacenar información alcanzó los 5 zettabytes en 2014, [45] el equivalente informativo de 4.500 pilas de libros impresos desde la tierra hasta el infinito. sol . [ cita necesaria ]

La cantidad de datos digitales almacenados parece crecer aproximadamente exponencialmente , lo que recuerda a la ley de Moore . Como tal, la ley de Kryder prescribe que la cantidad de espacio de almacenamiento disponible parece crecer aproximadamente exponencialmente. [56] [57] [58] [53]

La capacidad tecnológica mundial para recibir información a través de redes de transmisión unidireccionales era de 432 exabytes de información (óptimamente comprimida ) en 1986; 715 exabytes (óptimamente comprimidos) en 1993; 1,2 zettabytes (óptimamente comprimidos) en 2000; y 1,9 zettabytes en 2007, el equivalente informativo de 174 periódicos por persona al día. [44]

La capacidad efectiva del mundo para intercambiar información a través de redes de telecomunicaciones bidireccionales era de 281 petabytes de información (óptimamente comprimida) en 1986; 471 petabytes en 1993; 2,2 exabytes (óptimamente comprimidos) en 2000; y 65 exabytes (óptimamente comprimidos) en 2007, el equivalente informativo de seis periódicos por persona y día. [44] En la década de 1990, la expansión de Internet provocó un salto repentino en el acceso y la capacidad de compartir información en empresas y hogares a nivel mundial. Una computadora que costaba $3000 en 1997 costaría $2000 dos años después y $1000 el año siguiente, debido al rápido avance de la tecnología. [ cita necesaria ]

La capacidad tecnológica mundial para computar información con computadoras de uso general guiadas por humanos creció de 3,0 × 10 8 MIPS en 1986 a 4,4 × 10 9 MIPS en 1993; a 2,9 × 10 11 MIPS en 2000; a 6,4 × 10 12 MIPS en 2007. [44] Un artículo publicado en la revista Trends in Ecology and Evolution en 2016 informó que: [45]

La tecnología digital ha superado ampliamente la capacidad cognitiva de cualquier ser humano y lo ha hecho una década antes de lo previsto. En términos de capacidad, existen dos medidas de importancia: la cantidad de operaciones que un sistema puede realizar y la cantidad de información que se puede almacenar. Se ha estimado que el número de operaciones sinápticas por segundo en un cerebro humano se sitúa entre 10^15 y 10^17. Si bien esta cifra es impresionante, incluso en 2007 las computadoras de propósito general de la humanidad eran capaces de realizar más de 10^18 instrucciones por segundo. Las estimaciones sugieren que la capacidad de almacenamiento de un cerebro humano individual es de aproximadamente 10^12 bytes. Per cápita, esto se corresponde con el almacenamiento digital actual (5x10^21 bytes por 7,2x10^9 personas).

El código genético también puede considerarse parte de la revolución de la información . Ahora que la secuenciación se ha computarizado, el genoma puede representarse y manipularse como datos. Esto comenzó con la secuenciación del ADN , inventada por Walter Gilbert y Allan Maxam [59] en 1976-1977 y Frederick Sanger en 1977, creció de manera constante con el Proyecto Genoma Humano , inicialmente concebido por Gilbert y, finalmente, las aplicaciones prácticas de la secuenciación, como la secuenciación genética . pruebas , tras el descubrimiento por parte de Myriad Genetics de la mutación del gen del cáncer de mama BRCA1 . Los datos de secuencia en Genbank han crecido desde las 606 secuencias genómicas registradas en diciembre de 1982 hasta los 231 millones de genomas en agosto de 2021. A partir de agosto de 2021, se han registrado 13 billones de secuencias incompletas adicionales en la base de datos de envío de Whole Genome Shotgun. secuencias se ha duplicado cada 18 meses. [60]

En raras épocas de la historia de la humanidad, ha habido períodos de innovación que han transformado la vida humana. El Neolítico , la Era Científica y la Era Industrial indujeron, en última instancia, cambios discontinuos e irreversibles en los elementos económicos, sociales y culturales de la vida diaria de la mayoría de las personas. Tradicionalmente, estas épocas han durado cientos o, en el caso de la Revolución Neolítica, miles de años, mientras que la Era de la Información se extendió por todas partes del mundo en tan sólo unos pocos años, como resultado del rápido avance de la velocidad de la información. intercambio.

Hace entre 7.000 y 10.000 años, durante el período Neolítico, los humanos comenzaron a domesticar animales, a cultivar cereales y a sustituir las herramientas de piedra por otras de metal. Estas innovaciones permitieron que los cazadores-recolectores nómadas se establecieran. Las aldeas se formaron a lo largo del río Yangtsé en China en el año 6.500 a.C., en la región del río Nilo en África y en Mesopotamia ( Irak ) en el año 6.000 a.C. Las ciudades surgieron entre el 6.000 a.C. y el 3.500 a.C. El desarrollo de la comunicación escrita ( cuneiforme en Sumeria y jeroglíficos en Egipto en el año 3.500 C. y la escritura en Egipto en 2.560 a. C. y en Minoa y China alrededor de 1.450 a. C.) permitieron conservar ideas durante períodos prolongados para difundirlas ampliamente. En total, los avances neolíticos, potenciados por la escritura como herramienta de información, sentaron las bases para el advenimiento de la civilización.

La era científica comenzó en el período comprendido entre la prueba de Galileo en 1543 de que los planetas orbitan alrededor del Sol y la publicación de Newton de las leyes del movimiento y la gravedad en Principia en 1697. Esta era de descubrimientos continuó durante el siglo XVIII, acelerada por el uso generalizado. de la imprenta de tipos móviles de Johannes Gutenberg .

La Era Industrial comenzó en Gran Bretaña en 1760 y continuó hasta mediados del siglo XIX. La invención de máquinas como la tejedora textil mecánica de Edmund Cartwrite, la máquina de vapor de eje giratorio de James Watt y la desmotadora de algodón de Eli Whitney , junto con procesos de fabricación en masa, llegaron a satisfacer las necesidades de una población mundial en crecimiento. La era industrial aprovechó el vapor y la energía hidráulica para reducir la dependencia del trabajo físico animal y humano como principal medio de producción. Así, el núcleo de la Revolución Industrial fue la generación y distribución de energía a partir de carbón y agua para producir vapor y, más adelante en el siglo XX, electricidad.

La era de la información también requiere electricidad para alimentar las redes globales de computadoras que procesan y almacenan datos. Sin embargo, lo que aceleró drásticamente el ritmo de adopción de la era de la información, en comparación con las anteriores, fue la velocidad con la que el conocimiento podía transferirse y penetrar a toda la familia humana en unas pocas décadas. Esta aceleración se produjo con la adopción de una nueva forma de poder. A partir de 1972, los ingenieros idearon formas de aprovechar la luz para transmitir datos a través de cables de fibra óptica. Hoy en día, los sistemas de redes ópticas basadas en luz en el corazón de las redes de telecomunicaciones e Internet se extienden por todo el mundo y transportan la mayor parte del tráfico de información hacia y desde los usuarios y los sistemas de almacenamiento de datos.

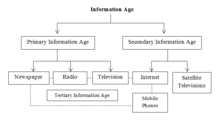

Existen diferentes conceptualizaciones de la Era de la Información. Algunos se centran en la evolución de la información a lo largo de los siglos, distinguiendo entre la Era de la Información Primaria y la Era de la Información Secundaria. La información en la Era de la Información Primaria estaba manejada por los periódicos , la radio y la televisión . La Era de la Información Secundaria fue desarrollada por Internet , la televisión por satélite y los teléfonos móviles . La Era de la Información Terciaria surgió gracias a los medios de la Era de la Información Primaria interconectados con los medios de la Era de la Información Secundaria tal como se experimenta actualmente. [61] [62] [63]

Otros lo clasifican en términos de las bien establecidas ondas largas schumpeterianas u ondas de Kondratiev . Aquí los autores distinguen tres metaparadigmas de largo plazo diferentes , cada uno con diferentes ondas largas. El primero se centró en la transformación de materiales, incluidos la piedra , el bronce y el hierro . La segunda, a menudo denominada Revolución Industrial , estuvo dedicada a la transformación de la energía, incluyendo el agua , el vapor , la electricidad y la combustión . Finalmente, el metaparadigma más reciente apunta a transformar la información . Comenzó con la proliferación de las comunicaciones y los datos almacenados y ahora ha entrado en la era de los algoritmos , cuyo objetivo es crear procesos automatizados para convertir la información existente en conocimiento procesable. [64]

La característica principal de la revolución de la información es el creciente papel económico, social y tecnológico de la información . [65] Las actividades relacionadas con la información no surgieron con la Revolución de la Información. Existieron, de una forma u otra, en todas las sociedades humanas, y eventualmente se convirtieron en instituciones, como la Academia platónica , la escuela peripatética de Aristóteles en el Liceo , el Museo y la Biblioteca de Alejandría , o las escuelas de astronomía babilónica. . La Revolución Agrícola y la Revolución Industrial surgieron cuando innovadores individuales o instituciones científicas y técnicas produjeron nuevos insumos de información. Durante la Revolución de la Información todas estas actividades están experimentando un crecimiento continuo, mientras que otras actividades orientadas a la información están surgiendo.

La información es el tema central de varias ciencias nuevas que surgieron en la década de 1940, incluida la teoría de la información de Shannon (1949) [66] y la cibernética de Wiener (1948) . Wiener afirmó: "la información es información, no materia ni energía". Este aforismo sugiere que la información debe considerarse junto con la materia y la energía como la tercera parte constituyente del Universo; la información es transportada por materia o por energía. [67] En la década de 1990, algunos escritores creían que los cambios implicados por la revolución de la información conducirían no sólo a una crisis fiscal para los gobiernos sino también a la desintegración de todas las "grandes estructuras". [68]

El término revolución de la información puede estar relacionado o contrastar con términos tan utilizados como Revolución Industrial y Revolución Agrícola . Tenga en cuenta, sin embargo, que es posible que prefiera el paradigma mentalista al materialista. Se pueden citar los siguientes aspectos fundamentales de la teoría de la revolución de la información: [69] [70]

Desde una perspectiva diferente, Irving E. Fang (1997) identificó seis "revoluciones de la información": la escritura, la imprenta, los medios de comunicación, el entretenimiento, el "cobertizo de herramientas" (que ahora llamamos "hogar") y la autopista de la información. En este trabajo, el término "revolución de la información" se utiliza en un sentido estricto para describir las tendencias en los medios de comunicación. [74]

Porat (1976) midió el sector de la información en Estados Unidos utilizando el análisis input-output ; La OCDE ha incluido estadísticas sobre el sector de la información en los informes económicos de sus países miembros. [75] Veneris (1984, 1990) exploró los aspectos teóricos, económicos y regionales de la revolución informacional y desarrolló un modelo informático de simulación de dinámica de sistemas . [69] [70]

Se puede considerar que estos trabajos siguen el camino iniciado con el trabajo de Fritz Machlup quien en su libro (1962) "La producción y distribución del conocimiento en los Estados Unidos", afirmó que "la industria del conocimiento representaba el 29% del producto nacional bruto de los Estados Unidos". producto", lo que vio como evidencia de que la era de la información había comenzado. Define el conocimiento como una mercancía e intenta medir la magnitud de la producción y distribución de esta mercancía dentro de una economía moderna. Machlup dividió el uso de la información en tres clases: conocimiento instrumental, intelectual y de pasatiempo. Identificó también cinco tipos de conocimiento: conocimiento práctico; conocimiento intelectual, es decir, cultura general y satisfacción de la curiosidad intelectual; conocimiento de pasatiempo, es decir, conocimiento que satisface la curiosidad no intelectual o el deseo de entretenimiento ligero y estimulación emocional; conocimiento espiritual o religioso; Conocimiento no deseado, adquirido accidentalmente y retenido sin rumbo. [76]

Estimaciones más recientes han llegado a los siguientes resultados: [44]

Con el tiempo, las tecnologías de la información y la comunicación (TIC), es decir, computadoras , maquinaria computarizada , fibra óptica , satélites de comunicación , Internet y otras herramientas TIC, se convirtieron en una parte importante de la economía mundial , a medida que el desarrollo de las redes ópticas y las microcomputadoras cambió en gran medida muchas cosas. negocios e industrias. [78] [79] Nicholas Negroponte capturó la esencia de estos cambios en su libro de 1995, Being Digital , en el que analiza las similitudes y diferencias entre productos hechos de átomos y productos hechos de bits . [80]

La era de la información ha afectado a la fuerza laboral de varias maneras, como obligar a los trabajadores a competir en un mercado laboral global . Una de las preocupaciones más evidentes es la sustitución de la mano de obra humana por computadoras que puedan hacer su trabajo con mayor rapidez y eficacia, creando así una situación en la que las personas que realizan tareas que pueden automatizarse fácilmente se ven obligadas a encontrar empleos donde su trabajo no es tan bueno. desechable. [81] Esto crea un problema especialmente para quienes viven en ciudades industriales , donde las soluciones generalmente implican reducir el tiempo de trabajo , lo que a menudo encuentra mucha resistencia. Así, las personas que pierden su empleo pueden verse presionadas a ascender a profesiones más indispensables (por ejemplo, ingenieros, médicos, abogados, profesores , científicos , ejecutivos , periodistas , consultores ) , que sean capaces de competir con éxito en el mercado mundial y recibir salarios (relativamente) altos. [ cita necesaria ]

Junto con la automatización, los trabajos tradicionalmente asociados con la clase media (por ejemplo, línea de montaje , procesamiento de datos , gestión y supervisión ) también han comenzado a desaparecer como resultado de la subcontratación . [82] Incapaces de competir con los de los países en desarrollo , los trabajadores de producción y servicios en las sociedades postindustriales (es decir, desarrolladas) pierden sus empleos a través de la subcontratación, aceptan recortes salariales o se conforman con empleos de servicios poco calificados y mal remunerados . [82] En el pasado, el destino económico de los individuos estaría ligado al de su nación. Por ejemplo, los trabajadores en Estados Unidos alguna vez estuvieron bien pagados en comparación con los de otros países. Con el advenimiento de la era de la información y las mejoras en la comunicación, este ya no es el caso, ya que los trabajadores ahora deben competir en un mercado laboral global , en el que los salarios dependen menos del éxito o el fracaso de las economías individuales. [82]

Al lograr una fuerza laboral globalizada , Internet también ha permitido mayores oportunidades en los países en desarrollo , haciendo posible que los trabajadores en esos lugares brinden servicios en persona y, por lo tanto, compitan directamente con sus contrapartes en otras naciones. Esta ventaja competitiva se traduce en mayores oportunidades y salarios más altos. [83]

La era de la información ha afectado a la fuerza laboral en el sentido de que la automatización y la informatización han resultado en una mayor productividad junto con una pérdida neta de empleos en la industria manufacturera . En Estados Unidos, por ejemplo, de enero de 1972 a agosto de 2010, el número de personas empleadas en trabajos manufactureros cayó de 17.500.000 a 11.500.000, mientras que el valor manufacturero aumentó un 270%. [84] Aunque inicialmente parecía que la pérdida de empleo en el sector industrial podría verse parcialmente compensada por el rápido crecimiento de los empleos en tecnología de la información , la recesión de marzo de 2001 presagió una fuerte caída en el número de empleos en el sector. Este patrón de disminución de empleos continuaría hasta 2003, [85] y los datos han demostrado que, en general, la tecnología crea más empleos de los que destruye, incluso en el corto plazo. [86]

La industria se ha vuelto más intensiva en información y menos en mano de obra y capital . Esto ha dejado implicaciones importantes para la fuerza laboral , ya que los trabajadores se han vuelto cada vez más productivos a medida que disminuye el valor de su trabajo. Para el sistema del capitalismo mismo, el valor del trabajo disminuye, el valor del capital aumenta.

En el modelo clásico , las inversiones en capital humano y financiero son predictores importantes del desempeño de una nueva empresa . [87] Sin embargo, como lo demostraron Mark Zuckerberg y Facebook , ahora parece posible que un grupo de personas relativamente inexpertas y con capital limitado tengan éxito a gran escala. [88]

La Era de la Información fue posible gracias a la tecnología desarrollada en la Revolución Digital , que a su vez fue posible gracias a los avances de la Revolución Tecnológica .

El inicio de la era de la información puede asociarse con el desarrollo de la tecnología de transistores . [2] El concepto de transistor de efecto de campo fue teorizado por primera vez por Julius Edgar Lilienfeld en 1925. [89] El primer transistor práctico fue el transistor de contacto puntual , inventado por los ingenieros Walter Houser Brattain y John Bardeen mientras trabajaban para William Shockley. en Bell Labs en 1947. Este fue un gran avance que sentó las bases de la tecnología moderna. [2] El equipo de investigación de Shockley también inventó el transistor de unión bipolar en 1952. [90] [89] El tipo de transistor más utilizado es el transistor de efecto de campo semiconductor de óxido metálico (MOSFET), inventado por Mohamed M. Atalla y Dawon Kahng en Bell Labs en 1960. [12] El proceso de fabricación complementario de MOS (CMOS) fue desarrollado por Frank Wanlass y Chih-Tang Sah en 1963. [91]

Antes de la llegada de la electrónica , las computadoras mecánicas , como la máquina analítica de 1837, estaban diseñadas para proporcionar cálculos matemáticos rutinarios y capacidades simples de toma de decisiones. Las necesidades militares durante la Segunda Guerra Mundial impulsaron el desarrollo de las primeras computadoras electrónicas, basadas en tubos de vacío , incluidas la Z3 , la computadora Atanasoff-Berry , la computadora Colossus y la ENIAC .

La invención del transistor permitió la era de las computadoras centrales (décadas de 1950 a 1970), tipificada por el IBM 360 . Estas grandes computadoras, del tamaño de una habitación, proporcionaban cálculo y manipulación de datos mucho más rápido de lo humanamente posible, pero eran costosas de comprar y mantener, por lo que inicialmente se limitaron a unas pocas instituciones científicas, grandes corporaciones y agencias gubernamentales.

El circuito integrado de germanio (CI) fue inventado por Jack Kilby en Texas Instruments en 1958. [92] El circuito integrado de silicio fue inventado luego en 1959 por Robert Noyce en Fairchild Semiconductor , utilizando el proceso plano desarrollado por Jean Hoerni , quien a su vez fue basándose en el método de pasivación de superficies de silicio de Mohamed Atalla desarrollado en Bell Labs en 1957. [93] [94] Tras la invención del transistor MOS por Mohamed Atalla y Dawon Kahng en Bell Labs en 1959, [12] el circuito integrado MOS fue desarrollado por Fred Heiman y Steven Hofstein en RCA en 1962. [95] El MOS IC de puerta de silicio fue desarrollado más tarde por Federico Faggin en Fairchild Semiconductor en 1968. [96] Con la llegada del transistor MOS y el MOS IC, la tecnología de transistores mejoró rápidamente y la relación entre potencia informática y tamaño aumentó dramáticamente, dando acceso directo a las computadoras a grupos cada vez más pequeños de personas.

El primer microprocesador comercial de un solo chip se lanzó en 1971, el Intel 4004 , que fue desarrollado por Federico Faggin utilizando su tecnología MOS IC de puerta de silicio, junto con Marcian Hoff , Masatoshi Shima y Stan Mazor . [97] [98]

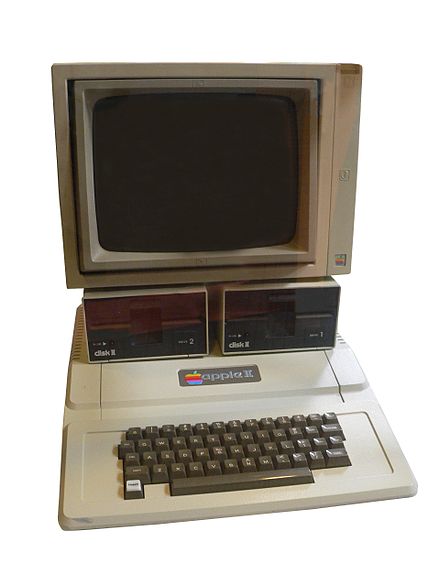

Junto con las máquinas recreativas electrónicas y las consolas de videojuegos domésticas de las que Nolan Bushnell fue pionero en la década de 1970, el desarrollo de computadoras personales como la Commodore PET y Apple II (ambas en 1977) dieron a las personas acceso a la computadora. Sin embargo, el intercambio de datos entre ordenadores individuales era inexistente o en gran medida manual , al principio mediante tarjetas perforadas y cintas magnéticas , y más tarde mediante disquetes .

Los primeros desarrollos para almacenar datos se basaron inicialmente en fotografías, comenzando con la microfotografía en 1851 y luego con la microforma en la década de 1920, con la capacidad de almacenar documentos en película, haciéndolos mucho más compactos. Las primeras teorías de la información y los códigos de Hamming se desarrollaron alrededor de 1950, pero esperaron a que se aprovecharan al máximo las innovaciones técnicas en la transmisión y el almacenamiento de datos.

La memoria de núcleo magnético se desarrolló a partir de la investigación de Frederick W. Viehe en 1947 y An Wang en la Universidad de Harvard en 1949. [99] [100] Con la llegada del transistor MOS, la memoria semiconductora MOS fue desarrollada por John Schmidt en Fairchild Semiconductor. en 1964. [101] [102] En 1967, Dawon Kahng y Simon Sze en Bell Labs describieron en 1967 cómo la puerta flotante de un dispositivo semiconductor MOS podría usarse para la celda de una ROM reprogramable. [103] Tras la invención de la memoria flash por Fujio Masuoka en Toshiba en 1980, [104] [105] Toshiba comercializó la memoria flash NAND en 1987. [106] [103]

En la década de 1960 se desarrollaron por primera vez cables de alambre de cobre que transmitían datos digitales, conectaban terminales de computadora y periféricos a computadoras centrales, y sistemas especiales para compartir mensajes que conducían al correo electrónico . Las redes independientes de computadora a computadora comenzaron con ARPANET en 1969. Esta se expandió hasta convertirse en Internet (acuñada en 1974). El acceso a Internet mejoró con la invención de la World Wide Web en 1991. La expansión de la capacidad a partir de la multiplexación por división de ondas densas , la amplificación óptica y las redes ópticas a mediados de la década de 1990 condujo a velocidades de transferencia de datos récord. En 2018, las redes ópticas entregaban habitualmente 30,4 terabits/s a través de un par de fibra óptica, el equivalente de datos a 1,2 millones de transmisiones simultáneas de vídeo 4K HD. [107]

El escalado de MOSFET , la rápida miniaturización de los MOSFET a un ritmo predicho por la ley de Moore , [108] llevó a que las computadoras se volvieran más pequeñas y más poderosas, hasta el punto de poder transportarlas. Durante las décadas de 1980 y 1990, las computadoras portátiles se desarrollaron como una forma de computadora portátil y los asistentes digitales personales (PDA) podían usarse mientras estaba de pie o caminando. Los buscapersonas , ampliamente utilizados en la década de 1980, fueron reemplazados en gran medida por teléfonos móviles a partir de finales de la década de 1990, proporcionando funciones de red móvil a algunas computadoras. Esta tecnología, que hoy es algo común, se ha extendido a las cámaras digitales y otros dispositivos portátiles. A partir de finales de la década de 1990, las tabletas y luego los teléfonos inteligentes combinaron y ampliaron estas capacidades de informática, movilidad e intercambio de información. Los sensores de imagen semiconductores de óxido metálico (MOS) , que comenzaron a aparecer a finales de los años 1960, condujeron a la transición de las imágenes analógicas a las digitales , y de las cámaras analógicas a las digitales, durante las décadas de 1980 y 1990. Los sensores de imagen más comunes son el sensor de dispositivo de carga acoplada (CCD) y el sensor de píxeles activos (sensor CMOS) CMOS (MOS complementario ).

El papel electrónico , que tiene sus orígenes en la década de 1970, permite que la información digital aparezca como documentos en papel.

En 1976, varias empresas competían por introducir las primeras computadoras personales comerciales verdaderamente exitosas. En 1977 se lanzaron tres máquinas, Apple II , Commodore PET 2001 y TRS-80 , [109] convirtiéndose en las más populares a finales de 1978. [110] La revista Byte se refirió más tarde a Commodore, Apple y Tandy como la "Trinity de 1977". ". [111] También en 1977, Sord Computer Corporation lanzó la computadora doméstica inteligente Sord M200 en Japón. [112]

Steve Wozniak (conocido como "Woz"), un visitante habitual de las reuniones del Homebrew Computer Club , diseñó la computadora Apple I de placa única y la demostró por primera vez allí. Con las especificaciones en mano y un pedido de 100 máquinas a 500 dólares cada una en Byte Shop , Woz y su amigo Steve Jobs fundaron Apple Computer .

Aproximadamente 200 de estas máquinas se vendieron antes de que la compañía anunciara el Apple II como una computadora completa. Tenía gráficos en color , un teclado QWERTY completo y ranuras internas para expansión, que estaban montadas en una carcasa de plástico aerodinámica de alta calidad. El monitor y los dispositivos de E/S se vendieron por separado. El sistema operativo original de Apple II era sólo el intérprete BASIC integrado contenido en la ROM. Se agregó Apple DOS para admitir la unidad de disquete; la última versión fue "Apple DOS 3.3".

Su precio más alto y la falta de BASIC de punto flotante , junto con la falta de sitios de distribución minorista, hicieron que sus ventas se quedaran rezagadas con respecto a las otras máquinas Trinity hasta 1979, cuando superó a la PET. Volvió a quedar en cuarto lugar cuando Atari, Inc. presentó sus computadoras Atari de 8 bits . [113]

A pesar de las lentas ventas iniciales, la vida útil de la serie Apple II fue unos ocho años más larga que la de otras máquinas, por lo que acumuló las mayores ventas totales. En 1985, se habían vendido 2,1 millones y se habían enviado más de 4 millones de Apple II al final de su producción en 1993. [114]

La comunicación óptica juega un papel crucial en las redes de comunicación . La comunicación óptica proporciona la columna vertebral de transmisión de las redes informáticas y de telecomunicaciones que sustentan Internet , la base de la revolución digital y la era de la información.

Las dos tecnologías principales son la fibra óptica y la amplificación de luz (el amplificador óptico ). En 1953, Bram van Heel demostró la transmisión de imágenes a través de haces de fibras ópticas con un revestimiento transparente. El mismo año, Harold Hopkins y Narinder Singh Kapany del Imperial College lograron fabricar haces de transmisión de imágenes con más de 10.000 fibras ópticas y posteriormente lograron la transmisión de imágenes a través de un haz de 75 cm de largo que combinaba varios miles de fibras.

Gordon Gould inventó el amplificador óptico y el láser , y también fundó la primera empresa de telecomunicaciones ópticas, Optelecom , para diseñar sistemas de comunicación. La empresa fue cofundadora de Ciena Corp. , la empresa que popularizó el amplificador óptico con la introducción del primer sistema de multiplexación por división de onda densa . [115] Esta tecnología de comunicación a gran escala se ha convertido en la base común de todas las redes de telecomunicaciones [3] y, por tanto, en la base de la era de la información. [116] [117]

Manuel Castells capta la importancia de la era de la información en La era de la información: economía, sociedad y cultura cuando escribe sobre nuestra interdependencia global y las nuevas relaciones entre economía, Estado y sociedad, lo que él llama "una nueva sociedad en ciernes". ". Advierte que sólo porque los humanos hayan dominado el mundo material no significa que la Era de la Información sea el fin de la historia:

"En realidad es todo lo contrario: la historia apenas comienza, si por historia entendemos el momento en que, después de milenios de una batalla prehistórica con la Naturaleza, primero para sobrevivir y luego para conquistarla, nuestra especie ha alcanzado el nivel del conocimiento. y organización social que nos permitirá vivir en un mundo predominantemente social. Es el comienzo de una nueva existencia, y de hecho el comienzo de una nueva era, la Era de la Información, marcada por la autonomía de la cultura frente a lo material. base de nuestra existencia." [118]

Thomas Chatterton Williams escribió sobre los peligros del antiintelectualismo en la era de la información en un artículo para The Atlantic . Aunque el acceso a la información nunca ha sido mayor, la mayor parte de la información es irrelevante o insustancial. El énfasis de la era de la información en la velocidad por encima de la experiencia contribuye a una "cultura superficial en la que incluso la elite menospreciará abiertamente como inútiles nuestros principales depósitos de lo mejor que se ha pensado". [119]

{{cite web}}: CS1 maint: archived copy as title (link)Si las ruedas detrás de la industria del CD-ROM se salen con la suya, este producto ayudará a abrir la puerta a un nuevo y valiente mundo multimedia para las microcomputadoras, donde la computadora está íntimamente vinculada con otros dispositivos electrónicos domésticos y con todos los dispositivos del hogar. House lee toneladas de datos de vídeo, audio y texto de discos CD-ROM.

Moore también afirmó que nunca dijo que el número de transistores se duplicaría cada 18 meses, como se dice comúnmente. Inicialmente, dijo que los transistores en un chip se duplicarían cada año. Luego lo recalibró cada dos años en 1975. David House, un ejecutivo de Intel en ese momento, señaló que los cambios harían que el rendimiento de la computadora se duplicara cada 18 meses.