Una computadora es una máquina que puede programarse para realizar automáticamente secuencias de operaciones aritméticas o lógicas ( cálculo ). Las computadoras electrónicas digitales modernas pueden realizar conjuntos genéricos de operaciones conocidas como programas . Estos programas permiten que las computadoras realicen una amplia gama de tareas. El término sistema informático puede referirse a una computadora nominalmente completa que incluye el hardware , el sistema operativo , el software y el equipo periférico necesarios y utilizados para su pleno funcionamiento; o a un grupo de computadoras que están vinculadas y funcionan juntas, como una red de computadoras o un clúster de computadoras .

Una amplia gama de productos industriales y de consumo utilizan computadoras como sistemas de control , incluidos dispositivos sencillos para propósitos especiales, como hornos microondas y controles remotos , y dispositivos de fábrica como robots industriales . Las computadoras son el núcleo de los dispositivos de uso general, como las computadoras personales , y los dispositivos móviles, como los teléfonos inteligentes . Las computadoras impulsan Internet , que conecta a miles de millones de computadoras y usuarios.

Las primeras computadoras estaban destinadas a usarse únicamente para cálculos. Instrumentos manuales sencillos como el ábaco han ayudado a la gente a realizar cálculos desde la antigüedad. A principios de la Revolución Industrial , se construyeron algunos dispositivos mecánicos para automatizar tareas largas y tediosas, como guiar patrones para telares . A principios del siglo XX, máquinas eléctricas más sofisticadas realizaban cálculos analógicos especializados. Las primeras máquinas calculadoras electrónicas digitales se desarrollaron durante la Segunda Guerra Mundial , tanto electromecánicas como mediante válvulas termoiónicas . A los primeros transistores semiconductores a finales de la década de 1940 les siguieron las tecnologías MOSFET (transistor MOS) basadas en silicio y chips de circuito integrado monolítico a finales de la década de 1950, lo que condujo a la revolución de los microprocesadores y las microcomputadoras en la década de 1970. La velocidad, la potencia y la versatilidad de las computadoras han aumentado drásticamente desde entonces, y el número de transistores aumentó a un ritmo rápido ( la ley de Moore señaló que el número se duplicaba cada dos años), lo que llevó a la Revolución Digital a finales del siglo XX y principios del XXI. .

Convencionalmente, una computadora moderna consta de al menos un elemento de procesamiento , típicamente una unidad central de procesamiento (CPU) en forma de microprocesador , junto con algún tipo de memoria de computadora , típicamente chips de memoria semiconductores . El elemento de procesamiento lleva a cabo operaciones aritméticas y lógicas, y una unidad de secuenciación y control puede cambiar el orden de las operaciones en respuesta a la información almacenada . Los dispositivos periféricos incluyen dispositivos de entrada ( teclados , ratones, joystick , etc.), dispositivos de salida (pantallas de monitor, impresoras , etc.) y dispositivos de entrada/salida que realizan ambas funciones (por ejemplo, la pantalla táctil de la década de 2000 ). Los dispositivos periféricos permiten recuperar información de una fuente externa y permiten guardar y recuperar los resultados de las operaciones.

No fue hasta mediados del siglo XX que la palabra adquirió su definición moderna; Según el Oxford English Dictionary , el primer uso conocido de la palabra computadora fue en un sentido diferente, en un libro de 1613 llamado The Yong Mans Gleanings del escritor inglés Richard Brathwait : "He leído [ sic ] la computadora más verdadera del Times, y el mejor Aritmético que jamás haya respirado, y él reduce tus días a un número corto." Este uso del término se refería a una computadora humana , una persona que realizaba cálculos o cómputos . La palabra siguió teniendo el mismo significado hasta mediados del siglo XX. Durante la última parte de este período, a menudo se contrataba a mujeres como computadoras porque se les podía pagar menos que a sus homólogos masculinos. [1] En 1943, la mayoría de las computadoras humanas eran mujeres. [2]

El Diccionario de Etimología en línea proporciona el primer uso documentado de computadora en la década de 1640, que significa "alguien que calcula"; este es un "sustantivo agente de computar (v.)". El Diccionario de Etimología en línea afirma que el uso del término para significar " 'máquina calculadora' (de cualquier tipo) data de 1897". El Diccionario de Etimología en Línea indica que el "uso moderno" del término, para significar 'computadora electrónica digital programable' data de "1945 bajo este nombre; [en un] [sentido] teórico de 1937, como máquina de Turing ". [3] El nombre se ha mantenido, aunque las computadoras modernas son capaces de realizar muchas funciones de nivel superior.

Se han utilizado dispositivos para ayudar en la computación durante miles de años, principalmente utilizando correspondencia uno a uno con los dedos . Lo más probable es que el primer dispositivo de conteo fuera una especie de palo de conteo . Las ayudas posteriores para el mantenimiento de registros en todo el Creciente Fértil incluyeron cálculos (esferas de arcilla, conos, etc.) que representaban recuentos de artículos, probablemente ganado o granos, sellados en recipientes huecos de arcilla sin cocer. [a] [4] El uso de varillas de conteo es un ejemplo.

El ábaco se utilizó inicialmente para tareas aritméticas. El ábaco romano se desarrolló a partir de dispositivos utilizados en Babilonia ya en el año 2400 a.C. Desde entonces, se han inventado muchas otras formas de tableros o tablas de cómputo. En una casa de contabilidad medieval europea , se colocaba un paño a cuadros sobre una mesa y los marcadores se movían sobre él de acuerdo con ciertas reglas, como ayuda para calcular sumas de dinero. [5]

Se cree que el mecanismo de Antikythera es la computadora analógica mecánica más antigua conocida , según Derek J. de Solla Price . [6] Fue diseñado para calcular posiciones astronómicas. Fue descubierto en 1901 en los restos del naufragio de Antikythera frente a la isla griega de Antikythera , entre Kythera y Creta , y data de aproximadamente c. 100 a . C. Dispositivos de complejidad comparable al mecanismo de Antikythera no reaparecerían hasta el siglo XIV. [7]

Se construyeron muchas ayudas mecánicas para el cálculo y la medición para uso astronómico y de navegación. El planisferio fue un mapa estelar inventado por Abū Rayhān al-Bīrūnī a principios del siglo XI. [8] El astrolabio fue inventado en el mundo helenístico en el siglo I o II a. C. y a menudo se atribuye a Hiparco . Una combinación del planisferio y la dioptra , el astrolabio era efectivamente una computadora analógica capaz de resolver varios tipos diferentes de problemas en astronomía esférica . Abi Bakr de Isfahán , Persia, inventó en 1235 un astrolabio que incorporaba una computadora de calendario mecánica [9] [10] y ruedas dentadas. [11] Abū Rayhān al-Bīrūnī inventó el primer astrolabio de calendario lunisolar con engranajes mecánicos , [ 12 ] Primera máquina de procesamiento de conocimientos con cable fijo [13] con tren de engranajes y ruedas dentadas, [14] c. 1000 d.C.

El sector , un instrumento de cálculo utilizado para resolver problemas de proporción, trigonometría, multiplicación y división, y para diversas funciones, como cuadrados y raíces cúbicas, se desarrolló a finales del siglo XVI y encontró aplicación en artillería, topografía y navegación.

El planímetro era un instrumento manual para calcular el área de una figura cerrada trazándola con un varillaje mecánico.

La regla de cálculo fue inventada alrededor de 1620-1630 por el clérigo inglés William Oughtred , poco después de la publicación del concepto de logaritmo . Es una computadora analógica manual para realizar multiplicaciones y divisiones. A medida que avanzaba el desarrollo de las reglas de cálculo, se agregaron escalas que proporcionaron recíprocos, cuadrados y raíces cuadradas, cubos y raíces cúbicas, así como funciones trascendentales como logaritmos y exponenciales, trigonometría circular e hiperbólica y otras funciones . Todavía se utilizan reglas de cálculo con escalas especiales para realizar rápidamente cálculos de rutina, como la regla de cálculo circular E6B que se utiliza para cálculos de tiempo y distancia en aviones ligeros.

En la década de 1770, Pierre Jaquet-Droz , un relojero suizo , construyó un muñeco mecánico ( autómata ) que podía escribir sosteniendo una pluma. Al cambiar el número y el orden de sus ruedas internas se podrían producir letras diferentes y, por tanto, mensajes diferentes. De hecho, podría "programarse" mecánicamente para leer instrucciones. Junto con otras dos máquinas complejas, la muñeca se encuentra en el Musée d'Art et d'Histoire de Neuchâtel , Suiza , y todavía funciona. [15]

En 1831-1835, el matemático e ingeniero Giovanni Plana ideó una máquina de calendario perpetuo que, mediante un sistema de poleas y cilindros en adelante, podía predecir el calendario perpetuo para cada año desde 0 EC (es decir, 1 a. C.) hasta 4000 EC. realizar un seguimiento de los años bisiestos y la duración variable de los días. La máquina de predicción de mareas inventada por el científico escocés Sir William Thomson en 1872 resultó de gran utilidad para la navegación en aguas poco profundas. Utilizó un sistema de poleas y cables para calcular automáticamente los niveles de marea previstos para un período determinado en un lugar determinado.

El analizador diferencial , una computadora mecánica analógica diseñada para resolver ecuaciones diferenciales por integración , utilizaba mecanismos de rueda y disco para realizar la integración. En 1876, Sir William Thomson ya había discutido la posible construcción de tales calculadoras, pero se había visto obstaculizado por el par de salida limitado de los integradores de bolas y discos . [16] En un analizador diferencial, la salida de un integrador impulsó la entrada del siguiente integrador, o una salida gráfica. El amplificador de par fue el avance que permitió funcionar a estas máquinas. A partir de la década de 1920, Vannevar Bush y otros desarrollaron analizadores diferenciales mecánicos.

En la década de 1890, el ingeniero español Leonardo Torres Quevedo comenzó a desarrollar una serie de máquinas analógicas avanzadas que podían resolver raíces reales y complejas de polinomios , [17] [18] [19] [20] que fueron publicadas en 1901 por la Academia de París. de Ciencias . [21]

Charles Babbage , un ingeniero mecánico y erudito inglés , originó el concepto de computadora programable. Considerado el " padre de la computadora ", [22] conceptualizó e inventó la primera computadora mecánica a principios del siglo XIX.

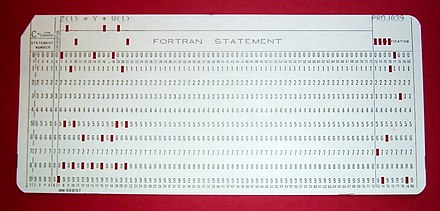

Después de trabajar en su motor diferencial, anunció su invento en 1822, en un artículo para la Royal Astronomical Society , titulado "Nota sobre la aplicación de maquinaria al cálculo de tablas astronómicas y matemáticas", [23] que también diseñó para ayudar en la navegación. Cálculos, en 1833 se dio cuenta de que era posible un diseño mucho más general, una máquina analítica . La entrada de programas y datos debía realizarse a la máquina mediante tarjetas perforadas , método que se utilizaba en aquella época para dirigir telares mecánicos como el telar Jacquard . Para la salida, la máquina tendría una impresora, un trazador de curvas y una campana. La máquina también podría perforar números en tarjetas para leerlos más tarde. El motor incorporaría una unidad lógica aritmética , flujo de control en forma de bifurcaciones y bucles condicionales y memoria integrada , lo que lo convertiría en el primer diseño de una computadora de propósito general que podría describirse en términos modernos como Turing completo . [24] [25]

La máquina se adelantó aproximadamente un siglo a su tiempo. Todas las piezas de su máquina debían fabricarse a mano; este era un problema importante para un dispositivo con miles de piezas. Finalmente, el proyecto se disolvió con la decisión del gobierno británico de dejar de financiarlo. El fracaso de Babbage a la hora de completar el motor analítico puede atribuirse principalmente a dificultades políticas y financieras, así como a su deseo de desarrollar una computadora cada vez más sofisticada y avanzar más rápido de lo que nadie podría seguir. Sin embargo, su hijo, Henry Babbage , completó una versión simplificada de la unidad informática de la máquina analítica (el molino ) en 1888. Dio una demostración exitosa de su uso en mesas informáticas en 1906.

En su obra Ensayos sobre automática publicada en 1914, Leonardo Torres Quevedo escribió una breve historia de los esfuerzos de Babbage por construir una máquina diferencial mecánica y una máquina analítica. El artículo contiene el diseño de una máquina capaz de calcular fórmulas como , para una secuencia de conjuntos de valores. Toda la máquina debía ser controlada por un programa de sólo lectura , que se completaba con disposiciones para la bifurcación condicional . También introdujo la idea de la aritmética de punto flotante . [26] [27] [28] En 1920, para celebrar el centenario de la invención del aritmómetro , Torres presentó en París el aritmómetro electromecánico, que permitía al usuario introducir problemas aritméticos a través de un teclado , y calcular e imprimir los resultados. , [29] [30] [31] [32] demostrando la viabilidad de un motor analítico electromecánico. [33]

Durante la primera mitad del siglo XX, muchas necesidades informáticas científicas fueron satisfechas por computadoras analógicas cada vez más sofisticadas, que utilizaban un modelo mecánico o eléctrico directo del problema como base para el cálculo . Sin embargo, estos no eran programables y, en general, carecían de la versatilidad y precisión de las computadoras digitales modernas. [34] La primera computadora analógica moderna fue una máquina de predicción de mareas , inventada por Sir William Thomson (más tarde Lord Kelvin) en 1872. El analizador diferencial , una computadora analógica mecánica diseñada para resolver ecuaciones diferenciales mediante integración usando rueda y- mecanismos de disco, fue conceptualizado en 1876 por James Thomson , el hermano mayor del más famoso Sir William Thomson. [dieciséis]

El arte de la computación mecánica analógica alcanzó su cenit con el analizador diferencial , construido por HL Hazen y Vannevar Bush en el MIT a partir de 1927. Se basó en los integradores mecánicos de James Thomson y los amplificadores de par inventados por HW Nieman. Se construyeron una docena de estos dispositivos antes de que su obsolescencia se hiciera evidente. En la década de 1950, el éxito de las computadoras electrónicas digitales había significado el fin de la mayoría de las máquinas informáticas analógicas, pero las computadoras analógicas siguieron utilizándose durante la década de 1950 en algunas aplicaciones especializadas como la educación ( regla de cálculo ) y las aeronaves ( sistemas de control ).

En 1938, la Armada de los Estados Unidos había desarrollado una computadora analógica electromecánica lo suficientemente pequeña como para usarla a bordo de un submarino . Se trataba del Torpedo Data Computer , que utilizaba la trigonometría para resolver el problema de disparar un torpedo a un objetivo en movimiento. Durante la Segunda Guerra Mundial también se desarrollaron dispositivos similares en otros países.

Las primeras computadoras digitales eran electromecánicas ; Los interruptores eléctricos accionaban relés mecánicos para realizar el cálculo. Estos dispositivos tenían una velocidad de funcionamiento baja y finalmente fueron reemplazados por computadoras totalmente eléctricas mucho más rápidas, que originalmente usaban tubos de vacío . El Z2 , creado por el ingeniero alemán Konrad Zuse en 1939 en Berlín , fue uno de los primeros ejemplos de computadora de relé electromecánico. [35]

.jpg/440px-Konrad_Zuse_(1992).jpg)

En 1941, Zuse siguió su máquina anterior con la Z3 , la primera computadora digital electromecánica, programable y totalmente automática en funcionamiento del mundo . [38] [39] El Z3 se construyó con 2000 relés , implementando una longitud de palabra de 22 bits que operaba a una frecuencia de reloj de aproximadamente 5 a 10 Hz . [40] El código del programa se suministraba en una película perforada , mientras que los datos podían almacenarse en 64 palabras de memoria o suministrarse desde el teclado. Era bastante similar a las máquinas modernas en algunos aspectos y fue pionera en numerosos avances, como los números de punto flotante . En lugar del sistema decimal, más difícil de implementar (utilizado en el diseño anterior de Charles Babbage ), el uso de un sistema binario significó que las máquinas de Zuse eran más fáciles de construir y potencialmente más confiables, dadas las tecnologías disponibles en ese momento. [41] El Z3 no era en sí mismo un ordenador universal, pero podía ampliarse para ser Turing completo . [42] [43]

La siguiente computadora de Zuse, la Z4 , se convirtió en la primera computadora comercial del mundo; Después de un retraso inicial debido a la Segunda Guerra Mundial, se completó en 1950 y se entregó a la ETH Zurich . [44] La computadora fue fabricada por la propia empresa de Zuse, Zuse KG , que fue fundada en 1941 como la primera empresa con el único propósito de desarrollar computadoras en Berlín. [44]

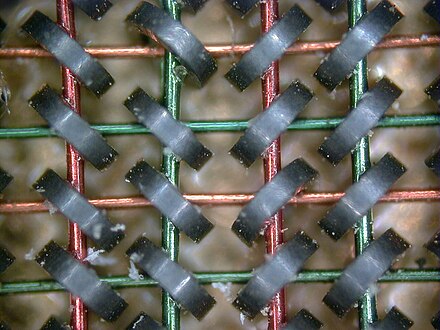

Los elementos de circuitos puramente electrónicos pronto reemplazaron a sus equivalentes mecánicos y electromecánicos, al mismo tiempo que el cálculo digital reemplazó al analógico. El ingeniero Tommy Flowers , que trabajaba en la Post Office Research Station de Londres en los años 1930, comenzó a explorar el posible uso de la electrónica para la central telefónica . El equipo experimental que construyó en 1934 entró en funcionamiento cinco años después, convirtiendo una parte de la red telefónica en un sistema de procesamiento electrónico de datos, utilizando miles de tubos de vacío . [34] En los EE. UU., John Vincent Atanasoff y Clifford E. Berry de la Universidad Estatal de Iowa desarrollaron y probaron la computadora Atanasoff-Berry (ABC) en 1942, [45] la primera "computadora digital electrónica automática". [46] Este diseño también era totalmente electrónico y utilizaba alrededor de 300 tubos de vacío, con condensadores fijados en un tambor giratorio mecánicamente para la memoria. [47]

Durante la Segunda Guerra Mundial, los descifradores de códigos británicos de Bletchley Park lograron varios éxitos al descifrar las comunicaciones militares alemanas cifradas. La máquina de cifrado alemana Enigma fue atacada por primera vez con la ayuda de bombas electromecánicas que a menudo eran manejadas por mujeres. [48] [49] Para descifrar la máquina alemana Lorenz SZ 40/42 más sofisticada , utilizada para comunicaciones de alto nivel del ejército, Max Newman y sus colegas encargaron a Flowers que construyera el Colossus . [47] Pasó once meses desde principios de febrero de 1943 diseñando y construyendo el primer Coloso. [50] Después de una prueba funcional en diciembre de 1943, Colossus fue enviado a Bletchley Park, donde fue entregado el 18 de enero de 1944 [51] y atacó su primer mensaje el 5 de febrero. [47]

Colossus fue la primera computadora electrónica digital programable del mundo . [34] Utilizaba una gran cantidad de válvulas (tubos de vacío). Tenía entrada de cinta de papel y podía configurarse para realizar una variedad de operaciones lógicas booleanas en sus datos, pero no estaba completo en Turing. Se construyeron nueve Mk II Colossi (el Mk I se convirtió en un Mk II, obteniendo diez máquinas en total). Colossus Mark I contenía 1.500 válvulas termoiónicas (tubos), pero el Mark II con 2.400 válvulas era cinco veces más rápido y más sencillo de operar que el Mark I, lo que aceleró enormemente el proceso de decodificación. [52] [53]

El ENIAC [54] (Computador e Integrador Numérico Electrónico) fue el primer ordenador electrónico programable construido en los EE. UU. Aunque el ENIAC era similar al Colossus, era mucho más rápido, más flexible y estaba completo en Turing. Al igual que el Colossus, un "programa" en el ENIAC estaba definido por los estados de sus cables de conexión e interruptores, muy lejos de las máquinas electrónicas con programas almacenados que vinieron después. Una vez que se escribía un programa, debía configurarse mecánicamente en la máquina con reinicio manual de enchufes e interruptores. Las programadoras de la ENIAC eran seis mujeres, a menudo conocidas colectivamente como las "chicas ENIAC". [55] [56]

Combinaba la alta velocidad de la electrónica con la capacidad de ser programado para muchos problemas complejos. Podía sumar o restar 5.000 veces por segundo, mil veces más rápido que cualquier otra máquina. También tenía módulos para multiplicar, dividir y raíz cuadrada. La memoria de alta velocidad estaba limitada a 20 palabras (unos 80 bytes). Construida bajo la dirección de John Mauchly y J. Presper Eckert en la Universidad de Pensilvania, el desarrollo y la construcción de ENIAC duraron desde 1943 hasta su pleno funcionamiento a finales de 1945. La máquina era enorme, pesaba 30 toneladas y consumía 200 kilovatios de energía eléctrica y Contenía más de 18.000 tubos de vacío, 1.500 relés y cientos de miles de resistencias, condensadores e inductores. [57]

El principio de la computadora moderna fue propuesto por Alan Turing en su artículo fundamental de 1936, [58] On Computable Numbers . Turing propuso un dispositivo simple al que llamó "Máquina de Computación Universal" y que ahora se conoce como máquina de Turing universal . Demostró que una máquina de este tipo es capaz de calcular cualquier cosa que sea computable ejecutando instrucciones (programas) almacenadas en cinta, lo que permite que la máquina sea programable. El concepto fundamental del diseño de Turing es el programa almacenado , donde todas las instrucciones para la computación se almacenan en la memoria. Von Neumann reconoció que el concepto central de la computadora moderna se debió a este artículo. [59] Las máquinas de Turing son hasta el día de hoy un objeto central de estudio en la teoría de la computación . Excepto por las limitaciones impuestas por sus almacenes de memoria finitos, se dice que las computadoras modernas son Turing-completas , es decir, tienen una capacidad de ejecución de algoritmos equivalente a una máquina de Turing universal.

Las primeras máquinas informáticas tenían programas fijos. Cambiar su función requirió volver a cablear y reestructurar la máquina. [47] Con la propuesta de la computadora con programa almacenado esto cambió. Una computadora con programa almacenado incluye por diseño un conjunto de instrucciones y puede almacenar en la memoria un conjunto de instrucciones (un programa ) que detalla el cálculo . Alan Turing expuso la base teórica de la computadora con programas almacenados en su artículo de 1936. En 1945, Turing se unió al Laboratorio Nacional de Física y comenzó a trabajar en el desarrollo de una computadora digital electrónica con programa almacenado. Su informe de 1945 "Calculadora electrónica propuesta" fue la primera especificación para un dispositivo de este tipo. John von Neumann, de la Universidad de Pensilvania, también hizo circular su primer borrador de un informe sobre el EDVAC en 1945. [34]

El Manchester Baby fue el primer ordenador con programas almacenados del mundo . Fue construido en la Universidad de Manchester en Inglaterra por Frederic C. Williams , Tom Kilburn y Geoff Tootill , y ejecutó su primer programa el 21 de junio de 1948. [60] Fue diseñado como banco de pruebas para el tubo Williams , el primer tubo aleatorio. acceder al dispositivo de almacenamiento digital. [61] Aunque la computadora fue descrita como "pequeña y primitiva" en una retrospectiva de 1998, fue la primera máquina en funcionamiento que contenía todos los elementos esenciales de una computadora electrónica moderna. [62] Tan pronto como el Baby demostró la viabilidad de su diseño, se inició un proyecto en la universidad para convertirlo en una computadora prácticamente útil, la Manchester Mark 1 .

El Mark 1, a su vez, se convirtió rápidamente en el prototipo del Ferranti Mark 1 , el primer ordenador de uso general disponible comercialmente en el mundo. [63] Construida por Ferranti , fue entregada a la Universidad de Manchester en febrero de 1951. Al menos siete de estas últimas máquinas fueron entregadas entre 1953 y 1957, una de ellas a los laboratorios Shell en Ámsterdam . [64] En octubre de 1947, los directores de la empresa de catering británica J. Lyons & Company decidieron asumir un papel activo en la promoción del desarrollo comercial de las computadoras. La computadora LEO I de Lyons , inspirada fielmente en la EDSAC de Cambridge de 1949, entró en funcionamiento en abril de 1951 [65] y realizó el primer trabajo rutinario de computadora de oficina del mundo .

El concepto de transistor de efecto de campo fue propuesto por Julius Edgar Lilienfeld en 1925. John Bardeen y Walter Brattain , mientras trabajaban con William Shockley en Bell Labs , construyeron el primer transistor funcional , el transistor de contacto puntual , en 1947, al que siguió por el transistor de unión bipolar de Shockley en 1948. [66] [67] A partir de 1955, los transistores reemplazaron a los tubos de vacío en los diseños de computadoras, dando lugar a la "segunda generación" de computadoras. En comparación con las válvulas de vacío, los transistores tienen muchas ventajas: son más pequeños y requieren menos energía que las válvulas de vacío, por lo que desprenden menos calor. Los transistores de unión eran mucho más fiables que los tubos de vacío y tenían una vida útil más larga e indefinida. Las computadoras transistorizadas podrían contener decenas de miles de circuitos lógicos binarios en un espacio relativamente compacto. Sin embargo, los primeros transistores de unión eran dispositivos relativamente voluminosos y difíciles de fabricar en masa , lo que los limitaba a una serie de aplicaciones especializadas. [68]

En la Universidad de Manchester , un equipo bajo el liderazgo de Tom Kilburn diseñó y construyó una máquina utilizando transistores recientemente desarrollados en lugar de válvulas. [69] Su primera computadora transistorizada y la primera en el mundo, estuvo operativa en 1953 , y una segunda versión se completó allí en abril de 1955. Sin embargo, la máquina hizo uso de válvulas para generar sus formas de onda de reloj de 125 kHz y en los circuitos. para leer y escribir en su memoria de tambor magnético , por lo que no fue el primer ordenador completamente transistorizado. Esa distinción corresponde al Harwell CADET de 1955, [70] construido por la división de electrónica del Atomic Energy Research Establishment de Harwell . [70] [71]

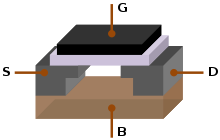

El transistor de efecto de campo de óxido de metal y silicio (MOSFET), también conocido como transistor MOS, fue inventado por Mohamed M. Atalla y Dawon Kahng en Bell Labs en 1959. [72] Fue el primer transistor verdaderamente compacto que pudo ser miniaturizados y producidos en masa para una amplia gama de usos. [68] Con su alta escalabilidad , [73] y un consumo de energía mucho menor y mayor densidad que los transistores de unión bipolar, [74] el MOSFET hizo posible construir circuitos integrados de alta densidad . [75] [76] Además del procesamiento de datos, también permitió el uso práctico de transistores MOS como elementos de almacenamiento de celdas de memoria , lo que llevó al desarrollo de la memoria semiconductora MOS , que reemplazó a la anterior memoria de núcleo magnético en las computadoras. El MOSFET condujo a la revolución de las microcomputadoras , [77] y se convirtió en la fuerza impulsora detrás de la revolución de las computadoras . [78] [79] El MOSFET es el transistor más utilizado en computadoras, [80] [81] y es el componente fundamental de la electrónica digital . [82]

El siguiente gran avance en la potencia informática se produjo con la llegada del circuito integrado (CI). La idea del circuito integrado fue concebida por primera vez por un científico de radar que trabajaba para el Royal Radar Establishment del Ministerio de Defensa , Geoffrey WA Dummer . Dummer presentó la primera descripción pública de un circuito integrado en el Simposio sobre el progreso en componentes electrónicos de calidad en Washington, DC , el 7 de mayo de 1952. [83]

Los primeros circuitos integrados en funcionamiento fueron inventados por Jack Kilby en Texas Instruments y Robert Noyce en Fairchild Semiconductor . [84] Kilby registró sus ideas iniciales sobre el circuito integrado en julio de 1958, demostrando con éxito el primer ejemplo integrado funcional el 12 de septiembre de 1958. [85] En su solicitud de patente del 6 de febrero de 1959, Kilby describió su nuevo dispositivo como "un cuerpo de material semiconductor... en el que todos los componentes del circuito electrónico están completamente integrados". [86] [87] Sin embargo, la invención de Kilby fue un circuito integrado híbrido (CI híbrido), en lugar de un chip de circuito integrado (CI) monolítico. [88] El CI de Kilby tenía conexiones de cables externas, lo que dificultaba su producción en masa. [89]

A Noyce también se le ocurrió su propia idea de un circuito integrado medio año después que Kilby. [90] La invención de Noyce fue el primer chip IC verdaderamente monolítico. [91] [89] Su chip resolvió muchos problemas prácticos que Kilby no había resuelto. Producido en Fairchild Semiconductor, estaba hecho de silicio , mientras que el chip de Kilby estaba hecho de germanio . El circuito integrado monolítico de Noyce se fabricó mediante el proceso planar , desarrollado por su colega Jean Hoerni a principios de 1959. A su vez, el proceso planar se basó en el trabajo de Mohamed M. Atalla sobre la pasivación de superficies semiconductoras mediante dióxido de silicio a finales de los años cincuenta. [92] [93] [94]

Los circuitos integrados monolíticos modernos son predominantemente circuitos integrados MOS ( semiconductores de óxido metálico ), construidos a partir de MOSFET (transistores MOS). [95] El primer MOS IC experimental que se fabricó fue un chip de 16 transistores construido por Fred Heiman y Steven Hofstein en RCA en 1962. [96] General Microelectronics introdujo más tarde el primer MOS IC comercial en 1964, [97] desarrollado por Robert Normando. [96] Tras el desarrollo del transistor MOS de puerta autoalineada (puerta de silicio) por Robert Kerwin, Donald Klein y John Sarace en Bell Labs en 1967, Federico desarrolló el primer MOS IC con puerta de silicio con puertas autoalineadas. Faggin en Fairchild Semiconductor en 1968. [98] Desde entonces, el MOSFET se ha convertido en el componente de dispositivo más crítico de los circuitos integrados modernos. [95]

El desarrollo del circuito integrado MOS condujo a la invención del microprocesador , [99] [100] y anunció una explosión en el uso comercial y personal de las computadoras. Si bien el tema de exactamente qué dispositivo fue el primer microprocesador es polémico, en parte debido a la falta de acuerdo sobre la definición exacta del término "microprocesador", es en gran medida indiscutible que el primer microprocesador de un solo chip fue el Intel 4004 , [101] diseñado y realizado por Federico Faggin con su tecnología MOS IC de puerta de silicio, [99] junto con Ted Hoff , Masatoshi Shima y Stanley Mazor en Intel . [b] [103] A principios de la década de 1970, la tecnología MOS IC permitió la integración de más de 10.000 transistores en un solo chip. [76]

Los sistemas en un chip (SoC) son computadoras completas en un microchip (o chip) del tamaño de una moneda. [104] Pueden o no tener RAM y memoria flash integradas . Si no está integrada, la RAM generalmente se coloca directamente encima (conocida como Paquete en paquete ) o debajo (en el lado opuesto de la placa de circuito ) del SoC, y la memoria flash generalmente se coloca justo al lado del SoC, todo esto para mejorar las velocidades de transferencia de datos, ya que las señales de datos no tienen que viajar largas distancias. Desde ENIAC en 1945, las computadoras han avanzado enormemente, con SoC modernos (como el Snapdragon 865) que tienen el tamaño de una moneda y al mismo tiempo son cientos de miles de veces más potentes que ENIAC, integran miles de millones de transistores y consumen solo unos pocos vatios. de poder.

Los primeros ordenadores móviles eran pesados y funcionaban con red eléctrica. El IBM 5100 de 50 libras (23 kg) fue un ejemplo temprano. Los portátiles posteriores, como el Osborne 1 y el Compaq Portable , eran considerablemente más ligeros, pero aún necesitaban estar conectados. Los primeros portátiles, como el Grid Compass , eliminaron este requisito al incorporar baterías, y con la continua miniaturización de los recursos informáticos y los avances en los portátiles. Debido a la duración de la batería, las computadoras portátiles ganaron popularidad en la década de 2000. [105] Los mismos avances permitieron a los fabricantes integrar recursos informáticos en teléfonos móviles a principios de la década de 2000.

Estos teléfonos inteligentes y tabletas funcionan con una variedad de sistemas operativos y recientemente se convirtieron en el dispositivo informático dominante en el mercado. [106] Estos funcionan con System on a Chip (SoC), que son computadoras completas en un microchip del tamaño de una moneda. [104]

Las computadoras se pueden clasificar de varias maneras diferentes, que incluyen:

El término hardware cubre todas aquellas partes de una computadora que son objetos físicos tangibles. Los circuitos , los chips de computadora, las tarjetas gráficas, las tarjetas de sonido, la memoria (RAM), la placa base, las pantallas, las fuentes de alimentación, los cables, los teclados, las impresoras y los "ratones" son dispositivos de entrada.

Una computadora de propósito general tiene cuatro componentes principales: la unidad lógica aritmética (ALU), la unidad de control , la memoria y los dispositivos de entrada y salida (denominados colectivamente E/S). Estas partes están interconectadas por buses , a menudo formados por grupos de cables . Dentro de cada una de estas partes hay miles o billones de pequeños circuitos eléctricos que pueden encenderse o apagarse mediante un interruptor electrónico . Cada circuito representa un bit (dígito binario) de información de modo que cuando el circuito está encendido representa un "1", y cuando está apagado representa un "0" (en representación de lógica positiva). Los circuitos están dispuestos en puertas lógicas de modo que uno o más circuitos puedan controlar el estado de uno o más de los otros circuitos.

Cuando los datos no procesados se envían a la computadora con la ayuda de dispositivos de entrada, los datos se procesan y se envían a dispositivos de salida. Los dispositivos de entrada pueden ser operados manualmente o automatizados. El acto de procesamiento está regulado principalmente por la CPU. Algunos ejemplos de dispositivos de entrada son:

Los medios a través de los cuales la computadora genera resultados se conocen como dispositivos de salida. Algunos ejemplos de dispositivos de salida son:

La unidad de control (a menudo llamada sistema de control o controlador central) gestiona los diversos componentes de la computadora; lee e interpreta (decodifica) las instrucciones del programa, transformándolas en señales de control que activan otras partes de la computadora. [d] Los sistemas de control en computadoras avanzadas pueden cambiar el orden de ejecución de algunas instrucciones para mejorar el rendimiento.

Un componente clave común a todas las CPU es el contador de programa , una celda de memoria especial (un registro ) que realiza un seguimiento de desde qué ubicación en la memoria se leerá la siguiente instrucción. [mi]

La función del sistema de control es la siguiente: esta es una descripción simplificada y algunos de estos pasos pueden realizarse simultáneamente o en un orden diferente según el tipo de CPU:

Dado que el contador del programa es (conceptualmente) simplemente otro conjunto de celdas de memoria, se puede cambiar mediante cálculos realizados en la ALU. Agregar 100 al contador del programa haría que la siguiente instrucción se leyera desde un lugar 100 ubicaciones más abajo en el programa. Las instrucciones que modifican el contador del programa a menudo se conocen como "saltos" y permiten bucles (instrucciones que repite la computadora) y, a menudo, la ejecución de instrucciones condicionales (ambos ejemplos de flujo de control ).

La secuencia de operaciones que realiza la unidad de control para procesar una instrucción es en sí misma como un programa de computadora corto y, de hecho, en algunos diseños de CPU más complejos, hay otra computadora aún más pequeña llamada microsecuenciador , que ejecuta un programa de microcódigo que causa que todos estos eventos sucedan.

La unidad de control, la ALU y los registros se conocen colectivamente como unidad central de procesamiento (CPU). Las primeras CPU estaban compuestas por muchos componentes separados. Desde la década de 1970, las CPU se han construido normalmente en un único chip de circuito integrado MOS llamado microprocesador .

La ALU es capaz de realizar dos clases de operaciones: aritméticas y lógicas. [111] El conjunto de operaciones aritméticas que admite una ALU particular puede limitarse a la suma y la resta, o puede incluir multiplicación, división, funciones trigonométricas como seno, coseno, etc., y raíces cuadradas . Algunos pueden operar sólo con números enteros ( enteros ), mientras que otros utilizan el punto flotante para representar números reales , aunque con precisión limitada. Sin embargo, cualquier computadora que sea capaz de realizar sólo las operaciones más simples puede programarse para dividir las operaciones más complejas en pasos simples que pueda realizar. Por lo tanto, cualquier computadora puede programarse para realizar cualquier operación aritmética, aunque llevará más tiempo hacerlo si su ALU no admite directamente la operación. Una ALU también puede comparar números y devolver valores de verdad booleanos (verdaderos o falsos) dependiendo de si uno es igual, mayor o menor que el otro ("¿64 es mayor que 65?"). Las operaciones lógicas implican lógica booleana : AND , OR , XOR y NOT . Estos pueden resultar útiles para crear sentencias condicionales complicadas y procesar lógica booleana .

Las computadoras superescalares pueden contener múltiples ALU, lo que les permite procesar varias instrucciones simultáneamente. [112] Los procesadores gráficos y las computadoras con características SIMD y MIMD a menudo contienen ALU que pueden realizar aritmética en vectores y matrices .

La memoria de una computadora puede verse como una lista de celdas en las que se pueden colocar o leer números. Cada celda tiene una "dirección" numerada y puede almacenar un solo número. Se puede indicar a la computadora que "ponga el número 123 en la celda número 1357" o que "suma el número que está en la celda 1357 al número que está en la celda 2468 y coloque la respuesta en la celda 1595". La información almacenada en la memoria puede representar prácticamente cualquier cosa. Letras, números e incluso instrucciones de computadora se pueden guardar en la memoria con la misma facilidad. Dado que la CPU no diferencia entre diferentes tipos de información, es responsabilidad del software dar significado a lo que la memoria ve como nada más que una serie de números.

En casi todas las computadoras modernas, cada celda de memoria está configurada para almacenar números binarios en grupos de ocho bits (llamados bytes ). Cada byte es capaz de representar 256 números diferentes (2 8 = 256); ya sea de 0 a 255 o de −128 a +127. Para almacenar números mayores, se pueden utilizar varios bytes consecutivos (normalmente dos, cuatro u ocho). Cuando se requieren números negativos, generalmente se almacenan en notación en complemento a dos . Son posibles otras disposiciones, pero normalmente no se ven fuera de aplicaciones especializadas o contextos históricos. Una computadora puede almacenar cualquier tipo de información en la memoria si se puede representar numéricamente. Las computadoras modernas tienen miles de millones o incluso billones de bytes de memoria.

La CPU contiene un conjunto especial de celdas de memoria llamadas registros que se pueden leer y escribir mucho más rápidamente que el área de memoria principal. Normalmente hay entre dos y cien registros según el tipo de CPU. Los registros se utilizan para los elementos de datos que se necesitan con más frecuencia para evitar tener que acceder a la memoria principal cada vez que se necesitan datos. Como se trabaja constantemente con los datos, la reducción de la necesidad de acceder a la memoria principal (que suele ser lenta en comparación con la ALU y las unidades de control) aumenta considerablemente la velocidad de la computadora.

La memoria principal de la computadora se presenta en dos variedades principales:

La RAM se puede leer y escribir en cualquier momento que la CPU lo ordene, pero la ROM está precargada con datos y software que nunca cambian, por lo tanto, la CPU solo puede leer desde ella. La ROM se utiliza normalmente para almacenar las instrucciones de inicio iniciales de la computadora. En general, el contenido de la RAM se borra cuando se apaga la computadora, pero la ROM retiene sus datos indefinidamente. En una PC, la ROM contiene un programa especializado llamado BIOS que organiza la carga del sistema operativo de la computadora desde el disco duro a la RAM cada vez que se enciende o reinicia la computadora. En las computadoras integradas , que frecuentemente no tienen unidades de disco, todo el software requerido puede almacenarse en una ROM. El software almacenado en la ROM a menudo se denomina firmware , porque en teoría se parece más a hardware que a software. La memoria flash borra la distinción entre ROM y RAM, ya que conserva sus datos cuando está apagada pero también es regrabable. Sin embargo, suele ser mucho más lento que la ROM y la RAM convencionales, por lo que su uso está restringido a aplicaciones en las que la alta velocidad no es necesaria. [F]

En ordenadores más sofisticados puede haber una o más memorias caché RAM , que son más lentas que los registros pero más rápidas que la memoria principal. Generalmente, las computadoras con este tipo de caché están diseñadas para mover automáticamente los datos que se necesitan con frecuencia al caché, a menudo sin necesidad de ninguna intervención por parte del programador.

La E/S es el medio por el cual una computadora intercambia información con el mundo exterior. [114] Los dispositivos que proporcionan entrada o salida a la computadora se denominan periféricos . [115] En una computadora personal típica, los periféricos incluyen dispositivos de entrada como el teclado y el mouse , y dispositivos de salida como la pantalla y la impresora . Las unidades de disco duro , las unidades de disquete y las unidades de discos ópticos sirven como dispositivos de entrada y salida. Las redes de computadoras son otra forma de E/S. Los dispositivos de E/S suelen ser ordenadores complejos en sí mismos, con su propia CPU y memoria. Una unidad de procesamiento de gráficos puede contener cincuenta o más computadoras pequeñas que realizan los cálculos necesarios para mostrar gráficos en 3D . [ cita necesaria ] Las computadoras de escritorio modernas contienen muchas computadoras más pequeñas que ayudan a la CPU principal a realizar E/S. Una pantalla plana de la era 2016 contiene sus propios circuitos de computadora.

Si bien se puede considerar que una computadora ejecuta un programa gigantesco almacenado en su memoria principal, en algunos sistemas es necesario dar la apariencia de ejecutar varios programas simultáneamente. Esto se logra mediante la multitarea, es decir, haciendo que la computadora cambie rápidamente entre la ejecución de cada programa por turno. [116] Un medio por el cual esto se hace es con una señal especial llamada interrupción , que puede hacer que periódicamente la computadora deje de ejecutar instrucciones donde estaba y haga otra cosa en su lugar. Al recordar dónde se estaba ejecutando antes de la interrupción, la computadora puede volver a esa tarea más tarde. Si se ejecutan varios programas "al mismo tiempo". entonces el generador de interrupciones podría estar provocando varios cientos de interrupciones por segundo, provocando un cambio de programa cada vez. Dado que las computadoras modernas generalmente ejecutan instrucciones varios órdenes de magnitud más rápido que la percepción humana, puede parecer que muchos programas se están ejecutando al mismo tiempo, aunque solo uno se esté ejecutando en un instante dado. Este método de multitarea a veces se denomina "tiempo compartido", ya que a cada programa se le asigna una "porción" de tiempo por turno. [117]

Antes de la era de las computadoras económicas, el uso principal de la multitarea era permitir que muchas personas compartieran la misma computadora. Aparentemente, la multitarea haría que una computadora que cambia entre varios programas se ejecutara más lentamente, en proporción directa a la cantidad de programas que está ejecutando, pero la mayoría de los programas pasan gran parte de su tiempo esperando que los dispositivos de entrada/salida lentos completen sus tareas. Si un programa está esperando que el usuario haga clic con el mouse o presione una tecla en el teclado, entonces no tomará un "intervalo de tiempo" hasta que haya ocurrido el evento que está esperando. Esto libera tiempo para que se ejecuten otros programas, de modo que muchos programas puedan ejecutarse simultáneamente sin una pérdida de velocidad inaceptable.

Algunas computadoras están diseñadas para distribuir su trabajo entre varias CPU en una configuración de multiprocesamiento, una técnica que antes se empleaba sólo en máquinas grandes y potentes, como supercomputadoras , computadoras centrales y servidores . Las computadoras personales y portátiles con múltiples procesadores y múltiples núcleos (múltiples CPU en un solo circuito integrado) ahora están ampliamente disponibles y, como resultado, se utilizan cada vez más en los mercados de gama baja.

Las supercomputadoras en particular suelen tener arquitecturas muy singulares que difieren significativamente de la arquitectura básica de programas almacenados y de las computadoras de propósito general. [g] A menudo cuentan con miles de CPU, interconexiones de alta velocidad personalizadas y hardware informático especializado. Estos diseños tienden a ser útiles sólo para tareas especializadas debido a la gran escala de organización del programa necesaria para utilizar la mayoría de los recursos disponibles a la vez. Las supercomputadoras generalmente se utilizan en aplicaciones de simulación , representación de gráficos y criptografía a gran escala , así como en otras tareas llamadas " vergonzosamente paralelas ".

El software se refiere a partes de la computadora que no tienen forma material, como programas, datos, protocolos, etc. El software es la parte de un sistema informático que consiste en información codificada o instrucciones de computadora, a diferencia del hardware físico del cual el sistema está construido. El software informático incluye programas informáticos, bibliotecas y datos no ejecutables relacionados , como documentación en línea o medios digitales . A menudo se divide en software de sistema y software de aplicación . El hardware y el software informático se necesitan mutuamente y, de manera realista, ninguno de ellos puede utilizarse por sí solo. Cuando el software se almacena en hardware que no se puede modificar fácilmente, como la BIOS ROM en una computadora compatible con IBM PC , a veces se le llama "firmware".

Hay miles de lenguajes de programación diferentes: algunos destinados a fines generales, otros útiles sólo para aplicaciones altamente especializadas.

La característica definitoria de las computadoras modernas que las distingue de todas las demás máquinas es que pueden programarse . Es decir que se le puede dar algún tipo de instrucciones (el programa ) a la computadora, y ésta las procesará. Las computadoras modernas basadas en la arquitectura von Neumann a menudo tienen código de máquina en forma de lenguaje de programación imperativo . En términos prácticos, un programa de ordenador puede consistir sólo en unas pocas instrucciones o abarcar muchos millones de instrucciones, como ocurre, por ejemplo, con los programas para procesadores de texto y navegadores web . Una computadora moderna típica puede ejecutar miles de millones de instrucciones por segundo ( gigaflops ) y rara vez comete un error durante muchos años de funcionamiento. Los equipos de programadores pueden tardar años en escribir grandes programas informáticos que constan de varios millones de instrucciones y, debido a la complejidad de la tarea, es casi seguro que contengan errores.

Esta sección se aplica a las computadoras basadas en máquinas RAM más comunes .

En la mayoría de los casos, las instrucciones de la computadora son simples: sumar un número a otro, mover algunos datos de una ubicación a otra, enviar un mensaje a algún dispositivo externo, etc. Estas instrucciones se leen de la memoria de la computadora y generalmente se llevan a cabo ( ejecutadas ). en el orden en que fueron dadas. Sin embargo, normalmente existen instrucciones especializadas para indicarle a la computadora que salte hacia adelante o hacia atrás a algún otro lugar del programa y que continúe ejecutándolo desde allí. Éstas se denominan instrucciones de "salto" (o ramas ). Además, se pueden hacer que las instrucciones de salto se realicen de forma condicional, de modo que se puedan utilizar diferentes secuencias de instrucciones dependiendo del resultado de algún cálculo previo o de algún evento externo. Muchas computadoras admiten directamente subrutinas al proporcionar un tipo de salto que "recuerda" la ubicación desde la que saltó y otra instrucción para regresar a la instrucción que sigue a esa instrucción de salto.

La ejecución de un programa podría compararse con la lectura de un libro. Si bien una persona normalmente lee cada palabra y línea en secuencia, en ocasiones puede retroceder a un lugar anterior del texto o saltarse secciones que no son de interés. De manera similar, una computadora a veces puede retroceder y repetir las instrucciones en alguna sección del programa una y otra vez hasta que se cumpla alguna condición interna. A esto se le llama flujo de control dentro del programa y es lo que permite que la computadora realice tareas repetidamente sin intervención humana.

Comparativamente, una persona que usa una calculadora de bolsillo puede realizar una operación aritmética básica, como sumar dos números, con solo presionar un par de botones. Pero para sumar todos los números del 1 al 1000 se necesitarían miles de pulsaciones de botones y mucho tiempo, con casi la certeza de cometer un error. Por otro lado, se puede programar una computadora para hacer esto con sólo unas pocas instrucciones simples. El siguiente ejemplo está escrito en lenguaje ensamblador MIPS :

comenzar: addi $8 , $0 , 0 # inicializar la suma a 0 addi $9 , $0 , 1 # establecer el primer número a agregar = 1 bucle: slti $10 , $9 , 1000 # verificar si el número es menor que 1000 beq $10 , $0 , finalizar # si el número impar es mayor que n, entonces salga y agregue $8 , $8 , $9 # actualice la suma addi $9 , $9 , 1 # obtenga el siguiente número j loop # repita el proceso de suma y finalice: agregue $2 , $8 , $0 # coloque la suma en el registro de salida Una vez que se le indique que ejecute este programa, la computadora realizará la tarea de suma repetitiva sin mayor intervención humana. Casi nunca cometerá un error y una PC moderna puede completar la tarea en una fracción de segundo.

En la mayoría de las computadoras, las instrucciones individuales se almacenan como código de máquina y a cada instrucción se le asigna un número único (su código de operación u código de operación para abreviar). El comando para sumar dos números tendría un código de operación; el comando para multiplicarlos tendría un código de operación diferente, y así sucesivamente. Las computadoras más simples son capaces de realizar un puñado de instrucciones diferentes; las computadoras más complejas tienen varios cientos para elegir, cada una con un código numérico único. Dado que la memoria de la computadora puede almacenar números, también puede almacenar códigos de instrucciones. Esto lleva al importante hecho de que programas completos (que no son más que listas de estas instrucciones) pueden representarse como listas de números y pueden manipularse dentro del ordenador del mismo modo que los datos numéricos. El concepto fundamental de almacenar programas en la memoria de la computadora junto con los datos con los que operan es el quid de la arquitectura von Neumann, o programa almacenado. [119] [120] En algunos casos, una computadora puede almacenar parte o la totalidad de su programa en una memoria que se mantiene separada de los datos con los que opera. Esto se llama arquitectura Harvard en honor a la computadora Harvard Mark I. Las computadoras von Neumann modernas muestran algunos rasgos de la arquitectura de Harvard en sus diseños, como en los cachés de la CPU .

Si bien es posible escribir programas de computadora como largas listas de números ( lenguaje de máquina ) y aunque esta técnica se usó con muchas de las primeras computadoras, [h] es extremadamente tedioso y potencialmente propenso a errores hacerlo en la práctica, especialmente para programas complicados. . En cambio, a cada instrucción básica se le puede dar un nombre corto que sea indicativo de su función y fácil de recordar: un mnemotécnico como ADD, SUB, MULT o JUMP. Estos mnemotécnicos se conocen colectivamente como lenguaje ensamblador de computadora . La conversión de programas escritos en lenguaje ensamblador a algo que la computadora realmente pueda entender (lenguaje de máquina) generalmente se realiza mediante un programa de computadora llamado ensamblador.

Los lenguajes de programación proporcionan varias formas de especificar programas para que los ejecuten las computadoras. A diferencia de los lenguajes naturales , los lenguajes de programación están diseñados para no permitir ambigüedades y ser concisos. Son lenguas puramente escritas y muchas veces resultan difíciles de leer en voz alta. Por lo general , un compilador o ensamblador los traduce a código de máquina antes de ejecutarlos, o un intérprete los traduce directamente en tiempo de ejecución . A veces los programas se ejecutan mediante un método híbrido de las dos técnicas.

Los lenguajes de máquina y los lenguajes ensambladores que los representan (denominados colectivamente lenguajes de programación de bajo nivel ) son generalmente exclusivos de la arquitectura particular de la unidad central de procesamiento ( CPU ) de una computadora . Por ejemplo, una CPU de arquitectura ARM (como la que se puede encontrar en un teléfono inteligente o un videojuego portátil ) no puede entender el lenguaje de máquina de una CPU x86 que podría estar en una PC . [i] Históricamente, se creó un número significativo de otras arquitecturas de CPU que tuvieron un uso extensivo, en particular incluyendo la tecnología MOS 6502 y 6510 además del Zilog Z80.

Aunque es considerablemente más fácil que en lenguaje de máquina, escribir programas largos en lenguaje ensamblador suele ser difícil y también propenso a errores. Por lo tanto, la mayoría de los programas prácticos están escritos en lenguajes de programación de alto nivel más abstractos que pueden expresar las necesidades del programador de manera más conveniente (y, por lo tanto, ayudan a reducir los errores del programador). Los lenguajes de alto nivel generalmente se "compilan" en lenguaje de máquina (o, a veces, en lenguaje ensamblador y luego en lenguaje de máquina) utilizando otro programa informático llamado compilador . [j] Los lenguajes de alto nivel están menos relacionados con el funcionamiento de la computadora de destino que el lenguaje ensamblador, y más relacionados con el lenguaje y la estructura de los problemas que debe resolver el programa final. Por lo tanto, a menudo es posible utilizar diferentes compiladores para traducir el mismo programa en lenguaje de alto nivel al lenguaje de máquina de muchos tipos diferentes de computadora. Esto es parte de los medios por los cuales software como los videojuegos pueden estar disponibles para diferentes arquitecturas informáticas, como computadoras personales y diversas consolas de videojuegos .

El diseño de programas pequeños es relativamente simple e implica el análisis del problema, la recopilación de entradas, el uso de construcciones de programación dentro de los lenguajes, el diseño o el uso de procedimientos y algoritmos establecidos, el suministro de datos para los dispositivos de salida y las soluciones al problema, según corresponda. [121] A medida que los problemas se vuelven más grandes y complejos, se encuentran características como subprogramas, módulos, documentación formal y nuevos paradigmas como la programación orientada a objetos. [122] Los programas grandes que involucran miles de líneas de código y más requieren metodologías de software formales. [123] La tarea de desarrollar grandes sistemas de software presenta un desafío intelectual importante. [124] Producir software con una confiabilidad aceptablemente alta dentro de un cronograma y presupuesto predecibles ha sido históricamente difícil; [125] la disciplina académica y profesional de la ingeniería de software se concentra específicamente en este desafío. [126]

Los errores en los programas informáticos se denominan " bugs ". Pueden ser benignos y no afectar la utilidad del programa, o tener sólo efectos sutiles. Sin embargo, en algunos casos pueden hacer que el programa o todo el sistema se " cuelga ", dejando de responder a entradas como clics del mouse o pulsaciones de teclas, fallando por completo o bloqueándose . [127] Los errores que de otro modo serían benignos a veces pueden ser aprovechados con intenciones maliciosas por un usuario sin escrúpulos que escribe un exploit , código diseñado para aprovechar un error e interrumpir la ejecución adecuada de una computadora. Los errores generalmente no son culpa de la computadora. Dado que las computadoras simplemente ejecutan las instrucciones que se les dan, los errores casi siempre son el resultado de un error del programador o un descuido en el diseño del programa. [k] A la almirante Grace Hopper , científica informática estadounidense y desarrolladora del primer compilador , se le atribuye haber utilizado por primera vez el término "errores" en informática después de que se encontró una polilla muerta cortando un relé en la computadora Harvard Mark II en septiembre de 1947. [128]

Las computadoras se han utilizado para coordinar información entre múltiples ubicaciones desde la década de 1950. El sistema SAGE del ejército estadounidense fue el primer ejemplo a gran escala de un sistema de este tipo, que dio lugar a una serie de sistemas comerciales de propósito especial como Sabre . [129] En la década de 1970, los ingenieros informáticos de instituciones de investigación de todo Estados Unidos comenzaron a vincular sus computadoras mediante tecnología de telecomunicaciones. El esfuerzo fue financiado por ARPA (ahora DARPA ) y la red informática resultante se llamó ARPANET . [130] Las tecnologías que hicieron posible Arpanet se difundieron y evolucionaron.

Con el tiempo, la red se extendió más allá de las instituciones académicas y militares y pasó a ser conocida como Internet. El surgimiento de las redes implicó una redefinición de la naturaleza y los límites de la computadora. Los sistemas operativos y las aplicaciones informáticas se modificaron para incluir la capacidad de definir y acceder a los recursos de otras computadoras en la red, como dispositivos periféricos, información almacenada y similares, como extensiones de los recursos de una computadora individual. Inicialmente, estas instalaciones estaban disponibles principalmente para personas que trabajaban en entornos de alta tecnología, pero en la década de 1990 la expansión de aplicaciones como el correo electrónico y la World Wide Web , combinada con el desarrollo de tecnologías de redes rápidas y baratas como Ethernet y ADSL, hicieron posible la creación de redes de computadoras. llegar a ser casi omnipresente. De hecho, el número de ordenadores conectados en red está creciendo enormemente. Una proporción muy grande de ordenadores personales se conecta periódicamente a Internet para comunicarse y recibir información. Las redes "inalámbricas", que a menudo utilizan redes de telefonía móvil, han significado que las redes se vuelvan cada vez más omnipresentes incluso en entornos informáticos móviles.

Una computadora no necesita ser electrónica , ni siquiera tener procesador , ni memoria RAM , ni siquiera disco duro . Si bien el uso popular de la palabra "computadora" es sinónimo de computadora electrónica personal, [l] una definición moderna típica de computadora es: " Un dispositivo que computa , especialmente una máquina electrónica programable [generalmente] que realiza operaciones matemáticas o operaciones lógicas o que reúne, almacena, correlaciona o de otro modo procesa información". [131] Según esta definición, cualquier dispositivo que procese información califica como computadora.

Hay investigaciones activas para fabricar computadoras no clásicas a partir de muchos tipos nuevos y prometedores de tecnología, como computadoras ópticas , computadoras de ADN , computadoras neuronales y computadoras cuánticas . La mayoría de las computadoras son universales y pueden calcular cualquier función computable , y están limitadas únicamente por su capacidad de memoria y velocidad de funcionamiento. Sin embargo, diferentes diseños de computadoras pueden ofrecer un rendimiento muy diferente para problemas particulares; por ejemplo, las computadoras cuánticas pueden potencialmente romper algunos algoritmos de cifrado modernos (mediante factorización cuántica ) muy rápidamente.

Existen muchos tipos de arquitecturas informáticas :

De todas estas máquinas abstractas , una computadora cuántica es la más prometedora para revolucionar la informática. [132] Las puertas lógicas son una abstracción común que puede aplicarse a la mayoría de los paradigmas digitales o analógicos anteriores . La capacidad de almacenar y ejecutar listas de instrucciones llamadas programas hace que las computadoras sean extremadamente versátiles, distinguiéndolas de las calculadoras . La tesis de Church-Turing es una declaración matemática de esta versatilidad: cualquier computadora con una capacidad mínima (siendo Turing completa) es, en principio, capaz de realizar las mismas tareas que cualquier otra computadora puede realizar. Por lo tanto, cualquier tipo de computadora ( netbook , supercomputadora , autómata celular , etc.) es capaz de realizar las mismas tareas computacionales, siempre que tenga suficiente tiempo y capacidad de almacenamiento.

Una computadora resolverá problemas exactamente de la forma en que está programada, sin tener en cuenta la eficiencia, las soluciones alternativas, los posibles atajos o los posibles errores en el código. Los programas informáticos que aprenden y se adaptan son parte del campo emergente de la inteligencia artificial y el aprendizaje automático . Los productos basados en inteligencia artificial generalmente se dividen en dos categorías principales: sistemas basados en reglas y sistemas de reconocimiento de patrones . Los sistemas basados en reglas intentan representar las reglas utilizadas por expertos humanos y su desarrollo tiende a ser costoso. Los sistemas basados en patrones utilizan datos sobre un problema para generar conclusiones. Ejemplos de sistemas basados en patrones incluyen el reconocimiento de voz , el reconocimiento de fuentes, la traducción y el campo emergente del marketing en línea.

A medida que el uso de las computadoras se ha extendido por toda la sociedad, hay un número cada vez mayor de carreras que involucran computadoras.

La necesidad de que las computadoras funcionen bien juntas y puedan intercambiar información ha generado la necesidad de muchas organizaciones, clubes y sociedades de normalización, tanto de naturaleza formal como informal.

Konrad Zuse se ganó el título semioficial de "inventor de la computadora moderna"

[

¿quién?

]

von Neumann... enfatizó firmemente para mí, y estoy seguro para otros, que la concepción fundamental se debe a Turing, en la medida en que Babbage, Lovelace y otros no lo anticiparon.Carta de Stanley Frankel a Brian Randell , 1972.

La relativa simplicidad y los bajos requisitos de energía de los MOSFET han fomentado la revolución actual de las microcomputadoras.

Se denomina arquitectura de programa almacenado o modelo de programa almacenado, también conocida como arquitectura de von Neumann. Usaremos estos términos indistintamente.

La experiencia de SAGE ayudó a hacer posible la primera red comercial en tiempo real a gran escala: el sistema informatizado de reservas aéreas SABRE.