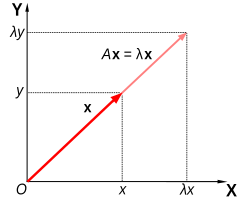

En álgebra lineal , un vector propio ( / ˈ aɪ ɡ ən -/ EYE -gən- ) o vector característico es un vector cuya dirección no cambia mediante una transformación lineal dada . Más precisamente, un vector propio, , de una transformación lineal, , se escala mediante un factor constante , , cuando se le aplica la transformación lineal: . A menudo es importante conocer estos vectores en álgebra lineal. El valor propio , valor característico o raíz característica correspondiente es el factor multiplicador .

Geométricamente, los vectores son cantidades multidimensionales con magnitud y dirección, a menudo representadas como flechas. Una transformación lineal gira , estira o corta los vectores sobre los que actúa. Sus vectores propios son aquellos vectores que sólo están estirados, sin rotación ni cizallamiento. El valor propio correspondiente es el factor por el cual un vector propio se estira o se aplasta. Si el valor propio es negativo, la dirección del vector propio se invierte. [1]

Los vectores propios y valores propios de una transformación lineal sirven para caracterizarla, por lo que desempeñan papeles importantes en todas las áreas donde se aplica el álgebra lineal, desde la geología hasta la mecánica cuántica . En particular, suele darse el caso de que un sistema esté representado por una transformación lineal cuyas salidas se alimentan como entradas a la misma transformación ( retroalimentación ). En tal aplicación, el valor propio más grande es de particular importancia, porque gobierna el comportamiento a largo plazo del sistema después de muchas aplicaciones de la transformación lineal, y el vector propio asociado es el estado estacionario del sistema.

Considere una matriz, A , y un vector distinto de cero ,. Si aplicar A a (denotado por ) simplemente escala por un factor de λ , donde λ es un escalar , entonces es un vector propio de A , y λ es el valor propio correspondiente. Esta relación se puede expresar como: . [2]

Existe una correspondencia directa entre n por n matrices cuadradas y transformaciones lineales de un espacio vectorial de n dimensiones en sí mismo, dada cualquier base del espacio vectorial. Por lo tanto, en un espacio vectorial de dimensión finita, es equivalente definir valores propios y vectores propios utilizando el lenguaje de matrices o el lenguaje de transformaciones lineales. [3] [4]

Si V es de dimensión finita, la ecuación anterior es equivalente a [5]

donde A es la representación matricial de T y u es el vector de coordenadas de v .

Los valores propios y los vectores propios ocupan un lugar destacado en el análisis de transformaciones lineales. El prefijo eigen- se adopta de la palabra alemana eigen ( similar a la palabra inglesa own ) para 'adecuado', 'característico', 'propio'. [6] [7] Originalmente utilizados para estudiar los ejes principales del movimiento de rotación de cuerpos rígidos , los valores propios y los vectores propios tienen una amplia gama de aplicaciones, por ejemplo en análisis de estabilidad , análisis de vibraciones , orbitales atómicos , reconocimiento facial y diagonalización de matrices .

En esencia, un vector propio v de una transformación lineal T es un vector distinto de cero que, cuando se le aplica T , no cambia de dirección. La aplicación de T al vector propio solo escala el vector propio según el valor escalar λ , llamado valor propio. Esta condición se puede escribir como la ecuación denominada ecuación de valor propio o ecuación propia . En general, λ puede ser cualquier escalar . Por ejemplo, λ puede ser negativo, en cuyo caso el vector propio invierte la dirección como parte del escalamiento, o puede ser cero o complejo .

El ejemplo aquí, basado en la Mona Lisa , proporciona una ilustración sencilla. Cada punto de la pintura se puede representar como un vector que apunta desde el centro de la pintura hasta ese punto. La transformación lineal en este ejemplo se llama mapeo de corte . Los puntos de la mitad superior se mueven hacia la derecha y los puntos de la mitad inferior se mueven hacia la izquierda, proporcionalmente a qué tan lejos están del eje horizontal que pasa por el centro de la pintura. Por lo tanto, los vectores que apuntan a cada punto de la imagen original se inclinan hacia la derecha o hacia la izquierda y la transformación los alarga o acorta. Los puntos a lo largo del eje horizontal no se mueven en absoluto cuando se aplica esta transformación. Por lo tanto, cualquier vector que apunte directamente a la derecha o a la izquierda sin componente vertical es un vector propio de esta transformación, porque el mapeo no cambia su dirección. Además, todos estos vectores propios tienen un valor propio igual a uno, porque el mapeo tampoco cambia su longitud.

Las transformaciones lineales pueden tomar muchas formas diferentes, mapeando vectores en una variedad de espacios vectoriales, por lo que los vectores propios también pueden tomar muchas formas. Por ejemplo, la transformación lineal podría ser un operador diferencial como , en cuyo caso los vectores propios son funciones llamadas funciones propias que son escaladas por ese operador diferencial, como Alternativamente, la transformación lineal podría tomar la forma de una matriz de n por n , en la que caso los vectores propios son matrices n por 1. Si la transformación lineal se expresa en forma de una matriz A de n por n , entonces la ecuación de valor propio para una transformación lineal anterior se puede reescribir como la multiplicación de matrices donde el vector propio v es una matriz de n por 1. Para una matriz, se pueden usar valores propios y vectores propios para descomponer la matriz , por ejemplo diagonalizándola .

Los valores propios y los vectores propios dan lugar a muchos conceptos matemáticos estrechamente relacionados, y el prefijo propio- se aplica generosamente al nombrarlos:

Los valores propios a menudo se introducen en el contexto del álgebra lineal o la teoría de matrices . Históricamente, sin embargo, surgieron en el estudio de formas cuadráticas y ecuaciones diferenciales .

En el siglo XVIII, Leonhard Euler estudió el movimiento de rotación de un cuerpo rígido y descubrió la importancia de los ejes principales . [a] Joseph-Louis Lagrange se dio cuenta de que los ejes principales son los vectores propios de la matriz de inercia. [11]

A principios del siglo XIX, Augustin-Louis Cauchy vio cómo su trabajo podía usarse para clasificar las superficies cuádricas y lo generalizó a dimensiones arbitrarias. [12] Cauchy también acuñó el término racine caractéristique (raíz característica), para lo que ahora se llama valor propio ; su término sobrevive en ecuación característica . [b]

Posteriormente, Joseph Fourier utilizó el trabajo de Lagrange y Pierre-Simon Laplace para resolver la ecuación del calor mediante separación de variables en su famoso libro de 1822 Théorie analytique de la chaleur . [13] Charles-François Sturm desarrolló aún más las ideas de Fourier y las llamó la atención de Cauchy, quien las combinó con sus propias ideas y llegó al hecho de que las matrices simétricas reales tienen valores propios reales. [12] Esto fue extendido por Charles Hermite en 1855 a lo que ahora se llaman matrices hermitianas . [14]

Casi al mismo tiempo, Francesco Brioschi demostró que los valores propios de matrices ortogonales se encuentran en el círculo unitario , [12] y Alfred Clebsch encontró el resultado correspondiente para matrices simétricas sesgadas . [14] Finalmente, Karl Weierstrass aclaró un aspecto importante de la teoría de la estabilidad iniciada por Laplace, al darse cuenta de que las matrices defectuosas pueden causar inestabilidad. [12]

Mientras tanto, Joseph Liouville estudió problemas de valores propios similares a los de Sturm; la disciplina que surgió de su trabajo ahora se llama teoría de Sturm-Liouville . [15] Schwarz estudió el primer valor propio de la ecuación de Laplace en dominios generales hacia finales del siglo XIX, mientras que Poincaré estudió la ecuación de Poisson unos años más tarde. [dieciséis]

A principios del siglo XX, David Hilbert estudió los valores propios de los operadores integrales considerándolos como matrices infinitas. [17] Fue el primero en utilizar la palabra alemana eigen , que significa "propio", [7] para denotar valores propios y vectores propios en 1904, [c] aunque puede haber estado siguiendo un uso relacionado de Hermann von Helmholtz . Durante algún tiempo, el término estándar en inglés era "valor adecuado", pero el término más distintivo "valor propio" es el estándar hoy en día. [18]

El primer algoritmo numérico para calcular valores propios y vectores propios apareció en 1929, cuando Richard von Mises publicó el método de la potencia . Uno de los métodos más populares hoy en día, el algoritmo QR , fue propuesto de forma independiente por John GF Francis [19] y Vera Kublanovskaya [20] en 1961. [21] [22]

Los valores propios y los vectores propios a menudo se presentan a los estudiantes en el contexto de cursos de álgebra lineal centrados en matrices. [23] [24] Además, las transformaciones lineales sobre un espacio vectorial de dimensión finita se pueden representar mediante matrices, [3] [4], lo cual es especialmente común en aplicaciones numéricas y computacionales. [25]

Considere vectores de n dimensiones que se forman como una lista de n escalares, como los vectores tridimensionales.

Se dice que estos vectores son múltiplos escalares entre sí, o paralelos o colineales , si existe un escalar λ tal que

En este caso, .

Ahora considere la transformación lineal de vectores n -dimensionales definidos por una matriz A n por n , o donde, para cada fila,

Si ocurre que v y w son múltiplos escalares, es decir si

entonces v es un vector propio de la transformación lineal A y el factor de escala λ es el valor propio correspondiente a ese vector propio. La ecuación ( 1 ) es la ecuación de valores propios de la matriz A.

La ecuación ( 1 ) se puede expresar de manera equivalente como

donde I es la matriz identidad n por n y 0 es el vector cero.

La ecuación ( 2 ) tiene una solución v distinta de cero si y solo si el determinante de la matriz ( A − λI ) es cero. Por lo tanto, los valores propios de A son valores de λ que satisfacen la ecuación

Usando la fórmula de Leibniz para los determinantes , el lado izquierdo de la ecuación ( 3 ) es una función polinómica de la variable λ y el grado de este polinomio es n , el orden de la matriz A. Sus coeficientes dependen de las entradas de A , excepto que su término de grado n es siempre (−1) n λ n . Este polinomio se llama polinomio característico de A. La ecuación ( 3 ) se llama ecuación característica o ecuación secular de A.

El teorema fundamental del álgebra implica que el polinomio característico de una matriz A de n por n , siendo un polinomio de grado n , se puede factorizar en el producto de n términos lineales,

donde cada λ i puede ser real pero en general es un número complejo. Los números λ 1 , λ 2 , ..., λ n , que pueden no tener todos valores distintos, son raíces del polinomio y son los valores propios de A .

Como ejemplo breve, que se describe con más detalle en la sección de ejemplos más adelante, considere la matriz

Tomando el determinante de ( A − λI ) , el polinomio característico de A es

Al establecer el polinomio característico igual a cero, tiene raíces en λ=1 y λ=3 , que son los dos valores propios de A. Los vectores propios correspondientes a cada valor propio se pueden encontrar resolviendo los componentes de v en la ecuación . En este ejemplo, los vectores propios son múltiplos escalares distintos de cero de

Si las entradas de la matriz A son todas números reales, entonces los coeficientes del polinomio característico también serán números reales, pero los valores propios aún pueden tener partes imaginarias distintas de cero. Por lo tanto, las entradas de los vectores propios correspondientes también pueden tener partes imaginarias distintas de cero. De manera similar, los valores propios pueden ser números irracionales incluso si todas las entradas de A son números racionales o incluso si todas son números enteros. Sin embargo, si las entradas de A son todas números algebraicos , que incluyen los racionales, los valores propios también deben ser números algebraicos.

Las raíces no reales de un polinomio real con coeficientes reales se pueden agrupar en pares de conjugados complejos , es decir, teniendo los dos miembros de cada par partes imaginarias que difieren sólo en signo y la misma parte real. Si el grado es impar, entonces, según el teorema del valor intermedio, al menos una de las raíces es real. Por lo tanto, cualquier matriz real de orden impar tiene al menos un valor propio real, mientras que una matriz real de orden par puede no tener ningún valor propio real. Los vectores propios asociados con estos valores propios complejos también son complejos y también aparecen en pares conjugados complejos.

El espectro de una matriz es la lista de valores propios, repetidos según la multiplicidad; en una notación alternativa el conjunto de valores propios con sus multiplicidades.

Una cantidad importante asociada con el espectro es el valor absoluto máximo de cualquier valor propio. Esto se conoce como radio espectral de la matriz.

Sea λi un valor propio de una matriz A de n por n . La multiplicidad algebraica μ A ( λ i ) del valor propio es su multiplicidad como raíz del polinomio característico, es decir, el entero más grande k tal que ( λ − λ i ) k divide uniformemente ese polinomio. [10] [26] [27]

Supongamos que una matriz A tiene dimensión n y d ≤ n valores propios distintos. Mientras que la ecuación ( 4 ) factoriza el polinomio característico de A en el producto de n términos lineales con algunos términos potencialmente repetidos, el polinomio característico también se puede escribir como el producto de d términos, cada uno de los cuales corresponde a un valor propio distinto y elevado a la potencia de multiplicidad algebraica,

Si d = n entonces el lado derecho es el producto de n términos lineales y esto es lo mismo que la ecuación ( 4 ). El tamaño de la multiplicidad algebraica de cada valor propio está relacionado con la dimensión n como

Si μ A ( λ i ) = 1, entonces se dice que λ i es un valor propio simple . [27] Si μ A ( λ i ) es igual a la multiplicidad geométrica de λ i , γ A ( λ i ), definida en la siguiente sección, entonces se dice que λ i es un valor propio semisimple .

Dado un valor propio particular λ de la matriz A de n por n , defina el conjunto E como todos los vectores v que satisfacen la ecuación ( 2 ),

Por un lado, este conjunto es precisamente el núcleo o espacio nulo de la matriz ( A − λI ). Por otro lado, por definición, cualquier vector distinto de cero que satisfaga esta condición es un vector propio de A asociado con λ . Entonces, el conjunto E es la unión del vector cero con el conjunto de todos los vectores propios de A asociados con λ , y E es igual al espacio nulo de ( A − λI ). E se llama espacio propio o espacio característico de A asociado con λ . [28] [10] En general, λ es un número complejo y los vectores propios son matrices complejas de n por 1. Una propiedad del espacio nulo es que es un subespacio lineal , por lo que E es un subespacio lineal de .

Debido a que el espacio propio E es un subespacio lineal, está cerrado bajo suma. Es decir, si dos vectores u y v pertenecen al conjunto E , escrito u , v ∈ E , entonces ( u + v ) ∈ E o equivalentemente A ( u + v ) = λ ( u + v ) . Esto se puede comprobar utilizando la propiedad distributiva de la multiplicación de matrices. De manera similar, debido a que E es un subespacio lineal, está cerrado bajo multiplicación escalar. Es decir, si v ∈ E y α es un número complejo, ( α v ) ∈ E o equivalentemente A ( α v ) = λ ( α v ) . Esto se puede comprobar observando que la multiplicación de matrices complejas por números complejos es conmutativa . Mientras u + v y α v no sean cero, también son vectores propios de A asociados con λ .

La dimensión del espacio propio E asociado con λ , o equivalentemente el número máximo de vectores propios linealmente independientes asociados con λ , se conoce como multiplicidad geométrica del valor propio . Debido a que E también es el espacio nulo de ( A − λI ), la multiplicidad geométrica de λ es la dimensión del espacio nulo de ( A − λI ), también llamada nulidad de ( A − λI ), que se relaciona con la dimensión y el rango de ( A − λI ) como

Debido a la definición de valores propios y vectores propios, la multiplicidad geométrica de un valor propio debe ser al menos uno, es decir, cada valor propio tiene al menos un vector propio asociado. Además, la multiplicidad geométrica de un valor propio no puede exceder su multiplicidad algebraica. Además, recuerde que la multiplicidad algebraica de un valor propio no puede exceder n .

Para probar la desigualdad , considere cómo la definición de multiplicidad geométrica implica la existencia de vectores propios ortonormales , tales que . Por lo tanto, podemos encontrar una matriz (unitaria) cuyas primeras columnas sean estos vectores propios, y cuyas columnas restantes puedan ser cualquier conjunto ortonormal de vectores ortogonales a estos vectores propios de . Entonces tiene rango completo y por tanto es invertible. Evaluando , obtenemos una matriz cuyo bloque superior izquierdo es la matriz diagonal . Esto se puede ver evaluando lo que el lado izquierdo hace con los vectores base de la primera columna. Al reorganizar y agregar en ambos lados, obtenemos desplazamientos con . En otras palabras, es similar a , y . Pero por la definición de , sabemos que contiene un factor , lo que significa que la multiplicidad algebraica de debe satisfacer .

Supongamos que tiene valores propios distintos , donde la multiplicidad geométrica de es . La multiplicidad geométrica total de , es la dimensión de la suma de todos los espacios propios de los valores propios de , o equivalentemente, el número máximo de vectores propios linealmente independientes de . Si entonces

Sea una matriz arbitraria de números complejos con valores propios . Cada valor propio aparece veces en esta lista, donde está la multiplicidad algebraica del valor propio. Las siguientes son propiedades de esta matriz y sus valores propios:

Muchas disciplinas tradicionalmente representan vectores como matrices con una sola columna en lugar de matrices con una sola fila. Por esa razón, la palabra "vector propio" en el contexto de matrices casi siempre se refiere a un vector propio derecho , es decir, un vector columna que multiplica por la derecha la matriz en la ecuación definitoria, ecuación ( 1 ),

El problema de valores propios y vectores propios también se puede definir para vectores fila que dejaron una matriz multiplicada . En esta formulación, la ecuación definitoria es

donde es un escalar y es una matriz. Cualquier vector fila que satisfaga esta ecuación se llama vector propio izquierdo de y es su valor propio asociado. Tomando la transpuesta de esta ecuación,

Comparando esta ecuación con la ecuación ( 1 ), se deduce inmediatamente que un vector propio izquierdo de es lo mismo que la transposición de un vector propio derecho de , con el mismo valor propio. Además, dado que el polinomio característico de es el mismo que el polinomio característico de , los vectores propios izquierdo y derecho de están asociados con los mismos valores propios.

Supongamos que los vectores propios de A forman una base, o de manera equivalente, A tiene n vectores propios linealmente independientes v 1 , v 2 , ..., v n con valores propios asociados λ 1 , λ 2 , ..., λ n . Los valores propios no necesitan ser distintos. Defina una matriz cuadrada Q cuyas columnas sean los n vectores propios linealmente independientes de A ,

Dado que cada columna de Q es un vector propio de A , multiplicar A por Q escala cada columna de Q por su valor propio asociado,

Teniendo esto en cuenta , defina una matriz diagonal Λ donde cada elemento diagonal Λ ii sea el valor propio asociado con la i -ésima columna de Q. Entonces

Como las columnas de Q son linealmente independientes, Q es invertible. Multiplicando a la derecha ambos lados de la ecuación por Q −1 ,

o en su lugar multiplicando ambos lados por la izquierda por Q −1 ,

Por lo tanto, A se puede descomponer en una matriz compuesta por sus vectores propios, una matriz diagonal con sus valores propios a lo largo de la diagonal y la inversa de la matriz de vectores propios. Esto se llama descomposición propia y es una transformación de similitud . Se dice que dicha matriz A es similar a la matriz diagonal Λ o diagonalizable . La matriz Q es la matriz de cambio de base de la transformación de similitud. Esencialmente, las matrices A y Λ representan la misma transformación lineal expresada en dos bases diferentes. Los vectores propios se utilizan como base al representar la transformación lineal como Λ.

Por el contrario, supongamos que una matriz A es diagonalizable. Sea P una matriz cuadrada no singular tal que P −1 AP es alguna matriz diagonal D . A la izquierda multiplicando ambos por P , AP = PD . Por tanto , cada columna de P debe ser un vector propio de A cuyo valor propio es el elemento diagonal correspondiente de D. Dado que las columnas de P deben ser linealmente independientes para que P sea invertible, existen n vectores propios linealmente independientes de A. Entonces se deduce que los vectores propios de A forman una base si y sólo si A es diagonalizable.

Una matriz que no es diagonalizable se dice defectuosa . Para matrices defectuosas, la noción de vectores propios se generaliza a vectores propios generalizados y la matriz diagonal de valores propios se generaliza a la forma normal de Jordan . Sobre un campo algebraicamente cerrado, cualquier matriz A tiene una forma normal de Jordan y por tanto admite una base de vectores propios generalizados y una descomposición en espacios propios generalizados .

En el caso hermitiano , a los valores propios se les puede dar una caracterización variacional. El valor propio más grande de es el valor máximo de la forma cuadrática . Un valor de that da cuenta de que el máximo es un vector propio.

Considere la matriz

La figura de la derecha muestra el efecto de esta transformación en las coordenadas de los puntos en el plano. Los vectores propios v de esta transformación satisfacen la ecuación ( 1 ), y los valores de λ para los cuales el determinante de la matriz ( A − λI ) es igual a cero son los valores propios.

Tomando el determinante para encontrar el polinomio característico de A ,

Al igualar el polinomio característico a cero, tiene raíces en λ =1 y λ =3 , que son los dos valores propios de A.

Para λ =1 , la ecuación ( 2 ) se convierte en,

Cualquier vector distinto de cero con v 1 = − v 2 resuelve esta ecuación. Por tanto, es un vector propio de A correspondiente a λ = 1, al igual que cualquier múltiplo escalar de este vector.

Para λ =3 , la ecuación ( 2 ) se convierte en

Cualquier vector distinto de cero con v 1 = v 2 resuelve esta ecuación. Por lo tanto,

es un vector propio de A correspondiente a λ = 3, al igual que cualquier múltiplo escalar de este vector.

Así, los vectores v λ =1 y v λ =3 son vectores propios de A asociados con los valores propios λ =1 y λ =3 , respectivamente.

Considere la matriz

El polinomio característico de A es

Las raíces del polinomio característico son 2, 1 y 11, que son los únicos tres valores propios de A. Estos valores propios corresponden a los vectores propios , y , o cualquier múltiplo distinto de cero de los mismos.

Considere la matriz de permutación cíclica.

Esta matriz desplaza las coordenadas del vector hacia arriba una posición y mueve la primera coordenada hacia abajo. Su polinomio característico es 1 − λ 3 , cuyas raíces son donde es una unidad imaginaria con .

Para el valor propio real λ 1 = 1, cualquier vector con tres entradas iguales distintas de cero es un vector propio. Por ejemplo,

Para el par conjugado complejo de valores propios imaginarios,

Entonces y

Por lo tanto, los otros dos vectores propios de A son complejos y tienen valores propios λ 2 y λ 3 , respectivamente. Los dos vectores propios complejos también aparecen en un par conjugado complejo,

Las matrices con entradas sólo a lo largo de la diagonal principal se denominan matrices diagonales . Los valores propios de una matriz diagonal son los propios elementos diagonales. Considere la matriz

El polinomio característico de A es

que tiene las raíces λ 1 = 1 , λ 2 = 2 y λ 3 = 3 . Estas raíces son los elementos diagonales y los valores propios de A.

Cada elemento diagonal corresponde a un vector propio cuyo único componente distinto de cero está en la misma fila que ese elemento diagonal. En el ejemplo, los valores propios corresponden a los vectores propios,

respectivamente, así como múltiplos escalares de estos vectores.

Una matriz cuyos elementos encima de la diagonal principal son todos cero se llama matriz triangular inferior , mientras que una matriz cuyos elementos debajo de la diagonal principal son todos cero se llama matriz triangular superior . Al igual que ocurre con las matrices diagonales, los valores propios de las matrices triangulares son los elementos de la diagonal principal.

Considere la matriz triangular inferior,

El polinomio característico de A es

que tiene las raíces λ 1 = 1 , λ 2 = 2 y λ 3 = 3 . Estas raíces son los elementos diagonales y los valores propios de A.

Estos valores propios corresponden a los vectores propios,

respectivamente, así como múltiplos escalares de estos vectores.

Como en el ejemplo anterior, la matriz triangular inferior tiene un polinomio característico que es producto de sus elementos diagonales,

Las raíces de este polinomio, y por tanto los valores propios, son 2 y 3. La multiplicidad algebraica de cada valor propio es 2; en otras palabras, ambas son raíces dobles. La suma de las multiplicidades algebraicas de todos los valores propios distintos es μ A = 4 = n , el orden del polinomio característico y la dimensión de A.

Por otro lado, la multiplicidad geométrica del valor propio 2 es sólo 1, porque su espacio propio está abarcado por un solo vector y, por tanto, es unidimensional. De manera similar, la multiplicidad geométrica del valor propio 3 es 1 porque su espacio propio está abarcado por un solo vector . La multiplicidad geométrica total γ A es 2, que es la más pequeña que podría ser para una matriz con dos valores propios distintos. Las multiplicidades geométricas se definen en una sección posterior.

Para una matriz hermitiana , la norma al cuadrado del j -ésimo componente de un vector propio normalizado se puede calcular utilizando sólo los valores propios de la matriz y los valores propios de la matriz menor correspondiente , donde está la submatriz formada eliminando la j -ésima fila y columna del original. matriz. [34] [35] [36] Esta identidad también se extiende a matrices diagonalizables y ha sido redescubierta muchas veces en la literatura. [35] [37]

Las definiciones de valor propio y vectores propios de una transformación lineal T siguen siendo válidas incluso si el espacio vectorial subyacente es un espacio de Hilbert o Banach de dimensión infinita . Una clase ampliamente utilizada de transformaciones lineales que actúan en espacios de dimensión infinita son los operadores diferenciales en espacios funcionales . Sea D un operador diferencial lineal en el espacio C ∞ de funciones reales infinitamente diferenciables de un argumento real t . La ecuación de valor propio para D es la ecuación diferencial

Las funciones que satisfacen esta ecuación son vectores propios de D y comúnmente se denominan funciones propias .

Considere el operador derivado con ecuación de valor propio

Esta ecuación diferencial se puede resolver multiplicando ambos lados por dt / f ( t ) e integrando . Su solución, la función exponencial, es la función propia del operador derivada. En este caso, la función propia es en sí misma una función de su valor propio asociado. En particular, para λ = 0 la función propia f ( t ) es una constante.

El artículo principal sobre funciones propias ofrece otros ejemplos.

El concepto de valores propios y vectores propios se extiende naturalmente a transformaciones lineales arbitrarias en espacios vectoriales arbitrarios. Sea V cualquier espacio vectorial sobre algún campo K de escalares , y sea T una transformación lineal que mapee V en V ,

Decimos que un vector distinto de cero v ∈ V es un vector propio de T si y sólo si existe un escalar λ ∈ K tal que

Esta ecuación se llama ecuación de valores propios de T , y el escalar λ es el valor propio de T correspondiente al vector propio v . T ( v ) es el resultado de aplicar la transformación T al vector v , mientras que λ v es el producto del escalar λ con v . [38] [39]

Dado un valor propio λ , considere el conjunto

que es la unión del vector cero con el conjunto de todos los vectores propios asociados a λ . E se llama espacio propio o espacio característico de T asociado con λ . [40]

Por definición de transformación lineal,

para x , y ∈ V y α ∈ K . Por lo tanto, si u y v son vectores propios de T asociados con el valor propio λ , es decir, u , v ∈ E , entonces

Entonces, tanto u + v como α v son cero o vectores propios de T asociados con λ , es decir, u + v , α v ∈ E , y E es cerrado bajo suma y multiplicación escalar. El espacio propio E asociado con λ es, por tanto , un subespacio lineal de V. [41] Si ese subespacio tiene dimensión 1, a veces se le llama línea propia . [42]

La multiplicidad geométrica γ T ( λ ) de un valor propio λ es la dimensión del espacio propio asociado con λ , es decir, el número máximo de vectores propios linealmente independientes asociados con ese valor propio. [10] [27] [43] Según la definición de valores propios y vectores propios, γ T ( λ ) ≥ 1 porque cada valor propio tiene al menos un vector propio.

Los espacios propios de T siempre forman una suma directa . Como consecuencia, los vectores propios de diferentes valores propios siempre son linealmente independientes. Por lo tanto, la suma de las dimensiones de los espacios propios no puede exceder la dimensión n del espacio vectorial en el que opera T , y no puede haber más de n valores propios distintos. [d]

Cualquier subespacio abarcado por vectores propios de T es un subespacio invariante de T , y la restricción de T a dicho subespacio es diagonalizable. Además, si todo el espacio vectorial V puede ser abarcado por los vectores propios de T , o de manera equivalente, si la suma directa de los espacios propios asociados con todos los valores propios de T es todo el espacio vectorial V , entonces se puede crear una base de V llamada base propia . formado a partir de vectores propios linealmente independientes de T . Cuando T admite una base propia, T es diagonalizable.

Si λ es un valor propio de T , entonces el operador ( T − λI ) no es uno a uno y, por tanto, su inverso ( T − λI ) −1 no existe. Lo contrario es cierto para espacios vectoriales de dimensión finita, pero no para espacios vectoriales de dimensión infinita. En general, el operador ( T − λI ) puede no tener inverso incluso si λ no es un valor propio.

Por esta razón, en el análisis funcional los valores propios se pueden generalizar al espectro de un operador lineal T como el conjunto de todos los escalares λ para los cuales el operador ( T − λI ) no tiene inversa acotada . El espectro de un operador siempre contiene todos sus valores propios pero no se limita a ellos.

Se puede generalizar el objeto algebraico que actúa sobre el espacio vectorial, reemplazando un único operador que actúa sobre un espacio vectorial con una representación algebraica (un álgebra asociativa que actúa sobre un módulo) . El estudio de tales acciones es el campo de la teoría de la representación .

El concepto de peso en la teoría de la representación es un análogo de los valores propios, mientras que los vectores de peso y los espacios de peso son análogos de los vectores propios y los espacios propios, respectivamente.

Hecke eigensheaf es un tensor múltiplo de sí mismo y se considera en la correspondencia de Langlands .

Las ecuaciones en diferencias más simples tienen la forma

La solución de esta ecuación para x en términos de t se encuentra usando su ecuación característica

que se puede encontrar apilando en forma matricial un conjunto de ecuaciones que consisten en la ecuación en diferencias anterior y las k – 1 ecuaciones que dan un sistema k -dimensional de primer orden en el vector variable apilado en términos de su valor una vez rezagado, y tomando la ecuación característica de la matriz de este sistema. Esta ecuación proporciona k raíces características para usar en la ecuación de solución.

Se utiliza un procedimiento similar para resolver una ecuación diferencial de la forma

El cálculo de valores propios y vectores propios es un tema en el que la teoría, tal como se presenta en los libros de texto de álgebra lineal elemental, suele estar muy lejos de la práctica.

El método clásico consiste en encontrar primero los valores propios y luego calcular los vectores propios para cada valor propio. En varios sentidos, no es adecuado para aritméticas no exactas como la coma flotante .

Los valores propios de una matriz se pueden determinar encontrando las raíces del polinomio característico. Esto es fácil para las matrices, pero la dificultad aumenta rápidamente con el tamaño de la matriz.

En teoría, los coeficientes del polinomio característico se pueden calcular exactamente, ya que son sumas de productos de elementos matriciales; y existen algoritmos que pueden encontrar todas las raíces de un polinomio de grado arbitrario con la precisión requerida . [44] Sin embargo, este enfoque no es viable en la práctica porque los coeficientes estarían contaminados por errores de redondeo inevitables , y las raíces de un polinomio pueden ser una función extremadamente sensible de los coeficientes (como lo ejemplifica el polinomio de Wilkinson ). [44] Incluso para matrices cuyos elementos son números enteros, el cálculo deja de ser trivial, porque las sumas son muy largas; el término constante es el determinante , que para una matriz es una suma de diferentes productos. [mi]

Sólo existen fórmulas algebraicas explícitas para las raíces de un polinomio si el grado es 4 o menos. Según el teorema de Abel-Ruffini no existe una fórmula algebraica general, explícita y exacta para las raíces de un polinomio de grado 5 o más. (La generalidad importa porque cualquier polinomio con grado es el polinomio característico de alguna matriz compañera de orden ). Por lo tanto, para matrices de orden 5 o más, los valores propios y vectores propios no pueden obtenerse mediante una fórmula algebraica explícita y, por lo tanto, deben calcularse mediante métodos aproximados. métodos numéricos . Incluso la fórmula exacta para las raíces de un polinomio de grado 3 es numéricamente poco práctica.

Una vez que se conoce el valor (exacto) de un valor propio, los vectores propios correspondientes se pueden encontrar encontrando soluciones distintas de cero de la ecuación de valores propios, que se convierte en un sistema de ecuaciones lineales con coeficientes conocidos. Por ejemplo, una vez que se sabe que 6 es un valor propio de la matriz

podemos encontrar sus vectores propios resolviendo la ecuación , es decir

Esta ecuación matricial es equivalente a dos ecuaciones lineales que son

Ambas ecuaciones se reducen a una única ecuación lineal . Por lo tanto, cualquier vector de la forma , para cualquier número real distinto de cero , es un vector propio de con valor propio .

La matriz anterior tiene otro valor propio . Un cálculo similar muestra que los vectores propios correspondientes son las soluciones distintas de cero de , es decir, cualquier vector de la forma , para cualquier número real distinto de cero .

El enfoque inverso, de buscar primero los vectores propios y luego determinar cada valor propio a partir de su vector propio, resulta mucho más manejable para las computadoras. El algoritmo más sencillo aquí consiste en elegir un vector inicial arbitrario y luego multiplicarlo repetidamente con la matriz (opcionalmente, normalizar el vector para mantener sus elementos de tamaño razonable); esto hace que el vector converja hacia un vector propio. Una variación es, en cambio, multiplicar el vector por ; esto hace que converja a un vector propio del valor propio más cercano a .

Si es (una buena aproximación de) un vector propio de , entonces el valor propio correspondiente se puede calcular como

donde denota la transpuesta conjugada de .

No se conocieron métodos eficientes y precisos para calcular valores propios y vectores propios de matrices arbitrarias hasta que se diseñó el algoritmo QR en 1961. [44] La combinación de la transformación de Householder con la descomposición LU da como resultado un algoritmo con mejor convergencia que el algoritmo QR. [ cita necesaria ] Para matrices dispersas hermitianas grandes , el algoritmo de Lanczos es un ejemplo de un método iterativo eficiente para calcular valores propios y vectores propios, entre varias otras posibilidades. [44]

La mayoría de los métodos numéricos que calculan los valores propios de una matriz también determinan un conjunto de vectores propios correspondientes como subproducto del cálculo, aunque a veces los implementadores optan por descartar la información del vector propio tan pronto como ya no es necesaria.

Los vectores propios y los valores propios pueden resultar útiles para comprender las transformaciones lineales de formas geométricas. La siguiente tabla presenta algunos ejemplos de transformaciones en el plano junto con sus matrices, valores propios y vectores propios de 2 × 2.

La ecuación característica de una rotación es una ecuación cuadrática con discriminante , que es un número negativo siempre que θ no sea un múltiplo entero de 180°. Por tanto, salvo estos casos especiales, los dos valores propios son números complejos ; y todos los vectores propios tienen entradas no reales. De hecho, excepto en esos casos especiales, una rotación cambia la dirección de cada vector distinto de cero en el plano.

Una transformación lineal que lleva un cuadrado a un rectángulo de la misma área (un mapeo de compresión ) tiene valores propios recíprocos.

La descomposición propia de una matriz semidefinida positiva simétrica (PSD) produce una base ortogonal de vectores propios, cada uno de los cuales tiene un valor propio no negativo. La descomposición ortogonal de una matriz PSD se utiliza en análisis multivariado , donde las matrices de covarianza muestrales son PSD. Esta descomposición ortogonal se denomina análisis de componentes principales (PCA) en estadística. PCA estudia relaciones lineales entre variables. El PCA se realiza en la matriz de covarianza o en la matriz de correlación (en la que cada variable se escala para que su varianza muestral sea igual a uno). Para la matriz de covarianza o correlación, los vectores propios corresponden a componentes principales y los valores propios a la varianza explicada por los componentes principales. El análisis de componentes principales de la matriz de correlación proporciona una base ortogonal para el espacio de los datos observados: en esta base, los valores propios más grandes corresponden a los componentes principales que están asociados con la mayor parte de la covariabilidad entre una serie de datos observados.

El análisis de componentes principales se utiliza como medio de reducción de dimensionalidad en el estudio de grandes conjuntos de datos , como los que se encuentran en bioinformática . En la metodología Q , los valores propios de la matriz de correlación determinan el juicio de importancia práctica del metodólogo Q (que difiere de la significación estadística de la prueba de hipótesis ; cf. criterios para determinar el número de factores ). De manera más general, el análisis de componentes principales se puede utilizar como método de análisis factorial en el modelado de ecuaciones estructurales .

En la teoría de grafos espectrales , un valor propio de un gráfico se define como un valor propio de la matriz de adyacencia del gráfico , o (cada vez más) de la matriz laplaciana del gráfico debido a su operador de Laplace discreto , que es (a veces llamado laplaciano combinatorio ) o (a veces llamado laplaciano normalizado ), donde es una matriz diagonal igual al grado del vértice , y en , la enésima entrada diagonal es . El enésimo vector propio principal de un gráfico se define como el vector propio correspondiente al enésimo valor propio más grande o al más pequeño del laplaciano. El primer vector propio principal del gráfico también se denomina simplemente vector propio principal.

El vector propio principal se utiliza para medir la centralidad de sus vértices. Un ejemplo es el algoritmo PageRank de Google . El vector propio principal de una matriz de adyacencia modificada del gráfico de la World Wide Web proporciona las clasificaciones de páginas como sus componentes. Este vector corresponde a la distribución estacionaria de la cadena de Markov representada por la matriz de adyacencia normalizada por filas; sin embargo, primero se debe modificar la matriz de adyacencia para garantizar que exista una distribución estacionaria. El segundo vector propio más pequeño se puede utilizar para dividir el gráfico en grupos, mediante agrupación espectral . También hay otros métodos disponibles para la agrupación.

Una cadena de Markov está representada por una matriz cuyas entradas son las probabilidades de transición entre estados de un sistema. En particular, las entradas no son negativas y cada fila de la matriz suma uno, siendo la suma de las probabilidades de transiciones de un estado a algún otro estado del sistema. El teorema de Perron-Frobenius proporciona condiciones suficientes para que una cadena de Markov tenga un valor propio dominante único, que gobierna la convergencia del sistema a un estado estacionario.

Los problemas de valores propios ocurren naturalmente en el análisis de vibraciones de estructuras mecánicas con muchos grados de libertad . Los valores propios son las frecuencias naturales (o frecuencias propias ) de vibración, y los vectores propios son las formas de estos modos vibratorios. En particular, la vibración no amortiguada está gobernada por o

Es decir, la aceleración es proporcional a la posición (es decir, esperamos que sea sinusoidal en el tiempo).

En dimensiones, se convierte en una matriz de masa y una matriz de rigidez . Las soluciones admisibles son entonces una combinación lineal de soluciones al problema de valores propios generalizado donde es el valor propio y es la frecuencia angular (imaginaria) . Los principales modos de vibración son diferentes de los principales modos de cumplimiento, que son vectores propios de ellos mismos. Además, la vibración amortiguada , gobernada por conduce al llamado problema de valores propios cuadráticos ,

Esto puede reducirse a un problema de valores propios generalizado mediante manipulación algebraica a costa de resolver un sistema más grande.

Las propiedades de ortogonalidad de los vectores propios permiten desacoplar las ecuaciones diferenciales para que el sistema pueda representarse como una suma lineal de los vectores propios. El problema de valores propios de estructuras complejas a menudo se resuelve mediante el análisis de elementos finitos , pero se generaliza claramente la solución a problemas de vibración con valores escalares.

En mecánica , los vectores propios del tensor de momento de inercia definen los ejes principales de un cuerpo rígido . El tensor de momento de inercia es una cantidad clave necesaria para determinar la rotación de un cuerpo rígido alrededor de su centro de masa .

En mecánica de sólidos , el tensor de tensión es simétrico y, por lo tanto, se puede descomponer en un tensor diagonal con los valores propios en la diagonal y los vectores propios como base. Debido a que es diagonal, en esta orientación, el tensor de tensión no tiene componentes de corte ; los componentes que tiene son los componentes principales.

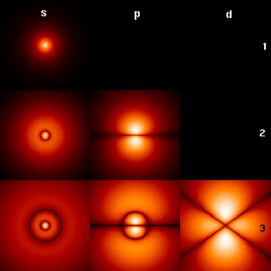

Un ejemplo de ecuación de valores propios donde la transformación se representa en términos de un operador diferencial es la ecuación de Schrödinger independiente del tiempo en mecánica cuántica :

donde , el hamiltoniano , es un operador diferencial de segundo orden y , la función de onda , es una de sus funciones propias correspondiente al valor propio , interpretado como su energía .

Sin embargo, en el caso en que uno esté interesado sólo en las soluciones de estado ligado de la ecuación de Schrödinger, busque dentro del espacio de funciones cuadradas integrables . Dado que este espacio es un espacio de Hilbert con un producto escalar bien definido , se puede introducir un conjunto de bases en el que y se puede representar como una matriz unidimensional (es decir, un vector) y una matriz respectivamente. Esto permite representar la ecuación de Schrödinger en forma matricial.

La notación bracket se utiliza a menudo en este contexto. Un vector, que representa un estado del sistema, en el espacio de Hilbert de funciones cuadradas integrables está representado por . En esta notación, la ecuación de Schrödinger es:

donde es un estado propio de y representa el valor propio. es un operador autoadjunto observable , el análogo de dimensión infinita de las matrices hermitianas. Al igual que en el caso matricial, en la ecuación anterior se entiende como el vector obtenido por aplicación de la transformación a .

La luz , las ondas acústicas y las microondas se dispersan aleatoriamente numerosas veces al atravesar un sistema estático desordenado. Aunque la dispersión múltiple aleatoriza repetidamente las ondas, en última instancia, el transporte de ondas coherente a través del sistema es un proceso determinista que puede describirse mediante una matriz de transmisión de campo . [45] [46] Los vectores propios del operador de transmisión forman un conjunto de frentes de onda de entrada específicos del desorden que permiten que las ondas se acoplen en los canales propios del sistema desordenado: las vías independientes que las ondas pueden viajar a través del sistema. Los valores propios , de corresponden a la transmitancia de intensidad asociada con cada canal propio. Una de las propiedades notables del operador de transmisión de sistemas difusivos es su distribución bimodal de valores propios con y . [46] Además, una de las propiedades sorprendentes de los canales propios abiertos, más allá de la transmitancia perfecta, es el perfil espacial estadísticamente robusto de los canales propios. [47]

En mecánica cuántica , y en particular en física atómica y molecular , dentro de la teoría de Hartree-Fock , los orbitales atómicos y moleculares pueden definirse mediante los vectores propios del operador de Fock . Los valores propios correspondientes se interpretan como potenciales de ionización según el teorema de Koopmans . En este caso, el término vector propio se utiliza con un significado algo más general, ya que el operador de Fock depende explícitamente de los orbitales y sus valores propios. Así, si se quiere subrayar este aspecto, se habla de problemas de valores propios no lineales. Estas ecuaciones suelen resolverse mediante un procedimiento de iteración , denominado en este caso método de campos autoconsistentes . En química cuántica , a menudo se representa la ecuación de Hartree-Fock en un conjunto de bases no ortogonales . Esta representación particular es un problema de valores propios generalizado llamado ecuaciones de Roothaan .

En geología , especialmente en el estudio de la formación de glaciares , los vectores propios y los valores propios se utilizan como un método mediante el cual una masa de información sobre la orientación y la inclinación de los constituyentes de un tejido de clastos se puede resumir en un espacio tridimensional mediante seis números. En el campo, un geólogo puede recopilar datos de cientos o miles de clastos en una muestra de suelo, que sólo se pueden comparar gráficamente, como en un diagrama Tri-Plot (Sneed and Folk), [48] [49] o como un Stereonet en una red Wulff. [50]

La salida del tensor de orientación está en los tres ejes ortogonales (perpendiculares) del espacio. Los tres vectores propios están ordenados por sus valores propios ; [51] entonces es la orientación/inclinación primaria de los clastos, es la secundaria y es la terciaria, en términos de fuerza. La orientación de los clastos se define como la dirección del vector propio, en una rosa de los vientos de 360° . La inclinación se mide como el valor propio, el módulo del tensor: esto se valora desde 0° (sin inclinación) hasta 90° (vertical). Los valores relativos de , y están dictados por la naturaleza de la estructura del sedimento. Si , se dice que el tejido es isotrópico. Si , se dice que la tela es plana. Si , se dice que la tela es lineal. [52]

El número básico de reproducción ( ) es un número fundamental en el estudio de cómo se propagan las enfermedades infecciosas. Si una persona infecciosa se incluye en una población de personas completamente susceptibles, entonces es el número promedio de personas que infectará una persona infecciosa típica. El tiempo de generación de una infección es el tiempo, desde que una persona se infecta hasta que la siguiente se infecta. En una población heterogénea, la matriz de próxima generación define cuántas personas de la población se infectarán una vez transcurrido el tiempo. El valor es entonces el valor propio más grande de la matriz de próxima generación. [53] [54]

En el procesamiento de imágenes , las imágenes procesadas de rostros pueden verse como vectores cuyos componentes son el brillo de cada píxel . [55] La dimensión de este espacio vectorial es el número de píxeles. Los vectores propios de la matriz de covarianza asociados con un gran conjunto de imágenes normalizadas de caras se denominan caras propias ; Este es un ejemplo de análisis de componentes principales . Son muy útiles para expresar cualquier imagen de rostro como una combinación lineal de algunas de ellas. En la rama de la biometría del reconocimiento facial , las caras propias proporcionan un medio para aplicar compresión de datos a las caras con fines de identificación . También se han realizado investigaciones relacionadas con sistemas de visión propios que determinan los gestos de las manos.

De manera similar a este concepto, las voces propias representan la dirección general de variabilidad en las pronunciaciones humanas de un enunciado particular, como una palabra en un idioma. A partir de una combinación lineal de dichas voces propias se puede construir una nueva pronunciación vocal de la palabra. Estos conceptos han resultado útiles en los sistemas automáticos de reconocimiento de voz para la adaptación del hablante.

![]() Wikiversity utiliza la física introductoria para presentar valores propios y vectores propios

Wikiversity utiliza la física introductoria para presentar valores propios y vectores propios