Los métodos numéricos para ecuaciones diferenciales ordinarias son métodos utilizados para encontrar aproximaciones numéricas a las soluciones de ecuaciones diferenciales ordinarias (EDO). Su uso también se conoce como " integración numérica ", aunque este término también puede referirse al cálculo de integrales .

Muchas ecuaciones diferenciales no se pueden resolver exactamente. Sin embargo, para fines prácticos (como en ingeniería) una aproximación numérica a la solución suele ser suficiente. Los algoritmos estudiados aquí se pueden utilizar para calcular dicha aproximación. Un método alternativo es utilizar técnicas de cálculo para obtener una expansión en serie de la solución.

Las ecuaciones diferenciales ordinarias ocurren en muchas disciplinas científicas, incluidas la física , la química , la biología y la economía . [1] Además, algunos métodos de ecuaciones diferenciales parciales numéricas convierten la ecuación diferencial parcial en una ecuación diferencial ordinaria, que luego debe resolverse.

Una ecuación diferencial de primer orden es un problema de valor inicial (IVP) de la forma, [2]

donde es una función y la condición inicial es un vector dado. Primer orden significa que solo la primera derivada de y aparece en la ecuación y las derivadas superiores están ausentes.

Sin pérdida de generalidad hacia los sistemas de orden superior, nos limitamos a ecuaciones diferenciales de primer orden , porque una EDO de orden superior se puede convertir en un sistema más grande de ecuaciones de primer orden introduciendo variables adicionales. Por ejemplo, la ecuación de segundo orden y ” = − y se puede reescribir como dos ecuaciones de primer orden: y ′ = z y z ′ = − y .

En esta sección, describimos métodos numéricos para los IVP y destacamos que los problemas de valores en la frontera (BVP) requieren un conjunto diferente de herramientas. En un BVP, se definen valores o componentes de la solución y en más de un punto. Debido a esto, es necesario utilizar diferentes métodos para resolver los BVP. Por ejemplo, el método de disparo (y sus variantes) o métodos globales como diferencias finitas , [3] métodos de Galerkin , [4] o métodos de colocación son apropiados para esa clase de problemas.

El teorema de Picard-Lindelöf establece que existe una solución única, siempre que f sea continua de Lipschitz .

Los métodos numéricos para resolver PIV de primer orden a menudo se clasifican en una de dos grandes categorías: [5] métodos lineales de varios pasos o métodos de Runge-Kutta . Se puede realizar una división adicional dividiendo los métodos en aquellos que son explícitos y aquellos que son implícitos. Por ejemplo, los métodos lineales implícitos de varios pasos incluyen los métodos de Adams-Moulton y los métodos de diferenciación hacia atrás (BDF), mientras que los métodos implícitos de Runge-Kutta [6] incluyen Runge-Kutta diagonalmente implícito (DIRK), [7] [8] Runge implícito diagonalmente –Kutta (SDIRK), [9] y Gauss-Radau [10] (basado en cuadratura gaussiana [11] ) métodos numéricos. Los ejemplos explícitos de la familia lineal de varios pasos incluyen los métodos de Adams-Bashforth , y cualquier método de Runge-Kutta con un cuadro de Butcher diagonal inferior es explícito . Una regla general vaga dicta que las ecuaciones diferenciales rígidas requieren el uso de esquemas implícitos, mientras que los problemas no rígidos pueden resolverse de manera más eficiente con esquemas explícitos.

Los llamados métodos lineales generales (GLM) son una generalización de las dos grandes clases de métodos anteriores. [12]

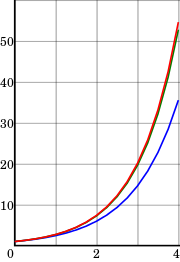

Desde cualquier punto de una curva, puedes encontrar una aproximación de un punto cercano de la curva moviéndote una distancia corta a lo largo de una línea tangente a la curva.

Comenzando con la ecuación diferencial ( 1 ), reemplazamos la derivada y ′ por la aproximación en diferencias finitas

que cuando se reorganiza da como resultado la siguiente fórmula

y usando ( 1 ) da:

Esta fórmula se suele aplicar de la siguiente manera. Elegimos un tamaño de paso h y construimos la secuencia que denotamos mediante una estimación numérica de la solución exacta . Motivados por ( 3 ), calculamos estas estimaciones mediante el siguiente esquema recursivo

Este es el método de Euler (o método de Euler hacia adelante , en contraste con el método de Euler hacia atrás , que se describirá a continuación). El método lleva el nombre de Leonhard Euler , quien lo describió en 1768.

El método de Euler es un ejemplo de método explícito . Esto significa que el nuevo valor y n +1 se define en términos de cosas que ya se conocen, como y n .

Si, en lugar de ( 2 ), utilizamos la aproximación

obtenemos el método de Euler hacia atrás :

El método de Euler hacia atrás es un método implícito , lo que significa que tenemos que resolver una ecuación para encontrar y n +1 . A menudo se utiliza la iteración de punto fijo o (alguna modificación de) el método de Newton-Raphson para lograrlo.

Cuesta más tiempo resolver esta ecuación que los métodos explícitos; Este costo debe tenerse en cuenta al seleccionar el método a utilizar. La ventaja de los métodos implícitos como ( 6 ) es que suelen ser más estables para resolver una ecuación rígida , lo que significa que se puede utilizar un tamaño de paso h mayor.

Los integradores exponenciales describen una gran clase de integradores que recientemente han experimentado un gran desarrollo. [13] Se remontan al menos a la década de 1960.

En lugar de ( 1 ), asumimos que la ecuación diferencial tiene la forma

o se ha linealizado localmente sobre un estado de fondo para producir un término lineal y un término no lineal .

Los integradores exponenciales se construyen multiplicando ( 7 ) por e integrando exactamente el resultado durante un intervalo de tiempo :

Esta ecuación integral es exacta, pero no define la integral.

El integrador exponencial de primer orden se puede realizar manteniendo constante durante todo el intervalo:

El método de Euler muchas veces no es lo suficientemente preciso. En términos más precisos, sólo tiene orden uno (el concepto de orden se explica a continuación). Esto hizo que los matemáticos buscaran métodos de orden superior.

Una posibilidad es utilizar no sólo el valor y n previamente calculado para determinar y n +1 , sino también hacer que la solución dependa de más valores pasados. Esto produce el llamado método de varios pasos . Quizás el más simple sea el método de salto , que es de segundo orden y (en términos generales) se basa en dos valores de tiempo.

Casi todos los métodos prácticos de varios pasos caen dentro de la familia de métodos lineales de varios pasos , que tienen la forma

Otra posibilidad es utilizar más puntos en el intervalo . Esto conduce a la familia de métodos Runge-Kutta , que lleva el nombre de Carl Runge y Martin Kutta . Uno de sus métodos de cuarto orden es especialmente popular.

Una buena implementación de uno de estos métodos para resolver una EDO implica más que la fórmula del paso del tiempo.

A menudo resulta ineficaz utilizar el mismo tamaño de paso todo el tiempo, por lo que se han desarrollado métodos de tamaño de paso variable . Por lo general, el tamaño del paso se elige de manera que el error (local) por paso esté por debajo de cierto nivel de tolerancia. Esto significa que los métodos también deben calcular un indicador de error , una estimación del error local.

Una extensión de esta idea es elegir dinámicamente entre diferentes métodos de diferentes órdenes (esto se llama método de orden variable ). Los métodos basados en la extrapolación de Richardson , [14] como el algoritmo de Bulirsch-Stoer , [15] [16] se utilizan a menudo para construir varios métodos de diferentes órdenes.

Otras características deseables incluyen:

Muchos métodos no entran dentro del marco discutido aquí. Algunas clases de métodos alternativos son:

Algunos IVP requieren una integración con una resolución temporal tan alta y/o en intervalos de tiempo tan largos que los métodos clásicos de pasos de tiempo en serie se vuelven computacionalmente inviables para ejecutarse en tiempo real (por ejemplo, IVP en predicción numérica del tiempo, modelado de plasma y dinámica molecular). Se han desarrollado métodos de tiempo paralelo (PinT) en respuesta a estos problemas para reducir los tiempos de ejecución de la simulación mediante el uso de computación paralela .

Los primeros métodos PinT (el primero propuesto en la década de 1960) [20] fueron inicialmente pasados por alto por los investigadores debido al hecho de que las arquitecturas de computación paralela que requerían aún no estaban ampliamente disponibles. Con más potencia informática disponible, el interés se renovó a principios de la década de 2000 con el desarrollo de Parareal , un algoritmo PinT flexible y fácil de usar que es adecuado para resolver una amplia variedad de IVP. La llegada de la computación a exaescala ha significado que los algoritmos PinT estén atrayendo cada vez más atención de la investigación y se estén desarrollando de tal manera que puedan aprovechar las supercomputadoras más poderosas del mundo . Los métodos más populares a partir de 2023 incluyen Parareal, PFASST, ParaDiag y MGRIT. [21]

El análisis numérico no es sólo el diseño de métodos numéricos, sino también su análisis. Tres conceptos centrales en este análisis son:

Se dice que un método numérico es convergente si la solución numérica se acerca a la solución exacta cuando el tamaño del paso h llega a 0. Más precisamente, requerimos que para cada EDO (1) con una función de Lipschitz f y cada t * > 0,

Todos los métodos mencionados anteriormente son convergentes.

Supongamos que el método numérico es

El error local (truncamiento) del método es el error cometido por un paso del método. Es decir, es la diferencia entre el resultado dado por el método, asumiendo que no se cometió ningún error en los pasos anteriores, y la solución exacta:

Se dice que el método es consistente si

El método tiene orden si

Por lo tanto, un método es consistente si tiene un orden mayor que 0. El método de Euler (hacia adelante) (4) y el método de Euler hacia atrás (6) presentados anteriormente tienen orden 1, por lo que son consistentes. La mayoría de los métodos que se utilizan en la práctica alcanzan un orden superior. La coherencia es una condición necesaria para la convergencia [ cita necesaria ] , pero no suficiente; Para que un método sea convergente, debe ser consistente y estable en cero.

Un concepto relacionado es el error global (truncamiento) , el error sostenido en todos los pasos que uno necesita para alcanzar un tiempo fijo . Explícitamente, el error global en el momento es dónde . El error global de un método de un solo paso de orden ésimo es ; en particular, dicho método es convergente. Esta afirmación no es necesariamente cierta para los métodos de varios pasos.

Para algunas ecuaciones diferenciales, la aplicación de métodos estándar, como el método de Euler, los métodos explícitos de Runge-Kutta o los métodos de varios pasos (por ejemplo, los métodos de Adams-Bashforth), muestra inestabilidad en las soluciones, aunque otros métodos pueden producir soluciones estables. Este "comportamiento difícil" en la ecuación (que puede no ser necesariamente complejo en sí mismo) se describe como rigidez y a menudo es causado por la presencia de diferentes escalas de tiempo en el problema subyacente. [23] Por ejemplo, una colisión en un sistema mecánico como en un oscilador de impacto normalmente ocurre en una escala de tiempo mucho más pequeña que el tiempo para el movimiento de los objetos; esta discrepancia produce "giros muy bruscos" en las curvas de los parámetros estatales.

Los problemas rígidos son omnipresentes en cinética química , teoría de control , mecánica de sólidos , pronóstico del tiempo , biología , física del plasma y electrónica . Una forma de superar la rigidez es extender la noción de ecuación diferencial a la de inclusión diferencial , que permite y modela la falta de suavidad. [24] [25]

A continuación se muestra una cronología de algunos avances importantes en este campo. [26] [27]

Los problemas de valores en la frontera (BVP) generalmente se resuelven numéricamente resolviendo un problema matricial aproximadamente equivalente obtenido discretizando el BVP original. [28] El método más comúnmente utilizado para resolver numéricamente BVP en una dimensión se llama Método de Diferencias Finitas . [3] Este método aprovecha combinaciones lineales de valores puntuales para construir coeficientes de diferencias finitas que describen derivadas de la función. Por ejemplo, la aproximación en diferencia central de segundo orden a la primera derivada viene dada por:

y la diferencia central de segundo orden para la segunda derivada viene dada por:

En ambas fórmulas, es la distancia entre valores de x vecinos en el dominio discretizado. Luego se construye un sistema lineal que luego puede resolverse mediante métodos matriciales estándar . Por ejemplo, supongamos que la ecuación a resolver es:

El siguiente paso sería discretizar el problema y utilizar aproximaciones derivadas lineales como

y resuelve el sistema resultante de ecuaciones lineales. Esto llevaría a ecuaciones como:

A primera vista, este sistema de ecuaciones parece tener dificultades asociadas con el hecho de que la ecuación no incluye términos que no se multipliquen por variables, pero en realidad esto es falso. En i = 1 y n − 1 hay un término que involucra los valores límite y dado que estos dos valores son conocidos, uno puede simplemente sustituirlos en esta ecuación y como resultado tener un sistema no homogéneo de ecuaciones lineales que no tiene soluciones triviales.