Un riesgo catastrófico global o un escenario apocalíptico es un evento hipotético que podría dañar el bienestar humano a escala global, [2] incluso poniendo en peligro o destruyendo la civilización moderna . [3] Un evento que podría causar la extinción humana o reducir de manera permanente y drástica la existencia o el potencial de la humanidad se conoce como un " riesgo existencial ". [4]

En el siglo XXI, se han creado varias organizaciones académicas y sin fines de lucro para investigar los riesgos catastróficos y existenciales globales, formular posibles medidas de mitigación y defender o implementar esas medidas. [5] [6] [7] [8]

El término riesgo catastrófico global “carece de una definición precisa” y generalmente se refiere (vagamente) a un riesgo que podría causar “daños graves al bienestar humano a escala global”. [10]

La humanidad ha sufrido grandes catástrofes en el pasado. Algunas de ellas han causado graves daños, pero sólo han tenido un alcance local (por ejemplo, la Peste Negra puede haber provocado la muerte de un tercio de la población de Europa, [11] el 10% de la población mundial en ese momento). [12] Algunas fueron globales, pero no tan graves (por ejemplo, la pandemia de gripe de 1918 mató a un 3-6% de la población mundial, según se estima). [13] La mayoría de los riesgos catastróficos globales no serían tan intensos como para matar a la mayoría de la vida en la Tierra, pero incluso si uno lo hiciera, el ecosistema y la humanidad acabarían recuperándose (a diferencia de los riesgos existenciales ).

De manera similar, en Catástrofe: riesgo y respuesta , Richard Posner identifica y agrupa los eventos que provocan “una catástrofe total o una ruina total” a escala global, en lugar de “local o regional”. Posner destaca esos eventos como dignos de especial atención por razones de costo-beneficio porque podrían poner en peligro directa o indirectamente la supervivencia de la raza humana en su conjunto. [14]

Los riesgos existenciales se definen como "riesgos que amenazan con la destrucción del potencial a largo plazo de la humanidad". [15] La materialización de un riesgo existencial (una catástrofe existencial [16] ) causaría la extinción total de la humanidad o la dejaría irreversiblemente atrapada en un estado de cosas drásticamente inferior. [9] [17] Los riesgos existenciales son una subclase de riesgos catastróficos globales, donde el daño no es solo global sino también terminal y permanente, impidiendo la recuperación y afectando así a las generaciones actuales y futuras. [9]

Aunque la extinción es la forma más obvia en la que se podría destruir el potencial a largo plazo de la humanidad, hay otras, incluyendo el colapso irrecuperable y la distopía irrecuperable . [18] Un desastre lo suficientemente grave como para causar el colapso permanente e irreversible de la civilización humana constituiría una catástrofe existencial, incluso si no llegara a la extinción. [18] De manera similar, si la humanidad cayera bajo un régimen totalitario, y no hubiera posibilidad de recuperación, entonces tal distopía también sería una catástrofe existencial. [19] Bryan Caplan escribe que "quizás una eternidad de totalitarismo sería peor que la extinción". [19] ( La novela de George Orwell Mil novecientos ochenta y cuatro sugiere [20] un ejemplo. [21] ) Un escenario distópico comparte las características clave de la extinción y el colapso irrecuperable de la civilización: antes de la catástrofe, la humanidad se enfrentaba a una amplia gama de futuros brillantes para elegir; después de la catástrofe, la humanidad está atrapada para siempre en un estado terrible. [18]

El psicólogo Steven Pinker ha calificado el riesgo existencial como una “categoría inútil” que puede distraer la atención de amenazas que él considera reales y solucionables, como el cambio climático y la guerra nuclear. [22]

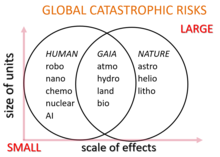

Los riesgos catastróficos globales potenciales se clasifican convencionalmente como peligros antropogénicos o no antropogénicos. Ejemplos de riesgos no antropogénicos son un impacto de asteroide o cometa , una erupción supervolcánica , una pandemia natural , un estallido letal de rayos gamma , una tormenta geomagnética causada por una eyección de masa coronal que destruya equipos electrónicos, un cambio climático natural a largo plazo , vida extraterrestre hostil o la transformación del Sol en una estrella gigante roja que envuelva a la Tierra dentro de miles de millones de años . [23]

Los riesgos antropogénicos son aquellos causados por los humanos e incluyen aquellos relacionados con la tecnología, la gobernanza y el cambio climático. Los riesgos tecnológicos incluyen la creación de inteligencia artificial desalineada con los objetivos humanos, la biotecnología y la nanotecnología . La gobernanza global insuficiente o maligna crea riesgos en el ámbito social y político, como la guerra global y el holocausto nuclear , [24] la guerra biológica y el bioterrorismo utilizando organismos genéticamente modificados , la guerra cibernética y el ciberterrorismo que destruyen infraestructura crítica como la red eléctrica , o la guerra radiológica utilizando armas como grandes bombas de cobalto . Otros riesgos catastróficos globales incluyen el cambio climático, la degradación ambiental , la extinción de especies , la hambruna como resultado de la distribución no equitativa de los recursos, la superpoblación o subpoblación humana , las malas cosechas y la agricultura no sostenible .

La investigación sobre la naturaleza y la mitigación de los riesgos catastróficos globales y los riesgos existenciales está sujeta a un conjunto único de desafíos y, como resultado, no es fácil someterla a los estándares habituales de rigor científico. [18] Por ejemplo, no es factible ni ético estudiar estos riesgos experimentalmente. Carl Sagan expresó esto con respecto a la guerra nuclear: "Comprender las consecuencias a largo plazo de la guerra nuclear no es un problema que se pueda verificar experimentalmente". [25] Además, muchos riesgos catastróficos cambian rápidamente a medida que avanza la tecnología y cambian las condiciones de fondo, como las condiciones geopolíticas. Otro desafío es la dificultad general de predecir con precisión el futuro en escalas de tiempo largas, especialmente para los riesgos antropogénicos que dependen de sistemas políticos, económicos y sociales humanos complejos. [18] Además de los riesgos conocidos y tangibles, pueden ocurrir eventos de extinción imprevisibles del tipo cisne negro , lo que presenta un problema metodológico adicional. [18] [26]

La humanidad nunca ha sufrido una catástrofe existencial y, si ocurriera una, sería necesariamente algo sin precedentes. [18] Por lo tanto, los riesgos existenciales plantean desafíos únicos para la predicción, incluso más que otros eventos de largo plazo, debido a los efectos de selección de la observación . [27] A diferencia de la mayoría de los eventos, el hecho de que no haya ocurrido un evento de extinción completa en el pasado no es evidencia en contra de su probabilidad en el futuro, porque todos los mundos que han experimentado un evento de extinción de este tipo han pasado desapercibidos para la humanidad. Independientemente de la frecuencia de los eventos de colapso de civilizaciones, ninguna civilización observa riesgos existenciales en su historia. [27] Estos problemas antrópicos pueden evitarse en parte analizando la evidencia que no tiene tales efectos de selección, como los cráteres de impacto de asteroides en la Luna, o evaluando directamente el impacto probable de las nuevas tecnologías. [9]

Para entender la dinámica de un colapso civilizacional global sin precedentes e irrecuperable (un tipo de riesgo existencial), puede ser instructivo estudiar los diversos colapsos civilizacionales locales que han ocurrido a lo largo de la historia humana. [28] Por ejemplo, civilizaciones como el Imperio Romano han terminado con una pérdida de gobierno centralizado y una importante pérdida de infraestructura y tecnología avanzada en toda la civilización. Sin embargo, estos ejemplos demuestran que las sociedades parecen ser bastante resistentes a las catástrofes; por ejemplo, la Europa medieval sobrevivió a la Peste Negra sin sufrir nada parecido a un colapso de civilización a pesar de perder entre el 25 y el 50 por ciento de su población. [29]

Existen razones económicas que pueden explicar por qué se dedica tan poco esfuerzo a la reducción del riesgo existencial. Se trata de un bien público global , por lo que deberíamos esperar que los mercados no lo ofrezcan en cantidad suficiente. [9] Incluso si una nación grande invierte en medidas de mitigación del riesgo, esa nación disfrutará sólo una pequeña fracción del beneficio que ello le reportaría. Además, la reducción del riesgo existencial es un bien público global intergeneracional , ya que la mayoría de los beneficios de la reducción del riesgo existencial serían disfrutados por las generaciones futuras, y aunque en teoría esas personas futuras tal vez estén dispuestas a pagar sumas sustanciales por la reducción del riesgo existencial, no existe ningún mecanismo para tal transacción. [9]

Numerosos sesgos cognitivos pueden influir en el juicio de las personas sobre la importancia de los riesgos existenciales, entre ellos la insensibilidad al alcance , el descuento hiperbólico , la heurística de disponibilidad , la falacia de conjunción , la heurística del afecto y el efecto del exceso de confianza . [30]

La insensibilidad al alcance de la acción influye en la percepción que la gente tiene de la extinción de la raza humana. Por ejemplo, cuando la gente está motivada a donar dinero a causas altruistas, la cantidad que está dispuesta a dar no aumenta linealmente con la magnitud del problema: la gente está más o menos dispuesta a evitar la muerte de 200.000 o de 2.000 aves. [31] De manera similar, la gente suele estar más preocupada por las amenazas a individuos que a grupos más grandes. [30]

Eliezer Yudkowsky teoriza que la negligencia en el alcance juega un papel en la percepción pública de los riesgos existenciales: [32] [33]

Cifras sustancialmente mayores, como 500 millones de muertes, y especialmente escenarios cualitativamente diferentes, como la extinción de toda la especie humana, parecen desencadenar un modo diferente de pensar... Las personas que nunca soñarían con lastimar a un niño oyen hablar de riesgo existencial y dicen: "Bueno, tal vez la especie humana realmente no merece sobrevivir".

Todas las predicciones anteriores sobre la extinción humana han resultado ser falsas. Para algunos, esto hace que las advertencias futuras parezcan menos creíbles. Nick Bostrom sostiene que la ausencia de extinciones humanas en el pasado es una prueba débil de que no habrá extinciones humanas en el futuro, debido al sesgo de supervivencia y otros efectos antrópicos . [34]

El sociobiólogo E. O. Wilson sostuvo que: "La razón de esta neblina miope, sostienen los biólogos evolucionistas, es que en realidad fue ventajosa durante todos los milenios, salvo los últimos, de los dos millones de años de existencia del género Homo... Se dio prioridad a la atención al futuro cercano y a la reproducción temprana, y poco más. Los desastres de una magnitud que sólo ocurren una vez cada pocos siglos fueron olvidados o transmutados en mitos". [35]

La defensa en profundidad es un marco útil para categorizar las medidas de mitigación de riesgos en tres capas de defensa: [36]

La extinción humana es más probable cuando las tres defensas son débiles, es decir, "por riesgos que es poco probable que podamos prevenir, a los que es poco probable que podamos responder con éxito y frente a los que es poco probable que podamos ser resilientes". [36]

La naturaleza sin precedentes de los riesgos existenciales plantea un desafío especial a la hora de diseñar medidas de mitigación de riesgos, ya que la humanidad no podrá aprender de un historial de acontecimientos anteriores. [18]

Algunos investigadores sostienen que tanto la investigación como otras iniciativas relacionadas con el riesgo existencial están insuficientemente financiadas. Nick Bostrom afirma que se han realizado más investigaciones sobre Star Trek , el snowboard o los escarabajos peloteros que sobre los riesgos existenciales. Las comparaciones de Bostrom han sido criticadas por ser "prepotentes". [22] [37] En 2020, la organización de la Convención sobre Armas Biológicas tenía un presupuesto anual de 1,4 millones de dólares. [38]

Algunos investigadores proponen el establecimiento en la Tierra de uno o más asentamientos remotos, autosuficientes y permanentemente ocupados, creados específicamente con el propósito de sobrevivir a un desastre global. [39] [40] [41] El economista Robin Hanson sostiene que un refugio que albergara permanentemente a tan sólo 100 personas mejoraría significativamente las posibilidades de supervivencia humana durante una serie de catástrofes globales. [39] [42]

Se ha propuesto el almacenamiento de alimentos a nivel mundial, pero el costo monetario sería alto. Además, probablemente contribuiría a los millones de muertes actuales por año debido a la desnutrición . [43] En 2022, un equipo dirigido por David Denkenberger modeló la rentabilidad de los alimentos resilientes para la seguridad de la inteligencia general artificial (AGI) y encontró "~98-99% de confianza" para un mayor impacto marginal del trabajo sobre alimentos resilientes. [44] Algunos supervivientes abastecen los refugios de supervivencia con suministros de alimentos para varios años.

La Bóveda Global de Semillas de Svalbard está enterrada a 120 m (400 pies) dentro de una montaña en una isla del Ártico . Está diseñada para albergar 2500 millones de semillas de más de 100 países como medida de precaución para preservar los cultivos del mundo. La roca circundante está a -6 °C (21 °F) (a partir de 2015), pero la bóveda se mantiene a -18 °C (0 °F) mediante refrigeradores alimentados con carbón de origen local. [45] [46]

En términos más especulativos, si la sociedad sigue funcionando y la biosfera sigue siendo habitable, las necesidades calóricas de la población humana actual podrían, en teoría, satisfacerse durante una ausencia prolongada de luz solar, siempre que se planifique con suficiente antelación. Entre las soluciones conjeturadas se encuentran el cultivo de hongos en la biomasa vegetal muerta que quedó tras la catástrofe, la conversión de celulosa en azúcar o la alimentación de bacterias que digieren metano con gas natural. [47] [48]

La falta de gobernanza global genera riesgos en el ámbito social y político, pero los mecanismos de gobernanza se desarrollan más lentamente que el cambio tecnológico y social. Los gobiernos, el sector privado y el público en general están preocupados por la falta de mecanismos de gobernanza para abordar eficazmente los riesgos, negociar y arbitrar entre intereses diversos y conflictivos. Esto se ve subrayado aún más por la comprensión de la interconexión de los riesgos sistémicos globales. [49] En ausencia o anticipación de una gobernanza global, los gobiernos nacionales pueden actuar individualmente para comprender, mitigar y prepararse mejor para las catástrofes globales. [50]

En 2018, el Club de Roma pidió una mayor acción frente al cambio climático y publicó su Plan de Emergencia Climática, que propone diez puntos de acción para limitar el aumento de la temperatura media global a 1,5 grados Celsius. [51] Además, en 2019, el Club publicó el Plan de Emergencia Planetaria, más completo. [52]

Hay evidencia que sugiere que la interacción colectiva con las experiencias emocionales que surgen al contemplar la vulnerabilidad de la especie humana en el contexto del cambio climático permite que estas experiencias sean adaptativas. Cuando la interacción colectiva con las experiencias emocionales y su procesamiento es de apoyo, esto puede conducir al crecimiento de la resiliencia, la flexibilidad psicológica, la tolerancia a las experiencias emocionales y la participación comunitaria. [53]

La colonización espacial es una alternativa propuesta para mejorar las probabilidades de sobrevivir a un escenario de extinción. [54] Soluciones de este alcance pueden requerir ingeniería a gran escala .

El astrofísico Stephen Hawking abogó por la colonización de otros planetas dentro del Sistema Solar una vez que la tecnología progrese lo suficiente, con el fin de mejorar las posibilidades de supervivencia humana ante eventos de alcance planetario como una guerra termonuclear global. [55] [56]

El multimillonario Elon Musk escribe que la humanidad debe convertirse en una especie multiplanetaria para evitar la extinción. [57] Su empresa SpaceX está desarrollando tecnología que, según sus proyecciones, se utilizará para colonizar Marte .

El Boletín de los Científicos Atómicos (fundado en 1945) es una de las organizaciones de riesgo global más antiguas, fundada después de que el público se alarmara por el potencial de una guerra atómica tras la Segunda Guerra Mundial. Estudia los riesgos asociados con la guerra y la energía nuclear y es famoso por mantener el Reloj del Juicio Final establecido en 1947. El Instituto Foresight (fundado en 1986) examina los riesgos de la nanotecnología y sus beneficios. Fue una de las primeras organizaciones en estudiar las consecuencias no deseadas de una tecnología inofensiva que se descontrola a escala global. Fue fundado por K. Eric Drexler, quien postuló la " sustancia viscosa gris ". [58] [59]

A partir del año 2000, un número cada vez mayor de científicos, filósofos y multimillonarios del sector tecnológico crearon organizaciones dedicadas a estudiar los riesgos globales tanto dentro como fuera del ámbito académico. [60]

Las organizaciones no gubernamentales (ONG) independientes incluyen el Machine Intelligence Research Institute (fundado en 2000), que tiene como objetivo reducir el riesgo de una catástrofe causada por la inteligencia artificial, [61] con donantes como Peter Thiel y Jed McCaleb . [62] La Nuclear Threat Initiative (fundada en 2001) busca reducir las amenazas globales de amenazas nucleares, biológicas y químicas, y la contención de daños después de un evento. [8] Mantiene un índice de seguridad de material nuclear. [63] La Lifeboat Foundation (fundada en 2009) financia investigaciones para prevenir una catástrofe tecnológica. [64] La mayor parte del dinero de investigación financia proyectos en universidades. [65] El Global Catastrophic Risk Institute (fundado en 2011) es un grupo de expertos no partidista y sin fines de lucro con sede en EE. UU. fundado por Seth Baum y Tony Barrett. GCRI realiza investigaciones y trabajo de políticas en varios riesgos, incluidos la inteligencia artificial, la guerra nuclear, el cambio climático y los impactos de asteroides. [66] La Global Challenges Foundation (fundada en 2012), con sede en Estocolmo y fundada por Laszlo Szombatfalvy , publica un informe anual sobre el estado de los riesgos globales. [67] [68] El Future of Life Institute (fundado en 2014) trabaja para reducir los riesgos extremos a gran escala de las tecnologías transformadoras, así como para dirigir el desarrollo y el uso de estas tecnologías en beneficio de toda la vida, mediante la concesión de subvenciones, la promoción de políticas en los Estados Unidos, la Unión Europea y las Naciones Unidas, y la divulgación educativa. [7] Elon Musk , Vitalik Buterin y Jaan Tallinn son algunos de sus mayores donantes. [69] El Center on Long-Term Risk (fundado en 2016), anteriormente conocido como Foundational Research Institute, es una organización británica centrada en la reducción de los riesgos de sufrimiento astronómico ( s-risks ) de las tecnologías emergentes. [70]

Entre las organizaciones universitarias se encontraba el Future of Humanity Institute (fundado en 2005), que investigaba las cuestiones del futuro a largo plazo de la humanidad, en particular el riesgo existencial. [5] Fue fundado por Nick Bostrom y tenía su sede en la Universidad de Oxford. [5] El Centre for the Study of Existential Risk (fundado en 2012) es una organización con sede en la Universidad de Cambridge que estudia cuatro grandes riesgos tecnológicos: la inteligencia artificial, la biotecnología, el calentamiento global y la guerra. [6] Todos son riesgos provocados por el hombre, como explicó Huw Price a la agencia de noticias AFP: "Parece una predicción razonable que en algún momento de este siglo o del próximo la inteligencia escapará de las limitaciones de la biología". Añadió que cuando esto ocurra "ya no seremos las cosas más inteligentes del mundo" y correremos el riesgo de estar a merced de "máquinas que no son maliciosas, sino máquinas cuyos intereses no nos incluyen". [71] Stephen Hawking fue asesor interino. La Alianza del Milenio para la Humanidad y la Biosfera es una organización con sede en la Universidad de Stanford que se centra en muchos temas relacionados con la catástrofe global al reunir a miembros del mundo académico en las humanidades. [72] [73] Fue fundada por Paul Ehrlich , entre otros. [74] La Universidad de Stanford también tiene el Centro para la Seguridad y la Cooperación Internacional, que se centra en la cooperación política para reducir el riesgo catastrófico global. [75] El Centro para la Seguridad y la Tecnología Emergente se estableció en enero de 2019 en la Escuela Walsh de Servicio Exterior de Georgetown y se centrará en la investigación de políticas de tecnologías emergentes con un énfasis inicial en la inteligencia artificial. [76] Recibieron una subvención de 55 millones de dólares de Good Ventures según lo sugerido por Open Philanthropy . [76]

Otros grupos de evaluación de riesgos tienen su base en organizaciones gubernamentales o forman parte de ellas. La Organización Mundial de la Salud (OMS) incluye una división llamada Alerta y Respuesta Global (GAR) que monitorea y responde a las crisis epidémicas globales. [77] GAR ayuda a los estados miembros con la capacitación y coordinación de la respuesta a las epidemias. [78] La Agencia de los Estados Unidos para el Desarrollo Internacional (USAID) tiene su Programa de Amenazas Pandémicas Emergentes que tiene como objetivo prevenir y contener las pandemias generadas naturalmente en su origen. [79] El Laboratorio Nacional Lawrence Livermore tiene una división llamada Dirección Principal de Seguridad Global que investiga en nombre del gobierno cuestiones como la bioseguridad y el contraterrorismo. [80]

Esta es una definición equivalente, aunque más precisa, de Nick Bostrom : "Un riesgo existencial es aquel que amenaza con la extinción prematura de la vida inteligente originada en la Tierra o la destrucción permanente y drástica de su potencial para un desarrollo futuro deseable". Fuente: Bostrom, Nick (2013). "Existential Risk Prevention as Global Priority". Global Policy. 4:15-31.

El creador de Winston, George Orwell, creía que la libertad acabaría derrotando al totalitarismo distorsionador de la verdad retratado en Mil novecientos ochenta y cuatro.

sobrevivió a la pérdida del 25 al 50 por ciento de su población en la Peste Negra, mientras que mantuvo la civilización firmemente intacta.

El organismo internacional responsable de la prohibición continua de las armas biológicas (la Convención sobre Armas Biológicas) tiene un presupuesto anual de 1,4 millones de dólares, menos que el restaurante McDonald's promedio.

El Instituto de Investigación de Inteligencia Artificial tiene como objetivo reducir el riesgo de una catástrofe, en caso de que tal evento finalmente ocurra.

Actualmente nos centramos en los esfuerzos para reducir los peores riesgos de sufrimiento astronómico (riesgos-s) de las tecnologías emergentes, con un enfoque en la inteligencia artificial transformadora.

Ya sea que busque una cura para el cáncer, o persiga una carrera académica o artística, o se dedique a establecer instituciones más justas, una amenaza para el futuro de la humanidad es también una amenaza para la importancia de lo que hace.