La ciencia de redes es un campo académico que estudia redes complejas como redes de telecomunicaciones , redes informáticas , redes biológicas , redes cognitivas y semánticas y redes sociales , considerando distintos elementos o actores representados por nodos (o vértices ) y las conexiones entre los elementos o actores. como enlaces (o bordes ). El campo se basa en teorías y métodos que incluyen la teoría de grafos de las matemáticas, la mecánica estadística de la física, la minería de datos y la visualización de información de la informática, el modelado inferencial de la estadística y la estructura social de la sociología. El Consejo Nacional de Investigación de Estados Unidos define la ciencia de redes como "el estudio de representaciones en red de fenómenos físicos, biológicos y sociales que conducen a modelos predictivos de estos fenómenos". [1]

El estudio de redes ha surgido en diversas disciplinas como un medio para analizar datos relacionales complejos. El primer artículo conocido en este campo son los famosos Siete Puentes de Königsberg, escrito por Leonhard Euler en 1736. La descripción matemática de Euler de los vértices y aristas fue la base de la teoría de grafos , una rama de las matemáticas que estudia las propiedades de las relaciones por pares en una estructura de red. . El campo de la teoría de grafos continuó desarrollándose y encontró aplicaciones en la química (Sylvester, 1878).

Dénes Kőnig , matemático y profesor húngaro, escribió el primer libro de Teoría de Grafos, titulado "Teoría de los grafos finitos e infinitos", en 1936. [2]

En la década de 1930 llega a Estados Unidos Jacob Moreno , psicólogo de tradición Gestalt . Desarrolló el sociograma y lo presentó al público en abril de 1933 en una convención de académicos médicos. Moreno afirmó que "antes del advenimiento de la sociometría nadie sabía cómo era 'precisamente' la estructura interpersonal de un grupo" (Moreno, 1953). El sociograma era una representación de la estructura social de un grupo de estudiantes de primaria. Los chicos eran amigos de chicos y las chicas eran amigas de chicas con la excepción de un chico que dijo que le gustaba una chica soltera. El sentimiento no fue correspondido. Esta representación en red de la estructura social resultó tan intrigante que se publicó en The New York Times (3 de abril de 1933, página 17). El sociograma ha encontrado muchas aplicaciones y ha crecido en el campo del análisis de redes sociales .

La teoría probabilística en la ciencia de redes se desarrolló como una rama de la teoría de grafos con los ocho famosos artículos de Paul Erdős y Alfréd Rényi sobre grafos aleatorios . Para las redes sociales, el modelo de gráfico aleatorio exponencial o p* es un marco de notación utilizado para representar el espacio de probabilidad de que ocurra un empate en una red social . Un enfoque alternativo a las estructuras de probabilidad de red es la matriz de probabilidad de red , que modela la probabilidad de que ocurran bordes en una red, en función de la presencia o ausencia histórica del borde en una muestra de redes.

En 1998, David Krackhardt y Kathleen Carley introdujeron la idea de una metared con el modelo PCANS. Sugieren que "todas las organizaciones están estructuradas en torno a estos tres dominios: individuos, tareas y recursos". Su artículo introdujo el concepto de que las redes ocurren en múltiples dominios y que están interrelacionadas. Este campo se ha convertido en otra subdisciplina de la ciencia de redes llamada análisis dinámico de redes .

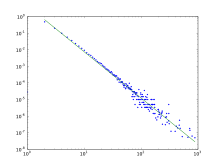

Más recientemente, otros esfuerzos científicos de redes se han centrado en describir matemáticamente diferentes topologías de redes. Duncan Watts y Steven Strogatz reconciliaron datos empíricos sobre redes con representación matemática, describiendo la red del mundo pequeño . Albert-László Barabási y Reka Albert descubrieron redes sin escala , una propiedad que captura el hecho de que en la red real los centros coexisten con muchos vértices de grado pequeño, y ofrecieron un modelo dinámico para explicar el origen de este estado sin escala.

El ejército estadounidense se interesó por primera vez en la guerra centrada en redes como un concepto operativo basado en la ciencia de redes en 1996. John A. Parmentola, director de Investigación y Gestión de Laboratorios del Ejército estadounidense, propuso a la Junta de Ciencia y Tecnología (BAST) del Ejército el 1 de diciembre de 2003 que Network Science se convirtió en una nueva área de investigación del Ejército. El BAST, la División de Ingeniería y Ciencias Físicas del Consejo Nacional de Investigación (NRC) de las Academias Nacionales, sirve como autoridad convocante para la discusión de cuestiones de ciencia y tecnología de importancia para el Ejército y supervisa estudios independientes relacionados con el Ejército realizados por las Academias Nacionales. El BAST llevó a cabo un estudio para descubrir si identificar y financiar un nuevo campo de investigación en investigación básica, la ciencia de redes, podría ayudar a cerrar la brecha entre lo que se necesita para realizar operaciones centradas en redes y el estado primitivo actual del conocimiento fundamental de las redes.

Como resultado, el BAST publicó el estudio de la NRC en 2005 titulado Network Science (mencionado anteriormente) que definió un nuevo campo de investigación básica en Network Science para el Ejército. Con base en los hallazgos y recomendaciones de ese estudio y el posterior informe de la NRC de 2007 titulado Estrategia para un Centro del Ejército para la Ciencia, Tecnología y Experimentación de Redes, los recursos de investigación básica del Ejército fueron redirigidos para iniciar un nuevo programa de investigación básica en Ciencia de Redes. Para construir una nueva base teórica para redes complejas, algunos de los esfuerzos clave de investigación en ciencia de redes que actualmente se llevan a cabo en los laboratorios del Ejército abordan:

Como lo inició en 2004 Frederick I. Moxley con el apoyo que solicitó de David S. Alberts, el Departamento de Defensa ayudó a establecer el primer Centro Científico en Red junto con el Ejército de los EE. UU. en la Academia Militar de los Estados Unidos (USMA). Bajo la tutela del Dr. Moxley y el cuerpo docente de la USMA, se impartieron a cadetes en West Point los primeros cursos interdisciplinarios de pregrado en Ciencias de Redes. [3] [4] [5] Para inculcar mejor los principios de la ciencia de redes entre su cuadro de futuros líderes, la USMA también ha instituido una especialización universitaria de cinco cursos en Ciencias de Redes. [6]

En 2006, el Ejército de los EE. UU. y el Reino Unido formaron la Alianza Tecnológica Internacional de Redes y Ciencias de la Información , una asociación de colaboración entre el Laboratorio de Investigación del Ejército, el Ministerio de Defensa del Reino Unido y un consorcio de industrias y universidades de los EE. UU. y el Reino Unido. El objetivo de la alianza es realizar investigación básica en apoyo de operaciones centradas en la red que cubran las necesidades de ambas naciones.

En 2009, el Ejército de los EE. UU. formó Network Science CTA , una alianza de investigación colaborativa entre el Laboratorio de Investigación del Ejército , CERDEC , y un consorcio de alrededor de 30 universidades y laboratorios de investigación y desarrollo industrial en los EE. UU. El objetivo de la alianza es desarrollar una comprensión profunda de los puntos comunes subyacentes entre las redes sociales/cognitivas, de información y de comunicaciones entrelazadas y, como resultado, mejoran nuestra capacidad para analizar, predecir, diseñar e influir en sistemas complejos que entrelazan muchos tipos de redes.

Posteriormente, como resultado de estos esfuerzos, el Departamento de Defensa de EE. UU. ha patrocinado numerosos proyectos de investigación que respaldan la Ciencia de Redes.

La definición de red determinista se define en comparación con la definición de red probabilística. En redes deterministas no ponderadas, los bordes existen o no; generalmente usamos 0 para representar la inexistencia de un borde mientras que 1 para representar la existencia de un borde. En redes deterministas ponderadas, el valor del borde representa el peso de cada borde, por ejemplo, el nivel de resistencia.

En las redes probabilísticas, los valores detrás de cada borde representan la probabilidad de existencia de cada borde. Por ejemplo, si una arista tiene un valor igual a 0,9, decimos que la probabilidad de existencia de esta arista es 0,9. [7]

A menudo, las redes tienen ciertos atributos que se pueden calcular para analizar las propiedades y características de la red. El comportamiento de estas propiedades de red a menudo define modelos de red y se puede utilizar para analizar cómo ciertos modelos contrastan entre sí. Muchas de las definiciones de otros términos utilizados en la ciencia de redes se pueden encontrar en el Glosario de teoría de grafos .

El tamaño de una red puede referirse a la cantidad de nodos o, menos comúnmente, a la cantidad de aristas que (para gráficos conectados sin múltiples aristas) pueden variar desde (un árbol) hasta (un gráfico completo). En el caso de un gráfico simple (una red en la que existe como máximo un borde (no dirigido) entre cada par de vértices y en la que ningún vértice se conecta entre sí), tenemos ; para gráficos dirigidos (sin nodos autoconectados), ; para gráficos dirigidos con autoconexiones permitidas, . En el caso de un gráfico dentro del cual pueden existir múltiples aristas entre un par de vértices, .

La densidad de una red se define como una relación normalizada entre 0 y 1 entre el número de aristas y el número de aristas posibles en una red con nodos. La densidad de la red es una medida del porcentaje de bordes "opcionales" que existen en la red y se puede calcular como dónde y son el número mínimo y máximo de bordes en una red conectada con nodos, respectivamente. En el caso de gráficas simples, viene dada por el coeficiente binomial y , dando densidad . Otra posible ecuación es que los vínculos son unidireccionales (Wasserman y Faust 1994). [8] Esto proporciona una mejor visión general de la densidad de la red, porque se pueden medir las relaciones unidireccionales.

La densidad de una red, donde no hay intersección entre aristas, se define como una relación entre el número de aristas y el número de aristas posibles en una red con nodos, dada por un gráfico sin aristas que se cruzan , dando

El grado de un nodo es el número de aristas conectadas a él. Estrechamente relacionado con la densidad de una red está el grado promedio (o, en el caso de gráficos dirigidos, el antiguo factor de 2 que surge de cada borde en un gráfico no dirigido que contribuye al grado de dos vértices distintos). En el modelo de gráfico aleatorio ER ( ) podemos calcular el valor esperado de (igual al valor esperado de un vértice arbitrario): un vértice aleatorio tiene otros vértices en la red disponibles y, con probabilidad , se conecta a cada uno. De este modo, .

La longitud promedio del camino más corto se calcula encontrando el camino más corto entre todos los pares de nodos y tomando el promedio de todos los caminos de su longitud (siendo la longitud el número de bordes intermedios contenidos en el camino, es decir, la distancia entre los dos vértices dentro del gráfico). Esto nos muestra, en promedio, la cantidad de pasos que se necesitan para llegar de un miembro de la red a otro. El comportamiento de la longitud promedio esperada del camino más corto (es decir, el promedio conjunto de la longitud promedio del camino más corto) en función del número de vértices de un modelo de red aleatorio define si ese modelo exhibe el efecto de mundo pequeño; si escala como , el modelo genera redes de mundo pequeño. Para un crecimiento más rápido que logarítmico, el modelo no produce mundos pequeños. El caso especial se conoce como efecto del mundo ultrapequeño.

Como otro medio para medir gráficos de red, podemos definir el diámetro de una red como el más largo de todos los caminos más cortos calculados en una red. Es la distancia más corta entre los dos nodos más distantes de la red. En otras palabras, una vez que se calcula la longitud de ruta más corta desde cada nodo a todos los demás nodos, el diámetro es la más larga de todas las longitudes de ruta calculadas. El diámetro es representativo del tamaño lineal de una red. Si los nodos ABCD están conectados, yendo de A->D, este sería el diámetro de 3 (3 saltos, 3 enlaces). [ cita necesaria ]

El coeficiente de agrupamiento es una medida de la propiedad "todos mis amigos se conocen". Esto a veces se describe como que los amigos de mis amigos son mis amigos. Más precisamente, el coeficiente de agrupamiento de un nodo es la relación entre los enlaces existentes que conectan a los vecinos de un nodo entre sí y el número máximo posible de dichos enlaces. El coeficiente de agrupamiento para toda la red es el promedio de los coeficientes de agrupamiento de todos los nodos. Un coeficiente de agrupamiento alto para una red es otro indicio de que el mundo es pequeño .

El coeficiente de agrupamiento del 'ésimo nodo es

donde es el número de vecinos del 'ésimo nodo y es el número de conexiones entre estos vecinos. El número máximo posible de conexiones entre vecinos es, entonces,

Desde un punto de vista probabilístico, el coeficiente de agrupamiento local esperado es la probabilidad de que exista un vínculo entre dos vecinos arbitrarios del mismo nodo.

La forma en que se conecta una red juega un papel importante en cómo se analizan e interpretan las redes. Las redes se clasifican en cuatro categorías diferentes:

Los índices de centralidad producen clasificaciones que buscan identificar los nodos más importantes en un modelo de red. Diferentes índices de centralidad codifican diferentes contextos para la palabra "importancia". La centralidad de intermediación , por ejemplo, considera que un nodo es muy importante si forma puentes entre muchos otros nodos. La centralidad del valor propio , por el contrario, considera un nodo muy importante si muchos otros nodos muy importantes se vinculan a él. En la literatura se han propuesto cientos de medidas de este tipo.

Los índices de centralidad sólo son precisos para identificar los nodos más importantes. Las medidas rara vez, o nunca, son significativas para el resto de los nodos de la red. [9] [10] Además, sus indicaciones sólo son precisas dentro del contexto asumido de importancia y tienden a "equivocarse" en otros contextos. [11] Por ejemplo, imagine dos comunidades separadas cuyo único vínculo es un borde entre el miembro más joven de cada comunidad. Dado que cualquier transferencia de una comunidad a otra debe pasar por este vínculo, los dos miembros más jóvenes tendrán una alta centralidad de intermediación. Pero, dado que son jóvenes, (presumiblemente) tienen pocas conexiones con los nodos "importantes" de su comunidad, lo que significa que la centralidad de su valor propio sería bastante baja.

Las limitaciones a las medidas de centralidad han llevado al desarrollo de medidas más generales. Dos ejemplos son la accesibilidad , que utiliza la diversidad de paseos aleatorios para medir qué tan accesible es el resto de la red desde un nodo de inicio determinado, [12] y la fuerza esperada , derivada del valor esperado de la fuerza de infección generada por un nodo. [9] Ambas medidas pueden calcularse significativamente a partir de la estructura de la red únicamente.

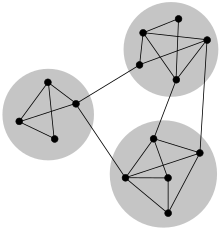

Los nodos de una red pueden dividirse en grupos que representan comunidades. Dependiendo del contexto, las comunidades pueden ser distintas o superpuestas. Normalmente, los nodos de dichas comunidades estarán fuertemente conectados con otros nodos de la misma comunidad, pero débilmente conectados con nodos fuera de la comunidad. En ausencia de una verdad fundamental que describa la estructura comunitaria de una red específica, se han desarrollado varios algoritmos para inferir posibles estructuras comunitarias utilizando métodos de agrupamiento supervisados o no supervisados.

Los modelos de red sirven como base para comprender las interacciones dentro de redes empíricas complejas. Varios modelos de generación de gráficos aleatorios producen estructuras de red que pueden usarse en comparación con redes complejas del mundo real.

El modelo Erdős-Rényi , llamado así por Paul Erdős y Alfréd Rényi , se utiliza para generar gráficos aleatorios en los que se establecen aristas entre nodos con iguales probabilidades. Se puede utilizar en el método probabilístico para demostrar la existencia de gráficos que satisfacen diversas propiedades o para proporcionar una definición rigurosa de lo que significa que una propiedad se cumpla para casi todos los gráficos.

Para generar un modelo Erdős-Rényi se deben especificar dos parámetros: el número total de nodos n y la probabilidad p de que un par aleatorio de nodos tenga una arista.

Debido a que el modelo se genera sin sesgo hacia nodos particulares, la distribución de grados es binomial: para un vértice elegido al azar ,

En este modelo, el coeficiente de agrupamiento es 0 a.s. El comportamiento de se puede dividir en tres regiones.

Subcrítico : Todos los componentes son simples y muy pequeños, el componente más grande tiene tamaño ;

Crítico : ;

Supercrítica : donde está la solución positiva de la ecuación .

El componente conectado más grande tiene una alta complejidad. Todos los demás componentes son simples y pequeños .

El modelo de configuración toma una secuencia de grados [13] [14] o una distribución de grados [15] (que posteriormente se utiliza para generar una secuencia de grados) como entrada y produce gráficos conectados aleatoriamente en todos los aspectos excepto la secuencia de grados. Esto significa que para una elección dada de la secuencia de grados, el gráfico se elige uniformemente al azar del conjunto de todos los gráficos que cumplen con esta secuencia de grados. El grado de un vértice elegido al azar es una variable aleatoria independiente e idénticamente distribuida con valores enteros. Cuando , el gráfico de configuración contiene el componente gigante conectado , que tiene un tamaño infinito. [14] El resto de los componentes tienen tamaños finitos, los cuales pueden cuantificarse con la noción de distribución de tamaños. La probabilidad de que un nodo muestreado aleatoriamente esté conectado a un componente de tamaño viene dada por las potencias de convolución de la distribución de grados: [16]

En el modelo de configuración dirigida, el grado de un nodo viene dado por dos números, dentro y fuera del grado , y en consecuencia, la distribución de grados es de dos variables. El número esperado de aristas de entrada y de salida coincide, de modo que . El modelo de configuración dirigida contiene el componente gigante iff [18]

para componentes externos.

El modelo de Watts y Strogatz es un modelo de generación de gráficos aleatorios que produce gráficos con propiedades de mundo pequeño .

Se utiliza una estructura reticular inicial para generar un modelo de Watts-Strogatz. Cada nodo de la red está inicialmente vinculado a sus vecinos más cercanos. Otro parámetro se especifica como la probabilidad de recableado. Cada borde tiene una probabilidad de que se vuelva a cablear en el gráfico como un borde aleatorio. El número esperado de enlaces recableados en el modelo es .

Como el modelo Watts-Strogatz comienza como una estructura reticular no aleatoria, tiene un coeficiente de agrupamiento muy alto junto con una longitud de camino promedio alta. Es probable que cada recableado cree un atajo entre clústeres altamente conectados. A medida que aumenta la probabilidad de recableado, el coeficiente de agrupamiento disminuye más lentamente que la longitud promedio del camino. En efecto, esto permite que la longitud promedio de la ruta de la red disminuya significativamente con solo ligeras disminuciones en el coeficiente de agrupamiento. Los valores más altos de p fuerzan más bordes recableados, lo que en efecto hace que el modelo Watts-Strogatz sea una red aleatoria.

El modelo Barabási-Albert es un modelo de red aleatorio que se utiliza para demostrar un vínculo preferencial o un efecto de "los ricos se hacen más ricos". En este modelo, es más probable que un borde se una a nodos con grados más altos. La red comienza con una red inicial de m 0 nodos. m 0 ≥ 2 y el grado de cada nodo en la red inicial debe ser al menos 1, de lo contrario siempre permanecerá desconectado del resto de la red.

En el modelo BA, los nuevos nodos se agregan a la red uno por uno. Cada nuevo nodo está conectado a nodos existentes con una probabilidad proporcional al número de enlaces que los nodos existentes ya tienen. Formalmente, la probabilidad p i de que el nuevo nodo esté conectado al nodo i es [20]

donde k i es el grado del nodo i . Los nodos muy vinculados ("hubs") tienden a acumular rápidamente aún más vínculos, mientras que los nodos con sólo unos pocos vínculos probablemente no sean elegidos como destino para un nuevo vínculo. Los nuevos nodos tienen una "preferencia" de unirse a los nodos que ya están fuertemente vinculados.

La distribución de grados resultante del modelo BA no tiene escala; en particular, para grados grandes es una ley potencial de la forma:

Los centros exhiben una alta centralidad de intermediación que permite que existan caminos cortos entre los nodos. Como resultado, el modelo BA tiende a tener longitudes de trayectoria promedio muy cortas. El coeficiente de agrupamiento de este modelo también tiende a 0.

El modelo Barabási-Albert [21] fue desarrollado para redes no dirigidas pero se aplicó a una amplia gama de aplicaciones diferentes. La versión dirigida de este modelo es el modelo de Price [22] [23] que se aplicó únicamente a redes de citas. Matemáticamente, se pueden utilizar las mismas ecuaciones para describir estos modelos [24] y ambos muestran las mismas características.

En la conexión preferencial no lineal (NLPA), los nodos existentes en la red obtienen nuevas aristas proporcionalmente al grado del nodo elevado a una potencia positiva constante, . [25] Formalmente, esto significa que la probabilidad de que el nodo obtenga una nueva arista está dada por

Si , NLPA se reduce al modelo BA y se denomina "lineal". Si , NLPA se denomina "sublineal" y la distribución de grados de la red tiende a una distribución exponencial extendida . Si , NLPA se denomina "superlineal" y una pequeña cantidad de nodos se conectan a casi todos los demás nodos de la red. Para ambos y , la propiedad libre de escala de la red se rompe en el límite del tamaño infinito del sistema. Sin embargo, si es sólo ligeramente mayor que , NLPA puede dar como resultado distribuciones de grados que parecen estar transitoriamente libres de escala. [26]

En el modelo de adjunto impulsado por mediación (MDA), en el que un nuevo nodo que viene con bordes selecciona al azar un nodo conectado existente y luego se conecta no con ese sino con sus vecinos elegidos también al azar. La probabilidad de que el nodo del nodo existente elegido sea

El factor es la inversa de la media armónica (IHM) de grados de los vecinos de un nodo . Una extensa investigación numérica sugiere que para aproximadamente el valor medio de IHM en el límite grande se convierte en una constante, lo que significa . Implica que cuanto mayores sean los vínculos (grado) que tenga un nodo, mayores serán sus posibilidades de obtener más vínculos, ya que se puede llegar a ellos de un mayor número de maneras a través de mediadores, lo que esencialmente encarna la idea intuitiva del mecanismo de que los ricos se hacen más ricos (o el mecanismo preferencial). regla de apego del modelo Barabasi-Albert). Por lo tanto, se puede ver que la red MDA sigue la regla de la PA, pero disfrazada. [27]

Sin embargo, describe el mecanismo del ganador se lo lleva todo, ya que encontramos que casi del total de nodos tienen grado uno y uno es súper rico en grado. A medida que el valor aumenta, la disparidad entre los súper ricos y los pobres disminuye y a medida que encontramos una transición de un mecanismo de transición de ricos que se vuelven súper ricos a ricos que se vuelven más ricos.

Caldarelli et al. introdujeron otro modelo en el que el ingrediente clave es la naturaleza del vértice. [28] Aquí se crea un vínculo entre dos vértices con una probabilidad dada por una función de vínculo de las aptitudes de los vértices involucrados. El grado de un vértice i viene dado por [29]

Si es una función invertible y creciente de , entonces la distribución de probabilidad está dada por

Como resultado, si las aptitudes se distribuyen como una ley potencial, también lo hace el grado de nodo.

De manera menos intuitiva, con una distribución de probabilidad que decae rápidamente y junto con una función de enlace del tipo

con una constante y la función Heavyside obtenemos también redes sin escala.

Este modelo se ha aplicado con éxito para describir el comercio entre naciones utilizando el PIB como aptitud para los distintos nodos y una función de enlace del tipo [30] [31]

Los modelos de gráficos aleatorios exponenciales (ERGM) son una familia de modelos estadísticos para analizar datos de redes sociales y de otro tipo. [32] La familia Exponencial es una amplia familia de modelos para cubrir muchos tipos de datos, no solo redes. Un ERGM es un modelo de esta familia que describe redes.

Adoptamos la notación para representar un gráfico aleatorio a través de un conjunto de nodos y una colección de variables vinculadas , indexadas por pares de nodos , donde si los nodos están conectados por un borde y en caso contrario.

El supuesto básico de los ERGM es que la estructura de un gráfico observado puede explicarse mediante un vector dado de estadísticas suficientes que son función de la red observada y, en algunos casos, de atributos nodales. La probabilidad de una gráfica en un ERGM está definida por:

donde es un vector de parámetros del modelo asociados con y es una constante de normalización.

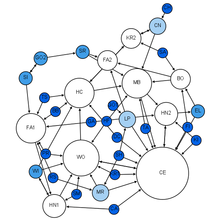

El análisis de redes sociales examina la estructura de las relaciones entre entidades sociales. [33] Estas entidades suelen ser personas, pero también pueden ser grupos , organizaciones , estados nacionales , sitios web y publicaciones académicas .

Desde la década de 1970, el estudio empírico de las redes ha desempeñado un papel central en las ciencias sociales, y muchas de las herramientas matemáticas y estadísticas utilizadas para estudiar las redes se desarrollaron por primera vez en la sociología . [24] Entre muchas otras aplicaciones, el análisis de redes sociales se ha utilizado para comprender la difusión de innovaciones , [34] noticias y rumores. De manera similar, se ha utilizado para examinar la propagación tanto de enfermedades como de comportamientos relacionados con la salud . También se ha aplicado al estudio de los mercados , donde se ha utilizado para examinar el papel de la confianza en las relaciones de intercambio y de los mecanismos sociales en la fijación de precios. De manera similar, se ha utilizado para estudiar el reclutamiento en movimientos políticos y organizaciones sociales. También se ha utilizado para conceptualizar desacuerdos científicos y prestigio académico. En la literatura sobre adquisición de segundas lenguas, tiene una historia establecida en la investigación de estudios en el extranjero, lo que revela cómo las redes de interacción entre pares influyen en su progreso lingüístico. [35] Más recientemente, el análisis de redes (y su primo cercano el análisis de tráfico ) ha ganado un uso significativo en la inteligencia militar, para descubrir redes insurgentes de naturaleza tanto jerárquica como sin líderes . [36] [37] En criminología , se utiliza para identificar actores influyentes en bandas criminales, movimientos de delincuentes, co-delincuencia, predecir actividades criminales y formular políticas. [38]

El análisis dinámico de redes examina la estructura cambiante de las relaciones entre diferentes clases de entidades en los efectos de sistemas sociotécnicos complejos y refleja la estabilidad social y cambios como el surgimiento de nuevos grupos, temas y líderes. [39] [40] [41] El análisis dinámico de redes se centra en metaredes compuestas por múltiples tipos de nodos (entidades) y múltiples tipos de enlaces . Estas entidades pueden ser muy variadas. Los ejemplos incluyen personas, organizaciones, temas, recursos, tareas, eventos, lugares y creencias.

Las técnicas de redes dinámicas son particularmente útiles para evaluar tendencias y cambios en las redes a lo largo del tiempo, identificar líderes emergentes y examinar la coevolución de personas e ideas.

Con la reciente explosión de datos biológicos de alto rendimiento disponibles públicamente, el análisis de redes moleculares ha ganado un interés significativo. El tipo de análisis de este contenido está estrechamente relacionado con el análisis de redes sociales, pero a menudo se centra en patrones locales en la red. Por ejemplo, los motivos de la red son pequeños subgrafos que están sobrerrepresentados en la red. Los motivos de actividad son patrones similares sobrerrepresentados en los atributos de los nodos y bordes de la red que están sobrerrepresentados dada la estructura de la red. El análisis de las redes biológicas ha llevado al desarrollo de la medicina en red , que analiza el efecto de las enfermedades en el interactoma . [42]

El análisis de enlaces es un subconjunto del análisis de redes que explora asociaciones entre objetos. Un ejemplo puede ser examinar las direcciones de sospechosos y víctimas, los números de teléfono que marcaron y las transacciones financieras en las que participaron durante un período de tiempo determinado, y las relaciones familiares entre estos sujetos como parte de la investigación policial. El análisis de vínculos proporciona aquí las relaciones y asociaciones cruciales entre muchos objetos de diferentes tipos que no son evidentes a partir de piezas de información aisladas. El análisis de enlaces asistido por ordenador o completamente automático es utilizado cada vez más por los bancos y las agencias de seguros para la detección de fraudes , por los operadores de telecomunicaciones para el análisis de redes de telecomunicaciones, por el sector médico en epidemiología y farmacología , en las investigaciones policiales y por los motores de búsqueda para la clasificación de relevancia . (y a la inversa, por parte de los spammers para la indexación de spam y de los empresarios para la optimización de los motores de búsqueda ), y en cualquier otro lugar donde se deban analizar las relaciones entre muchos objetos.

El modelo SIR es uno de los algoritmos más conocidos para predecir la propagación de pandemias globales dentro de una población infecciosa.

La fórmula anterior describe la "fuerza" de infección para cada unidad susceptible en una población infecciosa, donde β es equivalente a la tasa de transmisión de dicha enfermedad.

Para rastrear el cambio de aquellos susceptibles en una población infecciosa:

Con el tiempo, el número de infectados fluctúa según: la tasa de recuperación especificada, representada por uno pero deducido a lo largo del período infeccioso promedio , el número de individuos infecciosos, y el cambio en el tiempo .

Que una población sea superada por una pandemia, con respecto al modelo SIR, depende del valor o del "promedio de personas infectadas por un individuo infectado".

Varios algoritmos de clasificación de búsqueda web utilizan métricas de centralidad basadas en enlaces, incluidos (en orden de aparición) Hyper Search de Marchiori , PageRank de Google , el algoritmo HITS de Kleinberg , los algoritmos CheiRank y TrustRank . El análisis de enlaces también se lleva a cabo en ciencias de la información y la comunicación para comprender y extraer información de la estructura de las colecciones de páginas web. Por ejemplo, el análisis podría referirse a la interconexión entre los sitios web o blogs de los políticos.

PageRank funciona seleccionando "nodos" o sitios web al azar y luego, con cierta probabilidad, "saltando aleatoriamente" a otros nodos. Al saltar aleatoriamente a estos otros nodos, ayuda a PageRank a atravesar completamente la red, ya que algunas páginas web existen en la periferia y no se evaluarían tan fácilmente.

Cada nodo, tiene un PageRank definido por la suma de páginas que enlazan multiplicada por uno sobre los enlaces externos o "grado de salida" multiplicado por la "importancia" o PageRank de .

Como se explicó anteriormente, PageRank incluye saltos aleatorios en los intentos de asignar PageRank a cada sitio web en Internet. Estos saltos aleatorios encuentran sitios web que podrían no encontrarse durante las metodologías de búsqueda normales, como la búsqueda en amplitud y la búsqueda en profundidad .

Una mejora con respecto a la fórmula antes mencionada para determinar el PageRank incluye agregar estos componentes de salto aleatorio. Sin los saltos aleatorios, algunas páginas recibirían un PageRank de 0, lo que no sería bueno.

El primero es , o la probabilidad de que ocurra un salto aleatorio. Lo que contrasta es el "factor de amortiguación", o .

Otra forma de verlo:

La información sobre la importancia relativa de los nodos y las aristas en un gráfico se puede obtener mediante medidas de centralidad , ampliamente utilizadas en disciplinas como la sociología . Las medidas de centralidad son esenciales cuando un análisis de red tiene que responder preguntas como: "¿A qué nodos de la red se debe apuntar para garantizar que un mensaje o información se difunda a todos o a la mayoría de los nodos de la red?" o por el contrario, "¿A qué ganglios se debe dirigir para limitar la propagación de una enfermedad?". Las medidas de centralidad formalmente establecidas son la centralidad de grado , la centralidad de cercanía , la centralidad de intermediación , la centralidad de vector propio y la centralidad de Katz . El objetivo del análisis de red generalmente determina el tipo de medida de centralidad que se utilizará. [33]

El contenido de una red compleja se puede difundir mediante dos métodos principales: difusión conservada y difusión no conservada. [43] En la difusión conservada, la cantidad total de contenido que ingresa a una red compleja permanece constante a medida que pasa. El modelo de propagación conservada se puede representar mejor si se vierte una jarra que contiene una cantidad fija de agua en una serie de embudos conectados por tubos. Aquí, la jarra representa la fuente original y el agua es el contenido que se esparce. Los embudos y los tubos de conexión representan los nodos y las conexiones entre nodos, respectivamente. A medida que el agua pasa de un embudo a otro, el agua desaparece instantáneamente del embudo que estuvo previamente expuesto al agua. En la difusión no conservada, la cantidad de contenido cambia a medida que ingresa y pasa a través de una red compleja. El modelo de propagación no conservada se puede representar mejor mediante un grifo que funciona continuamente a través de una serie de embudos conectados por tubos. Aquí, la cantidad de agua de la fuente original es infinita. Además, cualquier embudo que haya estado expuesto al agua continúa experimentando el agua incluso cuando pasa a embudos sucesivos. El modelo no conservado es el más adecuado para explicar la transmisión de la mayoría de las enfermedades infecciosas .

En 1927, WO Kermack y AG McKendrick crearon un modelo en el que consideraban susceptible una población fija con sólo tres compartimentos: , infectados, y recuperados . Los compartimentos utilizados para este modelo constan de tres clases:

El flujo de este modelo se puede considerar de la siguiente manera:

Utilizando una población fija, Kermack y McKendrick derivaron las siguientes ecuaciones:

Se hicieron varios supuestos en la formulación de estas ecuaciones: Primero, se debe considerar que un individuo de la población tiene la misma probabilidad que cualquier otro individuo de contraer la enfermedad con una tasa de , que se considera la tasa de contacto o infección de la enfermedad. . Por tanto, un individuo infectado hace contacto y es capaz de transmitir la enfermedad a otros por unidad de tiempo y la fracción de contactos de un infectado con un susceptible es . Entonces, el número de nuevas infecciones en unidad de tiempo por infeccioso es , dando la tasa de nuevas infecciones (o de aquellas que salen de la categoría de susceptibles) como (Brauer & Castillo-Chávez, 2001). Para la segunda y tercera ecuaciones, considere que la población que sale de la clase susceptible es igual al número que ingresa a la clase infectada. Sin embargo, los infecciosos abandonan esta clase por unidad de tiempo para ingresar a la clase recuperada/eliminada a una tasa por unidad de tiempo (donde representa la tasa media de recuperación o el período infectivo medio). Estos procesos que ocurren simultáneamente se conocen como Ley de Acción de Masas , una idea ampliamente aceptada de que la tasa de contacto entre dos grupos de una población es proporcional al tamaño de cada uno de los grupos involucrados (Daley & Gani, 2005). Finalmente, se supone que la tasa de infección y recuperación es mucho más rápida que la escala temporal de nacimientos y muertes y, por lo tanto, estos factores se ignoran en este modelo.

Se puede leer más sobre este modelo en la página del modelo de epidemia .

Una ecuación maestra puede expresar el comportamiento de una red en crecimiento no dirigida donde, en cada paso de tiempo, se agrega un nuevo nodo a la red, vinculado a un nodo antiguo (elegido al azar y sin preferencia). La red inicial está formada por dos nodos y dos enlaces entre ellos en un momento , esta configuración es necesaria sólo para simplificar más cálculos, así en un momento la red tendrá nodos y enlaces.

La ecuación maestra para esta red es:

donde es la probabilidad de tener el nodo con grado en el momento y es el paso de tiempo en el que este nodo se agregó a la red. Tenga en cuenta que solo hay dos formas de que un nodo antiguo tenga enlaces en algún momento :

Después de simplificar este modelo, la distribución de grados es [44]

A partir de esta red en crecimiento, se desarrolla un modelo epidémico siguiendo una regla simple: cada vez que se agrega el nuevo nodo y después de elegir el nodo antiguo para vincular, se toma una decisión: si este nuevo nodo se infectará o no. La ecuación maestra para este modelo epidémico es:

donde representa la decisión de infectar ( ) o no ( ). Resolviendo esta ecuación maestra se obtiene la siguiente solución: [45]

Las redes multicapa son redes con múltiples tipos de relaciones. [46] Los intentos de modelar sistemas del mundo real como redes multidimensionales se han utilizado en diversos campos, como el análisis de redes sociales, [47] economía, historia, transporte urbano e internacional, ecología, psicología, medicina, biología, comercio, climatología, física. , neurociencia computacional, gestión de operaciones y finanzas.

Los problemas de red que implican encontrar una forma óptima de hacer algo se estudian bajo el nombre de optimización combinatoria . Los ejemplos incluyen flujo de red , problema de ruta más corta , problema de transporte , problema de transbordo , problema de ubicación , problema de coincidencia , problema de asignación , problema de embalaje , problema de ruta , análisis de ruta crítica y PERT (técnica de revisión y evaluación de programas).

Las redes interdependientes son redes donde el funcionamiento de los nodos de una red depende del funcionamiento de los nodos de otra red. En la naturaleza, las redes rara vez aparecen aisladas; más bien, normalmente las redes son elementos de sistemas más grandes e interactúan con elementos de ese sistema complejo. Dependencias tan complejas pueden tener efectos no triviales entre sí. Un ejemplo bien estudiado es la interdependencia de las redes de infraestructura, [48] las centrales eléctricas que forman los nodos de la red eléctrica requieren combustible entregado a través de una red de carreteras o tuberías y también se controlan a través de los nodos de la red de comunicaciones. Aunque la red de transporte no depende de la red eléctrica para funcionar, la red de comunicaciones sí. En dichas redes de infraestructura, el mal funcionamiento de un número crítico de nodos, ya sea en la red eléctrica o en la red de comunicaciones, puede provocar fallas en cascada en todo el sistema con resultados potencialmente catastróficos para todo el funcionamiento del sistema. [49] Si las dos redes se trataran de forma aislada, este importante efecto de retroalimentación no se vería y las predicciones de robustez de la red se sobreestimarían en gran medida.