El SAT ( / ˌɛsˌeɪˈtiː / ess -ay- TEE ) es un examen estandarizado ampliamente utilizado para admisiones universitarias en los Estados Unidos . Desde su debut en 1926, su nombre y puntuación han cambiado varias veces. Durante gran parte de su historia, se llamó Scholastic Aptitude Test y tenía dos componentes , Verbal y Matemático, cada uno de los cuales se puntuaba en un rango de 200 a 800. Más tarde se llamó Scholastic Assessment Test , luego SAT I: Reasoning Test , luego SAT Reasoning Test , luego simplemente SAT .

El SAT es propiedad, desarrollo y publicación totales del College Board , una organización privada sin fines de lucro en los Estados Unidos. Es administrado en nombre del College Board por el Educational Testing Service , [5] otra organización sin fines de lucro que hasta poco antes del rediseño del SAT en 2016 desarrolló la prueba y también mantuvo un repositorio de ítems (preguntas de prueba). [6] La prueba está destinada a evaluar la preparación de los estudiantes para la universidad. Originalmente diseñada para no estar alineada con los planes de estudio de la escuela secundaria, [7] se realizaron varios ajustes para la versión del SAT presentada en 2016. El presidente del College Board, David Coleman, agregó que quería que la prueba reflejara más de cerca lo que los estudiantes aprenden en la escuela secundaria con los nuevos estándares Common Core , [8] que han sido adoptados por el Distrito de Columbia y muchos estados.

Muchos estudiantes se preparan para el SAT con libros, clases, cursos en línea y tutorías, que ofrecen diversas empresas y organizaciones. Una de las empresas más conocidas es Kaplan, Inc. , que ofrece cursos de preparación para el SAT desde 1946. A partir del año escolar 2015-2016, el College Board comenzó a trabajar con Khan Academy para ofrecer cursos gratuitos de preparación para el SAT en línea. [9]

Históricamente, a partir de 1937, las pruebas ofrecidas bajo el estandarte del SAT también incluían pruebas de materias específicas del SAT opcionales , que se denominaron pruebas de logros del SAT hasta 1993 y luego se denominaron SAT II: pruebas de materias hasta 2005; estas se suspendieron después de junio de 2021. [10] [11] Después de junio de 2021, con algunas excepciones, el SAT ya no tiene una sección de ensayo. [12] [10] [11]

En el pasado, la prueba se realizaba utilizando formularios en papel que se rellenaban con un lápiz del número 2 y se calificaban (excepto las secciones de respuestas escritas a mano) utilizando tecnología de reconocimiento óptico de marcas tipo Scantron . A partir de marzo de 2023 para los examinados internacionales y de marzo de 2024 para los que se encuentran dentro de los EE. UU., la prueba se administra utilizando un programa informático llamado Bluebook que se ejecuta en una computadora portátil o tableta que trae el estudiante o que se proporciona en el lugar de la prueba. [13] [14] La prueba también se hizo adaptable, personalizando las preguntas que se le presentan al estudiante en función de su desempeño en las preguntas formuladas anteriormente en la prueba, y se acortó de tres horas a dos horas y 14 minutos. [1] [15]

Si bien se ha realizado una cantidad considerable de investigaciones sobre el SAT, aún quedan muchas preguntas y conceptos erróneos. [16] [17] Fuera de las admisiones universitarias, el SAT también lo utilizan los investigadores que estudian la inteligencia humana en general y la precocidad intelectual en particular, [18] [19] [20] y algunos empleadores en el proceso de contratación. [21] [22] [23]

El SAT lo suelen tomar los estudiantes de tercer y cuarto año de secundaria . [24] El College Board afirma que el SAT tiene como objetivo medir las habilidades de alfabetización, aritmética y escritura que se necesitan para el éxito académico en la universidad . Afirman que el SAT evalúa qué tan bien los examinados analizan y resuelven problemas, habilidades que aprendieron en la escuela y que necesitarán en la universidad.

El College Board también afirma que el SAT, en combinación con el promedio de calificaciones de la escuela secundaria (GPA) , proporciona un mejor indicador de éxito en la universidad que las calificaciones de la escuela secundaria por sí solas, medidas según el GPA de los estudiantes de primer año de universidad. Varios estudios realizados durante la existencia del SAT muestran un aumento estadísticamente significativo en la correlación de las calificaciones de la escuela secundaria y las calificaciones de los estudiantes de primer año de universidad cuando se tiene en cuenta el SAT. [25] La validez predictiva y los poderes del SAT son temas de investigación en psicometría. [16]

El SAT es un examen normativo cuyo objetivo es obtener puntuaciones que sigan una distribución en forma de curva de campana entre los examinados. Para lograr esta distribución, los diseñadores de pruebas incluyen preguntas de opción múltiple con opciones plausibles pero incorrectas, conocidas como "distractores", excluyen preguntas que la mayoría de los estudiantes responden correctamente e imponen restricciones de tiempo estrictas durante el examen. [26]

Existen diferencias sustanciales en materia de financiación, planes de estudio, calificaciones y dificultad entre las escuelas secundarias de Estados Unidos debido al federalismo estadounidense , el control local y la prevalencia de estudiantes educados en escuelas privadas, a distancia y en el hogar . Las puntuaciones del SAT (y del ACT ) tienen como objetivo complementar el historial de la escuela secundaria y ayudar a los funcionarios de admisión a poner los datos locales (como el trabajo del curso, las calificaciones y la clasificación en la clase) en una perspectiva nacional. [27]

Históricamente, el SAT era más utilizado por los estudiantes que vivían en los estados costeros y el ACT era más utilizado por los estudiantes del Medio Oeste y el Sur; sin embargo, en los últimos años, un número cada vez mayor de estudiantes de las costas este y oeste han estado tomando el ACT. [28] [29] Desde 2007, todas las universidades y colegios de cuatro años en los Estados Unidos que requieren una prueba como parte de una solicitud de admisión aceptarán el SAT o el ACT, y a partir del otoño de 2022, más de 1400 universidades y colegios de cuatro años no exigieron ninguna puntuación de prueba estandarizada para la admisión, aunque algunos de ellos planeaban aplicar esta política solo temporalmente debido a la pandemia de coronavirus . [30] [31]

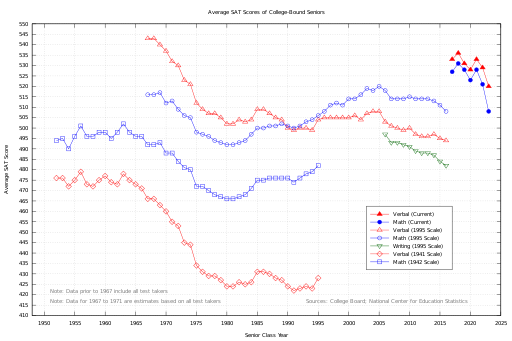

Los examinados del SAT tienen dos horas y 14 minutos para completar la prueba (más un descanso de 10 minutos entre la sección de lectura y escritura y la sección de matemáticas), [32] y a partir de 2024 [update]la prueba cuesta US$60,00, más tarifas adicionales por inscripción tardía a la prueba, inscripción por teléfono, cambios de inscripción, entrega rápida de resultados, entrega de resultados a más de cuatro instituciones, entregas de resultados ordenadas más de nueve días después de la prueba y pruebas administradas fuera de los Estados Unidos, según corresponda, y se ofrecen exenciones de tarifas a estudiantes de bajos ingresos dentro de los EE. UU. y sus territorios. [33] [34] [35] Los puntajes en el SAT varían de 400 a 1600, combinando los resultados de las pruebas de dos secciones de 200 a 800 puntos: la sección de matemáticas y la sección de lectura y escritura basada en evidencia. Aunque tomar el SAT, o su competidor el ACT , es un requisito para el ingreso de estudiantes de primer año en muchas universidades y colegios en los Estados Unidos, [36] a fines de la década de 2010, muchas instituciones hicieron que estos exámenes de ingreso fueran opcionales, [37] [38] [39] pero esto no impidió que los estudiantes intentaran lograr puntajes altos [40] ya que ellos y sus padres son escépticos de lo que significa "opcional" en este contexto. [41] [42] De hecho, la población que tomaba el examen estaba aumentando de manera constante. [43] Y si bien esto puede haber resultado en una disminución a largo plazo en los puntajes, [43] [44] [45] los expertos advirtieron contra el uso de esto para medir los niveles académicos de toda la población estadounidense. [45]

El SAT tiene dos secciones principales, a saber, la lectura y la escritura basadas en evidencias (EBRW, normalmente conocida como la parte "inglés" del examen) y la sección de matemáticas. Ambas se dividen en cuatro secciones: lectura, escritura y lenguaje, matemáticas (sin calculadora) y matemáticas (se permite calculadora). Hasta el verano de 2021, el candidato también podía escribir opcionalmente un ensayo que, en ese caso, es la quinta sección del examen. (El ensayo se eliminó después de junio de 2021, excepto en algunos estados y distritos escolares. [12] ) El tiempo total para la parte calificada del SAT es de dos horas y 14 minutos. Algunos candidatos que no realizan el ensayo también pueden tener una quinta sección, que se utiliza, al menos en parte, para la prueba previa de las preguntas que pueden aparecer en futuras administraciones del SAT. (Estas preguntas no se incluyen en el cálculo de la puntuación del SAT).

Dos puntuaciones de sección resultan de tomar el SAT: Lectura y escritura basadas en evidencia y Matemáticas . Las puntuaciones de sección se informan en una escala de 200 a 800, y cada puntuación de sección es un múltiplo de diez. Una puntuación total para el SAT se calcula sumando las puntuaciones de dos secciones, lo que da como resultado puntuaciones totales que varían de 400 a 1600. Además de las puntuaciones de dos secciones, se informan tres puntuaciones de "prueba" en una escala de 10 a 40, una para cada una de Lectura, Escritura y Lenguaje, y Matemáticas, con incrementos de 1 para Lectura / Escritura y Lenguaje, y 0,5 para Matemáticas. También hay dos puntuaciones de prueba cruzada que varían cada una de 10 a 40 puntos: Análisis en Historia / Estudios Sociales y Análisis en Ciencias. [46] El ensayo, si se tomó, se calificó por separado de las puntuaciones de dos secciones. [47] Dos personas califican cada ensayo otorgando cada una de 1 a 4 puntos en cada una de las tres categorías: Lectura, Análisis y Escritura. [48] Estas dos puntuaciones de los diferentes examinadores se combinan para dar una puntuación total de entre 2 y 8 puntos por categoría. Aunque a veces la gente cita su puntuación del ensayo de entre 24, el College Board no combina las diferentes categorías para dar una puntuación del ensayo, sino que da una puntuación para cada categoría.

No hay penalización ni calificación negativa por adivinar en el SAT: las puntuaciones se basan en la cantidad de preguntas respondidas correctamente. El ensayo opcional se incluyó por última vez en la administración de junio de 2021. [10] [11] College Board dijo que suspendió la sección de ensayo porque "hay otras formas en que los estudiantes pueden demostrar su dominio de la redacción de ensayos", incluida la parte de lectura y escritura del examen. [10] [11] También reconoció que la pandemia de COVID-19 había jugado un papel en el cambio, acelerando "un proceso que ya estaba en marcha". [11]

La prueba de lectura del SAT contiene una sección de 52 preguntas y un límite de tiempo de 65 minutos. [47] Todas las preguntas son de opción múltiple y se basan en pasajes de lectura. Algunos pasajes pueden ir acompañados de tablas, gráficos y diagramas, pero no se requiere ningún conocimiento matemático para responder correctamente las preguntas correspondientes. Hay cinco pasajes (hasta dos de los cuales pueden ser un par de pasajes más pequeños) en la prueba de lectura y diez u once preguntas por pasaje o par de pasajes. Los pasajes de lectura del SAT se basan en tres campos principales: historia, estudios sociales y ciencias. Cada prueba de lectura del SAT siempre incluye: un pasaje de la literatura estadounidense o mundial; un pasaje de un documento fundacional de los EE. UU. o un texto relacionado; un pasaje sobre economía, psicología, sociología u otra ciencia social; y dos pasajes científicos. Las respuestas a todas las preguntas se basan únicamente en el contenido establecido o implícito en el pasaje o par de pasajes. [49]

La prueba de lectura contribuye (junto con la prueba de escritura y lenguaje) a dos subpuntuaciones, cada una de las cuales varía entre 1 y 15 puntos: [46]

La prueba de escritura y lenguaje del SAT se compone de una sección con 44 preguntas de opción múltiple y un límite de tiempo de 35 minutos. [47] Al igual que en la prueba de lectura, todas las preguntas se basan en pasajes de lectura que pueden ir acompañados de tablas, gráficos y diagramas. Se le pedirá al candidato que lea los pasajes y sugiera correcciones o mejoras para los contenidos subrayados. Los pasajes de lectura de esta prueba varían en contenido desde argumentos temáticos hasta narraciones de no ficción en una variedad de temas. Las habilidades que se evalúan incluyen: aumentar la claridad de los argumentos; mejorar la elección de palabras; mejorar el análisis de temas en estudios sociales y ciencias; cambiar la estructura de oraciones o palabras para aumentar la calidad organizativa y el impacto de la escritura; y corregir o mejorar la estructura de oraciones, el uso de palabras y la puntuación. [50]

La prueba de escritura y lenguaje reporta dos subpuntajes, cada uno de los cuales varía entre 1 y 15 puntos: [46]

La parte de matemáticas del SAT se divide en dos secciones: Prueba de matemáticas sin calculadora y Prueba de matemáticas con calculadora. En total, la prueba de matemáticas del SAT dura 80 minutos e incluye 58 preguntas: 45 preguntas de opción múltiple y 13 preguntas de cuadrícula. [51] Las preguntas de opción múltiple tienen cuatro respuestas posibles; las preguntas de cuadrícula son de respuesta libre y requieren que el candidato proporcione una respuesta.

Se proporcionan varias puntuaciones al candidato para el examen de matemáticas. Se informa una puntuación parcial (en una escala de 1 a 15) para cada una de las tres categorías de contenido matemático:

La puntuación de la prueba de matemáticas se informa en una escala de 10 a 40, con un incremento de 0,5, y la puntuación de la sección (igual a la puntuación de la prueba multiplicada por 20) se informa en una escala de 200 a 800. [52] [53] [54]

Todas las calculadoras científicas y la mayoría de las calculadoras gráficas , incluidas las calculadoras del Sistema de Álgebra Computacional (CAS), están permitidas solo en la sección de Calculadora del examen SAT de Matemáticas. Sin embargo, con el cambio al SAT Digital durante 2023 y 2024, se puede usar una calculadora gráfica durante todo el examen y se puede acceder a ella a través del programa de aplicación del examen. [55] También se permiten todas las calculadoras de cuatro funciones; sin embargo, no se recomiendan estos dispositivos. No se permiten las calculadoras de teléfonos móviles y teléfonos inteligentes, las calculadoras con teclados tipo máquina de escribir ( QWERTY ), las computadoras portátiles y otras computadoras portátiles, y las calculadoras capaces de acceder a Internet. [56] [57]

El College Board realizó una investigación para estudiar el efecto del uso de la calculadora en las puntuaciones de matemáticas del SAT I: Reasoning Test. El estudio descubrió que el rendimiento en la sección de matemáticas estaba asociado con el grado de uso de la calculadora: aquellos que usaban calculadora en aproximadamente entre un tercio y la mitad de los ítems obtuvieron puntuaciones medias más altas que aquellos que usaban calculadoras con mayor o menor frecuencia. Sin embargo, era "más probable que el efecto haya sido el resultado de que los estudiantes capaces usaran las calculadoras de manera diferente que los estudiantes menos capaces, en lugar del uso de la calculadora en sí". [58] Hay cierta evidencia de que el uso frecuente de una calculadora en la escuela fuera de la situación de prueba tiene un efecto positivo en el rendimiento en la prueba en comparación con aquellos que no usan calculadoras en la escuela. [59]

La mayoría de las preguntas del SAT, a excepción de las respuestas de matemáticas en cuadrícula, son de opción múltiple ; todas las preguntas de opción múltiple tienen cuatro opciones de respuesta, una de las cuales es correcta. Trece de las preguntas de la parte de matemáticas del SAT (alrededor del 22% de todas las preguntas de matemáticas) no son de opción múltiple. [60] En cambio, requieren que el candidato ingrese un número en una cuadrícula de cuatro columnas.

Todas las preguntas de cada sección del SAT tienen la misma ponderación. Por cada respuesta correcta, se suma un punto. [61] No se deducen puntos por las respuestas incorrectas. La puntuación final se deriva de la puntuación bruta; la tabla de conversión precisa varía entre las distintas administraciones de la prueba.

El SAT se ofrece siete veces al año en los Estados Unidos: en agosto, octubre, noviembre, diciembre, marzo, mayo y junio. Para los estudiantes internacionales, el SAT se ofrece cuatro veces al año: en octubre, diciembre, marzo y mayo (excepción de 2020: para cubrir la cancelación mundial de mayo, se introdujo un examen adicional en septiembre y también se puso a disposición de los examinados internacionales el mes de agosto). El examen se ofrece normalmente el primer sábado del mes para las administraciones de octubre, noviembre, diciembre, mayo y junio. [62] [63] El examen fue realizado por 1.913.742 graduados de la escuela secundaria en la clase de 2023. [3]

Los candidatos que deseen tomar el examen pueden registrarse en línea en el sitio web del College Board o por correo al menos tres semanas antes de la fecha del examen.

A partir de 2022, el SAT cuesta 60 dólares estadounidenses, más tasas adicionales si se realiza fuera de los Estados Unidos. [33] El College Board ofrece exenciones de tasas a estudiantes de bajos ingresos. Se aplican tasas adicionales por inscripción tardía, exámenes en espera, cambios de inscripción, calificaciones por teléfono e informes de calificaciones adicionales (además de los cuatro proporcionados de forma gratuita).

Los estudiantes con discapacidades verificables, incluidas discapacidades físicas y de aprendizaje, son elegibles para tomar el examen SAT con adaptaciones. El aumento de tiempo estándar para los estudiantes que requieren tiempo adicional debido a discapacidades de aprendizaje o discapacidades físicas es tiempo + 50%; también se ofrece tiempo + 100%.

En enero de 2022, College Board anunció que el SAT pasaría de ser en papel a ser digital (en computadora). [13] Los centros de evaluación internacionales (fuera de EE. UU.) comenzaron a utilizar el formato digital el 11 de marzo de 2023. El SAT de diciembre de 2023 fue el último examen SAT ofrecido en papel. El cambio al formato digital se produjo el 9 de marzo de 2024 en EE. UU. [64] El SAT digital lleva aproximadamente una hora menos que el examen en papel (dos horas frente a tres). Se administra en un centro de evaluación oficial, como antes, pero los estudiantes usan sus propios dispositivos de evaluación (una computadora portátil o tableta). Si un estudiante no puede traer su propio dispositivo, se puede solicitar uno a College Board. [65] Antes de la prueba, la aplicación "Bluebook" de College Board debe haberse instalado correctamente en el dispositivo de evaluación. [66]

La nueva prueba es adaptativa , lo que significa que los estudiantes tienen dos módulos por sección (lectura/escritura y matemáticas), y el segundo módulo se adapta al nivel demostrado en función de los resultados del primer módulo. En las secciones de lectura y escritura, las preguntas tendrán pasajes más cortos para cada pregunta. En las secciones de matemáticas, los problemas de palabras serán más concisos. Los estudiantes tienen un descanso de diez minutos después de los dos primeros módulos de inglés y antes de los dos módulos de matemáticas. El software de prueba incluye un cronómetro que comenzará a funcionar automáticamente una vez que el estudiante termine el segundo módulo de inglés. También se incluyen en la nueva prueba nuevas herramientas, como un marcador de preguntas, un cronómetro y una calculadora gráfica integrada. [67]

Los estudiantes reciben sus informes de puntuación en línea aproximadamente dos o tres semanas después de la administración de la prueba (más tiempo para las puntuaciones enviadas por correo en papel). [68] En el informe se incluye la puntuación total (la suma de las puntuaciones de las dos secciones, cada sección calificada en una escala de 200 a 800) y tres subpuntuaciones (en lectura, escritura y análisis, cada una en una escala de 2 a 8) para el ensayo opcional. [69] Los estudiantes también pueden recibir, por una tarifa adicional, varios servicios de verificación de puntuación, incluido (para administraciones de pruebas seleccionadas) el Servicio de preguntas y respuestas, que proporciona las preguntas de la prueba, las respuestas del estudiante, las respuestas correctas y el tipo y la dificultad de cada pregunta. [70]

Además, los estudiantes reciben dos puntuaciones percentiles , cada una de las cuales está definida por el College Board como el porcentaje de estudiantes en un grupo de comparación con puntuaciones de prueba iguales o inferiores. Uno de los percentiles, llamado "Percentil de muestra representativa a nivel nacional", utiliza como grupo de comparación a todos los estudiantes de 11.º y 12.º grado en los Estados Unidos, independientemente de si tomaron o no el SAT. Este percentil es teórico y se deriva utilizando métodos de inferencia estadística . El segundo percentil, llamado "Percentil de usuario del SAT", utiliza puntuaciones reales de un grupo de comparación de estudiantes recientes de los Estados Unidos que tomaron el SAT. Por ejemplo, para el año escolar 2019-2020, el percentil de usuario del SAT se basó en las puntuaciones de las pruebas de los estudiantes de las clases de graduados de 2018 y 2019 que tomaron el SAT (específicamente, la revisión de 2016) durante la escuela secundaria. Los estudiantes reciben ambos tipos de percentiles para su puntuación total, así como para sus puntuaciones de sección. [69]

El siguiente gráfico resume los percentiles originales utilizados para la versión del SAT administrada entre marzo de 2005 y enero de 2016. Estos percentiles utilizaron a los estudiantes de la clase que se graduó en 2006 como grupo de comparación. [71] [72]

La puntuación verbal media fue de 461 para los estudiantes que tomaron el examen SAT y de 383 para la muestra de todos los estudiantes. [74]

Los puntajes matemáticos para 1969-70 se desglosaron por género en lugar de informarse en su totalidad; el puntaje promedio de matemáticas para los niños fue 415, para las niñas 378. Las diferencias para la población muestreada a nivel nacional para matemáticas (no se muestran en la tabla) fueron similares a las de la sección verbal. [74]

La versión del SAT administrada antes de abril de 1995 tenía un límite muy alto. Por ejemplo, en el año escolar 1985-1986, sólo 9 estudiantes de 1,7 millones de examinados obtuvieron una puntuación de 1600. [75]

En 2015, el puntaje promedio de la Clase 2015 fue 1490 de un máximo de 2400. Eso representó una reducción de 7 puntos respecto de la calificación de la clase anterior y fue el puntaje compuesto más bajo de la última década. [44]

El College Board y ACT, Inc., llevaron a cabo un estudio conjunto de estudiantes que tomaron tanto el SAT como el ACT entre septiembre de 2004 (para el ACT) o marzo de 2005 (para el SAT) y junio de 2006. Se proporcionaron tablas para concordar los puntajes de los estudiantes que tomaron el SAT después de enero de 2005 y antes de marzo de 2016. [76] [77] En mayo de 2016, el College Board publicó tablas de concordancia para los puntajes de concordancia en el SAT utilizado desde marzo de 2005 hasta enero de 2016 con el SAT utilizado desde marzo de 2016, así como tablas para los puntajes de concordancia en el SAT utilizado desde marzo de 2016 hasta el ACT. [78]

En 2018, el College Board, en asociación con el ACT, presentó una nueva tabla de concordancia para comparar mejor cómo le iría a un estudiante de una prueba a otra. [79] Esta ahora se considera la concordancia oficial que deben usar los profesionales universitarios y está reemplazando a la de 2016. La nueva concordancia ya no incluye el antiguo SAT (de 2400), solo el nuevo SAT (de 1600) y el ACT (de 36).

A partir de 2018, el puntaje SAT correspondiente más apropiado para el puntaje ACT dado también se muestra en la siguiente tabla. [80]

La preparación para el SAT , iniciada por Stanley Kaplan en 1946 con un curso de 64 horas, [81] se ha convertido en un campo muy lucrativo. [82] Muchas empresas y organizaciones ofrecen preparación para exámenes en forma de libros, clases, cursos en línea y tutorías. [83] La industria de preparación para exámenes comenzó casi simultáneamente con la introducción de los exámenes de ingreso a la universidad en los EE. UU. y floreció desde el principio. [84] Las estafas de preparación para exámenes son un problema genuino para padres y estudiantes. [85] En general, los estadounidenses de origen asiático oriental, especialmente los estadounidenses de origen coreano , son los más propensos a tomar cursos privados de preparación para el SAT, mientras que los afroamericanos generalmente dependen más de la tutoría individual para el aprendizaje correctivo . [86]

Sin embargo, el College Board mantiene que el SAT es esencialmente imposible de entrenar y la investigación del College Board y la Asociación Nacional de Asesoramiento de Admisión a la Universidad sugiere que los cursos de tutoría resultan en un aumento promedio de alrededor de 20 puntos en la sección de matemáticas y 10 puntos en la sección verbal. [87] De hecho, los investigadores han demostrado una y otra vez que los cursos de preparación tienden a ofrecer en el mejor de los casos un impulso modesto a las puntuaciones de las pruebas. [88] [89] [90] Al igual que las puntuaciones de CI, que son un fuerte correlato, las puntuaciones del SAT tienden a ser estables en el tiempo, lo que significa que los cursos de preparación para el SAT ofrecen solo una ventaja limitada. [91] Un metaanálisis temprano (de 1983) encontró resultados similares y señaló que "el tamaño del efecto del entrenamiento estimado a partir de los estudios emparejados o aleatorios (10 puntos) parece demasiado pequeño para ser prácticamente importante". [92] Los estadísticos Ben Domingue y Derek C. Briggs examinaron datos de la Encuesta Longitudinal de Educación de 2002 y encontraron que los efectos del entrenamiento solo fueron estadísticamente significativos para las matemáticas; Además, el coaching tuvo un mayor efecto en ciertos estudiantes que en otros, especialmente en aquellos que habían tomado cursos rigurosos y aquellos de alto nivel socioeconómico. [93] Una revisión sistemática de la literatura de 2012 estimó un efecto del coaching de 23 y 32 puntos para las pruebas de matemáticas y verbales, respectivamente. [84] Un metaanálisis de 2016 estimó el tamaño del efecto en 0,09 y 0,16 para las secciones verbal y de matemáticas respectivamente, aunque hubo un gran grado de heterogeneidad. [94] Mientras tanto, un estudio de 2011 encontró que los efectos de la tutoría individual eran mínimos entre todos los grupos étnicos. [86] La incomprensión pública sobre cómo prepararse para el SAT continúa siendo explotada por la industria de la preparación. [16]

Si bien existe un vínculo entre los antecedentes familiares y la realización de un curso de preparación para el SAT, no todos los estudiantes se benefician por igual de esa inversión. De hecho, cualquier aumento promedio en las puntuaciones del SAT debido a esos cursos se debe principalmente a las mejoras entre los estadounidenses de origen asiático oriental. [95] Cuando se desglosa aún más este grupo, los estadounidenses de origen coreano tienen más probabilidades de realizar cursos de preparación para el SAT que los estadounidenses de origen chino , aprovechando al máximo sus comunidades religiosas y su economía étnica. [96]

El College Board anunció una asociación con la organización sin fines de lucro Khan Academy para ofrecer materiales gratuitos de preparación para exámenes a partir del año académico 2015-2016 para ayudar a nivelar el campo de juego para los estudiantes de familias de bajos ingresos. [9] [44] Los estudiantes también pueden evitar los costosos programas de preparación utilizando la guía oficial más asequible del College Board y con hábitos de estudio sólidos. [97]

El College Board también ofrece una prueba llamada Prueba Preliminar SAT/National Merit Scholarship Qualifying Test ( PSAT/NMSQT ), y hay alguna evidencia de que tomar el PSAT al menos una vez puede ayudar a los estudiantes a obtener mejores resultados en el SAT; [98] además, como en el caso del SAT, los mejores puntajes en el PSAT podrían ganar becas. [42] Según la científica cognitiva Sian Beilock , el "atragantamiento" o el desempeño deficiente en ocasiones importantes, como tomar el SAT, se puede prevenir haciendo muchas preguntas de práctica y exámenes supervisados para mejorar la memoria procedimental , haciendo uso del cuadernillo para escribir los pasos intermedios para evitar sobrecargar la memoria de trabajo y escribiendo una entrada en el diario sobre las ansiedades de uno el día del examen para mejorar la autoempatía y la autoimagen positiva. [99] La higiene del sueño es importante ya que la calidad del sueño durante los días previos al examen puede mejorar el rendimiento. Además, se ha demostrado que los horarios de clase más tardíos (8:30 am en lugar de 7:30 am), que se adaptan mejor al ritmo circadiano modificado de los adolescentes, pueden aumentar los puntajes del SAT lo suficiente como para cambiar el nivel de las universidades en las que los estudiantes podrían ser admitidos. [100] [101]

A raíz de la pandemia de COVID-19, un gran número de universidades estadounidenses decidieron que los resultados de los exámenes estandarizados fueran opcionales para los futuros estudiantes. Sin embargo, muchos estudiantes optaron por tomar el SAT e inscribirse en programas de preparación, que siguieron siendo rentables. [102]

En 2009, los investigadores en educación Richard C. Atkinson y Saul Geiser del sistema de la Universidad de California (UC) argumentaron que el promedio de calificaciones de la escuela secundaria es mejor que el SAT para predecir las calificaciones universitarias, independientemente del tipo o la calidad de la escuela secundaria. [103] En su informe de 2020, el senado académico de la UC descubrió que el SAT era mejor que el promedio de calificaciones de la escuela secundaria para predecir el promedio de calificaciones del primer año, y tan bueno como el promedio de calificaciones de la escuela secundaria para predecir el promedio de calificaciones de pregrado, la retención en el primer año y la graduación. Se descubrió que esta validez predictiva se mantenía en todos los grupos demográficos, y el informe señaló que las puntuaciones de las pruebas estandarizadas eran en realidad "mejores predictores del éxito para los estudiantes que son estudiantes de minorías subrepresentadas (URM), que son de primera generación o cuyas familias son de bajos ingresos". [104] Una serie de informes del College Board señalan una validez predictiva similar en todos los grupos demográficos. [105] [106]

Pero un mes después del informe del senado académico de la UC, Saul Geiser cuestionó las conclusiones del senado académico de la UC, diciendo "que las afirmaciones del Senado son 'espurias', basadas en un error fundamental de omitir la demografía de los estudiantes en el modelo de predicción". Indicando que cuando el GPA de la escuela secundaria se combina con la demografía en la predicción, el SAT es menos confiable. Li Cai , un profesor de la UCLA que dirige el Centro Nacional de Investigación sobre Evaluación, Estándares y Pruebas de Estudiantes , indicó que el Senado Académico de la UC incluyó la demografía de los estudiantes al usar un modelo diferente y más simple para que el público lo entienda y que los impactos discriminatorios del SAT se compensan durante el proceso de admisión. Jesse Rothstein , profesor de política pública y economía de la UC Berkeley , refutó la afirmación de Li, mencionando que el senado académico de la UC "se equivocó en muchas cosas sobre el SAT", exagera el valor del SAT y "no hay base para su conclusión de que las admisiones de la UC 'compensan' las brechas de puntaje de las pruebas entre los grupos". [107] Sin embargo, al analizar sus propios datos institucionales, las universidades de Brown , Yale y Dartmouth llegaron a la conclusión de que las puntuaciones del SAT son predictores más confiables del éxito universitario que el GPA. Además, las puntuaciones les permiten identificar a más estudiantes potencialmente calificados de entornos desfavorecidos de lo que lo harían de otra manera. [108] En la Universidad de Texas en Austin , los estudiantes que se negaron a enviar las puntuaciones del SAT cuando dichas puntuaciones eran opcionales tuvieron un peor desempeño que sus compañeros que lo hicieron. [108] Estos resultados fueron replicados por un estudio realizado por la organización sin fines de lucro Opportunity Insights que analizó datos de instituciones de la Ivy League (Brown University, Columbia University , Cornell University , Dartmouth College, Harvard University , Princeton University , University of Pennsylvania y Yale University) más Stanford University , Massachusetts Institute of Technology y University of Chicago . [109] [108] Un estudio de 2009 encontró que las puntuaciones del SAT o ACT junto con los GPA de la escuela secundaria son fuertes predictores de los GPA universitarios acumulativos. En particular, aquellos con puntajes en pruebas estandarizadas en el percentil 50 o más tenían una probabilidad de dos tercios de tener un GPA universitario acumulativo en la mitad superior. [110] [17] Un metaanálisis de 2010 realizado por investigadores de la Universidad de Minnesotaofreció evidencia de que las pruebas de admisión estandarizadas como el SAT predecían no solo el GPA de primer año sino también el GPA universitario general. [111] [91] Un estudio de 2012 de la misma universidad que utilizó un conjunto de datos multiinstitucionales reveló que incluso después de controlar el estado socioeconómico y el GPA de la escuela secundaria, los puntajes del SAT todavía eran capaces de predecir el GPA de primer año entre los estudiantes universitarios o de colegios. [112] Un estudio de 2019 con un tamaño de muestra de alrededor de un cuarto de millón de estudiantes sugiere que juntos, los puntajes del SAT y el GPA de la escuela secundaria ofrecen un excelente predictor del GPA universitario de primer año y la retención de segundo año. [16] En 2018, los psicólogos Oren R. Shewach, Kyle D. McNeal, Nathan R. Kuncel y Paul R. Sackett demostraron que tanto el GPA de la escuela secundaria como los puntajes del SAT predicen la inscripción en cursos universitarios avanzados, incluso después de controlar los créditos de Colocación Avanzada . [113] [16]

En 2005, el economista de la educación Jesse M. Rothstein indicó que las puntuaciones medias del SAT en la escuela secundaria eran mejores para predecir el promedio de calificaciones de los estudiantes de primer año en la universidad en comparación con las puntuaciones individuales del SAT. En otras palabras, las puntuaciones del SAT de un estudiante no eran tan informativas con respecto al éxito académico futuro como el promedio de su escuela secundaria. En cambio, los promedios de calificaciones individuales de la escuela secundaria eran un mejor predictor del éxito universitario que los promedios de calificaciones promedio de la escuela secundaria. [114] [115] Además, un funcionario de admisiones que no tuviera en cuenta las puntuaciones medias del SAT correría el riesgo de sobreestimar el rendimiento futuro de un estudiante de una escuela con una puntuación baja y subestimar el de un estudiante de una escuela con una puntuación alta. [115]

Si bien el SAT está correlacionado con la inteligencia y como tal estima las diferencias individuales, no tiene nada que decir sobre el "rendimiento cognitivo efectivo" o lo que hacen las personas inteligentes. [16] Tampoco mide rasgos no cognitivos asociados con el éxito académico, como actitudes positivas o escrupulosidad . [16] [111] Los psicometristas Thomas R. Coyle y David R. Pillow demostraron en 2008 que el SAT predice el GPA universitario incluso después de eliminar el factor general de inteligencia ( g ), con el que está altamente correlacionado. [116]

Al igual que otras pruebas estandarizadas como el ACT o el GRE, el SAT es un método tradicional para evaluar la aptitud académica de los estudiantes que han tenido experiencias educativas muy diferentes y, como tal, se centra en los materiales comunes que se podría esperar razonablemente que los estudiantes hayan encontrado a lo largo del curso de estudio. Como tal, la sección de matemáticas no contiene materiales por encima del nivel de pre-cálculo , por ejemplo. El psicólogo Raymond Cattell se refirió a esto como una prueba de inteligencia cristalizada "histórica" en lugar de "actual" . [117] El psicólogo Scott Barry Kaufman señaló además que el SAT solo puede medir una instantánea del desempeño de una persona en un momento particular en el tiempo. [118] Los psicólogos educativos Jonathan Wai, David Lubinski y Camilla Benbow observaron que una forma de aumentar la validez predictiva del SAT es evaluando la capacidad de razonamiento espacial del estudiante , ya que el SAT en la actualidad no contiene ninguna pregunta a tal efecto. Las habilidades de razonamiento espacial son importantes para el éxito en STEM. [119] Un estudio de 2006 dirigido por el psicometrista Robert Sternberg descubrió que la capacidad de los puntajes del SAT y los promedios de calificaciones de la escuela secundaria para predecir el desempeño universitario podría mejorarse aún más mediante evaluaciones adicionales del pensamiento analítico, creativo y práctico. [120] [121]

La psicóloga experimental Meredith Frey señaló que, si bien los avances en la investigación educativa y la neurociencia pueden ayudar a mejorar gradualmente la capacidad de predecir el rendimiento académico en el futuro, el SAT u otras pruebas estandarizadas probablemente seguirán siendo una herramienta valiosa sobre la que construir. [16] En un artículo de opinión de 2014 para The New York Times , el psicólogo John D. Mayer calificó los poderes predictivos del SAT como "un logro asombroso" y advirtió contra hacerlo opcional y otras pruebas estandarizadas. [122] [17] La investigación de los psicometristas David Lubinsky, Camilla Benbow y sus colegas ha demostrado que el SAT podría incluso predecir los resultados de la vida más allá de la universidad. [17]

El SAT evalúa rigurosamente la resistencia mental, la memoria, la velocidad, la precisión y la capacidad de razonamiento abstracto y analítico de los estudiantes. [97] Para las universidades y colegios estadounidenses, las puntuaciones de las pruebas estandarizadas son el factor más importante en las admisiones, solo superadas por los promedios de calificaciones de la escuela secundaria. [121] Sin embargo, según los estándares internacionales, el SAT no es tan difícil. [123] Por ejemplo, el College Scholastic Ability Test ( CSAT ) de Corea del Sur y el Matriculation Examination de Finlandia son más largos, más difíciles y cuentan más para la admisibilidad de un estudiante a la universidad. [124] En muchos países alrededor del mundo, los exámenes, incluidos los exámenes de ingreso a la universidad, son el único factor decisivo de admisión; las calificaciones escolares son simplemente irrelevantes. [123] En China e India, obtener buenos resultados en el Gaokao o el IIT-JEE , respectivamente, mejora el estatus social de los estudiantes y sus familias. [125]

En un artículo de 2012, el psicólogo educativo Jonathan Wai argumentó que el SAT era demasiado fácil para ser útil para las universidades más competitivas, cuyos solicitantes generalmente tenían promedios de calificaciones brillantes en la escuela secundaria y puntajes en exámenes estandarizados. Por lo tanto, los funcionarios de admisión tenían la carga de diferenciar a los mejores puntajes entre sí, sin saber si las calificaciones perfectas o casi perfectas de los estudiantes reflejaban realmente sus aptitudes académicas. Sugirió que el College Board hiciera que el SAT fuera más difícil, lo que elevaría el límite de medición de la prueba, lo que permitiría a las mejores escuelas identificar a los mejores y más brillantes entre los solicitantes. [126] En ese momento, el College Board ya estaba trabajando para hacer que el SAT fuera más difícil. [126] Los cambios se anunciaron en 2014 y se implementaron en 2016. [127]

Después de darse cuenta de que la prueba de junio de 2018 era más fácil de lo habitual, el College Board realizó ajustes que dieron como resultado puntuaciones inferiores a las esperadas, lo que provocó quejas de los estudiantes, aunque algunos entendieron que esto era para garantizar la imparcialidad. [128] En su análisis del incidente, Princeton Review apoyó la idea de curvar las calificaciones, pero señaló que la prueba era incapaz de distinguir a los estudiantes en el percentil 86 (650 puntos) o superior en matemáticas. Princeton Review también señaló que esta curva en particular era inusual porque no ofrecía protección contra errores descuidados o de último momento para los estudiantes de alto rendimiento. [129] The Review publicó una entrada de blog similar para el SAT de agosto de 2019, cuando ocurrió un incidente similar y el College Board respondió de la misma manera, señalando: "Un estudiante que falla dos preguntas en una prueba más fácil no debería obtener una puntuación tan buena como un estudiante que falla dos preguntas en una prueba difícil. La equiparación se encarga de ese problema". También advirtió a los estudiantes que no volvieran a tomar el examen SAT inmediatamente, ya que podrían decepcionarse nuevamente, y recomendó que en lugar de eso se dieran un "margen de maniobra" antes de volver a intentarlo. [130]

El College Board afirma que, fuera de los Estados Unidos, el SAT se considera para la admisión a universidades en aproximadamente 70 países, a partir del año académico 2023-24. [131]

En un estudio de 2000, la psicometrista Ann M. Gallagher y sus colegas descubrieron que sólo los mejores estudiantes hacían uso del razonamiento intuitivo para resolver los problemas encontrados en la sección de matemáticas del SAT. [132] Las psicólogas cognitivas Brenda Hannon y Mary McNaughton-Cassill descubrieron que tener una buena memoria de trabajo , la capacidad de integración de conocimientos y bajos niveles de ansiedad ante los exámenes predice un alto rendimiento en el SAT. [133]

Frey y Detterman (2004) investigaron las asociaciones de las puntuaciones del SAT con las puntuaciones de las pruebas de inteligencia. Utilizando una estimación de la capacidad mental general , o g , basada en la Batería de Aptitud Vocacional de las Fuerzas Armadas , encontraron que las puntuaciones del SAT estaban altamente correlacionadas con g (r = .82 en su muestra, .857 cuando se ajusta por no linealidad) en su muestra tomada de una encuesta de probabilidad nacional de 1979. Además, investigaron la correlación entre los resultados del SAT, utilizando la forma revisada y recentrada de la prueba, y las puntuaciones en las Matrices Progresivas Avanzadas de Raven , una prueba de inteligencia fluida (razonamiento), esta vez utilizando una muestra no aleatoria. Encontraron que la correlación de los resultados del SAT con las puntuaciones en las Matrices Progresivas Avanzadas de Raven era de .483, estimaron que esta correlación habría sido de aproximadamente 0.72 si no fuera por la restricción del rango de capacidad en la muestra. También notaron que parecía haber un efecto de techo en las puntuaciones del Raven que puede haber suprimido la correlación. [134] Beaujean y sus colegas (2006) han llegado a conclusiones similares a las de Frey y Detterman. [135] Debido a que el SAT está fuertemente correlacionado con la inteligencia general, puede utilizarse como un indicador para medir la inteligencia, especialmente cuando no se dispone de los métodos tradicionales de evaluación que requieren mucho tiempo. [16]

La psicometrista Linda Gottfredson señaló que el SAT es eficaz para identificar a los estudiantes intelectualmente dotados que aspiran a la universidad. [136]

Durante décadas, muchos críticos han acusado a los diseñadores del SAT verbal de sesgo cultural como explicación de la disparidad en las puntuaciones entre los examinados más pobres y los más ricos, [137] y los mayores críticos provienen del sistema de la Universidad de California. [138] [139] Un ejemplo famoso de este sesgo percibido en el SAT I fue la pregunta de analogía remero - regata , que ya no forma parte del examen. El objeto de la pregunta era encontrar el par de términos que tuvieran la relación más similar a la relación entre "corredor" y "maratón". La respuesta correcta era "remero" y "regata". Se pensaba que la elección de la respuesta correcta presuponía la familiaridad de los estudiantes con el remo , un deporte popular entre los ricos. [140] Sin embargo, para los psicometristas, las preguntas de analogía son una herramienta útil para medir las habilidades mentales de los estudiantes, ya que, incluso si el significado de dos palabras no está claro, un estudiante con habilidades de pensamiento analítico suficientemente fuertes aún debería ser capaz de identificar sus relaciones. [138] Las preguntas de analogía se eliminaron en 2005. [141] En su lugar hay preguntas que brindan más información contextual en caso de que los estudiantes ignoren la definición relevante de una palabra, lo que les facilita adivinar la respuesta correcta. [142]

En 2010, los físicos Stephen Hsu y James Schombert, de la Universidad de Oregón, examinaron cinco años de expedientes académicos de sus alumnos y descubrieron que el nivel académico de los estudiantes que se especializaban en matemáticas o física (pero no en biología, inglés, sociología o historia) dependía en gran medida de las puntuaciones de matemáticas en el SAT. Los estudiantes con puntuaciones de matemáticas en el SAT inferiores a 600 tenían muy pocas probabilidades de destacarse en la especialidad de matemáticas o física. Sin embargo, no encontraron patrones similares entre el SAT verbal o el SAT combinado verbal y matemáticas y las otras materias mencionadas anteriormente. [143] [144]

En 2015, el psicólogo educativo Jonathan Wai de la Universidad de Duke analizó los puntajes promedio de las pruebas del Army General Classification Test de 1946 (10.000 estudiantes), el Selective Service College Qualification Test de 1952 (38.420), Project Talent a principios de los años 1970 (400.000), el Graduate Record Examination entre 2002 y 2005 (más de 1,2 millones) y el SAT Math and Verbal de 2014 (1,6 millones). Wai identificó un patrón consistente: aquellos con los puntajes más altos en las pruebas tendían a elegir las ciencias físicas y la ingeniería como sus especialidades, mientras que aquellos con los puntajes más bajos tenían más probabilidades de elegir educación y agricultura. (Véase la figura siguiente.) [144] [145]

Un artículo de 2020 de Laura H. Gunn y sus colegas que examinó datos de 1389 instituciones en los Estados Unidos reveló fuertes correlaciones positivas entre los percentiles promedio del SAT de los estudiantes que ingresan y las proporciones de graduados que se especializan en STEM y ciencias sociales. Por otro lado, encontraron correlaciones negativas entre los primeros y las proporciones de graduados en psicología, teología, aplicación de la ley, recreación y acondicionamiento físico. [146]

Varios investigadores han establecido que las puntuaciones medias del SAT o ACT y la clasificación universitaria en el US News & World Report están altamente correlacionadas, casi 0,9. [16] [147] [90] [b] Entre los años 1980 y 2010, la población estadounidense creció mientras que las universidades y colegios no ampliaron sus capacidades de manera tan sustancial. Como resultado, las tasas de admisión cayeron considerablemente, lo que significa que se ha vuelto más difícil ser admitido en una escuela cuyos ex alumnos incluyen a los padres de uno. Además de eso, los estudiantes con altas puntuaciones hoy en día tienen muchas más probabilidades de abandonar sus ciudades de origen en busca de educación superior en instituciones prestigiosas. En consecuencia, las pruebas estandarizadas, como el SAT, son una medida más confiable de selectividad que las tasas de admisión. Aun así, cuando Michael J. Petrilli y Pedro Enamorado analizaron las puntuaciones compuestas del SAT (matemáticas y verbal) de las clases de primer año entrantes de 1985 y 2016 de las mejores universidades y colegios de artes liberales en los Estados Unidos, encontraron que las puntuaciones medias de los nuevos estudiantes aumentaron en 93 puntos para su muestra, de 1216 a 1309. En particular, catorce instituciones vieron un aumento de al menos 150 puntos, incluida la Universidad de Notre-Dame (de 1290 a 1440, o 150 puntos) y Elon College (de 952 a 1192, o 240 puntos). [148]

Aunque parece haber evidencia de que las escuelas privadas tienden a producir estudiantes que obtienen mejores resultados en pruebas estandarizadas como el ACT o el SAT, Keven Duncan y Jonathan Sandy demostraron, utilizando datos de las Encuestas Longitudinales Nacionales de Jóvenes , que cuando se tomaron en cuenta las características de los estudiantes, como la edad, la raza y el sexo (7%), los antecedentes familiares (45%), la calidad de la escuela (26%) y otros factores, la ventaja de las escuelas privadas disminuyó en un 78%. Los investigadores concluyeron que los estudiantes que asistían a escuelas privadas ya tenían los atributos asociados con las puntuaciones altas por sí mismos. [149]

Una investigación del sistema de la Universidad de California publicada en 2001 que analizaba los datos de sus estudiantes de grado entre el otoño de 1996 y el otoño de 1999, ambos inclusive, descubrió que el SAT II [c] era el mejor predictor individual del éxito universitario en el sentido del promedio de calificaciones del primer año, seguido del promedio de calificaciones de la escuela secundaria y, por último, el SAT I. Después de controlar los ingresos familiares y la educación de los padres, la ya baja capacidad del SAT para medir la aptitud y la preparación para la universidad cayó drásticamente, mientras que las capacidades más sustanciales de medición de la aptitud y la preparación para la universidad del promedio de calificaciones de la escuela secundaria y el SAT II permanecieron inalteradas (e incluso aumentaron ligeramente). El sistema de la Universidad de California exigió tanto el SAT I como el SAT II a los solicitantes del sistema de la UC durante los cuatro años académicos del estudio. [150] Este análisis se publicita mucho, pero muchos estudios lo contradicen. [111]

Hay evidencia de que el SAT está correlacionado con los resultados sociales y educativos, [118] incluyendo la finalización de un programa universitario de cuatro años. [151] Un artículo de 2012 de psicólogos de la Universidad de Minnesota que analiza conjuntos de datos multiinstitucionales sugirió que el SAT mantuvo su capacidad para predecir el rendimiento universitario incluso después de controlar el estatus socioeconómico (medido por la combinación del logro educativo y los ingresos de los padres) y el GPA de la escuela secundaria. Esto significa que los puntajes del SAT no fueron simplemente un indicador para medir el estatus socioeconómico, concluyeron los investigadores. [112] [152] Este hallazgo se ha replicado y se ha demostrado que se mantiene en todos los grupos raciales o étnicos y para ambos sexos. [16] Además, los investigadores de Minnesota descubrieron que las distribuciones del estatus socioeconómico de los cuerpos estudiantiles de las escuelas examinadas reflejaban las de sus respectivos grupos de solicitantes. [112] Debido a lo que mide, los puntajes del SAT de una persona no se pueden separar de su origen socioeconómico. [118] Sin embargo, la correlación entre las puntuaciones del SAT y los ingresos o el estatus socioeconómico de los padres no debe interpretarse como causalidad . Podría ser que los que obtienen puntuaciones altas tengan padres inteligentes que trabajan en empleos cognitivamente exigentes y, como tal, ganan salarios más altos. [153] Además, la correlación solo es significativa entre familias biológicas, no adoptivas, lo que sugiere que esto podría deberse a la herencia genética , no a la riqueza económica. [154] [153]

En 2007, Rebecca Zwick y Jennifer Greif Green observaron que un análisis típico no tenía en cuenta la heterogeneidad de las escuelas secundarias a las que asistían los estudiantes en términos no sólo de los estatus socioeconómicos de los cuerpos estudiantiles sino también de los estándares de calificación. Zwick y Greif Green procedieron a demostrar que cuando se tenían en cuenta estos factores, la correlación entre el estatus socioeconómico familiar y las calificaciones y el puesto en el aula aumentaba, mientras que la correlación entre el estatus socioeconómico y las puntuaciones del SAT disminuía. Llegaron a la conclusión de que las calificaciones escolares y las puntuaciones del SAT estaban asociadas de manera similar con el ingreso familiar. [114]

Según el College Board, en 2019, el 56% de los examinados tenían padres con un título universitario, el 27% padres con solo un diploma de escuela secundaria y aproximadamente el 9% no se graduó de la escuela secundaria. (El 8% no respondió a la pregunta). [43]

Una de las explicaciones parciales propuestas para la brecha entre los estudiantes asiáticos y euroamericanos en el logro educativo, medido por ejemplo por el SAT, es la tendencia general de los asiáticos a provenir de hogares estables con dos padres . [155] En su análisis de 2018 de los datos de las Encuestas Longitudinales Nacionales de la Oficina de Estadísticas Laborales , los economistas Adam Blandin, Christopher Herrington y Aaron Steelman concluyeron que la estructura familiar jugó un papel importante en la determinación de los resultados educativos en general y las puntuaciones del SAT en particular. Las familias con un solo padre que no tiene títulos fueron designadas 1L, con dos padres pero sin títulos 2L, y dos padres con al menos un título entre ellos 2H. Los niños de familias 2H tenían una ventaja significativa sobre los de familias 1L, y esta brecha creció entre 1990 y 2010. Debido a que las puntuaciones compuestas medianas del SAT (verbal y matemáticas) para las familias 2H aumentaron en 20 puntos mientras que las de las familias 1L cayeron en un punto, la brecha entre ellas aumentó en 21 puntos, o una quinta parte de una desviación estándar. [151]

En 2013, la American College Testing Board publicó un informe que afirmaba que los niños superaban a las niñas en la sección de matemáticas del examen, [156] una brecha significativa que ha persistido durante más de 35 años. [157] A partir de 2015, los niños obtuvieron en promedio 32 puntos más que las niñas en la sección de matemáticas del SAT. Entre los que obtuvieron una puntuación en el rango de 700 a 800, la proporción de hombres a mujeres fue de 1,6:1. [158] En 2014, el psicólogo Stephen Ceci y sus colaboradores descubrieron que los niños obtuvieron mejores resultados que las niñas en todos los percentiles. Por ejemplo, una niña que obtuvo una puntuación en el 10% superior de su sexo solo estaría en el 20% superior entre los niños. [159] [160] En 2010, el psicólogo Jonathan Wai y sus colegas demostraron, al analizar datos de tres décadas que involucraron a 1,6 millones de estudiantes de séptimo grado intelectualmente dotados del Programa de Identificación de Talentos (TIP) de la Universidad de Duke, que en la década de 1980 la brecha de género en la sección de matemáticas del SAT entre los estudiantes que puntuaban en el 0,01% superior era de 13,5:1 a favor de los niños, pero se redujo a 3,8:1 en la década de 1990. [161] [160] La dramática proporción de sexos de la década de 1980 replica un estudio diferente que utilizó una muestra de la Universidad Johns Hopkins. [162] Esta proporción es similar a la observada para las puntuaciones de matemáticas y ciencias del ACT entre principios de la década de 1990 y finales de la década de 2000. [161] Se mantuvo prácticamente inalterada a finales de la década de 2000. [161] [163] [164] Las diferencias de género en las puntuaciones de matemáticas del SAT comenzaron a hacerse evidentes a partir de los 400 puntos. [161] A finales de la década de 2000, por cada mujer que obtuvo una puntuación perfecta de 800 en el examen de matemáticas del SAT, había dos hombres. [165] [163]

Algunos investigadores señalan evidencia que apoya una mayor variabilidad masculina en habilidades de razonamiento verbal y cuantitativo. [166] Se ha encontrado una mayor variabilidad masculina en peso corporal, altura y habilidades cognitivas en las diferentes culturas, lo que lleva a un mayor número de hombres en las distribuciones más bajas y más altas de las pruebas. [167] En consecuencia, se encuentra un mayor número de hombres en los extremos superior e inferior de las distribuciones de desempeño de las secciones de matemáticas de las pruebas estandarizadas como el SAT, lo que resulta en la discrepancia de género observada. [168] [160] [169] Paradójicamente, esto está en desacuerdo con la tendencia de las niñas a tener puntajes más altos en el aula que los niños, [160] lo que demuestra que no carecen de aptitud académica. Sin embargo, los niños tienden a obtener mejores resultados en preguntas de pruebas estandarizadas que no están relacionadas directamente con el currículo. [166]

Por otra parte, Wai y sus colegas descubrieron que ambos sexos en el 5% superior parecían estar más o menos en paridad en lo que se refiere a la sección verbal del SAT, aunque las niñas han ganado una ligera pero notable ventaja sobre los niños a partir de mediados de la década de 1980. [162] El psicólogo David Lubinski, que realizó estudios longitudinales de estudiantes de séptimo grado que obtuvieron puntuaciones excepcionalmente altas en el SAT, encontró un resultado similar. Las niñas generalmente tenían mejores habilidades de razonamiento verbal y los niños habilidades matemáticas. [169] Esto refleja otras investigaciones sobre la capacidad cognitiva de la población general, en lugar de solo el percentil 95 y superiores. [162] [169]

Aunque aspectos de las pruebas como la amenaza de los estereotipos son una preocupación, la investigación sobre la validez predictiva del SAT ha demostrado que tiende a ser un predictor más preciso del GPA femenino en la universidad en comparación con el GPA masculino. [170]

Los problemas matemáticos del SAT pueden clasificarse en dos grandes grupos: convencionales y no convencionales. Los problemas convencionales pueden resolverse de forma rutinaria mediante fórmulas o algoritmos conocidos, mientras que los no convencionales requieren un pensamiento más creativo para hacer un uso inusual de métodos de solución conocidos o para llegar a las ideas específicas necesarias para resolver esos problemas. En 2000, la psicometrista de la ETS Ann M. Gallagher y sus colegas analizaron cómo los estudiantes manejaban las preguntas de matemáticas del SAT reveladas en los autoinformes. Encontraron que para ambos sexos, el enfoque más favorecido era utilizar fórmulas o algoritmos aprendidos en clase. Sin embargo, cuando esto fallaba, los hombres eran más propensos que las mujeres a identificar los métodos adecuados de solución. Investigaciones anteriores sugirieron que los hombres eran más propensos a explorar caminos inusuales para la solución, mientras que las mujeres tendían a ceñirse a lo que habían aprendido en clase y que las mujeres eran más propensas a identificar los enfoques apropiados si estos no requerían nada más que el dominio de los materiales del aula. [132]

Las versiones anteriores del SAT preguntaban a los estudiantes qué tan seguros estaban de su aptitud matemática y su capacidad de razonamiento verbal, específicamente, si creían o no que estaban en el 10% superior. Devin G. Pope analizó datos de más de cuatro millones de examinados desde finales de la década de 1990 hasta principios de la década de 2000 y descubrió que los que obtuvieron puntajes altos tenían más probabilidades de confiar en que estaban en el 10% superior, y los que obtuvieron puntajes más altos informaron los niveles más altos de confianza. Pero había algunas brechas notables entre los sexos. Los hombres tendían a confiar mucho más en su aptitud matemática que las mujeres. Por ejemplo, entre los que obtuvieron 700 puntos en la sección de matemáticas, el 67% de los hombres respondió que creía que estaba en el 10% superior, mientras que solo el 56% de las mujeres hizo lo mismo. Las mujeres, por otro lado, tenían un poco más de confianza en su capacidad de razonamiento verbal que los hombres. [171]

Los neurocientíficos cognitivos Richard Haier y Camilla Persson Benbow emplearon tomografías por emisión de positrones ( PET ) para investigar la tasa de metabolismo de la glucosa entre los estudiantes que habían realizado el SAT. Encontraron que entre los hombres, aquellos con puntuaciones más altas en matemáticas en el SAT exhibieron tasas más altas de metabolismo de la glucosa en los lóbulos temporales que aquellos con puntuaciones más bajas, contradiciendo la hipótesis de la eficiencia cerebral. Esta tendencia, sin embargo, no se encontró entre las mujeres, para quienes los investigadores no pudieron encontrar ninguna región cortical asociada con el razonamiento matemático. Ambos sexos obtuvieron la misma puntuación en promedio en su muestra y tuvieron las mismas tasas de metabolismo cortical de la glucosa en general. Según Haier y Benbow, esto es evidencia de las diferencias estructurales del cerebro entre los sexos. [172] [19]

Un metaanálisis de 2001 de los resultados de 6.246.729 participantes evaluados en cuanto a capacidad o aptitud cognitiva encontró una diferencia en las puntuaciones promedio entre estudiantes negros y blancos de alrededor de 1,0 desviación estándar , con resultados comparables para el SAT (2,4 millones de examinados). [173] De manera similar, en promedio, los estudiantes hispanos y amerindios se desempeñan en el orden de una desviación estándar más baja en el SAT que los estudiantes blancos y asiáticos. [174] [175] [176] [177] Las matemáticas parecen ser la parte más difícil del examen. [43] En 1996, la brecha entre negros y blancos en la sección de matemáticas era de 0,91 desviaciones estándar, pero en 2020, cayó a 0,79. [178] En 2013, los estadounidenses de origen asiático como grupo obtuvieron 0,38 desviaciones estándar más altas que los blancos en la sección de matemáticas. [155]

Some researchers believe that the difference in scores is closely related to the overall achievement gap in American society between students of different racial groups. This gap may be explainable in part by the fact that students of disadvantaged racial groups tend to go to schools that provide lower educational quality. This view is supported by evidence that the black-white gap is higher in cities and neighborhoods that are more racially segregated.[179] Other research cites poorer minority proficiency in key coursework relevant to the SAT (English and math), as well as peer pressure against students who try to focus on their schoolwork ("acting white").[180] Cultural issues are also evident among black students in wealthier households, with high achieving parents. John Ogbu, a Nigerian-American professor of anthropology, concluded that instead of looking to their parents as role models, black youth chose other models like rappers and did not make an effort to be good students.[181]

One set of studies has reported differential item functioning, namely, that some test questions function differently based on the racial group of the test taker, reflecting differences in ability to understand certain test questions or to acquire the knowledge required to answer them between groups. In 2003, Freedle published data showing that black students have had a slight advantage on the verbal questions that are labeled as difficult on the SAT, whereas white and Asian students tended to have a slight advantage on questions labeled as easy. Freedle argued that these findings suggest that "easy" test items use vocabulary that is easier to understand for white middle class students than for minorities, who often use a different language in the home environment, whereas the difficult items use complex language learned only through lectures and textbooks, giving both student groups equal opportunities to acquiring it.[182][183][184] The study was severely criticized by the ETS board, but the findings were replicated in a subsequent study by Santelices and Wilson in 2010.[185][186]

There is no evidence that SAT scores systematically underestimate future performance of minority students. However, the predictive validity of the SAT has been shown to depend on the dominant ethnic and racial composition of the college.[187] Some studies have also shown that African-American students under-perform in college relative to their white peers with the same SAT scores; researchers have argued that this is likely because white students tend to benefit from social advantages outside of the educational environment (for example, high parental involvement in their education, inclusion in campus academic activities, positive bias from same-race teachers and peers) which result in better grades.[188]

Christopher Jencks concludes that as a group, African Americans have been harmed by the introduction of standardized entrance exams such as the SAT. This, according to him, is not because the tests themselves are flawed, but because of labeling bias and selection bias; the tests measure the skills that African Americans are less likely to develop in their socialization, rather than the skills they are more likely to develop. Furthermore, standardized entrance exams are often labeled as tests of general ability, rather than of certain aspects of ability. Thus, a situation is produced in which African-American ability is consistently underestimated within the education and workplace environments, contributing in turn to selection bias against them which exacerbates underachievement.[188]

Among the major racial or ethnic groups of the United States, gaps in SAT mathematics scores are the greatest at the tails, with Hispanic and Latino Americans being the most likely to score at the lowest range and Asian Americans the highest. In addition, there is some evidence suggesting that if the test contains more questions of both the easy and difficult varieties, which would increase the variability of the scores, the gaps would be even wider. Given the distribution for Asians, for example, many could score higher than 800 if the test allowed them to. (See figure below.)[189]

2020 was the year in which education worldwide was disrupted by the COVID-19 pandemic and indeed, the performance of students in the United States on standardized tests, such as the SAT, suffered. Yet the gaps persisted.[190] According to the College Board, in 2020, while 83% of Asian students met the benchmark of college readiness in reading and writing and 80% in mathematics, only 44% and 21% of black students did those respective categories. Among whites, 79% met the benchmark for reading and writing and 59% did mathematics. For Hispanics and Latinos, the numbers were 53% and 30%, respectively. (See figure below.)[178]

_aboard_the_conventionally_powered_aircraft_carrier_USS_Kitty_Hawk_(CV_63).jpg/440px-thumbnail.jpg)

By analyzing data from the National Center for Education Statistics, economists Ember Smith and Richard Reeves of the Brookings Institution deduced that the number of students taking the SAT increased at a rate faster than population and high-school graduation growth rates between 2000 and 2020. The increase was especially pronounced among Hispanics and Latinos. Even among whites, whose number of high-school graduates was shrinking, the number of SAT takers rose.[178] In 2015, for example, 1.7 million students took the SAT,[40] up from 1.6 million in 2013.[127] But in 2019, a record-breaking 2.2 million students took the exam, compared to 2.1 million in 2018, another record-breaking year.[43] The rise in the number of students taking the SAT was due in part to many school districts offering to administer the SAT during school days often at no further costs to the students.[43] Some require students to take the SAT, regardless of whether or not they are going to college.[191] However, in 2021, in the wake of the COVID-19 pandemic and the optional status of the SAT at many colleges and universities, only 1.5 million students took the test.[13] But as testing centers reopened, ambitious students chose to take the SAT or the ACT to make themselves stand out from the competition regardless of the admissions policies of their preferred schools.[192][108] Among the class of 2023, 1.9 million students took the test.[108]

Psychologists Jean Twenge, W. Keith Campbell, and Ryne A. Sherman analyzed vocabulary test scores on the U.S. General Social Survey () and found that after correcting for education, the use of sophisticated vocabulary has declined between the mid-1970s and the mid-2010s across all levels of education, from below high school to graduate school. However, they cautioned against the use of SAT verbal scores to track the decline for while the College Board reported that SAT verbal scores had been decreasing, these scores were an imperfect measure of the vocabulary level of the nation as a whole because the test-taking demographic has changed and because more students took the SAT in the 2010s than in the 1970s, meaning there were more with limited ability who took it.[45] However, as the frequency of reading for pleasure and the level of reading comprehension among American high-school students continue to decline, students who take the SAT might struggle to do well, even if reforms have been introduced to shorten the duration of the test and to reduce the number of questions associated with a given passage in the verbal portion of the test.[193]

Certain high IQ societies, like Mensa, Intertel, the Prometheus Society and the Triple Nine Society, use scores from certain years as one of their admission tests. For instance, Intertel accepts scores (verbal and math combined) of at least 1300 on tests taken through January 1994;[194] the Triple Nine Society accepts scores of 1450 or greater on SAT tests taken before April 1995, and scores of at least 1520 on tests taken between April 1995 and February 2005.[195] Mensa accepts qualifying SAT scores earned on or before January 31, 1994.

Because it is strongly correlated with general intelligence, the SAT has often been used as a proxy to measure intelligence by researchers, especially since 2004.[16] In particular, scientists studying mathematically gifted individuals have been using the mathematics section of the SAT to identify subjects for their research.[18]

A growing body of research indicates that SAT scores can predict individual success decades into the future, for example in terms of income and occupational achievements.[16][23][91] A longitudinal study published in 2005 by educational psychologists Jonathan Wai, David Lubinski, and Camilla Benbow suggests that among the intellectually precocious (the top 1%), those with higher scores in the mathematics section of the SAT at the age of 12 were more likely to earn a PhD in the STEM fields, to have a publication, to register a patent, or to secure university tenure.[196][144] Wai further showed that an individual's academic ability, as measured by the average SAT or ACT scores of the institution attended, predicted individual differences in income, even among the richest people of all, and being a member of the 'American elite', namely Fortune 500 CEOs, billionaires, federal judges, and members of Congress.[197][16] Wai concluded that the American elite was also the cognitive elite.[197] Gregory Park, Lubinski, and Benbow gave statistical evidence that intellectually gifted adolescents, as identified by SAT scores, could be expected to accomplish great feats of creativity in the future, both in the arts and in STEM.[198][16]

The SAT is sometimes given to students at age 12 or 13 by organizations such as the Study of Mathematically Precocious Youth (SMPY), Johns Hopkins Center for Talented Youth, and the Duke University Talent Identification Program (TIP) to select, study, and mentor students of exceptional ability, that is, those in the top one percent.[19] Among SMPY participants, those within the top quartile, as indicated by the SAT composite score (mathematics and verbal), were markedly more likely to have a doctoral degree, to have at least one publication in STEM, to earn income in the 95th percentile, to have at least one literary publication, or to register at least one patent than those in the bottom quartile. Duke TIP participants generally picked career tracks in STEM should they be stronger in mathematics, as indicated by SAT mathematics scores, or the humanities if they possessed greater verbal ability, as indicated by SAT verbal scores. For comparison, the bottom SMPY quartile is five times more likely than the average American to have a patent. Meanwhile, as of 2016, the shares doctorates among SMPY participants was 44% and Duke TIP 37%, compared to two percent among the general U.S. population.[20] Consequently, the notion that beyond a certain point, differences in cognitive ability as measured by standardized tests such as the SAT cease to matter is gainsaid by the evidence.[199]

In the 2010 paper which showed that the sex gap in SAT mathematics scores had dropped dramatically between the early 1980s and the early 1990s but had persisted for the next two decades or so, Wai and his colleagues argued that "sex differences in abilities in the extreme right tail should not be dismissed as no longer part of the explanation for the dearth of women in math-intensive fields of science."[161][200]

Cognitive ability is correlated with job training outcomes and job performance.[111][22] As such, some employers rely on SAT scores to assess the suitability of a prospective recruit,[23] especially if the person has limited work experience.[22] There is nothing new about this practice.[21] Major companies and corporations have spent princely sums on learning how to avoid hiring errors and have decided that standardized test scores are a valuable tool in deciding whether or not a person is fit for the job. In some cases, a company might need to hire someone to handle proprietary materials of its own making, such as computer software. But since the ability to work with such materials cannot be assessed via external certification, it makes sense for such a firm to rely on something that is a proxy of measuring general intelligence.[23][201] In other cases, a firm may not care about academic background but needs to assess a prospective recruit's quantitative reasoning ability, and what makes standardized test scores necessary.[21] Several companies, especially those considered to be the most prestigious in industries such as investment banking and management consulting such as Goldman Sachs and McKinsey, have been reported to ask prospective job candidates about their SAT scores.[201][202][203][204]

Nevertheless, some other top employers, such as Google, have eschewed the use of SAT or other standardized test scores unless the potential employee is a recent graduate. Google's Laszlo Bock explained to The New York Times, "We found that they don’t predict anything." Educational psychologist Jonathan Wai suggested this might be due to the inability of the SAT to differentiate the intellectual capacities of those at the extreme right end of the distribution of intelligence. Wai told The New York Times, "Today the SAT is actually too easy, and that's why Google doesn't see a correlation. Every single person they get through the door is a super-high scorer."[23]

In 2002, New York Times columnist Richard Rothstein argued that the U.S. math averages on the SAT and ACT continued their decade-long rise over national verbal averages on the tests while the averages of verbal portions on the same tests were floundering.[205]

During the 1960s and 1970s, there was a movement to drop achievement scores. After some time, the countries, states, and provinces that reintroduced them agreed that academic standards had dropped, students had studied less, and had taken their education less seriously. Testing requirements were reinstated in some places after research concluded that these high-stakes tests produced benefits that outweighed the costs.[206] However, in a 2001 speech to the American Council on Education, Richard C. Atkinson, the president of the University of California, urged the dropping of aptitude tests such as the SAT I but not achievement tests such as the SAT II[c] as a college admissions requirement.[207] Atkinson's critique of the predictive validity and powers of the SAT has been contested by the University of California academic senate.[104] In April 2020, the academic senate, which consisted of faculty members, voted 51–0 to restore the requirement of standardized test scores, but the governing board overruled the academic senate and did not reinstate the test requirement anyway. Because of the size of the Californian population, this decision might have an impact on U.S. higher education at large; schools looking to admit Californian students could have a harder time.[121]