El análisis de supervivencia es una rama de la estadística para analizar la duración esperada del tiempo hasta que ocurre un evento, como la muerte en organismos biológicos y fallas en sistemas mecánicos. Este tema se llama teoría de la confiabilidad o análisis de confiabilidad en ingeniería , análisis de duración o modelado de duración en economía y análisis de historia de eventos en sociología . El análisis de supervivencia intenta responder ciertas preguntas, como ¿cuál es la proporción de una población que sobrevivirá después de un tiempo determinado? De los que sobrevivan, ¿a qué ritmo morirán o fracasarán? ¿Se pueden tener en cuenta múltiples causas de muerte o fracaso? ¿Cómo aumentan o disminuyen las circunstancias o características particulares la probabilidad de supervivencia ?

Para responder a estas preguntas, es necesario definir "vida". En el caso de la supervivencia biológica, la muerte es inequívoca, pero en el caso de la confiabilidad mecánica, el fallo puede no estar bien definido, pues bien puede haber sistemas mecánicos en los que el fallo sea parcial, una cuestión de grado o no esté localizado en el tiempo . Incluso en los problemas biológicos, algunos acontecimientos (por ejemplo, un ataque cardíaco u otra insuficiencia orgánica) pueden tener la misma ambigüedad. La teoría que se describe a continuación supone eventos bien definidos en momentos específicos; otros casos pueden tratarse mejor mediante modelos que tengan en cuenta explícitamente acontecimientos ambiguos.

De manera más general, el análisis de supervivencia implica el modelado de datos de tiempo hasta el evento; En este contexto, la muerte o el fracaso se consideran un "evento" en la literatura sobre análisis de supervivencia; tradicionalmente, solo ocurre un evento para cada sujeto, después del cual el organismo o mecanismo muere o se rompe. Los modelos de eventos recurrentes o de eventos repetidos relajan esa suposición. El estudio de eventos recurrentes es relevante en la confiabilidad de los sistemas , y en muchas áreas de las ciencias sociales y la investigación médica.

El análisis de supervivencia se utiliza de varias maneras:

Los siguientes términos se utilizan comúnmente en los análisis de supervivencia:

Este ejemplo utiliza el conjunto de datos de supervivencia de la leucemia mielógena aguda "aml" del paquete "survival" en R. El conjunto de datos es de Miller (1997) [1] y la pregunta es si el ciclo estándar de quimioterapia debe extenderse ('mantenerse ') para ciclos adicionales.

El conjunto de datos de aml ordenados por tiempo de supervivencia se muestra en el cuadro.

La última observación (11), a las 161 semanas, está censurada. La censura indica que el paciente no tuvo ningún evento (no hubo recurrencia del cáncer de aml). Otro sujeto, la observación 3, fue censurado a las 13 semanas (indicado por estado = 0). Este sujeto estuvo en el estudio solo durante 13 semanas y el cáncer de aml no recurrió durante esas 13 semanas. Es posible que este paciente fuera inscrito cerca del final del estudio, por lo que pudo ser observado durante sólo 13 semanas. También es posible que el paciente haya sido inscrito tempranamente en el estudio, pero se haya perdido durante el seguimiento o se haya retirado del estudio. La tabla muestra que otros sujetos fueron censurados a las 16, 28 y 45 semanas (observaciones 17, 6 y 9 con estado = 0). Todos los sujetos restantes experimentaron eventos (recurrencia de cáncer de aml) durante el estudio. La cuestión de interés es si la recurrencia ocurre más tarde en pacientes mantenidos que en pacientes no mantenidos.

La función de supervivencia S ( t ), es la probabilidad de que un sujeto sobreviva más que el tiempo t . S ( t ) es teóricamente una curva suave, pero generalmente se estima utilizando la curva de Kaplan-Meier (KM). El gráfico muestra la gráfica de KM para los datos de aml y se puede interpretar de la siguiente manera:

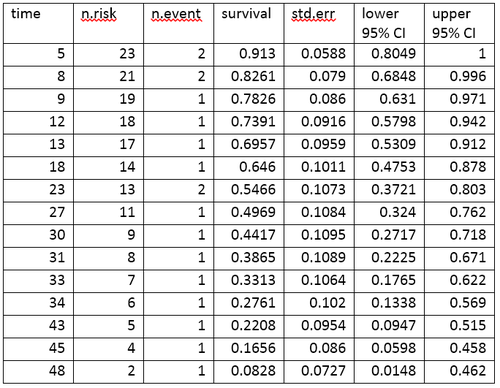

Una tabla de vida resume los datos de supervivencia en términos del número de eventos y la proporción de sobrevivientes en cada momento del evento. Se muestra la tabla de mortalidad para los datos de aml, creada con el software R.

La tabla de vida resume los eventos y la proporción de supervivientes en cada momento del evento. Las columnas de la tabla de vida tienen la siguiente interpretación:

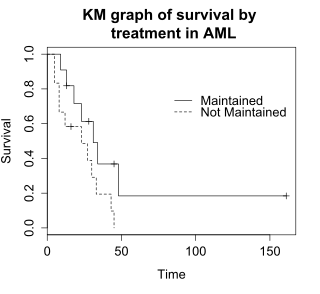

La prueba de rangos logarítmicos compara los tiempos de supervivencia de dos o más grupos. Este ejemplo utiliza una prueba de rango logarítmico para una diferencia en la supervivencia en los grupos de tratamiento mantenido versus no mantenido en los datos de aml. El gráfico muestra gráficos de KM para los datos de aml desglosados por grupo de tratamiento, lo que se indica con la variable "x" en los datos.

La hipótesis nula para una prueba de rangos logarítmicos es que los grupos tienen la misma supervivencia. El número esperado de sujetos que sobreviven en cada momento de cada evento se ajusta al número de sujetos en riesgo en los grupos en cada momento del evento. La prueba de rango logarítmico determina si el número observado de eventos en cada grupo es significativamente diferente del número esperado. La prueba formal se basa en una estadística de chi-cuadrado. Cuando la estadística de rango logarítmico es grande, es evidencia de una diferencia en los tiempos de supervivencia entre los grupos. El estadístico de rango logarítmico tiene aproximadamente una distribución de Chi-cuadrado con un grado de libertad, y el valor p se calcula mediante la prueba de Chi-cuadrado .

Para los datos del ejemplo, la prueba de rangos logarítmicos para la diferencia en la supervivencia da un valor p de p=0,0653, lo que indica que los grupos de tratamiento no difieren significativamente en la supervivencia, suponiendo un nivel alfa de 0,05. El tamaño de la muestra de 23 sujetos es modesto, por lo que hay poco poder para detectar diferencias entre los grupos de tratamiento. La prueba de chi-cuadrado se basa en una aproximación asintótica, por lo que el valor p debe considerarse con precaución para tamaños de muestra pequeños .

Las curvas de Kaplan-Meier y las pruebas de rango logarítmico son más útiles cuando la variable predictiva es categórica (p. ej., fármaco frente a placebo) o toma un número pequeño de valores (p. ej., dosis de fármaco de 0, 20, 50 y 100 mg/día). ) que puede ser tratado como categórico. La prueba de rango logarítmico y las curvas KM no funcionan fácilmente con predictores cuantitativos como la expresión genética, el recuento de glóbulos blancos o la edad. Para variables predictivas cuantitativas, un método alternativo es el análisis de regresión de riesgos proporcionales de Cox . Los modelos Cox PH también funcionan con variables predictoras categóricas, que están codificadas como indicador {0,1} o variables ficticias. La prueba de rango logarítmico es un caso especial de análisis de Cox PH y se puede realizar utilizando el software Cox PH.

Este ejemplo utiliza el conjunto de datos sobre melanoma del Capítulo 14 de Dalgaard. [2]

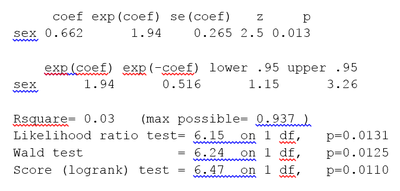

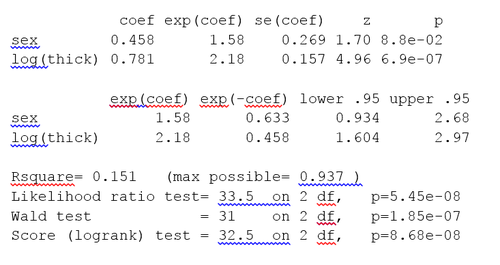

Los datos están en el paquete R ISwR. La regresión de riesgos proporcionales de Cox utilizando R proporciona los resultados que se muestran en el cuadro.

Los resultados de la regresión de Cox se interpretan de la siguiente manera.

El resultado resumido también proporciona intervalos de confianza superior e inferior del 95 % para el índice de riesgo: límite inferior del 95 % = 1,15; límite superior del 95% = 3,26.

Finalmente, el resultado proporciona valores p para tres pruebas alternativas de significancia general del modelo:

Estas tres pruebas son asintóticamente equivalentes. Para N lo suficientemente grande, darán resultados similares. Para N pequeño, pueden diferir algo. La última fila, "Prueba de puntuación (logrank)" es el resultado de la prueba de rango logarítmico, con p=0,011, el mismo resultado que la prueba de rango logarítmico, porque la prueba de rango logarítmico es un caso especial de Cox PH. regresión. La prueba de razón de verosimilitud tiene un mejor comportamiento para tamaños de muestra pequeños, por lo que generalmente se prefiere.

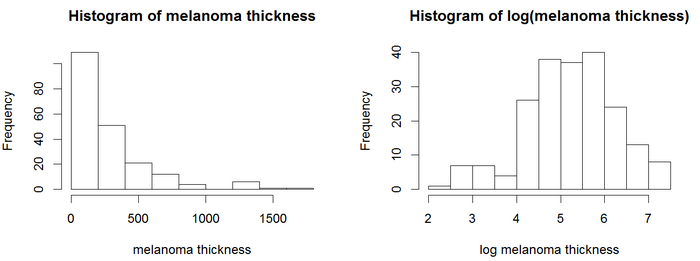

El modelo de Cox amplía la prueba de rangos logarítmicos al permitir la inclusión de covariables adicionales. [3] Este ejemplo utiliza el conjunto de datos de melanoma donde las variables predictoras incluyen una covariable continua, el grosor del tumor (nombre de la variable = "grueso").

En los histogramas, los valores de espesor están sesgados positivamente y no tienen una distribución de probabilidad simétrica similar a Gauss . Los modelos de regresión, incluido el modelo de Cox, generalmente dan resultados más confiables con variables distribuidas normalmente. [ cita necesaria ] Para este ejemplo podemos usar una transformación logarítmica . El logaritmo del espesor del tumor parece tener una distribución más normal, por lo que los modelos de Cox utilizarán el logaritmo del espesor. El análisis de PH de Cox proporciona los resultados en el cuadro.

El valor p de las tres pruebas generales (probabilidad, Wald y puntuación) es significativo, lo que indica que el modelo es significativo. El valor p para log(grueso) es 6,9e-07, con un índice de riesgo HR = exp(coef) = 2,18, lo que indica una fuerte relación entre el espesor del tumor y un mayor riesgo de muerte.

Por el contrario, el valor p para el sexo es ahora p=0,088. El índice de riesgo HR = exp(coef) = 1,58, con un intervalo de confianza del 95% de 0,934 a 2,68. Debido a que el intervalo de confianza para la FC incluye 1, estos resultados indican que el sexo hace una contribución menor a la diferencia en la FC después de controlar el grosor del tumor, y solo tiene una tendencia hacia la significación. El examen de los gráficos de log(grosor) por sexo y una prueba t de log(grosor) por sexo indican que existe una diferencia significativa entre hombres y mujeres en el espesor del tumor cuando consultan por primera vez al médico.

El modelo de Cox supone que los riesgos son proporcionales. El supuesto de riesgo proporcional se puede probar utilizando la función R cox.zph(). Un valor p inferior a 0,05 indica que los riesgos no son proporcionales. Para los datos de melanoma obtenemos p=0,222. Por tanto, no podemos rechazar la hipótesis nula de que los riesgos son proporcionales. En los libros de texto citados se describen pruebas y gráficos adicionales para examinar un modelo de Cox.

Los modelos de Cox se pueden ampliar para abordar variaciones del análisis simple.

El modelo de regresión de Cox PH es un modelo lineal. Es similar a la regresión lineal y la regresión logística. Específicamente, estos métodos suponen que una sola línea, curva, plano o superficie es suficiente para separar grupos (vivos, muertos) o para estimar una respuesta cuantitativa (tiempo de supervivencia).

En algunos casos, las particiones alternativas dan una clasificación o estimaciones cuantitativas más precisas. Un conjunto de métodos alternativos son los modelos de supervivencia estructurados en árboles, [4] [5] [6], incluidos los bosques aleatorios de supervivencia. [7] Los modelos de supervivencia estructurados en árboles pueden dar predicciones más precisas que los modelos de Cox. Examinar ambos tipos de modelos para un conjunto de datos determinado es una estrategia razonable.

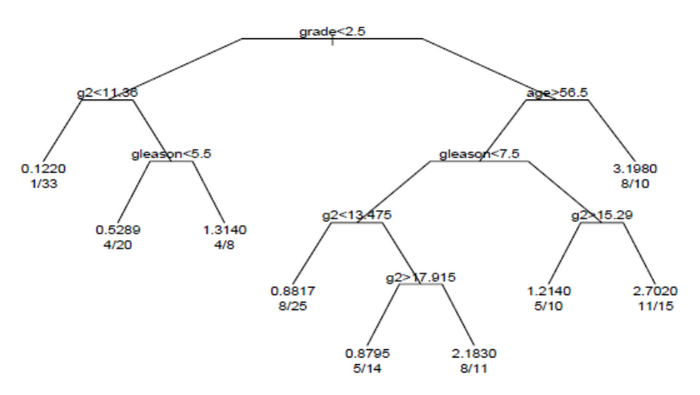

Este ejemplo de análisis de árbol de supervivencia utiliza el paquete R "rpart". [8] El ejemplo se basa en 146 pacientes con cáncer de próstata en estadio C en el conjunto de datos stagec de la parte. Rpart y el ejemplo de stagec se describen en Atkinson y Therneau (1997), [9], que también se distribuye como una viñeta del paquete rpart. [8]

Las variables por etapas son:

El árbol de supervivencia producido por el análisis se muestra en la figura.

Cada rama del árbol indica una división del valor de una variable. Por ejemplo, la raíz del árbol divide las materias con una calificación < 2,5 frente a las materias con una calificación de 2,5 o superior. Los nodos terminales indican la cantidad de sujetos en el nodo, la cantidad de sujetos que tienen eventos y la tasa de eventos relativa en comparación con la raíz. En el nodo del extremo izquierdo, los valores 1/33 indican que uno de los 33 sujetos en el nodo tuvo un evento y que la tasa relativa de eventos es 0,122. En el nodo del extremo inferior derecho, los valores 11/15 indican que 11 de 15 sujetos en el nodo tuvieron un evento y la tasa relativa de eventos es 2,7.

Una alternativa a la construcción de un único árbol de supervivencia es construir muchos árboles de supervivencia, donde cada árbol se construye utilizando una muestra de los datos y se promedian los árboles para predecir la supervivencia. [7] Este es el método subyacente a los modelos forestales aleatorios de supervivencia. El análisis de bosque aleatorio de supervivencia está disponible en el paquete R "randomForestSRC". [10]

El paquete randomForestSRC incluye un ejemplo de análisis de bosque aleatorio de supervivencia utilizando el conjunto de datos pbc. Estos datos provienen del ensayo de cirrosis biliar primaria (CBP) del hígado de Mayo Clinic realizado entre 1974 y 1984. En el ejemplo, el modelo de supervivencia del bosque aleatorio proporciona predicciones de supervivencia más precisas que el modelo de Cox PH. Los errores de predicción se estiman mediante remuestreo de arranque .

Los avances recientes en el aprendizaje de representación profunda se han extendido a la estimación de la supervivencia. El modelo DeepSurv [11] propone reemplazar la parametrización log-lineal del modelo CoxPH con un perceptrón multicapa. Extensiones adicionales como Deep Survival Machines [12] y Deep Cox Mixtures [13] implican el uso de modelos de mezcla de variables latentes para modelar la distribución del tiempo hasta el evento como una mezcla de distribuciones paramétricas o semiparamétricas mientras se aprenden conjuntamente representaciones de la entrada. covariables. Los enfoques de aprendizaje profundo han demostrado un rendimiento superior, especialmente en modalidades de datos de entrada complejas, como imágenes y series temporales clínicas.

El objeto de interés principal es la función de supervivencia , convencionalmente denotada como S , que se define como

Generalmente se supone S (0) = 1, aunque podría ser menor que 1 si existe la posibilidad de muerte o fracaso inmediato.

La función de supervivencia debe ser no creciente: S ( u ) ≤ S ( t ) si u ≥ t . Esta propiedad se sigue directamente porque T > u implica T > t . Esto refleja la noción de que la supervivencia hasta una edad posterior sólo es posible si se alcanzan todas las edades más tempranas. Dada esta propiedad, la función de distribución de la vida útil y la densidad de eventos ( F y f a continuación) están bien definidas.

Generalmente se supone que la función de supervivencia se acerca a cero a medida que la edad aumenta sin límite (es decir, S ( t ) → 0 cuando t → ∞), aunque el límite podría ser mayor que cero si la vida eterna es posible. Por ejemplo, podríamos aplicar el análisis de supervivencia a una mezcla de isótopos de carbono estables e inestables ; Los isótopos inestables se desintegrarían tarde o temprano, pero los isótopos estables durarían indefinidamente.

Las cantidades relacionadas se definen en términos de la función de supervivencia.

La función de distribución de vida , convencionalmente denotada como F , se define como el complemento de la función de supervivencia,

La función de supervivencia se puede expresar en términos de distribución de probabilidad y funciones de densidad de probabilidad.

La función de riesgo , denominada convencionalmente o , se define como la tasa de eventos en el tiempo condicionada a la supervivencia hasta el momento o más tarde (es decir, ). Supongamos que un elemento ha sobrevivido durante un tiempo y deseamos la probabilidad de que no sobreviva durante un tiempo adicional :

La fuerza de mortalidad de la función de supervivencia se define como

La fuerza de la mortalidad también se llama fuerza del fracaso. Es la función de densidad de probabilidad de la distribución de la mortalidad.

En ciencia actuarial, la tasa de riesgo es la tasa de muerte de personas mayores . Para una vida envejecida , la fuerza de la mortalidad años después es la fuerza de la mortalidad para un niño de un año. La tasa de riesgo también se llama tasa de fracaso. Tasa de riesgo y tasa de fracaso son nombres utilizados en la teoría de la confiabilidad.

Cualquier función es una función de riesgo si y sólo si satisface las siguientes propiedades:

De hecho, la tasa de riesgo suele ser más informativa sobre el mecanismo subyacente del fracaso que las otras representaciones de una distribución a lo largo de la vida.

La función de riesgo debe ser no negativa y su integral debe ser infinita, pero no está limitada de otra manera; puede ser creciente o decreciente, no monótono o discontinuo. Un ejemplo es la función de riesgo de la curva de la bañera , que es grande para valores pequeños de , disminuye hasta un mínimo y luego aumenta nuevamente; esto puede modelar la propiedad de algunos sistemas mecánicos de fallar poco después de la operación o mucho más tarde, a medida que el sistema envejece.

La función de riesgo también se puede representar en términos de la función de riesgo acumulativo , convencionalmente denotada o :

De la definición de , vemos que aumenta sin límite cuando t tiende a infinito (asumiendo que tiende a cero). Esto implica que no debe disminuir demasiado rápido, ya que, por definición, el riesgo acumulativo tiene que divergir. Por ejemplo, no es la función de riesgo de ninguna distribución de supervivencia, porque su integral converge a 1.

La función de supervivencia , la función de riesgo acumulativo , la densidad , la función de riesgo y la función de distribución de vida están relacionadas a través de

La vida futura en un momento dado es el tiempo que queda hasta la muerte, dada la supervivencia hasta la edad . Por tanto, está en la notación actual. La vida futura esperada es el valor esperado de la vida futura. La probabilidad de morir a la edad o antes , dada la supervivencia hasta la edad , es simplemente

Para , es decir, al nacer, esto se reduce a la vida esperada.

En problemas de confiabilidad, la vida útil esperada se llama tiempo medio hasta la falla y la vida futura esperada se llama vida residual media .

Como la probabilidad de que un individuo sobreviva hasta la edad t o más tarde es S ( t ), por definición, el número esperado de sobrevivientes a la edad t de una población inicial de n recién nacidos es n × S ( t ), suponiendo la misma función de supervivencia. para todos los individuos. Por tanto, la proporción esperada de supervivientes es S ( t ). Si la supervivencia de diferentes individuos es independiente, el número de supervivientes a la edad t tiene una distribución binomial con parámetros n y S ( t ), y la varianza de la proporción de supervivientes es S ( t ) × (1- S ( t ) )/ n .

La edad a la que permanece una proporción específica de supervivientes se puede encontrar resolviendo la ecuación S ( t ) = q para t , donde q es el cuantil en cuestión. Normalmente uno está interesado en la vida media , para la cual q = 1/2, u otros cuantiles como q = 0,90 o q = 0,99.

La censura es una forma de problema de datos faltantes en el que no se observa el tiempo hasta el evento por razones como la finalización del estudio antes de que todos los sujetos reclutados hayan mostrado el evento de interés o el sujeto haya abandonado el estudio antes de experimentar un evento. La censura es común en el análisis de supervivencia.

Si sólo se conoce el límite inferior l para el tiempo real del evento T tal que T > l , esto se llama censura derecha . La censura correcta se producirá, por ejemplo, para aquellos sujetos cuya fecha de nacimiento se conoce pero que todavía están vivos cuando se les pierde el seguimiento o cuando finaliza el estudio. Generalmente nos encontramos con datos censurados por la derecha.

Si el evento de interés ya ocurrió antes de que el sujeto fuera incluido en el estudio pero no se sabe cuándo ocurrió, se dice que los datos están censurados a la izquierda . [14] Cuando sólo se puede decir que el evento ocurrió entre dos observaciones o exámenes, se trata de censura de intervalo .

La censura izquierda se produce por ejemplo cuando ya ha emergido un diente permanente antes de iniciar un estudio odontológico que tiene como objetivo estimar su distribución de aparición. En el mismo estudio, el tiempo de emergencia se censura por intervalos cuando el diente permanente está presente en la boca en el examen actual pero aún no en el examen anterior. La censura por intervalos ocurre a menudo en los estudios sobre VIH/SIDA. De hecho, el tiempo transcurrido hasta la seroconversión del VIH sólo puede determinarse mediante una evaluación de laboratorio que normalmente se inicia después de una visita al médico. Entonces sólo se puede concluir que la seroconversión del VIH se produjo entre dos exámenes. Lo mismo ocurre con el diagnóstico del SIDA, que se basa en los síntomas clínicos y debe confirmarse mediante un examen médico.

También puede suceder que sujetos con una vida inferior a cierto umbral no sean observados en absoluto: esto se llama truncamiento . Tenga en cuenta que el truncamiento es diferente de la censura por la izquierda, ya que para un dato censurado por la izquierda, sabemos que el sujeto existe, pero para un dato truncado, es posible que desconozcamos por completo al sujeto. El truncamiento también es común. En el llamado estudio de entrada retrasada , los sujetos no son observados en absoluto hasta que alcanzan una determinada edad. Por ejemplo, es posible que las personas no sean observadas hasta que hayan alcanzado la edad para ingresar a la escuela. Se desconoce si hay sujetos fallecidos en el grupo de edad preescolar. Los datos truncados a la izquierda son comunes en el trabajo actuarial para seguros de vida y pensiones . [15]

Los datos censurados a la izquierda pueden ocurrir cuando el tiempo de supervivencia de una persona se vuelve incompleto en el lado izquierdo del período de seguimiento de la persona. Por ejemplo, en un ejemplo epidemiológico, podemos monitorear a un paciente para detectar un trastorno infeccioso a partir del momento en que la prueba de la infección da positivo. Aunque podemos conocer el lado derecho de la duración del interés, es posible que nunca sepamos el tiempo exacto de exposición al agente infeccioso. [dieciséis]

Los modelos de supervivencia pueden considerarse útiles como modelos de regresión ordinarios en los que la variable de respuesta es el tiempo. Sin embargo, la censura complica el cálculo de la función de probabilidad (necesaria para ajustar parámetros o hacer otros tipos de inferencias). La función de probabilidad de un modelo de supervivencia, en presencia de datos censurados, se formula de la siguiente manera. Por definición, la función de verosimilitud es la probabilidad condicional de los datos dados los parámetros del modelo. Se acostumbra suponer que los datos son independientes dados los parámetros. Entonces la función de verosimilitud es el producto de la verosimilitud de cada dato. Es conveniente dividir los datos en cuatro categorías: sin censura, censurados por la izquierda, censurados por la derecha y censurados por intervalos. Estos se denominan "unc.", "lc", "rc" e "ic" en la siguiente ecuación.

El estimador de Kaplan-Meier se puede utilizar para estimar la función de supervivencia. El estimador de Nelson-Aalen se puede utilizar para proporcionar una estimación no paramétrica de la función de tasa de riesgo acumulada. Estos estimadores requieren datos de toda la vida. Los recuentos periódicos de casos (cohorte) y muertes (y recuperación) son estadísticamente suficientes para realizar estimaciones no paramétricas de máxima verosimilitud y mínimos cuadrados de las funciones de supervivencia, sin datos de vida.

La bondad del ajuste de los modelos de supervivencia se puede evaluar mediante reglas de puntuación . [17]

El libro de texto de Kleinbaum tiene ejemplos de análisis de supervivencia utilizando SAS, R y otros paquetes. [18] Los libros de texto de Brostrom, [19] Dalgaard [2] y Tableman y Kim [20] dan ejemplos de análisis de supervivencia usando R (o usando S, y que se ejecutan en R).