La historia del hardware informático a partir de 1960 está marcada por la conversión de tubos de vacío a dispositivos de estado sólido, como transistores y luego chips de circuitos integrados (IC). Alrededor de 1953 a 1959, los transistores discretos comenzaron a considerarse lo suficientemente confiables y económicos como para hacer que otras computadoras de válvulas de vacío dejaran de ser competitivas . La tecnología de integración a gran escala (LSI) de semiconductores de óxido de metal (MOS ) condujo posteriormente al desarrollo de la memoria semiconductora a mediados y finales de la década de 1960 y luego al microprocesador a principios de la década de 1970. Esto llevó a que la memoria primaria de la computadora se alejara de los dispositivos de memoria de núcleo magnético a la memoria semiconductora estática y dinámica de estado sólido, lo que redujo en gran medida el costo, el tamaño y el consumo de energía de las computadoras. Estos avances llevaron a la computadora personal (PC) miniaturizada en la década de 1970, comenzando con las computadoras domésticas y de escritorio , seguidas por las computadoras portátiles y luego las computadoras móviles durante las siguientes décadas.

A los efectos de este artículo, el término "segunda generación" se refiere a computadoras que utilizan transistores discretos, incluso cuando los proveedores se refieren a ellas como "tercera generación". En 1960, las computadoras transistorizadas estaban reemplazando a las computadoras de tubo de vacío, ofreciendo menores costos, mayores velocidades y menor consumo de energía. El mercado estaba dominado por IBM y los siete enanitos :

Algunos ejemplos de computadoras de segunda generación de la década de 1960 de esos proveedores son:

Sin embargo, algunas empresas más pequeñas hicieron contribuciones significativas. Además, hacia el final de la segunda generación, Digital Equipment Corporation (DEC) era un serio competidor en el mercado de máquinas pequeñas y medianas.

Mientras tanto, en la URSS también se estaban desarrollando ordenadores de segunda generación como, por ejemplo, la familia Razdan de ordenadores digitales de uso general creada en el Instituto de Investigación y Desarrollo Informático de Ereván .

Las arquitecturas informáticas de segunda generación variaron inicialmente; incluían computadoras decimales basadas en caracteres , computadoras decimales de signo-magnitud con una palabra de 10 dígitos, computadoras binarias de signo-magnitud y computadoras binarias en complemento a uno , aunque Philco, RCA y Honeywell, por ejemplo, tenían algunas computadoras que eran de caracteres. Computadoras binarias basadas en y Digital Equipment Corporation (DEC) y Philco, por ejemplo, tenían computadoras en complemento a dos . Con la llegada de IBM System/360 , el complemento a dos se convirtió en la norma para las nuevas líneas de productos.

Los tamaños de palabras más comunes para las computadoras centrales binarias eran 36 y 48 bits, aunque las máquinas de nivel básico y medio usaban palabras más pequeñas, por ejemplo, 12 bits , 18 bits , 24 bits , 30 bits. Todas las máquinas, excepto las más pequeñas, tenían interrupciones y canales de E/S asíncronos . Normalmente, las computadoras binarias con un tamaño de palabra de hasta 36 bits tenían una instrucción por palabra, las computadoras binarias con 48 bits por palabra tenían dos instrucciones por palabra y las máquinas CDC de 60 bits podían tener dos, tres o cuatro instrucciones por palabra, dependiendo de la mezcla de instrucciones; las líneas Burroughs B5000 , B6500/B7500 y B8500 son excepciones notables a esto.

Las computadoras de primera generación con canales de datos (canales de E/S) tenían una interfaz DMA básica para el cable del canal. La segunda generación vio tanto canales más simples, por ejemplo, en la serie CDC 6000 que no tenían DMA, como diseños más sofisticados, por ejemplo, el 7909 en el IBM 7090 tenía un sistema computacional, de ramificación condicional y de interrupción limitado.

En 1960, el núcleo magnético era la tecnología de memoria dominante, aunque todavía había algunas máquinas nuevas que utilizaban baterías y líneas de retardo durante la década de 1960. En algunas máquinas de segunda generación se utilizaron memorias de varilla y película delgada magnética , pero los avances en la tecnología central hicieron que siguieran siendo jugadores de nicho hasta que la memoria semiconductora desplazó tanto al núcleo como a la película delgada.

En la primera generación, las computadoras orientadas a palabras tenían típicamente un único acumulador y una extensión, denominada, por ejemplo, registro de acumulador superior e inferior, acumulador y cociente multiplicador (MQ). En la segunda generación, se volvió común que las computadoras tuvieran múltiples acumuladores direccionables. En algunas computadoras, por ejemplo, PDP-6 , los mismos registros servían como acumuladores y registros de índice , lo que los convierte en un ejemplo temprano de registros de propósito general .

En la segunda generación hubo un desarrollo considerable de nuevos modos de dirección , incluido el direccionamiento truncado en, por ejemplo, Philco TRANSAC S-2000 , UNIVAC III , y el incremento automático del registro de índice en, por ejemplo, RCA 601, UNIVAC 1107 y GE. -Serie 600 . Aunque los registros índice se introdujeron en la primera generación con el nombre de línea B , su uso se volvió mucho más común en la segunda generación. De manera similar, el direccionamiento indirecto se volvió más común en la segunda generación, ya sea junto con registros de índice o en lugar de ellos. Mientras que las computadoras de primera generación generalmente tenían una pequeña cantidad de registros de índice o ninguno, varias líneas de computadoras de segunda generación tenían una gran cantidad de registros de índice, por ejemplo, Atlas , Bendix G-20 , IBM 7070 .

La primera generación fue pionera en el uso de funciones especiales para llamar a subrutinas, p. ej. TSX en el IBM 709 . En la segunda generación, esas instalaciones eran omnipresentes; algunos ejemplos son:

La segunda generación vio la introducción de funciones destinadas a admitir configuraciones de multiprocesador y multiprogramación , incluido el modo maestro/esclavo (supervisor/problema), claves de protección de almacenamiento, registros de límite, protección asociada con la traducción de direcciones e instrucciones atómicas .

El aumento masivo en el uso de computadoras se aceleró con las computadoras de tercera generación que comenzaron alrededor de 1966 en el mercado comercial. Estos generalmente se basaban en la tecnología de circuitos integrados temprana (transistores inferiores a 1000) . La tercera generación finaliza con la cuarta generación basada en microprocesadores .

En 1958, Jack Kilby de Texas Instruments inventó el circuito integrado híbrido (CI híbrido), [1] que tenía conexiones de cables externas, lo que dificultaba su producción en masa. [2] En 1959, Robert Noyce de Fairchild Semiconductor inventó el chip de circuito integrado (IC) monolítico. [3] [2] Estaba hecho de silicio , mientras que el chip de Kilby estaba hecho de germanio . La base del circuito integrado monolítico de Noyce fue el proceso plano de Fairchild , que permitió diseñar circuitos integrados utilizando los mismos principios que los de los circuitos impresos . El proceso planar fue desarrollado por el colega de Noyce, Jean Hoerni, a principios de 1959, basándose en los procesos de pasivación de superficies de silicio y oxidación térmica desarrollados por Mohamed M. Atalla en Bell Labs a finales de la década de 1950. [4] [5] [6]

Las computadoras que usaban chips IC comenzaron a aparecer a principios de los años 1960. Por ejemplo, la computadora de red de semiconductores de 1961 (computadora electrónica molecular, Mol-E-Com), [7] [8] [9] la primera computadora de propósito general con circuito integrado monolítico [10] [11] [12] (construida para demostración propósitos, programado para simular una calculadora de escritorio) fue construido por Texas Instruments para la Fuerza Aérea de EE. UU . [13] [14] [15] [16]

Algunos de sus primeros usos fueron en sistemas integrados , en particular utilizados por la NASA para la computadora de guía Apollo , por los militares en el misil balístico intercontinental LGM-30 Minuteman , la computadora aerotransportada Honeywell ALERT, [17] [18] y en el Central Air Computadora de datos utilizada para el control de vuelo en el avión de combate F-14A Tomcat de la Marina de los EE. UU .

Uno de los primeros usos comerciales fue el SDS 92 de 1965 . [19] [20] IBM utilizó por primera vez circuitos integrados en computadoras para la lógica del System/360 Modelo 85 enviado en 1969 y luego hizo un uso extensivo de circuitos integrados en su System/370 , que comenzó a distribuirse en 1971.

El circuito integrado permitió el desarrollo de computadoras mucho más pequeñas. La minicomputadora fue una innovación significativa en los años 1960 y 1970. Llevó la potencia informática a más personas, no sólo mediante un tamaño físico más conveniente sino también mediante la ampliación del campo de proveedores de computadoras. Digital Equipment Corporation se convirtió en la segunda empresa informática detrás de IBM con sus populares sistemas informáticos PDP y VAX . Un hardware más pequeño y asequible también propició el desarrollo de nuevos sistemas operativos importantes como Unix .

En noviembre de 1966, Hewlett-Packard presentó la minicomputadora 2116A [21] [22] , una de las primeras computadoras comerciales de 16 bits. Usó CTμL (MicroLogic de transistor complementario) [23] en circuitos integrados de Fairchild Semiconductor . Hewlett-Packard siguió esto con computadoras similares de 16 bits, como la 2115A en 1967, [24] la 2114A en 1968, [25] y otras.

En 1969, Data General presentó el Nova y envió un total de 50.000 a 8.000 dólares cada uno. La popularidad de las computadoras de 16 bits, como la serie Hewlett-Packard 21xx y la Data General Nova, abrió el camino hacia longitudes de palabras que eran múltiplos del byte de 8 bits . Nova fue el primero en emplear circuitos de integración de mediana escala (MSI) de Fairchild Semiconductor, y los modelos posteriores utilizaron circuitos integrados de gran escala (LSI). También fue notable que todo el procesador central estuviera contenido en una placa de circuito impreso de 15 pulgadas .

Las grandes computadoras centrales usaban circuitos integrados para aumentar las capacidades de almacenamiento y procesamiento. La familia de computadoras centrales IBM System/360 de 1965 a veces se denominan computadoras de tercera generación; sin embargo, su lógica consistía principalmente en circuitos híbridos SLT , que contenían transistores y diodos discretos interconectados sobre un sustrato con cables impresos y componentes pasivos impresos; el S/360 M85 y M91 utilizaron circuitos integrados para algunos de sus circuitos. El System/370 de 1971 de IBM utilizó circuitos integrados para su lógica, y los modelos posteriores utilizaron memoria semiconductora .

En 1971, la supercomputadora ILLIAC IV era la computadora más rápida del mundo y utilizaba alrededor de un cuarto de millón de circuitos integrados de puerta lógica ECL a pequeña escala para formar sesenta y cuatro procesadores de datos en paralelo. [26]

Las computadoras de tercera generación se ofrecieron hasta bien entrada la década de 1990; por ejemplo, el IBM ES9000 9X2 anunciado en abril de 1994 [27] utilizó 5.960 chips ECL para fabricar un procesador de 10 vías. [28] Otras computadoras de tercera generación ofrecidas en la década de 1990 incluyeron la DEC VAX 9000 (1989), construida a partir de matrices de puertas ECL y chips personalizados, [29] y la Cray T90 (1995).

Las minicomputadoras de tercera generación eran esencialmente versiones reducidas de las computadoras centrales , mientras que los orígenes de la cuarta generación son fundamentalmente diferentes. [ se necesita aclaración ] La base de la cuarta generación es el microprocesador , un procesador de computadora contenido en un único chip de circuito integrado MOS de integración a gran escala (LSI) . [30]

Las computadoras basadas en microprocesadores eran originalmente muy limitadas en su capacidad y velocidad computacional y de ninguna manera eran un intento de reducir el tamaño de la minicomputadora. Se dirigían a un mercado completamente diferente.

La potencia de procesamiento y las capacidades de almacenamiento han crecido más allá de todo reconocimiento desde los años 1970, pero la tecnología subyacente ha seguido siendo básicamente la misma de los microchips de integración a gran escala (LSI) o de integración a muy gran escala (VLSI), por lo que se considera ampliamente que la mayoría de los ordenadores actuales todavía pertenecen a la cuarta generación.

.jpg/440px-C4004_(Intel).jpg)

El microprocesador tiene su origen en el chip del circuito integrado MOS (MOS IC). [30] El MOS IC fue fabricado por Fred Heiman y Steven Hofstein en RCA en 1962. [31] Debido al rápido escalado de los MOSFET , los chips MOS IC aumentaron rápidamente en complejidad a un ritmo predicho por la ley de Moore , lo que llevó a una integración a gran escala ( LSI) con cientos de transistores en un solo chip MOS a finales de los años 1960. La aplicación de los chips MOS LSI a la informática fue la base de los primeros microprocesadores, cuando los ingenieros comenzaron a reconocer que un solo chip MOS LSI podía contener un procesador de computadora completo. [30]

Los primeros microprocesadores multichip fueron el Four-Phase Systems AL1 en 1969 y Garrett AiResearch MP944 en 1970, cada uno de los cuales utilizaba varios chips MOS LSI. [30] El 15 de noviembre de 1971, Intel lanzó el primer microprocesador de un solo chip del mundo, el 4004 , en un solo chip MOS LSI. Su desarrollo estuvo liderado por Federico Faggin , utilizando tecnología MOS de puerta de silicio , junto con Ted Hoff , Stanley Mazor y Masatoshi Shima . [32] Fue desarrollado para una empresa japonesa de calculadoras llamada Busicom como una alternativa a los circuitos cableados, pero las computadoras se desarrollaron en torno a él, con gran parte de sus capacidades de procesamiento proporcionadas por un pequeño chip de microprocesador. El chip de RAM dinámica (DRAM) se basó en la celda de memoria MOS DRAM desarrollada por Robert Dennard de IBM, que ofrece kilobits de memoria en un solo chip. Intel combinó el chip RAM con el microprocesador, permitiendo que las computadoras de cuarta generación fueran más pequeñas y más rápidas que las computadoras anteriores. El 4004 solo era capaz de realizar 60.000 instrucciones por segundo, pero sus sucesores trajeron una velocidad y potencia cada vez mayores a las computadoras, incluidos el Intel 8008, 8080 (utilizado en muchas computadoras que utilizan el sistema operativo CP/M ) y la familia 8086/8088. . (La computadora personal (PC) de IBM y sus compatibles utilizan procesadores que aún son compatibles con versiones anteriores del 8086.) Otros productores también fabricaron microprocesadores que se utilizaron ampliamente en microcomputadoras.

La siguiente tabla muestra una línea de tiempo de desarrollo significativo de microprocesadores.

Las poderosas supercomputadoras de la época estaban en el otro extremo del espectro informático de las microcomputadoras , y también utilizaban tecnología de circuitos integrados. En 1976, el Cray-1 fue desarrollado por Seymour Cray , quien había dejado Control Data en 1972 para formar su propia empresa. Esta máquina fue la primera supercomputadora que hizo práctico el procesamiento de vectores . Tenía una característica forma de herradura para acelerar el procesamiento acortando los recorridos del circuito. El procesamiento vectorial utiliza una instrucción para realizar la misma operación con muchos argumentos; Desde entonces, ha sido un método fundamental de procesamiento de supercomputadoras. El Cray-1 podía calcular 150 millones de operaciones de punto flotante por segundo (150 megaflops ). Se enviaron 85 a un precio de 5 millones de dólares cada uno. El Cray-1 tenía una CPU construida principalmente con circuitos integrados SSI y MSI ECL .

Las computadoras eran generalmente sistemas grandes y costosos propiedad de grandes instituciones antes de la introducción del microprocesador a principios de la década de 1970: corporaciones, universidades, agencias gubernamentales y similares. Los usuarios eran especialistas experimentados que normalmente no interactuaban con la máquina en sí, sino que preparaban tareas para la computadora en equipos fuera de línea, como perforadoras de tarjetas . Una serie de tareas para la computadora se reunirían y procesarían en modo por lotes . Una vez finalizados los trabajos, los usuarios podían recoger las impresiones y las tarjetas perforadas. En algunas organizaciones, pueden pasar horas o días entre el envío de un trabajo al centro de computación y la recepción del resultado.

Una forma más interactiva de uso de la computadora se desarrolló comercialmente a mediados de la década de 1960. En un sistema de tiempo compartido , múltiples teleimpresores y terminales de visualización permiten que muchas personas compartan el uso de un procesador de computadora central , y el sistema operativo asigna intervalos de tiempo a los trabajos de cada usuario. Esto era común en aplicaciones comerciales y en ciencia e ingeniería.

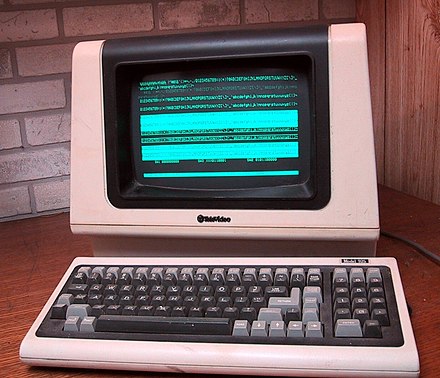

Un modelo diferente de uso de la computadora fue presagiado por la forma en que se utilizaron las primeras computadoras experimentales, precomerciales, donde un usuario tenía uso exclusivo de un procesador. [33] Algunas de las primeras computadoras que podrían llamarse "personales" fueron las primeras minicomputadoras como LINC y PDP-8 , y más tarde VAX y minicomputadoras más grandes de Digital Equipment Corporation (DEC), Data General , Prime Computer y otras. . Se originaron como procesadores periféricos para computadoras centrales, asumiendo algunas tareas rutinarias y liberando el procesador para la computación.

Según los estándares actuales, eran físicamente grandes (aproximadamente del tamaño de un refrigerador) y costosos (normalmente decenas de miles de dólares estadounidenses ) y, por lo tanto, rara vez los compraban personas individuales. Sin embargo, eran mucho más pequeños, menos costosos y, en general, más sencillos de operar que las computadoras centrales de la época y, por lo tanto, asequibles para laboratorios individuales y proyectos de investigación. Las minicomputadoras liberaron en gran medida a estas organizaciones del procesamiento por lotes y la burocracia de un centro informático comercial o universitario.

Además, las minicomputadoras eran más interactivas que las mainframes y pronto tuvieron sus propios sistemas operativos . La minicomputadora Xerox Alto (1973) fue un paso histórico en el desarrollo de las computadoras personales, debido a su interfaz gráfica de usuario , pantalla de alta resolución con mapas de bits , gran almacenamiento de memoria interna y externa, mouse y software especial. [34]

En las minicomputadoras, antepasados de las computadoras personales modernas, el procesamiento se llevaba a cabo mediante circuitos con una gran cantidad de componentes dispuestos en múltiples placas de circuito impreso de gran tamaño . En consecuencia, las minicomputadoras eran físicamente grandes y costosas de producir en comparación con los sistemas de microprocesadores posteriores. Después de que se comercializó la "computadora en un chip", el costo de producir un sistema informático se redujo drásticamente. Las funciones aritméticas, lógicas y de control que anteriormente ocupaban varias placas de circuitos costosas ahora estaban disponibles en un circuito integrado cuyo diseño era muy costoso pero barato de producir en grandes cantidades. Al mismo tiempo, los avances en el desarrollo de memorias de estado sólido eliminaron la memoria de núcleo magnético, voluminosa, costosa y que consume mucha energía, utilizada en generaciones anteriores de computadoras.

En Francia, la empresa R2E (Réalisations et Etudes Electroniques), formada por cinco antiguos ingenieros de la empresa Intertechnique , André Truong Trong Thi [35] [36] y François Gernelle [37] , introdujo en febrero de 1973 un microordenador, el Micral N, basado en el Intel 8008 . [38] Originalmente, la computadora había sido diseñada por Gernelle, Lacombe, Beckmann y Benchitrite para el Institut National de la Recherche Agronomique para automatizar las mediciones higrométricas. [39] [40] El Micral N cuesta una quinta parte del precio de un PDP-8 , alrededor de 8500FF ($1300). El reloj del Intel 8008 estaba ajustado a 500 kHz y la memoria era de 16 kilobytes. Se introdujo un autobús, llamado Pluribus, que permitía la conexión de hasta 14 placas. R2E disponía de diferentes placas para E/S digitales, E/S analógicas, memoria y disquetes.

El desarrollo del microprocesador de un solo chip fue un enorme catalizador para la popularización de computadoras baratas, fáciles de usar y verdaderamente personales. El Altair 8800 , presentado en un artículo de la revista Popular Electronics en la edición de enero de 1975, en ese momento estableció un nuevo precio bajo para una computadora, llevando la propiedad de una computadora a un mercado ciertamente selecto en la década de 1970. A esta le siguió la computadora IMSAI 8080 , con capacidades y limitaciones similares. Altair e IMSAI eran esencialmente minicomputadoras reducidas y estaban incompletas: para conectarles un teclado o una teleimpresora se requerían "periféricos" pesados y costosos. Ambas máquinas presentaban un panel frontal con interruptores y luces, que se comunicaban con el operador en binario . Para programar la máquina después de encenderla, era necesario introducir el programa del cargador bootstrap , sin errores, en binario, y luego cargar una cinta de papel que contenía un intérprete BASIC desde un lector de cintas de papel. Para activar el cargador era necesario configurar un banco de ocho interruptores hacia arriba o hacia abajo y presionar el botón "cargar", una vez por cada byte del programa, que normalmente tenía cientos de bytes de longitud. La computadora podría ejecutar programas BÁSICOS una vez cargado el intérprete.

El MITS Altair , el primer kit de microprocesador de éxito comercial, apareció en la portada de la revista Popular Electronics en enero de 1975. Fue el primer kit de computadora personal producido en masa del mundo, así como la primera computadora en utilizar un procesador Intel 8080 . Fue un éxito comercial con el envío de 10.000 Altair. El Altair también inspiró los esfuerzos de desarrollo de software de Paul Allen y su amigo de la escuela secundaria Bill Gates, quienes desarrollaron un intérprete BÁSICO para el Altair y luego formaron Microsoft .

El MITS Altair 8800 creó efectivamente una nueva industria de microcomputadoras y kits de computadora, a la que le siguieron muchas otras, como una ola de computadoras para pequeñas empresas a fines de la década de 1970 basadas en los chips de microprocesador Intel 8080, Zilog Z80 e Intel 8085 . La mayoría ejecutaba el sistema operativo CP/M -80 desarrollado por Gary Kildall de Digital Research . CP/M-80 fue el primer sistema operativo de microcomputadora popular utilizado por muchos proveedores de hardware diferentes, y se escribieron muchos paquetes de software para él, como WordStar y dBase II.

A mediados de la década de 1970, muchos aficionados diseñaron sus propios sistemas, con diversos grados de éxito, y en ocasiones se unieron para facilitar el trabajo. A partir de estas reuniones domésticas surgió el Homebrew Computer Club , donde los aficionados se reunían para hablar sobre lo que habían hecho, intercambiar esquemas y software y demostrar sus sistemas. Mucha gente construyó o montó sus propias computadoras según los diseños publicados. Por ejemplo, muchos miles de personas construyeron la computadora doméstica de Galaksija a principios de los años 1980.

El Altair fue influyente. Fue anterior a Apple Computer , así como a Microsoft , que produjo y vendió el intérprete del lenguaje de programación Altair BASIC , el primer producto de Microsoft. La segunda generación de microcomputadoras , las que aparecieron a finales de los años 1970, provocadas por la inesperada demanda de computadoras en kit en los clubes de aficionados a la electrónica, se conocían habitualmente como computadoras domésticas . Para uso empresarial, estos sistemas eran menos capaces y, en cierto modo, menos versátiles que las grandes computadoras comerciales de la época. Fueron diseñados con fines divertidos y educativos, no tanto para un uso práctico. Y aunque en ellos se podían utilizar algunas aplicaciones sencillas de oficina y productividad, generalmente eran utilizados por entusiastas de la informática para aprender a programar y ejecutar juegos de ordenador, para los cuales los ordenadores personales de la época eran menos adecuados y demasiado caros. Para los aficionados más técnicos, las computadoras domésticas también se usaban para conectarse electrónicamente a dispositivos externos, como controlar modelos de ferrocarriles y otras actividades generales de los aficionados.

.jpg/440px-Home_or_Personal_Computers_from_1977_-_Commodore_PET_2001,_Apple_II,_TRS-80_Model_I,_together_called_'Trinity77'_(edited_image).jpg)

La llegada del microprocesador y la memoria de estado sólido hizo que la informática doméstica fuera asequible. Los primeros sistemas de microcomputadoras para aficionados, como el Altair 8800 y el Apple que introduje alrededor de 1975, marcaron el lanzamiento de chips de procesador de 8 bits de bajo costo, que tenían suficiente potencia informática para ser de interés para los usuarios aficionados y experimentales. En 1977, los sistemas preensamblados como el Apple II , el Commodore PET y el TRS-80 (posteriormente denominado "Trinidad de 1977" por la revista Byte ) [41] comenzaron la era de las computadoras domésticas del mercado masivo ; se requirió mucho menos esfuerzo para obtener una computadora operativa y aplicaciones como juegos, procesamiento de textos y hojas de cálculo comenzaron a proliferar. A diferencia de las computadoras utilizadas en los hogares, los sistemas de las pequeñas empresas generalmente se basaban en CP/M , hasta que IBM introdujo la IBM PC , que fue rápidamente adoptada. La PC fue clonada en gran medida , lo que llevó a la producción en masa y la consiguiente reducción de costos a lo largo de la década de 1980. Esto amplió la presencia de la PC en los hogares, reemplazando la categoría de computadora doméstica durante la década de 1990 y conduciendo a la actual monocultura de computadoras personales arquitectónicamente idénticas.

{{cite book}}: CS1 maint: others (link)