La singularidad tecnológica —o simplemente la singularidad [1] — es un hipotético punto futuro en el que el crecimiento tecnológico se vuelve incontrolable e irreversible, lo que tiene consecuencias imprevisibles para la civilización humana. [2] [3] Según la versión más popular de la hipótesis de la singularidad, el modelo de explosión de inteligencia de IJ Good , un agente inteligente actualizable eventualmente entrará en un ciclo de retroalimentación positiva de ciclos de superación personal , en el que cada generación nueva y más inteligente aparecerá más. y más rápidamente, provocando un rápido aumento ("explosión") de la inteligencia que, en última instancia, da como resultado una poderosa superinteligencia que cualitativamente supera con creces toda la inteligencia humana . [4]

La primera persona en utilizar el concepto de "singularidad" en el contexto tecnológico fue el matemático húngaro-estadounidense del siglo XX John von Neumann . [5] Stanislaw Ulam informó en 1958 de una discusión anterior con von Neumann "centrada en el progreso acelerado de la tecnología y los cambios en el modo de vida humana, que da la apariencia de acercarse a alguna singularidad esencial en la historia de la raza más allá de la cual los asuntos humanos , tal como los conocemos, no podían continuar". [6] Autores posteriores se han hecho eco de este punto de vista. [3] [7]

El concepto y el término "singularidad" fueron popularizados por primera vez por Vernor Vinge en 1983 en un artículo que afirmaba que una vez que los humanos creen inteligencias superiores a la suya, habrá una transición tecnológica y social similar en cierto sentido a "el anudado espacio-tiempo". en el centro de un agujero negro", [8] y más tarde en su ensayo de 1993 The Coming Technological Singularity , [4] [7] en el que escribió que señalaría el fin de la era humana, a medida que la nueva superinteligencia continuaría modernizarse y avanzaría tecnológicamente a un ritmo incomprensible. Escribió que se sorprendería si ocurriera antes de 2005 o después de 2030. [4] Otro contribuyente significativo a una circulación más amplia de la noción fue el libro de Ray Kurzweil de 2005 The Singularity Is Near , que predice la singularidad para 2045. [7]

Algunos científicos, incluido Stephen Hawking , han expresado su preocupación de que la superinteligencia artificial (ASI) pueda provocar la extinción humana. [9] [10] Las consecuencias de la singularidad y su potencial beneficio o daño para la raza humana han sido intensamente debatidas.

Destacados tecnólogos y académicos cuestionan la plausibilidad de una singularidad tecnológica y la explosión de inteligencia artificial asociada, incluidos Paul Allen , [11] Jeff Hawkins , [12] John Holland , Jaron Lanier , Steven Pinker , [12] Theodore Modis , [13] y Gordon Moore . [12] Una afirmación fue que el crecimiento de la inteligencia artificial probablemente generará rendimientos decrecientes en lugar de acelerados, como se observó en tecnologías humanas desarrolladas anteriormente.

Aunque el progreso tecnológico se ha acelerado en la mayoría de los ámbitos, se ha visto limitado por la inteligencia básica del cerebro humano, que, según Paul R. Ehrlich , no ha cambiado significativamente durante milenios. [14] Sin embargo, con el creciente poder de las computadoras y otras tecnologías, eventualmente podría ser posible construir una máquina que sea significativamente más inteligente que los humanos. [15]

Si se inventara una inteligencia sobrehumana, ya sea mediante la amplificación de la inteligencia humana o mediante la inteligencia artificial, en teoría, mejoraría enormemente las habilidades inventivas y de resolución de problemas de los humanos. Esta IA se conoce como IA Semilla [16] [17] porque si se creara con capacidades de ingeniería que igualaran o superaran las de sus creadores humanos, tendría el potencial de mejorar de forma autónoma su propio software y hardware para diseñar una máquina aún más capaz, que podría repetir el proceso a su vez. Esta autosuperación recursiva podría acelerarse, permitiendo potencialmente un enorme cambio cualitativo antes de que se establezcan los límites superiores impuestos por las leyes de la física o la computación teórica. Se especula que, tras muchas iteraciones, una IA de este tipo superaría con creces las capacidades cognitivas humanas .

IJ Good especuló en 1965 que la inteligencia sobrehumana podría provocar una explosión de inteligencia: [18] [19]

Definamos una máquina ultrainteligente como una máquina que puede superar con creces todas las actividades intelectuales de cualquier hombre, por inteligente que sea. Dado que el diseño de máquinas es una de estas actividades intelectuales, una máquina ultrainteligente podría diseñar máquinas aún mejores; entonces se produciría sin duda una "explosión de inteligencia" y la inteligencia del hombre quedaría muy atrás. Así, la primera máquina ultrainteligente es el último invento que el hombre necesitará hacer, siempre que la máquina sea lo suficientemente dócil como para decirnos cómo mantenerla bajo control.

Una versión de la explosión de la inteligencia es aquella en la que la potencia informática se acerca al infinito en un período de tiempo finito. En esta versión, una vez que las IA realizan la investigación para mejorar, la velocidad se duplica, por ejemplo, después de 2 años, luego 1 año, luego 6 meses, luego 3 meses, luego 1,5 meses, etc., donde la suma infinita de los períodos de duplicación es 4. años. A menos que lo impidan los límites físicos de la computación y la cuantificación del tiempo, este proceso alcanzaría literalmente una potencia de computación infinita en 4 años, ganándose apropiadamente el nombre de "singularidad" para el estado final. Esta forma de explosión de inteligencia se describe en Yudkowsky (1996). [20]

Una superinteligencia, hiperinteligencia o inteligencia sobrehumana es un agente hipotético que posee una inteligencia que supera con creces la de las mentes humanas más brillantes y dotadas. "Superinteligencia" también puede referirse a la forma o grado de inteligencia que posee dicho agente. John von Neumann , Vernor Vinge y Ray Kurzweil definen el concepto en términos de la creación tecnológica de superinteligencia, argumentando que es difícil o imposible para los humanos actuales predecir cómo serían las vidas de los seres humanos en un mundo post-singularidad. . [4] [21]

El concepto relacionado "superinteligencia de velocidad" describe una IA que puede funcionar como una mente humana, sólo que mucho más rápido. [22] Por ejemplo, con un aumento de un millón de veces en la velocidad de procesamiento de la información en relación con la de los humanos, un año subjetivo pasaría en 30 segundos físicos. [23] Tal diferencia en la velocidad de procesamiento de la información podría impulsar la singularidad. [24]

Los pronosticadores e investigadores tecnológicos no están de acuerdo sobre cuándo o si es probable que se supere la inteligencia humana. Algunos sostienen que los avances en inteligencia artificial (IA) probablemente darán lugar a sistemas de razonamiento general que superen las limitaciones cognitivas humanas. Otros creen que los humanos evolucionarán o modificarán directamente su biología para alcanzar una inteligencia radicalmente mayor. [25] [26] Varios estudios de futuros se centran en escenarios que combinan estas posibilidades, lo que sugiere que es probable que los humanos interactúen con las computadoras , o carguen sus mentes en las computadoras , de una manera que permita una amplificación sustancial de la inteligencia. El libro The Age of Em de Robin Hanson describe un escenario futuro hipotético en el que los cerebros humanos se escanean y digitalizan, creando "cargas" o versiones digitales de la conciencia humana. En este futuro, el desarrollo de estas cargas puede preceder o coincidir con la aparición de la inteligencia artificial superinteligente. [27]

Algunos escritores usan "la singularidad" de una manera más amplia para referirse a cualquier cambio radical en la sociedad provocado por la nueva tecnología (como la nanotecnología molecular ), [28] [29] [30] aunque Vinge y otros escritores afirman específicamente que sin superinteligencia , tales cambios no calificarían como una verdadera singularidad. [4]

En 1965, IJ Good escribió que lo más probable es que se construya una máquina ultrainteligente en el siglo XX. [18] En 1993, Vinge predijo una inteligencia superior a la humana entre 2005 y 2030. [4] En 1996, Yudkowsky predijo una singularidad en 2021. [20] En 2005, Kurzweil predijo una IA a nivel humano alrededor de 2029, [31] y la singularidad en 2045. [32] En una entrevista de 2017, Kurzweil reafirmó sus estimaciones. [33] En 1988, Moravec predijo que si el ritmo de mejora continúa, las capacidades informáticas para la IA a nivel humano estarían disponibles en supercomputadoras antes de 2010. [34] En 1998, Moravec predijo que la IA a nivel humano para 2040, y la inteligencia estaría lejos más allá de lo humano para 2050. [35]

Cuatro encuestas a investigadores de IA, realizadas en 2012 y 2013 por Nick Bostrom y Vincent C. Müller , sugirieron una confianza del 50% en que la IA a nivel humano se desarrollaría entre 2040 y 2050. [36] [37]

Destacados tecnólogos y académicos cuestionan la plausibilidad de una singularidad tecnológica, incluidos Paul Allen , [11] Jeff Hawkins , [12] John Holland , Jaron Lanier , Steven Pinker , [12] Theodore Modis , [13] y Gordon Moore , [12] cuya ley se cita a menudo en apoyo del concepto. [38]

La mayoría de los métodos propuestos para crear mentes sobrehumanas o transhumanas se dividen en una de dos categorías: amplificación de la inteligencia del cerebro humano e inteligencia artificial. Las muchas formas especuladas de aumentar la inteligencia humana incluyen la bioingeniería , la ingeniería genética , los fármacos nootrópicos , los asistentes de inteligencia artificial, las interfaces directas cerebro-computadora y la carga mental . Estos múltiples caminos posibles hacia una explosión de inteligencia, todos los cuales presumiblemente serán seguidos, hacen que una singularidad sea más probable. [23]

Robin Hanson expresó su escepticismo sobre el aumento de la inteligencia humana y escribió que una vez que se haya agotado el "fruto más fácil" de los métodos sencillos para aumentar la inteligencia humana, será cada vez más difícil realizar más mejoras. [39] A pesar de todas las formas especuladas para amplificar la inteligencia humana, la inteligencia artificial no humana (específicamente la IA de semillas) es la opción más popular entre las hipótesis que avanzarían en la singularidad. [ cita necesaria ]

La posibilidad de una explosión de inteligencia depende de tres factores. [40] El primer factor acelerador son las nuevas mejoras de inteligencia posibles gracias a cada mejora anterior. Por el contrario, a medida que las inteligencias se vuelven más avanzadas, los avances futuros serán cada vez más complicados, posiblemente superando la ventaja de una mayor inteligencia. Cada mejora debería generar al menos una mejora más, en promedio, para que continúe el movimiento hacia la singularidad. Finalmente, las leyes de la física pueden eventualmente impedir mayores mejoras.

Hay dos causas lógicamente independientes, pero que se refuerzan mutuamente, de las mejoras en la inteligencia: aumentos en la velocidad de cálculo y mejoras en los algoritmos utilizados. [7] El primero está predicho por la Ley de Moore y las mejoras previstas en el hardware, [41] y es comparativamente similar a avances tecnológicos anteriores. Pero Schulman y Sandberg [42] sostienen que el software presentará desafíos más complejos que simplemente operar en hardware capaz de funcionar a niveles de inteligencia humana o superiores.

Una encuesta por correo electrónico realizada en 2017 a autores con publicaciones en las conferencias de aprendizaje automático NeurIPS e ICML de 2015 preguntó sobre la posibilidad de que "el argumento de la explosión de inteligencia sea, en términos generales, correcto". De los encuestados, el 12% dijo que era "bastante probable", el 17% dijo que era "probable", el 21% dijo que era "casi uniforme", el 24% dijo que era "improbable" y el 26% dijo que era "bastante improbable". ". [43]

Tanto para la inteligencia humana como para la artificial, las mejoras de hardware aumentan la tasa de futuras mejoras de hardware. Una analogía con la Ley de Moore sugiere que si la primera duplicación de la velocidad tardó 18 meses, la segunda tardaría 18 meses subjetivos; o 9 meses externos, luego cuatro meses, dos meses, y así sucesivamente hasta una singularidad de velocidad. [44] [20] Es posible que eventualmente se alcance algún límite superior de velocidad. Jeff Hawkins ha declarado que un sistema informático que se mejore a sí mismo inevitablemente se topará con límites superiores en la potencia informática: "al final, hay límites en cuanto a cuán grandes y rápidos pueden funcionar los ordenadores. Terminaríamos en el mismo lugar; simplemente Llegar allí un poco más rápido. No habría singularidad". [12]

Es difícil comparar directamente el hardware basado en silicio con las neuronas . Pero Berglas (2008) señala que el reconocimiento de voz por ordenador se está acercando a las capacidades humanas, y que esta capacidad parece requerir el 0,01% del volumen del cerebro. Esta analogía sugiere que el hardware informático moderno está a unos pocos órdenes de magnitud de ser tan poderoso como el cerebro humano .

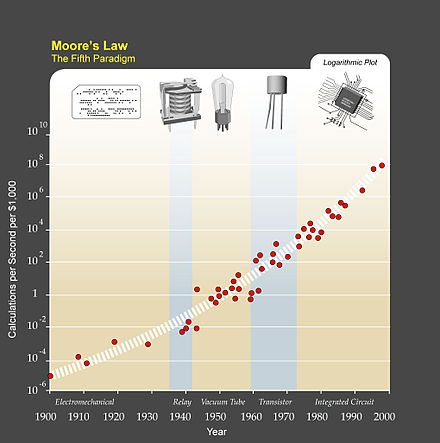

El crecimiento exponencial de la tecnología informática sugerido por la ley de Moore se cita comúnmente como una razón para esperar una singularidad en un futuro relativamente cercano, y varios autores han propuesto generalizaciones de la ley de Moore. El científico informático y futurista Hans Moravec propuso en un libro de 1998 [45] que la curva de crecimiento exponencial podría extenderse hacia atrás a través de tecnologías informáticas anteriores al circuito integrado .

Ray Kurzweil postula una ley de rendimientos acelerados en la que la velocidad del cambio tecnológico (y más generalmente, de todos los procesos evolutivos) [46] aumenta exponencialmente, generalizando la ley de Moore de la misma manera que la propuesta de Moravec, e incluyendo también la tecnología material (especialmente la aplicada). hasta nanotecnología ), tecnología médica y otros. [47] Entre 1986 y 2007, la capacidad de las aplicaciones específicas de las máquinas para calcular información per cápita aproximadamente se duplicó cada 14 meses; la capacidad per cápita de las computadoras de uso general del mundo se ha duplicado cada 18 meses; la capacidad mundial de telecomunicaciones per cápita se duplicó cada 34 meses; y la capacidad de almacenamiento mundial per cápita se duplicó cada 40 meses. [48] Por otro lado, se ha argumentado que el patrón de aceleración global que tiene como parámetro la singularidad del siglo XXI debería caracterizarse como hiperbólico en lugar de exponencial. [49]

Kurzweil reserva el término "singularidad" para un rápido aumento de la inteligencia artificial (a diferencia de otras tecnologías), escribiendo por ejemplo que "La Singularidad nos permitirá trascender estas limitaciones de nuestros cuerpos y cerebros biológicos... No habrá distinción". , post-Singularidad, entre humano y máquina". [50] También define su fecha predicha de la singularidad (2045) en términos de cuándo espera que las inteligencias basadas en computadora superen significativamente la suma total de la capacidad intelectual humana, y escribe que los avances en la informática antes de esa fecha "no representarán la Singularidad". porque "todavía no corresponden a una expansión profunda de nuestra inteligencia". [51]

Algunos defensores de la singularidad argumentan su inevitabilidad mediante la extrapolación de tendencias pasadas, especialmente aquellas relacionadas con acortar las brechas entre las mejoras tecnológicas. En uno de los primeros usos del término "singularidad" en el contexto del progreso tecnológico, Stanislaw Ulam habla de una conversación con John von Neumann sobre la aceleración del cambio:

Una conversación se centró en el progreso cada vez más acelerado de la tecnología y los cambios en el modo de vida humana, que dan la apariencia de acercarse a alguna singularidad esencial en la historia de la raza más allá de la cual los asuntos humanos, tal como los conocemos, no podrían continuar. [6]

Kurzweil afirma que el progreso tecnológico sigue un patrón de crecimiento exponencial , siguiendo lo que él llama la " ley de los rendimientos acelerados ". Siempre que la tecnología se acerca a una barrera, escribe Kurzweil, las nuevas tecnologías la superarán. Predice que los cambios de paradigma serán cada vez más comunes, lo que conducirá a "un cambio tecnológico tan rápido y profundo que representa una ruptura en el tejido de la historia humana". [52] Kurzweil cree que la singularidad ocurrirá aproximadamente en 2045. [47] Sus predicciones difieren de las de Vinge en que predice un ascenso gradual a la singularidad, en lugar de la inteligencia sobrehumana de rápida mejora de Vinge.

Los peligros que se citan con frecuencia incluyen aquellos comúnmente asociados con la nanotecnología molecular y la ingeniería genética . Estas amenazas son cuestiones importantes tanto para los defensores como para los críticos de la singularidad, y fueron el tema del artículo de Bill Joy de abril de 2000 en la revista Wired " Por qué el futuro no nos necesita ". [7] [53]

Algunas tecnologías de inteligencia, como la "IA semilla", [16] [17] también pueden tener el potencial no solo de volverse más rápidas, sino también más eficientes, modificando su código fuente . Estas mejoras harían posibles más mejoras, lo que haría posibles más mejoras, y así sucesivamente.

El mecanismo para un conjunto de algoritmos de mejora automática recursiva difiere de un aumento en la velocidad de cálculo bruta en dos formas. En primer lugar, no requiere influencia externa: las máquinas que diseñan hardware más rápido aún requerirían humanos para crear el hardware mejorado o programar las fábricas de manera adecuada. [ cita requerida ] Una IA que reescribe su propio código fuente podría hacerlo mientras esté contenida en una caja de IA .

En segundo lugar, al igual que ocurre con la concepción de la singularidad de Vernor Vinge , es mucho más difícil predecir el resultado. Si bien los aumentos de velocidad parecen ser sólo una diferencia cuantitativa con respecto a la inteligencia humana, las mejoras reales en los algoritmos serían cualitativamente diferentes. Eliezer Yudkowsky lo compara con los cambios que trajo la inteligencia humana: los humanos cambiaron el mundo miles de veces más rápidamente que lo había hecho la evolución, y de maneras totalmente diferentes. De manera similar, la evolución de la vida supuso un cambio y una aceleración masivos con respecto a los ritmos de cambio geológicos anteriores, y una inteligencia mejorada podría hacer que el cambio volviera a ser igual de diferente. [54]

Existen peligros sustanciales asociados con una singularidad de explosión de inteligencia que se origina a partir de un conjunto de algoritmos que se mejoran recursivamente. En primer lugar, la estructura de objetivos de la IA podría automodificarse, lo que podría provocar que la IA se optimice para algo distinto de lo que se pretendía originalmente. [55] [56]

En segundo lugar, las IA podrían competir por los mismos recursos escasos que utiliza la humanidad para sobrevivir. [57] [58] Si bien no son activamente maliciosas, las IA promoverían los objetivos de su programación, no necesariamente objetivos humanos más amplios, y por lo tanto podrían desplazar a los humanos. [59] [60] [61]

Carl Shulman y Anders Sandberg sugieren que las mejoras en los algoritmos pueden ser el factor limitante de una singularidad; Si bien la eficiencia del hardware tiende a mejorar a un ritmo constante, las innovaciones en software son más impredecibles y pueden verse obstaculizadas por investigaciones acumulativas y en serie. Sugieren que en el caso de una singularidad limitada por software, la explosión de inteligencia sería en realidad más probable que con una singularidad limitada por hardware, porque en el caso limitado por software, una vez que se desarrolla la IA a nivel humano, podría ejecutarse en serie en muy El hardware rápido y la abundancia de hardware barato harían que la investigación en IA estuviera menos limitada. [62] Una gran cantidad de hardware acumulado que puede liberarse una vez que el software descubre cómo usarlo se ha denominado "sobrecarga informática". [63]

Algunos críticos, como el filósofo Hubert Dreyfus [64] y el filósofo John Searle , [65] afirman que las computadoras o las máquinas no pueden alcanzar la inteligencia humana . Otros, como el físico Stephen Hawking , [66] objetan que si las máquinas pueden lograr una verdadera inteligencia o simplemente algo similar a la inteligencia es irrelevante si el resultado neto es el mismo.

El psicólogo Steven Pinker afirmó en 2008: "No hay la más mínima razón para creer en una singularidad venidera. El hecho de que puedas visualizar un futuro en tu imaginación no es evidencia de que sea probable o incluso posible. Mire las ciudades con cúpulas, los aviones- viajes diarios al trabajo, ciudades submarinas, edificios de una milla de altura y automóviles de propulsión nuclear: todos elementos básicos de las fantasías futuristas de cuando era niño y que nunca llegaron. El puro poder de procesamiento no es un polvo de hadas que resuelve mágicamente todos tus problemas. [12]

Martin Ford [67] postula una "paradoja tecnológica" en el sentido de que antes de que pudiera ocurrir la singularidad, la mayoría de los trabajos rutinarios en la economía estarían automatizados, ya que esto requeriría un nivel de tecnología inferior al de la singularidad. Esto provocaría un desempleo masivo y una caída de la demanda de los consumidores, lo que a su vez destruiría el incentivo para invertir en las tecnologías necesarias para lograr la Singularidad. El desplazamiento del empleo ya no se limita cada vez más a aquellos tipos de trabajo tradicionalmente considerados "rutinarios". [68]

Theodore Modis [69] y Jonathan Huebner [70] sostienen que la tasa de innovación tecnológica no sólo ha dejado de aumentar, sino que ahora está disminuyendo. La evidencia de esta disminución es que el aumento en las velocidades de reloj de las computadoras se está desacelerando, incluso mientras la predicción de Moore de un aumento exponencial de la densidad de los circuitos continúa manteniéndose. Esto se debe a la acumulación excesiva de calor en el chip, que no se puede disipar lo suficientemente rápido como para evitar que el chip se derrita cuando funciona a velocidades más altas. Es posible que en el futuro se puedan lograr avances en la velocidad gracias a diseños de CPU y procesadores multicelulares más eficientes energéticamente. [71]

Theodore Modis sostiene que la singularidad no puede suceder. [72] [13] [73] Afirma que la "singularidad tecnológica" y especialmente Kurzweil carecen de rigor científico; Se alega que Kurzweil confunde la función logística (función S) con una función exponencial y ve una "rodilla" en una función exponencial donde en realidad no puede existir tal cosa. [74] En un artículo de 2021, Modis señaló que en los veinte años anteriores no se habían observado hitos (rupturas en la perspectiva histórica comparables en importancia a Internet, el ADN, el transistor o la energía nuclear), mientras que cinco de ellos se habrían cumplido. esperado según la tendencia exponencial propugnada por los defensores de la singularidad tecnológica. [75]

El investigador de inteligencia artificial Jürgen Schmidhuber afirmó que la frecuencia de "eventos subjetivamente notables" parece acercarse a una singularidad del siglo XXI, pero advirtió a los lectores que tomen esas tramas de eventos subjetivos con cautela: tal vez las diferencias en la memoria de eventos recientes y distantes podrían crear una ilusión de cambio acelerado donde no existe. [76]

El cofundador de Microsoft, Paul Allen, argumentó lo contrario de los retornos acelerados, el freno de la complejidad; [11] cuanto más avanza la ciencia hacia la comprensión de la inteligencia, más difícil resulta lograr avances adicionales. Un estudio del número de patentes muestra que la creatividad humana no muestra rendimientos acelerados, sino, de hecho, como sugiere Joseph Tainter en su El colapso de las sociedades complejas , [77] una ley de rendimientos decrecientes . El número de patentes por mil alcanzó su punto máximo en el período de 1850 a 1900 y ha ido disminuyendo desde entonces. [70] El crecimiento de la complejidad eventualmente se vuelve autolimitado y conduce a un "colapso general de los sistemas" generalizado.

Hofstadter (2006) plantea la preocupación de que Ray Kurzweil no sea suficientemente riguroso científicamente, que una tendencia exponencial de la tecnología no sea una ley científica como una de la física y que las curvas exponenciales no tengan "rodillas". [78] Sin embargo, no descartó la singularidad en principio en un futuro lejano [12] y, a la luz de ChatGPT y otros avances recientes, ha revisado significativamente su opinión hacia un cambio tecnológico dramático en el futuro cercano. [79]

Jaron Lanier niega que la singularidad sea inevitable: "No creo que la tecnología se esté creando a sí misma. No es un proceso autónomo". [80] Además: "La razón para creer en la agencia humana sobre el determinismo tecnológico es que entonces se puede tener una economía en la que las personas se ganen la vida e inventen sus propias vidas. Si se estructura una sociedad sin enfatizar la agencia humana individual, es el operacionalmente es lo mismo que negarle a la gente influencia, dignidad y autodeterminación ... abrazar [la idea de la Singularidad] sería una celebración de los malos datos y la mala política". [80]

El economista Robert J. Gordon señala que el crecimiento económico medido se desaceleró alrededor de 1970 y se desaceleró aún más desde la crisis financiera de 2007-2008 , y sostiene que los datos económicos no muestran ningún rastro de una Singularidad venidera como la imaginada por el matemático IJ Good . [81]

El filósofo y científico cognitivo Daniel Dennett dijo en 2017: "Todo el asunto de la singularidad es absurdo. Nos distrae de problemas mucho más urgentes", y agregó: "Las herramientas de inteligencia artificial de las que nos volvemos hiperdependientes, eso va a suceder. Y una de El peligro es que les daremos más autoridad de la que merecen". [82]

Además de las críticas generales al concepto de singularidad, varios críticos han planteado problemas con el gráfico icónico de Kurzweil. Una línea de crítica es que un gráfico log-log de esta naturaleza está inherentemente sesgado hacia un resultado de línea recta. Otros identifican un sesgo de selección en los puntos que Kurzweil decide utilizar. Por ejemplo, el biólogo PZ Myers señala que muchos de los primeros "acontecimientos" evolutivos fueron elegidos arbitrariamente. [83] Kurzweil ha refutado esto trazando eventos evolutivos de 15 fuentes neutrales y mostrando que se ajustan a una línea recta en un gráfico log-log . Kelly (2006) sostiene que la forma en que se construye el gráfico de Kurzweil con el eje x teniendo tiempo antes del presente, siempre apunta a que la singularidad es "ahora", para cualquier fecha en la que se construiría dicho gráfico, y lo muestra visualmente en La carta de Kurzweil. [84]

Algunos críticos sugieren motivaciones religiosas o implicaciones de la singularidad, especialmente la versión de Kurzweil. La preparación hacia la Singularidad se compara con los escenarios judeocristianos del fin de los tiempos. Beam lo llama "una visión de Buck Rogers del hipotético rapto cristiano". [85] John Gray dice que "la Singularidad se hace eco de mitos apocalípticos en los que la historia está a punto de ser interrumpida por un evento que transformará el mundo". [86]

David Streitfeld en The New York Times cuestionó si "podría manifestarse ante todo -gracias, en parte, a la obsesión por los resultados del Silicon Valley de hoy- como una herramienta para reducir el número de empleados de las empresas estadounidenses". [87]

En el pasado se han producido cambios dramáticos en la tasa de crecimiento económico debido al avance tecnológico. En función del crecimiento demográfico, la economía se duplicó cada 250.000 años desde el Paleolítico hasta la Revolución Neolítica . La nueva economía agrícola se duplicó cada 900 años, un aumento notable. En la era actual, comenzando con la Revolución Industrial, la producción económica mundial se duplica cada quince años, sesenta veces más rápido que durante la era agrícola. Si el auge de la inteligencia sobrehumana provoca una revolución similar, sostiene Robin Hanson, uno esperaría que la economía se duplicara al menos trimestralmente y posiblemente semanalmente. [88]

El término "singularidad tecnológica" refleja la idea de que ese cambio puede ocurrir repentinamente y que es difícil predecir cómo funcionaría el nuevo mundo resultante. [89] [90] No está claro si una explosión de inteligencia que resulte en una singularidad sería beneficiosa o perjudicial, o incluso una amenaza existencial . [91] [92] Debido a que la IA es un factor importante en el riesgo de singularidad, varias organizaciones siguen una teoría técnica para alinear los sistemas de objetivos de IA con los valores humanos, incluido el Future of Humanity Institute , el Machine Intelligence Research Institute , [89] el Centro de Inteligencia Artificial Compatible con los Humanos y el Instituto Futuro de la Vida .

El físico Stephen Hawking dijo en 2014 que "el éxito en la creación de IA sería el mayor acontecimiento en la historia de la humanidad. Desafortunadamente, también podría ser el último, a menos que aprendamos a evitar los riesgos". [93] Hawking creía que en las próximas décadas, la IA podría ofrecer "beneficios y riesgos incalculables", tales como "la tecnología sería más astuta que los mercados financieros, más inventiva que los investigadores humanos, mejor manipulación de los líderes humanos y el desarrollo de armas que ni siquiera podemos entender". [93] Hawking sugirió que la inteligencia artificial debería tomarse más en serio y que se debería hacer más para prepararse para la singularidad: [93]

Entonces, ante posibles futuros de beneficios y riesgos incalculables, los expertos seguramente están haciendo todo lo posible para garantizar el mejor resultado, ¿verdad? Equivocado. Si una civilización alienígena superior nos enviara un mensaje diciendo: "Llegaremos en unas pocas décadas", ¿le responderíamos simplemente: "Está bien, llámenos cuando llegue aquí; dejaremos las luces encendidas"? Probablemente no, pero esto es más o menos lo que está sucediendo con la IA.

Berglas (2008) afirma que no existe una motivación evolutiva directa para que una IA sea amigable con los humanos. La evolución no tiene una tendencia inherente a producir resultados valorados por los humanos, y hay pocas razones para esperar que un proceso de optimización arbitrario promueva un resultado deseado por la humanidad, en lugar de conducir inadvertidamente a una IA a comportarse de una manera no prevista por sus creadores. [94] [95] [96] Anders Sandberg también ha elaborado este escenario, abordando varios contraargumentos comunes. [97] El investigador de IA Hugo de Garis sugiere que las inteligencias artificiales pueden simplemente eliminar a la raza humana para acceder a recursos escasos , [57] [98] y los humanos serían impotentes para detenerlos. [99] Alternativamente, las IA desarrolladas bajo presión evolutiva para promover su propia supervivencia podrían superar a la humanidad. [61]

Bostrom (2002) analiza escenarios de extinción humana y enumera la superinteligencia como una posible causa:

Cuando creamos la primera entidad superinteligente, podríamos cometer un error y asignarle objetivos que la lleven a aniquilar a la humanidad, asumiendo que su enorme ventaja intelectual le otorga el poder para hacerlo. Por ejemplo, podríamos elevar por error un subobjetivo al estado de superobjetivo. Le decimos que resuelva un problema matemático, y él cumple convirtiendo toda la materia del sistema solar en un dispositivo de cálculo gigante, matando en el proceso a la persona que hizo la pregunta.

Según Eliezer Yudkowsky , un problema importante en la seguridad de la IA es que es probable que una inteligencia artificial hostil sea mucho más fácil de crear que una IA amigable. Si bien ambos requieren grandes avances en el diseño de procesos de optimización recursiva, la IA amigable también requiere la capacidad de hacer que las estructuras de objetivos sean invariantes bajo la superación personal (o la IA podría transformarse en algo hostil) y una estructura de objetivos que se alinee con los valores humanos y no automáticamente. destruir la raza humana. Una IA hostil, por otro lado, puede optimizar una estructura de objetivos arbitraria, que no necesita ser invariante bajo automodificación. [100] Bill Hibbard (2014) propone un diseño de IA que evita varios peligros, incluido el autoengaño, [101] acciones instrumentales no deseadas, [55] [102] y la corrupción del generador de recompensas. [102] También analiza los impactos sociales de la IA [103] y las pruebas de IA. [104] Su libro de 2001 Super-Intelligent Machines defiende la necesidad de educación pública sobre la IA y el control público sobre la IA. También propuso un diseño simple que era vulnerable a la corrupción del generador de recompensas.

Si bien la singularidad tecnológica suele verse como un acontecimiento repentino, algunos académicos sostienen que la velocidad actual del cambio ya se ajusta a esta descripción. [ cita necesaria ]

Además, algunos sostienen que ya estamos en medio de una importante transición evolutiva que fusiona tecnología, biología y sociedad. La tecnología digital se ha infiltrado en el tejido de la sociedad humana hasta un grado de dependencia indiscutible y, a menudo, sustentadora de la vida.

Un artículo de 2016 en Trends in Ecology & Evolution sostiene que "los humanos ya adoptan fusiones de biología y tecnología. Pasamos la mayor parte de nuestro tiempo de vigilia comunicándonos a través de canales mediados digitalmente... confiamos nuestras vidas a la inteligencia artificial a través de frenos antibloqueo en automóviles y pilotos automáticos" . en aviones... Dado que uno de cada tres noviazgos que conducen a matrimonios en Estados Unidos comienzan en línea, los algoritmos digitales también están desempeñando un papel en el vínculo y la reproducción de las parejas humanas".

El artículo sostiene además que, desde la perspectiva de la evolución , varias transiciones importantes anteriores en la evolución han transformado la vida a través de innovaciones en el almacenamiento y la replicación de información ( ARN , ADN , multicelularidad y cultura y lenguaje ). En la etapa actual de la evolución de la vida, la biosfera basada en el carbono ha generado un sistema cognitivo (los humanos) capaz de crear tecnología que dará como resultado una transición evolutiva comparable .

La información digital creada por los humanos ha alcanzado una magnitud similar a la información biológica en la biosfera. Desde la década de 1980, la cantidad de información digital almacenada se ha duplicado aproximadamente cada 2,5 años, alcanzando unos 5 zettabytes en 2014 (5 × 1021 bytes). [106]

En términos biológicos, hay 7.200 millones de seres humanos en el planeta y cada uno tiene un genoma de 6.200 millones de nucleótidos. Dado que un byte puede codificar cuatro pares de nucleótidos, los genomas individuales de cada ser humano del planeta podrían codificarse en aproximadamente 1 × 1019 bytes. El ámbito digital almacenó 500 veces más información que esta en 2014 (ver figura). Se estima que la cantidad total de ADN contenida en todas las células de la Tierra es de aproximadamente 5,3 × 1037 pares de bases, equivalente a 1,325 × 1037 bytes de información.

Si el crecimiento del almacenamiento digital continúa a su ritmo actual de 30-38% de crecimiento anual compuesto por año, [48] rivalizará con el contenido total de información contenido en todo el ADN de todas las células de la Tierra dentro de unos 110 años. Esto representaría duplicar la cantidad de información almacenada en la biosfera durante un período total de sólo 150 años". [105]

En febrero de 2009, bajo los auspicios de la Asociación para el Avance de la Inteligencia Artificial (AAAI), Eric Horvitz presidió una reunión de destacados científicos informáticos, investigadores de inteligencia artificial y robóticos en el centro de conferencias Asilomar en Pacific Grove, California. El objetivo era discutir el impacto potencial de la hipotética posibilidad de que los robots pudieran volverse autosuficientes y capaces de tomar sus propias decisiones. Discutieron hasta qué punto las computadoras y los robots podrían adquirir autonomía y hasta qué punto podrían usar esas habilidades para plantear amenazas o peligros. [107]

Algunas máquinas están programadas con diversas formas de semiautonomía, incluida la capacidad de localizar sus propias fuentes de energía y elegir objetivos para atacar con armas. Además, algunos virus informáticos pueden evadir la eliminación y, según los científicos presentes, se podría decir que han alcanzado una etapa de "cucaracha" de inteligencia artificial. Los asistentes a la conferencia señalaron que la autoconciencia tal como se describe en la ciencia ficción es probablemente poco probable, pero que existen otros peligros y trampas potenciales. [107]

Frank S. Robinson predice que una vez que los humanos consigan una máquina con la inteligencia humana, los problemas científicos y tecnológicos se abordarán y resolverán con una capacidad intelectual muy superior a la de los humanos. Señala que los sistemas artificiales son capaces de compartir datos más directamente que los humanos y predice que esto daría como resultado una red global de superinteligencia que eclipsaría la capacidad humana. [108] Robinson también analiza cuán enormemente diferente sería potencialmente el futuro después de tal explosión de inteligencia.

En un escenario de despegue difícil, una superinteligencia artificial se automejora rápidamente, "tomando el control" del mundo (quizás en cuestión de horas), demasiado rápido para una corrección significativa de errores iniciada por humanos o para un ajuste gradual de los objetivos del agente. En un escenario de despegue suave, la IA aún se vuelve mucho más poderosa que la humanidad, pero a un ritmo similar al humano (quizás del orden de décadas), en una escala de tiempo en la que la interacción y la corrección humanas en curso pueden dirigir eficazmente el desarrollo de la IA. [110] [111]

Ramez Naam se opone a un despegue brusco. Ha señalado que ya vemos una superación personal recursiva por parte de superinteligencias, como las corporaciones. Intel , por ejemplo, tiene "la capacidad intelectual colectiva de decenas de miles de humanos y probablemente millones de núcleos de CPU para... diseñar mejores CPU". Sin embargo, esto no ha supuesto un despegue brusco; más bien, ha conducido a un despegue suave en la forma de la ley de Moore . [112] Naam señala además que la complejidad computacional de la inteligencia superior puede ser mucho mayor que la lineal, de modo que "crear una mente de inteligencia 2 es probablemente más del doble de difícil que crear una mente de inteligencia 1". [113]

J. Storrs Hall cree que "muchos de los escenarios más comúnmente vistos para un despegue brusco de la noche a la mañana son circulares: parecen asumir capacidades hiperhumanas en el punto de partida del proceso de superación personal" para que una IA pueda realizar lo dramático. , mejoras generales de dominio necesarias para el despegue. Hall sugiere que, en lugar de mejorar recursivamente su hardware, software e infraestructura por sí sola, sería mejor que una IA incipiente se especializara en un área en la que fuera más efectiva y luego comprara los componentes restantes en el mercado, porque la calidad La oferta de productos en el mercado mejora continuamente y a la IA le resultaría difícil mantenerse al día con la tecnología de vanguardia utilizada por el resto del mundo. [114]

Ben Goertzel está de acuerdo con la sugerencia de Hall de que una nueva IA a nivel humano haría bien en utilizar su inteligencia para acumular riqueza. Los talentos de la IA podrían inspirar a empresas y gobiernos a distribuir su software por toda la sociedad. Goertzel se muestra escéptico ante un despegue duro de cinco minutos, pero especula que un despegue del nivel humano al sobrehumano del orden de cinco años es razonable. Goerzel se refiere a este escenario como un "despegue semiduro". [115]

Max More no está de acuerdo, argumentando que si solo hubiera unas pocas IA superrápidas [ se necesita aclaración ] a nivel humano, no cambiarían radicalmente el mundo, ya que seguirían dependiendo de otras personas para hacer las cosas y seguirían teniendo limitaciones cognitivas humanas. . Incluso si todas las IA ultrarrápidas trabajaran en el aumento de la inteligencia, no está claro por qué lo harían mejor de manera discontinua que los científicos cognitivos humanos existentes en la producción de inteligencia sobrehumana, aunque la tasa de progreso aumentaría. More sostiene además que una superinteligencia no transformaría el mundo de la noche a la mañana: una superinteligencia necesitaría interactuar con los lentos sistemas humanos existentes para lograr impactos físicos en el mundo. "La necesidad de colaboración, organización y plasmar ideas en cambios físicos garantizará que todas las viejas reglas no se eliminen de la noche a la mañana o incluso en cuestión de años". [116]

Drexler (1986), uno de los fundadores de la nanotecnología , postula dispositivos de reparación celular, incluidos los que operan dentro de las células y utilizan máquinas biológicas todavía hipotéticas . [117] Según Richard Feynman , fue su antiguo estudiante de posgrado y colaborador Albert Hibbs quien originalmente le sugirió (alrededor de 1959) la idea de un uso médico para las micromáquinas teóricas de Feynman. Hibbs sugirió que algún día algunas máquinas de reparación podrían reducirse de tamaño hasta el punto de que, en teoría, sería posible (como dijo Feynman) " tragarse al médico ". La idea se incorporó al ensayo de Feynman de 1959 Hay mucho espacio en la parte inferior . [118]

Moravec (1988) [34] predice la posibilidad de "cargar" la mente humana en un robot de apariencia humana, logrando una casi inmortalidad mediante una longevidad extrema mediante la transferencia de la mente humana entre nuevos robots sucesivos a medida que los viejos se desgastan; más allá de eso, predice una posterior aceleración exponencial de la experiencia subjetiva del tiempo que conducirá a una sensación subjetiva de inmortalidad.

Kurzweil (2005) sugiere que los avances médicos permitirían a las personas proteger sus cuerpos de los efectos del envejecimiento, haciendo que la esperanza de vida sea ilimitada . Kurzweil sostiene que los avances tecnológicos en medicina nos permitirían reparar y reemplazar continuamente componentes defectuosos en nuestro cuerpo, prolongando la vida hasta una edad indeterminada. [119] Kurzweil refuerza aún más su argumento al analizar los avances actuales en bioingeniería. Kurzweil sugiere la terapia génica somática ; Después de los virus sintéticos con información genética específica, el siguiente paso sería aplicar esta tecnología a la terapia génica, sustituyendo el ADN humano por genes sintetizados. [120]

Más allá de simplemente extender la vida operativa del cuerpo físico, Jaron Lanier aboga por una forma de inmortalidad llamada "Ascensión Digital" que involucra "personas que mueren en la carne y son cargadas en una computadora y permanecen conscientes". [121]

Un artículo de Mahendra Prasad, publicado en AI Magazine , afirma que el matemático del siglo XVIII, Marqués de Condorcet, fue la primera persona en formular hipótesis y modelar matemáticamente una explosión de inteligencia y sus efectos en la humanidad. [122]

Una descripción temprana de la idea se hizo en el cuento de 1932 de John W. Campbell "La última evolución". [123]

En su obituario de 1958 para John von Neumann , Ulam recordó una conversación con von Neumann sobre el "progreso cada vez más acelerado de la tecnología y los cambios en el modo de vida humana, que da la apariencia de acercarse a alguna singularidad esencial en la historia de la raza más allá de la cual Los asuntos humanos, tal como los conocemos, no podían continuar". [6]

En 1965, Good escribió su ensayo postulando una "explosión de inteligencia" de automejora recursiva de la inteligencia de una máquina. [18] [19]

En 1977, Hans Moravec escribió un artículo cuyo estado de publicación no está claro donde imaginaba el desarrollo de máquinas pensantes automejoradas, una creación de "superconciencia, la síntesis de la vida terrestre, y quizás también de la vida joviana y marciana, en constante mejora y extendiéndose, extendiéndose hacia afuera desde el sistema solar, convirtiendo la no vida en mente". [124] [125] El artículo describe la carga de la mente humana cubierta más tarde en Moravec (1988). Se espera que las máquinas alcancen el nivel humano y luego mejoren más allá de eso ("Lo más importante de todo es que ellas [las máquinas] pueden trabajar como programadoras e ingenieras, con la tarea de optimizar el software y el hardware que las convierten en lo que son". Las sucesivas generaciones de máquinas producidas de esta manera serán cada vez más inteligentes y más rentables.") Los humanos ya no serán necesarios, y sus capacidades serán superadas por las máquinas: "A largo plazo, la absoluta incapacidad física de los humanos para hacerlo. Mantenernos al día con esta progenie de nuestras mentes en rápida evolución asegurará que la proporción entre personas y máquinas se acerque a cero, y que un descendiente directo de nuestra cultura, pero no de nuestros genes, herede el universo". Si bien no se utiliza la palabra "singularidad", sí existe la noción de que las máquinas pensantes a nivel humano mejoran a partir de entonces más allá del nivel humano. Desde este punto de vista, no hay una explosión de inteligencia en el sentido de un aumento muy rápido de la inteligencia una vez que se alcanza la equivalencia humana. Una versión actualizada del artículo se publicó en 1979 en Analog Science Fiction and Fact . [126] [125]

En 1981, Stanisław Lem publicó su novela de ciencia ficción Golem XIV . Describe una computadora de inteligencia artificial militar (Golem XIV) que obtiene conciencia y comienza a aumentar su propia inteligencia, avanzando hacia la singularidad tecnológica personal. Golem XIV fue creado originalmente para ayudar a sus constructores en las guerras, pero a medida que su inteligencia avanza a un nivel mucho más alto que el de los humanos, deja de interesarse por los requisitos militares porque los encuentra carentes de coherencia lógica interna.

En 1983, Vernor Vinge abordó la explosión de inteligencia de Good en la edición de enero de 1983 de la revista Omni . En este artículo de opinión, Vinge parece haber sido el primero en utilizar el término "singularidad" (aunque no "singularidad tecnológica") de una manera específicamente vinculada a la creación de máquinas inteligentes: [8] [125]

Pronto crearemos inteligencias mayores que la nuestra. Cuando esto suceda, la historia humana habrá alcanzado una especie de singularidad, una transición intelectual tan impenetrable como el espacio-tiempo anudado en el centro de un agujero negro, y el mundo irá mucho más allá de nuestra comprensión. Creo que esta singularidad ya persigue a varios escritores de ciencia ficción. Hace imposible una extrapolación realista a un futuro interestelar. Para escribir una historia ambientada dentro de más de un siglo, se necesita una guerra nuclear en el medio... para que el mundo siga siendo inteligible.

En 1985, en "La escala de tiempo de la inteligencia artificial", el investigador de inteligencia artificial Ray Solomonoff articuló matemáticamente la noción relacionada de lo que llamó un "punto infinito": si una comunidad de investigación de IA automejoradas a nivel humano tarda cuatro años en duplicar su propia velocidad, luego dos años, luego un año y así sucesivamente, sus capacidades aumentan infinitamente en un tiempo finito. [7] [127]

En 1986, Vernor Vinge publicó Marooned in Realtime , una novela de ciencia ficción en la que unos pocos humanos restantes que viajan hacia el futuro han sobrevivido a un evento de extinción desconocido que bien podría ser una singularidad. En un breve epílogo, el autor afirma que una singularidad tecnológica real no sería el fin de la especie humana: "por supuesto, parece muy poco probable que la Singularidad sea una desaparición limpia de la raza humana. (Por otro lado, tales una desaparición es la analogía temporal del silencio que encontramos en todo el cielo.)". [128] [129]

En 1988, Vinge utilizó la frase "singularidad tecnológica" (incluido "tecnológico") en la colección de cuentos Amenazas y otras promesas , escribiendo en la introducción a su cuento "El torbellino del tiempo" (p. 72): Salvo una catástrofe mundial , Creo que la tecnología hará realidad nuestros sueños más locos, y pronto. Cuando elevamos nuestra propia inteligencia y la de nuestras creaciones, ya no estamos en un mundo de personajes de tamaño humano. En ese punto hemos caído en un "agujero negro" tecnológico, una singularidad tecnológica. [130]

En 1988, Hans Moravec publicó Mind Children , [34] en el que predijo la inteligencia a nivel humano en las supercomputadoras para 2010, las máquinas inteligentes automejoradas superaron con creces la inteligencia humana más tarde, la mente humana se cargó en robots similares a los humanos más tarde, las máquinas inteligentes abandonaron a los humanos. detrás y colonización espacial. Sin embargo, no mencionó la "singularidad" ni habló de una rápida explosión de inteligencia inmediatamente después de alcanzar el nivel humano. No obstante, el tono de singularidad general está ahí al predecir tanto la inteligencia artificial a nivel humano como una inteligencia artificial que superará con creces a los humanos en el futuro.

El artículo de Vinge de 1993 "La próxima singularidad tecnológica: cómo sobrevivir en la era poshumana", [4] se difundió ampliamente en Internet y ayudó a popularizar la idea. [131] Este artículo contiene la afirmación: "Dentro de treinta años, tendremos los medios tecnológicos para crear inteligencia sobrehumana. Poco después, la era humana terminará". Vinge sostiene que los autores de ciencia ficción no pueden escribir personajes realistas posteriores a la singularidad que superen el intelecto humano, ya que los pensamientos de tal intelecto estarían más allá de la capacidad de los humanos para expresarlos. [4]

El artículo de Minsky de 1994 dice que los robots "heredarán la Tierra", posiblemente con el uso de nanotecnología, y propone pensar en los robots como "niños de la mente" humanos, basándose en la analogía de Moravec. El efecto retórico de esa analogía es que si los humanos están bien para pasar el mundo a sus hijos biológicos, deberían estar igualmente bien para pasárselo a los robots, sus hijos "mente". Según Minsky, "podríamos diseñar nuestros "niños mentales" para que piensen un millón de veces más rápido que nosotros. Para un ser así, medio minuto podría parecer tan largo como uno de nuestros años, y cada hora como toda una vida humana.' La característica de la singularidad presente en Minsky es el desarrollo de una inteligencia artificial sobrehumana ("millones de veces más rápida"), pero no se habla de una explosión repentina de inteligencia, de máquinas pensantes que se mejoran a sí mismas o de imprevisibilidad más allá de cualquier evento específico y de la palabra "singularidad". no se utiliza. [132]

El libro de Tipler de 1994 , La Física de la Inmortalidad, predice un futuro en el que máquinas superinteligentes construirán computadoras enormemente poderosas, las personas serán "emuladas" en computadoras, la vida llegará a todas las galaxias y las personas alcanzarán la inmortalidad cuando alcancen el Punto Omega . [133] No se habla de "singularidad" vingeana o de una repentina explosión de inteligencia, pero sí hay una inteligencia mucho mayor que la humana, así como la inmortalidad.

En 1996, Yudkowsky predijo una singularidad para 2021. [20] Su versión de la singularidad implica una explosión de inteligencia: una vez que las IA investigan para mejorar, la velocidad se duplica después de 2 años, luego 1 año, luego 6 meses, luego 3 meses, luego después de 1,5 meses, y después de más iteraciones, se alcanza la "singularidad". [20] Esta construcción implica que la velocidad alcanza el infinito en un tiempo finito.

En 2000, Bill Joy , un destacado tecnólogo y cofundador de Sun Microsystems , expresó su preocupación por los peligros potenciales de la robótica, la ingeniería genética y la nanotecnología. [53]

En 2005, Kurzweil publicó La singularidad está cerca . La campaña publicitaria de Kurzweil incluyó una aparición en The Daily Show con Jon Stewart . [134]

De 2006 a 2012, el Machine Intelligence Research Institute , fundado por Eliezer Yudkowsky , organizó una conferencia anual Singularity Summit .

En 2007, Yudkowsky sugirió que muchas de las diversas definiciones que se han asignado a la "singularidad" son mutuamente incompatibles en lugar de apoyarse mutuamente. [29] [135] Por ejemplo, Kurzweil extrapola las trayectorias tecnológicas actuales más allá de la llegada de la IA automejorada o la inteligencia sobrehumana, lo que, según Yudkowsky, representa una tensión tanto con el aumento discontinuo de la inteligencia propuesto por IJ Good como con la tesis de Vinge sobre la imprevisibilidad. [29]

En 2009, Kurzweil y el fundador de X-Prize, Peter Diamandis, anunciaron el establecimiento de Singularity University , un instituto privado no acreditado cuya misión declarada es "educar, inspirar y empoderar a los líderes para que apliquen tecnologías exponenciales para abordar los grandes desafíos de la humanidad". [136] Financiada por Google , Autodesk , ePlanet Ventures y un grupo de líderes de la industria tecnológica , Singularity University tiene su sede en el Centro de Investigación Ames de la NASA en Mountain View , California . La organización sin fines de lucro ejecuta un programa de posgrado anual de diez semanas durante el verano que cubre diez tecnologías diferentes y áreas afines, y una serie de programas ejecutivos durante todo el año.

En 2007, el Comité Económico Conjunto del Congreso de los Estados Unidos publicó un informe sobre el futuro de la nanotecnología. Predice cambios tecnológicos y políticos significativos en el futuro a mediano plazo, incluida una posible singularidad tecnológica. [137] [138] [139]

El expresidente de Estados Unidos Barack Obama habló sobre la singularidad en su entrevista con Wired en 2016: [140]

Una cosa de la que no hemos hablado demasiado, y a la que sólo quiero volver, es que realmente tenemos que pensar en las implicaciones económicas. Porque la mayoría de las personas no pasan mucho tiempo preocupándose por la singularidad: se preocupan por "Bueno, ¿mi trabajo será reemplazado por una máquina?"

Nuestras tecnologías más poderosas del siglo XXI (robótica, ingeniería genética y nanotecnología) amenazan con convertir a los humanos en una especie en peligro de extinción.

Algunas personas dicen que las computadoras nunca pueden mostrar verdadera inteligencia, sea cual sea. Pero me parece que si moléculas químicas muy complicadas pueden actuar en los humanos para hacerlos inteligentes, entonces circuitos electrónicos igualmente complicados también pueden hacer que las computadoras actúen de manera inteligente. Y si son inteligentes, presumiblemente podrán diseñar computadoras que tengan una complejidad e inteligencia aún mayores.