La renormalización es una colección de técnicas en la teoría cuántica de campos , la teoría estadística de campos y la teoría de estructuras geométricas autosemejantes , que se utilizan para tratar infinitos que surgen en cantidades calculadas alterando los valores de estas cantidades para compensar los efectos de sus autointeracciones. . Pero incluso si no surgieran infinitos en los diagramas de bucles de la teoría cuántica de campos, se podría demostrar que sería necesario volver a normalizar la masa y los campos que aparecen en el lagrangiano original . [1]

Por ejemplo, una teoría del electrón puede comenzar postulando un electrón con una masa y carga iniciales. En la teoría cuántica de campos, una nube de partículas virtuales , como fotones , positrones y otras, rodea e interactúa con el electrón inicial. La consideración de las interacciones de las partículas circundantes (por ejemplo, colisiones a diferentes energías) muestra que el sistema de electrones se comporta como si tuviera una masa y una carga diferentes a las inicialmente postuladas. La renormalización, en este ejemplo, reemplaza matemáticamente la masa y carga inicialmente postuladas de un electrón con la masa y carga observadas experimentalmente. Las matemáticas y los experimentos demuestran que los positrones y las partículas más masivas, como los protones, exhiben exactamente la misma carga observada que el electrón, incluso en presencia de interacciones mucho más fuertes y nubes más intensas de partículas virtuales.

La renormalización especifica relaciones entre parámetros en la teoría cuando los parámetros que describen escalas de distancia grandes difieren de los parámetros que describen escalas de distancia pequeñas. Físicamente, la acumulación de contribuciones de una infinidad de escalas involucradas en un problema puede resultar en más infinidades. Al describir el espacio-tiempo como un continuo, ciertas construcciones estadísticas y de mecánica cuántica no están bien definidas . Para definirlos, o hacerlos inequívocos, un límite continuo debe eliminar cuidadosamente el "andamio de construcción" de celosías a varias escalas. Los procedimientos de renormalización se basan en el requisito de que ciertas cantidades físicas (como la masa y la carga de un electrón) sean iguales a los valores observados (experimentales). Es decir, el valor experimental de la cantidad física produce aplicaciones prácticas, pero debido a su naturaleza empírica, la medición observada representa áreas de la teoría cuántica de campos que requieren una derivación más profunda de bases teóricas.

La renormalización se desarrolló por primera vez en la electrodinámica cuántica (QED) para dar sentido a las integrales infinitas en la teoría de la perturbación . Inicialmente vista como un procedimiento provisional sospechoso incluso por algunos de sus creadores, la renormalización finalmente fue adoptada como un mecanismo real importante y autoconsistente de la física de escalas en varios campos de la física y las matemáticas . A pesar de su escepticismo posterior, fue Paul Dirac quien fue pionero en la renormalización. [2] [3]

Hoy en día, el punto de vista ha cambiado: sobre la base de las innovadoras ideas del grupo de renormalización de Nikolay Bogolyubov y Kenneth Wilson , la atención se centra en la variación de cantidades físicas a través de escalas contiguas, mientras que las escalas distantes se relacionan entre sí a través de descripciones "efectivas". . Todas las escalas están vinculadas de una manera ampliamente sistemática, y la física real pertinente a cada una se extrae con las técnicas computacionales específicas adecuadas para cada una. Wilson aclaró qué variables de un sistema son cruciales y cuáles son redundantes.

La renormalización es distinta de la regularización , otra técnica para controlar infinitos asumiendo la existencia de nueva física desconocida en nuevas escalas.

El problema de los infinitos surgió por primera vez en la electrodinámica clásica de partículas puntuales en el siglo XIX y principios del XX.

La masa de una partícula cargada debe incluir la masa-energía en su campo electrostático ( masa electromagnética ). Supongamos que la partícula es una capa esférica cargada de radio r e . La masa-energía en el campo es

que se vuelve infinito cuando r e → 0 . Esto implica que la partícula puntual tendría una inercia infinita y, por tanto, no podría acelerarse. Por cierto, el valor de r e que iguala la masa del electrón se llama radio clásico del electrón , que (estableciendo y restableciendo los factores de c y ) resulta ser

donde es la constante de estructura fina y es la longitud de onda de Compton reducida del electrón.

Renormalización: la masa efectiva total de una partícula esférica cargada incluye la masa desnuda real de la capa esférica (además de la masa mencionada anteriormente asociada con su campo eléctrico). Si se permite que la masa desnuda del caparazón sea negativa, sería posible establecer un límite de puntos consistente. [ cita necesaria ] Esto se llamó renormalización , y Lorentz y Abraham intentaron desarrollar una teoría clásica del electrón de esta manera. Este trabajo inicial fue la inspiración para intentos posteriores de regularización y renormalización en la teoría cuántica de campos.

(Ver también regularización (física) para conocer una forma alternativa de eliminar infinitos de este problema clásico, suponiendo que exista nueva física a pequeñas escalas).

Al calcular las interacciones electromagnéticas de partículas cargadas , resulta tentador ignorar la reacción inversa del propio campo de una partícula sobre sí misma. (Análogo a la contraEMF del análisis de circuitos). Pero esta contrarreacción es necesaria para explicar la fricción sobre las partículas cargadas cuando emiten radiación. Si se supone que el electrón es un punto, el valor de la reacción inversa diverge, por la misma razón que la masa diverge, porque el campo es inverso al cuadrado .

La teoría de Abraham-Lorentz tenía una "preaceleración" no causal. A veces, un electrón comenzaría a moverse antes de que se aplicara la fuerza. Esta es una señal de que el límite de puntos es inconsistente.

El problema era peor en la teoría de campos clásica que en la teoría cuántica de campos, porque en la teoría cuántica de campos una partícula cargada experimenta Zitterbewegung debido a la interferencia con pares virtuales partícula-antipartícula, difuminando así efectivamente la carga en una región comparable a la longitud de onda de Compton. En electrodinámica cuántica con acoplamiento pequeño, la masa electromagnética solo diverge como el logaritmo del radio de la partícula.

Al desarrollar la electrodinámica cuántica en la década de 1930, Max Born , Werner Heisenberg , Pascual Jordan y Paul Dirac descubrieron que en las correcciones perturbativas muchas integrales eran divergentes (ver El problema de los infinitos ).

Una forma de describir las divergencias de las correcciones de la teoría de la perturbación fue descubierta en 1947-49 por Hans Kramers , [4] Hans Bethe , [5] Julian Schwinger , [6] [7] [8] [9] Richard Feynman , [10] [11] [12] y Shin'ichiro Tomonaga , [13] [14] [15] [16] [17] [ 18] [19] y sistematizado por Freeman Dyson en 1949. [20] Las divergencias aparecen en correcciones radiativas que involucra diagramas de Feynman con bucles cerrados de partículas virtuales en ellos.

Si bien las partículas virtuales obedecen a la conservación de la energía y el momento , pueden tener cualquier energía y momento, incluso uno que no esté permitido por la relación relativista energía-momento para la masa observada de esa partícula (es decir, no es necesariamente la masa al cuadrado de la partícula). partícula en ese proceso, por ejemplo, para un fotón podría ser distinto de cero). Esta partícula se llama fuera de cáscara . Cuando hay un bucle, el impulso de las partículas involucradas en el bucle no está determinado únicamente por las energías y los momentos de las partículas entrantes y salientes. Una variación en la energía de una partícula en el bucle se puede equilibrar con un cambio igual y opuesto en la energía de otra partícula en el bucle, sin afectar las partículas entrantes y salientes. Por tanto, son posibles muchas variaciones. Entonces , para encontrar la amplitud del proceso del bucle, se deben integrar todas las combinaciones posibles de energía y momento que podrían viajar alrededor del bucle.

Estas integrales suelen ser divergentes , es decir, dan infinitas respuestas. Las divergencias que resultan significativas son las " ultravioleta " (UV). Una divergencia ultravioleta puede describirse como aquella que proviene de

Así pues, estas divergencias son fenómenos de corta distancia y de corta duración.

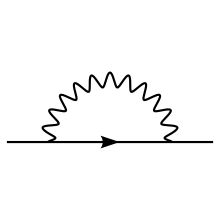

Como se muestra en las imágenes del margen derecho, hay exactamente tres diagramas de bucles divergentes de un bucle en electrodinámica cuántica: [21]

Las tres divergencias corresponden a los tres parámetros de la teoría considerada:

La segunda clase de divergencia, llamada divergencia infrarroja , se debe a partículas sin masa, como el fotón. Todo proceso que involucra partículas cargadas emite una infinidad de fotones coherentes de longitud de onda infinita, y la amplitud para emitir cualquier número finito de fotones es cero. En el caso de los fotones, estas divergencias se comprenden bien. Por ejemplo, en el orden de 1 bucle, la función de vértice tiene divergencias tanto ultravioleta como infrarroja . A diferencia de la divergencia ultravioleta, la divergencia infrarroja no requiere la renormalización de un parámetro en la teoría involucrada. La divergencia infrarroja del diagrama de vértices se elimina incluyendo un diagrama similar al diagrama de vértices con la siguiente diferencia importante: el fotón que conecta las dos patas del electrón se corta y se reemplaza por dos fotones en la capa (es decir, reales) cuyas longitudes de onda tienden a hasta el infinito; este diagrama es equivalente al proceso de bremsstrahlung . Este diagrama adicional debe incluirse porque no existe una forma física de distinguir un fotón de energía cero que fluye a través de un bucle como en el diagrama de vértice y los fotones de energía cero emitidos a través de bremsstrahlung . Desde un punto de vista matemático, las divergencias IR se pueden regularizar asumiendo una diferenciación fraccionaria con respecto a un parámetro, por ejemplo:

está bien definido en p = a pero es UV divergente; si tomamos la derivada fraccionaria 3 ⁄ 2 con respecto a − a 2 , obtenemos la divergencia IR

entonces podemos curar las divergencias IR convirtiéndolas en divergencias UV. [ se necesita aclaración ]

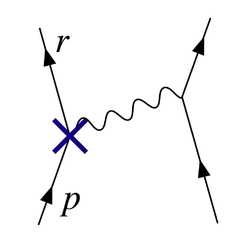

El diagrama de la Figura 2 muestra una de las varias contribuciones de un bucle a la dispersión electrón-electrón en QED. El electrón en el lado izquierdo del diagrama, representado por la línea continua, comienza con un momento de 4 p μ y termina con un momento de 4 r μ . Emite un fotón virtual que transporta r μ − p μ para transferir energía y momento al otro electrón. Pero en este diagrama, antes de que eso suceda, emite otro fotón virtual con un momento de 4 q μ , y lo reabsorbe después de emitir el otro fotón virtual. La conservación de la energía y del momento no determinan el momento de 4 q μ de forma única, por lo que todas las posibilidades contribuyen por igual y debemos integrarlas.

La amplitud de este diagrama termina, entre otras cosas, con un factor del bucle de

Los diversos factores γ μ en esta expresión son matrices gamma como en la formulación covariante de la ecuación de Dirac ; tienen que ver con el espín del electrón. Los factores de e son la constante de acoplamiento eléctrico, mientras que proporcionan una definición heurística del contorno de integración alrededor de los polos en el espacio de momentos. La parte importante para nuestros propósitos es la dependencia de q μ de los tres grandes factores del integrando, que provienen de los propagadores de las dos líneas de electrones y la línea de fotones en el bucle.

Esto tiene una pieza con dos potencias de q μ en la parte superior que domina en valores grandes de q μ (Pokorski 1987, p. 122):

Esta integral es divergente e infinita, a menos que la cortemos de alguna manera en energía y momento finitos.

Divergencias de bucles similares ocurren en otras teorías cuánticas de campos.

La solución fue darse cuenta de que las cantidades que aparecían inicialmente en las fórmulas de la teoría (como la fórmula del lagrangiano ), que representaban cosas como la carga eléctrica y la masa del electrón , así como las normalizaciones de los propios campos cuánticos, en realidad no correspondían. a las constantes físicas medidas en el laboratorio. Tal como están escritas, eran cantidades simples que no tenían en cuenta la contribución de los efectos del bucle de partículas virtuales a las constantes físicas mismas . Entre otras cosas, estos efectos incluirían la contraparte cuántica de la reacción electromagnética inversa que tanto molestó a los teóricos clásicos del electromagnetismo. En general, estos efectos serían tan divergentes como las amplitudes consideradas en primer lugar; por lo tanto, cantidades finitas medidas implicarían, en general, cantidades desnudas divergentes.

Entonces, para establecer contacto con la realidad, las fórmulas tendrían que reescribirse en términos de cantidades mensurables y renormalizadas . La carga del electrón, digamos, se definiría en términos de una cantidad medida en un punto de renormalización cinemática o punto de resta específico (que generalmente tendrá una energía característica, llamada escala de renormalización o simplemente escala de energía ). Las partes sobrantes del lagrangiano, que involucran las porciones restantes de las cantidades desnudas, podrían luego reinterpretarse como contratérminos , involucrados en diagramas divergentes que anulan exactamente las divergencias problemáticas de otros diagramas.

Por ejemplo, en el lagrangiano de QED

los campos y la constante de acoplamiento son cantidades realmente básicas , de ahí el subíndice B anterior. Convencionalmente, las cantidades simples se escriben de modo que los términos lagrangianos correspondientes sean múltiplos de los renormalizados:

La invariancia de calibre , a través de una identidad de Ward-Takahashi , implica que podemos renormalizar los dos términos de la pieza derivada covariante.

juntos (Pokorski 1987, p. 115), que es lo que pasó con Z 2 ; es lo mismo que Z 1 .

Un término en este lagrangiano, por ejemplo, la interacción electrón-fotón que se muestra en la Figura 1, se puede escribir entonces

La constante física e , la carga del electrón, puede entonces definirse en términos de algún experimento específico: establecemos la escala de renormalización igual a la energía característica de este experimento, y el primer término da la interacción que vemos en el laboratorio (hasta pequeñas , correcciones finitas a partir de diagramas de bucle, que proporcionan elementos tan exóticos como las correcciones de alto orden del momento magnético ). El resto es el contratérmino. Si la teoría es renormalizable (ver más abajo para más información sobre esto), como lo es en QED, las partes divergentes de los diagramas de bucles se pueden descomponer en partes con tres o menos patas, con una forma algebraica que puede cancelarse con la segunda. término (o por los contratérminos similares que provienen de Z 0 y Z 3 ).

El diagrama con el vértice de interacción del contratérmino Z 1 colocado como en la Figura 3 anula la divergencia del bucle en la Figura 2.

Históricamente, la división de los "términos básicos" en términos originales y contratérminos se produjo antes de la idea del grupo de renormalización debida a Kenneth Wilson . [22] Según estas ideas del grupo de renormalización , que se detallan en la siguiente sección, esta división es antinatural y, de hecho, antifísica, ya que todas las escalas del problema entran de manera continua y sistemática.

Para minimizar la contribución de los diagramas de bucle a un cálculo dado (y por lo tanto facilitar la extracción de resultados), se elige un punto de renormalización cercano a las energías y momentos intercambiados en la interacción. Sin embargo, el punto de renormalización no es en sí mismo una cantidad física: las predicciones físicas de la teoría, calculadas para todos los órdenes, deberían en principio ser independientes de la elección del punto de renormalización, siempre que esté dentro del dominio de aplicación de la teoría. Los cambios en la escala de renormalización simplemente afectarán la cantidad de resultado que proviene de los diagramas de Feynman sin bucles y la cantidad que proviene de las partes finitas restantes de los diagramas de bucles. Se puede aprovechar este hecho para calcular la variación efectiva de constantes físicas con cambios de escala. Esta variación está codificada por funciones beta , y la teoría general de este tipo de dependencia de escala se conoce como grupo de renormalización .

Coloquialmente, los físicos de partículas a menudo hablan de ciertas "constantes" físicas que varían con la energía de interacción, aunque, de hecho, la escala de renormalización es la cantidad independiente. Sin embargo, esta ejecución proporciona un medio conveniente para describir cambios en el comportamiento de una teoría de campos bajo cambios en las energías involucradas en una interacción. Por ejemplo, dado que el acoplamiento en la cromodinámica cuántica se vuelve pequeño a grandes escalas de energía, la teoría se comporta más como una teoría libre a medida que la energía intercambiada en una interacción se vuelve grande, un fenómeno conocido como libertad asintótica . La elección de una escala de energía creciente y el uso del grupo de renormalización deja esto claro a partir de diagramas simples de Feynman; si no se hiciera esto, la predicción sería la misma, pero surgiría de cancelaciones complicadas de alto orden.

Por ejemplo,

está mal definido.

Para eliminar la divergencia, simplemente cambie el límite inferior de la integral a ε a y ε b :

Asegurándoseεb/ε un→ 1 , entonces yo = lna/b.

Dado que la cantidad ∞ − ∞ está mal definida, para que esta noción de cancelación de divergencias sea precisa, las divergencias primero deben controlarse matemáticamente utilizando la teoría de los límites , en un proceso conocido como regularización (Weinberg, 1995).

Una modificación esencialmente arbitraria de los integrandos del bucle, o regulador , puede hacer que caigan más rápido a altas energías y momentos, de tal manera que las integrales converjan. Un regulador tiene una escala de energía característica conocida como corte ; llevar este límite al infinito (o, de manera equivalente, la escala de longitud/tiempo correspondiente a cero) recupera las integrales originales.

Con el regulador implementado y un valor finito para el límite, los términos divergentes en las integrales se convierten en términos finitos pero dependientes del límite. Después de cancelar estos términos con las contribuciones de los contratérminos dependientes del límite, el límite se lleva al infinito y se recuperan los resultados físicos finitos. Si la física en escalas que podemos medir es independiente de lo que sucede en las escalas de tiempo y distancia más cortas, entonces debería ser posible obtener resultados de cálculo independientes de los límites.

En los cálculos de la teoría cuántica de campos se utilizan muchos tipos diferentes de reguladores, cada uno con sus ventajas y desventajas. Uno de los más populares en el uso moderno es la regularización dimensional , inventada por Gerardus 't Hooft y Martinus JG Veltman , [23] que domina las integrales llevándolas a un espacio con un número fraccionario ficticio de dimensiones. Otra es la regularización de Pauli-Villars , que añade partículas ficticias a la teoría con masas muy grandes, de modo que los integrandos de bucle que involucran partículas masivas anulan los bucles existentes en momentos grandes.

Otro esquema de regularización más es la regularización reticular , introducida por Kenneth Wilson , que pretende que una red hipercúbica construya nuestro espacio-tiempo con un tamaño de cuadrícula fijo. Este tamaño es un límite natural para el momento máximo que podría poseer una partícula cuando se propaga en la red. Y después de hacer un cálculo en varias redes con diferentes tamaños de cuadrícula, el resultado físico se extrapola al tamaño de cuadrícula 0, o nuestro universo natural. Esto presupone la existencia de un límite de escala .

Un enfoque matemático riguroso de la teoría de la renormalización es la llamada teoría de la perturbación causal , donde las divergencias ultravioleta se evitan desde el principio en los cálculos realizando operaciones matemáticas bien definidas solo dentro del marco de la teoría de la distribución . En este enfoque, las divergencias son reemplazadas por la ambigüedad: a un diagrama divergente corresponde un término que ahora tiene un coeficiente finito, pero indeterminado. Luego se deben utilizar otros principios, como la simetría de calibre, para reducir o eliminar la ambigüedad.

Julian Schwinger descubrió una relación [ cita necesaria ] entre la regularización y la renormalización de la función zeta , utilizando la relación asintótica:

como regulador Λ → ∞ . Con base en esto, consideró usar los valores de ζ (− n ) para obtener resultados finitos. Aunque alcanzó resultados inconsistentes, una fórmula mejorada estudiada por Hartle , J. García, y basada en los trabajos de E. Elizalde incluye la técnica del algoritmo de regularización zeta .

donde las B son los números de Bernoulli y

Entonces, cada I ( m , Λ) se puede escribir como una combinación lineal de ζ (−1), ζ (−3), ζ (−5), ..., ζ (− m ) .

O simplemente usando la fórmula de Abel-Plana tenemos para cada integral divergente:

válido cuando m > 0 . Aquí la función zeta es la función zeta de Hurwitz y Beta es un número real positivo.

La analogía "geométrica" viene dada por (si usamos el método del rectángulo ) para evaluar la integral de modo:

Usando la regularización zeta de Hurwitz más el método del rectángulo con el paso h (no confundir con la constante de Planck ).

La integral divergente logarítmica tiene la regularización

ya que para la serie Armónica en el límite debemos recuperar la serie

Para integrales de bucles múltiples que dependerán de varias variables, podemos hacer un cambio de variables a coordenadas polares y luego reemplazar la integral sobre los ángulos por una suma, de modo que solo tengamos una integral divergente, que dependerá del módulo y luego podemos Al aplicar el algoritmo de regularización zeta, la idea principal para las integrales de bucles múltiples es reemplazar el factor después de un cambio a las coordenadas hiperesféricas F ( r , Ω) para que las divergencias superpuestas de UV se codifiquen en la variable r . Para regularizar estas integrales se necesita un regulador; para el caso de integrales de múltiples bucles, estos reguladores se pueden tomar como

por lo que la integral de bucles múltiples convergerá para s lo suficientemente grande. Usando la regularización Zeta, podemos continuar analíticamente con la variable s hasta el límite físico donde s = 0 y luego regularizar cualquier integral UV, reemplazando una integral divergente por una combinación lineal de series divergentes. , que puede regularizarse en términos de los valores negativos de la función zeta de Riemann ζ (− m ) .

Los primeros formuladores de la QED y otras teorías cuánticas de campos estaban, por regla general, insatisfechos con esta situación. Parecía ilegítimo hacer algo equivalente a restar infinitos de infinitos para obtener respuestas finitas.

Freeman Dyson argumentó que estos infinitos son de naturaleza básica y no pueden eliminarse mediante ningún procedimiento matemático formal, como el método de renormalización. [24] [25]

La crítica de Dirac fue la más persistente. [26] Todavía en 1975, decía: [27]

Otro crítico importante fue Feynman . A pesar de su papel crucial en el desarrollo de la electrodinámica cuántica, escribió lo siguiente en 1985: [28]

A Feynman le preocupaba que todas las teorías de campo conocidas en la década de 1960 tuvieran la propiedad de que las interacciones se vuelven infinitamente fuertes en escalas de distancias suficientemente cortas. Esta propiedad, llamada polo de Landau , hacía posible que las teorías cuánticas de campos fueran todas inconsistentes. En 1974, Gross , Politzer y Wilczek demostraron que otra teoría cuántica de campos, la cromodinámica cuántica , no tiene un polo de Landau. Feynman, junto con la mayoría de los demás, aceptó que la QCD era una teoría totalmente consistente. [ cita necesaria ]

El malestar general fue casi universal en los textos hasta las décadas de 1970 y 1980. Sin embargo, a partir de la década de 1970, inspirados por el trabajo sobre el grupo de renormalización y la teoría de campo efectiva , y a pesar de que Dirac y varios otros (todos ellos pertenecientes a la generación anterior) nunca retiraron sus críticas, las actitudes comenzaron a cambiar, especialmente entre teóricos más jóvenes. Kenneth G. Wilson y otros demostraron que el grupo de renormalización es útil en la teoría estadística de campos aplicada a la física de la materia condensada , donde proporciona importantes conocimientos sobre el comportamiento de las transiciones de fase . En la física de la materia condensada existe un regulador físico de corta distancia: la materia deja de ser continua en la escala de los átomos . Las divergencias de corta distancia en la física de la materia condensada no presentan un problema filosófico, ya que de todos modos la teoría de campos es sólo una representación eficaz y suavizada del comportamiento de la materia; no hay infinitos ya que el límite es siempre finito, y tiene mucho sentido que las cantidades básicas dependan del límite.

Si QFT se mantiene hasta más allá de la longitud de Planck (donde podría ceder a la teoría de cuerdas , la teoría de conjuntos causales o algo diferente), entonces puede que tampoco haya un problema real con las divergencias de corta distancia en la física de partículas ; todas las teorías de campo podrían ser simplemente teorías de campo efectivas. En cierto sentido, este enfoque se hace eco de la antigua actitud de que las divergencias en QFT hablan de ignorancia humana sobre el funcionamiento de la naturaleza, pero también reconoce que esta ignorancia puede cuantificarse y que las teorías efectivas resultantes siguen siendo útiles.

Sea como fuere, la observación de Salam [29] en 1972 parece todavía relevante

En QFT, el valor de una constante física, en general, depende de la escala que se elige como punto de renormalización, y resulta muy interesante examinar el funcionamiento del grupo de renormalización de constantes físicas bajo cambios en la escala de energía. Las constantes de acoplamiento en el modelo estándar de física de partículas varían de diferentes maneras al aumentar la escala de energía: el acoplamiento de la cromodinámica cuántica y el acoplamiento de isospin débil de la fuerza electrodébil tienden a disminuir, y el acoplamiento de hipercarga débil de la fuerza electrodébil tiende a aumentar. En la colosal escala de energía de 10 15 GeV (mucho más allá del alcance de nuestros actuales aceleradores de partículas ), todos adquieren aproximadamente el mismo tamaño (Grotz y Klapdor 1990, p. 254), una motivación importante para las especulaciones sobre la gran teoría unificada . En lugar de ser sólo un problema preocupante, la renormalización se ha convertido en una importante herramienta teórica para estudiar el comportamiento de las teorías de campo en diferentes regímenes.

Si una teoría que presenta renormalización (por ejemplo, QED) sólo puede interpretarse sensatamente como una teoría de campo efectiva, es decir, como una aproximación que refleja la ignorancia humana sobre el funcionamiento de la naturaleza, entonces persiste el problema de descubrir una teoría más precisa que no tenga estos problemas de renormalización. . Como lo expresó Lewis Ryder : "En la teoría cuántica, estas divergencias [clásicas] no desaparecen; por el contrario, parecen empeorar. Y a pesar del éxito comparativo de la teoría de la renormalización, persiste la sensación de que debería haber una forma más satisfactoria de hacer las cosas". [31]

De esta reevaluación filosófica, surge naturalmente un nuevo concepto: la noción de renormalizabilidad. No todas las teorías se prestan a una renormalización de la manera descrita anteriormente, con un suministro finito de contratérminos y todas las cantidades se vuelven independientes del límite al final del cálculo. Si el lagrangiano contiene combinaciones de operadores de campo de dimensión suficientemente alta en unidades de energía, los contratérminos necesarios para cancelar todas las divergencias proliferan hasta un número infinito y, a primera vista, la teoría parecería ganar un número infinito de parámetros libres y, por tanto, perder todos. poder predictivo, volviéndose científicamente inútil. Estas teorías se denominan no renormalizables .

El modelo estándar de física de partículas contiene sólo operadores renormalizables, pero las interacciones de la relatividad general se convierten en operadores no renormalizables si se intenta construir una teoría de campo de la gravedad cuántica de la manera más directa (tratando la métrica del lagrangiano de Einstein-Hilbert como una perturbación sobre la métrica de Minkowski ), lo que sugiere que la teoría de la perturbación no es satisfactoria en su aplicación a la gravedad cuántica.

Sin embargo, en una teoría de campo eficaz , "renormalizabilidad" es, estrictamente hablando, un nombre inapropiado . En la teoría de campos efectivos no renormalizable, los términos en lagrangiano se multiplican hasta el infinito, pero tienen coeficientes suprimidos por potencias inversas cada vez más extremas del corte de energía. Si el límite es una cantidad física real, es decir, si la teoría es sólo una descripción efectiva de la física hasta una escala de energía máxima o distancia mínima, entonces estos términos adicionales podrían representar interacciones físicas reales. Suponiendo que las constantes adimensionales en la teoría no sean demasiado grandes, se pueden agrupar los cálculos por potencias inversas del límite y extraer predicciones aproximadas de orden finito en el límite que todavía tengan un número finito de parámetros libres. Incluso puede resultar útil renormalizar estas interacciones "no renormalizables".

Las interacciones no renormalizables en las teorías de campos efectivas se debilitan rápidamente a medida que la escala de energía se vuelve mucho más pequeña que el límite. El ejemplo clásico es la teoría de Fermi de la fuerza nuclear débil , una teoría efectiva no renormalizable cuyo límite es comparable a la masa de la partícula W. Este hecho también puede proporcionar una posible explicación de por qué casi todas las interacciones entre partículas que vemos se pueden describir mediante teorías renormalizables. Puede ser que cualquier otro que pueda existir en la escala GUT o Planck simplemente se vuelva demasiado débil para detectarlo en el ámbito que podemos observar, con una excepción: la gravedad , cuya interacción extremadamente débil se magnifica por la presencia de enormes masas de estrellas y planetas . [ cita necesaria ]

En los cálculos reales, los contratérminos introducidos para cancelar las divergencias en los cálculos del diagrama de Feynman más allá del nivel del árbol deben fijarse mediante un conjunto de condiciones de renormalización . Los esquemas de renormalización comunes en uso incluyen:

Además, existe una definición "natural" del acoplamiento renormalizado (combinado con el propagador de fotones) como un propagador de bosones libres duales, que no requiere explícitamente la introducción de contratérminos. [32]

Una comprensión más profunda del significado físico y la generalización del proceso de renormalización, que va más allá del grupo de dilatación de las teorías renormalizables convencionales , provino de la física de la materia condensada. El artículo de Leo P. Kadanoff de 1966 propuso el grupo de renormalización "bloque-giro". [33] La idea de bloqueo es una forma de definir los componentes de la teoría a grandes distancias como agregados de componentes a distancias más cortas.

Este enfoque cubrió el punto conceptual y recibió sustancia computacional completa [22] en las extensas e importantes contribuciones de Kenneth Wilson . El poder de las ideas de Wilson quedó demostrado mediante una solución constructiva de renormalización iterativa de un problema de larga data, el problema de Kondo , en 1974, así como los desarrollos fundamentales precedentes de su nuevo método en la teoría de las transiciones de fase de segundo orden y los fenómenos críticos. en 1971. Por estas decisivas contribuciones recibió el premio Nobel en 1982.

En términos más técnicos, supongamos que tenemos una teoría descrita por una determinada función de las variables de estado y un determinado conjunto de constantes de acoplamiento . Esta función puede ser una función de partición , una acción , un hamiltoniano , etc. Debe contener la descripción completa de la física del sistema.

Ahora consideramos una cierta transformación de bloqueo de las variables de estado , el número de debe ser menor que el número de . Ahora intentemos reescribir la función sólo en términos de . Si esto se puede lograr mediante un cierto cambio en los parámetros, entonces se dice que la teoría es renormalizable .

Los posibles estados macroscópicos del sistema, a gran escala, vienen dados por este conjunto de puntos fijos.

La información más importante en el flujo RG son sus puntos fijos . Un punto fijo está definido por la desaparición de la función beta asociada al flujo. Entonces, los puntos fijos del grupo de renormalización son, por definición, invariantes de escala. En muchos casos de invariancia de escala de interés físico se amplía a invariancia conforme. Entonces se tiene una teoría de campos conforme en el punto fijo.

La capacidad de varias teorías para fluir hacia el mismo punto fijo conduce a la universalidad .

Si estos puntos fijos corresponden a la teoría del campo libre, se dice que la teoría exhibe trivialidad cuántica . Numerosos puntos fijos aparecen en el estudio de las teorías de la red de Higgs , pero la naturaleza de las teorías cuánticas de campos asociadas con ellos sigue siendo una cuestión abierta. [34]