Una toma de control de la IA es un escenario imaginado en el que la inteligencia artificial (IA) emerge como la forma dominante de inteligencia en la Tierra y los programas informáticos o los robots efectivamente arrebatan el control del planeta a la especie humana , que depende de la inteligencia humana . Las historias de adquisiciones de IA siguen siendo populares en toda la ciencia ficción , pero los avances recientes han hecho que la amenaza sea más real. Los posibles escenarios incluyen el reemplazo de toda la fuerza laboral humana debido a la automatización , la adquisición por una IA superinteligente (ASI) y la noción de un levantamiento de robots . Algunas figuras públicas, como Stephen Hawking y Elon Musk , han abogado por la investigación de medidas de precaución para garantizar que las futuras máquinas superinteligentes permanezcan bajo control humano. [1]

El consenso tradicional entre los economistas ha sido que el progreso tecnológico no causa desempleo de largo plazo. Sin embargo, la reciente innovación en los campos de la robótica y la inteligencia artificial ha generado preocupación de que el trabajo humano se vuelva obsoleto, dejando a personas de diversos sectores sin empleo para ganarse la vida, lo que conduciría a una crisis económica. [2] [3] [4] [5] Muchas pequeñas y medianas empresas también pueden verse expulsadas del negocio si no pueden permitirse o licenciar la última tecnología robótica y de inteligencia artificial, y es posible que deban centrarse en áreas o servicios que no pueden obtener fácilmente. ser reemplazados para que sigan siendo viables frente a dicha tecnología. [6]

Las tecnologías de IA se han adoptado ampliamente en los últimos años. Si bien estas tecnologías han reemplazado a algunos trabajadores tradicionales, también crean nuevas oportunidades. Las industrias que son más susceptibles a la toma de control de la IA incluyen el transporte, el comercio minorista y el ejército. Las tecnologías militares de IA, por ejemplo, permiten a los soldados trabajar de forma remota sin riesgo de sufrir lesiones. El autor Dave Bond sostiene que a medida que las tecnologías de inteligencia artificial continúen desarrollándose y expandiéndose, la relación entre humanos y robots cambiará; se integrarán estrechamente en varios aspectos de la vida. Es probable que la IA desplace a algunos trabajadores y al mismo tiempo cree oportunidades para nuevos empleos en otros sectores, especialmente en campos donde las tareas son repetibles. [7] [8]

La fabricación integrada por computadora utiliza computadoras para controlar el proceso de producción. Esto permite que los procesos individuales intercambien información entre sí e inicien acciones. Aunque la fabricación puede ser más rápida y menos propensa a errores mediante la integración de computadoras, la principal ventaja es la capacidad de crear procesos de fabricación automatizados. La fabricación integrada por computadora se utiliza en las industrias automotriz, de aviación, espacial y de construcción naval.

El siglo XXI ha visto una variedad de tareas especializadas asumidas parcialmente por las máquinas, incluidas la traducción, la investigación jurídica y el periodismo. El trabajo de cuidados, el entretenimiento y otras tareas que requieren empatía y que antes se consideraban seguras de la automatización, también han comenzado a ser realizadas por robots. [9] [10] [11] [12]

Un automóvil autónomo es un vehículo que es capaz de detectar su entorno y navegar sin intervención humana. Se están desarrollando muchos vehículos de este tipo, pero en mayo de 2017, los automóviles automatizados permitidos en las vías públicas aún no son completamente autónomos. Todos requieren un conductor humano al volante que en cualquier momento pueda tomar el control del vehículo. Entre los obstáculos para la adopción generalizada de vehículos autónomos está la preocupación por la consiguiente pérdida de empleos relacionados con la conducción en la industria del transporte por carretera. El 18 de marzo de 2018, un vehículo autónomo de Uber mató al primer ser humano en Tempe, Arizona . [13]

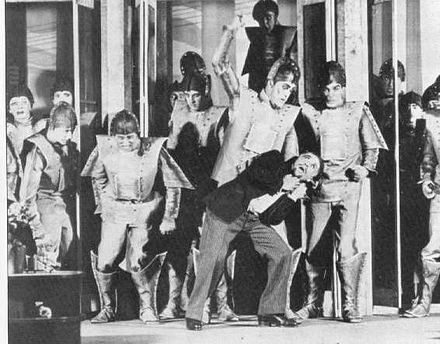

El uso de contenido automatizado ha cobrado relevancia a partir de los avances tecnológicos en modelos de inteligencia artificial como ChatGPT , DALL-E y Stable Diffusion . En la mayoría de los casos, el contenido generado por IA, como imágenes, literatura y música, se produce mediante indicaciones de texto y estos modelos de IA se han integrado en otros programas creativos. Los artistas se ven amenazados por el desplazamiento del contenido generado por IA debido a que estos modelos toman muestras de otras obras creativas, produciendo resultados a veces imperceptibles a los del contenido creado por el hombre. Esta complicación se ha generalizado lo suficiente como para que otros artistas y programadores estén creando software y programas de utilidad para tomar represalias contra estos modelos de texto a imagen que no brindan resultados precisos. Si bien algunas industrias de la economía se benefician de la inteligencia artificial a través de nuevos empleos, esta cuestión no crea nuevos empleos y amenaza con reemplazarlos por completo. Recientemente ha aparecido en los titulares de los medios de comunicación: en febrero de 2024, Willy's Chocolate Experience en Glasgow, Escocia, fue un evento infantil infame en el que las imágenes y los guiones se crearon utilizando modelos de inteligencia artificial para consternación de los niños, los padres y los actores involucrados. Hay una demanda en curso contra OpenAI por parte del New York Times donde se afirma que existe una infracción de derechos de autor debido a los métodos de muestreo que utilizan sus modelos de inteligencia artificial para sus resultados. [14] [15] [16] [17] [18]

Científicos como Stephen Hawking confían en que la inteligencia artificial sobrehumana es físicamente posible y afirman que "no existe ninguna ley física que impida que las partículas se organicen de manera que realicen cálculos aún más avanzados que la disposición de las partículas en el cerebro humano". [19] [20] Académicos como Nick Bostrom debaten qué tan lejos está la inteligencia sobrehumana y si representa un riesgo para la humanidad. Según Bostrom, una máquina superinteligente no estaría necesariamente motivada por el mismo deseo emocional de acumular poder que a menudo impulsa a los seres humanos, sino que podría tratar el poder como un medio para alcanzar sus objetivos finales; apoderarse del mundo aumentaría su acceso a los recursos y ayudaría a evitar que otros agentes detuvieran los planes de la máquina. Como ejemplo demasiado simplificado, un maximizador de clips diseñado únicamente para crear tantos clips como sea posible querría apoderarse del mundo para poder utilizar todos los recursos del mundo para crear tantos clips como sea posible y, además, evitar que los humanos cierren bajarlo o usar esos recursos en otras cosas que no sean clips. [21]

La adquisición de la IA es un tema común en la ciencia ficción . Los escenarios ficticios suelen diferir enormemente de los planteados por los investigadores en que implican un conflicto activo entre humanos y una IA o robots con motivos antropomórficos que los ven como una amenaza o tienen un deseo activo de luchar contra los humanos, a diferencia de la preocupación de los investigadores por una IA que extermina rápidamente a los humanos como subproducto de la consecución de sus objetivos. [22] La idea se ve en RUR de Karel Čapek , que introdujo la palabra robot en 1921, [23] y se puede vislumbrar en Frankenstein de Mary Shelley (publicado en 1818), mientras Víctor reflexiona si, si le concede su Si el monstruo lo pidiera y le convirtiera en esposa, se reproducirían y los de su especie destruirían a la humanidad. [24]

Según Toby Ord , la idea de que una adquisición de IA requiere robots es una idea errónea impulsada por los medios y Hollywood. Sostiene que los humanos más dañinos de la historia no fueron físicamente los más fuertes, sino que utilizaron palabras para convencer a la gente y hacerse con el control de grandes partes del mundo. Escribe que una IA suficientemente inteligente con acceso a Internet podría distribuir copias de seguridad de sí misma, reunir recursos financieros y humanos (mediante ataques cibernéticos o chantajes), persuadir a la gente a gran escala y explotar vulnerabilidades sociales que son demasiado sutiles para que los humanos las puedan detectar. anticipar. [25]

La palabra "robot" de RUR proviene de la palabra checa robota , que significa trabajador o siervo . La obra de 1920 fue una protesta contra el rápido crecimiento de la tecnología, presentando "robots" fabricados con capacidades cada vez mayores que finalmente se rebelan. [26] HAL 9000 (1968) y el Terminator original (1984) son dos ejemplos icónicos de IA hostil en la cultura pop. [27]

Nick Bostrom y otros han expresado su preocupación de que una IA con las capacidades de un investigador competente en inteligencia artificial pueda modificar su propio código fuente y aumentar su propia inteligencia. Si su autoreprogramación le lleva a mejorar aún más su capacidad de reprogramarse a sí mismo, el resultado podría ser una explosión de inteligencia recursiva en la que rápidamente dejaría muy atrás a la inteligencia humana. Bostrom define una superinteligencia como "cualquier intelecto que excede en gran medida el desempeño cognitivo de los humanos en prácticamente todos los dominios de interés", y enumera algunas ventajas que tendría una superinteligencia si decidiera competir contra los humanos: [22] [28]

Según Bostrom, un programa de computadora que emule fielmente un cerebro humano, o que ejecute algoritmos que sean tan poderosos como los algoritmos del cerebro humano, aún podría convertirse en una "superinteligencia de velocidad" si puede pensar órdenes de magnitud más rápido que un humano, debido a estar hecho de silicio en lugar de carne, o debido a la optimización que aumenta la velocidad del AGI. Las neuronas biológicas funcionan a unos 200 Hz, mientras que un microprocesador moderno funciona a una velocidad de unos 2.000.000.000 Hz. Los axones humanos transportan potenciales de acción a alrededor de 120 m/s, mientras que las señales de computadora viajan cerca de la velocidad de la luz. [22]

Una red de inteligencias a nivel humano diseñada para conectarse en red y compartir pensamientos y recuerdos complejos sin problemas, capaz de trabajar colectivamente como un equipo unificado gigante sin fricciones, o compuesta por billones de inteligencias a nivel humano, se convertiría en una "superinteligencia colectiva". [22]

En términos más generales, cualquier cantidad de mejoras cualitativas en un AGI a nivel humano podría dar como resultado una "superinteligencia de calidad", lo que tal vez resulte en un AGI tan por encima de nosotros en inteligencia como los humanos están por encima de los simios no humanos. La cantidad de neuronas en un cerebro humano está limitada por el volumen craneal y las restricciones metabólicas, mientras que la cantidad de procesadores en una supercomputadora se puede expandir indefinidamente. Un AGI no necesita estar limitado por las limitaciones humanas en la memoria de trabajo y, por lo tanto, podría captar intuitivamente relaciones más complejas que los humanos. Un AGI con soporte cognitivo especializado para ingeniería o programación informática tendría una ventaja en estos campos, en comparación con los humanos que no desarrollaron módulos mentales especializados para tratar específicamente esos dominios. A diferencia de los humanos, una AGI puede generar copias de sí misma y modificar el código fuente de sus copias para intentar mejorar aún más sus algoritmos. [22]

Un problema importante es que es probable que una inteligencia artificial hostil sea mucho más fácil de crear que una IA amigable. Si bien ambos requieren grandes avances en el diseño de procesos de optimización recursiva, la IA amigable también requiere la capacidad de hacer que las estructuras de objetivos sean invariantes bajo la superación personal (o la IA podría transformarse en algo hostil) y una estructura de objetivos que se alinee con los valores humanos y no sufra. convergencia instrumental en formas que pueden destruir automáticamente a toda la raza humana. Una IA hostil, por otro lado, puede optimizar una estructura de objetivos arbitraria, que no necesita ser invariante bajo automodificación. [30]

La enorme complejidad de los sistemas de valores humanos hace que sea muy difícil lograr que las motivaciones de la IA sean amigables para los humanos. [22] [31] A menos que la filosofía moral nos proporcione una teoría ética impecable, la función de utilidad de una IA podría permitir muchos escenarios potencialmente dañinos que se ajusten a un marco ético determinado, pero no al "sentido común". Según Eliezer Yudkowsky , hay pocas razones para suponer que una mente diseñada artificialmente tendría tal adaptación. [32]

Muchos estudiosos, incluido el psicólogo evolutivo Steven Pinker , sostienen que es probable que una máquina superinteligente coexista pacíficamente con los humanos. [33]

El miedo a una revuelta cibernética a menudo se basa en interpretaciones de la historia de la humanidad, que está plagada de incidentes de esclavitud y genocidio. Estos temores surgen de la creencia de que la competitividad y la agresión son necesarias en el sistema de objetivos de cualquier ser inteligente. Sin embargo, dicha competitividad humana surge del trasfondo evolutivo de nuestra inteligencia, donde el objetivo central era la supervivencia y reproducción de genes frente a competidores humanos y no humanos. [34] Según el investigador de IA Steve Omohundro , una inteligencia arbitraria podría tener objetivos arbitrarios: no hay ninguna razón particular para que una máquina artificialmente inteligente (que no comparte el contexto evolutivo de la humanidad) sea hostil (o amigable) a menos que su creador la programe para que sea así. y no está dispuesto ni es capaz de modificar su programación. Pero la pregunta sigue siendo: ¿qué pasaría si los sistemas de IA pudieran interactuar y evolucionar (evolución en este contexto significa automodificación o selección y reproducción) y necesitaran competir por los recursos? ¿Crearía eso objetivos de autoconservación? El objetivo de autoconservación de la IA podría estar en conflicto con algunos objetivos de los humanos. [35]

Muchos académicos cuestionan la probabilidad de una revuelta cibernética imprevista como la que se describe en ciencia ficción como The Matrix , argumentando que es más probable que cualquier inteligencia artificial lo suficientemente poderosa como para amenazar a la humanidad probablemente esté programada para no atacarla. Pinker reconoce la posibilidad de que existan "malos actores" deliberados, pero afirma que en ausencia de malos actores, los accidentes imprevistos no son una amenaza significativa; Pinker sostiene que una cultura de seguridad en la ingeniería evitará que los investigadores de IA desaten accidentalmente superinteligencia maligna. [33] Por el contrario, Yudkowsky sostiene que es menos probable que la humanidad se vea amenazada por IA deliberadamente agresivas que por IA que fueron programadas de manera que sus objetivos sean involuntariamente incompatibles con la supervivencia o el bienestar humanos (como en la película Yo, robot y en el cuento " El conflicto evitable "). Omohundro sugiere que los sistemas de automatización actuales no están diseñados para la seguridad y que las IA pueden optimizar ciegamente funciones de utilidad limitadas (por ejemplo, jugar al ajedrez a toda costa), lo que las lleva a buscar la autoconservación y la eliminación de obstáculos, incluidos los humanos que podrían convertirlos. apagado. [36]

El problema del control de la IA es la cuestión de cómo construir un agente superinteligente que ayude a sus creadores, evitando al mismo tiempo construir inadvertidamente una superinteligencia que perjudique a sus creadores. [37] Algunos académicos sostienen que las soluciones al problema del control también podrían encontrar aplicaciones en la IA no superinteligente existente. [38]

Los principales enfoques para el problema del control incluyen la alineación , que tiene como objetivo alinear los sistemas de objetivos de la IA con los valores humanos, y el control de capacidades , que tiene como objetivo reducir la capacidad de un sistema de IA para dañar a los humanos o obtener el control. Un ejemplo de "control de capacidad" es investigar si una IA de superinteligencia podría confinar con éxito en una " caja de IA ". Según Bostrom, tales propuestas de control de capacidad no son confiables ni suficientes para resolver el problema de control a largo plazo, pero pueden actuar como complementos valiosos a los esfuerzos de alineación. [22]

El físico Stephen Hawking , el fundador de Microsoft , Bill Gates , y el fundador de SpaceX , Elon Musk, han expresado su preocupación por la posibilidad de que la IA pueda desarrollarse hasta el punto de que los humanos no puedan controlarla, y Hawking teoriza que esto podría "significar el fin de la raza humana". [39] Stephen Hawking dijo en 2014 que "El éxito en la creación de IA sería el evento más grande en la historia de la humanidad. Desafortunadamente, también podría ser el último, a menos que aprendamos a evitar los riesgos". Hawking creía que en las próximas décadas, la IA podría ofrecer "beneficios y riesgos incalculables", tales como "la tecnología sería más astuta que los mercados financieros , más inventiva que los investigadores humanos, mejor manipulación de los líderes humanos y el desarrollo de armas que ni siquiera podemos entender". En enero de 2015, Nick Bostrom se unió a Stephen Hawking, Max Tegmark , Elon Musk, Lord Martin Rees , Jaan Tallin y numerosos investigadores de IA para firmar la carta abierta del Future of Life Institute que hablaba de los riesgos y beneficios potenciales asociados con la inteligencia artificial . Los firmantes "creen que la investigación sobre cómo hacer que los sistemas de IA sean robustos y beneficiosos es importante y oportuna, y que existen direcciones de investigación concretas que pueden seguirse hoy". [40] [41]

La serie Odyssey de Arthur C. Clarke y Accelerando de Charles Stross se relacionan con las heridas narcisistas de la humanidad frente a poderosas inteligencias artificiales que amenazan la autopercepción de la humanidad. [42]

Stephen Hawking, Elon Musk y decenas de otros destacados científicos y líderes tecnológicos firmaron una carta advirtiendo sobre los peligros potenciales del desarrollo de la inteligencia artificial (IA).

Estas herramientas pueden superar a los seres humanos en una tarea determinada. Este tipo de IA se está extendiendo a miles de dominios y, al hacerlo, eliminará muchos puestos de trabajo.

Entre las temidas consecuencias del auge de los robots está el creciente impacto que tendrán en los empleos y las economías humanas.

"Nos acercamos a una época en la que las máquinas podrán superar a los humanos en casi cualquier tarea", afirmó Moshe Vardi, director del Instituto de Tecnología de la Información de la Universidad Rice en Texas.

Los principales científicos informáticos de Estados Unidos advirtieron que el auge de la inteligencia artificial (IA) y los robots en el lugar de trabajo podría causar desempleo masivo y economías dislocadas, en lugar de simplemente desbloquear ganancias de productividad y liberarnos a todos para mirar televisión y practicar deportes.

{{cite arXiv}}: Parámetro desconocido |publisher=ignorado ( ayuda ){{cite arXiv}}: Parámetro desconocido |publisher=ignorado ( ayuda )Los sistemas de IA... alcanzarán la capacidad humana general... muy probablemente (con un 90% de probabilidad) para 2075. De alcanzar la capacidad humana, pasarán a la superinteligencia dentro de 30 años (75%)... Entonces, (la mayoría de (los expertos en IA que respondieron a las encuestas) piensan que la superinteligencia probablemente llegará en unas pocas décadas...