Los ataques de desinformación son campañas estratégicas de engaño [1] que involucran la manipulación de los medios y la manipulación de Internet , [2] para difundir información engañosa , [3] con el objetivo de confundir , paralizar y polarizar a una audiencia . [4] La desinformación puede considerarse un ataque cuando ocurre como una campaña narrativa adversa que utiliza múltiples estrategias retóricas y formas de conocimiento, incluidas no solo falsedades sino también verdades, medias verdades y juicios cargados de valores, para explotar y amplificar la identidad. -controversias impulsadas. [5] Los ataques de desinformación utilizan la manipulación de los medios para atacar a los medios de difusión como canales de televisión y radios patrocinados por el estado. [6] [7] Debido al uso cada vez mayor de manipulación de Internet en las redes sociales , [2] pueden considerarse una amenaza cibernética . [8] [9] Las herramientas digitales como bots , algoritmos y tecnología de inteligencia artificial , junto con agentes humanos, incluidos personas influyentes , difunden y amplifican la desinformación entre poblaciones microobjetivo en plataformas en línea como Instagram , Twitter , Google , Facebook y YouTube . [10] [5]

Según un informe de 2018 de la Comisión Europea , [11] los ataques de desinformación pueden representar amenazas a la gobernabilidad democrática , al disminuir la legitimidad de la integridad de los procesos electorales . Los ataques de desinformación son utilizados por y contra gobiernos , corporaciones , científicos, periodistas, activistas y otros individuos privados. [12] [13] [14] [15] Estos ataques se emplean comúnmente para remodelar actitudes y creencias, impulsar una agenda particular o provocar ciertas acciones de una audiencia objetivo. Las tácticas incluyen hacer circular información incorrecta o engañosa, crear incertidumbre y socavar la legitimidad de las fuentes de información oficiales. [16] [17] [18]

Un área de investigación emergente se centra en las contramedidas a los ataques de desinformación. [19] [20] [18] Tecnológicamente, las medidas defensivas incluyen aplicaciones de aprendizaje automático que pueden detectar desinformación en plataformas digitales . [17] Socialmente, también se están desarrollando programas educativos para enseñar a las personas cómo discernir mejor entre hechos y desinformación en línea [21] y recomendaciones de periodistas para evaluar las fuentes. [22] Comercialmente se proponen revisiones de algoritmos, publicidad y prácticas de influencia en plataformas digitales. [2] Las intervenciones individuales incluyen acciones que los individuos pueden tomar para mejorar sus propias habilidades para manejar la información (por ejemplo, alfabetización mediática ) y acciones individuales para desafiar la desinformación. [23]

Los ataques de desinformación implican la difusión intencional de información falsa, con el objetivo final de engañar, confundir o manipular a otros [4] para ganar dinero, poder o reputación. [24] Pueden involucrar actores políticos, económicos e individuales. Pueden intentar influir en actitudes y creencias, impulsar una agenda específica, lograr que la gente actúe de maneras específicas o destruir la credibilidad de individuos o instituciones. La presentación de información incorrecta puede ser la parte más obvia de un ataque de desinformación, pero no es el único propósito. A menudo también se pretende crear incertidumbre y socavar tanto la información correcta como la credibilidad de las fuentes de información. [16] [17] [18]

Si se puede convencer a los individuos de algo que es objetivamente incorrecto, es posible que tomen decisiones que de hecho van en contra de sus mejores intereses y los de quienes los rodean. Si se puede convencer a la mayoría de las personas de una sociedad de algo que es objetivamente incorrecto, la desinformación puede conducir a decisiones políticas y sociales que no redundan en el mejor interés de esa sociedad. Esto puede tener graves impactos tanto a nivel individual como social. [25]

En la década de 1990, un médico británico que poseía una patente sobre una vacuna contra el sarampión de inyección única promovió la desconfianza hacia la vacuna triple triple vírica combinada . Sus afirmaciones fraudulentas estaban destinadas a promover las ventas de su propia vacuna. El posterior frenesí mediático aumentó el miedo y muchos padres optaron por no vacunar a sus hijos. [26] A esto le siguió un aumento significativo de casos, hospitalizaciones y muertes que se habrían evitado con la vacuna MMR. [27] [28] También condujo al gasto de dinero sustancial en investigaciones de seguimiento que probaron las afirmaciones hechas en la desinformación, [29] y en campañas de información pública que intentaban corregir la desinformación. Se sigue haciendo referencia a la afirmación fraudulenta y esto aumenta las dudas sobre las vacunas . [30]

En el caso de las elecciones presidenciales de Estados Unidos de 2020 , se utilizó desinformación en un intento de convencer a la gente de creer algo que no era cierto y cambiar el resultado de las elecciones. [31] [32] Se introdujeron repetidos mensajes de desinformación sobre la posibilidad de fraude electoral años antes de que ocurrieran las elecciones reales, ya en 2016. [33] [34] Los investigadores descubrieron que muchas de las noticias falsas se originaron en grupos nacionales de derecha. . La organización no partidista Election Integrity Partnership informó antes de las elecciones que "Lo que estamos viendo ahora son esencialmente semillas que se están plantando, docenas de semillas cada día, de historias falsas... Todas se están plantando de tal manera que podrían ser citadas y reactivado... después de las elecciones." [35] Se sentaron las bases mediante múltiples y repetidos ataques de desinformación por afirmaciones de que la votación fue injusta y para deslegitimar los resultados de las elecciones una vez que ocurrieron. [35] Aunque se confirmaron los resultados de las elecciones presidenciales de Estados Unidos de 2020 , algunas personas todavía creen en la " gran mentira ". [32]

Las personas que obtienen información de una variedad de fuentes de noticias, no sólo de fuentes desde un punto de vista particular, tienen más probabilidades de detectar desinformación. [36] Los consejos para detectar desinformación incluyen leer fuentes de noticias confiables a nivel local o nacional, en lugar de depender de las redes sociales. Tenga cuidado con los titulares sensacionalistas que pretenden llamar la atención y despertar emociones. Verifique la información de manera amplia, no solo en una plataforma habitual o entre amigos. Consulta la fuente original de la información. Pregunte qué se dijo realmente, quién lo dijo y cuándo. Considere posibles agendas o conflictos de intereses por parte del orador o de quienes transmiten la información. [37] [38] [39] [40] [41]

A veces, socavar la creencia en la información correcta es un objetivo más importante de la desinformación que convencer a las personas de que mantengan una nueva creencia. En el caso de las vacunas combinadas MMR, la desinformación originalmente tenía como objetivo convencer a las personas de una afirmación fraudulenta específica y, al hacerlo, promover las ventas de un producto competidor. [26] Sin embargo, el impacto de la desinformación se hizo mucho más amplio. El temor de que un tipo de vacuna pudiera representar un peligro alimentó los temores generales de que las vacunas pudieran representar un riesgo. En lugar de convencer a la gente de que eligiera un producto sobre otro, se erosionó la creencia en toda un área de la investigación médica. [30]

Existe un acuerdo generalizado en que la desinformación está generando confusión. [42] Esto no es sólo un efecto secundario; confundir y abrumar a la gente es un objetivo intencional. [43] [44] Ya sea que los ataques de desinformación se utilicen contra oponentes políticos o contra "ciencia comercialmente inconveniente", siembran dudas e incertidumbre como una forma de socavar el apoyo a una posición opuesta e impedir una acción efectiva. [45]

Un artículo de 2016 describe las tácticas de desinformación política impulsadas por las redes sociales como una "manguera de falsedad" que "entretiene, confunde y abruma a la audiencia". [46] Se ilustraron cuatro características con respecto a la propaganda rusa. La desinformación se utiliza de una manera que es 1) de gran volumen y multicanal 2) continua y repetitiva 3) ignora la realidad objetiva y 4) ignora la coherencia. Se vuelve eficaz creando confusión y oscureciendo, perturbando y disminuyendo la verdad. Cuando se expone una falsedad, "los propagandistas la descartan y pasan a una nueva explicación (aunque no necesariamente más plausible)". [46] El propósito no es convencer a la gente de una narrativa específica, sino "Negar, desviar, distraer". [47]

Contrarrestar esto es difícil, en parte porque "lleva menos tiempo inventar hechos que verificarlos". [46] Existe evidencia de que las "cascadas" de información falsa viajan más lejos, más rápido y más ampliamente que la información veraz, tal vez debido a la novedad y la carga emocional. [48] Tratar de luchar contra una hidra de desinformación de muchas cabezas puede ser menos eficaz que crear conciencia sobre cómo funciona la desinformación y cómo identificarla, antes de que se produzca un ataque. [46] Por ejemplo, Ucrania pudo advertir a los ciudadanos y periodistas sobre el posible uso de deepfakes patrocinados por el estado antes de un ataque real, lo que probablemente ralentizó su propagación. [49]

Otra forma de contrarrestar la desinformación es centrarse en identificar y contrarrestar su objetivo real. [46] Por ejemplo, si la desinformación intenta disuadir a los votantes, encontrar formas de empoderarlos y elevar información autorizada sobre cuándo, dónde y cómo votar. [50] Si se presentan denuncias de fraude electoral, proporcione mensajes claros sobre cómo se produce el proceso de votación y remita a las personas a fuentes acreditadas que puedan abordar sus inquietudes. [51]

La desinformación implica algo más que una simple competencia entre información precisa e inexacta. La desinformación, los rumores y las teorías de conspiración ponen en duda la confianza subyacente en múltiples niveles. El socavamiento de la confianza puede estar dirigido a científicos, gobiernos y medios de comunicación y tener consecuencias muy reales. La confianza pública en la ciencia es esencial para el trabajo de los formuladores de políticas y para la buena gobernanza, particularmente en cuestiones de medicina, salud pública y ciencias ambientales. Es fundamental que las personas, las organizaciones y los gobiernos tengan acceso a información precisa a la hora de tomar decisiones. [13] [14]

Un ejemplo es la desinformación sobre las vacunas COVID-19. La desinformación se ha dirigido a los productos mismos, a los investigadores y organizaciones que los desarrollaron, a los profesionales y organizaciones de la salud que los administran, y a los responsables políticos que han apoyado su desarrollo y aconsejado su uso. [13] [52] [53] Los países donde los ciudadanos tenían niveles más altos de confianza en la sociedad y el gobierno parecen haberse movilizado más eficazmente contra el virus, según lo medido por una propagación más lenta del virus y tasas de mortalidad más bajas. [54]

Los estudios sobre las creencias de las personas sobre la cantidad de desinformación y desinformación en los medios de comunicación sugieren que la desconfianza en los medios de noticias tradicionales tiende a estar asociada con la dependencia de fuentes de información alternativas, como las redes sociales. El apoyo estructural a las libertades de prensa, una prensa independiente más fuerte y evidencia de la credibilidad y honestidad de la prensa pueden ayudar a restaurar la confianza en los medios tradicionales como proveedores de información independiente, honesta y transparente. [55] [44]

Una táctica importante de la desinformación es atacar e intentar socavar la credibilidad de las personas y organizaciones cuya investigación o posición de autoridad las coloca en posición de oponerse a la narrativa de la desinformación. [56] Esto puede incluir políticos, funcionarios gubernamentales, científicos, periodistas, activistas, defensores de los derechos humanos y otros. [15]

Por ejemplo, un informe del New Yorker de 2023 reveló detalles sobre la campaña llevada a cabo por los Emiratos Árabes Unidos , en virtud de la cual el presidente emiratí, Mohamed bin Zayed, pagó millones de euros a un empresario suizo, Mario Brero, por "relaciones públicas oscuras" contra sus objetivos. Brero y su empresa Alp Services utilizaron el dinero de los Emiratos Árabes Unidos para crear entradas condenatorias en Wikipedia y publicar artículos de propaganda contra Qatar y aquellos con vínculos con los Hermanos Musulmanes . Los objetivos incluían la empresa Lord Energy, que finalmente se declaró en quiebra tras acusaciones no probadas de vínculos con el terrorismo. [57] Los Emiratos Árabes Unidos también pagaron a Alp para que publicara 100 artículos de propaganda al año contra Qatar. [58]

Los ataques de desinformación contra los científicos y la ciencia, incluidos los ataques financiados por las industrias del tabaco y los combustibles fósiles, han sido minuciosamente documentados en libros como Merchants of Doubt , [56] [59] [60] Doubt Is Their Product , [61] [62] y El triunfo de la duda : el dinero oscuro y la ciencia del engaño (2020). [63] [64] Si bien los científicos, médicos y profesores son considerados los profesionales más confiables a nivel mundial, [14] a los científicos les preocupa si la confianza en la ciencia ha disminuido. [14] [53] Sudip Parikh, director ejecutivo de la Asociación Estadounidense para el Avance de la Ciencia (AAAS) en 2022, es citado diciendo: "Ahora tenemos una minoría significativa de la población que es hostil a la empresa científica... Estamos "Tendré que trabajar duro para recuperar la confianza". [53] Dicho esto, al mismo tiempo que la desinformación representa una amenaza, el uso generalizado de las redes sociales por parte de los científicos ofrece una oportunidad sin precedentes para la comunicación científica y el compromiso entre los científicos y el público, con el potencial de aumentar el conocimiento público. [14] [65]

El Consejo Estadounidense de Ciencia y Salud ofrece consejos para los científicos que enfrentan una campaña de desinformación y señala que las campañas de desinformación a menudo incorporan algunos elementos de verdad para hacerlas más convincentes. Las cinco recomendaciones incluyen identificar y reconocer cualquier parte de la historia que sea realmente cierta; explicar por qué otras partes son falsas, están fuera de contexto o están manipuladas; denunciar las motivaciones que pueden estar detrás de la desinformación, como intereses financieros o de poder; preparar una "auditoría de acusaciones" en previsión de nuevos ataques; y mantener la calma y el autocontrol. [66] Otros recomiendan informarse sobre las plataformas que se utilizan y las herramientas de privacidad que ofrecen para proteger la información personal y silenciar, bloquear y denunciar a los participantes en línea. Es poco probable que los desinformadores y los trolls en línea entablen debates razonados o interactúen de buena fe, y responderles rara vez resulta útil. [67]

Los estudios documentan claramente el acoso a los científicos, tanto personalmente como en términos de credibilidad científica. En 2021, una encuesta de Nature informó que casi el 60% de los científicos que habían hecho declaraciones públicas sobre el COVID-19 vieron atacada su credibilidad. Los ataques afectaron desproporcionadamente a quienes pertenecían a grupos de identidad no dominantes, como mujeres, personas transgénero y personas de color. [67] Un ejemplo muy visible es Anthony S. Fauci . Es profundamente respetado a nivel nacional e internacional como experto en enfermedades infecciosas. También ha sido objeto de intimidación, acoso y amenazas de muerte alimentadas por ataques de desinformación y teorías de conspiración. [68] [69] [70] A pesar de esas experiencias, Fauci alienta a los científicos que inician su carrera "a no dejarse disuadir, porque la satisfacción y el grado de contribución que pueden hacer a la sociedad al ingresar al servicio público y la salud pública es inconmensurable". [71]

Las decisiones individuales, como fumar o no, son objetivos importantes de la desinformación. También lo son los procesos de formulación de políticas, como la formulación de políticas de salud pública, la recomendación y adopción de medidas políticas y la aceptación o regulación de procesos y productos. La opinión pública y las políticas interactúan: la opinión pública y la popularidad de las medidas de salud pública pueden influir fuertemente en las políticas gubernamentales y en la creación y aplicación de estándares industriales. La desinformación intenta socavar la opinión pública e impedir la organización de acciones de cobranza, incluidos debates políticos, acciones gubernamentales, regulaciones y litigios. [45]

Un tipo importante de actividad colectiva es el acto de votar. En las elecciones generales de Kenia de 2017 , el 87% de los kenianos encuestados informaron haber encontrado desinformación antes de las elecciones de agosto, y el 35% informó que, como resultado, no pudieron tomar una decisión de voto informada. [7] Las campañas de desinformación a menudo se dirigen a grupos específicos, como los votantes negros o latinos, para desalentar la votación y el compromiso cívico . Se utilizan cuentas falsas y robots para amplificar la incertidumbre sobre si la votación realmente importa, si los votantes son "apreciados" y qué intereses preocupan a los políticos. [72] [73] La microtargeting puede presentar mensajes diseñados con precisión para una población elegida, mientras que la geocerca puede identificar a las personas según el lugar al que van, como los feligreses. En algunos casos, los ataques de supresión de votantes han hecho circular información incorrecta sobre dónde y cuándo votar. [74] Durante las primarias demócratas estadounidenses de 2020, surgieron narrativas de desinformación en torno al uso de máscaras y el uso de boletas por correo, relacionadas con si la gente votaría y cómo. [75]

La desinformación ataca los cimientos del gobierno democrático: "la idea de que la verdad es cognoscible y que los ciudadanos pueden discernirla y utilizarla para gobernarse a sí mismos". [76] Las campañas de desinformación están diseñadas por actores nacionales y extranjeros para obtener ventajas políticas y económicas. El debilitamiento de un gobierno funcional debilita el Estado de derecho y puede permitir que actores nacionales y extranjeros obtengan beneficios políticos y económicos. Tanto en casa como en el extranjero, el objetivo es debilitar a los oponentes. Las elecciones son un objetivo especialmente crítico, pero la capacidad cotidiana de gobernar también se ve socavada. [76] [77]

El Oxford Internet Institute de la Universidad de Oxford informa que en 2020, las campañas organizadas de manipulación de las redes sociales estuvieron activas en 81 países, un aumento con respecto a los 70 países en 2019. 76 de esos países utilizaron ataques de desinformación. El informe describe la desinformación como algo que se produce a nivel mundial "a escala industrial". [78]

Una operación rusa conocida como Agencia de Investigación de Internet (IRA) gastó miles de dólares en anuncios en las redes sociales para influir en las elecciones presidenciales de Estados Unidos de 2016 , confundir al público sobre cuestiones políticas clave y sembrar discordia. Estos anuncios políticos aprovecharon los datos de los usuarios para microdirigidos a determinadas poblaciones y difundir información engañosa, con el objetivo final de exacerbar la polarización y erosionar la confianza pública en las instituciones políticas. [9] [79] [19] El Proyecto de Propaganda Computacional de la Universidad de Oxford descubrió que los anuncios del IRA buscaban específicamente sembrar desconfianza hacia el gobierno de los Estados Unidos entre los mexicano-estadounidenses y desalentar la participación electoral entre los afroamericanos . [80]

Un examen de la actividad de Twitter antes de las elecciones presidenciales francesas de 2017 indica que el 73% de la desinformación denunciada por Le Monde se remontaba a dos comunidades políticas: una asociada con François Fillon (de derecha, con el 50,75% de los enlaces falsos compartidos) y otra otro con Marine Le Pen (extrema derecha, 22,21%). El 6% de las cuentas de la comunidad de Fillon y el 5% de la comunidad de Le Pen fueron las primeras en difundir desinformación. La desacreditación de la desinformación provino de otras comunidades y estuvo relacionada con mayor frecuencia con Emmanuel Macron (39,18% de las desacreditadas) y Jean-Luc Mélenchon (14% de las desacreditadas). [81]

Otro análisis, de la campaña de desinformación #MacronLeaks de 2017 , ilustra patrones frecuentes de campañas de desinformación relacionadas con las elecciones. Estas campañas suelen alcanzar su punto máximo uno o dos días antes de las elecciones. La escala de una campaña como #MacronLeaks puede ser comparable al volumen de discusión regular en ese período, lo que sugiere que puede obtener una atención colectiva considerable. Alrededor del 18 por ciento de los usuarios involucrados en #MacronLeaks eran identificables como bots. Los picos en el contenido de los bots tendieron a ocurrir ligeramente antes que los picos en el contenido creado por humanos, lo que sugiere que los bots fueron capaces de desencadenar cascadas de desinformación. Algunas cuentas de bot mostraron un patrón de uso previo: creación poco antes de las elecciones presidenciales de EE. UU. de 2016, uso breve en ese momento y ninguna actividad adicional hasta principios de mayo de 2017, antes de las elecciones francesas. Personalidades de los medios de extrema derecha, incluidos el británico Paul Joseph Watson y el estadounidense Jack Posobiec, compartieron de manera destacada el contenido de MacronLeaks antes de las elecciones francesas. [82] A los expertos les preocupa que los ataques de desinformación se utilicen cada vez más para influir en las elecciones nacionales y los procesos democráticos. [9]

En Mucha gente está diciendo: El nuevo conspiracismo y el asalto a la democracia (2020), Nancy L. Rosenblum y Russell Muirhead examinan la historia y la psicología de las teorías de la conspiración y las formas en que se utilizan para deslegitimar el sistema político. Distinguen entre la teoría de la conspiración clásica en la que se examinan y combinan cuestiones y acontecimientos reales (como el asesinato de John F. Kennedy ) para crear una teoría, y una nueva forma de "conspiracismo sin teoría" que se basa en la repetición de declaraciones falsas y rumores. sin fundamento fáctico. [83] [84]

Esta desinformación explota el sesgo humano a la hora de aceptar nueva información. Los seres humanos comparten información constantemente y dependen de otros para proporcionar información que no pueden verificar por sí mismos. Gran parte de esa información será cierta, ya sea que pregunten si hace frío afuera o en la Antártida. Como resultado, tienden a creer lo que escuchan. Los estudios muestran un " efecto de verdad ilusorio ": cuanto más a menudo la gente escucha una afirmación, más probabilidades hay de que la consideren cierta. Este es el caso incluso cuando las personas identifican una afirmación como falsa la primera vez que la ven; es probable que clasifiquen la probabilidad de que sea cierto más alta después de múltiples exposiciones. [84] [85] Las redes sociales son particularmente peligrosas como fuente de desinformación porque se utilizan robots y múltiples cuentas falsas para repetir y magnificar el impacto de las declaraciones falsas. Los algoritmos rastrean en qué hacen clic los usuarios y recomiendan contenido similar al que han elegido, creando un sesgo de confirmación y burbujas de filtro . En comunidades más concentradas se potencia un efecto de cámara de eco . [86] [87] [84 ] [ 88] [89] [19]

Los autócratas han empleado ataques internos de desinformación de los votantes para encubrir la corrupción electoral . La desinformación de los votantes puede incluir declaraciones públicas que afirman que los procesos electorales locales son legítimos y declaraciones que desacreditan a los observadores electorales. Se pueden contratar empresas de relaciones públicas para ejecutar campañas de desinformación especializadas, incluidos anuncios en los medios y cabildeo entre bastidores , para impulsar la narrativa de una elección honesta y democrática. [90] La supervisión independiente del proceso electoral es esencial para combatir la desinformación electoral. El monitoreo puede incluir tanto a observadores ciudadanos electorales como a observadores internacionales, siempre que sean creíbles. Las normas para una caracterización precisa de las elecciones se basan en principios éticos, metodologías eficaces y análisis imparciales. Las normas democráticas enfatizan la importancia de los datos electorales abiertos, el libre ejercicio de los derechos políticos y la protección de los derechos humanos. [90]

Los ataques de desinformación pueden aumentar la polarización política y alterar el discurso público. [89] Las campañas de manipulación extranjeras pueden intentar amplificar las posiciones extremas y debilitar a una sociedad objetivo, mientras que los actores nacionales pueden tratar de demonizar a los oponentes políticos. [76] Los estados con panoramas políticos altamente polarizados y baja confianza pública en los medios y el gobierno locales son particularmente vulnerables a los ataques de desinformación. [91] [92]

Existe la preocupación de que Rusia emplee desinformación, propaganda e intimidación para desestabilizar a los miembros de la OTAN , como los Estados bálticos , y obligarlos a aceptar las narrativas y agendas rusas. [80] [91] Durante la guerra ruso-ucraniana de 2014, Rusia combinó la guerra de combate tradicional con ataques de desinformación en una forma de guerra híbrida en su estrategia ofensiva, para sembrar dudas y confusión entre las poblaciones enemigas e intimidar a los adversarios, erosionar la confianza pública en instituciones ucranianas e impulsar la reputación y la legitimidad de Rusia. [93] Desde que se intensificó la guerra ruso-ucraniana con la invasión rusa de Ucrania en 2022 , CBC News ha descrito el patrón de desinformación de Rusia como "Negar, desviar, distraer". [47]

Se han desmentido miles de historias, incluidas fotografías manipuladas y deepfakes. La propaganda rusa promueve al menos 20 "temas" principales, dirigidos a audiencias mucho más allá de Ucrania y Rusia. Muchos de ellos intentan reforzar las ideas de que Ucrania está de alguna manera controlada por los nazis, que sus fuerzas militares son débiles y que los daños y las atrocidades se deben a acciones ucranianas, no rusas. [47] Muchas de las imágenes que examinan se comparten en Telegraph . Las organizaciones gubernamentales y los grupos periodísticos independientes como Bellingcat trabajan para confirmar o negar dichos informes, a menudo utilizando datos de fuente abierta y herramientas sofisticadas para identificar dónde y cuándo se originó la información y si las afirmaciones son legítimas. Bellingcat trabaja para brindar un relato preciso de los eventos a medida que ocurren y para crear un registro permanente, verificado y a largo plazo. [94]

Se utilizan teorías de conspiración y alarmismo para fomentar la polarización, promover narrativas excluyentes y legitimar el discurso de odio y la agresión. [52] [87] Como se ha documentado minuciosamente, el período previo al Holocausto estuvo marcado por una desinformación repetida y una creciente persecución por parte del gobierno nazi , [95] [96] que culminó con el asesinato en masa [97] de 165.200 judíos alemanes. [98] por un "Estado genocida". [97] Actualmente se considera que las poblaciones de África, Asia, Europa y América del Sur corren un grave riesgo de sufrir abusos contra los derechos humanos. [7] Las condiciones cambiantes en los Estados Unidos también han sido identificadas como factores de riesgo cada vez mayores para la violencia. [92]

Las elecciones son puntos de transición política particularmente tensos, cargados de emociones en cualquier momento y cada vez más blanco de desinformación. Estas condiciones aumentan el riesgo de violencia individual, disturbios civiles y atrocidades masivas. Se considera que los países en mayor riesgo son países como Kenia, cuya historia ha implicado violencia étnica o relacionada con las elecciones, interferencia nacional o extranjera y una gran dependencia del uso de las redes sociales para el discurso político. El Marco de Análisis de Crímenes Atroces de las Naciones Unidas identifica las elecciones como un indicador de riesgo de atrocidades: la desinformación puede actuar como un multiplicador de amenazas de crímenes atroces . Es esencial reconocer la gravedad de este problema para movilizar a los gobiernos, la sociedad civil y las plataformas de redes sociales para que tomen medidas para prevenir daños tanto en línea como fuera de línea. [7]

Los ataques de desinformación apuntan a la credibilidad de la ciencia, particularmente en áreas de salud pública [24] y ciencias ambientales . [99] [14] Los ejemplos incluyen negar los peligros de la gasolina con plomo , [100] [101] fumar , [102] [103] [104] y el cambio climático . [59] [105] [20] [106]

En la década de 1920 se desarrolló un patrón de ataques de desinformación que involucraban fuentes científicas. Ilustra tácticas que se siguen utilizando. [107] Ya en 1910, la toxicóloga industrial Alice Hamilton documentó los peligros asociados con la exposición al plomo . [108] [109] En la década de 1920, Charles Kettering , Thomas Midgley Jr. y Robert A. Kehoe de Ethyl Gasoline Corporation introdujeron el plomo en la gasolina. Tras la sensacional locura y la muerte de los trabajadores en sus plantas, en 1925 se celebró una conferencia del Servicio de Salud Pública para revisar el uso de tetraetilo de plomo (TEL). Hamilton y otros advirtieron sobre el peligro potencial de la gasolina con plomo para las personas y el medio ambiente. Cuestionaron la metodología de investigación utilizada por Kehoe, quien afirmaba que el plomo era una parte "natural" del medio ambiente y que los niveles altos de plomo en los trabajadores eran "normales". [110] [111] [100] Kettering, Midgley y Kehoe enfatizaron que se necesitaba un aditivo para el gas y argumentaron que hasta que "se demuestre... que como resultado se produce un peligro real para el público", [108] a la empresa se le debe permitir producir su producto. En lugar de exigir a la industria que demostrara que su producto era seguro antes de poder venderlo, la carga de la prueba recayó en los defensores de la salud pública, que debían presentar pruebas irrefutables de que se había producido un daño. [108] [112] Los críticos de TEL fueron descritos como "histéricos". [113] Con el apoyo de la industria, Kehoe se convirtió en un destacado experto de la industria y defendió la posición de que la gasolina con plomo era segura, manteniendo "un monopolio casi completo" sobre la investigación en el área. [114] Pasarían décadas antes de que su trabajo fuera finalmente desacreditado. [100] En 1988, la EPA estimó que durante los 60 años anteriores, 68 millones de niños sufrieron una exposición altamente tóxica al plomo procedente de combustibles con plomo. [115]

En la década de 1950, la producción y el uso de investigaciones "científicas" sesgadas formaban parte de un "manual de desinformación" constante utilizado por las empresas de las industrias del tabaco, [116] los pesticidas [117] y los combustibles fósiles. [59] [105] [118] En muchos casos, múltiples industrias contrataron a los mismos investigadores, grupos de investigación y empresas de relaciones públicas. Argumentaron repetidamente que los productos eran seguros sabiendo que no lo eran. Cuando se cuestionaron las afirmaciones de seguridad, se argumentó que los productos eran necesarios. [104] A través de campañas coordinadas y generalizadas, trabajaron para influir en la opinión pública y manipular a los funcionarios gubernamentales y las agencias reguladoras, para evitar acciones regulatorias o legales que pudieran interferir con las ganancias. [45]

Las campañas de desinformación científica siguen utilizando tácticas similares. Cuando se presenta prueba de daño, se argumenta que la prueba no es suficiente. El argumento de que se necesitan más pruebas se utiliza para posponer la acción para algún momento futuro. Los retrasos se utilizan para bloquear los intentos de limitar o regular la industria y evitar litigios, sin dejar de seguir obteniendo beneficios. Expertos financiados por la industria llevan a cabo investigaciones que con demasiada frecuencia pueden ser cuestionadas por motivos metodológicos y por conflictos de intereses. Los desinformadores utilizan malas investigaciones como base para afirmar que los científicos no están de acuerdo y para generar afirmaciones específicas como parte de una narrativa de desinformación. Los oponentes a menudo son atacados a nivel personal así como en términos de su trabajo científico. [119] [45] [120]

Un memorando de la industria tabacalera resumió este enfoque diciendo: "La duda es nuestro producto". [119] Los científicos generalmente consideran una pregunta en términos de la probabilidad de que una conclusión sea respaldada, dado el peso de la mejor evidencia científica disponible. La evidencia tiende a implicar mediciones, y la medición introduce un potencial de error. Un científico puede decir que la evidencia disponible es suficiente para respaldar una conclusión sobre un problema, pero rara vez afirmará que un problema se comprende completamente o que una conclusión es 100% segura. La retórica de la desinformación intenta socavar la ciencia e influir en la opinión pública mediante el uso de una "estrategia de la duda". Replanteando el proceso científico normal, la desinformación a menudo sugiere que cualquier cosa menos del 100% de certeza implica duda, y esa duda significa que no hay consenso sobre un tema. La desinformación intenta socavar tanto la certeza sobre un tema particular como sobre la ciencia misma. [119] [45] Décadas de ataques de desinformación han erosionado considerablemente la creencia pública en la ciencia. [45]

La información científica puede distorsionarse a medida que se transfiere entre fuentes científicas primarias, la prensa popular y las redes sociales. Esto puede ocurrir tanto de forma intencionada como no intencionada. Algunas características de las publicaciones académicas actuales, como el uso de servidores de preimpresión, facilitan que información inexacta se haga pública, especialmente si la información reportada es novedosa o sensacionalista. [37]

Las medidas para proteger la ciencia de la desinformación y la interferencia incluyen tanto acciones individuales por parte de científicos, revisores pares y editores, como acciones colectivas a través de organizaciones de investigación, subvenciones y profesionales, y agencias reguladoras. [45] [121] [122]

Los canales de medios tradicionales se pueden utilizar para difundir desinformación. Por ejemplo, Russia Today es un canal de noticias financiado por el estado que se transmite a nivel internacional. Su objetivo es mejorar la reputación de Rusia en el extranjero y también mostrar a las naciones occidentales , como Estados Unidos, bajo una luz negativa. Ha servido como plataforma para difundir propaganda y teorías de conspiración destinadas a engañar y desinformar a su audiencia. [6]

Dentro de Estados Unidos, el intercambio de desinformación y propaganda se ha asociado con el desarrollo de medios de comunicación cada vez más "partidistas", sobre todo en fuentes de derecha como Breitbart , The Daily Caller y Fox News . [123] A medida que los medios de comunicación locales han disminuido, ha habido un aumento de medios de comunicación partidistas que se "hacen pasar" por fuentes de noticias locales. [124] [125] El impacto del partidismo y su amplificación a través de los medios de comunicación está documentado. Por ejemplo, las actitudes hacia la legislación climática eran bipartidistas en la década de 1990, pero se polarizaron intensamente en 2010. Mientras que los mensajes de los demócratas sobre el clima en los medios aumentaron entre 1990 y 2015 y tendieron a apoyar el consenso científico sobre el cambio climático, los mensajes republicanos sobre el clima disminuyeron y se volvieron más mezclado. [20]

Una "creencia de entrada" que afecta la aceptación de las posiciones y políticas científicas por parte de las personas es su comprensión del grado de acuerdo científico sobre un tema. Por lo tanto, socavar el consenso científico es una táctica de desinformación frecuente. Indicar que existe un consenso científico (y explicar la ciencia involucrada) puede ayudar a contrarrestar la información errónea. [20] Indicar el amplio consenso de los expertos puede ayudar a alinear las percepciones y comprensiones de las personas con la evidencia empírica. [126] Presentar los mensajes de una manera que se alinee con el marco de referencia cultural de alguien hace que sea más probable que sean aceptados. [20]

Es importante evitar un falso equilibrio , en el que las afirmaciones opuestas se presentan de una manera desproporcionada con la evidencia real de cada lado. Una forma de contrarrestar el falso equilibrio es presentar una declaración de ponderación de la evidencia que indique explícitamente el equilibrio de la evidencia para diferentes posiciones. [126] [127]

Los perpetradores utilizan principalmente los canales de redes sociales como medio para difundir desinformación, utilizando una variedad de herramientas. [128] Los investigadores han recopilado múltiples acciones a través de las cuales se producen ataques de desinformación en las redes sociales, que se resumen en la siguiente tabla. [2] [129] [130]

Una aplicación llamada "Dawn of Glad Tidings", desarrollada por miembros del Estado Islámico , ayuda en los esfuerzos de la organización por difundir rápidamente desinformación en los canales de las redes sociales. Cuando un usuario descarga la aplicación, se le solicita que la vincule a su cuenta de Twitter y le otorgue acceso a la aplicación para twittear desde su cuenta personal. Esta aplicación permite enviar tweets automatizados desde cuentas de usuarios reales y ayuda a crear tendencias en Twitter que amplifican la desinformación producida por el Estado Islámico a nivel internacional. [80]

En muchos casos, se paga a personas y empresas de diferentes países para que creen contenido falso e impulsen desinformación, y en ocasiones obtienen tanto pagos como ingresos publicitarios al hacerlo. [128] [2] Los "actores de desinformación a sueldo" a menudo promueven múltiples temas, o incluso múltiples lados en el mismo tema, únicamente para obtener ganancias materiales. [139] Otros están motivados política o psicológicamente. [140] [2]

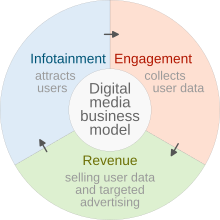

En términos más generales, las redes sociales pueden examinarse en términos de sus prácticas de mercado y las formas en que sus estructuras y prácticas " monetizan " la participación de los espectadores. Los medios de comunicación (1) brindan contenido al público a bajo costo o sin costo alguno, (2) capturan y reenfocan la atención del público y (3) recopilan, utilizan y revenden datos de los usuarios. Las empresas de publicidad, los editores, las personas influyentes, las marcas y los clientes pueden beneficiarse de la desinformación de diversas formas. [2]

En 2022, el Journal of Communication publicó un estudio sobre la economía política que subyace a la desinformación en torno a las vacunas. Los investigadores identificaron 59 "actores" de habla inglesa que proporcionaban "casi exclusivamente publicaciones antivacunas". Sus sitios web monetizaron la desinformación mediante llamamientos a donaciones, ventas de medios basados en contenidos y otras mercancías, publicidad de terceros y cuotas de membresía. Algunos mantenían un grupo de sitios web vinculados, atrayendo visitantes con un sitio y solicitando dinero y vendiendo mercancías en otros. En la forma en que ganaron atención y obtuvieron financiación, sus actividades mostraron una "estrategia de monetización híbrida". Atrajeron la atención combinando aspectos llamativos de "noticias basura" y promoción de celebridades en línea. Al mismo tiempo, desarrollaron comunidades de campañas específicas para publicitar y legitimar su posición, de manera similar a los movimientos sociales radicales. [140]

Las emociones se utilizan y manipulan para difundir desinformación y creencias falsas. [19] Despertar emociones puede ser persuasivo. Cuando las personas tienen sentimientos fuertes sobre algo, es más probable que lo consideren cierto. [85] La emoción también puede hacer que las personas piensen con menos claridad sobre lo que están leyendo y la credibilidad de su fuente. Es más probable que el contenido que apela a las emociones se difunda rápidamente en Internet. El miedo, la confusión y la distracción pueden interferir con la capacidad de las personas para pensar críticamente y tomar buenas decisiones. [141]

Se aprovecha la psicología humana para hacer que los ataques de desinformación sean más potentes y virales. [19] Los fenómenos psicológicos, como los estereotipos, el sesgo de confirmación , la atención selectiva y las cámaras de eco , contribuyen a la viralidad y el éxito de la desinformación en las plataformas digitales. [137] [142] [5] Los ataques de desinformación a menudo se consideran un tipo de guerra psicológica debido al uso de técnicas psicológicas para manipular a las poblaciones. [143] [25]

Las percepciones de identidad y el sentido de pertenencia se manipulan para influir en las personas. [19] Los sentimientos de pertenencia social se refuerzan para fomentar la afiliación a un grupo y desalentar la disidencia. Esto puede hacer que las personas sean más susceptibles a un "influencer" o líder que pueda alentar a sus " seguidores comprometidos " a atacar a otros. El tipo de comportamiento ha sido comparado con el comportamiento colectivo de las turbas y es similar a la dinámica dentro de las sectas . [67] [144] [145]

Como ha señalado el Instituto Knight de la Primera Enmienda de la Universidad de Columbia, "el problema de la desinformación es social y no sólo tecnológico o legal". [146] Plantea serias cuestiones éticas sobre cómo nos relacionamos unos con otros. [147] La Cumbre de 2023 sobre "Verdad, Confianza y Esperanza", celebrada por el Comité del Premio Nobel y la Academia Nacional de Ciencias, identificó la desinformación como más peligrosa que cualquier otra crisis, por la forma en que obstaculiza el abordaje y resolución de todos los demás problemas. [148]

Las medidas defensivas contra la desinformación pueden ocurrir en una amplia variedad de niveles, en sociedades diversas, bajo diferentes leyes y condiciones. Las respuestas a la desinformación pueden involucrar instituciones, individuos y tecnologías, incluida la regulación gubernamental, la autorregulación, el monitoreo por parte de terceros, las acciones de actores privados, la influencia de multitudes y cambios tecnológicos en la arquitectura de las plataformas y los comportamientos algorítmicos. [149] [150] Es importante desarrollar y compartir mejores prácticas para contrarrestar la desinformación y desarrollar resiliencia contra ella. [76]

Es posible que las directrices sociales, legales y regulatorias existentes no se apliquen fácilmente a las acciones en un mundo virtual internacional, donde las corporaciones privadas compiten por la rentabilidad, a menudo sobre la base de la participación de los usuarios. [149] [2] Las preocupaciones éticas se aplican a algunas de las posibles respuestas a la desinformación, mientras las personas debaten cuestiones de moderación de contenidos, libertad de expresión, el derecho a la privacidad personal, la identidad humana, la dignidad humana, la supresión de los derechos humanos y la libertad religiosa, y el uso de datos. [147] El alcance del problema significa que "crear resiliencia y contrarrestar las campañas de información manipuladoras es un esfuerzo de toda la sociedad". [76]

Si bien los regímenes autoritarios han optado por utilizar los ataques de desinformación como herramienta política, su uso plantea peligros específicos para los gobiernos democráticos: el uso de tácticas equivalentes profundizará aún más la desconfianza pública en los procesos políticos y socavará la base de un gobierno democrático y legítimo. "Las democracias no deberían tratar de influir encubiertamente en el debate público, ya sea difundiendo deliberadamente información falsa o engañosa o incurriendo en prácticas engañosas, como el uso de personajes ficticios en línea". [151] Además, se alienta a las democracias a aprovechar sus fortalezas, incluido el estado de derecho, el respeto por los derechos humanos, la cooperación con socios y aliados, el poder blando y la capacidad técnica para abordar las amenazas cibernéticas. [151]

Las normas constitucionales que gobiernan una sociedad son necesarias tanto para que la gobernanza sea eficaz como para evitar la tiranía . [146] Proporcionar información precisa y combatir la desinformación son actividades legítimas del gobierno. La OCDE sugiere que la comunicación pública de las respuestas políticas debe seguir los principios de gobierno abierto de integridad, transparencia, rendición de cuentas y participación ciudadana. [152] Un debate sobre la capacidad del gobierno de Estados Unidos para responder legalmente a la desinformación sostiene que las respuestas deben basarse en principios de transparencia y generalidad. Las respuestas deben evitar ataques ad hominem , apelaciones raciales o selectividad en la persona a la que se responde. La crítica debe centrarse primero en proporcionar información correcta y, en segundo lugar, en explicar por qué la información falsa es incorrecta, en lugar de centrarse en el hablante o repetir la narrativa falsa. [146] [141] [153]

En el caso de la pandemia de COVID-19 , múltiples factores crearon "espacio para que prolifere la desinformación". Las respuestas gubernamentales a este problema de salud pública indican varias áreas de debilidad, incluidas lagunas en el conocimiento básico de salud pública, falta de coordinación en la comunicación gubernamental y confusión sobre cómo abordar una situación que implica una incertidumbre significativa. Las lecciones de la pandemia incluyen la necesidad de admitir la incertidumbre cuando existe y de distinguir claramente entre lo que se sabe y lo que aún no se sabe. La ciencia es un proceso, y es importante reconocer y comunicar que la comprensión científica y los consejos relacionados cambiarán con el tiempo sobre la base de nueva evidencia. [152]

La regulación de la desinformación plantea cuestiones éticas. El derecho a la libertad de expresión está reconocido como un derecho humano en la Declaración Universal de Derechos Humanos y en el derecho internacional de los derechos humanos de las Naciones Unidas . Muchos países tienen leyes constitucionales que protegen la libertad de expresión. Las leyes de un país pueden identificar categorías específicas de expresión que están o no protegidas, y partes específicas cuyas acciones están restringidas. [149]

La Primera Enmienda a la Constitución de los Estados Unidos protege tanto la libertad de expresión como la libertad de prensa de la interferencia del Congreso de los Estados Unidos . Como resultado, la regulación de la desinformación en Estados Unidos tiende a dejarse en manos de acciones privadas y no gubernamentales. [149]

La Primera Enmienda no protege el discurso utilizado para incitar a la violencia o violar la ley, [154] o "obscenidad, pornografía infantil, discurso difamatorio, publicidad engañosa, amenazas verdaderas y palabras de lucha". [155] Con estas excepciones, se espera que debatir cuestiones de "interés público o general" de una manera "desinhibida, sólida y abierta" beneficie a una sociedad democrática. [156]

La Primera Enmienda tiende a depender del contradiscurso como medida correctiva viable, prefiriendo la refutación de la falsedad a la regulación. [149] [146] Existe la suposición subyacente de que las partes identificables tendrán la oportunidad de compartir sus puntos de vista en un campo de juego relativamente nivelado, donde una figura pública que sea arrastrada a un debate tendrá un mayor acceso a los medios de comunicación y una posibilidad de refutación. . [156] Es posible que esto ya no sea cierto cuando se implementan ataques rápidos y masivos de desinformación contra un individuo o grupo a través de terceros anónimos o múltiples, donde "una demora de medio día es toda una vida para una mentira en línea". [146]

Otras leyes civiles y penales tienen por objeto proteger a personas y organizaciones en casos en que el discurso implique difamación de carácter ( libelo o calumnia ) o fraude . En tales casos, ser incorrecto no es suficiente para justificar una acción legal o gubernamental. La información incorrecta debe causar daño a otros de manera demostrable o permitir al mentiroso obtener un beneficio injustificado. Alguien que, a sabiendas, haya difundido desinformación y haya utilizado esa desinformación para ganar dinero puede ser acusado de fraude. [157] No está claro hasta qué punto estas leyes existentes pueden aplicarse eficazmente contra los ataques de desinformación. [149] [146] [158] Según este enfoque, un subconjunto de desinformación, que no sólo es falsa sino que "se comunica con el propósito de obtener ganancias o ventajas mediante el engaño y causa daño como resultado" podría considerarse "fraude en el público", [31] y ya no se considera un tipo de expresión protegida. Gran parte del discurso que constituye desinformación no pasaría esta prueba. [31]

La Ley de Servicios Digitales (DSA) es un Reglamento de la legislación de la UE que establece un marco legal dentro de la Unión Europea para la gestión de contenidos por parte de intermediarios, incluidos contenidos ilegales, publicidad transparente y desinformación. [159] [160] El Parlamento Europeo aprobó la DSA junto con la Ley de Mercados Digitales el 5 de julio de 2022. [161] El Consejo Europeo dio su aprobación final al Reglamento sobre la Ley de Servicios Digitales el 4 de octubre de 2022. [ 162] fue publicado en el Diario Oficial de la Unión Europea el 19 de octubre de 2022. Los proveedores de servicios afectados tendrán hasta el 1 de enero de 2024 para cumplir con sus disposiciones. [161] DSA tiene como objetivo armonizar las diferentes leyes a nivel nacional en la Unión Europea [159] , incluidas Alemania ( NetzDG ), Austria ("Kommunikationsplattformen-Gesetz") y Francia (" Loi Avia "). [163] Las plataformas con más de 45 millones de usuarios en la Unión Europea , incluidas Facebook , YouTube , Twitter y TikTok, estarían sujetas a las nuevas obligaciones. Las empresas que no cumplan con esas obligaciones podrían correr el riesgo de recibir multas de hasta el 10% de su facturación anual. [164]

Al 25 de abril de 2023, Wikipedia fue una de las 17 plataformas designadas como Plataforma en línea muy grande (VLOP) por la Comisión de la UE, y las regulaciones entraron en vigor a partir del 25 de agosto de 2023. [165] Además de las medidas adoptadas por Según la Fundación Wikimedia, el cumplimiento de Wikipedia con la Ley de Servicios Digitales será auditado de forma independiente, anualmente, a partir de 2024. [166]

Se ha sugerido que China y Rusia están presentando conjuntamente a Estados Unidos y la Unión Europea como adversarios en términos del uso de la información y la tecnología. Luego, China y Rusia utilizan esta narrativa para justificar la restricción de la libertad de expresión, el acceso a medios independientes y las libertades en Internet. Han pedido conjuntamente la "internacionalización de la gobernanza de Internet", es decir, la distribución del control de Internet a estados soberanos individuales. Por el contrario, los llamados a una gobernanza global de Internet enfatizan la existencia de una Internet libre y abierta, cuya gobernanza involucre a los ciudadanos y la sociedad civil. [167] [76] Los gobiernos democráticos deben ser conscientes del impacto potencial de las medidas utilizadas para restringir la desinformación tanto en el país como en el extranjero. Este no es un argumento que deba bloquear la legislación, pero debería tenerse en cuenta a la hora de elaborarla. [76]

En Estados Unidos, la Primera Enmienda limita las acciones del Congreso, no las de particulares, empresas y empleadores. [154] Las entidades privadas pueden establecer sus propias reglas (sujetas a las leyes locales e internacionales) para manejar la información. [155] Las plataformas de redes sociales como Facebook, Twitter y Telegram podrían establecer legalmente pautas para la moderación de la información y la desinformación en sus plataformas. Idealmente, las plataformas deberían intentar equilibrar la libre expresión de sus usuarios con la moderación o eliminación del discurso dañino e ilegal. [38] [168]

El intercambio de información a través de los medios de comunicación y los periódicos se ha autorregulado en gran medida. Ha dependido del autogobierno voluntario y del establecimiento de normas por parte de organizaciones profesionales como la Sociedad de Periodistas Profesionales de Estados Unidos (SPJ). La SPJ cuenta con un código de ética para la rendición de cuentas profesional, que incluye buscar y reportar la verdad, minimizar el daño, la rendición de cuentas y la transparencia. [169] El código establece que "quien disfruta de una medida especial de libertad, como un periodista profesional, tiene la obligación ante la sociedad de utilizar sus libertades y poderes de manera responsable". [170] Cualquiera puede escribir una carta al editor del New York Times , pero el Times no publicará esa carta a menos que así lo decida. [171]

Podría decirse que las plataformas de redes sociales son tratadas más como la oficina de correos (que transmite información sin revisarla) que como periodistas y editores impresos que toman decisiones editoriales y se espera que asuman la responsabilidad de lo que publican. Los tipos de marcos éticos, sociales y legales que el periodismo y la publicación impresa han desarrollado no se han aplicado a las plataformas de redes sociales. [172]

Se ha señalado que las plataformas de redes sociales como Facebook y Twitter carecen de incentivos para controlar la desinformación o autorregularse. [169] [149] [173] En la medida en que las plataformas dependen de la publicidad para obtener ingresos, les beneficia financieramente maximizar la participación del usuario, y la atención de los usuarios es evidentemente captada por contenido sensacionalista. [19] [174] Los algoritmos que impulsan contenido basándose en historiales de búsqueda de usuarios, clics frecuentes y publicidad paga generan información desequilibrada, mal obtenida y activamente engañosa. También es muy rentable. [169] [173] [175] Al contrarrestar la desinformación, el uso de algoritmos para monitorear el contenido es más barato que emplear personas para revisar y verificar el contenido. Las personas son más eficaces a la hora de detectar la desinformación. Las personas también pueden aportar sus propios prejuicios (o los de sus empleadores) a la tarea de moderación. [172]

Las plataformas de redes sociales de propiedad privada, como Facebook y Twitter, pueden desarrollar legalmente regulaciones, procedimientos y herramientas para identificar y combatir la desinformación en sus plataformas. [176] Por ejemplo, Twitter puede utilizar aplicaciones de aprendizaje automático para señalar contenido que no cumple con sus términos de servicio e identificar publicaciones extremistas que alientan el terrorismo. Facebook y Google han desarrollado un sistema de jerarquía de contenido donde los verificadores de datos pueden identificar y desclasificar posible desinformación y ajustar los algoritmos en consecuencia. [9] Las empresas también están considerando utilizar sistemas legales procesales para regular el contenido en sus plataformas. Específicamente, están considerando utilizar sistemas de apelación: las publicaciones pueden eliminarse por violar los términos de servicio y presentarse como una amenaza de desinformación, pero los usuarios pueden impugnar esta acción a través de una jerarquía de órganos de apelación. [133]

Se ha sugerido que la tecnología Blockchain es un posible mecanismo de defensa contra la manipulación de Internet. [177] Si bien blockchain se desarrolló originalmente para crear un libro de transacciones para la moneda digital bitcoin , ahora se usa ampliamente en aplicaciones donde se desea un registro o historial permanente de activos, transacciones y actividades. Proporciona un potencial para la transparencia y la rendición de cuentas, [178] La tecnología Blockchain podría aplicarse para hacer que el transporte de datos sea más seguro en los espacios en línea y en las redes de Internet de las cosas , dificultando que los actores alteren o censuren el contenido y lleven a cabo ataques de desinformación. [179] La aplicación de técnicas como blockchain y marcas de agua con clave en redes sociales/plataformas de mensajería también podría ayudar a detectar y frenar los ataques de desinformación. Se podría observar la densidad y la tasa de reenvío de un mensaje para detectar patrones de actividad que sugieran el uso de bots y actividad de cuentas falsas en ataques de desinformación. Blockchain podría soportar tanto el seguimiento hacia atrás como hacia adelante de eventos que involucran la difusión de desinformación. Si el contenido se considera peligroso o inapropiado, su difusión podría frenarse inmediatamente. [177]

Es comprensible que los métodos para contrarrestar la desinformación que implican una gobernanza algorítmica planteen preocupaciones éticas. El uso de tecnologías que rastrean y manipulan información plantea interrogantes sobre "quién es responsable de su funcionamiento, si pueden crear injusticias y erosionar las normas cívicas, y cómo debemos resolver sus consecuencias (no) deseadas". [169] [180] [181]

Un estudio del Pew Research Center informa que el apoyo público a la restricción de la desinformación tanto por parte de las empresas de tecnología como del gobierno aumentó entre los estadounidenses de 2018 a 2021. Sin embargo, las opiniones sobre si el gobierno y las empresas de tecnología deberían tomar tales medidas se volvieron cada vez más partidistas y polarizadas durante el mismo periodo de tiempo. [182]

Los expertos en seguridad cibernética afirman que la colaboración entre los sectores público y privado es necesaria para combatir con éxito los ataques de desinformación. [19] Las estrategias de defensa cooperativa recomendadas incluyen:

Sin embargo, en Estados Unidos, el Partido Republicano se opone activamente tanto a la investigación de la desinformación como a la participación del gobierno en la lucha contra la desinformación. Los republicanos obtuvieron la mayoría en la Cámara en enero de 2023. Desde entonces, el Comité Judicial de la Cámara ha utilizado acciones legales para enviar cartas, citaciones y amenazas de acciones legales a los investigadores, exigiendo notas, correos electrónicos y otros registros de los investigadores e incluso de los estudiantes en prácticas. que se remonta a 2015. Las instituciones afectadas incluyen el Observatorio de Internet de Stanford en la Universidad de Stanford , la Universidad de Washington , el Laboratorio de Investigación Forense Digital del Atlantic Council y la firma de análisis de redes sociales Graphika. Los proyectos incluyen la Asociación de Integridad Electoral, formada para identificar intentos de "suprimir la votación, reducir la participación, confundir a los votantes o deslegitimar los resultados electorales sin pruebas" [184] y el Proyecto Viralidad, que ha examinado la difusión de afirmaciones falsas sobre las vacunas. Los investigadores argumentan que tienen libertad académica para estudiar las redes sociales y la desinformación, así como libertad de expresión para informar sus resultados. [184] [185] [186] A pesar de las afirmaciones conservadoras de que el gobierno actuó para censurar el discurso en línea, "no ha surgido ninguna evidencia de que los funcionarios del gobierno hayan obligado a las empresas a tomar medidas contra las cuentas". [184]

A nivel estatal, los gobiernos estatales que estaban políticamente alineados con los activistas antivacunas solicitaron con éxito una orden judicial preliminar para impedir que la Administración Biden instara a las empresas de redes sociales a luchar contra la desinformación sobre la salud pública. La orden emitida por la Corte de Apelaciones del Quinto Circuito de los Estados Unidos en 2023 "limita severamente la capacidad de la Casa Blanca, el cirujano general [y] los Centros para el Control y la Prevención de Enfermedades... para comunicarse con las empresas de redes sociales sobre el contenido". relacionados con el Covid-19... que el gobierno considera desinformación". [187]

Los informes sobre desinformación en Armenia [52] y Asia [76] identifican cuestiones clave y hacen recomendaciones. Estos pueden aplicarse a muchos otros países, particularmente a aquellos que experimentan "al mismo tiempo una profunda perturbación y una oportunidad de cambio". [52] El informe enfatiza la importancia de fortalecer la sociedad civil protegiendo la integridad de las elecciones y reconstruyendo la confianza en las instituciones públicas. Las medidas para apoyar la integridad de las elecciones incluyen: garantizar un proceso libre y justo, permitir la observación y el monitoreo independientes, permitir el acceso periodístico independiente e investigar las infracciones electorales. Otras sugerencias incluyen repensar las estrategias de comunicación estatales para permitir que todos los niveles de gobierno se comuniquen de manera más efectiva y aborden los ataques de desinformación. [52]

Se recomienda un diálogo nacional que reúna a diversos actores públicos, comunitarios, políticos, estatales y no estatales como partes interesadas para una planificación estratégica eficaz a largo plazo. Se recomienda crear una estrategia unificada para la legislación que aborde los espacios de información. Es fundamental equilibrar las preocupaciones sobre la libertad de expresión con la protección de las personas y las instituciones democráticas. [52] [188] [189]

Otra preocupación es el desarrollo de un entorno informativo saludable que apoye el periodismo basado en hechos, el discurso veraz y la información independiente, al mismo tiempo que rechace la manipulación de la información y la desinformación. Las cuestiones clave para el apoyo de medios independientes resilientes incluyen la transparencia de la propiedad, la viabilidad financiera, la independencia editorial, la ética y los estándares profesionales de los medios, y los mecanismos de autorregulación. [52] [188] [189] [190] [76]

Durante las elecciones generales mexicanas de 2018 , se estableció el proyecto de periodismo colaborativo Verificado 2018 para abordar la desinformación. En él participaron al menos ochenta organizaciones, incluidos medios de comunicación locales y nacionales, universidades y grupos de defensa y de la sociedad civil. El grupo investigó afirmaciones y declaraciones políticas en línea y publicó verificaciones conjuntas. Durante el transcurso de las elecciones, produjeron más de 400 notas y 50 videos que documentaban afirmaciones falsas y sitios sospechosos, y rastrearon casos en los que las noticias falsas se volvieron virales. [191] Verificado.mx recibió 5,4 millones de visitas durante las elecciones, y sus organizaciones asociadas registraron millones más. [192] : 25 Para abordar el intercambio de mensajes cifrados a través de WhatsApp , Verificado creó una línea directa donde los usuarios de WhatsApp podían enviar mensajes para su verificación y desacreditación. Más de 10.000 usuarios se suscribieron a la línea directa de Verificado. [191]

Las organizaciones que promueven la sociedad civil y la democracia, los periodistas independientes, los defensores de los derechos humanos y otros activistas son cada vez más blanco de campañas de desinformación y violencia. Su protección es esencial. Periodistas, activistas y organizaciones pueden ser aliados clave para combatir las narrativas falsas, promover la inclusión y fomentar el compromiso cívico. Los órganos de supervisión y ética también son fundamentales. [52] [193] Las organizaciones que han desarrollado recursos y capacitaciones para apoyar mejor a los periodistas contra la violencia en línea y fuera de línea y la violencia contra las mujeres incluyen la Coalición Contra la Violencia en Línea, [194] [195] Centro Knight para el Periodismo en las Américas , [196] Fundación Internacional de Mujeres en los Medios , [197] UNESCO , [193] [196] PEN América . [198] y otros. [199]

Se recomienda que las escuelas y universidades públicas reciban educación sobre alfabetización mediática e información sobre cómo identificar y combatir la desinformación. [52] En 2022, los países de la Unión Europea fueron clasificados en un Índice de Alfabetización Mediática para medir la resiliencia contra la desinformación. Finlandia , el país con la clasificación más alta, ha desarrollado un extenso plan de estudios que enseña pensamiento crítico y resistencia a la guerra de información, y lo ha integrado en su sistema de educación pública. Los finlandeses también ocupan un lugar destacado en la confianza en las autoridades gubernamentales y los medios de comunicación. [200] [201] Luego de un ciberataque en 2007 que incluyó tácticas de desinformación, el país de Estonia se centró en mejorar sus defensas cibernéticas e hizo de la educación mediática un foco importante desde el jardín de infantes hasta la escuela secundaria. [202] [203]

En 2018, el vicepresidente ejecutivo de la Comisión Europea para una Europa adaptada a la era digital reunió a un grupo de expertos para elaborar un informe con recomendaciones para la enseñanza de la alfabetización digital. Los planes de estudio de alfabetización digital propuestos familiarizan a los estudiantes con sitios web de verificación de datos como Snopes y FactCheck.org . Este plan de estudios tiene como objetivo dotar a los estudiantes de habilidades de pensamiento crítico para discernir entre contenido fáctico y desinformación en línea. [21] Las áreas sugeridas para centrarse incluyen habilidades de pensamiento crítico , [204] alfabetización informacional , [205] [206] alfabetización científica [207] y alfabetización sanitaria . [24]

Otro enfoque es crear juegos interactivos como el juego Cranky Uncle , que enseña pensamiento crítico e inocula a los jugadores contra técnicas de desinformación y negación científica. El juego Cranky Uncle está disponible gratuitamente y ha sido traducido a al menos 9 idiomas. [208] [209] También se pueden encontrar en línea videos para enseñar pensamiento crítico y abordar la desinformación. [210] [211]

Grupos de periodistas, científicos y otros están desarrollando y compartiendo capacitación y mejores prácticas para identificar y contrarrestar la desinformación (por ejemplo, Acción climática contra la desinformación, [22] PEN America , [212] [213] [214] UNESCO , [44] Unión de Científicos Preocupados , [215] [216] Iniciativa de Jóvenes Líderes Africanos [217] ).

Las investigaciones sugieren que varias tácticas han demostrado ser útiles contra la desinformación científica sobre el cambio climático. Estos incluyen: 1) proporcionar explicaciones claras sobre por qué está ocurriendo el cambio climático 2) indicar que existe un consenso científico sobre la existencia del cambio climático y sobre su base en las acciones humanas 3) presentar información de manera que esté culturalmente alineada con el oyente 4) "inocular" a las personas identificando claramente la información errónea (idealmente antes de que se encuentre un mito, pero también más tarde desacreditándolo). [20] [18]

Una "Caja de herramientas de intervenciones contra la desinformación y la manipulación en línea" revisa la investigación sobre intervenciones centradas individualmente para combatir la desinformación y su posible eficacia. Las tácticas incluyen: [23] [218]

{{cite journal}}: Mantenimiento CS1: DOI inactivo a partir de enero de 2024 ( enlace )La desinformación y la propaganda de sitios partidistas dedicados en ambos lados de la división política desempeñaron un papel mucho mayor en las elecciones. Sin embargo, fue más rampante en la derecha que en la izquierda, ya que echó raíces en los medios partidistas dominantes de la derecha, incluidos Breitbart, The Daily Caller y Fox News.