El vídeo es un medio electrónico para la grabación, copia , reproducción , transmisión y visualización de medios visuales en movimiento . [1] El vídeo se desarrolló primero para sistemas de televisión mecánicos , que fueron rápidamente reemplazados por sistemas de tubo de rayos catódicos (CRT), que, a su vez, fueron reemplazados por pantallas planas de varios tipos.

Los sistemas de video varían en cuanto a resolución de pantalla , relación de aspecto , frecuencia de actualización , capacidades de color y otras cualidades. Existen variantes analógicas y digitales que pueden transmitirse en diversos medios, incluidas transmisiones de radio , cintas magnéticas , discos ópticos , archivos de computadora y transmisión en red .

La palabra vídeo viene del latín video (veo). [2]

El vídeo se desarrolló a partir de sistemas de fax desarrollados a mediados del siglo XIX. Los primeros escáneres de vídeo mecánicos, como el disco de Nipkow , se patentaron ya en 1884; sin embargo, pasaron varias décadas antes de que se pudieran desarrollar sistemas de vídeo prácticos, muchas décadas después de que se desarrollara la película . La película graba utilizando una secuencia de imágenes fotográficas en miniatura visibles para el ojo cuando se examina físicamente la película. El vídeo, por el contrario, codifica las imágenes electrónicamente, convirtiéndolas en señales electrónicas analógicas o digitales para su transmisión o grabación. [3]

La tecnología de vídeo se desarrolló primero para sistemas de televisión mecánicos , que fueron rápidamente reemplazados por sistemas de televisión de tubo de rayos catódicos (CRT) . El vídeo era originalmente una tecnología exclusivamente en directo . Las cámaras de vídeo en directo utilizaban un haz de electrones que escaneaba una placa fotoconductora con la imagen deseada y producía una señal de voltaje proporcional al brillo de cada parte de la imagen. La señal podía entonces enviarse a televisores donde otro haz recibiría y mostraría la imagen. [4] Charles Ginsburg dirigió un equipo de investigación de Ampex para desarrollar una de las primeras grabadoras de vídeo (VTR) prácticas. En 1951, la primera VTR capturó imágenes en directo de cámaras de televisión escribiendo la señal eléctrica de la cámara en una cinta de vídeo magnética .

En 1956, las grabadoras de vídeo se vendían a 50.000 dólares estadounidenses y las cintas de vídeo costaban 300 dólares estadounidenses por rollo de una hora. [5] Sin embargo, los precios bajaron gradualmente con el paso de los años; en 1971, Sony comenzó a vender grabadoras de videocasetes (VCR) y cintas en el mercado de consumo . [6]

El vídeo digital es capaz de ofrecer una mayor calidad y, eventualmente, un coste mucho menor que la tecnología analógica anterior. Tras la introducción comercial del DVD en 1997 y más tarde del Blu-ray Disc en 2006, las ventas de cintas de vídeo y equipos de grabación se desplomaron. Los avances en la tecnología informática permiten que incluso ordenadores personales y teléfonos inteligentes económicos capturen, almacenen, editen y transmitan vídeo digital, lo que reduce aún más el coste de producción de vídeo y permite a los realizadores de programas y emisoras pasar a la producción sin cintas . La llegada de la radiodifusión digital y la posterior transición a la televisión digital están en proceso de relegar el vídeo analógico al estado de una tecnología heredada en la mayor parte del mundo. El desarrollo de cámaras de vídeo de alta resolución con un rango dinámico y gamas de colores mejorados, junto con la introducción de formatos de datos intermedios digitales de alto rango dinámico con una profundidad de color mejorada , ha hecho que la tecnología de vídeo digital converja con la tecnología cinematográfica. Desde 2013, [actualizar]el uso de cámaras digitales en Hollywood ha superado el uso de cámaras de película. [7]

La velocidad de cuadros , el número de imágenes fijas por unidad de tiempo de vídeo, varía de seis u ocho cuadros por segundo ( cuadro/s ) para las antiguas cámaras mecánicas a 120 o más cuadros por segundo para las nuevas cámaras profesionales. Los estándares PAL (Europa, Asia, Australia, etc.) y SECAM (Francia, Rusia, partes de África, etc.) especifican 25 cuadros/s, mientras que los estándares NTSC (Estados Unidos, Canadá, Japón, etc.) especifican 29,97 cuadros/s. [8] La película se graba a una velocidad de cuadros más lenta de 24 cuadros por segundo, lo que complica ligeramente el proceso de transferencia de una película cinematográfica a vídeo. La velocidad de cuadros mínima para lograr una ilusión cómoda de una imagen en movimiento es de unos dieciséis cuadros por segundo. [9]

El video puede ser entrelazado o progresivo . En los sistemas de escaneo progresivo, cada período de actualización actualiza todas las líneas de escaneo en cada cuadro en secuencia. Al mostrar una transmisión o señal grabada de forma nativa progresiva, el resultado es la resolución espacial óptima tanto de las partes estacionarias como de las móviles de la imagen. El entrelazado se inventó como una forma de reducir el parpadeo en las primeras pantallas de video mecánicas y CRT sin aumentar la cantidad de cuadros completos por segundo. El entrelazado conserva los detalles al tiempo que requiere un ancho de banda menor en comparación con el escaneo progresivo. [10] [11]

En el vídeo entrelazado, las líneas de exploración horizontales de cada fotograma completo se tratan como si estuvieran numeradas consecutivamente y se capturan como dos campos : un campo impar (campo superior) que consta de las líneas impares y un campo par (campo inferior) que consta de las líneas pares. Los dispositivos de visualización analógicos reproducen cada fotograma, duplicando efectivamente la velocidad de fotogramas en lo que respecta al parpadeo general perceptible. Cuando el dispositivo de captura de imágenes adquiere los campos uno a la vez, en lugar de dividir un fotograma completo después de capturarlo, la velocidad de fotogramas para el movimiento también se duplica efectivamente, lo que da como resultado una reproducción más suave y más realista de las partes de la imagen que se mueven rápidamente cuando se ven en una pantalla CRT entrelazada. [10] [11]

NTSC, PAL y SECAM son formatos entrelazados. Las especificaciones de resolución de video abreviadas a menudo incluyen una i para indicar entrelazado. Por ejemplo, el formato de video PAL se describe a menudo como 576i50 , donde 576 indica el número total de líneas de exploración horizontales, i indica entrelazado y 50 indica 50 campos (medios fotogramas) por segundo. [11] [12]

Al visualizar una señal entrelazada de forma nativa en un dispositivo de escaneo progresivo, la resolución espacial general se degrada por una simple duplicación de línea (artefactos, como parpadeos o efectos de "peine" en partes móviles de la imagen que aparecen a menos que un procesamiento especial de la señal los elimine). [10] [13] Un procedimiento conocido como desentrelazado puede optimizar la visualización de una señal de video entrelazada de una fuente analógica, de DVD o satelital en un dispositivo de escaneo progresivo como un televisor LCD , un proyector de video digital o un panel de plasma. Sin embargo, el desentrelazado no puede producir una calidad de video que sea equivalente al material de fuente de escaneo progresivo real. [11] [12] [13]

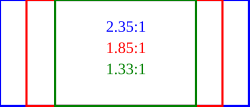

La relación de aspecto describe la relación proporcional entre el ancho y la altura de las pantallas de vídeo y los elementos de imagen del vídeo. Todos los formatos de vídeo populares son rectangulares , y esto se puede describir mediante una relación entre el ancho y la altura. La relación entre el ancho y la altura de una pantalla de televisión tradicional es de 4:3, o aproximadamente 1,33:1. Los televisores de alta definición utilizan una relación de aspecto de 16:9, o aproximadamente 1,78:1. La relación de aspecto de un fotograma completo de una película de 35 mm con banda sonora (también conocida como relación Academy ) es de 1,375:1. [14] [15]

Los píxeles de los monitores de ordenador suelen ser cuadrados, pero los píxeles utilizados en el vídeo digital suelen tener relaciones de aspecto no cuadradas, como las que se utilizan en las variantes PAL y NTSC del estándar de vídeo digital CCIR 601 y los formatos de pantalla ancha anamórficos correspondientes. La trama de 720 x 480 píxeles utiliza píxeles finos en una pantalla con una relación de aspecto de 4:3 y píxeles gruesos en una pantalla de 16:9. [14] [15]

La popularidad de ver videos en teléfonos móviles ha llevado al crecimiento del video vertical . Mary Meeker , socia de la firma de capital de riesgo de Silicon Valley Kleiner Perkins Caufield & Byers , destacó el crecimiento de la visualización de videos verticales en su Informe de tendencias de Internet de 2015, creciendo del 5% de visualización de videos en 2010 al 29% en 2015. Los anuncios de video verticales como los de Snapchat se miran en su totalidad nueve veces más frecuentemente que los anuncios de video horizontales. [16]

El modelo de color utiliza la representación de color del vídeo y asigna valores de color codificados a colores visibles reproducidos por el sistema. Existen varias representaciones de este tipo de uso común: normalmente, YIQ se utiliza en televisión NTSC, YUV se utiliza en televisión PAL, YDbDr se utiliza en televisión SECAM y YCbCr se utiliza para vídeo digital. [17] [18]

La cantidad de colores distintos que puede representar un píxel depende de la profundidad de color expresada en la cantidad de bits por píxel. Una forma habitual de reducir la cantidad de datos necesarios en el vídeo digital es mediante el submuestreo de croma (p. ej., 4:4:4, 4:2:2, etc.). Debido a que el ojo humano es menos sensible a los detalles del color que al brillo, se mantienen los datos de luminancia de todos los píxeles, mientras que los datos de crominancia se promedian para una cantidad de píxeles en un bloque y se utiliza el mismo valor para todos ellos. Por ejemplo, esto da como resultado una reducción del 50 % en los datos de crominancia utilizando bloques de 2 píxeles (4:2:2) o del 75 % utilizando bloques de 4 píxeles (4:2:0). Este proceso no reduce la cantidad de posibles valores de color que se pueden mostrar, pero reduce la cantidad de puntos distintos en los que cambia el color. [12] [17] [18]

La calidad del vídeo se puede medir con métricas formales como la relación señal-ruido (PSNR) o mediante una evaluación subjetiva de la calidad del vídeo mediante la observación de expertos. En la recomendación BT.500 de la UIT-T se describen muchos métodos subjetivos de calidad de vídeo . Uno de los métodos estandarizados es la Escala de deterioro por doble estímulo (DSIS). En la DSIS, cada experto ve un vídeo de referencia sin deterioro , seguido de una versión deteriorada del mismo vídeo. A continuación, el experto califica el vídeo deteriorado utilizando una escala que va desde "los deterioros son imperceptibles" hasta "los deterioros son muy molestos".

El vídeo sin comprimir ofrece la máxima calidad, pero a una velocidad de datos muy alta . Se utilizan diversos métodos para comprimir secuencias de vídeo, siendo los más eficaces los que utilizan un grupo de imágenes (GOP) para reducir la redundancia espacial y temporal . En términos generales, la redundancia espacial se reduce registrando las diferencias entre partes de un mismo fotograma; esta tarea se conoce como compresión intrafotograma y está estrechamente relacionada con la compresión de imágenes . Del mismo modo, la redundancia temporal se puede reducir registrando las diferencias entre fotogramas; esta tarea se conoce como compresión interfotograma , que incluye la compensación de movimiento y otras técnicas. Los estándares de compresión modernos más comunes son MPEG-2 , utilizado para DVD , Blu-ray y televisión por satélite , y MPEG-4 , utilizado para AVCHD , teléfonos móviles (3GP) e Internet. [19] [20]

El vídeo estereoscópico para películas 3D y otras aplicaciones se puede visualizar utilizando varios métodos diferentes: [21] [22]

Cada una de las diferentes capas de transmisión y almacenamiento de vídeo proporciona su propio conjunto de formatos para elegir.

Para la transmisión, existe un conector físico y un protocolo de señal (consulte la Lista de conectores de video ). Un enlace físico determinado puede transportar ciertos estándares de visualización que especifican una frecuencia de actualización, una resolución de pantalla y un espacio de color particulares .

Se utilizan muchos formatos de grabación analógicos y digitales, y los videoclips digitales también se pueden almacenar en un sistema de archivos informático como archivos, que tienen sus propios formatos. Además del formato físico utilizado por el dispositivo de almacenamiento de datos o el medio de transmisión, el flujo de unos y ceros que se envía debe estar en un formato de codificación de video digital particular , para el cual hay un número disponible.

El vídeo analógico es una señal de vídeo representada por una o más señales analógicas . Las señales de vídeo en color analógicas incluyen luminancia (Y) y crominancia (C). Cuando se combinan en un canal, como es el caso, entre otros, de NTSC , PAL y SECAM , se denomina vídeo compuesto . El vídeo analógico puede transportarse en canales separados, como en los formatos de vídeo componente multicanal y S-Video (YC) de dos canales .

El vídeo analógico se utiliza en aplicaciones de producción de televisión tanto profesionales como de consumo .

Se han adoptado formatos de señales de vídeo digitales , incluida la interfaz digital en serie (SDI), la interfaz visual digital (DVI), la interfaz multimedia de alta definición (HDMI) y la interfaz DisplayPort .

El vídeo se puede transmitir o transportar de diversas formas, como la televisión terrestre inalámbrica como señal analógica o digital, o el cable coaxial en un sistema de circuito cerrado como señal analógica. Las cámaras de estudio o de transmisión utilizan un sistema de cable coaxial simple o doble mediante una interfaz digital en serie (SDI). Consulte la Lista de conectores de vídeo para obtener información sobre los conectores físicos y los estándares de señal relacionados.

El vídeo puede transportarse a través de redes y otros enlaces de comunicaciones digitales compartidos utilizando, por ejemplo, el flujo de transporte MPEG , SMPTE 2022 y SMPTE 2110 .

Las transmisiones de televisión digital utilizan MPEG-2 y otros formatos de codificación de video e incluyen:

Los estándares de transmisión de televisión analógica incluyen:

Un formato de vídeo analógico consta de más información que el contenido visible del fotograma. Antes y después de la imagen hay líneas y píxeles que contienen metadatos e información de sincronización. Este margen circundante se conoce como intervalo de supresión o región de supresión ; el porche delantero y el porche trasero horizontales y verticales son los componentes básicos del intervalo de supresión.

Los estándares de pantalla de computadora especifican una combinación de relación de aspecto, tamaño de pantalla, resolución de pantalla, profundidad de color y frecuencia de actualización. Hay una lista de resoluciones comunes disponible.

La televisión en sus inicios era casi exclusivamente un medio en vivo, con algunos programas grabados en película con fines históricos utilizando Kinescope . La grabadora de cinta de vídeo analógica se introdujo comercialmente en 1951. La siguiente lista está en orden cronológico aproximado. Todos los formatos enumerados fueron vendidos y utilizados por emisoras, productores de vídeo o consumidores; o fueron importantes históricamente. [23] [24]

Las grabadoras de vídeo digitales ofrecían una calidad mejorada en comparación con las grabadoras analógicas. [24] [26]

Los medios de almacenamiento óptico ofrecían una alternativa, especialmente en aplicaciones de consumo, a los voluminosos formatos de cinta. [23] [27]

Un códec de vídeo es un software o hardware que comprime y descomprime vídeo digital . En el contexto de la compresión de vídeo, códec es un acrónimo de codificador y decodificador , mientras que un dispositivo que solo comprime se suele llamar codificador , y uno que solo descomprime es un decodificador . El formato de datos comprimidos suele ajustarse a un formato de codificación de vídeo estándar . La compresión suele ser con pérdida , lo que significa que el vídeo comprimido carece de cierta información presente en el vídeo original. Una consecuencia de esto es que el vídeo descomprimido tiene una calidad inferior a la del vídeo original sin comprimir porque no hay suficiente información para reconstruir con precisión el vídeo original. [28]

{{cite book}}: Mantenimiento de CS1: falta la ubicación del editor ( enlace ){{cite book}}: Mantenimiento de CS1: falta la ubicación del editor ( enlace ){{cite book}}: Mantenimiento de CS1: falta la ubicación del editor ( enlace )