La predicción numérica del tiempo ( NWP ) utiliza modelos matemáticos de la atmósfera y los océanos para predecir el tiempo basándose en las condiciones meteorológicas actuales. Aunque se intentó por primera vez en la década de 1920, no fue hasta la llegada de la simulación por ordenador en la década de 1950 que las predicciones numéricas del tiempo produjeron resultados realistas. En diferentes países del mundo se ejecutan varios modelos de pronóstico globales y regionales que utilizan como entrada las observaciones meteorológicas actuales transmitidas por radiosondas , satélites meteorológicos y otros sistemas de observación.

Los modelos matemáticos basados en los mismos principios físicos se pueden utilizar para generar pronósticos meteorológicos a corto plazo o predicciones climáticas a largo plazo; estas últimas se aplican ampliamente para comprender y proyectar el cambio climático . Las mejoras realizadas en los modelos regionales han permitido mejoras significativas en los pronósticos de la trayectoria de los ciclones tropicales y de la calidad del aire ; sin embargo, los modelos atmosféricos funcionan mal a la hora de manejar procesos que ocurren en un área relativamente restringida, como los incendios forestales .

Para manipular los grandes conjuntos de datos y realizar los complejos cálculos necesarios para la predicción numérica moderna del tiempo se necesitan algunas de las supercomputadoras más potentes del mundo. Incluso con la creciente potencia de las supercomputadoras, la capacidad de predicción de los modelos numéricos del tiempo se extiende a sólo unos seis días. Los factores que afectan a la precisión de las predicciones numéricas incluyen la densidad y la calidad de las observaciones utilizadas como entrada para las predicciones, junto con las deficiencias en los propios modelos numéricos. Se han desarrollado técnicas de posprocesamiento como las estadísticas de salida del modelo (MOS) para mejorar el manejo de los errores en las predicciones numéricas.

Un problema más fundamental radica en la naturaleza caótica de las ecuaciones diferenciales parciales que describen la atmósfera. Es imposible resolver estas ecuaciones con exactitud, y los pequeños errores aumentan con el tiempo (duplicándose aproximadamente cada cinco días). La comprensión actual es que este comportamiento caótico limita los pronósticos precisos a unos 14 días, incluso con datos de entrada precisos y un modelo perfecto. Además, las ecuaciones diferenciales parciales utilizadas en el modelo deben complementarse con parametrizaciones para la radiación solar , los procesos húmedos (nubes y precipitación ), el intercambio de calor , el suelo, la vegetación, el agua superficial y los efectos del terreno. En un esfuerzo por cuantificar la gran cantidad de incertidumbre inherente que permanece en las predicciones numéricas, los pronósticos de conjunto se han utilizado desde la década de 1990 para ayudar a medir la confianza en el pronóstico y obtener resultados útiles más lejanos en el futuro de lo que sería posible de otra manera. Este enfoque analiza múltiples pronósticos creados con un modelo de pronóstico individual o múltiples modelos.

La historia de la predicción numérica del tiempo comenzó en la década de 1920 gracias a los esfuerzos de Lewis Fry Richardson , quien utilizó procedimientos desarrollados originalmente por Vilhelm Bjerknes [1] para producir a mano un pronóstico de seis horas del estado de la atmósfera en dos puntos de Europa central, tardando al menos seis semanas en hacerlo. [2] [1] [3] No fue hasta la llegada de la computadora y las simulaciones por computadora que el tiempo de cálculo se redujo a menos del período de pronóstico en sí. El ENIAC se utilizó para crear los primeros pronósticos meteorológicos por computadora en 1950, basados en una aproximación altamente simplificada a las ecuaciones que gobiernan la atmósfera. [4] [5] En 1954, el grupo de Carl-Gustav Rossby en el Instituto Meteorológico e Hidrológico Sueco utilizó el mismo modelo para producir el primer pronóstico operativo (es decir, una predicción de rutina para uso práctico). [6] La predicción numérica operacional del tiempo en los Estados Unidos comenzó en 1955 bajo la Unidad Conjunta de Predicción Numérica del Tiempo (JNWPU), un proyecto conjunto de la Fuerza Aérea , la Armada y la Oficina Meteorológica de los Estados Unidos . [7] En 1956, Norman Phillips desarrolló un modelo matemático que podía representar de manera realista los patrones mensuales y estacionales en la troposfera; este se convirtió en el primer modelo climático exitoso . [8] [9] Después del trabajo de Phillips, varios grupos comenzaron a trabajar para crear modelos de circulación general . [10] El primer modelo climático de circulación general que combinaba procesos oceánicos y atmosféricos se desarrolló a fines de la década de 1960 en el Laboratorio de Dinámica de Fluidos Geofísicos de la NOAA . [11]

A medida que las computadoras se han vuelto más poderosas, el tamaño de los conjuntos de datos iniciales ha aumentado y se han desarrollado modelos atmosféricos más nuevos para aprovechar la potencia computacional adicional disponible. Estos modelos más nuevos incluyen más procesos físicos en las simplificaciones de las ecuaciones de movimiento en simulaciones numéricas de la atmósfera. [6] En 1966, Alemania Occidental y los Estados Unidos comenzaron a producir pronósticos operativos basados en modelos de ecuaciones primitivas , seguidos por el Reino Unido en 1972 y Australia en 1977. [1] [12] El desarrollo de modelos de área limitada (regionales) facilitó avances en el pronóstico de las trayectorias de los ciclones tropicales , así como de la calidad del aire en los años 1970 y 1980. [13] [14] A principios de la década de 1980, los modelos comenzaron a incluir las interacciones del suelo y la vegetación con la atmósfera, lo que llevó a pronósticos más realistas. [15]

Los resultados de los modelos de predicción basados en la dinámica atmosférica no permiten resolver algunos detalles del clima cerca de la superficie de la Tierra. Por ello, en los años 1970 y 1980 se desarrolló una relación estadística entre los resultados de un modelo meteorológico numérico y las condiciones resultantes en el terreno, conocida como estadísticas de resultados de modelos (MOS). [16] [17] A partir de los años 1990, se han utilizado pronósticos de conjuntos de modelos para ayudar a definir la incertidumbre de los pronósticos y ampliar el período en el que los pronósticos numéricos del clima son viables más allá de lo que sería posible de otro modo. [18] [19] [20]

La atmósfera es un fluido . Como tal, la idea de la predicción numérica del tiempo es tomar muestras del estado del fluido en un momento dado y usar las ecuaciones de la dinámica de fluidos y la termodinámica para estimar el estado del fluido en algún momento en el futuro. El proceso de ingresar datos de observación en el modelo para generar condiciones iniciales se llama inicialización . En tierra, los mapas de terreno disponibles en resoluciones de hasta 1 kilómetro (0,6 mi) a nivel mundial se utilizan para ayudar a modelar las circulaciones atmosféricas dentro de regiones de topografía accidentada, con el fin de representar mejor características como vientos descendentes, ondas de montaña y nubosidad relacionada que afecta la radiación solar entrante. [21] Las principales entradas de los servicios meteorológicos de los países son observaciones de dispositivos (llamados radiosondas ) en globos meteorológicos que miden varios parámetros atmosféricos y los transmiten a un receptor fijo, así como de satélites meteorológicos . La Organización Meteorológica Mundial actúa para estandarizar la instrumentación, las prácticas de observación y el tiempo de estas observaciones en todo el mundo. Las estaciones informan cada hora en informes METAR , [22] o cada seis horas en informes SYNOP . [23] Estas observaciones están espaciadas irregularmente, por lo que son procesadas mediante métodos de asimilación de datos y análisis objetivo, que realizan un control de calidad y obtienen valores en ubicaciones utilizables por los algoritmos matemáticos del modelo. [24] Los datos luego se utilizan en el modelo como punto de partida para un pronóstico. [25]

Se utilizan diversos métodos para reunir datos de observación para su uso en modelos numéricos. Los sitios lanzan radiosondas en globos meteorológicos que se elevan a través de la troposfera y hasta la estratosfera . [26] La información de los satélites meteorológicos se utiliza donde no se dispone de fuentes de datos tradicionales. Commerce proporciona informes de pilotos a lo largo de las rutas de las aeronaves [27] e informes de barcos a lo largo de las rutas de navegación. [28] Los proyectos de investigación utilizan aviones de reconocimiento para volar dentro y alrededor de los sistemas meteorológicos de interés, como los ciclones tropicales . [29] [30] Los aviones de reconocimiento también vuelan sobre los océanos abiertos durante la temporada fría en sistemas que causan una incertidumbre significativa en la guía de pronóstico, o se espera que tengan un alto impacto de tres a siete días en el futuro sobre el continente río abajo. [31] El hielo marino comenzó a inicializarse en los modelos de pronóstico en 1971. [32] Los esfuerzos para involucrar la temperatura de la superficie del mar en la inicialización del modelo comenzaron en 1972 debido a su papel en la modulación del clima en latitudes más altas del Pacífico. [33]

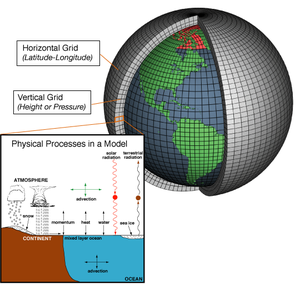

Un modelo atmosférico es un programa informático que produce información meteorológica para tiempos futuros en lugares y altitudes determinados. Dentro de cualquier modelo moderno hay un conjunto de ecuaciones, conocidas como ecuaciones primitivas , que se utilizan para predecir el estado futuro de la atmósfera. [34] Estas ecuaciones, junto con la ley de los gases ideales , se utilizan para desarrollar los campos escalares de densidad , presión y temperatura potencial y el campo vectorial de velocidad del aire (viento) de la atmósfera a través del tiempo. También se incluyen ecuaciones de transporte adicionales para contaminantes y otros aerosoles en algunos modelos de alta resolución de ecuaciones primitivas. [35] Las ecuaciones utilizadas son ecuaciones diferenciales parciales no lineales que son imposibles de resolver exactamente a través de métodos analíticos, [36] con la excepción de unos pocos casos idealizados. [37] Por lo tanto, los métodos numéricos obtienen soluciones aproximadas. Diferentes modelos utilizan diferentes métodos de solución: algunos modelos globales y casi todos los modelos regionales utilizan métodos de diferencias finitas para las tres dimensiones espaciales, mientras que otros modelos globales y algunos modelos regionales utilizan métodos espectrales para las dimensiones horizontales y métodos de diferencias finitas en la vertical. [36]

Estas ecuaciones se inicializan a partir de los datos de análisis y se determinan las tasas de cambio. Estas tasas de cambio predicen el estado de la atmósfera en un corto tiempo en el futuro; el incremento de tiempo para esta predicción se llama paso de tiempo . Este estado atmosférico futuro se utiliza luego como punto de partida para otra aplicación de las ecuaciones predictivas para encontrar nuevas tasas de cambio, y estas nuevas tasas de cambio predicen la atmósfera en un paso de tiempo aún más en el futuro. Este paso de tiempo se repite hasta que la solución alcanza el tiempo de pronóstico deseado. La longitud del paso de tiempo elegido dentro del modelo está relacionada con la distancia entre los puntos en la cuadrícula computacional y se elige para mantener la estabilidad numérica . [38] Los pasos de tiempo para los modelos globales son del orden de decenas de minutos, [39] mientras que los pasos de tiempo para los modelos regionales son entre uno y cuatro minutos. [40] Los modelos globales se ejecutan en diferentes momentos en el futuro. El modelo unificado de UKMET se ejecuta seis días en el futuro, [41] mientras que el Sistema de pronóstico integrado del Centro europeo de pronósticos meteorológicos a medio plazo y el Modelo multiescala ambiental global de Environment Canada se ejecutan hasta diez días en el futuro, [42] y el modelo del Sistema de pronóstico global ejecutado por el Centro de modelado ambiental se ejecuta dieciséis días en el futuro. [43] La salida visual producida por una solución de modelo se conoce como un gráfico de pronóstico o prog . [44]

Algunos procesos meteorológicos son demasiado pequeños o demasiado complejos para incluirlos explícitamente en los modelos numéricos de predicción del tiempo. La parametrización es un procedimiento para representar estos procesos relacionándolos con variables en las escalas que resuelve el modelo. Por ejemplo, las cuadrículas de los modelos meteorológicos y climáticos tienen lados de entre 5 y 300 kilómetros de longitud. Un cúmulo típico tiene una escala de menos de 1 kilómetro y requeriría una cuadrícula aún más fina para ser representada físicamente por las ecuaciones del movimiento de fluidos. Por lo tanto, los procesos que representan dichas nubes están parametrizados mediante procesos de diversa sofisticación. En los primeros modelos, si una columna de aire dentro de una cuadrícula del modelo era condicionalmente inestable (esencialmente, la parte inferior era más cálida y húmeda que la superior) y el contenido de vapor de agua en cualquier punto dentro de la columna se saturaba, entonces se volcaba (el aire cálido y húmedo comenzaba a ascender) y el aire en esa columna vertical se mezclaba. Los esquemas más sofisticados reconocen que sólo algunas porciones de la caja pueden conveccionarse y que se producen arrastre y otros procesos. Los modelos meteorológicos que tienen cajas de cuadrícula con tamaños entre 5 y 25 kilómetros (3 y 16 millas) pueden representar explícitamente las nubes convectivas, aunque necesitan parametrizar la microfísica de las nubes que se produce a una escala menor. [45] La formación de nubes a gran escala ( tipo estratos ) tiene una base más física; se forman cuando la humedad relativa alcanza un valor prescrito. La fracción de nubes se puede relacionar con este valor crítico de humedad relativa. [46]

La cantidad de radiación solar que llega al suelo, así como la formación de gotitas de nubes, ocurren a escala molecular, por lo que deben parametrizarse antes de que puedan incluirse en el modelo. El arrastre atmosférico producido por las montañas también debe parametrizarse, ya que las limitaciones en la resolución de los contornos de elevación producen subestimaciones significativas del arrastre. [47] Este método de parametrización también se realiza para el flujo de energía superficial entre el océano y la atmósfera, con el fin de determinar temperaturas realistas de la superficie del mar y el tipo de hielo marino que se encuentra cerca de la superficie del océano. [48] Se tiene en cuenta el ángulo del sol, así como el impacto de múltiples capas de nubes. [49] El tipo de suelo, el tipo de vegetación y la humedad del suelo determinan cuánta radiación entra en el calentamiento y cuánta humedad se absorbe en la atmósfera adyacente, por lo que es importante parametrizar su contribución a estos procesos. [50] Dentro de los modelos de calidad del aire, las parametrizaciones tienen en cuenta las emisiones atmosféricas de múltiples fuentes relativamente pequeñas (por ejemplo, carreteras, campos, fábricas) dentro de casillas de cuadrícula específicas. [51]

El dominio horizontal de un modelo es global , cubriendo toda la Tierra, o regional , cubriendo solo una parte de ella. Los modelos regionales (también conocidos como modelos de área limitada o LAM) permiten el uso de un espaciado de cuadrícula más fino que los modelos globales porque los recursos computacionales disponibles se concentran en un área específica en lugar de estar esparcidos por todo el globo. Esto permite que los modelos regionales resuelvan explícitamente fenómenos meteorológicos de escala más pequeña que no se pueden representar en la cuadrícula más gruesa de un modelo global. Los modelos regionales utilizan un modelo global para especificar las condiciones en el borde de su dominio ( condiciones de contorno ) para permitir que los sistemas de fuera del dominio del modelo regional se muevan hacia su área. La incertidumbre y los errores dentro de los modelos regionales son introducidos por el modelo global utilizado para las condiciones de contorno del borde del modelo regional, así como los errores atribuibles al propio modelo regional. [52]

La coordenada vertical se maneja de varias maneras. El modelo de Lewis Fry Richardson de 1922 utilizó la altura geométrica ( ) como coordenada vertical. Los modelos posteriores sustituyeron la coordenada geométrica por un sistema de coordenadas de presión, en el que las alturas geopotenciales de las superficies de presión constante se convierten en variables dependientes , simplificando enormemente las ecuaciones primitivas. [53] Esta correlación entre sistemas de coordenadas se puede realizar ya que la presión disminuye con la altura a través de la atmósfera de la Tierra . [54] El primer modelo utilizado para pronósticos operativos, el modelo barotrópico de una sola capa, utilizó una sola coordenada de presión en el nivel de 500 milibares (aproximadamente 5500 m (18 000 pies)), [4] y, por lo tanto, era esencialmente bidimensional. Los modelos de alta resolución, también llamados modelos de mesoescala , como el modelo Weather Research and Forecasting tienden a utilizar coordenadas de presión normalizadas denominadas coordenadas sigma . [55] Este sistema de coordenadas recibe su nombre de la variable independiente utilizada para escalar las presiones atmosféricas con respecto a la presión en la superficie, y en algunos casos también con la presión en la parte superior del dominio. [56]

Debido a que los modelos de pronóstico basados en las ecuaciones de la dinámica atmosférica no determinan perfectamente las condiciones meteorológicas, se han desarrollado métodos estadísticos para intentar corregir los pronósticos. Se crearon modelos estadísticos basados en los campos tridimensionales producidos por los modelos meteorológicos numéricos, las observaciones de superficie y las condiciones climatológicas para lugares específicos. Estos modelos estadísticos se conocen colectivamente como estadísticas de salida del modelo (MOS), [57] y fueron desarrollados por el Servicio Meteorológico Nacional para su conjunto de modelos de pronóstico del tiempo a fines de la década de 1960. [16] [58]

Las estadísticas de salida del modelo difieren de la técnica de prog perfecto , que supone que la salida de la guía de predicción numérica del tiempo es perfecta. [59] MOS puede corregir los efectos locales que no pueden ser resueltos por el modelo debido a una resolución de cuadrícula insuficiente, así como los sesgos del modelo. Debido a que MOS se ejecuta después de su respectivo modelo global o regional, su producción se conoce como posprocesamiento. Los parámetros de pronóstico dentro de MOS incluyen temperaturas máximas y mínimas, probabilidad porcentual de lluvia dentro de un período de varias horas, cantidad de precipitación esperada, probabilidad de que la precipitación sea de naturaleza congelada, probabilidad de tormentas eléctricas, nubosidad y vientos superficiales. [60]

En 1963, Edward Lorenz descubrió la naturaleza caótica de las ecuaciones de dinámica de fluidos involucradas en la predicción meteorológica. [61] Los errores extremadamente pequeños en temperatura, vientos u otros datos iniciales dados a los modelos numéricos se amplificarán y duplicarán cada cinco días, [61] haciendo imposible que los pronósticos de largo plazo (aquellos realizados con más de dos semanas de anticipación) predigan el estado de la atmósfera con algún grado de habilidad de pronóstico . Además, las redes de observación existentes tienen una cobertura deficiente en algunas regiones (por ejemplo, sobre grandes masas de agua como el Océano Pacífico), lo que introduce incertidumbre en el verdadero estado inicial de la atmósfera. Si bien existe un conjunto de ecuaciones, conocidas como ecuaciones de Liouville , para determinar la incertidumbre inicial en la inicialización del modelo, las ecuaciones son demasiado complejas para ejecutarlas en tiempo real, incluso con el uso de supercomputadoras. [62] Estas incertidumbres limitan la precisión del modelo de pronóstico a aproximadamente cinco o seis días en el futuro. [63] [64]

Edward Epstein reconoció en 1969 que la atmósfera no podía describirse completamente con una única ejecución de pronóstico debido a la incertidumbre inherente, y propuso utilizar un conjunto de simulaciones estocásticas de Monte Carlo para producir medias y varianzas para el estado de la atmósfera. [65] Aunque este primer ejemplo de un conjunto mostró habilidad, en 1974 Cecil Leith demostró que producían pronósticos adecuados solo cuando la distribución de probabilidad del conjunto era una muestra representativa de la distribución de probabilidad en la atmósfera. [66]

Desde la década de 1990, los pronósticos de conjunto se han utilizado operativamente (como pronósticos de rutina) para dar cuenta de la naturaleza estocástica de los procesos meteorológicos, es decir, para resolver su incertidumbre inherente. Este método implica analizar múltiples pronósticos creados con un modelo de pronóstico individual utilizando diferentes parametrizaciones físicas o variando las condiciones iniciales. [62] A partir de 1992 con los pronósticos de conjunto preparados por el Centro Europeo de Pronósticos Meteorológicos de Plazo Medio (ECMWF) y los Centros Nacionales de Predicción Ambiental , los pronósticos de conjunto de modelos se han utilizado para ayudar a definir la incertidumbre del pronóstico y para extender la ventana en la que el pronóstico numérico del tiempo es viable más lejos en el futuro de lo que sería posible de otra manera. [18] [19] [20] El modelo ECMWF, el Sistema de Predicción de Conjuntos, [19] utiliza vectores singulares para simular la densidad de probabilidad inicial , mientras que el conjunto NCEP, el Sistema de Pronóstico de Conjuntos Globales, utiliza una técnica conocida como cría de vectores . [18] [20] La Oficina Meteorológica del Reino Unido ejecuta pronósticos de conjunto globales y regionales donde las perturbaciones de las condiciones iniciales son utilizadas por 24 miembros del conjunto en el Sistema de Predicción de Conjunto Global y Regional de la Oficina Meteorológica (MOGREPS) para producir 24 pronósticos diferentes. [67]

En un enfoque basado en un solo modelo, el pronóstico del conjunto generalmente se evalúa en términos de un promedio de los pronósticos individuales con respecto a una variable de pronóstico, así como el grado de acuerdo entre varios pronósticos dentro del sistema de conjunto, como se representa por su dispersión general. La dispersión del conjunto se diagnostica a través de herramientas como los diagramas de espagueti , que muestran la dispersión de una cantidad en los gráficos de pronóstico para pasos de tiempo específicos en el futuro. Otra herramienta donde se utiliza la dispersión del conjunto es un meteograma , que muestra la dispersión en el pronóstico de una cantidad para una ubicación específica. Es común que la dispersión del conjunto sea demasiado pequeña para incluir el clima que realmente ocurre, lo que puede llevar a los pronosticadores a diagnosticar erróneamente la incertidumbre del modelo; [68] este problema se vuelve particularmente grave para los pronósticos del clima con unos diez días de anticipación. [69] Cuando la dispersión del conjunto es pequeña y las soluciones de pronóstico son consistentes dentro de múltiples ejecuciones del modelo, los pronosticadores perciben más confianza en la media del conjunto y el pronóstico en general. [68] A pesar de esta percepción, la relación entre dispersión y habilidad de pronóstico es a menudo débil o no se encuentra, ya que las correlaciones dispersión-error normalmente son menores a 0,6, y solo en circunstancias especiales varían entre 0,6 y 0,7. [70] La relación entre dispersión de conjunto y habilidad de pronóstico varía sustancialmente dependiendo de factores tales como el modelo de pronóstico y la región para la cual se realiza el pronóstico. [ cita requerida ]

De la misma manera que se pueden utilizar muchos pronósticos de un solo modelo para formar un conjunto, también se pueden combinar varios modelos para producir un pronóstico de conjunto. Este enfoque se denomina pronóstico de conjunto de múltiples modelos y se ha demostrado que mejora los pronósticos en comparación con un enfoque basado en un solo modelo. [71] Los modelos dentro de un conjunto de múltiples modelos se pueden ajustar para sus diversos sesgos, lo que es un proceso conocido como pronóstico de superconjunto . Este tipo de pronóstico reduce significativamente los errores en la salida del modelo. [72]

Los pronósticos de la calidad del aire intentan predecir cuándo las concentraciones de contaminantes alcanzarán niveles que sean peligrosos para la salud pública. La concentración de contaminantes en la atmósfera está determinada por su transporte , o velocidad media de movimiento a través de la atmósfera, su difusión , transformación química y deposición en el suelo . [73] Además de la información sobre la fuente de contaminantes y el terreno, estos modelos requieren datos sobre el estado del flujo de fluidos en la atmósfera para determinar su transporte y difusión. [74] Las condiciones meteorológicas como las inversiones térmicas pueden evitar que el aire de la superficie se eleve, atrapando contaminantes cerca de la superficie, [75] lo que hace que los pronósticos precisos de tales eventos sean cruciales para el modelado de la calidad del aire. Los modelos de calidad del aire urbano requieren una malla computacional muy fina, lo que requiere el uso de modelos meteorológicos de mesoescala de alta resolución; a pesar de esto, la calidad de la guía meteorológica numérica es la principal incertidumbre en los pronósticos de la calidad del aire. [74]

Un modelo de circulación general (GCM) es un modelo matemático que se puede utilizar en simulaciones por computadora de la circulación global de una atmósfera planetaria o un océano. Un modelo de circulación general atmosférica (AGCM) es esencialmente lo mismo que un modelo numérico global de predicción meteorológica, y algunos (como el utilizado en el Modelo Unificado del Reino Unido) se pueden configurar tanto para pronósticos meteorológicos a corto plazo como para predicciones climáticas a largo plazo. Junto con el hielo marino y los componentes de la superficie terrestre, los AGCM y los GCM oceánicos (OGCM) son componentes clave de los modelos climáticos globales y se aplican ampliamente para comprender el clima y proyectar el cambio climático . Para los aspectos del cambio climático, se puede introducir una variedad de escenarios de emisiones químicas creadas por el hombre en los modelos climáticos para ver cómo un efecto invernadero mejorado modificaría el clima de la Tierra. [76] Las versiones diseñadas para aplicaciones climáticas con escalas de tiempo de décadas a siglos fueron creadas originalmente en 1969 por Syukuro Manabe y Kirk Bryan en el Laboratorio de Dinámica de Fluidos Geofísicos en Princeton, Nueva Jersey . [77] Cuando se ejecutan durante varias décadas, las limitaciones computacionales significan que los modelos deben utilizar una cuadrícula gruesa que deja sin resolver las interacciones de menor escala. [78]

La transferencia de energía entre el viento que sopla sobre la superficie de un océano y la capa superior del océano es un elemento importante en la dinámica de las olas. [79] La ecuación de transporte espectral de las olas se utiliza para describir el cambio en el espectro de las olas a medida que cambia la topografía. Simula la generación de olas, el movimiento de las olas (propagación dentro de un fluido), la reducción de las olas , la refracción , la transferencia de energía entre olas y la disipación de las olas. [80] Dado que los vientos superficiales son el principal mecanismo de fuerza en la ecuación de transporte espectral de las olas, los modelos de olas oceánicas utilizan la información producida por los modelos numéricos de predicción meteorológica como entradas para determinar cuánta energía se transfiere desde la atmósfera a la capa en la superficie del océano. Junto con la disipación de energía a través de crestas blancas y la resonancia entre olas, los vientos superficiales de los modelos numéricos meteorológicos permiten predicciones más precisas del estado de la superficie del mar. [81]

La predicción de ciclones tropicales también se basa en datos proporcionados por modelos numéricos del tiempo. Existen tres clases principales de modelos de orientación de ciclones tropicales : Los modelos estadísticos se basan en un análisis del comportamiento de las tormentas utilizando la climatología y correlacionan la posición y la fecha de una tormenta para producir un pronóstico que no se basa en la física de la atmósfera en ese momento. Los modelos dinámicos son modelos numéricos que resuelven las ecuaciones que gobiernan el flujo de fluidos en la atmósfera; se basan en los mismos principios que otros modelos numéricos de predicción del tiempo de área limitada, pero pueden incluir técnicas computacionales especiales, como dominios espaciales refinados que se mueven junto con el ciclón. Los modelos que utilizan elementos de ambos enfoques se denominan modelos estadístico-dinámicos. [82]

En 1978, comenzó a funcionar el primer modelo de seguimiento de huracanes basado en la dinámica atmosférica , el modelo de malla fina móvil (MFM). [13] En el campo de la predicción de la trayectoria de los ciclones tropicales , a pesar de la guía de modelos dinámicos en constante mejora que se produjo con el aumento de la potencia computacional, no fue hasta la década de 1980 cuando la predicción numérica del tiempo mostró su habilidad , y hasta la década de 1990 cuando superó consistentemente a los modelos estadísticos o dinámicos simples. [83] Las predicciones de la intensidad de un ciclón tropical basadas en la predicción numérica del tiempo siguen siendo un desafío, ya que los métodos estadísticos siguen mostrando una mayor habilidad que la guía dinámica. [84]

A escala molecular, hay dos procesos de reacción principales que compiten en la degradación de la celulosa , o de los combustibles de madera, en los incendios forestales . Cuando hay una baja cantidad de humedad en una fibra de celulosa, se produce la volatilización del combustible; este proceso generará productos gaseosos intermedios que, en última instancia, serán la fuente de la combustión . Cuando hay humedad presente, o cuando se está alejando suficiente calor de la fibra, se produce la carbonización . La cinética química de ambas reacciones indica que hay un punto en el que el nivel de humedad es lo suficientemente bajo, y/o las tasas de calentamiento lo suficientemente altas, para que los procesos de combustión se vuelvan autosuficientes. En consecuencia, los cambios en la velocidad del viento, la dirección, la humedad, la temperatura o la tasa de gradiente térmico en diferentes niveles de la atmósfera pueden tener un impacto significativo en el comportamiento y el crecimiento de un incendio forestal. Dado que el incendio forestal actúa como una fuente de calor para el flujo atmosférico, el incendio forestal puede modificar los patrones de advección locales , introduciendo un bucle de retroalimentación entre el incendio y la atmósfera. [85]

Un modelo bidimensional simplificado para la propagación de incendios forestales que utilizó la convección para representar los efectos del viento y el terreno, así como la transferencia de calor radiativo como el método dominante de transporte de calor condujo a sistemas de reacción-difusión de ecuaciones diferenciales parciales . [86] [87] Los modelos más complejos unen modelos numéricos meteorológicos o modelos de dinámica de fluidos computacional con un componente de incendios forestales que permiten estimar los efectos de retroalimentación entre el incendio y la atmósfera. [85] La complejidad adicional en la última clase de modelos se traduce en un aumento correspondiente en sus requisitos de potencia de cómputo. De hecho, un tratamiento tridimensional completo de la combustión mediante simulación numérica directa a escalas relevantes para el modelado atmosférico no es práctico actualmente debido al excesivo costo computacional que requeriría tal simulación. Los modelos numéricos meteorológicos tienen una capacidad de pronóstico limitada en resoluciones espaciales inferiores a 1 kilómetro (0,6 mi), lo que obliga a los modelos complejos de incendios forestales a parametrizar el incendio para calcular cómo los vientos serán modificados localmente por el incendio forestal, y utilizar esos vientos modificados para determinar la velocidad a la que el incendio se propagará localmente. [88] [89] [90] Aunque modelos como FIRETEC de Los Álamos resuelven las concentraciones de combustible y oxígeno , la cuadrícula computacional no puede ser lo suficientemente fina para resolver la reacción de combustión, por lo que se deben hacer aproximaciones para la distribución de temperatura dentro de cada celda de la cuadrícula, así como para las tasas de reacción de combustión en sí. [ cita requerida ]

{{cite web}}: CS1 maint: nombres numéricos: lista de autores ( enlace ){{cite book}}: CS1 maint: varios nombres: lista de autores ( enlace ){{cite book}}: CS1 maint: varios nombres: lista de autores ( enlace ){{cite web}}: CS1 maint: nombres numéricos: lista de autores ( enlace ){{cite book}}: CS1 maint: varios nombres: lista de autores ( enlace ){{cite journal}}: CS1 maint: varios nombres: lista de autores ( enlace ){{cite journal}}: CS1 maint: varios nombres: lista de autores ( enlace ){{cite journal}}: CS1 maint: varios nombres: lista de autores ( enlace )