La obtención de imágenes por rayos X con contraste de fase o imágenes por rayos X sensibles a la fase es un término general para diferentes métodos técnicos que utilizan información sobre los cambios en la fase de un haz de rayos X que pasa a través de un objeto para crear sus imágenes. Las técnicas estándar de obtención de imágenes por rayos X, como la radiografía o la tomografía computarizada (TC), se basan en una disminución de la intensidad del haz de rayos X ( atenuación ) al atravesar la muestra , que se puede medir directamente con la ayuda de un detector de rayos X. Sin embargo, en la obtención de imágenes por rayos X con contraste de fase, el cambio de fase del haz causado por la muestra no se mide directamente, sino que se transforma en variaciones de intensidad, que luego pueden ser registradas por el detector. [1]

Además de producir imágenes de proyección , la obtención de imágenes de rayos X con contraste de fase, al igual que la transmisión convencional, se puede combinar con técnicas tomográficas para obtener la distribución 3D de la parte real del índice de refracción de la muestra. Cuando se aplica a muestras que consisten en átomos con un número atómico Z bajo , la obtención de imágenes de rayos X con contraste de fase es más sensible a las variaciones de densidad en la muestra que la obtención de imágenes de rayos X con transmisión convencional . Esto conduce a imágenes con un contraste de tejido blando mejorado . [2]

En los últimos años, se han desarrollado diversas técnicas de obtención de imágenes de rayos X por contraste de fase, todas ellas basadas en la observación de patrones de interferencia entre ondas difractadas y no difractadas. [3] Las técnicas más comunes son la interferometría de cristal, la obtención de imágenes basada en propagación, la obtención de imágenes basada en analizadores, la iluminación de bordes y la obtención de imágenes basada en rejillas (véase más abajo).

El primero en descubrir los rayos X fue Wilhelm Conrad Röntgen en 1895, donde comprobó que tenían la capacidad de penetrar materiales opacos. Grabó la primera imagen de rayos X, mostrando la mano de su esposa. [4] Recibió el primer Premio Nobel de Física en 1901 "en reconocimiento a los extraordinarios servicios que había prestado con el descubrimiento de los notables rayos que posteriormente recibieron su nombre". [5] Desde entonces, los rayos X se han utilizado como herramienta para determinar de forma segura las estructuras internas de diferentes objetos, aunque durante mucho tiempo la información se obtenía midiendo únicamente la intensidad transmitida de las ondas y la información de fase no era accesible.

El principio de la obtención de imágenes por contraste de fases fue desarrollado por primera vez por Frits Zernike durante su trabajo con rejillas de difracción y luz visible. [6] [7] La aplicación de sus conocimientos a la microscopía le valió el Premio Nobel de Física en 1953. Desde entonces, la microscopía de contraste de fases ha sido un campo importante de la microscopía óptica .

La transferencia de imágenes de contraste de fase de la luz visible a los rayos X tomó mucho tiempo, debido al lento progreso en la mejora de la calidad de los rayos X y la inaccesibilidad de las lentes de rayos X. En la década de 1970, se comprendió que la radiación de sincrotrón , emitida por partículas cargadas que circulaban en anillos de almacenamiento construidos para experimentos de física nuclear de alta energía, puede haber sido una fuente más intensa y versátil de rayos X que los tubos de rayos X ; [8] esto, combinado con el progreso en el desarrollo de la óptica de rayos X, fue fundamental para el avance posterior de la física de rayos X.

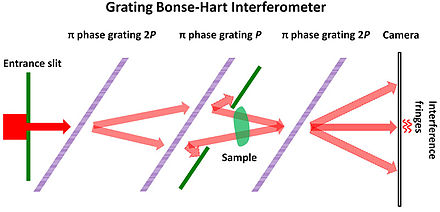

El trabajo pionero en la implementación del método de contraste de fase a la física de rayos X fue presentado en 1965 por Ulrich Bonse y Michael Hart, del Departamento de Ciencia e Ingeniería de Materiales de la Universidad de Cornell, Nueva York. Presentaron un interferómetro de cristal, hecho de un monocristal grande y altamente perfecto . [9] No menos de 30 años después, los científicos japoneses Atsushi Momose , Tohoru Takeda y colaboradores adoptaron esta idea y la refinaron para su aplicación en imágenes biológicas, por ejemplo, aumentando el campo de visión con la ayuda de nuevas configuraciones de instalación y técnicas de recuperación de fase . [10] [11] El interferómetro de Bonse-Hart proporciona varios órdenes de magnitud más de sensibilidad en muestras biológicas que otras técnicas de contraste de fase, pero no puede utilizar tubos de rayos X convencionales porque los cristales solo aceptan una banda de energía muy estrecha de rayos X (Δ E / E ~ 10 −4 ). En 2012, Han Wen y sus colaboradores dieron un paso adelante al reemplazar los cristales por rejillas de fase nanométricas. [12] Las rejillas dividen y dirigen los rayos X a lo largo de un amplio espectro, eliminando así la restricción del ancho de banda de la fuente de rayos X. Detectaron una curvatura refractiva de rayos X de menos de un nanorradián en muestras biológicas con un interferómetro Bonse-Hart de rejilla. [12]

Al mismo tiempo, surgieron dos enfoques más para la obtención de imágenes por contraste de fase con el objetivo de superar los problemas de la interferometría de cristales. La técnica de obtención de imágenes basada en la propagación fue introducida principalmente por el grupo de Anatoly Snigirev en el ESRF (European Synchrotron Radiation Facility) en Grenoble, Francia, [13] y se basaba en la detección de "franjas de Fresnel" que surgen bajo ciertas circunstancias en la propagación en el espacio libre. La configuración experimental consistía en una configuración en línea de una fuente de rayos X, una muestra y un detector y no requería ningún elemento óptico. Era conceptualmente idéntica a la configuración del trabajo revolucionario de Dennis Gabor sobre holografía en 1948. [14]

En 1995, Viktor Ingal y Elena Beliaevskaya, en el laboratorio de rayos X de San Petersburgo (Rusia), [15] y Tim Davis y sus colegas de la División de Ciencia y Tecnología de los Materiales de la CSIRO (Organización de Investigación Científica e Industrial de la Commonwealth) en Clayton (Australia), exploraron por primera vez un enfoque alternativo denominado obtención de imágenes mediante analizadores. [16] Este método utiliza un cristal de Bragg como filtro angular para reflejar solo una pequeña parte del haz que cumple la condición de Bragg sobre un detector. Una colaboración estadounidense de los equipos de investigación de Dean Chapman, Zhong Zhong y William Thomlinson ha hecho importantes contribuciones al progreso de este método, por ejemplo, la extracción de una señal adicional causada por la dispersión de ángulos ultrapequeños [17] y la primera imagen de TC realizada con obtención de imágenes mediante analizadores. [18] Alessandro Olivo y sus colaboradores del sincrotrón Elettra en Trieste (Italia) desarrollaron una alternativa a la obtención de imágenes mediante analizadores que proporciona resultados equivalentes sin necesidad de utilizar un cristal. [19] Este método, llamado “iluminación de borde”, realiza una selección fina en la dirección de los rayos X utilizando el borde físico de los propios píxeles del detector, de ahí el nombre. Más tarde, Olivo, en colaboración con Robert Speller del University College de Londres, adaptó el método para su uso con fuentes de rayos X convencionales, [20] abriendo el camino a la traducción a aplicaciones clínicas y de otro tipo. Peter Munro (también del UCL) contribuyó sustancialmente al desarrollo del enfoque basado en el laboratorio, al demostrar que prácticamente no impone requisitos de coherencia [21] y que, a pesar de ello, sigue siendo completamente cuantitativo. [22]

El último enfoque que se analiza aquí es el denominado efecto de imagen basado en rejilla, que utiliza el efecto Talbot , descubierto por Henry Fox Talbot en 1836. [23] Este efecto de autoimagen crea un patrón de interferencia aguas abajo de una rejilla de difracción . A una distancia particular, este patrón se asemeja exactamente a la estructura de la rejilla y es registrado por un detector. La posición del patrón de interferencia se puede alterar colocando un objeto en el haz, lo que induce un cambio de fase. Este desplazamiento del patrón de interferencia se mide con la ayuda de una segunda rejilla y, mediante ciertos métodos de reconstrucción, se obtiene información sobre la parte real del índice de refracción. El llamado interferómetro Talbot-Lau fue utilizado inicialmente en interferometría atómica , por ejemplo por John F. Clauser y Shifang Li en 1994. [24] Los primeros interferómetros de rejilla de rayos X que utilizan fuentes de sincrotrón fueron desarrollados por Christian David y colegas del Instituto Paul Scherrer (PSI) en Villingen, Suiza [25] y el grupo de Atsushi Momose de la Universidad de Tokio. [26] En 2005, independientemente uno del otro, el grupo de David y Momose incorporaron la tomografía computarizada en la interferometría de rejilla, lo que puede verse como el siguiente hito en el desarrollo de imágenes basadas en rejilla. [27] [28] En 2006, otro gran avance fue la transferencia de la técnica basada en rejilla a los tubos de rayos X de laboratorio convencionales por Franz Pfeiffer y colaboradores, [29] lo que amplió bastante el potencial de la técnica para el uso clínico. Aproximadamente dos años después, el grupo de Franz Pfeiffer también logró extraer una señal suplementaria de sus experimentos; la llamada "señal de campo oscuro" fue causada por la dispersión debida a la microestructura porosa de la muestra y proporcionó "información estructural complementaria y de otro modo inaccesible sobre la muestra en la escala de longitud micrométrica y submicrométrica". [30] Al mismo tiempo, Han Wen y sus colaboradores de los Institutos Nacionales de Salud de EE. UU. llegaron a una técnica de rejilla mucho más simplificada para obtener la imagen de dispersión ("campo oscuro"). Utilizaron una única proyección de una rejilla y un nuevo enfoque para la extracción de señales llamado "análisis de Fourier de disparo único". [31] Recientemente, se realizó mucha investigación para mejorar la técnica basada en rejilla: Han Wen y su equipo analizaron huesos de animales y descubrieron que la intensidad de la señal de campo oscuro depende de la orientación de la rejilla y esto se debe a la anisotropía de la estructura ósea. [32]Los investigadores lograron importantes avances en aplicaciones biomédicas al reemplazar el escaneo mecánico de las rejillas por un escaneo electrónico de la fuente de rayos X. [33] El campo de TC de contraste de fase basado en rejillas se amplió con imágenes tomográficas de la señal de campo oscuro [34] y TC de contraste de fase con resolución temporal. [35] Además, se publicaron los primeros estudios preclínicos que utilizaron imágenes de rayos X de contraste de fase basadas en rejillas. Marco Stampanoni y su grupo examinaron el tejido mamario nativo con "mamografía de contraste de fase diferencial", [36] y un equipo dirigido por Dan Stutman investigó cómo utilizar imágenes basadas en rejillas para las pequeñas articulaciones de la mano. [37]

Más recientemente, se produjo un avance significativo en la obtención de imágenes basadas en rejillas debido al descubrimiento de un efecto muaré de fase [38] [39] por parte de Wen y sus colegas. Esto condujo a una interferometría que iba más allá del rango de obtención de imágenes propias de Talbot, utilizando solo rejillas de fase y fuentes y detectores convencionales. Las rejillas de fase de rayos X se pueden realizar con períodos muy finos, lo que permite obtener imágenes con dosis bajas de radiación para lograr una alta sensibilidad.

La imagenología convencional con rayos X utiliza la caída de intensidad a través de la atenuación causada por un objeto en el haz de rayos X y la radiación se trata como rayos, como en la óptica geométrica . Pero cuando los rayos X pasan a través de un objeto, no solo se altera su amplitud sino también su fase. En lugar de rayos simples , los rayos X también pueden tratarse como ondas electromagnéticas . Un objeto puede describirse entonces por su índice de refracción complejo (cf. [8] ):

El término δ es el decremento de la parte real del índice de refracción, y la parte imaginaria β describe el índice de absorción o coeficiente de extinción. Nótese que en contraste con la luz óptica, la parte real del índice de refracción es menor que pero cercana a la unidad, esto se debe "al hecho de que el espectro de rayos X generalmente se encuentra en el lado de alta frecuencia de varias resonancias asociadas con la unión de electrones". [8] La velocidad de fase dentro del objeto es mayor que la velocidad de la luz c . Esto conduce a un comportamiento diferente de los rayos X en un medio en comparación con la luz visible (por ejemplo, los ángulos de refracción tienen valores negativos) pero no contradice la ley de la relatividad , "que requiere que solo las señales que transportan información no viajen más rápido que c . Tales señales se mueven con la velocidad de grupo , no con la velocidad de fase, y se puede demostrar que la velocidad de grupo es de hecho menor que c ." [8]

El impacto del índice de refracción en el comportamiento de la onda se puede demostrar con una onda que se propaga en un medio arbitrario con un índice de refracción fijo n . Por razones de simplicidad, se supone aquí una onda plana monocromática sin polarización . La onda se propaga en dirección normal a la superficie del medio, denominada z en este ejemplo (ver figura a la derecha). La función de onda escalar en el vacío es

Dentro del medio, el número de onda angular cambia de k a nk . Ahora la onda puede describirse como:

donde δkz es el cambio de fase y e −β kz es un factor de decaimiento exponencial que disminuye la amplitud E 0 de la onda. [8]

En términos más generales, el desplazamiento de fase total del haz que se propaga una distancia z se puede calcular utilizando la integral

donde λ es la longitud de onda del haz de rayos X incidente. Esta fórmula significa que el cambio de fase es la proyección del decremento de la parte real del índice de refracción en la dirección de la imagen. Esto cumple con el requisito del principio tomográfico , que establece que "los datos de entrada al algoritmo de reconstrucción deben ser una proyección de una cantidad f que transmita información estructural dentro de una muestra. Luego, se puede obtener un tomograma que mapea el valor f ". [40] En otras palabras, en la imagen de contraste de fase, se puede reconstruir un mapa de la parte real del índice de refracción δ(x,y,z) con técnicas estándar como la retroproyección filtrada que es análoga a la tomografía computarizada de rayos X convencional donde se puede recuperar un mapa de la parte imaginaria del índice de refracción.

Para obtener información sobre la composición de una muestra, básicamente la distribución de densidad de la muestra, uno tiene que relacionar los valores medidos para el índice de refracción con los parámetros intrínsecos de la muestra, dicha relación se da mediante las siguientes fórmulas:

donde ρ a es la densidad del número atómico, σ a la sección transversal de absorción , k la longitud del vector de onda y

donde p es la sección transversal de desplazamiento de fase.

Lejos de los bordes de absorción (picos en la sección transversal de absorción debido a la mayor probabilidad de absorción de un fotón que tiene una frecuencia cercana a la frecuencia de resonancia del medio), los efectos de dispersión pueden despreciarse; este es el caso de los elementos ligeros ( número atómico Z < 40) que son los componentes del tejido humano y las energías de rayos X superiores a 20 keV, que se utilizan típicamente en imágenes médicas. Suponiendo estas condiciones, la sección transversal de absorción se establece aproximadamente por

donde 0,02 es una constante dada en barn , la unidad típica del área de la sección transversal de interacción de partículas, k la longitud del vector de onda , k 0 la longitud de un vector de onda con una longitud de onda de 1 Angstrom y Z el número atómico . [41] La fórmula válida en estas condiciones para la sección transversal de cambio de fase es:

donde Z es el número atómico , k la longitud del vector de onda y r 0 el radio clásico del electrón .

Esto da como resultado las siguientes expresiones para las dos partes del índice de refracción complejo:

La inserción de valores típicos de tejido humano en las fórmulas dadas anteriormente muestra que δ es generalmente tres órdenes de magnitud mayor que β dentro del rango de rayos X de diagnóstico. Esto implica que el cambio de fase de un haz de rayos X que se propaga a través del tejido puede ser mucho mayor que la pérdida de intensidad, lo que hace que las imágenes de rayos X de contraste de fase sean más sensibles a las variaciones de densidad en el tejido que las imágenes de absorción. [42]

Debido a las proporcionalidades

La ventaja del contraste de fase sobre el contraste de absorción convencional aumenta aún más con el aumento de la energía. Además, debido a que la formación de la imagen de contraste de fase no está intrínsecamente vinculada a la absorción de rayos X en la muestra, la dosis absorbida puede reducirse potencialmente utilizando energías de rayos X más altas. [29] [42]

Como se mencionó anteriormente, en relación con la luz visible, la parte real del índice de refracción n puede desviarse fuertemente de la unidad (n del vidrio en luz visible varía de 1,5 a 1,8), mientras que la desviación de la unidad para rayos X en diferentes medios es generalmente del orden de 10 −5 . Por lo tanto, los ángulos de refracción causados en el límite entre dos medios isótropos calculados con la fórmula de Snell también son muy pequeños. La consecuencia de esto es que los ángulos de refracción de los rayos X que pasan a través de una muestra de tejido no se pueden detectar directamente y generalmente se determinan indirectamente mediante "la observación del patrón de interferencia entre ondas difractadas y no difractadas producidas por variaciones espaciales de la parte real del índice de refracción". [3]

La interferometría de cristal , a veces también llamada interferometría de rayos X , es el método más antiguo pero también el más complejo utilizado para la realización experimental. Consiste en tres divisores de haz en geometría de Laue alineados en paralelo entre sí. (Véase la figura de la derecha) El haz incidente, que normalmente es colimado y filtrado por un monocromador (cristal de Bragg) antes, se divide en el primer cristal (S) por difracción de Laue en dos haces coherentes, un haz de referencia que permanece inalterado y un haz que pasa a través de la muestra. El segundo cristal (T) actúa como un espejo de transmisión y hace que los haces converjan uno hacia el otro. Los dos haces se encuentran en el plano del tercer cristal (A), que a veces se llama cristal analizador, y crean un patrón de interferencia cuya forma depende de la diferencia de trayectoria óptica entre los dos haces causada por la muestra. Este patrón de interferencia se detecta con un detector de rayos X detrás del cristal analizador. [9] [43]

Colocando la muestra en una platina giratoria y registrando proyecciones desde diferentes ángulos, se puede recuperar la distribución 3D del índice de refracción y, por lo tanto, las imágenes tomográficas de la muestra. [40] A diferencia de los métodos descritos a continuación, con el interferómetro de cristal se mide la fase en sí y no cualquier alternancia espacial de la misma. Para recuperar el desplazamiento de fase de los patrones de interferencia, se utiliza una técnica llamada escalonamiento de fase o escaneo de franjas: se introduce un desplazador de fase (con la forma de una cuña) en el haz de referencia. El desplazador de fase crea franjas de interferencia rectas con intervalos regulares; las llamadas franjas portadoras. Cuando la muestra se coloca en el otro haz, las franjas portadoras se desplazan. El desplazamiento de fase causado por la muestra corresponde al desplazamiento de las franjas portadoras. Se registran varios patrones de interferencia para diferentes desplazamientos del haz de referencia y, al analizarlos, se puede extraer la información de fase módulo 2 π . [40] [43] Esta ambigüedad de la fase se denomina efecto de envoltura de fase y se puede eliminar mediante las denominadas "técnicas de desenrollado de fase". [44] Estas técnicas se pueden utilizar cuando la relación señal-ruido de la imagen es suficientemente alta y la variación de fase no es demasiado abrupta. [28]

Como alternativa al método de escaneo de franjas, se puede utilizar el método de transformada de Fourier para extraer la información de cambio de fase con un solo interferograma, acortando así el tiempo de exposición, pero esto tiene la desventaja de limitar la resolución espacial por el espaciamiento de las franjas portadoras. [45]

Se considera que la interferometría de rayos X es el método más sensible al cambio de fase de los cuatro, y, en consecuencia, proporciona la resolución de densidad más alta en el rango de mg/cm 3 . [28] Pero debido a su alta sensibilidad, las franjas creadas por una muestra con un fuerte cambio de fase pueden volverse irresolubles; para superar este problema, recientemente se ha desarrollado un nuevo enfoque llamado "imágenes de rayos X de contraste de coherencia", donde en lugar del cambio de fase, el cambio del grado de coherencia causado por la muestra es relevante para el contraste de la imagen. [46]

Una limitación general a la resolución espacial de este método es la distorsión en el cristal analizador que surge de la refracción dinámica, es decir, la desviación angular del haz debido a la refracción en la muestra se amplifica unas diez mil veces en el cristal, porque la trayectoria del haz dentro del cristal depende fuertemente de su ángulo de incidencia. Este efecto se puede reducir adelgazando el cristal analizador, por ejemplo, con un espesor de analizador de 40 μm se calculó una resolución de aproximadamente 6 μm . Alternativamente, los cristales de Laue se pueden reemplazar por cristales de Bragg , de modo que el haz no pase a través del cristal sino que se refleje en la superficie. [47]

Otra limitación del método es el requisito de una estabilidad muy alta del montaje; la alineación de los cristales debe ser muy precisa y la diferencia de longitud de trayectoria entre los haces debe ser menor que la longitud de onda de los rayos X; para lograr esto, el interferómetro generalmente se construye a partir de un solo bloque de silicio altamente perfecto cortando dos ranuras. Mediante la producción monolítica , la coherencia reticular espacial muy importante entre los tres cristales se puede mantener relativamente bien, pero limita el campo de visión a un tamaño pequeño (por ejemplo, 5 cm x 5 cm para un lingote de 6 pulgadas) y debido a que la muestra normalmente se coloca en una de las trayectorias del haz, el tamaño de la muestra en sí también está limitado por el tamaño del bloque de silicio. [9] [48] Las configuraciones desarrolladas recientemente, que utilizan dos cristales en lugar de uno, amplían considerablemente el campo de visión, pero son aún más sensibles a las inestabilidades mecánicas. [49] [50]

Otra dificultad adicional del interferómetro de cristal es que los cristales de Laue filtran la mayor parte de la radiación entrante, por lo que requieren una alta intensidad de haz o tiempos de exposición muy largos. [51] Eso limita el uso del método a fuentes de rayos X muy brillantes como los sincrotrones.

Según las limitaciones de la configuración, el interferómetro de cristal funciona mejor para obtener imágenes de alta resolución de muestras pequeñas que generan gradientes de fase pequeños o suaves .

Para tener la sensibilidad superior de la interferometría de Bonse-Hart de cristal sin algunas de las limitaciones básicas, los cristales monolíticos han sido reemplazados por rejillas de desplazamiento de fase de rayos X nanométricas. [52] Las primeras rejillas de este tipo tienen períodos de 200 a 400 nanómetros. Pueden dividir los rayos X en los amplios espectros de energía de los tubos de rayos X comunes. La principal ventaja de esta técnica es que utiliza la mayoría de los rayos X entrantes que habrían sido filtrados por los cristales. Debido a que solo se utilizan rejillas de fase, la fabricación de rejillas es menos desafiante que las técnicas que utilizan rejillas de absorción. El primer interferómetro de Bonse-Hart con rejilla (gBH) funcionó a una energía de fotones de 22,5 keV y un ancho de banda espectral del 1,5%.

El haz incidente se forma mediante ranuras de unas pocas decenas de micrómetros de modo que la longitud de coherencia transversal sea mayor que el período de la rejilla. El interferómetro consta de tres rejillas de fase paralelas e igualmente espaciadas y una cámara de rayos X. El haz incidente se difracta mediante una primera rejilla de período 2P en dos haces. Estos se difractan a su vez mediante una segunda rejilla de período P en cuatro haces. Dos de los cuatro se fusionan en una tercera rejilla de período 2P. Cada uno de ellos se difracta aún más mediante la tercera rejilla. Los múltiples haces difractados pueden propagarse a una distancia suficiente para que los diferentes órdenes de difracción estén separados en la cámara. Existe un par de haces difractados que se copropagan desde la tercera rejilla hasta la cámara. Interfieren entre sí para producir franjas de intensidad si las rejillas están ligeramente desalineadas entre sí. El par central de trayectorias de difracción siempre tiene la misma longitud independientemente de la energía de los rayos X o del ángulo del haz incidente. Los patrones de interferencia de diferentes energías de fotones y ángulos de incidencia están bloqueados en fase.

El objeto fotografiado se coloca cerca de la rejilla central. Se obtienen imágenes de fase absoluta si el objeto intersecta una de un par de trayectorias coherentes. Si las dos trayectorias pasan por el objeto en dos lugares que están separados por una distancia lateral d, se detecta una imagen de diferencia de fase de Φ(r) - Φ(rd). Se realiza un escalonamiento de fase de una de las rejillas para recuperar las imágenes de fase. La imagen de diferencia de fase Φ(r) - Φ(rd) se puede integrar para obtener una imagen de desplazamiento de fase del objeto.

Esta técnica logró una sensibilidad sustancialmente mayor que otras técnicas con la excepción del interferómetro de cristal. [12] [53] Una limitación básica de la técnica es la dispersión cromática de la difracción de rejilla, que limita su resolución espacial. Un sistema de sobremesa con un tubo de rayos X con objetivo de tungsteno que funcione a 60 kVp tendrá una resolución límite de 60 μm. [12] Otra restricción es que el haz de rayos X se corta a solo decenas de micrómetros de ancho. Se ha propuesto una posible solución en forma de imágenes paralelas con múltiples rendijas. [12]

La obtención de imágenes con analizador (ABI) también se conoce como obtención de imágenes mejoradas por difracción , introscopia de dispersión de fase y radiografía de imágenes múltiples [54]. Su configuración consiste en un monocromador (normalmente un cristal simple o doble que también colima el haz) delante de la muestra y un cristal analizador colocado en geometría de Bragg entre la muestra y el detector. (Véase la figura de la derecha)

Este cristal analizador actúa como un filtro angular para la radiación proveniente de la muestra. Cuando estos rayos X golpean el cristal analizador, la condición de difracción de Bragg se satisface solo para un rango muy estrecho de ángulos de incidencia. Cuando los rayos X dispersos o refractados tienen ángulos de incidencia fuera de este rango, no se reflejarán en absoluto y no contribuirán a la señal. Los rayos X refractados dentro de este rango se reflejarán dependiendo del ángulo de incidencia. La dependencia de la intensidad reflejada en el ángulo de incidencia se llama curva de oscilación y es una propiedad intrínseca del sistema de imágenes, es decir, representa la intensidad medida en cada píxel del detector cuando el cristal analizador se "sacude" (rota ligeramente en un ángulo θ) sin ningún objeto presente y, por lo tanto, se puede medir fácilmente. [54] La aceptación angular típica es de unos pocos microradianes a decenas de microradianes y está relacionada con el ancho total a la mitad del máximo (FWHM) de la curva de oscilación del cristal.

Cuando el analizador está perfectamente alineado con el monocromador y, por lo tanto, colocado en el pico de la curva de oscilación, se obtiene una radiografía estándar con un contraste mejorado porque no hay borrosidad por fotones dispersos. A esto a veces se lo denomina "contraste de extinción".

Si, por el contrario, el analizador está orientado en un ángulo pequeño (ángulo de desintonización) con respecto al monocromador, los rayos X refractados en la muestra con un ángulo menor se reflejarán menos, y los rayos X refractados con un ángulo mayor se reflejarán más. Por lo tanto, el contraste de la imagen se basa en diferentes ángulos de refracción en la muestra. Para gradientes de fase pequeños, el ángulo de refracción se puede expresar como

donde k es la longitud del vector de onda de la radiación incidente y el segundo término del lado derecho es la primera derivada de la fase en la dirección de difracción. Dado que no se mide la fase en sí, sino la primera derivada del frente de fase, la obtención de imágenes mediante analizadores es menos sensible a las frecuencias espaciales bajas que la interferometría de cristal, pero más sensible que la PBI.

A diferencia de los métodos anteriores, la obtención de imágenes mediante analizadores suele proporcionar información de fase solo en la dirección de difracción, pero no es sensible a las desviaciones angulares en el plano perpendicular al plano de difracción. Esta sensibilidad a solo un componente del gradiente de fase puede generar ambigüedades en la estimación de la fase. [55]

Al registrar varias imágenes en diferentes ángulos de desafinación, es decir, en diferentes posiciones en la curva de oscilación, se obtiene un conjunto de datos que permite la recuperación de información cuantitativa de fase diferencial. Existen varios algoritmos para reconstruir información a partir de las curvas de oscilación, algunos de ellos proporcionan una señal adicional. Esta señal proviene de la dispersión de ángulo ultra pequeño por estructuras de muestra de subpíxeles y causa un ensanchamiento angular del haz y, por lo tanto, un ensanchamiento de la forma de la curva de oscilación. Con base en este contraste de dispersión, se puede producir un nuevo tipo de imagen llamada imagen de campo oscuro. [17] [54] [56]

La obtención de imágenes tomográficas con un analizador se puede realizar fijando el analizador en un ángulo específico y rotando la muestra 360° mientras se adquieren los datos de proyección. Se adquieren varios conjuntos de proyecciones de la misma muestra con diferentes ángulos de desintonización y luego se puede reconstruir una imagen tomográfica. Suponiendo que los cristales están alineados normalmente de modo que la derivada del índice de refracción se mide en la dirección paralela al eje tomográfico, la "imagen de TC de refracción" resultante muestra la imagen pura del gradiente fuera del plano.

En el caso de la obtención de imágenes con analizadores, los requisitos de estabilidad de los cristales son menos estrictos que en el caso de la interferometría de cristales, pero la configuración sigue requiriendo un cristal analizador perfecto que debe controlarse con mucha precisión en cuanto a ángulo y tamaño, y la restricción de que el haz debe ser paralelo también limita el campo de visión. Además, como en el caso de la interferometría de cristales, una limitación general para la resolución espacial de este método se da por la borrosidad en el cristal analizador debido a los efectos de difracción dinámica , pero se puede mejorar utilizando difracción de incidencia rasante para el cristal. [55]

Si bien el método en principio requiere una radiación monocromática altamente colimada y, por lo tanto, está limitado a una fuente de radiación de sincrotrón, recientemente se demostró que el método sigue siendo factible utilizando una fuente de laboratorio con un espectro policromático cuando la curva de oscilación se adapta a la radiación de la línea espectral K α del material objetivo. [57]

Debido a su alta sensibilidad a pequeños cambios en el índice de refracción, este método es muy adecuado para obtener imágenes de muestras de tejidos blandos y ya se ha implementado en imágenes médicas, especialmente en mamografía para una mejor detección de microcalcificaciones [1] y en estudios de cartílago óseo. [58]

La técnica de imágenes basada en propagación (PBI) es el nombre más común para esta técnica, pero también se denomina holografía en línea , imágenes mejoradas por refracción [59] o radiografía de contraste de fase . La última denominación se deriva del hecho de que la configuración experimental de este método es básicamente la misma que en la radiografía convencional. Consiste en una disposición en línea de una fuente de rayos X, la muestra y un detector de rayos X y no se requieren otros elementos ópticos. La única diferencia es que el detector no se coloca inmediatamente detrás de la muestra, sino a cierta distancia, por lo que la radiación refractada por la muestra puede interferir con el haz inalterado. [13] Esta configuración simple y los bajos requisitos de estabilidad proporcionan una gran ventaja de este método sobre otros métodos discutidos aquí.

Bajo una iluminación espacialmente coherente y una distancia intermedia entre la muestra y el detector se crea un patrón de interferencia con "franjas de Fresnel"; es decir, las franjas surgen en la propagación en el espacio libre en el régimen de Fresnel , lo que significa que para la distancia entre el detector y la muestra, la aproximación de la fórmula de difracción de Kirchhoff para el campo cercano, la ecuación de difracción de Fresnel, es válida. A diferencia de la interferometría de cristal, las franjas de interferencia registradas en PBI no son proporcionales a la fase en sí, sino a la segunda derivada (el Laplaciano ) de la fase del frente de onda. Por lo tanto, el método es más sensible a los cambios abruptos en el decremento del índice de refracción. Esto conduce a un contraste más fuerte que delinea las superficies y los límites estructurales de la muestra ( mejora de los bordes ) en comparación con un radiograma convencional. [60] [61]

La PBI se puede utilizar para mejorar el contraste de una imagen de absorción; en este caso, la información de fase en el plano de la imagen se pierde pero contribuye a la intensidad de la imagen ( mejora de los bordes de la imagen de atenuación). Sin embargo, también es posible separar la fase y el contraste de atenuación, es decir, reconstruir la distribución de la parte real e imaginaria del índice de refracción por separado. La determinación inequívoca de la fase del frente de onda ( recuperación de fase ) se puede realizar registrando varias imágenes a diferentes distancias entre el detector y la muestra y utilizando algoritmos basados en la linealización de la integral de difracción de Fresnel para reconstruir la distribución de fase, pero este enfoque sufre de ruido amplificado para frecuencias espaciales bajas y, por lo tanto, los componentes que varían lentamente pueden no recuperarse con precisión. Hay varios enfoques más para la recuperación de fase y se ofrece una buena descripción general sobre ellos en [62] [63] .

Las reconstrucciones tomográficas de la distribución 3D del índice de refracción u “Holotomografía” se implementan rotando la muestra y registrando para cada ángulo de proyección una serie de imágenes a diferentes distancias. [64]

Para resolver las franjas de interferencia se requiere un detector de alta resolución, lo que prácticamente limita el campo de visión de esta técnica o requiere distancias de propagación mayores. La resolución espacial lograda es relativamente alta en comparación con los otros métodos y, dado que no hay elementos ópticos en el haz, está limitada principalmente por el grado de coherencia espacial del haz. Como se mencionó anteriormente, para la formación de las franjas de Fresnel, la restricción en la coherencia espacial de la radiación utilizada es muy estricta, lo que limita el método a fuentes pequeñas o muy distantes, pero en contraste con la interferometría de cristal y la formación de imágenes basada en analizadores, la restricción en la coherencia temporal , es decir, la policromaticidad, es bastante relajada. [55] En consecuencia, el método no solo se puede utilizar con fuentes de sincrotrón, sino también con fuentes de rayos X de laboratorio policromáticas que proporcionen suficiente coherencia espacial, como los tubos de rayos X de microfoco . [60]

En términos generales, el contraste de imagen que proporciona este método es menor que el de otros métodos analizados aquí, especialmente si las variaciones de densidad en la muestra son pequeñas. Debido a su capacidad para mejorar el contraste en los límites, es muy adecuado para obtener imágenes de muestras de fibra o espuma. [65] Una aplicación muy importante de la PBI es el examen de fósiles con radiación de sincrotrón, que revela detalles sobre los especímenes paleontológicos que de otro modo serían inaccesibles sin destruir la muestra. [66]

Las imágenes basadas en rejilla (GBI) incluyen la interferometría de cizallamiento o interferometría Talbot de rayos X (XTI) y la interferometría policromática de campo lejano (PFI) . [38] Desde que se construyó el primer interferómetro de rejilla de rayos X, que consta de dos rejillas de fase y un cristal analizador [25] , se han desarrollado varias configuraciones ligeramente diferentes para este método; a continuación, el enfoque se centra en el método estándar actual que consta de una rejilla de fase y una rejilla analizadora. [26] (Véase la figura de la derecha).

La técnica XTI se basa en el efecto Talbot o "fenómeno de autoimagen", que es un efecto de difracción de Fresnel y conduce a la repetición de un frente de onda periódico después de una cierta distancia de propagación, llamada " longitud de Talbot ". Este frente de onda periódico puede generarse mediante la iluminación espacialmente coherente de una estructura periódica, como una rejilla de difracción , y si es así, la distribución de intensidad del campo de onda en la longitud de Talbot se asemeja exactamente a la estructura de la rejilla y se llama autoimagen. [23] También se ha demostrado que se crearán patrones de intensidad en ciertas longitudes de Talbot fraccionarias. A la mitad de la distancia aparece la misma distribución de intensidad excepto por un desplazamiento lateral de la mitad del período de la rejilla, mientras que a ciertas distancias de Talbot fraccionarias más pequeñas las autoimágenes tienen períodos fraccionarios y tamaños fraccionarios de los máximos y mínimos de intensidad, que se vuelven visibles en la distribución de intensidad detrás de la rejilla, una llamada alfombra de Talbot. La longitud de Talbot y las longitudes fraccionarias se pueden calcular conociendo los parámetros de la radiación de iluminación y la rejilla iluminada y, por lo tanto, proporciona la posición exacta de los máximos de intensidad, que deben medirse en GBI. [67] Si bien el efecto Talbot y el interferómetro de Talbot se descubrieron y estudiaron ampliamente utilizando luz visible, se demostró hace varios años también para el régimen de rayos X duros. [68]

En GBI, se coloca una muestra antes o detrás de la rejilla de fase (las líneas de la rejilla muestran una absorción insignificante pero un desplazamiento de fase sustancial) y, por lo tanto, el patrón de interferencia del efecto Talbot se modifica por la absorción, la refracción y la dispersión en la muestra. Para un objeto de fase con un gradiente de fase pequeño, el haz de rayos X se desvía por

donde k es la longitud del vector de onda de la radiación incidente y el segundo factor en el lado derecho es la primera derivada de la fase en la dirección perpendicular a la dirección de propagación y paralela a la alineación de la rejilla. Dado que el desplazamiento transversal de las franjas de interferencia es lineal proporcional al ángulo de desviación, la fase diferencial del frente de onda se mide en GBI, de forma similar a como se hace en ABI. En otras palabras, las desviaciones angulares se traducen en cambios de intensidad transmitida localmente. Al realizar mediciones con y sin muestra, se puede recuperar el cambio de posición del patrón de interferencia causado por la muestra. El período del patrón de interferencia suele estar en el rango de unos pocos micrómetros , que solo se puede resolver convenientemente con un detector de muy alta resolución en combinación con una iluminación muy intensa (una fuente que proporciona un flujo muy alto) y, por lo tanto, limita significativamente el campo de visión. [69] Esta es la razón por la que se coloca una segunda rejilla, normalmente una rejilla de absorción, a una longitud de Talbot fraccionaria para analizar el patrón de interferencia. [26]

La rejilla del analizador normalmente tiene el mismo período que las franjas de interferencia y, por lo tanto, transforma la posición local de la franja en variación de la intensidad de la señal en el detector, que se coloca inmediatamente detrás de la rejilla. Para separar la información de fase de otras contribuciones a la señal, se utiliza una técnica llamada "escalonamiento de fase". [27] Una de las rejillas se escanea a lo largo del término de dirección transversal x g ; durante un período de la rejilla, y para diferentes posiciones de la rejilla se toma una imagen. La señal de intensidad en cada píxel en el plano del detector oscila como una función de x g . La oscilación de intensidad registrada se puede representar mediante una serie de Fourier y, al registrar y comparar estas oscilaciones de intensidad con o sin la muestra, se puede extraer el desplazamiento de fase diferencial separado y la señal de absorción en relación con la imagen de referencia. [27] Al igual que en la obtención de imágenes basadas en analizadores, también se puede reconstruir una señal adicional procedente de la dispersión de ángulo ultrapequeño por microestructuras de subpíxeles de la muestra, denominada contraste de campo oscuro. [30] Este método proporciona una alta resolución espacial, pero también requiere tiempos de exposición prolongados.

Un enfoque alternativo es la recuperación de la fase diferencial mediante el uso de franjas de Moiré . Estas se crean como una superposición de la autoimagen de G1 y el patrón de G2 mediante el uso de rejillas con la misma periodicidad e inclinando G2 contra G1 con respecto al eje óptico con un ángulo muy pequeño (<<1). Estas franjas de Moiré actúan como franjas portadoras porque tienen un espaciamiento/periodo mucho mayor (menor frecuencia espacial) que las franjas de Talbot y, por lo tanto, el gradiente de fase introducido por la muestra se puede detectar como el desplazamiento de las franjas de Moiré. [26] Con un análisis de Fourier del patrón de Moiré, también se pueden extraer la señal de absorción y de campo oscuro. [70] Usando este enfoque, la resolución espacial es menor que la lograda con la técnica de escalonamiento de fase, pero el tiempo total de exposición puede ser mucho más corto, porque se puede recuperar una imagen de fase diferencial con un solo patrón de Moiré. [71] La técnica de análisis de Fourier de disparo único se utilizó en las primeras imágenes de dispersión basadas en cuadrícula [31] de manera similar al sensor de frente de onda Shack-Hartmann en óptica, lo que permitió los primeros estudios con animales vivos. [72]

Una técnica para eliminar el barrido mecánico de la rejilla y aún así conservar la máxima resolución espacial es el escalonamiento de fase electrónico. [33] Escanea el punto de origen del tubo de rayos X con un campo electromagnético. Esto hace que la proyección del objeto se mueva en la dirección opuesta, y también causa un movimiento relativo entre la proyección y las franjas de Moiré. Las imágenes se desplazan digitalmente para realinear las proyecciones. El resultado es que la proyección del objeto es estacionaria, mientras que las franjas de Moiré se mueven sobre ella. Esta técnica sintetiza eficazmente el proceso de escalonamiento de fase, pero sin los costos y demoras asociados con los movimientos mecánicos.

Con ambos métodos de extracción de fase, la tomografía es aplicable rotando la muestra alrededor del eje tomográfico, registrando una serie de imágenes con diferentes ángulos de proyección y utilizando algoritmos de retroproyección para reconstruir las distribuciones tridimensionales de la parte real e imaginaria del índice de refracción. [27] [71] La reconstrucción tomográfica cuantitativa de la señal de campo oscuro también se ha demostrado para la técnica de escalonamiento de fase [34] y muy recientemente también para el enfoque del patrón Moiré. [70]

También se ha demostrado que la obtención de imágenes de campo oscuro con el interferómetro de rejilla se puede utilizar para extraer información de orientación de detalles estructurales en el régimen submicrométrico más allá de la resolución espacial del sistema de detección. Mientras que la dispersión de rayos X en una dirección perpendicular a las líneas de rejilla proporciona el contraste de campo oscuro, la dispersión en una dirección paralela a las líneas de rejilla sólo produce borrosidad en la imagen, que no es visible en la baja resolución del detector. [31] Esta propiedad física intrínseca de la configuración se utiliza para extraer información de orientación sobre la variación angular del poder de dispersión local de la muestra rotando la muestra alrededor del eje óptico de la configuración y recopilando un conjunto de varias imágenes de campo oscuro, cada una midiendo el componente de la dispersión perpendicular a las líneas de rejilla para esa orientación particular. Esto se puede utilizar para determinar el ángulo local y el grado de orientación del hueso y podría proporcionar información valiosa para mejorar la investigación y el diagnóstico de enfermedades óseas como la osteoporosis o la osteoartritis . [73] [74]

La configuración estándar que se muestra en la figura de la derecha requiere coherencia espacial de la fuente y, en consecuencia, está limitada a fuentes de radiación de sincrotrón de alto brillo. Este problema se puede solucionar añadiendo una tercera rejilla cerca de la fuente de rayos X, conocida como interferómetro Talbot-Lau . Esta rejilla de fuente, que suele ser una rejilla de absorción con ranuras de transmisión, crea una "matriz de fuentes coherentes individualmente pero mutuamente incoherentes". Como la rejilla de fuente puede contener una gran cantidad de aperturas individuales, cada una de las cuales crea una fuente de línea virtual suficientemente coherente, se pueden utilizar de manera eficiente generadores de rayos X estándar con tamaños de fuente de unos pocos milímetros cuadrados y se puede aumentar significativamente el campo de visión. [29]

Dado que la posición de las franjas de interferencia formadas detrás de la rejilla divisora de haz es independiente de la longitud de onda en un amplio rango de energía de la radiación incidente, el interferómetro en configuración de escalonamiento de fase todavía se puede utilizar de manera eficiente con radiación policromática. [27] Para la configuración de patrón de Moiré, la restricción en la energía de radiación es un poco más estricta, porque un ancho de banda finito de energía en lugar de radiación monocromática causa una disminución en la visibilidad de las franjas de Moiré y, por lo tanto, la calidad de la imagen, pero aún se permite una policromaticidad moderada. [75] Una gran ventaja del uso de la radiación policromática es el acortamiento de los tiempos de exposición y esto se ha explotado recientemente mediante el uso de radiación de sincrotrón blanca para realizar la primera tomografía de contraste de fase dinámica (resuelta en el tiempo). [35]

Una barrera técnica a superar es la fabricación de rejillas con alta relación de aspecto y pequeños períodos. La producción de estas rejillas a partir de una oblea de silicio implica técnicas de microfabricación como la fotolitografía , el grabado húmedo anisotrópico , la galvanoplastia y el moldeo . [76] Un proceso de fabricación muy común para rejillas de rayos X es LIGA , que se basa en la litografía profunda de rayos X y la galvanoplastia. Fue desarrollado en la década de 1980 para la fabricación de microestructuras de relación de aspecto extremadamente alta por científicos del Instituto de Tecnología de Karlsruhe (KIT) . [77] Otro requisito técnico es la estabilidad y la alineación y el movimiento precisos de las rejillas (normalmente en el rango de algunos nm), pero en comparación con otros métodos, por ejemplo, el interferómetro de cristal, la restricción es fácil de cumplir.

El desafío de fabricación de rejillas se facilitó con el descubrimiento de un efecto muaré de fase [38] que proporciona un interferómetro de rejilla de todas las fases que funciona con fuentes compactas, llamado interferómetro de campo lejano policromático (ver figura a la derecha). Las rejillas de fase son más fáciles de hacer en comparación con las rejillas de fuente y analizador mencionadas anteriormente, ya que la profundidad de rejilla requerida para causar un cambio de fase es mucho menor que la que se necesita para absorber rayos X. Las rejillas de fase de períodos de 200 a 400 nanómetros se han utilizado para mejorar la sensibilidad de fase en los generadores de imágenes PFI de sobremesa. [39] En PFI, se utiliza una rejilla de fase para convertir las franjas de interferencia finas en un patrón de intensidad amplio en un plano distal, basado en el efecto muaré de fase . Además de una mayor sensibilidad, otro incentivo para períodos de rejilla más pequeños es que la coherencia lateral de la fuente debe ser al menos un período de rejilla.

Una desventaja de la configuración estándar de GBI es la sensibilidad a un solo componente del gradiente de fase, que es la dirección paralela a las rejillas 1-D. Este problema se ha solucionado ya sea registrando imágenes de contraste de fase diferencial de la muestra en ambas direcciones x e y girando la muestra (o las rejillas) 90° [78] o mediante el empleo de rejillas bidimensionales. [79]

Al ser una técnica de fase diferencial, la GBI no es tan sensible como la interferometría de cristal a frecuencias espaciales bajas, pero debido a la alta resistencia del método contra inestabilidades mecánicas, la posibilidad de usar detectores con píxeles grandes y un campo de visión amplio y, de importancia crucial, la aplicabilidad a tubos de rayos X de laboratorio convencionales, la obtención de imágenes basadas en rejillas es una técnica muy prometedora para el diagnóstico médico y la obtención de imágenes de tejidos blandos. Las primeras aplicaciones médicas, como un estudio de mamografía preclínica , muestran un gran potencial para el futuro de esta técnica. [36] Más allá de eso, la GBI tiene aplicaciones en un amplio campo de la ciencia de los materiales; por ejemplo, podría usarse para mejorar los controles de seguridad. [30] [80]

La iluminación de borde (EI) se desarrolló en el sincrotrón italiano (Elettra) a finales de los años 90 [19] como alternativa a la ABI. Se basa en la observación de que, iluminando solo el borde de los píxeles del detector, se obtiene una alta sensibilidad a los efectos de fase (véase la figura).

También en este caso se aprovecha la relación entre el ángulo de refracción de rayos X y la primera derivada del desplazamiento de fase causado por el objeto:

Si el haz de rayos X es delgado verticalmente e incide en el borde del detector, la refracción de rayos X puede cambiar el estado del rayo X individual de "detectado" a "no detectado" y viceversa, desempeñando efectivamente el mismo papel que la curva de oscilación del cristal en ABI. Esta analogía con ABI, ya observada cuando se desarrolló inicialmente el método, [19] se demostró formalmente más recientemente. [81] Efectivamente, se obtiene el mismo efecto: una selección angular fina en la dirección del fotón; sin embargo, mientras que en la formación de imágenes basada en analizadores el haz debe ser altamente colimado y monocromático, la ausencia del cristal significa que la iluminación del borde se puede implementar con haces divergentes y policromáticos, como los generados por un tubo de rayos X de ánodo giratorio convencional. Esto se hace introduciendo dos máscaras diseñadas oportunamente (a veces denominadas máscaras de "apertura codificada" [20] ), una inmediatamente antes de la muestra y otra en contacto con el detector (ver figura).

El propósito de esta última máscara es simplemente crear regiones insensibles entre píxeles adyacentes, y su uso se puede evitar si se emplea tecnología de detector especializada. De esta manera, la configuración de iluminación de borde se realiza simultáneamente para todas las filas de píxeles de un detector de área. Esta pluralidad de haces individuales significa que, en contraste con la implementación de sincrotrón discutida anteriormente, no se requiere escaneo de muestra: la muestra se coloca aguas abajo de la máscara de muestra y se captura la imagen en una sola toma (dos si se realiza la recuperación de fase [22] ). Aunque la configuración quizás se parezca superficialmente a la de un interferómetro de rejilla, el mecanismo físico subyacente es diferente. A diferencia de otras técnicas de imágenes de rayos X de contraste de fase, la iluminación de borde es una técnica incoherente y, de hecho, se demostró que funciona con fuentes incoherentes tanto espacial como temporalmente, sin ninguna apertura de fuente adicional o colimación. [22] [82] Por ejemplo, se utilizan rutinariamente puntos focales de 100 μm que son compatibles con, por ejemplo, sistemas de mamografía de diagnóstico. También se demostró la recuperación de fase cuantitativa con fuentes incoherentes (no colimadas), mostrando que en algunos casos se pueden obtener resultados análogos al estándar de oro de sincrotrón. [22] La configuración relativamente simple de iluminación de borde da como resultado una sensibilidad de fase al menos comparable con otras técnicas de imágenes de rayos X de contraste de fase, [83] resulta en una serie de ventajas, que incluyen un tiempo de exposición reducido para la misma potencia de fuente, dosis de radiación reducida, robustez contra vibraciones ambientales y acceso más fácil a alta energía de rayos X. [83] [84] [85] [86] Además, dado que su relación de aspecto no es particularmente exigente, las máscaras son baratas, fáciles de fabricar (por ejemplo, no requieren litografía de rayos X) y ya se pueden escalar a áreas grandes. El método se extiende fácilmente a la sensibilidad de fase en dos direcciones, por ejemplo, a través de la realización de aberturas en forma de L para la iluminación simultánea de dos bordes ortogonales en cada píxel del detector. [87] En términos más generales, si bien en su implementación más simple los beamlets coinciden con filas de píxeles individuales (o píxeles), el método es altamente flexible y, por ejemplo, se pueden utilizar detectores dispersos y máscaras asimétricas [88] y se pueden construir sistemas compactos [89] y de microscopía [90] . Hasta ahora, el método se ha demostrado con éxito en áreas como escaneo de seguridad, [91] imágenes biológicas, [83] [89] ciencia de los materiales, [92] paleontología [93] [94] y otras; también se demostró la adaptación a 3D (tomografía computarizada). [93] [95]Además de la traducción simple para su uso con fuentes de rayos X convencionales, existen beneficios sustanciales en la implementación de la iluminación de borde con radiación sincrotrón coherente, entre los que se encuentran un alto rendimiento a energías de rayos X muy altas [94] y altas resoluciones angulares. [96]

Se han identificado cuatro posibles beneficios del contraste de fase en el contexto de imágenes médicas: [42]

Una comparación cuantitativa de la mamografía de contraste de fase y de absorción que tuvo en cuenta restricciones realistas (dosis, geometría y economía de fotones) concluyó que la obtención de imágenes de contraste de fase basada en rejilla (interferometría de Talbot) no muestra una mejora general de la relación señal-ruido en relación con el contraste de absorción, pero el rendimiento depende en gran medida de la tarea. [97] [98] Aún no se ha realizado una comparación de este tipo para todos los métodos de contraste de fase, sin embargo, las siguientes consideraciones son fundamentales para dicha comparación:

Algunas de las ventajas y desventajas se ilustran en la figura de la derecha, que muestra el beneficio del contraste de fase sobre el contraste de absorción para la detección de diferentes objetivos relevantes en la mamografía en función del tamaño del objetivo. [97] Tenga en cuenta que estos resultados no incluyen los beneficios potenciales de la señal de campo oscuro.

Tras estudios preliminares de laboratorio en tomografía computarizada [100] y mamografía, [101] la obtención de imágenes con contraste de fase está empezando a aplicarse en aplicaciones médicas reales, como la obtención de imágenes de pulmón, [102] la obtención de imágenes de extremidades, [103] la obtención de imágenes de muestras intraoperatorias. [104] Las aplicaciones in vivo de la obtención de imágenes con contraste de fase han sido impulsadas por el estudio pionero de mamografía con radiación de sincrotrón realizado en Trieste, Italia. [105]

{{cite book}}: CS1 maint: varios nombres: lista de autores ( enlace ){{cite book}}: CS1 maint: varios nombres: lista de autores ( enlace ){{cite book}}: |journal=ignorado ( ayuda ){{cite book}}: Mantenimiento de CS1: falta la ubicación del editor ( enlace )