En estadística , un tamaño del efecto es un valor que mide la fuerza de la relación entre dos variables en una población, o una estimación de esa cantidad basada en una muestra. Puede referirse al valor de una estadística calculada a partir de una muestra de datos , al valor de un parámetro para una población hipotética o a la ecuación que operacionaliza cómo las estadísticas o parámetros conducen al valor del tamaño del efecto. [1] Ejemplos de tamaños del efecto incluyen la correlación entre dos variables, [2] el coeficiente de regresión en una regresión, la diferencia de medias o el riesgo de que ocurra un evento particular (como un ataque cardíaco). Los tamaños del efecto complementan las pruebas de hipótesis estadísticas y desempeñan un papel importante en los análisis de potencia , la planificación del tamaño de la muestra y los metanálisis . El conjunto de métodos de análisis de datos relativos a los tamaños del efecto se denomina estadística de estimación .

El tamaño del efecto es un componente esencial al evaluar la solidez de una afirmación estadística y es el primer elemento (magnitud) de los criterios MAGIC . La desviación estándar del tamaño del efecto es de importancia crítica, ya que indica cuánta incertidumbre se incluye en la medición. Una desviación estándar demasiado grande hará que la medición pierda casi sentido. En el metanálisis, donde el propósito es combinar múltiples tamaños del efecto, la incertidumbre en el tamaño del efecto se utiliza para sopesar los tamaños del efecto, de modo que los estudios grandes se consideran más importantes que los estudios pequeños. La incertidumbre en el tamaño del efecto se calcula de manera diferente para cada tipo de tamaño del efecto, pero generalmente solo requiere conocer el tamaño de la muestra del estudio ( N ), o el número de observaciones ( n ) en cada grupo.

Informar los tamaños del efecto o sus estimaciones (estimación del efecto [EE], estimación del efecto) se considera una buena práctica al presentar los resultados de investigaciones empíricas en muchos campos. [3] [4] La presentación de informes sobre los tamaños del efecto facilita la interpretación de la importancia de un resultado de investigación, en contraste con su significación estadística . [5] Los tamaños del efecto son particularmente prominentes en las ciencias sociales y en la investigación médica (donde el tamaño del efecto del tratamiento es importante).

Los tamaños del efecto pueden medirse en términos relativos o absolutos. En los tamaños relativos del efecto, dos grupos se comparan directamente entre sí, como en los odds ratios y los riesgos relativos . Para tamaños de efecto absolutos, un valor absoluto mayor siempre indica un efecto más fuerte. Muchos tipos de medidas se pueden expresar como absolutas o relativas, y se pueden utilizar juntas porque transmiten información diferente. Un destacado grupo de trabajo de la comunidad de investigación en psicología hizo la siguiente recomendación:

Siempre presente tamaños del efecto para los resultados primarios... Si las unidades de medida son significativas en un nivel práctico (por ejemplo, número de cigarrillos fumados por día), entonces generalmente preferimos una medida no estandarizada (coeficiente de regresión o diferencia de medias) a una medida estandarizada. ( r o d ). [3]

Al igual que en la estimación estadística , el tamaño del efecto real se distingue del tamaño del efecto observado; por ejemplo, para medir el riesgo de enfermedad en una población (el tamaño del efecto de la población), se puede medir el riesgo dentro de una muestra de esa población (el tamaño del efecto de la muestra). . Las convenciones para describir los tamaños del efecto verdadero y observado siguen prácticas estadísticas estándar; un enfoque común es utilizar letras griegas como ρ [rho] para indicar parámetros poblacionales y letras latinas como r para indicar la estadística correspondiente. Alternativamente, se puede colocar un "sombrero" sobre el parámetro de población para indicar la estadística, por ejemplo, siendo la estimación del parámetro .

Como en cualquier entorno estadístico, los tamaños del efecto se estiman con error de muestreo y pueden estar sesgados a menos que el estimador del tamaño del efecto que se utilice sea apropiado para la forma en que se muestrearon los datos y la forma en que se realizaron las mediciones. Un ejemplo de esto es el sesgo de publicación , que ocurre cuando los científicos informan resultados solo cuando los tamaños del efecto estimados son grandes o estadísticamente significativos. Como resultado, si muchos investigadores llevan a cabo estudios con bajo poder estadístico, los tamaños del efecto informados tenderán a ser mayores que los efectos reales (poblacionales), si los hay. [6] Otro ejemplo en el que los tamaños del efecto pueden estar distorsionados es en un experimento de múltiples ensayos, donde el cálculo del tamaño del efecto se basa en la respuesta promediada o agregada entre los ensayos. [7]

Los estudios más pequeños a veces muestran tamaños de efecto diferentes, a menudo mayores, que los estudios más grandes. Este fenómeno se conoce como efecto de estudio pequeño, que puede indicar un sesgo de publicación. [8]

Los tamaños del efecto basados en muestras se distinguen de las estadísticas de prueba utilizadas en las pruebas de hipótesis, en que estiman la fuerza (magnitud) de, por ejemplo, una relación aparente, en lugar de asignar un nivel de significancia que refleje si la magnitud de la relación observada podría deberse al azar. El tamaño del efecto no determina directamente el nivel de significancia, ni viceversa. Dado un tamaño de muestra suficientemente grande, una comparación estadística no nula siempre mostrará un resultado estadísticamente significativo a menos que el tamaño del efecto poblacional sea exactamente cero (e incluso allí mostrará significancia estadística a la tasa del error Tipo I utilizado). Por ejemplo, un coeficiente de correlación de Pearson de muestra de 0,01 es estadísticamente significativo si el tamaño de la muestra es 1000. Informar sólo el valor p significativo de este análisis podría ser engañoso si una correlación de 0,01 es demasiado pequeña para ser de interés en una aplicación particular.

El término tamaño del efecto puede referirse a una medida estandarizada del efecto (como r , d de Cohen o el odds ratio ), o a una medida no estandarizada (p. ej., la diferencia entre las medias de los grupos o los coeficientes de regresión no estandarizados). Las medidas estandarizadas del tamaño del efecto se suelen utilizar cuando:

En los metanálisis, los tamaños del efecto estandarizados se utilizan como una medida común que puede calcularse para diferentes estudios y luego combinarse en un resumen general.

El hecho de que el tamaño de un efecto deba interpretarse como pequeño, mediano o grande depende de su contexto sustantivo y su definición operativa. Los criterios convencionales de Cohen (pequeño , mediano o grande) [9] son casi omnipresentes en muchos campos, aunque Cohen [9] advirtió:

"Los términos 'pequeño', 'mediano' y 'grande' son relativos, no sólo entre sí, sino también con el área de las ciencias del comportamiento o incluso más particularmente con el contenido específico y el método de investigación que se emplea en cualquier investigación determinada. ... Frente a esta relatividad, existe un cierto riesgo inherente al ofrecer definiciones operativas convencionales de estos términos para su uso en el análisis de poder en un campo de investigación tan diverso como las ciencias del comportamiento. Sin embargo, este riesgo se acepta en la creencia de que se necesita más Se gana más que se pierde al proporcionar un marco de referencia convencional común cuyo uso se recomienda sólo cuando no se dispone de una base mejor para estimar el índice ES". (pág. 25)

En el diseño de dos muestras, Sawilowsky [10] concluyó: "Con base en los hallazgos de la investigación actual en la literatura aplicada, parece apropiado revisar las reglas generales para los tamaños del efecto", teniendo en cuenta las advertencias de Cohen, y amplió las descripciones para incluir descripciones muy pequeñas. , muy grande y enorme . Se podrían desarrollar las mismas normas de facto para otros diseños.

Lenth [11] destaca por un tamaño de efecto "medio", "usted elegirá el mismo n independientemente de la precisión o confiabilidad de su instrumento, o de la estrechez o diversidad de sus sujetos. Claramente, aquí se ignoran consideraciones importantes". "Deberíamos interpretar la importancia sustancial de sus resultados al fundamentarlos en un contexto significativo o cuantificar su contribución al conocimiento, y las descripciones del tamaño del efecto de Cohen pueden ser útiles como punto de partida". [5] De manera similar, un informe patrocinado por el Departamento de Educación de EE. UU. decía: "El uso indiscriminado generalizado de los valores genéricos de tamaño del efecto pequeño, mediano y grande de Cohen para caracterizar los tamaños del efecto en dominios a los que sus valores normativos no se aplican es, por lo tanto, igualmente inapropiado y engañoso". ". [12]

Sugirieron que "las normas apropiadas son aquellas basadas en distribuciones de tamaños de efectos para medidas de resultados comparables de intervenciones comparables dirigidas a muestras comparables". Así, si un estudio en un campo donde la mayoría de las intervenciones son pequeñas arrojara un efecto pequeño (según los criterios de Cohen), estos nuevos criterios lo llamarían "grande". En un punto relacionado, véanse la paradoja de Abelson y la paradoja de Sawilowsky. [13] [14] [15]

Se conocen entre 50 y 100 medidas diferentes del tamaño del efecto. Muchos tamaños de efectos de diferentes tipos se pueden convertir a otros tipos, ya que muchos estiman la separación de dos distribuciones, por lo que están relacionados matemáticamente. Por ejemplo, un coeficiente de correlación se puede convertir a d de Cohen y viceversa.

Estos tamaños del efecto estiman la cantidad de varianza dentro de un experimento que el modelo del experimento "explica" o "contabiliza" ( variación explicada ).

La correlación de Pearson , a menudo denominada r e introducida por Karl Pearson , se utiliza ampliamente como tamaño del efecto cuando se dispone de datos cuantitativos pareados; por ejemplo, si estuviéramos estudiando la relación entre el peso al nacer y la longevidad. El coeficiente de correlación también se puede utilizar cuando los datos son binarios. La r de Pearson puede variar en magnitud de −1 a 1, donde −1 indica una relación lineal negativa perfecta, 1 indica una relación lineal positiva perfecta y 0 indica que no hay relación lineal entre dos variables. Cohen da las siguientes pautas para las ciencias sociales: [9] [16]

Un tamaño del efecto relacionado es r 2 , el coeficiente de determinación (también conocido como R 2 o " r cuadrado "), calculado como el cuadrado de la correlación de Pearson r . En el caso de datos pareados, esta es una medida de la proporción de varianza compartida por las dos variables y varía de 0 a 1. Por ejemplo, con una r de 0,21 el coeficiente de determinación es 0,0441, lo que significa que el 4,4% de la la varianza de cualquiera de las variables se comparte con la otra variable. La r 2 es siempre positiva, por lo que no transmite la dirección de la correlación entre las dos variables.

Eta-cuadrado describe la relación de varianza explicada en la variable dependiente por un predictor mientras se controlan otros predictores, lo que lo hace análogo a r 2 . Eta-cuadrado es un estimador sesgado de la varianza explicada por el modelo en la población (estima solo el tamaño del efecto en la muestra). Esta estimación comparte con r 2 la debilidad de que cada variable adicional aumentará automáticamente el valor de η 2 . Además, mide la varianza explicada de la muestra, no de la población, lo que significa que siempre sobreestimará el tamaño del efecto, aunque el sesgo se reduce a medida que la muestra crece.

Un estimador menos sesgado de la varianza explicada en la población es ω 2 [17]

Esta forma de fórmula se limita al análisis entre sujetos con tamaños de muestra iguales en todas las celdas. [17] Dado que es menos sesgado (aunque no imparcial ), ω 2 es preferible a η 2 ; sin embargo, puede resultar más inconveniente calcularlo para análisis complejos. Se ha publicado una forma generalizada del estimador para experimentos de análisis entre sujetos y dentro de sujetos, medidas repetidas, diseño mixto y diseño de bloques aleatorios. [18] Además, se han publicado métodos para calcular ω 2 parcial para factores individuales y factores combinados en diseños con hasta tres variables independientes. [18]

La f 2 de Cohen es una de varias medidas del tamaño del efecto que se pueden usar en el contexto de una prueba F para ANOVA o regresión múltiple . Su cantidad de sesgo (sobreestimación del tamaño del efecto para el ANOVA) depende del sesgo de su medida subyacente de la varianza explicada (por ejemplo, R 2 , η 2 , ω 2 ).

La medida del tamaño del efecto f 2 para regresión múltiple se define como:

Asimismo, f 2 se puede definir como:

La medida del tamaño del efecto para la regresión múltiple secuencial y también común para el modelado PLS [20] se define como:

El de Cohen también se puede encontrar para el análisis factorial de varianza (ANOVA) trabajando hacia atrás, usando:

En un diseño equilibrado (tamaños de muestra equivalentes entre grupos) de ANOVA, el parámetro poblacional correspondiente de es

Otra medida que se utiliza con diferencias de correlación es la q de Cohen. Ésta es la diferencia entre dos coeficientes de regresión de Pearson transformados por Fisher. En símbolos esto es

donde r 1 y r 2 son las regresiones que se comparan. El valor esperado de q es cero y su varianza es

El tamaño del efecto bruto correspondiente a una comparación de dos grupos se calcula inherentemente como las diferencias entre las dos medias. Sin embargo, para facilitar la interpretación es común estandarizar el tamaño del efecto; A continuación se presentan varias convenciones para la estandarización estadística.

Un tamaño del efecto (poblacional) θ basado en medias generalmente considera la diferencia de medias estandarizada (DME) entre dos poblaciones [21] : 78

En el ámbito práctico, los valores de la población normalmente no se conocen y deben estimarse a partir de estadísticas de muestra. Las diversas versiones de tamaños del efecto basadas en medias difieren con respecto a las estadísticas que se utilizan.

Esta forma para el tamaño del efecto se asemeja al cálculo de un estadístico de prueba t , con la diferencia crítica de que el estadístico de prueba t incluye un factor de . Esto significa que para un tamaño de efecto determinado, el nivel de significancia aumenta con el tamaño de la muestra. A diferencia del estadístico de prueba t , el tamaño del efecto tiene como objetivo estimar un parámetro poblacional y no se ve afectado por el tamaño de la muestra.

Los valores de SMD de 0,2 a 0,5 se consideran pequeños, de 0,5 a 0,8 se consideran medios y mayores de 0,8 se consideran grandes. [22]

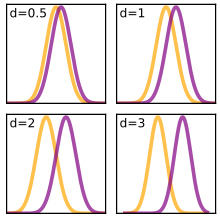

La d de Cohen se define como la diferencia entre dos medias dividida por una desviación estándar de los datos, es decir

Jacob Cohen definió s , la desviación estándar combinada , como (para dos muestras independientes): [9] : 67

La siguiente tabla contiene descriptores para magnitudes de d = 0,01 a 2,0, como lo sugirió inicialmente Cohen y lo amplió Sawilowsky. [10]

Otros autores eligen un cálculo ligeramente diferente de la desviación estándar cuando se refieren a la " d de Cohen " donde el denominador es sin "-2" [23] [24] : 14

Con dos muestras pareadas, observamos la distribución de las puntuaciones de diferencia. En ese caso, s es la desviación estándar de esta distribución de puntuaciones de diferencia. Esto crea la siguiente relación entre el estadístico t para probar una diferencia en las medias de los dos grupos y la d de Cohen :

La d de Cohen se utiliza con frecuencia para estimar tamaños de muestra para pruebas estadísticas. Una d de Cohen más baja indica la necesidad de tamaños de muestra más grandes, y viceversa, como se puede determinar posteriormente junto con los parámetros adicionales del nivel de significancia deseado y el poder estadístico . [25]

Para muestras pareadas, Cohen sugiere que la d calculada es en realidad una d', que no proporciona la respuesta correcta para obtener la potencia de la prueba, y que antes de buscar los valores en las tablas proporcionadas, se debe corregir para r como en la siguiente fórmula: [26]

En 1976, Gene V. Glass propuso un estimador del tamaño del efecto que utiliza sólo la desviación estándar del segundo grupo [21] : 78

El segundo grupo puede considerarse como un grupo de control, y Glass argumentó que si se compararan varios tratamientos con el grupo de control, sería mejor usar solo la desviación estándar calculada a partir del grupo de control, de modo que los tamaños del efecto no difieran en condiciones iguales. y diferentes variaciones.

Bajo un supuesto correcto de varianzas poblacionales iguales, una estimación agrupada de σ es más precisa.

La g de Hedges , sugerida por Larry Hedges en 1981, [27] es como las otras medidas basadas en una diferencia estandarizada [21] : 79

Sin embargo, como estimador del tamaño del efecto poblacional θ está sesgado . Sin embargo, este sesgo se puede corregir aproximadamente multiplicando por un factor

Un estimador del tamaño del efecto similar para comparaciones múltiples (por ejemplo, ANOVA ) es el efecto estandarizado de la raíz cuadrática media Ψ: [19]

Básicamente, esto presenta la diferencia general de todo el modelo ajustada por la raíz cuadrática media, análoga a d o g .

Además, se ha proporcionado una generalización para diseños multifactoriales. [19]

Siempre que los datos tengan una distribución gaussiana , una g de Hedges escalada , sigue una distribución t no central con el parámetro de no centralidad y ( n 1 + n 2 − 2) grados de libertad. Asimismo, el Δ de Glass escalado se distribuye con n 2 − 1 grados de libertad.

A partir de la distribución es posible calcular la expectativa y la varianza de los tamaños del efecto.

En algunos casos se utilizan aproximaciones de muestras grandes para la varianza. Una sugerencia para la varianza del estimador insesgado de Hedges es [21] : 86

La distancia de Mahalanobis (D) es una generalización multivariada de la d de Cohen, que tiene en cuenta las relaciones entre las variables. [29]

Las medidas de asociación comúnmente utilizadas para la prueba de chi-cuadrado son el coeficiente Phi y la V de Cramér (a veces denominada phi de Cramér y denotada como φ c ). Phi está relacionado con el coeficiente de correlación biserial puntual y la d de Cohen y estima el alcance de la relación entre dos variables (2 × 2). [30] La V de Cramér se puede utilizar con variables que tengan más de dos niveles.

Phi se puede calcular encontrando la raíz cuadrada del estadístico chi-cuadrado dividida por el tamaño de la muestra.

De manera similar, la V de Cramér se calcula tomando la raíz cuadrada del estadístico chi-cuadrado dividida por el tamaño de la muestra y la longitud de la dimensión mínima ( k es el menor del número de filas r o columnas c ).

φ c es la intercorrelación de las dos variables discretas [31] y puede calcularse para cualquier valor de r o c . Sin embargo, como los valores de chi-cuadrado tienden a aumentar con el número de celdas, cuanto mayor sea la diferencia entre r y c , es más probable que V tienda a 1 sin evidencia sólida de una correlación significativa.

Otra medida del tamaño del efecto utilizada para las pruebas de chi cuadrado es el omega de Cohen ( ). Esto se define como

En Statistical Power Analysis for the Behavioral Sciences (1988, pp.224-225), Cohen ofrece la siguiente pauta general para interpretar omega (ver tabla a continuación), pero advierte contra su "posible inadecuación en cualquier contexto sustantivo dado" y aconseja utilizar en su lugar, un juicio relevante para el contexto.

El odds ratio (OR) es otro tamaño del efecto útil. Es apropiado cuando la pregunta de investigación se centra en el grado de asociación entre dos variables binarias . Por ejemplo, considere un estudio sobre la capacidad de ortografía. En un grupo de control, dos estudiantes aprueban la clase por cada uno que reprueba, por lo que las probabilidades de aprobar son de dos a uno (o 2/1 = 2). En el grupo de tratamiento, seis estudiantes aprueban por cada uno que reprueba, por lo que las probabilidades de aprobar son de seis a uno (o 6/1 = 6). El tamaño del efecto se puede calcular observando que las probabilidades de aprobar en el grupo de tratamiento son tres veces mayores que en el grupo de control (porque 6 dividido por 2 es 3). Por lo tanto, la razón de probabilidades es 3. Las estadísticas de la razón de probabilidades están en una escala diferente a la d de Cohen, por lo que este '3' no es comparable a una d de Cohen de 3.

El riesgo relativo (RR), también llamado índice de riesgo, es simplemente el riesgo (probabilidad) de un evento en relación con alguna variable independiente. Esta medida del tamaño del efecto difiere del odds ratio en que compara probabilidades en lugar de odds , pero se acerca asintóticamente a esta última para probabilidades pequeñas. Usando el ejemplo anterior, las probabilidades de que pasen los del grupo de control y del grupo de tratamiento son 2/3 (o 0,67) y 6/7 (o 0,86), respectivamente. El tamaño del efecto se puede calcular igual que antes, pero utilizando las probabilidades. Por tanto, el riesgo relativo es 1,28. Dado que se utilizaron probabilidades de aprobación bastante grandes, existe una gran diferencia entre el riesgo relativo y el odds ratio. Si se hubiera utilizado el fracaso (una probabilidad menor) como evento (en lugar de aprobar ), la diferencia entre las dos medidas del tamaño del efecto no sería tan grande.

Si bien ambas medidas son útiles, tienen diferentes usos estadísticos. En la investigación médica, el odds ratio se utiliza comúnmente para estudios de casos y controles , ya que generalmente se estiman los odds, pero no las probabilidades. [32] El riesgo relativo se utiliza comúnmente en ensayos controlados aleatorios y estudios de cohortes , pero el riesgo relativo contribuye a sobreestimaciones de la efectividad de las intervenciones. [33]

La diferencia de riesgo (DR), a veces llamada reducción absoluta del riesgo, es simplemente la diferencia en el riesgo (probabilidad) de un evento entre dos grupos. Es una medida útil en la investigación experimental, ya que la RD indica en qué medida una intervención experimental cambia la probabilidad de un evento o resultado. Usando el ejemplo anterior, las probabilidades de que aquellos en el grupo de control y en el grupo de tratamiento pasen son 2/3 (o 0,67) y 6/7 (o 0,86), respectivamente, por lo que el tamaño del efecto RD es 0,86 − 0,67 = 0,19 (o 19%). RD es la medida superior para evaluar la efectividad de las intervenciones. [33]

Una medida utilizada en el análisis de poder al comparar dos proporciones independientes es la h de Cohen . Esto se define de la siguiente manera

Para describir más fácilmente el significado de un tamaño del efecto a personas ajenas a la estadística, el tamaño del efecto en lenguaje común, como su nombre lo indica, fue diseñado para comunicarlo en un inglés sencillo. Se utiliza para describir una diferencia entre dos grupos y fue propuesto y nombrado por Kenneth McGraw y SP Wong en 1992. [34] Utilizaron el siguiente ejemplo (sobre las alturas de hombres y mujeres): "en cualquier emparejamiento aleatorio de hombres y mujeres adultos jóvenes, la probabilidad de que el hombre sea más alto que la mujer es .92, o en términos más simples aún, en 92 de cada 100 citas a ciegas entre adultos jóvenes, el hombre será más alto que la mujer", [34 ] al describir el valor poblacional del tamaño del efecto del lenguaje común.

El valor poblacional, para el tamaño del efecto del lenguaje común, a menudo se informa así, en términos de pares elegidos aleatoriamente de la población. Kerby (2014) señala que un par , definido como una puntuación en un grupo emparejada con una puntuación en otro grupo, es un concepto central del tamaño del efecto del lenguaje común. [35]

Como otro ejemplo, consideremos un estudio científico (tal vez de un tratamiento para alguna enfermedad crónica, como la artritis) con diez personas en el grupo de tratamiento y diez personas en un grupo de control. Si se compara a todos los miembros del grupo de tratamiento con todos los del grupo de control, entonces hay (10×10=) 100 pares. Al final del estudio, el resultado se clasifica en una puntuación para cada individuo (por ejemplo, en una escala de movilidad y dolor, en el caso de un estudio de artritis) y luego se comparan todas las puntuaciones entre los pares. El resultado, como porcentaje de pares que apoyan la hipótesis, es el tamaño del efecto del lenguaje común. En el estudio de ejemplo podría ser (digamos) 0,80, si 80 de los 100 pares de comparación muestran un mejor resultado para el grupo de tratamiento que para el grupo de control, y el informe podría decir lo siguiente: "Cuando un paciente en el grupo de tratamiento En comparación con un paciente del grupo de control, en 80 de 100 pares el paciente tratado mostró un mejor resultado del tratamiento". El valor de la muestra, por ejemplo en un estudio como este, es un estimador insesgado del valor de la población. [36]

Vargha y Delaney generalizaron el tamaño del efecto del lenguaje común (Vargha-Delaney A ), para cubrir datos de nivel ordinal. [37]

Un tamaño del efecto relacionado con el tamaño del efecto del lenguaje común es la correlación de rango biserial. Esta medida fue introducida por Cureton como tamaño del efecto para la prueba U de Mann-Whitney . [38] Es decir, hay dos grupos y las puntuaciones de los grupos se han convertido en rangos. La fórmula de diferencia simple de Kerby calcula la correlación biserial de rango a partir del tamaño del efecto del lenguaje común. [35] Sea f la proporción de pares favorables a la hipótesis (el tamaño del efecto del lenguaje común), y sea u la proporción de pares no favorables, el rango biserial r es la diferencia simple entre las dos proporciones: r = f − tu . En otras palabras, la correlación es la diferencia entre el tamaño del efecto del lenguaje común y su complemento. Por ejemplo, si el tamaño del efecto del lenguaje común es del 60%, entonces el rango biserial r es igual al 60% menos el 40%, o r = 0,20. La fórmula de Kerby es direccional y los valores positivos indican que los resultados respaldan la hipótesis.

Wendt proporcionó una fórmula no direccional para la correlación biserial de rango, de modo que la correlación es siempre positiva. [39] La ventaja de la fórmula de Wendt es que se puede calcular con información que está fácilmente disponible en artículos publicados. La fórmula utiliza solo el valor de prueba de U de la prueba U de Mann-Whitney y los tamaños de muestra de los dos grupos: r = 1 – (2 U )/( n 1 n 2 ). Tenga en cuenta que U se define aquí según la definición clásica como el menor de los dos valores U que se pueden calcular a partir de los datos. Esto asegura que 2 U < n 1 n 2 , ya que n 1 n 2 es el valor máximo de la estadística U.

Un ejemplo puede ilustrar el uso de las dos fórmulas. Consideremos un estudio de salud de veinte adultos mayores, diez en el grupo de tratamiento y diez en el grupo de control; por tanto, hay diez veces diez o 100 pares. El programa de salud utiliza dieta, ejercicio y suplementos para mejorar la memoria, y la memoria se mide mediante una prueba estandarizada. Una prueba U de Mann-Whitney muestra que el adulto del grupo de tratamiento tenía mejor memoria en 70 de los 100 pares y peor memoria en 30 pares. La U de Mann-Whitney es la menor de 70 y 30, por lo que U = 30. La correlación entre la memoria y el rendimiento del tratamiento según la fórmula de diferencia simple de Kerby es r = (70/100) − (30/100) = 0,40. La correlación según la fórmula de Wendt es r = 1 − (2·30)/(10·10) = 0,40.

El delta de Cliff o , desarrollado originalmente por Norman Cliff para su uso con datos ordinales, [40] es una medida de la frecuencia con la que los valores de una distribución son mayores que los valores de una segunda distribución. Fundamentalmente, no requiere ninguna suposición sobre la forma o extensión de las dos distribuciones.

La estimación muestral viene dada por:

está linealmente relacionado con el estadístico U de Mann-Whitney ; sin embargo, capta la dirección de la diferencia en su signo. Dado el Mann-Whitney , es:

Los intervalos de confianza de tamaños de efecto estandarizados, especialmente los de Cohen y , se basan en el cálculo de intervalos de confianza de parámetros de no centralidad ( ncp ). Un enfoque común para construir el intervalo de confianza de ncp es encontrar los valores críticos de ncp para ajustar la estadística observada a los cuantiles de cola α /2 y (1 − α /2). El paquete MBESS de SAS y R proporciona funciones para encontrar valores críticos de ncp .

Para un solo grupo, M denota la media de la muestra, μ la media de la población, SD la desviación estándar de la muestra, σ la desviación estándar de la población y n es el tamaño de la muestra del grupo. El valor t se utiliza para probar la hipótesis sobre la diferencia entre la media y una línea base μ . Por lo general, la línea base μ es cero. En el caso de dos grupos relacionados, el grupo único se construye a partir de las diferencias en pares de muestras, mientras que SD y σ denotan las desviaciones estándar de las diferencias de la muestra y la población en lugar de dentro de los dos grupos originales.

es la estimación puntual de

Entonces,

n 1 o n 2 son los respectivos tamaños de muestra.

donde

y Cohen

Entonces,

La prueba ANOVA unidireccional aplica una distribución F no central . Mientras que con una desviación estándar de población determinada , la misma pregunta de prueba aplica una distribución de chi-cuadrado no central .

Para cada j - ésima muestra dentro del i -ésimo grupo Xi , j , denota

Mientras,

Entonces, tanto ncp ( s ) de F como igualan

En el caso de K grupos independientes del mismo tamaño, el tamaño total de la muestra es N := n · K .

La prueba t para un par de grupos independientes es un caso especial de ANOVA unidireccional. Tenga en cuenta que el parámetro de no centralidad de F no es comparable al parámetro de no centralidad del t correspondiente . En realidad, y .

Los valores SMD de 0,2 a 0,5 se consideran pequeños, los valores de 0,5 a 0,8 se consideran medios y los valores > 0,8 se consideran grandes. En los estudios de psicofarmacología que comparan grupos independientes, las DME que son estadísticamente significativas casi siempre se encuentran en el rango pequeño a mediano. Es raro que se obtengan SMD grandes.

Más explicaciones