Una pantalla de visualización frontal , o HUD ( Head - Up Display) , [1] también conocida como HUD ( / hʌd / ) o sistema de guía de visualización frontal ( HGS ), es cualquier pantalla transparente que presenta datos sin requerir que los usuarios aparten la vista de sus puntos de vista habituales. El origen del nombre se debe a que un piloto puede ver la información con la cabeza posicionada "arriba" y mirando hacia adelante, en lugar de inclinada hacia abajo mirando los instrumentos inferiores. Un HUD también tiene la ventaja de que los ojos del piloto no necesitan reenfocarse para ver el exterior después de mirar los instrumentos ópticamente más cercanos.

Aunque inicialmente se desarrollaron para la aviación militar, los HUD ahora se utilizan en aviones comerciales, automóviles y otras aplicaciones (principalmente profesionales).

Las pantallas de visualización frontal fueron una tecnología precursora de la realidad aumentada (RA), incorporando un subconjunto de las características necesarias para la experiencia de RA completa, pero carecían del registro y seguimiento necesarios entre el contenido virtual y el entorno del mundo real del usuario. [2]

.jpg/440px-PZL_TS-11F_Iskra_(HUD).jpg)

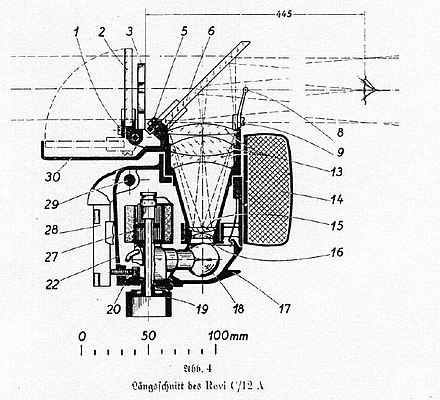

Un HUD típico contiene tres componentes principales: una unidad de proyección , un combinador y una computadora de generación de video . [3]

La unidad de proyección de un HUD típico es una configuración de colimador óptico : una lente convexa o un espejo cóncavo con un tubo de rayos catódicos , una pantalla de diodos emisores de luz o una pantalla de cristal líquido en su foco. Esta configuración (un diseño que existe desde la invención de la mira reflectora en 1900) produce una imagen en la que la luz está colimada , es decir, el punto focal se percibe como el infinito.

El combinador es típicamente una pieza de vidrio plana en ángulo (un divisor de haz ) ubicada directamente frente al espectador, que redirige la imagen proyectada desde el proyector de tal manera que se pueda ver el campo de visión y la imagen infinita proyectada al mismo tiempo. Los combinadores pueden tener recubrimientos especiales que reflejan la luz monocromática proyectada sobre ellos desde la unidad del proyector mientras permiten que pasen todas las demás longitudes de onda de luz. En algunos diseños ópticos, los combinadores también pueden tener una superficie curva para reenfocar la imagen del proyector.

La computadora proporciona la interfaz entre el HUD (es decir, la unidad de proyección) y los sistemas/datos que se mostrarán y genera las imágenes y la simbología que mostrará la unidad de proyección.

Además del HUD montado fijo, también existen pantallas montadas en la cabeza (HMD). Estas incluyen pantallas montadas en el casco (ambas abreviadas como HMD), formas de HUD que cuentan con un elemento de pantalla que se mueve con la orientación de la cabeza del usuario.

Muchos cazas modernos (como el F/A-18 , el F-16 y el Eurofighter ) utilizan tanto un HUD como un HMD simultáneamente. El F-35 Lightning II fue diseñado sin HUD, basándose únicamente en el HMD, lo que lo convierte en el primer caza militar moderno que no tiene un HUD fijo.

Los HUD se dividen en cuatro generaciones que reflejan la tecnología utilizada para generar las imágenes.

Se están introduciendo nuevas tecnologías de imágenes por micropantalla, entre ellas la pantalla de cristal líquido (LCD), el cristal líquido sobre silicio (LCoS), los microespejos digitales (DMD) y el diodo orgánico emisor de luz (OLED).

Los HUD evolucionaron a partir de la mira reflectora , una tecnología de mira óptica sin paralaje anterior a la Segunda Guerra Mundial para aviones de combate militares . [4] La mira giroscópica agregó una retícula que se movía según la velocidad y la tasa de giro para calcular la cantidad de avance necesario para alcanzar un objetivo mientras se maniobra.

A principios de la década de 1940, el Telecommunications Research Establishment (TRE), a cargo del desarrollo del radar en el Reino Unido, descubrió que los pilotos de cazas nocturnos de la Royal Air Force (RAF) tenían dificultades para reaccionar a las instrucciones verbales del operador del radar cuando se acercaban a sus objetivos. Experimentaron con la adición de una segunda pantalla de radar para el piloto, pero descubrieron que tenían problemas para levantar la vista de la pantalla iluminada hacia el cielo oscuro para encontrar el objetivo. En octubre de 1942 habían combinado con éxito la imagen del tubo del radar con una proyección de su mira giroscópica GGS Mk. II estándar en un área plana del parabrisas y, más tarde, en la propia mira. [5] Una mejora clave fue el cambio del radar AI Mk. IV original al radar AI Mk. VIII de frecuencia de microondas que se encuentra en el caza nocturno De Havilland Mosquito . Este conjunto produjo un horizonte artificial que facilitó aún más el vuelo con la cabeza erguida. [ cita requerida ]

En 1955, la Oficina de Investigación y Desarrollo Naval de la Armada de los EE. UU. realizó una investigación con una unidad de HUD de maqueta junto con un controlador de palanca lateral en un intento de aliviar la carga del piloto al volar aviones a reacción modernos y hacer que la instrumentación sea menos complicada durante el vuelo. Si bien su investigación nunca se incorporó a ningún avión de esa época, la maqueta rudimentaria de HUD que construyeron tenía todas las características de las unidades HUD modernas de la actualidad. [6]

La tecnología HUD fue desarrollada posteriormente por la Marina Real Británica en el Buccaneer , cuyo prototipo voló por primera vez el 30 de abril de 1958. El avión fue diseñado para volar a muy baja altura y a velocidades muy altas y lanzar bombas en combates que duraban segundos. Por ello, el piloto no tenía tiempo de levantar la vista de los instrumentos para mirar la mira de bombardeo. Esto condujo al concepto de una "mira de ataque" que combinaría la altitud, la velocidad aerodinámica y el cañón/mira de bombardeo en una única pantalla similar a una mira de cañón. Hubo una feroz competencia entre los partidarios del nuevo diseño del HUD y los partidarios de la antigua mira de cañón electromecánica, y el HUD se describió como una opción radical, incluso temeraria.

La rama Air Arm del Ministerio de Defensa del Reino Unido patrocinó el desarrollo de un Strike Sight. El Royal Aircraft Establishment (RAE) diseñó el equipo y el uso más temprano del término "head-up-display" se remonta a esta época. [7] Las unidades de producción fueron construidas por Rank Cintel , y el sistema se integró por primera vez en 1958. El negocio de HUD de Cintel fue absorbido por Elliott Flight Automation y el HUD Buccaneer fue fabricado y desarrollado, continuando hasta una versión Mark III con un total de 375 sistemas fabricados; la Royal Navy le dio el título de "instalar y olvidar" y todavía estaba en servicio casi 25 años después. BAE Systems , como sucesor de Elliotts a través de GEC-Marconi Avionics, tiene así derecho a reclamar el primer head-up display del mundo en servicio operativo. [8] Una versión similar que reemplazó los modos de bombardeo con modos de ataque con misiles fue parte del HUD AIRPASS instalado en el English Electric Lightning a partir de 1959.

En el Reino Unido, pronto se observó que los pilotos que volaban con las nuevas miras estaban mejorando en el pilotaje de sus aviones. [ cita requerida ] En este punto, el HUD amplió su propósito más allá de la puntería de armas al pilotaje general. En la década de 1960, el piloto de pruebas francés Gilbert Klopfstein creó el primer HUD moderno y un sistema estandarizado de símbolos de HUD para que los pilotos solo tuvieran que aprender un sistema y pudieran cambiar de aeronave más fácilmente. El HUD moderno utilizado en las aproximaciones de reglas de vuelo por instrumentos para el aterrizaje se desarrolló en 1975. [9] Klopfstein fue pionero en la tecnología HUD en aviones de combate militares y helicópteros , con el objetivo de centralizar los datos de vuelo críticos dentro del campo de visión del piloto. Este enfoque buscaba aumentar la eficiencia de escaneo del piloto y reducir la "saturación de tareas" y la sobrecarga de información .

El uso de HUD se extendió más allá de los aviones militares. En la década de 1970, el HUD se introdujo en la aviación comercial y, en 1988, el Oldsmobile Cutlass Supreme se convirtió en el primer automóvil de producción con una pantalla de visualización frontal.

Hasta hace unos años, los aviones Embraer 190, Saab 2000, Boeing 727 y Boeing 737 Classic (737-300/400/500) y Next Generation (737-600/700/800/900) eran los únicos aviones comerciales de pasajeros disponibles con HUD. Sin embargo, la tecnología se está volviendo más común en aviones como el Canadair RJ , el Airbus A318 y varios jets comerciales que cuentan con las pantallas. Los HUD se han convertido en equipo estándar en el Boeing 787. [ 10] Además, las familias Airbus A320, A330, A340 y A380 están actualmente en proceso de certificación para un HUD. [11] Los HUD también se agregaron al orbitador del transbordador espacial .

Hay varios factores que interactúan en el diseño de un HUD:

En los sistemas de aviónica de las aeronaves, los HUD suelen funcionar a partir de sistemas informáticos redundantes duales e independientes. Reciben información directamente de los sensores ( pitot-estático , giroscópico , de navegación, etc.) a bordo de la aeronave y realizan sus propios cálculos en lugar de recibir datos calculados previamente de las computadoras de vuelo. En otras aeronaves (el Boeing 787, por ejemplo), el cálculo de guía del HUD para el despegue con baja visibilidad (LVTO) y la aproximación con baja visibilidad proviene de la misma computadora de guía de vuelo que controla el piloto automático. Las computadoras están integradas con los sistemas de la aeronave y permiten la conectividad con varios buses de datos diferentes, como el ARINC 429 , el ARINC 629 y el MIL-STD-1553 . [9]

Los HUD típicos de las aeronaves muestran la velocidad aerodinámica , la altitud , una línea del horizonte , el rumbo , los indicadores de viraje/inclinación y derrape/derrape . Estos instrumentos son los mínimos requeridos por la Parte 91 del Título 14 del CFR. [13]

Otros símbolos y datos también están disponibles en algunos HUD:

Desde que se introdujeron en los HUD, tanto el símbolo FPV como el de aceleración se están volviendo estándar en las pantallas de visualización frontal (HDD). La forma real del símbolo FPV en un HDD no está estandarizada, pero generalmente es un dibujo simple de una aeronave, como un círculo con dos líneas cortas en ángulo (180 ± 30 grados) y "alas" en los extremos de la línea descendente. Mantener el FPV en el horizonte permite al piloto volar en virajes nivelados en varios ángulos de inclinación.

Además de la información genérica descrita anteriormente, las aplicaciones militares incluyen datos de sistemas de armas y sensores como:

Durante la década de 1980, el ejército de los Estados Unidos probó el uso de HUD en aeronaves de despegue y aterrizaje verticales (VTOL) y de despegue y aterrizaje cortos (STOL). Se desarrolló un formato HUD en el Centro de Investigación Ames de la NASA para proporcionar a los pilotos de aeronaves VTOL y STOL una guía de vuelo completa e información de control para operaciones de vuelo en área terminal de Categoría III C. Esto incluye una gran variedad de operaciones de vuelo, desde vuelos STOL en pistas terrestres hasta operaciones VTOL en portaaviones . Las principales características de este formato de visualización son la integración de la trayectoria de vuelo y la información de guía de seguimiento en un campo de visión estrecho, fácilmente asimilable por el piloto con una sola mirada, y la superposición de información de situación vertical y horizontal. La pantalla es un derivado de un diseño exitoso desarrollado para aeronaves de transporte convencionales. [14]

El uso de pantallas de visualización frontal permite a los aviones comerciales una gran flexibilidad en sus operaciones. Se han aprobado sistemas que permiten despegues y aterrizajes con visibilidad reducida, así como aterrizajes y aterrizajes totalmente manuales de Categoría III A. [15] [16] [17] Inicialmente costosos y físicamente grandes, estos sistemas solo se instalaron en aviones más grandes capaces de soportarlos. Estos tendían a ser los mismos aviones que, como estándar, admitían el aterrizaje automático (con la excepción de ciertos tipos de turbohélice [ aclaración necesaria ] que tenían HUD como opción), lo que hacía que la pantalla de visualización frontal fuera innecesaria para los aterrizajes de Categoría III. Esto retrasó la adopción del HUD en los aviones comerciales. Al mismo tiempo, los estudios han demostrado que el uso de un HUD durante los aterrizajes disminuye la desviación lateral de la línea central en todas las condiciones de aterrizaje, aunque el punto de contacto a lo largo de la línea central no cambia. [18]

Para la aviación general , MyGoFlight espera recibir un STC y vender su HUD SkyDisplay por $25,000 sin instalación para un solo motor de pistón como el Cirrus SR22s y más para Cessna Caravans o Pilatus PC-12s turbohélices monomotor: 5 a 10% del costo de un HUD tradicional aunque no es conforme , no coincide exactamente con el terreno exterior. [19] Los datos de vuelo de una tableta se pueden proyectar en el HUD Epic Optix Eagle 1 de $1,800. [20]

En sistemas más avanzados, como el denominado "Sistema de visión de vuelo mejorado" de la Administración Federal de Aviación de los Estados Unidos (FAA), [21] se puede superponer una imagen visual del mundo real sobre el combinador. Normalmente, se instala una cámara infrarroja (monobanda o multibanda) en el morro del avión para mostrar una imagen conformada al piloto. "Sistema de visión mejorada EVS" es un término aceptado por la industria que la FAA decidió no utilizar porque "la FAA cree que [podría] confundirse con la definición del sistema y el concepto operativo que se encuentran en 91.175(l) y (m)" [21]. En una instalación EVS, la cámara está instalada en realidad en la parte superior del estabilizador vertical en lugar de "lo más cerca posible de la posición de los ojos del piloto". Sin embargo, cuando se utiliza con un HUD, la cámara debe montarse lo más cerca posible del punto de los ojos del piloto, ya que se espera que la imagen "se superponga" al mundo real cuando el piloto mira a través del combinador.

El "registro", o la superposición precisa de la imagen del EVS con la imagen del mundo real, es una característica que las autoridades examinan detenidamente antes de aprobar un EVS basado en HUD. Esto se debe a la importancia de que el HUD coincida con el mundo real y, por lo tanto, pueda proporcionar datos precisos en lugar de información engañosa.

Si bien la pantalla EVS puede ser de gran ayuda, la FAA solo ha relajado las normas operativas [22] para que una aeronave con EVS pueda realizar una aproximación de CATEGORÍA I a los mínimos de CATEGORÍA II . En todos los demás casos, la tripulación de vuelo debe cumplir con todas las restricciones visuales "sin ayuda". (Por ejemplo, si la visibilidad de la pista está restringida debido a la niebla, aunque el EVS puede proporcionar una imagen visual clara, no es apropiado (o legal) maniobrar la aeronave utilizando solo el EVS por debajo de los 100 pies sobre el nivel del suelo).

Los sistemas HUD también están siendo diseñados para mostrar una imagen gráfica del sistema de visión sintética (SVS), que utiliza bases de datos de alta precisión de navegación, actitud, altitud y terreno para crear vistas realistas e intuitivas del mundo exterior. [23] [24] [25]

En la primera imagen del SVS con la cabeza hacia abajo que se muestra a la derecha, los indicadores inmediatamente visibles incluyen la cinta de velocidad aerodinámica a la izquierda, la cinta de altitud a la derecha y las pantallas de viraje/inclinación/derrape/derrape en el centro superior. El símbolo de alineación (-v-) está en el centro y directamente debajo de este está el símbolo del vector de la trayectoria de vuelo (FPV) (el círculo con alas cortas y un estabilizador vertical). La línea del horizonte es visible a lo largo de la pantalla con una interrupción en el centro, y directamente a la izquierda hay números a ±10 grados con una línea corta a ±5 grados (la línea de +5 grados es más fácil de ver) que, junto con la línea del horizonte, muestran la inclinación de la aeronave. A diferencia de esta representación en color del SVS en una pantalla de vuelo principal con la cabeza hacia abajo, el SVS que se muestra en un HUD es monocromático, es decir, normalmente, en tonos de verde.

La imagen indica una aeronave con las alas niveladas (es decir, el símbolo del vector de la trayectoria de vuelo es plano en relación con la línea del horizonte y no hay balanceo en el indicador de viraje/inclinación). La velocidad aerodinámica es de 140 nudos, la altitud es de 9450 pies, el rumbo es de 343 grados (el número debajo del indicador de viraje/inclinación). Una inspección minuciosa de la imagen muestra un pequeño círculo violeta que se desplaza del vector de la trayectoria de vuelo ligeramente hacia la parte inferior derecha. Esta es la señal de guía que proviene del sistema de guía de vuelo. Cuando se estabiliza en la aproximación, este símbolo violeta debe estar centrado dentro del FPV.

El terreno está completamente generado por computadora a partir de una base de datos de terreno de alta resolución.

En algunos sistemas, el SVS calcula la trayectoria de vuelo actual o posible de la aeronave (según un modelo de rendimiento de la aeronave, la energía actual de la aeronave y el terreno circundante) y luego enciende cualquier obstáculo en rojo para alertar a la tripulación de vuelo. Un sistema de este tipo podría haber ayudado a evitar el accidente del vuelo 965 de American Airlines contra una montaña en diciembre de 1995. [ cita requerida ]

En el lado izquierdo de la pantalla hay un símbolo exclusivo del SVS, con la apariencia de una escalera violeta que va disminuyendo de lado a lado y que continúa en el lado derecho de la pantalla. Las dos líneas definen un "túnel en el cielo". Este símbolo define la trayectoria deseada de la aeronave en tres dimensiones. Por ejemplo, si el piloto hubiera seleccionado un aeropuerto a la izquierda, este símbolo se curvaría hacia la izquierda y hacia abajo. Si el piloto mantiene el vector de la trayectoria de vuelo junto con el símbolo de la trayectoria, la aeronave volará por la ruta óptima. Esta ruta se basaría en la información almacenada en la base de datos del sistema de gestión de vuelo y mostraría la aproximación aprobada por la FAA para ese aeropuerto.

El túnel en el cielo también puede ayudar mucho al piloto cuando se requiere un vuelo en cuatro dimensiones más preciso, como los requisitos de espacio libre vertical u horizontal reducidos del Rendimiento de Navegación Requerido (RNP). En tales condiciones, el piloto recibe una representación gráfica de dónde debería estar la aeronave y hacia dónde debería ir en lugar de que el piloto tenga que integrar mentalmente la altitud, la velocidad aerodinámica, el rumbo, la energía y la longitud y latitud para volar correctamente la aeronave. [26]

A mediados de 2017, las Fuerzas de Defensa de Israel comenzarán las pruebas de Iron Vision de Elbit , la primera pantalla de visualización frontal del mundo montada en el casco para tanques. Elbit de Israel, que desarrolló el sistema de pantalla montado en el casco para el F-35 , planea que Iron Vision use una serie de cámaras montadas externamente para proyectar la vista de 360° de los alrededores de un tanque en las viseras montadas en el casco de sus miembros de tripulación. Esto permite que los miembros de la tripulación permanezcan dentro del tanque, sin tener que abrir las escotillas para ver afuera. [27]

Estas pantallas están cada vez más disponibles en los automóviles de producción y, por lo general, ofrecen velocímetro , tacómetro y pantallas del sistema de navegación . La información de visión nocturna también se muestra a través del HUD en ciertos automóviles. A diferencia de la mayoría de los HUD que se encuentran en los aviones, las pantallas de visualización frontal para automóviles no están libres de paralaje. Es posible que la pantalla no sea visible para un conductor que use anteojos de sol con lentes polarizados.

También existen sistemas HUD complementarios que proyectan la pantalla sobre un combinador de vidrio montado encima o debajo del parabrisas, o utilizan el propio parabrisas como combinador.

El primer HUD para automóviles fue desarrollado por General Motors Corporation en 1999 con la función de mostrar el servicio de navegación frente a la línea de visión del conductor. En 2010, se introdujo la tecnología AR y se combinó con el HUD para automóviles existente. Basándose en esta tecnología, el servicio de navegación comenzó a mostrarse en el parabrisas del vehículo. [28]

En 2012, Pioneer Corporation presentó un sistema de navegación HUD que reemplaza la visera solar del lado del conductor y superpone visualmente animaciones de las condiciones futuras, una forma de realidad aumentada (RA). [29] [30] Desarrollado por Pioneer Corporation, AR-HUD se convirtió en el primer Head-Up Display automotriz del mercado de accesorios en utilizar un método de escaneo de haz láser directo al ojo, también conocido como pantalla de retina virtual (VRD). La tecnología principal de AR-HUD involucra una pantalla de escaneo de haz láser en miniatura desarrollada por MicroVision, Inc. [31]

Los HUD para cascos de motocicleta también están disponibles comercialmente. [32]

En los últimos años, se ha argumentado que los HUD convencionales serán reemplazados por tecnologías de AR holográficas , como las desarrolladas por WayRay que utilizan elementos ópticos holográficos (HOE). Los HOE permiten un campo de visión más amplio al tiempo que reducen el tamaño del dispositivo y hacen que la solución sea personalizable para cualquier modelo de automóvil. [33] [34] Mercedes Benz presentó un Head Up Display basado en Realidad Aumentada [35] mientras que Faurecia invirtió en un Head Up Display controlado por la mirada y los dedos. [36]

Se han propuesto o se están desarrollando experimentalmente HUD para una serie de otras aplicaciones. En entornos militares, un HUD se puede utilizar para superponer información táctica, como la salida de un telémetro láser o las ubicaciones de los compañeros de escuadrón a los soldados de infantería . También se ha desarrollado un prototipo de HUD que muestra información en el interior de las gafas de un nadador o de la máscara de un buzo . [37] También se están probando sistemas HUD que proyectan información directamente sobre la retina del usuario con un láser de baja potencia ( pantalla de retina virtual ). [38] [39]

Algunas pantallas de visualización frontal pueden realizar traducción de idiomas en tiempo real. [40]