.jpg/440px-Human_Genome_Project_Timeline_(26964377742).jpg)

La biología computacional se refiere al uso de análisis de datos , modelado matemático y simulaciones computacionales para comprender sistemas y relaciones biológicas. [1] Este campo, una intersección de la informática , la biología y los big data , también tiene fundamentos en matemáticas aplicadas , química y genética . [2] Se diferencia de la informática biológica , un subcampo de la informática y la ingeniería que utiliza la bioingeniería para construir computadoras .

La bioinformática , el análisis de los procesos informáticos en sistemas biológicos , comenzó a principios de los años 1970. En ese momento, la investigación en inteligencia artificial utilizaba modelos de redes del cerebro humano para generar nuevos algoritmos . Este uso de datos biológicos empujó a los investigadores biológicos a utilizar computadoras para evaluar y comparar grandes conjuntos de datos en su propio campo. [3]

En 1982, los investigadores compartían información mediante tarjetas perforadas . La cantidad de datos creció exponencialmente a finales de la década de 1980, lo que requirió nuevos métodos computacionales para interpretar rápidamente la información relevante. [3]

Quizás el ejemplo más conocido de biología computacional, el Proyecto Genoma Humano , comenzó oficialmente en 1990. [4] En 2003, el proyecto había mapeado alrededor del 85% del genoma humano, satisfaciendo sus objetivos iniciales. [5] Sin embargo, el trabajo continuó y para 2021 se alcanzó el nivel de "genoma completo" con solo el 0,3% de las bases restantes cubiertas por posibles problemas. [6] [7] El cromosoma Y faltante se agregó en enero de 2022.

Desde finales de la década de 1990, la biología computacional se ha convertido en una parte importante de la biología, dando lugar a numerosos subcampos. [8] Hoy en día, la Sociedad Internacional de Biología Computacional reconoce 21 'Comunidades de Interés Especial' diferentes, cada una de las cuales representa una porción del campo más amplio. [9] Además de ayudar a secuenciar el genoma humano, la biología computacional ha ayudado a crear modelos precisos del cerebro humano , mapear la estructura tridimensional de los genomas y modelar sistemas biológicos. [3]

La anatomía computacional es el estudio de la forma y la forma anatómicas en la escala anatómica visible o macroscópica de la morfología . Implica el desarrollo de métodos matemáticos computacionales y de análisis de datos para modelar y simular estructuras biológicas. Se centra en las estructuras anatómicas de las que se obtienen imágenes, en lugar de en los dispositivos de imágenes médicas. Debido a la disponibilidad de mediciones tridimensionales densas a través de tecnologías como la resonancia magnética , la anatomía computacional ha surgido como un subcampo de las imágenes médicas y la bioingeniería para extraer sistemas de coordenadas anatómicas a escala de morfema en 3D.

La formulación original de la anatomía computacional es como un modelo generativo de formas a partir de ejemplares sobre los que se actúa mediante transformaciones. [10] El grupo de difeomorfismo se utiliza para estudiar diferentes sistemas de coordenadas mediante transformaciones de coordenadas generadas a través de las velocidades de flujo lagrangianas y eulerianas de una configuración anatómica a otra. Se relaciona con la estadística de formas y la morfometría , con la distinción de que los difeomorfismos se utilizan para mapear sistemas de coordenadas, cuyo estudio se conoce como difeomorfometría.

La biología matemática es el uso de modelos matemáticos de organismos vivos para examinar los sistemas que gobiernan la estructura, el desarrollo y el comportamiento en los sistemas biológicos . Esto implica un enfoque más teórico de los problemas, en lugar de su contraparte más empírica de la biología experimental . [11] La biología matemática se basa en las matemáticas discretas , la topología (también útil para el modelado computacional), la estadística bayesiana , el álgebra lineal y el álgebra de Boole . [12]

Estos enfoques matemáticos han permitido la creación de bases de datos y otros métodos para almacenar, recuperar y analizar datos biológicos, un campo conocido como bioinformática . Por lo general, este proceso implica genética y análisis de genes .

La recopilación y el análisis de grandes conjuntos de datos han dado cabida a campos de investigación en crecimiento, como la minería de datos , [12] y el biomodelado computacional, que se refiere a la construcción de modelos informáticos y simulaciones visuales de sistemas biológicos. Esto permite a los investigadores predecir cómo reaccionarán dichos sistemas ante diferentes entornos, lo que resulta útil para determinar si un sistema puede "mantener su estado y sus funciones frente a perturbaciones externas e internas". [13] Si bien las técnicas actuales se centran en sistemas biológicos pequeños, los investigadores están trabajando en enfoques que permitirán analizar y modelar redes más grandes. La mayoría de los investigadores cree que esto será esencial en el desarrollo de enfoques médicos modernos para crear nuevos fármacos y terapias genéticas . [13] Un enfoque de modelado útil es utilizar redes de Petri a través de herramientas como esyN . [14]

De manera similar, hasta décadas recientes la ecología teórica se ha ocupado en gran medida de modelos analíticos que estaban separados de los modelos estadísticos utilizados por los ecólogos empíricos . Sin embargo, los métodos computacionales han ayudado a desarrollar la teoría ecológica mediante la simulación de sistemas ecológicos, además de aumentar la aplicación de métodos de estadística computacional en análisis ecológicos.

La biología de sistemas consiste en calcular las interacciones entre varios sistemas biológicos que van desde el nivel celular hasta poblaciones enteras con el objetivo de descubrir propiedades emergentes. Este proceso suele implicar la interconexión de vías metabólicas y de señalización celular . La biología de sistemas a menudo utiliza técnicas computacionales de modelado biológico y teoría de grafos para estudiar estas interacciones complejas a niveles celulares. [12]

La biología computacional ha ayudado a la biología evolutiva al:

La genómica computacional es el estudio de los genomas de células y organismos . El Proyecto Genoma Humano es un ejemplo de genómica computacional. Este proyecto busca secuenciar todo el genoma humano en un conjunto de datos. Una vez implementado por completo, esto podría permitir a los médicos analizar el genoma de un paciente individual . [16] Esto abre la posibilidad de una medicina personalizada, prescribiendo tratamientos basados en los patrones genéticos preexistentes de un individuo. Los investigadores buscan secuenciar los genomas de animales, plantas, bacterias y todos los demás tipos de vida. [17]

Una de las principales formas en que se comparan los genomas es mediante homología de secuencia . La homología es el estudio de estructuras biológicas y secuencias de nucleótidos en diferentes organismos que provienen de un ancestro común . Las investigaciones sugieren que entre el 80 y el 90% de los genes de los genomas procarióticos recién secuenciados pueden identificarse de esta manera. [17]

La alineación de secuencias es otro proceso para comparar y detectar similitudes entre secuencias biológicas o genes. La alineación de secuencias es útil en varias aplicaciones bioinformáticas, como calcular la subsecuencia común más larga de dos genes o comparar variantes de ciertas enfermedades . [18]

Un proyecto intacto en genómica computacional es el análisis de regiones intergénicas, que comprenden aproximadamente el 97% del genoma humano. [17] Los investigadores están trabajando para comprender las funciones de las regiones no codificantes del genoma humano mediante el desarrollo de métodos computacionales y estadísticos y a través de grandes proyectos de consorcios como ENCODE y el Roadmap Epigenomics Project .

Comprender cómo los genes individuales contribuyen a la biología de un organismo a nivel molecular , celular y de organismo se conoce como ontología genética . La misión del Gene Ontology Consortium es desarrollar un modelo computacional completo y actualizado de sistemas biológicos , desde el nivel molecular hasta vías más amplias y sistemas a nivel celular y de organismo. El recurso Gene Ontology proporciona una representación computacional del conocimiento científico actual sobre las funciones de los genes (o, más propiamente, las proteínas y las moléculas de ARN no codificantes producidas por los genes) de muchos organismos diferentes, desde humanos hasta bacterias. [19]

La genómica 3D es una subsección de la biología computacional que se centra en la organización e interacción de genes dentro de una célula eucariota . Un método utilizado para recopilar datos genómicos en 3D es mediante el mapeo de arquitectura del genoma (GAM). GAM mide distancias 3D de cromatina y ADN en el genoma combinando criosección , el proceso de cortar una tira del núcleo para examinar el ADN, con microdisección láser. Un perfil nuclear es simplemente esta tira o corte que se toma del núcleo. Cada perfil nuclear contiene ventanas genómicas, que son determinadas secuencias de nucleótidos , la unidad básica del ADN. GAM captura una red genómica de contactos complejos de cromatina multipotenciadores en toda la célula. [20]

La neurociencia computacional es el estudio de la función cerebral en términos de las propiedades de procesamiento de información del sistema nervioso . Un subconjunto de la neurociencia, busca modelar el cerebro para examinar aspectos específicos del sistema neurológico. [21] Los modelos del cerebro incluyen:

Es trabajo de los neurocientíficos computacionales mejorar los algoritmos y las estructuras de datos que se utilizan actualmente para aumentar la velocidad de dichos cálculos.

La neuropsiquiatría computacional es un campo emergente que utiliza modelos matemáticos y asistidos por computadora de los mecanismos cerebrales involucrados en los trastornos mentales . Varias iniciativas han demostrado que el modelado computacional es una contribución importante para comprender los circuitos neuronales que podrían generar funciones y disfunciones mentales. [23] [24] [25]

La farmacología computacional es "el estudio de los efectos de los datos genómicos para encontrar vínculos entre genotipos y enfermedades específicos y luego examinar los datos de los fármacos ". [26] La industria farmacéutica requiere un cambio en los métodos para analizar los datos de los medicamentos. Los farmacólogos pudieron utilizar Microsoft Excel para comparar datos químicos y genómicos relacionados con la eficacia de los medicamentos. Sin embargo, la industria ha llegado a lo que se conoce como la barricada de Excel. Esto surge del número limitado de celdas accesibles en una hoja de cálculo . Este desarrollo condujo a la necesidad de la farmacología computacional. Los científicos e investigadores desarrollan métodos computacionales para analizar estos conjuntos de datos masivos . Esto permite una comparación eficiente entre los puntos de datos notables y permite desarrollar medicamentos más precisos. [27]

Los analistas proyectan que si los principales medicamentos fracasan debido a las patentes, será necesaria la biología computacional para reemplazar los medicamentos actuales en el mercado. Se anima a los estudiantes de doctorado en biología computacional a seguir carreras en la industria en lugar de ocupar puestos posdoctorales. Esto es un resultado directo de que las principales empresas farmacéuticas necesitan analistas más calificados de los grandes conjuntos de datos necesarios para producir nuevos medicamentos. [27]

Del mismo modo, la oncología computacional tiene como objetivo determinar las futuras mutaciones en el cáncer mediante enfoques algorítmicos. La investigación en este campo ha llevado al uso de mediciones de alto rendimiento que millones de puntos de datos utilizan robótica y otros dispositivos de detección. Estos datos se recopilan del ADN, el ARN y otras estructuras biológicas. Las áreas de interés incluyen determinar las características de los tumores , analizar moléculas que son deterministas en la causa del cáncer y comprender cómo se relaciona el genoma humano con la causa de los tumores y el cáncer. [28] [29]

Los biólogos computacionales utilizan una amplia gama de software y algoritmos para llevar a cabo sus investigaciones.

El aprendizaje no supervisado es un tipo de algoritmo que encuentra patrones en datos sin etiquetar. Un ejemplo es la agrupación de k-medias , que tiene como objetivo dividir n puntos de datos en k grupos, en los que cada punto de datos pertenece al grupo con la media más cercana. Otra versión es el algoritmo k-medoides , que, al seleccionar un centro de conglomerado o un centroide de conglomerado, seleccionará uno de sus puntos de datos en el conjunto, y no solo un promedio del conglomerado.

El algoritmo sigue estos pasos:

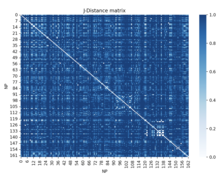

Un ejemplo de esto en biología se utiliza en el mapeo 3D de un genoma. La información de la región HIST1 del cromosoma 13 de un ratón se obtiene de Gene Expression Omnibus . [30] Esta información contiene datos sobre qué perfiles nucleares aparecen en determinadas regiones genómicas. Con esta información, la distancia de Jaccard se puede utilizar para encontrar una distancia normalizada entre todos los loci.

El análisis de gráficos, o análisis de redes , es el estudio de gráficos que representan conexiones entre diferentes objetos. Los gráficos pueden representar todo tipo de redes en biología, como redes de interacción proteína-proteína , redes reguladoras, redes metabólicas y bioquímicas y mucho más. Hay muchas formas de analizar estas redes. Uno de los cuales es observar la centralidad en gráficos. Encontrar centralidad en gráficos asigna clasificaciones de nodos según su popularidad o centralidad en el gráfico. Esto puede resultar útil para encontrar qué nodos son los más importantes. Esto puede resultar muy útil en biología de muchas maneras. Por ejemplo, si tuviéramos datos sobre la actividad de los genes en un período de tiempo determinado, podemos usar el grado de centralidad para ver qué genes son más activos en toda la red o qué genes interactúan más con otros en toda la red. Esto puede ayudarnos a comprender qué funciones desempeñan ciertos genes en la red.

Hay muchas formas de calcular la centralidad en gráficos, todas las cuales pueden brindar diferentes tipos de información sobre la centralidad. Encontrar centralidades en biología se puede aplicar en muchas circunstancias diferentes, algunas de las cuales son la regulación de genes, la interacción de proteínas y las redes metabólicas. [31]

El aprendizaje supervisado es un tipo de algoritmo que aprende de datos etiquetados y aprende a asignar etiquetas a datos futuros que no están etiquetados. En biología, el aprendizaje supervisado puede ser útil cuando tenemos datos que sabemos cómo categorizar y nos gustaría categorizar más datos en esas categorías.

Un algoritmo de aprendizaje supervisado común es el bosque aleatorio , que utiliza numerosos árboles de decisión para entrenar un modelo para clasificar un conjunto de datos. Un árbol de decisión, que forma la base del bosque aleatorio, es una estructura que tiene como objetivo clasificar o etiquetar un conjunto de datos utilizando ciertas características conocidas de esos datos. Un ejemplo biológico práctico de esto sería tomar los datos genéticos de un individuo y predecir si ese individuo está o no predispuesto a desarrollar una determinada enfermedad o cáncer. En cada nodo interno, el algoritmo verifica el conjunto de datos en busca de exactamente una característica, un gen específico en el ejemplo anterior, y luego se bifurca hacia la izquierda o hacia la derecha según el resultado. Luego, en cada nodo hoja, el árbol de decisión asigna una etiqueta de clase al conjunto de datos. Entonces, en la práctica, el algoritmo recorre un camino específico de raíz a hoja basado en el conjunto de datos de entrada a través del árbol de decisión, lo que da como resultado la clasificación de ese conjunto de datos. Comúnmente, los árboles de decisión tienen variables objetivo que toman valores discretos, como sí/no, en cuyo caso se denomina árbol de clasificación , pero si la variable objetivo es continua, se denomina árbol de regresión . Para construir un árbol de decisión, primero se debe entrenar utilizando un conjunto de entrenamiento para identificar qué características son los mejores predictores de la variable objetivo.

El software de código abierto proporciona una plataforma para la biología computacional donde todos pueden acceder y beneficiarse del software desarrollado en la investigación. PLOS cita [ cita necesaria ] cuatro razones principales para el uso de software de código abierto:

Hay varias conferencias importantes que se ocupan de la biología computacional. Algunos ejemplos notables son Sistemas Inteligentes para Biología Molecular , Conferencia Europea sobre Biología Computacional e Investigación en Biología Molecular Computacional .

También existen numerosas revistas dedicadas a la biología computacional. Algunos ejemplos notables incluyen Journal of Computational Biology y PLOS Computational Biology , una revista de acceso abierto revisada por pares que tiene muchos proyectos de investigación notables en el campo de la biología computacional. Proporcionan reseñas de software , tutoriales para software de código abierto y muestran información sobre las próximas conferencias de biología computacional. [ cita necesaria ]

La biología computacional, la bioinformática y la biología matemática son enfoques interdisciplinarios de las ciencias biológicas que se basan en disciplinas cuantitativas como las matemáticas y las ciencias de la información . El NIH describe la biología computacional/matemática como el uso de enfoques computacionales/matemáticos para abordar cuestiones teóricas y experimentales en biología y, por el contrario, la bioinformática como la aplicación de la ciencia de la información para comprender datos complejos de las ciencias biológicas. [1]

Específicamente, el NIH define

Biología computacional: desarrollo y aplicación de métodos teóricos y analíticos de datos, modelado matemático y técnicas de simulación computacional para el estudio de sistemas biológicos, conductuales y sociales. [1]

Bioinformática: Investigación, desarrollo o aplicación de herramientas y enfoques computacionales para ampliar el uso de datos biológicos, médicos, conductuales o de salud, incluidos aquellos para adquirir, almacenar, organizar, archivar, analizar o visualizar dichos datos. [1]

Si bien cada campo es distinto, puede haber una superposición significativa en su interfaz, [1] hasta el punto de que, para muchos, bioinformática y biología computacional son términos que se usan indistintamente.

Los términos biología computacional y computación evolutiva tienen un nombre similar, pero no deben confundirse. A diferencia de la biología computacional, la computación evolutiva no se ocupa de modelar y analizar datos biológicos. En cambio, crea algoritmos basados en las ideas de evolución entre especies. A veces denominados algoritmos genéticos , la investigación de este campo se puede aplicar a la biología computacional. Si bien la computación evolutiva no es inherentemente parte de la biología computacional, la biología evolutiva computacional es un subcampo de la misma. [33]