En estadística , el estadístico de késimo orden de una muestra estadística es igual a su késimo valor más pequeño. [1] Junto con las estadísticas de rango , las estadísticas de orden se encuentran entre las herramientas más fundamentales en la inferencia y las estadísticas no paramétricas .

Casos especiales importantes de las estadísticas de orden son el valor mínimo y máximo de una muestra y (con algunas salvedades que se analizan más adelante) la mediana muestral y otros cuantiles muestrales .

Cuando se utiliza la teoría de la probabilidad para analizar estadísticas de orden de muestras aleatorias de una distribución continua , se utiliza la función de distribución acumulativa para reducir el análisis al caso de estadísticas de orden de la distribución uniforme .

Por ejemplo, supongamos que se observan o registran cuatro números, lo que da como resultado una muestra de tamaño 4. Si los valores de la muestra son

las estadísticas del pedido se indicarían

donde el subíndice ( i ) entre paréntesis indica el estadístico de iésimo orden de la muestra.

El estadístico de primer orden (o estadístico de orden más pequeño ) es siempre el mínimo de la muestra, es decir,

donde, siguiendo una convención común, utilizamos letras mayúsculas para referirnos a variables aleatorias y letras minúsculas (como arriba) para referirnos a sus valores reales observados.

De manera similar, para una muestra de tamaño n , el estadístico de orden n (o estadístico de orden mayor ) es el máximo , es decir,

El rango de muestra es la diferencia entre el máximo y el mínimo. Es función de las estadísticas del pedido:

Una estadística importante similar en el análisis de datos exploratorios que simplemente se relaciona con las estadísticas de orden es el rango intercuartílico de la muestra .

La mediana muestral puede ser o no un estadístico de orden, ya que solo hay un valor medio único cuando el número n de observaciones es impar . Más precisamente, si n = 2 m +1 para algún número entero m , entonces la mediana muestral es y también lo es un estadístico de orden. Por otro lado, cuando n es par , n = 2 m y hay dos valores medios, y , y la mediana muestral es alguna función de los dos (normalmente el promedio) y, por tanto, no es un estadístico de orden. Se aplican observaciones similares a todos los cuantiles muestrales.

Dadas cualquier variable aleatoria X 1 , X 2 ..., X n , las estadísticas de orden X (1) , X (2) , ..., X ( n ) también son variables aleatorias, definidas ordenando los valores ( realizaciones ) de X 1 , ..., X n en orden creciente.

Cuando las variables aleatorias X 1 , X 2 ..., X n forman una muestra , son independientes y están distribuidas idénticamente . Este es el caso que se trata a continuación. En general, las variables aleatorias X 1 , ..., X n pueden surgir mediante muestreo de más de una población. Entonces son independientes , pero no necesariamente están distribuidas de manera idéntica, y su distribución de probabilidad conjunta viene dada por el teorema de Bapat-Beg .

De ahora en adelante, asumiremos que las variables aleatorias consideradas son continuas y, cuando sea conveniente, también asumiremos que tienen una función de densidad de probabilidad (PDF), es decir, que son absolutamente continuas . Las peculiaridades del análisis de distribuciones que asignan masa a puntos (en particular, distribuciones discretas ) se discuten al final.

Para una muestra aleatoria como la anterior, con distribución acumulativa , las estadísticas de orden para esa muestra tienen distribuciones acumulativas de la siguiente manera [2] (donde r especifica qué estadística de orden):

la función de densidad de probabilidad correspondiente se puede derivar de este resultado, y se encuentra que es

Además, hay dos casos especiales en los que las CDF son fáciles de calcular.

Lo cual puede derivarse de una cuidadosa consideración de las probabilidades.

En esta sección mostramos que los estadísticos de orden de la distribución uniforme en el intervalo unitario tienen distribuciones marginales que pertenecen a la familia de distribuciones beta . También proporcionamos un método simple para derivar la distribución conjunta de cualquier número de estadísticas de orden y, finalmente, traducir estos resultados a distribuciones continuas arbitrarias utilizando la cdf .

A lo largo de esta sección asumimos que es una muestra aleatoria extraída de una distribución continua con CDF . Denotando obtenemos la muestra aleatoria correspondiente de la distribución uniforme estándar . Tenga en cuenta que las estadísticas de pedidos también satisfacen .

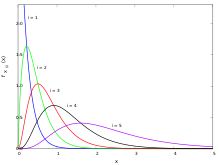

La función de densidad de probabilidad del estadístico de orden es igual a [3]

es decir, el estadístico de orden k de la distribución uniforme es una variable aleatoria con distribución beta . [3] [4]

La prueba de estas afirmaciones es la siguiente. Para estar entre u y u + du , es necesario que exactamente k − 1 elementos de la muestra sean menores que u , y que al menos uno esté entre u y u + d u . La probabilidad de que más de uno esté en este último intervalo ya es , por lo que tenemos que calcular la probabilidad de que exactamente k − 1, 1 y n − k observaciones caigan en los intervalos , y respectivamente. Esto es igual (consulte la distribución multinomial para obtener más detalles)

y el resultado sigue.

La media de esta distribución es k / ( n + 1).

De manera similar, para i < j , se puede demostrar que la función de densidad de probabilidad conjunta de las estadísticas de dos órdenes U ( i ) < U ( j ) es

que es (hasta términos de orden superior a ) la probabilidad de que i − 1 , 1, j − 1 − i , 1 y n − j elementos muestrales caigan en los intervalos , , , respectivamente.

Uno razona de manera completamente análoga para derivar las distribuciones conjuntas de orden superior. Quizás sea sorprendente que la densidad conjunta de las estadísticas de orden n resulte ser constante :

Una forma de entender esto es que la muestra desordenada tiene una densidad constante igual a 1 y que hay n ! diferentes permutaciones de la muestra correspondientes a la misma secuencia de estadísticas de orden. Esto está relacionado con el hecho de que 1/ n ! es el volumen de la región . También está relacionado con otra particularidad de las estadísticas de orden de variables aleatorias uniformes: de la desigualdad BRS se deduce que el número máximo esperado de variables aleatorias uniformes U(0,1] que se puede elegir de una muestra de tamaño n con una suma no exceder está acotado arriba por , que por lo tanto es invariante en el conjunto de todos con producto constante .

Utilizando las fórmulas anteriores, se puede derivar la distribución del rango de las estadísticas de orden, es decir, la distribución de , es decir, máximo menos mínimo. De manera más general, for , también tiene una distribución beta:

Para una muestra aleatoria de tamaño n de una distribución exponencial con parámetro λ , los estadísticos de orden X ( i ) para i = 1,2,3, ..., n cada uno tiene distribución

donde Z j son variables aleatorias exponenciales estándar iid (es decir, con parámetro de tasa 1). Este resultado fue publicado por primera vez por Alfréd Rényi . [5] [6]

La transformada de Laplace de las estadísticas de orden se puede muestrear a partir de una distribución de Erlang mediante un método de conteo de rutas [ se necesita aclaración ] . [7]

Si F X es absolutamente continuo , tiene una densidad tal que , y podemos usar las sustituciones

y

derivar las siguientes funciones de densidad de probabilidad para las estadísticas de orden de una muestra de tamaño n extraída de la distribución de X :

Una pregunta interesante es qué tan bien funcionan las estadísticas de orden como estimadores de los cuantiles de la distribución subyacente.

El caso más simple a considerar es qué tan bien la mediana muestral estima la mediana poblacional.

Como ejemplo, considere una muestra aleatoria de tamaño 6. En ese caso, la mediana muestral generalmente se define como el punto medio del intervalo delimitado por los estadísticos de tercer y cuarto orden. Sin embargo, sabemos por la discusión anterior que la probabilidad de que este intervalo realmente contenga la mediana poblacional es [ se necesita aclaración ]

Aunque la mediana muestral probablemente se encuentre entre las mejores estimaciones puntuales de la mediana poblacional independientes de la distribución, lo que este ejemplo ilustra es que no es particularmente buena en términos absolutos. En este caso particular, un mejor intervalo de confianza para la mediana es el delimitado por los estadísticos de segundo y quinto orden, que contiene la mediana poblacional con probabilidad

Con un tamaño de muestra tan pequeño, si se quiere al menos un 95% de confianza, se reduce a decir que la mediana está entre el mínimo y el máximo de las 6 observaciones con una probabilidad de 31/32 o aproximadamente el 97%. El tamaño 6 es, de hecho, el tamaño de muestra más pequeño, de modo que el intervalo determinado por el mínimo y el máximo sea al menos un intervalo de confianza del 95% para la mediana de la población.

Para la distribución uniforme, cuando n tiende a infinito, el p -ésimo cuantil de muestra tiene una distribución asintóticamente normal , ya que se aproxima por

Para una distribución general F con una densidad continua distinta de cero en F −1 ( p ), se aplica una normalidad asintótica similar:

donde f es la función de densidad y F −1 es la función cuantil asociada con F . Una de las primeras personas en mencionar y demostrar este resultado fue Frederick Mosteller en su artículo fundamental de 1946. [8] Investigaciones posteriores condujeron en la década de 1960 a la representación de Bahadur , que proporciona información sobre los límites de error. La convergencia a la distribución normal también se cumple en un sentido más fuerte, como la convergencia en entropía relativa o la divergencia KL . [9]

Se puede hacer una observación interesante en el caso en que la distribución es simétrica y la mediana poblacional es igual a la media poblacional. En este caso, la media muestral , según el teorema del límite central , también está distribuida asintóticamente normalmente, pero con varianza σ 2 /n en su lugar. Este análisis asintótico sugiere que la media supera a la mediana en casos de curtosis baja , y viceversa. Por ejemplo, la mediana logra mejores intervalos de confianza para la distribución de Laplace , mientras que la media funciona mejor para X que se distribuyen normalmente.

Se puede demostrar que

dónde

siendo Z i variables aleatorias exponenciales independientes distribuidas idénticamente con tasa 1. Dado que X / n e Y / n están distribuidos asintóticamente normalmente por el CLT, nuestros resultados se siguen mediante la aplicación del método delta .

Los momentos de la distribución del estadístico de primer orden se pueden utilizar para desarrollar un estimador de densidad no paramétrico. [10] Supongamos que queremos estimar la densidad en el punto . Considere las variables aleatorias , que son iid con función de distribución . En particular, .

El valor esperado del estadístico de primer orden dada una muestra de observaciones totales produce,

donde es la función cuantil asociada con la distribución , y . Esta ecuación, en combinación con una técnica de jackknifing, se convierte en la base del siguiente algoritmo de estimación de densidad:

Entrada: Una muestra de observaciones. Puntos de evaluación de densidad. Parámetro de sintonización (normalmente 1/3). Salida: densidad estimada en los puntos de evaluación.

1: Conjunto 2: Conjunto 3: Cree una matriz que contenga subconjuntos con observaciones cada uno. 4: Cree un vector para contener las evaluaciones de densidad. 5: para hacer 6: para hacer 7: encontrar la distancia más cercana al punto actual dentro del subconjunto 8: final para 9: Calcular el promedio del subconjunto de distancias a 10: Calcular la estimación de densidad en 11: final para 12: regresar

A diferencia de los parámetros de ajuste basados en ancho de banda/longitud para los enfoques basados en histograma y kernel , el parámetro de ajuste para el estimador de densidad basado en estadística de orden es el tamaño de los subconjuntos de muestra. Un estimador de este tipo es más robusto que los enfoques basados en histogramas y kernel; por ejemplo, densidades como la distribución de Cauchy (que carecen de momentos finitos) se pueden inferir sin la necesidad de modificaciones especializadas, como los anchos de banda basados en IQR . Esto se debe a que el primer momento de la estadística de orden siempre existe si el valor esperado de la distribución subyacente existe, pero lo contrario no es necesariamente cierto. [11]

Supongamos que son variables aleatorias iid de una distribución discreta con función de distribución acumulativa y función de masa de probabilidad . Para encontrar las probabilidades de las estadísticas de orden, primero se necesitan tres valores, a saber

La función de distribución acumulativa del estadístico de orden se puede calcular observando que

De manera similar, está dada por

Tenga en cuenta que la función de masa de probabilidad de es solo la diferencia de estos valores, es decir

El problema de calcular el k -ésimo elemento más pequeño (o más grande) de una lista se llama problema de selección y se resuelve mediante un algoritmo de selección. Aunque este problema es difícil para listas muy grandes, se han creado algoritmos de selección sofisticados que pueden resolverlo en un tiempo proporcional al número de elementos de la lista, incluso si la lista está totalmente desordenada. Si los datos se almacenan en ciertas estructuras de datos especializadas, este tiempo se puede reducir a O (log n ). En muchas aplicaciones se requieren todas las estadísticas de orden, en cuyo caso se puede utilizar un algoritmo de clasificación y el tiempo necesario es O ( n log n ).

como también conocida, la distribución beta es la distribución del

estadístico de orden

m de una muestra aleatoria de tamaño

n

de la distribución uniforme (en (0,1)).