El argumento del fin del mundo ( DA ), o catástrofe de Carter , es un argumento probabilístico que pretende predecir la población futura de la especie humana a partir de una estimación del número de humanos nacidos hasta la fecha. El argumento apocalíptico fue propuesto originalmente por el astrofísico Brandon Carter en 1983, [1] lo que dio lugar al nombre inicial de la catástrofe de Carter. El argumento fue posteriormente defendido por el filósofo John A. Leslie y desde entonces ha sido concebido de forma independiente por J. Richard Gott [2] y Holger Bech Nielsen . [3] Principios similares de escatología fueron propuestos anteriormente por Heinz von Foerster , entre otros. Anteriormente se dio una forma más general en el efecto Lindy , [4] que propone que para ciertos fenómenos, la esperanza de vida futura es proporcional (aunque no necesariamente igual) a la edad actual y se basa en una tasa de mortalidad decreciente con el tiempo.

La premisa del argumento es la siguiente: supongamos que el número total de seres humanos que existirán alguna vez es fijo. De ser así, la probabilidad de que una persona seleccionada al azar exista en un momento particular de la historia sería proporcional a la población total en ese momento. Ante esto, el argumento plantea que una persona viva hoy debería ajustar sus expectativas sobre el futuro de la raza humana porque su existencia proporciona información sobre el número total de humanos que vivirán alguna vez.

Si el número total de humanos que nacieron o nacerán alguna vez se denota por , entonces el principio copernicano sugiere que cualquier ser humano tiene la misma probabilidad (junto con los demás humanos) de encontrarse en cualquier posición de la población total, por lo que los humanos asumen que nuestra posición fraccionaria está distribuida uniformemente en el intervalo [0,1] antes de conocer nuestra posición absoluta.

se distribuye uniformemente en (0,1) incluso después de conocer la posición absoluta . Por ejemplo, hay un 95% de posibilidades de que esté en el intervalo (0,05,1), es decir . En otras palabras, se puede suponer con un 95% de certeza que cualquier ser humano estaría dentro del último 95% de todos los humanos que jamás hayan nacido. Si se conoce la posición absoluta , este argumento implica un límite superior de confianza del 95% que se obtiene reorganizando para dar .

Si se utiliza la cifra de Leslie [5] , entonces hasta ahora han nacido aproximadamente 60 mil millones de humanos, por lo que se puede estimar que hay un 95% de posibilidades de que el número total de humanos sea inferior a 20 60 mil millones = 1,2 billones. Suponiendo que la población mundial se estabilice en 10 mil millones y una esperanza de vida de 80 años , se puede estimar que los 1140 mil millones de humanos restantes nacerán en 9120 años. Dependiendo de la proyección de la población mundial en los próximos siglos, las estimaciones pueden variar, pero el argumento afirma que es poco probable que alguna vez vivan más de 1,2 billones de humanos.

Supongamos, por simplicidad, que el número total de humanos que nacerán algún día es 60 mil millones ( N 1 ), o 6 billones ( N 2 ). [6] Si no hay conocimiento previo de la posición que tiene un individuo actualmente vivo, X , en la historia de la humanidad, se puede calcular cuántos humanos nacieron antes de X y llegar a, digamos, 59.854.795.447, lo que necesariamente colocaría a X. entre los primeros 60 mil millones de seres humanos que jamás hayan existido.

Es posible sumar las probabilidades para cada valor de N y, por lo tanto, calcular un 'límite de confianza' estadístico en N. Por ejemplo, tomando los números anteriores, hay un 99% de certeza de que N es menor que 6 billones.

Tenga en cuenta que , como se señaló anteriormente, este argumento supone que la probabilidad a priori para N es plana, o 50% para N 1 y 50% para N 2 en ausencia de información sobre X. Por otro lado , es posible concluir, dado X , que N 2 es más probable que N 1 si se utiliza un prior diferente para N. Más precisamente, el teorema de Bayes nos dice que P( N | X ) = P( X | N )P( N )/P( X ), y la aplicación conservadora del principio copernicano sólo nos dice cómo calcular P( X | norte ). Tomando P( X ) como plano, todavía tenemos que asumir la probabilidad previa P( N ) de que el número total de humanos sea N. Si concluimos que N 2 es mucho más probable que N 1 (por ejemplo, porque producir una población más grande lleva más tiempo, lo que aumenta la posibilidad de que en ese tiempo ocurra un evento natural de baja probabilidad pero cataclísmico), entonces P( X | N ) puede volverse más ponderado hacia el valor mayor de N . A continuación, en la sección Refutaciones, se ofrece una discusión más detallada, así como las distribuciones relevantes P( N ).

El argumento apocalíptico no dice que la humanidad no pueda o no vaya a existir indefinidamente. No pone ningún límite superior al número de humanos que alguna vez existirán ni proporciona una fecha para cuando la humanidad se extinguirá . Una forma abreviada del argumento hace estas afirmaciones, al confundir probabilidad con certeza. Sin embargo, la conclusión real de la versión utilizada anteriormente es que hay un 95% de posibilidades de extinción dentro de 9.120 años y un 5% de posibilidades de que algunos humanos todavía estén vivos al final de ese período. (Las cifras exactas varían según los argumentos apocalípticos específicos).

Este argumento ha generado un debate filosófico y aún no ha surgido ningún consenso sobre su solución. Las variantes que se describen a continuación producen el DA mediante derivaciones separadas.

Gott propone específicamente la forma funcional para la distribución previa del número de personas que nacerán ( N ). El fiscal del distrito de Gott utilizó la vaga distribución previa :

dónde

Dado que Gott especifica la distribución previa del total de humanos, P(N) , el teorema de Bayes y el principio de indiferencia por sí solos nos dan P(N|n) , la probabilidad de que nazcan N humanos si n es un sorteo aleatorio de N :

Este es el teorema de Bayes para la probabilidad posterior de que la población total haya nacido alguna vez en N , condicionada a la población nacida hasta el momento en n . Ahora, usando el principio de indiferencia:

La distribución n incondicionada de la población actual es idéntica a la vaga función de densidad de probabilidad N anterior , [nota 1] entonces:

dando P ( N | n ) para cada N específico (mediante una sustitución en la ecuación de probabilidad posterior):

La forma más fácil de producir la estimación apocalíptica con una confianza dada (digamos 95%) es pretender que N es una variable continua (ya que es muy grande) e integrarla sobre la densidad de probabilidad de N = n a N = Z. (Esto dará una función para la probabilidad de que N ≤ Z ):

Definir Z = 20 n da:

Esta es la derivación bayesiana más simple del argumento apocalíptico:

El uso de una distribución previa vaga parece bien motivado ya que supone el menor conocimiento posible sobre N , dado que se debe elegir alguna función particular. Es equivalente a la suposición de que la densidad de probabilidad de la posición fraccionaria permanece uniformemente distribuida incluso después de conocer la posición absoluta ( n ).

La "clase de referencia" de Gott en su artículo original de 1993 no era el número de nacimientos, sino el número de años que los "humanos" habían existido como especie, que cifró en 200.000 . Además, Gott intentó dar un intervalo de confianza del 95% entre un tiempo de supervivencia mínimo y un máximo. Debido a la probabilidad del 2,5% que da de subestimar el mínimo, tiene sólo un 2,5% de probabilidad de sobreestimar el máximo. Esto equivale a un 97,5% de confianza en que la extinción ocurre antes del límite superior de su intervalo de confianza, que se puede usar en la integral anterior con Z = 40 n y n = 200.000 años:

Así es como Gott produce una confianza del 97,5% de extinción dentro de N ≤ 8.000.000 de años. El número que citó fue el tiempo restante probable, N − n = 7,8 millones de años. Esto era mucho más alto que el límite de confianza temporal producido al contar los nacimientos, porque aplicaba el principio de indiferencia al tiempo. (Producir diferentes estimaciones muestreando diferentes parámetros en la misma hipótesis es la paradoja de Bertrand .) De manera similar, hay un 97,5% de probabilidad de que el presente se encuentre en el primer 97,5% de la historia humana, por lo que hay un 97,5% de probabilidad de que la esperanza de vida total de la humanidad será al menos

En otras palabras, el argumento de Gott da un 95% de confianza en que los humanos se extinguirán entre 5.100 y 7,8 millones de años en el futuro.

Gott también ha probado esta formulación con el Muro de Berlín y obras de Broadway y fuera de Broadway. [7]

El argumento de Leslie difiere de la versión de Gott en que no asume una distribución de probabilidad previa vaga para N. En cambio, sostiene que la fuerza del argumento del fin del mundo reside puramente en la mayor probabilidad de un día del fin del mundo temprano una vez que se tiene en cuenta su posición de nacimiento, independientemente de su distribución de probabilidad previa para N. Él llama a esto el cambio de probabilidad .

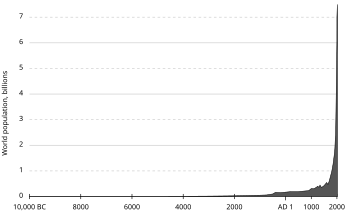

Heinz von Foerster argumentó que la capacidad de la humanidad para construir sociedades, civilizaciones y tecnologías no resulta en una autoinhibición. Más bien, el éxito de las sociedades varía directamente con el tamaño de la población. Von Foerster descubrió que este modelo se ajusta a unos 25 puntos de datos desde el nacimiento de Jesús hasta 1958, quedando sólo el 7% de la varianza sin explicar. Se publicaron varias cartas de seguimiento (1961, 1962,...) en Science que mostraban que la ecuación de von Foerster todavía estaba en camino. Los datos continuaron ajustándose hasta 1973. Lo más notable del modelo de von Foerster fue que predijo que la población humana alcanzaría el infinito o una singularidad matemática el viernes 13 de noviembre de 2026. De hecho, von Foerster no dio a entender que los La población mundial en ese día podría en realidad llegar a ser infinita. La verdadera implicación era que el patrón de crecimiento de la población mundial seguido durante muchos siglos antes de 1960 estaba a punto de llegar a su fin y transformarse en un patrón radicalmente diferente. Tenga en cuenta que esta predicción comenzó a cumplirse apenas unos años después de que se publicara el argumento del "fin del mundo". [nota 2]

La clase de referencia de la que se extrae n , y de la que N es el tamaño final, es un punto crucial de discordia en el argumento del fin del mundo. La hipótesis "estándar" del argumento apocalíptico se salta este punto por completo y se limita a afirmar que la clase de referencia es el número de "personas". Dado que eres humano, el principio copernicano podría usarse para determinar si naciste excepcionalmente temprano; sin embargo, el término "humano" ha sido muy cuestionado por razones prácticas y filosóficas . Según Nick Bostrom , la conciencia es (parte de) el discriminador entre lo que está dentro y fuera de la clase de referencia y, por lo tanto, la inteligencia extraterrestre podría tener un impacto significativo en el cálculo. [ cita necesaria ]

Las siguientes subsecciones se relacionan con diferentes clases de referencia sugeridas, a cada una de las cuales se le ha aplicado el argumento estándar del fin del mundo.

Nick Bostrom , considerando los efectos de selección de observación , ha elaborado un Supuesto de Automuestreo (SSA): "que debes pensar en ti mismo como si fueras un observador aleatorio de una clase de referencia adecuada". Si la "clase de referencia" es el conjunto de humanos que alguna vez nacerán, esto da N < 20 n con un 95% de confianza (el argumento estándar del fin del mundo). Sin embargo, ha perfeccionado esta idea para aplicarla a los momentos del observador en lugar de solo a los observadores. Él ha formalizado esto como: [8]

Una aplicación del principio subyacente a SSSA (aunque Bostrom no articula expresamente esta aplicación en ninguna parte) es: si el minuto en el que usted lee este artículo se selecciona aleatoriamente de cada minuto en la vida de cada ser humano, entonces (con un 95% de confianza) este evento ha ocurrido después del primer 5% de los momentos de observador humano. Si la esperanza de vida media en el futuro es el doble de la esperanza de vida media histórica, esto implica un 95% de confianza en que N < 10 n (el humano futuro promedio representará el doble de los momentos de observador del humano histórico promedio). Por lo tanto, la estimación del tiempo de extinción del percentil 95 en esta versión es de 4560 años.

Un contraargumento al argumento del fin del mundo está de acuerdo con sus métodos estadísticos pero no está de acuerdo con su estimación del tiempo de extinción. Esta posición requiere justificar por qué no se puede suponer que el observador sea seleccionado aleatoriamente del conjunto de todos los humanos que alguna vez nacerán, lo que implica que este conjunto no es una clase de referencia apropiada. Al no estar de acuerdo con el argumento apocalíptico, implica que el observador se encuentra dentro del primer 5% de los humanos que nacen.

Por analogía, si uno es miembro de 50.000 personas en un proyecto colaborativo, el razonamiento del argumento apocalíptico implica que nunca habrá más de un millón de miembros en ese proyecto, dentro de un intervalo de confianza del 95%. Sin embargo, si las características de uno son típicas de un usuario pionero , en lugar de las típicas de un miembro promedio durante la vida útil del proyecto, entonces puede no ser razonable suponer que uno se ha unido al proyecto en un momento aleatorio de su vida. Por ejemplo, la mayoría de los usuarios potenciales preferirán participar cuando el proyecto esté casi terminado. Sin embargo, si uno disfrutara de lo incompleto del proyecto, ya se sabría que es inusual, antes de descubrir su participación temprana.

Si uno tiene atributos mensurables que lo diferencian del usuario típico a largo plazo, el argumento apocalíptico del proyecto puede refutar basándose en el hecho de que uno podría esperar estar dentro del primer 5% de miembros, a priori . La analogía con la forma del argumento de población humana total es que la confianza en una predicción de la distribución de las características humanas que coloca a los humanos modernos e históricos fuera de la corriente principal implica que ya se sabe, antes de examinar n , que es probable que ser muy temprano en N . Este es un argumento para cambiar la clase de referencia.

Por ejemplo, si uno está seguro de que el 99% de los humanos que alguna vez vivirán serán cyborgs , pero que sólo una fracción insignificante de los humanos que han nacido hasta la fecha son cyborgs, uno podría estar igualmente seguro de que al menos cien veces más la gente queda por nacer como ha sido.

El artículo de Robin Hanson resume estas críticas al argumento apocalíptico: [9]

Todo lo demás no es igual; Tenemos buenas razones para pensar que no somos humanos seleccionados al azar entre todos los que vivirán.

La observación a posteriori de que los eventos de nivel de extinción son raros podría ofrecerse como evidencia de que las predicciones del argumento apocalíptico son inverosímiles; Por lo general, las extinciones de especies dominantes ocurren con menos frecuencia que una vez cada millón de años. Por lo tanto, se argumenta que la extinción humana es poco probable dentro de los próximos diez milenios. (Otro argumento probabilístico , que llega a una conclusión diferente a la del argumento apocalíptico).

En términos bayesianos, esta respuesta al argumento apocalíptico dice que nuestro conocimiento de la historia (o nuestra capacidad para prevenir desastres) produce un marginal previo para N con un valor mínimo de billones. Si N se distribuye uniformemente de 10 12 a 10 13 , por ejemplo, entonces la probabilidad de que N < 1200 mil millones se infiera a partir de n = 60 mil millones será extremadamente pequeña. Se trata de un cálculo bayesiano igualmente impecable, que rechaza el principio copernicano porque debemos ser "observadores especiales", ya que no existe ningún mecanismo probable para que la humanidad se extinga en los próximos cien mil años.

Se acusa a esta respuesta de pasar por alto las amenazas tecnológicas a la supervivencia de la humanidad , a las que la vida anterior no estuvo sujeta, y es específicamente rechazada por la mayoría [ ¿por quién? – Discutir ] los críticos académicos del argumento apocalíptico (posiblemente con excepción de Robin Hanson ).

Robin Hanson sostiene que el anterior de N puede distribuirse exponencialmente : [9]

Aquí, cyq son constantes . Si q es grande, entonces nuestro límite superior de confianza del 95% está en el sorteo uniforme, no en el valor exponencial de N.

La forma más sencilla de comparar esto con el argumento bayesiano de Gott es aplanar la distribución a partir del vago anterior haciendo que la probabilidad disminuya más lentamente con N (que proporcionalmente a la inversa). Esto corresponde a la idea de que el crecimiento de la humanidad puede ser exponencial en el tiempo y que el fin del mundo tiene una función de densidad de probabilidad previa vaga en el tiempo . Esto significaría que N , el último nacimiento, tendría una distribución similar a la siguiente:

Esta distribución N previa es todo lo que se requiere (con el principio de indiferencia) para producir la inferencia de N a partir de n , y esto se hace de manera idéntica al caso estándar, como lo describe Gott (equivalente a = 1 en esta distribución ):

Sustituyendo en la ecuación de probabilidad posterior):

Integrando la probabilidad de cualquier N por encima de xn :

Por ejemplo, si x = 20 y = 0,5, esto se convierte en:

Por lo tanto, con esto previo, la probabilidad de que ocurra un billón de nacimientos es muy superior al 20%, en lugar del 5% que da el DA estándar. Si se reduce aún más asumiendo una distribución previa de N más plana , entonces los límites de N dados por n se vuelven más débiles. Un valor de uno reproduce el cálculo de Gott con una clase de referencia de nacimiento, y alrededor de 0,5 podría aproximarse a su cálculo de intervalo de confianza temporal (si la población se expandiera exponencialmente). A medida que (se hace más pequeño) n se vuelve cada vez menos informativo sobre N . En el límite, esta distribución se acerca a una distribución uniforme (ilimitada) , donde todos los valores de N son igualmente probables. Este es el "Supuesto 3" de Page et al., que encuentran pocas razones para rechazar, a priori . (Aunque todas las distribuciones con antecedentes inadecuados, esto también se aplica a la distribución a priori vaga de Gott, y todas pueden convertirse para producir integrales adecuadas postulando un límite de población superior finito). Dado que la probabilidad de alcanzar una población de tamaño 2 N es generalmente considerado como la posibilidad de alcanzar N multiplicada por la probabilidad de supervivencia de N a 2 N, se deduce que Pr( N ) debe ser una función monótonamente decreciente de N , pero esto no necesariamente requiere una proporcionalidad inversa. [9]

Otra objeción al argumento apocalíptico es que la población humana total esperada es en realidad infinita . [10] El cálculo es el siguiente:

Para ver un ejemplo similar de expectativas infinitas contraintuitivas, consulte la paradoja de San Petersburgo .

Una objeción es que la posibilidad de que un ser humano exista depende de cuántos humanos existirán alguna vez ( N ). Si este es un número alto, entonces la posibilidad de que existan es mayor que si solo existieran unos pocos humanos. Dado que efectivamente existen, esto es evidencia de que la cantidad de humanos que alguna vez existirán es alta. [11]

Esta objeción, originalmente propuesta por Dennis Dieks (1992), [12] ahora se conoce con el nombre que le dio Nick Bostrom : la " objeción del supuesto de autoindicación ". Se puede demostrar que algunas SIA impiden cualquier inferencia de N a partir de n (la población actual). [13]

El argumento bayesiano de Carlton M. Caves afirma que el supuesto de distribución uniforme es incompatible con el principio copernicano , no una consecuencia del mismo. [14]

Caves da una serie de ejemplos para argumentar que la regla de Gott es inverosímil. Por ejemplo, dice, imagina que te topas con una fiesta de cumpleaños de la que no sabes nada:

Su pregunta amistosa sobre la edad del celebrante provoca la respuesta de que está celebrando su ( t p =) 50 cumpleaños. Según Gott, se puede predecir con un 95% de confianza que la mujer sobrevivirá entre [50]/39 = 1,28 años y 39[×50] = 1.950 años en el futuro. Dado que el amplio rango abarca expectativas razonables con respecto a la supervivencia de la mujer, puede que no parezca tan malo, hasta que uno se da cuenta de que [la regla de Gott] predice que con una probabilidad de 1/2 la mujer sobrevivirá más allá de los 100 años y con una probabilidad de 1/3 más allá de los 150. Pocos de nosotros querríamos apostar a la supervivencia de la mujer utilizando la regla de Gott. (Consulte el artículo en línea de Caves a continuación).

Aunque este ejemplo expone una debilidad en el DA del "método Copernicus" de J. Richard Gott (que no especifica cuándo se puede aplicar el "método Copernicus") no es precisamente análogo al DA moderno [ aclaración necesaria ] ; Los refinamientos epistemológicos del argumento de Gott por parte de filósofos como Nick Bostrom especifican que:

Las variantes cuidadosas de DA especificadas con esta regla no se muestran inverosímiles en el ejemplo anterior de la "Vieja Dama" de Caves, porque la edad de la mujer se da antes de la estimación de su esperanza de vida. Dado que la edad humana proporciona una estimación del tiempo de supervivencia (a través de tablas actuariales ), la estimación de la edad de la fiesta de cumpleaños de Caves no podría caer en la clase de problemas DA definidos con esta condición.

Para producir un "ejemplo de fiesta de cumpleaños" comparable del DA bayesiano cuidadosamente especificado, necesitaríamos excluir por completo todo conocimiento previo sobre la probable duración de la vida humana; en principio esto podría hacerse (p. ej.: hipotética cámara de amnesia). Sin embargo, esto eliminaría el ejemplo modificado de la experiencia cotidiana. Para mantenerlo en el ámbito cotidiano, la edad de la dama debe ocultarse antes de realizar la estimación de supervivencia. (Aunque este ya no es exactamente el DA, es mucho más comparable a él).

Sin conocer la edad de la dama, el razonamiento DA produce una regla para convertir el cumpleaños ( n ) en una esperanza de vida máxima con un 50% de confianza ( N ). La regla del método Copérnico de Gott es simplemente: Prob ( N < 2 n ) = 50%. ¿Qué tan precisa resultaría esta estimación? La demografía occidental es ahora bastante uniforme en todas las edades, por lo que un cumpleaños aleatorio ( n ) podría aproximarse (muy aproximadamente) mediante un sorteo U(0, M ] donde M es la esperanza de vida máxima en el censo. En este modelo "plano", todos comparte la misma vida útil, por lo que N = M . Si n resulta ser menor que ( M )/2, entonces la estimación 2 n de Gott de N estará por debajo de M , su cifra real, la otra mitad del tiempo 2 n subestima M , y en. En este caso (el que Caves destaca en su ejemplo) el sujeto morirá antes de que se alcance la estimación de 2 n . En este modelo de "demografía plana", la cifra de confianza del 50% de Gott resulta correcta el 50% de las veces.

Algunos filósofos han sugerido que sólo las personas que han contemplado el argumento apocalíptico (DA) pertenecen a la clase de referencia " humanos ". Si esa es la clase de referencia apropiada, Carter desafió su propia predicción cuando describió por primera vez el argumento (a la Royal Society ). Un asistente podría haber argumentado así:

Actualmente, sólo una persona en el mundo entiende el argumento del Juicio Final, por lo que según su propia lógica hay un 95% de posibilidades de que sea un problema menor que sólo interesará a veinte personas, y debería ignorarlo.

Jeff Dewynne y el profesor Peter Landsberg sugirieron que esta línea de razonamiento creará una paradoja para el argumento apocalíptico: [10]

Si un miembro de la Royal Society hiciera tal comentario, indicaría que entendió el DA lo suficientemente bien como para que de hecho se pudiera considerar que 2 personas lo entendieron y, por lo tanto, habría un 5% de posibilidades de que 40 o más personas lo hicieran. realmente estar interesado. Además, por supuesto, ignorar algo porque sólo se espera que un pequeño número de personas esté interesado en ello es extremadamente miope: si se adoptara este enfoque, nunca se exploraría nada nuevo, si asumimos que no hay ningún conocimiento a priori del tema. naturaleza del interés y mecanismos de atención.

Varios autores han argumentado que el argumento apocalíptico se basa en una combinación incorrecta de duración futura con duración total. Esto ocurre en la especificación de los dos períodos de tiempo como "destino pronto" y "destino diferido", lo que significa que ambos períodos se seleccionan para que ocurran después del valor observado del orden de nacimiento. Una refutación en Pisaturo (2009) [15] sostiene que el argumento apocalíptico se basa en el equivalente de esta ecuación:

Pisaturo luego observa:

Pisaturo toma ejemplos numéricos basados en dos posibles correcciones a esta ecuación: considerando solo duraciones futuras y considerando solo duraciones totales. En ambos casos, concluye que la afirmación del argumento apocalíptico de que hay un "giro bayesiano" a favor de una duración futura más corta es falaz.

Este argumento también se repite en O'Neill (2014). [16] En este trabajo, O'Neill sostiene que un "cambio bayesiano" unidireccional es imposible dentro de la formulación estándar de la teoría de la probabilidad y es contradictorio con las reglas de la probabilidad. Al igual que Pisaturo, sostiene que el argumento del fin del mundo combina la duración futura con la duración total mediante la especificación de los tiempos del fin del mundo que ocurren después del orden de nacimiento observado. Según O'Neill:

Gelman y Robert [17] afirman que el argumento apocalíptico confunde los intervalos de confianza frecuentistas con los intervalos de credibilidad bayesianos . Supongamos que cada individuo conoce su número n y lo usa para estimar un límite superior en N. Cada individuo tiene una estimación diferente, y estas estimaciones se construyen de modo que el 95% de ellas contengan el valor verdadero de N y el otro 5% no. Esto, dicen Gelman y Robert, es la propiedad definitoria de un intervalo de confianza del 95% de cola inferior frecuentista. Pero, dicen, "esto no significa que haya un 95% de posibilidades de que cualquier intervalo en particular contenga el valor verdadero". Es decir, si bien el 95% de los intervalos de confianza contendrán el valor verdadero de N , esto no es lo mismo que N esté contenido en el intervalo de confianza con una probabilidad del 95%. Esta última es una propiedad diferente y es la característica definitoria de un intervalo de credibilidad bayesiano. Gelman y Robert concluyen:

El argumento del Juicio Final es el triunfo final de la idea, muy querida entre los educadores bayesianos, de que nuestros estudiantes y clientes no entienden realmente los intervalos de confianza de Neyman-Pearson e inevitablemente les dan la interpretación bayesiana intuitiva.