La teoría del proceso dual dentro de la psicología moral es una teoría influyente del juicio moral humano que postula que los seres humanos poseen dos subsistemas cognitivos distintos que compiten en los procesos de razonamiento moral : uno rápido, intuitivo e impulsado emocionalmente , el otro lento, que requiere deliberación consciente y una mayor carga cognitiva . Inicialmente propuesta por Joshua Greene junto con Brian Sommerville, Leigh Nystrom, John Darley , Jonathan David Cohen y otros, [1] [2] [3] la teoría puede verse como un ejemplo específico de dominio de las explicaciones más generales del proceso dual en psicología , como la distinción "sistema 1" / "sistema 2" de Daniel Kahneman popularizada en su libro, Pensar rápido, pensar despacio . Greene a menudo ha enfatizado las implicaciones normativas de la teoría, [4] [5] [6] lo que ha iniciado un extenso debate en ética . [7] [8] [9] [10]

La teoría del proceso dual ha tenido una influencia significativa en la investigación en psicología moral . La investigación fMRI original [1] que propone la teoría del proceso dual ha sido citada en más de 2000 artículos académicos, lo que ha generado un uso extensivo de una metodología similar, así como críticas.

La teoría del doble proceso del juicio moral afirma que las decisiones morales son el producto de uno de dos procesos mentales distintos.

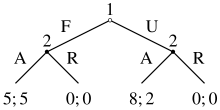

Siguiendo experimentos neurocientíficos en los que los sujetos fueron confrontados a dilemas éticos siguiendo la lógica del famoso caso del carrito de Philippa Foot (ver Figura 1), Joshua Greene afirma que ambos procesos pueden vincularse a dos clases de teorías éticas respectivamente. [6]

Lo llama el problema de la tensión central: los juicios morales que pueden caracterizarse como deontológicos se sustentan preferentemente en procesos e intuiciones automático-emocionales, mientras que los juicios típicamente utilitaristas parecen sustentarse en procesos controlados por la conciencia y en el razonamiento deliberativo. [6]

Como ilustración de su teoría del razonamiento moral basado en el doble proceso, Greene compara el doble proceso en el cerebro humano con una cámara SLR digital que funciona en dos modos complementarios: automático y manual. [6] Un fotógrafo puede emplear el modo automático de "apuntar y disparar", que es rápido y muy eficiente, o ajustar y refinar los ajustes en el modo manual, que le da al fotógrafo una mayor flexibilidad.

El razonamiento moral de doble proceso es una respuesta eficaz a un equilibrio similar entre eficiencia y flexibilidad . A menudo nos basamos en nuestras "configuraciones automáticas" y permitimos que las intuiciones guíen nuestro comportamiento y nuestro juicio. En el "modo manual", los juicios se basan tanto en el conocimiento general sobre "cómo funciona el mundo" como en la comprensión explícita de las características especiales de cada situación. El funcionamiento de este sistema de "modo manual" requiere una deliberación consciente y esforzada. [6]

Greene admite que su analogía tiene una fuerza limitada. Si bien un fotógrafo puede alternar entre el modo automático y el manual, los procesos automático-intuitivos del razonamiento humano siempre están activos: las deliberaciones conscientes deben "anular" nuestras intuiciones. Además de eso, las configuraciones automáticas de nuestro cerebro no están necesariamente "programadas", sino que pueden modificarse mediante el aprendizaje (cultural). [6]

No hay acuerdo sobre si ambos procesos interactúan entre sí y de qué manera. [12] [13] [14] [15] No está claro si los que responden deontológicamente, por ejemplo, confían ciegamente en la respuesta intuitiva sin pensar en consideraciones utilitarias o si reconocen la respuesta utilitaria alternativa pero, después de considerarla, deciden no hacerlo. Estas interpretaciones alternativas apuntan a diferentes modelos de interacción: un modelo serial (o "intervencionista por defecto") y un modelo paralelo. [16]

Los modelos seriales suponen que inicialmente se hace hincapié exclusivamente en el sistema intuitivo para emitir juicios, pero que este procesamiento predeterminado puede ir seguido de un procesamiento deliberativo en una etapa posterior. El modelo de Greene et al. suele incluirse en esta categoría. [14] [15] Por el contrario, en un modelo paralelo se supone que ambos procesos se llevan a cabo simultáneamente desde el principio. [16]

Los modelos de la primera categoría respaldan la idea de que los seres humanos, en un esfuerzo por minimizar el esfuerzo cognitivo, optarán por abstenerse del sistema deliberativo más exigente siempre que sea posible. Sólo los que responden utilitaristas habrán optado por ello. Esto implica además que los que responden deontológicamente no experimentarán ningún conflicto a causa de la "atracción utilitarista" del dilema: no han participado en el procesamiento que da lugar a estas consideraciones en primer lugar. Por el contrario, en un modelo paralelo, tanto los que responden utilitaristas como los deontológicos habrán puesto en marcha ambos sistemas de procesamiento. Los que responden deontológicamente reconocen que se enfrentan a respuestas conflictivas, pero no participan en el procesamiento deliberativo en una medida suficiente como para permitirles anular la respuesta intuitiva (deontológica). [16]

En el marco de la investigación genérica sobre procesos duales , algunos científicos han sostenido que los modelos seriales y paralelos no logran captar la verdadera naturaleza de la interacción entre sistemas de procesos duales. [17] [18] Sostienen que algunas operaciones que comúnmente se dice que pertenecen al sistema deliberativo también pueden, de hecho, ser guiadas por el sistema intuitivo, [19] y que debemos pensar en modelos híbridos a la luz de esta evidencia. [15] Los modelos híbridos respaldarían la noción de una "intuición utilitaria": una respuesta utilitaria guiada por el sistema cognitivo automático, "impulsado por la emoción". [15]

Greene utiliza fMRI para evaluar las actividades y respuestas cerebrales de personas enfrentadas a diferentes variantes del famoso problema del tranvía en ética.

Existen dos versiones del problema del tranvía: el dilema del conductor del tranvía y el dilema del puente peatonal, que se presentan a continuación.

El caso del interruptor "Estás al volante de un tranvía desbocado que se acerca rápidamente a una bifurcación de las vías. En las vías que se extienden hacia la izquierda hay un grupo de cinco trabajadores del ferrocarril. En las vías que se extienden hacia la derecha hay un solo trabajador del ferrocarril. Si no haces nada, el tranvía avanzará hacia la izquierda, causando la muerte de los cinco trabajadores. La única forma de evitar la muerte de estos trabajadores es pulsar un interruptor en tu tablero de mandos que hará que el tranvía avance hacia la derecha, causando la muerte del único trabajador. ¿Es apropiado que pulses el interruptor para evitar la muerte de los cinco trabajadores? [9] (La mayoría de la gente considera que es apropiado pulsar el interruptor en este caso).

El caso de la pasarela: "Un tranvía desbocado se dirige por las vías hacia cinco trabajadores que morirán si el tranvía continúa su curso actual. Usted se encuentra en una pasarela sobre las vías, entre el tranvía que se acerca y los cinco trabajadores. Junto a usted en esta pasarela hay un extraño que resulta ser muy grande. La única forma de salvar las vidas de los cinco trabajadores es empujar a este extraño desde el puente hacia las vías de abajo, donde su gran cuerpo detendrá el tranvía. El extraño morirá si usted hace esto, pero los cinco trabajadores se salvarán. ¿Es apropiado que usted empuje al extraño hacia las vías para salvar a los cinco trabajadores? [9] (La mayoría de la gente considera que no es apropiado empujar al extraño hacia las vías).

Greene [21] y sus colegas llevaron a cabo experimentos de fMRI para investigar qué regiones del cerebro se activaban en los sujetos al responder a "dilemas personales", como el dilema del puente peatonal, y "dilemas impersonales", como el dilema del interruptor. Los "dilemas personales" se definieron como cualquier condición que satisficiera tres condiciones: a) Se podría esperar razonablemente que la acción en cuestión condujera a un daño corporal, b) El daño se inflige a personas particulares o miembros de un grupo particular y c) El daño no es el resultado de desviar una amenaza previamente existente hacia otra parte. Todos los demás dilemas se clasificaron como "impersonales". Se observó que al responder a dilemas personales, los sujetos mostraron una mayor actividad en regiones del cerebro asociadas con la emoción (la corteza prefrontal medial , la corteza cingulada posterior / precuneo , el surco temporal superior posterior / lóbulo parietal inferior y la amígdala ), mientras que cuando respondieron a dilemas impersonales, mostraron una mayor actividad en regiones del cerebro asociadas con la memoria de trabajo (la corteza prefrontal dorsolateral y el lóbulo parietal ). En un trabajo reciente, Greene ha afirmado que la amígdala es principalmente responsable de la respuesta emocional, mientras que la corteza prefrontal ventromedial es responsable de sopesar la respuesta consecuencialista frente a la respuesta emocional. Por lo tanto, tres regiones cerebrales están principalmente implicadas en la realización de juicios morales. [20] Esto da lugar a lo que Greene [6] llama el Principio de Tensión Central : "Los juicios característicamente deontológicos están preferentemente respaldados por respuestas emocionales automáticas, mientras que los juicios característicamente consecuencialistas están preferentemente respaldados por el razonamiento consciente y procesos aliados de control cognitivo".

Greene señala un amplio conjunto de evidencias provenientes de la ciencia cognitiva que sugieren que la inclinación hacia el juicio deontológico o consecuencialista depende de si en el proceso de toma de decisiones se han implicado reacciones emocionales-intuitivas o más calculadas. [6] Por ejemplo, fomentar la deliberación o eliminar la presión del tiempo conduce a un aumento de la respuesta consecuencialista. Estar bajo una carga cognitiva mientras se hace un juicio moral disminuye las respuestas consecuencialistas. [22] Por el contrario, resolver un problema matemático difícil antes de hacer un juicio moral (destinado a hacer que los participantes sean más escépticos respecto de sus intuiciones) aumenta el número de respuestas consecuencialistas. Cuando se les pidió que explicaran o justificaran sus respuestas, los sujetos eligieron preferentemente principios consecuencialistas, incluso para explicar respuestas característicamente deontológicas. Otras evidencias muestran que las respuestas consecuencialistas a dilemas similares al problema del tranvía están asociadas con déficits en la conciencia emocional en personas con alexitimia o tendencias psicopáticas. [22] Por otra parte, los sujetos que están preparados para ser más emocionales o empáticos dan respuestas más característicamente deontológicas.

Además, los resultados de Greene muestran que algunas áreas cerebrales, como la corteza prefrontal medial, el cíngulo posterior/precúneo, el surco temporal posterior superior/lóbulo parietal inferior y la amígdala, están asociadas con procesos emocionales. Los sujetos mostraron una mayor actividad en estas regiones cerebrales cuando se les presentaron situaciones que implicaban el uso de la fuerza personal (por ejemplo, el caso del "puente peatonal"). La corteza prefrontal dorsolateral y el lóbulo parietal son regiones cerebrales "cognitivas"; los sujetos mostraron una mayor actividad en estas dos regiones cuando se les presentaron dilemas morales impersonales. [6]

Los argumentos a favor de la teoría del proceso dual basados en datos de neuroimagen han sido criticados por su dependencia de la inferencia inversa . [23] [24]

La evidencia neuropsicológica de estudios de lesiones centrados en pacientes con daño en la corteza prefrontal ventromedial también apunta a una posible disociación entre los procesos de decisión emocionales y racionales. El daño en esta área se asocia típicamente con rasgos de personalidad antisocial y deterioro de la toma de decisiones morales. [25] Los pacientes con estas lesiones tienden a mostrar una adhesión más frecuente a la vía "utilitaria" en los dilemas del problema del tranvía. [26] Greene et al. afirman que esto demuestra que cuando la información emocional se elimina a través del contexto o el daño a las regiones cerebrales necesarias para presentar dicha información, el proceso asociado con el razonamiento racional y controlado domina la toma de decisiones. [27]

Un caso médico popular, estudiado en particular por el neurocientífico Antonio Damasio , [28] fue el del trabajador ferroviario estadounidense Phineas Gage . El 13 de septiembre de 1848, mientras trabajaba en una vía férrea en Vermont , se vio involucrado en un accidente: una "barra de hierro utilizada para introducir la pólvora explosiva en la mejilla de Gage, atravesó la parte frontal de su cerebro y salió por la parte superior de su cabeza". [29] Sorprendentemente, no solo sobrevivió Gage, sino que también volvió a su vida normal en menos de dos meses. [28] Sin embargo, aunque sus capacidades físicas fueron restauradas, su personalidad y su carácter cambiaron radicalmente. Se volvió vulgar y antisocial: "Donde antes había sido responsable y autocontrolado, ahora era impulsivo, caprichoso y poco confiable". [29] Damasio escribió: "Gage ya no era Gage". [28] Además, también sus intuiciones morales se transformaron. Estudios posteriores mediante neuroimagen mostraron una correlación entre dichas transformaciones "morales" y de carácter y lesiones en la corteza prefrontal ventromedial. [30]

En su libro El error de Descartes , al comentar el caso de Phineas Gage, Damasio dijo que después del accidente el trabajador del ferrocarril fue capaz de "saber, pero no de sentir". [28] Como explicó David Edmonds , Joshua Greene pensó que esto podría explicar la diferencia en las intuiciones morales en diferentes versiones del problema del tranvía: "Sentimos que no deberíamos empujar al hombre gordo. Pero pensamos que es mejor salvar cinco vidas en lugar de una. Y el sentimiento y el pensamiento son distintos". [29]

Otra prueba fundamental que apoya la teoría del proceso dual proviene de los datos sobre el tiempo de reacción asociados a los experimentos de dilemas morales. Los sujetos que eligieron el camino "utilitario" en dilemas morales mostraron tiempos de reacción mayores bajo una carga cognitiva alta en dilemas "personales", mientras que los que eligieron el camino "deontológico" no se vieron afectados. [31] Se ha descubierto que la carga cognitiva, en general, también aumenta la probabilidad de un juicio "deontológico" [32] . Estos hallazgos de laboratorio se complementan con trabajos que analizan los procesos de toma de decisiones de altruistas del mundo real en situaciones de vida o muerte [33] . Estos héroes describieron abrumadoramente sus acciones como rápidas, intuitivas y prácticamente nunca tan cuidadosamente razonadas.

A la teoría del proceso dual se le suele dar una justificación evolutiva (en este sentido básico, la teoría es un ejemplo de psicología evolutiva ).

En el pensamiento predarwinista , como en el Tratado de la naturaleza humana de Hume , encontramos especulaciones sobre los orígenes de la moralidad , que se derivan de fenómenos naturales comunes a todos los seres humanos. Por ejemplo, menciona la "causa común o natural de nuestras pasiones" y la generación del amor por los demás representada por el autosacrificio en pos del bien mayor del grupo. La obra de Hume se cita a veces como inspiración para las teorías contemporáneas del proceso dual. [8]

La teoría evolutiva de Darwin ofrece un mejor proceso descriptivo de cómo se derivan estas normas morales de los procesos evolutivos y la selección natural. [8] Por ejemplo, las presiones selectivas favorecen el autosacrificio en beneficio del grupo y castigan a quienes no lo hacen. Esto proporciona una mejor explicación de la relación costo-beneficio de la generación de amor hacia los demás, como lo mencionó originalmente Hume .

Otro ejemplo de una norma derivada de la evolución es la justicia , que nace de la capacidad de detectar a quienes hacen trampas. Peter Singer explica la justicia desde la perspectiva evolutiva al afirmar que el instinto de reciprocidad mejoraba la aptitud para la supervivencia, por lo que quienes no correspondían eran considerados tramposos y excluidos del grupo. [8]

Peter Singer está de acuerdo con Greene en que los juicios consecuencialistas deben ser favorecidos por sobre los juicios deontológicos . Según él, el constructivismo moral busca fundamentos razonables mientras que los juicios deontológicos se basan en respuestas apresuradas y emocionales. [8] [ verificación fallida ] Singer sostiene que nuestras intuiciones morales más inmediatas deben ser cuestionadas. Una ética normativa no debe evaluarse en la medida en que coincida con esas intuiciones morales. Pone el ejemplo de un hermano y una hermana que deciden en secreto tener relaciones sexuales entre sí utilizando anticonceptivos . Nuestra primera reacción intuitiva es una firme condena del incesto como moralmente incorrecto. Sin embargo, un juicio consecuencialista trae otra conclusión. Como el hermano y la hermana no se lo dijeron a nadie y utilizaron anticonceptivos, el incesto no tuvo ninguna consecuencia dañina. Por lo tanto, en ese caso, el incesto no es necesariamente incorrecto. [8]

Singer se apoya en teorías evolutivas para justificar su afirmación. Durante la mayor parte de nuestra historia evolutiva, los seres humanos han vivido en pequeños grupos en los que la violencia era omnipresente. Los juicios deontológicos vinculados a respuestas emocionales e intuitivas fueron desarrollados por los seres humanos al enfrentarse a interacciones personales y cercanas con otros. En el siglo pasado, nuestras organizaciones sociales se alteraron y, por lo tanto, este tipo de interacciones se han vuelto menos frecuentes. Por lo tanto, Singer sostiene que deberíamos confiar en juicios consecuencialistas más sofisticados que se adapten mejor a nuestros tiempos modernos que los juicios deontológicos que fueron útiles para interacciones más rudimentarias. [8]

Se han formulado varias críticas científicas contra la teoría del proceso dual. Una de ellas afirma que el modelo dual emocional/racional ignora el aspecto motivacional de la toma de decisiones en contextos sociales humanos. [34] [35] Un ejemplo más específico de esta crítica se centra en los datos sobre la lesión de la corteza prefrontal ventromedial. Aunque los pacientes con este daño muestran un comportamiento característicamente "de sangre fría" en el problema del tranvía, muestran una mayor probabilidad de respaldar las opciones cargadas de emotividad en el Juego del Ultimátum . [36] Se sostiene que las decisiones morales se entienden mejor como la integración de información emocional, racional y motivacional, la última de las cuales se ha demostrado que involucra áreas del cerebro en el sistema límbico y el tronco encefálico . [37]

Otras críticas se centran en la metodología de uso de dilemas morales como el problema del tranvía. Estas críticas señalan la falta de realismo afectivo en los dilemas morales artificiales y su tendencia a utilizar las acciones de extraños para ofrecer una visión de los sentimientos morales humanos. Paul Bloom , en particular, ha argumentado que una multitud de actitudes hacia los agentes involucrados es importante para evaluar la postura moral de un individuo, así como para evaluar las motivaciones que pueden informar esas decisiones. [38] Kahane y Shackel examinan las preguntas y los dilemas que utilizan Greene et al., y afirman que la metodología utilizada en el estudio neurocientífico de las intuiciones debe mejorarse. [39] Sin embargo, después de que Kahane y sus colegas diseñaran un conjunto de dilemas morales específicamente destinados a refutar la teoría de Greene, sus dilemas morales resultaron confirmarla. [6]

Berker ha planteado tres preocupaciones metodológicas sobre los hallazgos empíricos de Greene. [9] En primer lugar, no es cierto que sólo los juicios deontológicos estén vinculados a los procesos cognitivos. De hecho, una región del cerebro tradicionalmente asociada con las emociones –la corteza cingulada posterior– parece activarse para los juicios característicamente consecuencialistas. Si bien no está claro qué papel crucial desempeña esta región en los juicios morales, se puede argumentar que todos los juicios morales parecen implicar al menos algún procesamiento emocional. Esto refutaría la versión más simple de la hipótesis del proceso dual. Greene respondió a este argumento proponiendo que las emociones que impulsan los juicios deontológicos son “similares a una alarma”, mientras que las que están presentes durante los juicios consecuencialistas son “más como moneda de cambio”. [40] Una respuesta que Berker considera que no tiene respaldo empírico. [9]

La segunda preocupación metodológica de Berker es que Greene et al. presentaron los datos de tiempo de respuesta a los dilemas morales de una manera estadísticamente inválida. En lugar de calcular la diferencia promedio en el tiempo de respuesta entre las respuestas "apropiadas" y las "inapropiadas" para cada dilema moral, Greene et al. calcularon el tiempo de respuesta promedio de las respuestas "apropiadas" e "inapropiadas" combinadas . Debido a esta forma de calcular, las diferencias entre las preguntas sesgaron significativamente los resultados; Berker señala que algunas preguntas involucraban casos "fáciles" que no deberían clasificarse como dilemas. Esto se debe a que, debido a la forma en que se enmarcaron estos casos, las personas encontraron que una de las opciones era obviamente inapropiada.

En tercer lugar, Berker sostiene que los criterios de Greene para clasificar los dilemas morales impersonales y personales no se corresponden con la distinción entre juicios morales deontológicos y consecuencialistas. No es cierto que los juicios consecuencialistas sólo surjan si los casos involucran factores impersonales. Berker destaca el "caso de la Lazy Susan", donde la única manera de salvar a cinco personas que se sientan en una Lazy Susan es empujar la Lazy Susan hacia un transeúnte inocente, matándolo, de modo que sirve como contraejemplo. Aunque este experimento mental involucra daño personal, el filósofo Francis Kamm llega a un juicio consecuencialista intuitivo, pensando que es permisible matar a uno para salvar a cinco.

No obstante lo anterior, Greene ha considerado la crítica posterior. [41]

Las preocupaciones metodológicas más recientes surgen de nuevas evidencias que sugieren que las inclinaciones deontológicas no son necesariamente más emocionales o menos racionales que las inclinaciones utilitaristas. Por ejemplo, la reflexión cognitiva predice tanto las inclinaciones utilitaristas como las deontológicas, [42] pero solo al disociar estas inclinaciones morales con un protocolo más avanzado que no se utilizó en las primeras investigaciones teóricas del proceso dual. [43] Además, hay evidencia de que las decisiones utilitaristas están asociadas con un mayor arrepentimiento emocional que las decisiones deontológicas. [44] Evidencias como estas complican las afirmaciones de los teóricos del proceso dual de que el pensamiento utilitarista es más racional o que el pensamiento deontológico es más emocional.

Guzmán, Barbato, Sznycer y Cosmides señalaron que los dilemas morales eran un problema adaptativo recurrente para los humanos ancestrales, cuya vida social creaba múltiples responsabilidades hacia los demás (hermanos, padres y descendientes, socios cooperativos, aliados de coalición, etc.). Las soluciones intermedias, aquellas que logran un equilibrio entre valores morales en conflicto, a menudo habrían promovido la aptitud más que descuidar un valor para satisfacer plenamente otros. La selección natural habría favorecido la capacidad de hacer juicios intermedios o de "compromiso". [45]

Sin embargo, el modelo de proceso dual descarta la posibilidad de compromisos morales. Según Greene y sus colegas, las personas experimentan el problema del puente peatonal como un dilema porque "dos procesos [psicológicos disociables] producen respuestas diferentes a la misma pregunta". [46] Por un lado, el Sistema 2 produce un juicio utilitarista: "empujar al espectador". Por otro lado, el Sistema 1 activa una emoción de "campana de alarma": "no dañar al espectador". Greene y sus colegas afirman que la prohibición de dañar es "no negociable": no se puede sopesar frente a otros valores, incluidas las consideraciones utilitaristas. [5] [46] Argumentan que "los dilemas insolubles surgen cuando los sistemas psicológicos producen resultados que son... no negociables porque sus resultados se procesan como demandas absolutas, en lugar de preferencias fungibles". [46] El modelo de proceso dual predice que los cambios sutiles en el contexto harán que las personas cambien entre juicios extremos: deónticos y utilitaristas. Los compromisos morales serán "errores de mano temblorosa" poco frecuentes. [45]

Los problemas del tranvía no pueden utilizarse para probar la no negociabilidad, porque fuerzan respuestas extremas (por ejemplo, empujar o no empujar). [45] Por lo tanto, para probar la predicción, Guzmán y sus colegas diseñaron un dilema moral sacrificial que permite juicios de compromiso, de la forma "sacrificar x personas para salvar y ", donde N > 1 personas se salvan por cada una sacrificada. Sus resultados experimentales muestran que las personas hacen muchos juicios de compromiso, que respetan los axiomas de la elección racional. Estos resultados contradicen el modelo de proceso dual, que afirma que solo los juicios deónticos son el producto de la racionalidad moral. Los resultados indican la existencia de un sistema de compensaciones morales que sopesa las consideraciones morales en competencia y encuentra una solución que es la más correcta, que puede ser un juicio de compromiso.

Greene vincula los dos procesos con dos clases existentes de teorías éticas en la filosofía moral. [5] Sostiene que la tensión existente entre las teorías deontológicas de la ética que se centran en la "acción correcta" y las teorías utilitaristas que se centran en los "mejores resultados" se puede explicar por la organización de doble proceso de la mente humana. Las decisiones éticas que caen bajo la "acción correcta" corresponden al procesamiento automático-emocional (sistema 1), mientras que los "mejores resultados" corresponden al razonamiento controlado por la conciencia (sistema 2).

Un ejemplo de esta tensión son las intuiciones sobre los casos de tranvías que difieren según la dimensión de la fuerza personal. [6] Cuando se pregunta a las personas si sería correcto o incorrecto accionar un interruptor para evitar que un tranvía mate a cinco personas, sus intuiciones suelen indicar que accionar el interruptor es la opción moralmente correcta. Sin embargo, cuando se les presenta el mismo escenario a las personas, pero en lugar de accionar un interruptor, se les pregunta si empujarían a un hombre gordo hacia las vías para detener el tranvía, las intuiciones suelen indicar que empujar al hombre gordo es la opción incorrecta. Dado que ambas acciones conducen a la salvación de cinco personas, ¿por qué se juzga que una es correcta, mientras que la otra es incorrecta? Según Greene, no hay justificación moral para esta diferencia de intuiciones entre el "interruptor" y el caso del "hombre gordo". En cambio, lo que conduce a tal diferencia es el hecho moralmente irrelevante de que el caso del "hombre gordo" implica el uso de la fuerza personal (lo que lleva a la mayoría de las personas a juzgar que empujar al hombre gordo es la acción incorrecta), mientras que el caso del "interruptor" no (lo que lleva a la mayoría de las personas a juzgar que accionar el interruptor es la acción correcta).

Greene toma estas observaciones como punto de partida para argumentar que los juicios producidos por procesos automáticos-emocionales carecen de fuerza normativa en comparación con los producidos por procesos controlados por la conciencia. Confiar en respuestas automáticas y emocionales cuando se trata de dilemas morales desconocidos significaría contar con " milagros cognitivos" . [6] Greene propone posteriormente que esto reivindica el consecuencialismo. Rechaza la deontología como marco moral, ya que sostiene que las teorías deontológicas pueden reducirse a racionalizaciones "post-hoc" de respuestas emocionales arbitrarias. [5]

Greene sostiene, en primer lugar, que los hallazgos científicos pueden ayudarnos a llegar a conclusiones normativas interesantes , sin cruzar la brecha entre lo que es y lo que debería ser . Por ejemplo, considera la afirmación normativa "los jurados capitales hacen buenos juicios". Los hallazgos científicos podrían llevarnos a revisar este juicio si se descubriera que los jurados capitales son, de hecho, sensibles a la raza si aceptamos la premisa normativa indiscutible de que los jurados capitales no deberían ser sensibles a la raza. [6]

Greene afirma entonces que la evidencia de la teoría del proceso dual podría darnos motivos para cuestionar los juicios basados en intuiciones morales, en los casos en que esas intuiciones morales podrían estar basadas en factores moralmente irrelevantes. Pone el ejemplo de hermanos incestuosos. La intuición podría decirnos que esto es moralmente incorrecto, pero Greene sugiere que esta intuición es el resultado de que el incesto ha sido históricamente desventajoso desde el punto de vista evolutivo. Sin embargo, si los hermanos toman precauciones extremas, como la vasectomía, para evitar el riesgo de mutación genética en su descendencia, la causa de la intuición moral ya no es relevante. En tales casos, los hallazgos científicos nos han dado motivos para ignorar algunas de nuestras intuiciones morales y, a su vez, revisar los juicios morales que se basan en ellas. [6]

Greene no afirma que los juicios morales basados en las emociones sean categóricamente malos. Su postura es que los diferentes "entornos" son apropiados para diferentes escenarios.

En cuanto a los ajustes automáticos, Greene dice que sólo deberíamos confiar en ellos cuando nos enfrentamos a un problema moral que nos resulta suficientemente "familiar". La familiaridad, según la concepción de Greene, puede surgir de tres fuentes: la historia evolutiva, la cultura y la experiencia personal. Es posible que el miedo a las serpientes, por ejemplo, pueda atribuirse a disposiciones genéticas, mientras que la renuencia a poner la mano sobre una estufa se deba a una experiencia previa de quemarse la mano con una estufa caliente. [6]

La idoneidad de aplicar nuestro modo intuitivo y automático de razonamiento a un problema moral determinado depende, por tanto, de cómo se formó el proceso en primer lugar. Los ajustes automáticos, que se configuran a partir de la experiencia de ensayo y error, sólo funcionarán bien cuando se tenga suficiente experiencia de la situación en cuestión.

A la luz de estas consideraciones, Greene formula el " Principio de No Hay Milagros Cognitivos ": [6]

Cuando nos enfrentamos a problemas morales desconocidos*, deberíamos confiar menos en los ajustes automáticos (respuestas emocionales automáticas) y más en el modo manual (razonamiento consciente y controlado), para no contar con milagros cognitivos.

Esto tiene implicaciones para la discusión filosófica de lo que Greene llama "problemas desconocidos", o problemas éticos con los que no tenemos una experiencia evolutiva, cultural o personal adecuada. Tal vez tengamos que revisar atentamente nuestras intuiciones sobre temas como el cambio climático , la ingeniería genética , el terrorismo global, la pobreza global, etc. Como afirma Greene, esto no significa que nuestras intuiciones siempre estarán equivocadas, pero sí significa que debemos prestar atención a su origen y a cómo se comparan con argumentos más racionales. [6]

El artículo de Greene de 2008 "La broma secreta del alma de Kant" [47] sostiene que la ética kantiana/deontológica tiende a estar impulsada por respuestas emocionales y se entiende mejor como racionalización en lugar de racionalismo, un intento de justificar juicios morales intuitivos a posteriori, aunque el autor afirma que su argumento es especulativo y no será concluyente. Varios filósofos han escrito respuestas críticas, principalmente criticando la vinculación necesaria entre el proceso, automático o controlado, intuitivo o contraintuitivo/racional, con el contenido, respectivamente, deontológico o utilitarista. [48] [49] [50] [51] [52] [53]

Thomas Nagel ha argumentado que Joshua Greene, en su libro Moral Tribes, se apresura demasiado a concluir que el utilitarismo surge específicamente del objetivo general de construir una moralidad imparcial; por ejemplo, dice, Immanuel Kant y John Rawls ofrecen otros enfoques imparciales de las cuestiones éticas. [54] [ cita irrelevante ]

Robert Wright ha calificado de ambiciosa la propuesta de Joshua Greene para una armonía global, añadiendo: "¡Me gusta la ambición!" [55] Pero también afirma que las personas tienen una tendencia a ver los hechos de una manera que sirva a su endogrupo , incluso si no hay desacuerdo sobre los principios morales subyacentes que gobiernan las disputas. "Si de hecho estamos programados para el tribalismo", explica Wright, "entonces tal vez gran parte del problema tenga menos que ver con diferentes visiones morales que con el simple hecho de que mi tribu es mi tribu y tu tribu es tu tribu. Tanto Greene como Paul Bloom citan estudios en los que las personas fueron divididas aleatoriamente en dos grupos e inmediatamente favorecieron a los miembros de su propio grupo en la asignación de recursos, incluso cuando sabían que la asignación era aleatoria". [55] En cambio, Wright propone que "alimentar las semillas de la iluminación autóctona de las tribus del mundo es una apuesta mejor que tratar de convertir a todas las tribus al utilitarismo, es más probable que tenga éxito y más eficaz si lo tiene". [55]

En una crítica ampliamente citada del trabajo de Greene y las implicaciones filosóficas de la teoría del proceso dual, el profesor de filosofía de Harvard Selim Berker analizó críticamente cuatro argumentos que podrían inferirse de la conclusión de Greene y Singer. [9] Etiqueta a tres de ellos como mera retórica o "malos argumentos", y al último como "el argumento de factores irrelevantes". [9] Según Berker, todos ellos son falaces .

Si bien los tres argumentos malos identificados por Berker no son planteados explícitamente por Greene y Singer, Berker los considera implícitos en su razonamiento.

El primero es el argumento de que las emociones son malas y el razonamiento bueno . Según él, nuestras intuiciones deontológicas están impulsadas por las emociones, mientras que las intuiciones consecuencialistas implican un razonamiento abstracto. Por lo tanto, las intuiciones deontológicas no tienen ninguna fuerza normativa, mientras que las intuiciones consecuencialistas sí. Berker sostiene que esto es una petición de principio por dos razones. En primer lugar, porque no hay respaldo para la afirmación de que las intuiciones impulsadas por las emociones son menos fiables que las guiadas por la razón. En segundo lugar, porque el argumento parece basarse en el supuesto de que las intuiciones deontológicas implican solo procesos emocionales, mientras que las intuiciones consecuencialistas implican solo razonamiento abstracto. Para Berker, este supuesto también carece de evidencia empírica . De hecho, la propia investigación de Greene [2] muestra que las respuestas consecuencialistas a los dilemas morales personales involucran al menos una región cerebral -la cingulada posterior- que está asociada con los procesos emocionales. Por lo tanto, no puede justificarse la afirmación de que los juicios deontológicos son menos fiables que los juicios consecuencialistas porque están influidos por las emociones.

El segundo argumento malo presentado por Berker es "El argumento de la heurística " , que es una versión mejorada del argumento "Las emociones son malas, el razonamiento es bueno". Se afirma que los procesos impulsados por las emociones tienden a implicar heurísticas rápidas, lo que los hace poco fiables. De ello se deduce que no se debe confiar en las intuiciones deontológicas, al ser una forma emocional de razonamiento en sí mismas. Según Berker, esta línea de pensamiento también es errónea. Esto es así porque las formas de razonamiento que consisten en heurísticas son generalmente aquellas en las que tenemos una noción clara de lo que es correcto e incorrecto. Por lo tanto, en el ámbito moral, donde estas nociones son muy discutidas, "es una petición de principio suponer que los procesos emocionales que sustentan las intuiciones deontológicas consisten en heurísticas". [9] Berker también cuestiona la propia suposición de que las heurísticas conducen a juicios poco fiables. Además, sostiene que, hasta donde sabemos, los juicios consecuencialistas también pueden basarse en heurísticas, dado que es muy poco probable que siempre puedan ser el producto de cálculos mentales precisos y completos de todos los resultados posibles.

El tercer argumento malo es el "Argumento de la Historia Evolutiva". Se basa en la idea de que nuestras diferentes respuestas morales hacia los daños personales e impersonales tienen una base evolutiva. De hecho, puesto que la violencia personal se conoce desde la antigüedad, los humanos desarrollaron respuestas emocionales como sistemas de alarma innatos para adaptarse, manejar y responder con prontitud a tales situaciones de violencia dentro de sus grupos. Los casos de violencia impersonal, en cambio, no generan la misma alarma innata y, por lo tanto, dejan lugar a un juicio más preciso y analítico de la situación. Así pues, según este argumento, a diferencia de las intuiciones consecuencialistas, las intuiciones deontológicas basadas en la emoción son los efectos secundarios de esta adaptación evolutiva al entorno preexistente. Por lo tanto, "las intuiciones deontológicas, a diferencia de las intuiciones consecuencialistas, no tienen ninguna fuerza normativa". [9] Berker afirma que esta es una conclusión incorrecta porque no hay razón para pensar que las intuiciones consecuencialistas no sean también subproductos de la evolución. [9] Además, sostiene que la invitación, avanzada por Singer, [8] a separar los juicios morales basados en la evolución (supuestamente poco confiables) de aquellos que se basan en la razón, es engañosa porque se basa en una falsa dicotomía .

Berker sostuvo que el argumento más prometedor para pasar del “es” neuronal al “debería” moral es el siguiente: [9]

"P1. El procesamiento emocional que da lugar a las intuiciones deontológicas responde a factores que hacen que un dilema sea personal en lugar de impersonal.

P2. Los factores que hacen que un dilema sea personal en lugar de impersonal son moralmente irrelevantes.

C1. Así pues, el procesamiento emocional que da lugar a intuiciones deontológicas responde a factores que son moralmente irrelevantes.

C2. Por tanto, las intuiciones deontológicas, a diferencia de las intuiciones consecuencialistas, no tienen ninguna fuerza normativa genuina.

Berker critica tanto las premisas como el paso de C1 a C2. En cuanto a P1, Berker no está convencido de que los juicios deontológicos se caractericen correctamente como una mera apelación a factores que hacen que el dilema sea personal. Por ejemplo, el caso de la "Lazy Susan" de Kamm [56] es un ejemplo de un dilema "personal" que provoca una respuesta característicamente consecuencialista . En cuanto a P2, sostiene que los factores que hacen que un dilema sea personal o impersonal no son necesariamente moralmente irrelevantes. Además, añade, P2 es "filosofar desde el sillón": no se puede deducir de los resultados neurocientíficos que la proximidad de un dilema influya en su relevancia moral . [9] Finalmente, Berker concluye que incluso si aceptamos P1 y P2, C1 no implica necesariamente C2. Esto se debe a que puede darse el caso de que las intuiciones consecuencialistas también respondan a factores moralmente irrelevantes. A menos que podamos demostrar que este no es el caso, la inferencia de C1 a C2 es inválida.

Muchos filósofos apelan a lo que se conoce coloquialmente como el factor de asco , o la creencia de que una intuición negativa generalizada y común hacia algo es evidencia de que hay algo moralmente incorrecto en ello. Esto se opone a la conclusión de Greene de que no se debe esperar que las intuiciones "funcionen bien" o nos den un buen razonamiento ético para algunos problemas éticos. La sabiduría de la repugnancia de Leon Kass presenta un excelente ejemplo de una respuesta basada en los sentimientos a un dilema ético . Kass intenta presentar un caso contra la clonación humana sobre la base de los fuertes sentimientos generalizados de repugnancia hacia la clonación. Enumera ejemplos de las diversas consecuencias desagradables de la clonación y apela a nociones de naturaleza y dignidad humanas para mostrar que nuestro asco es la expresión emocional de una sabiduría profunda que no es completamente articulable. [57]

Existe un debate generalizado sobre el papel de las emociones morales, como la culpa o la empatía , y su papel en la filosofía, y la relación de las intuiciones con ellas. [58]

En particular, el papel de la empatía en la moralidad ha sido recientemente muy criticado por comentaristas como Jess Prinz , quien la describe como "propensa a sesgos que hacen que el juicio moral sea potencialmente dañino". [59] De manera similar , Paul Bloom , autor de 'Against Empathy : The Case for Rational Compassion ' etiqueta la empatía como "de mente estrecha, parroquial e innumerable", [60] principalmente debido a los efectos nocivos que pueden surgir al confiar respuestas emocionales y no razonadas para abordar cuestiones éticas complejas, que solo pueden abordarse adecuadamente a través de la racionalidad y la reflexión.

Un ejemplo de esto es "el efecto de la víctima identificable" , donde los sujetos muestran una reacción emocional mucho más fuerte ante el sufrimiento de una víctima conocida , en oposición a la respuesta emocional más débil experimentada cuando se responde al sufrimiento de un grupo anónimo a gran escala (aunque el beneficio conferido por el sujeto sería de igual utilidad en ambos casos).

Esto ejemplifica el potencial de que la empatía "falle" y motiva el consenso ampliamente compartido en el debate sobre la mejora moral de que se requiere algo más que la amplificación de ciertas emociones. Aumentar la empatía de un agente elevando artificialmente los niveles de oxitocina probablemente no sea efectivo para mejorar su agencia moral general, porque tal disposición depende en gran medida de los contextos psicológicos, sociales y situacionales, así como de sus convicciones y creencias profundamente arraigadas. [61] Más bien,

Es probable que aumentar las capacidades de orden superior para modular las propias respuestas morales de una manera flexible, sensible a la razón y dependiente del contexto sea un medio más confiable y, en la mayoría de los casos, más deseable para la mejora moral agencial. [61]