.jpg/440px-Customer_cleared_to_board_flight_(46092017161).jpg)

Un sistema de reconocimiento facial [1] es una tecnología potencialmente capaz de comparar un rostro humano a partir de una imagen digital o un fotograma de vídeo con una base de datos de rostros. Un sistema de este tipo se emplea normalmente para autenticar a los usuarios a través de servicios de verificación de identidad y funciona señalando y midiendo los rasgos faciales a partir de una imagen determinada. [2]

El desarrollo de sistemas similares comenzó en la década de 1960, comenzando como una forma de aplicación informática . Desde sus inicios, los sistemas de reconocimiento facial han tenido usos más amplios en los últimos tiempos en teléfonos inteligentes y en otras formas de tecnología, como la robótica . Debido a que el reconocimiento facial computarizado implica la medición de las características fisiológicas de un ser humano, los sistemas de reconocimiento facial se clasifican como biométricos . Aunque la precisión de los sistemas de reconocimiento facial como tecnología biométrica es menor que la del reconocimiento del iris , la adquisición de imágenes de huellas dactilares , el reconocimiento de la palma o el reconocimiento de voz , se adopta ampliamente debido a su proceso sin contacto. [3] Los sistemas de reconocimiento facial se han implementado en la interacción avanzada entre humanos y computadoras , videovigilancia , aplicación de la ley , control de pasajeros, decisiones sobre empleo y vivienda e indexación automática de imágenes. [4] [5]

Hoy en día, gobiernos y empresas privadas emplean sistemas de reconocimiento facial en todo el mundo. [6] Su eficacia varía y algunos sistemas han sido desechados anteriormente debido a su ineficacia. El uso de sistemas de reconocimiento facial también ha generado controversia, con afirmaciones de que los sistemas violan la privacidad de los ciudadanos, comúnmente realizan identificaciones incorrectas, fomentan normas de género [7] [8] y perfiles raciales , [9] y no protegen datos biométricos importantes. La aparición de medios sintéticos como los deepfakes también ha generado preocupación sobre su seguridad. [10] Estas afirmaciones han llevado a la prohibición de los sistemas de reconocimiento facial en varias ciudades de Estados Unidos . [11] Las crecientes preocupaciones sociales llevaron a la empresa de redes sociales Meta Platforms a cerrar su sistema de reconocimiento facial de Facebook en 2021, eliminando los datos de escaneo facial de más de mil millones de usuarios. [12] [13] El cambio representó uno de los mayores cambios en el uso del reconocimiento facial en la historia de la tecnología. IBM también dejó de ofrecer tecnología de reconocimiento facial debido a preocupaciones similares. [14]

El reconocimiento facial automatizado fue iniciado en la década de 1960 por Woody Bledsoe , Helen Chan Wolf y Charles Bisson, cuyo trabajo se centró en enseñar a las computadoras a reconocer rostros humanos. [15] Su primer proyecto de reconocimiento facial se denominó "hombre-máquina" porque un humano primero necesitaba establecer las coordenadas de los rasgos faciales en una fotografía antes de que una computadora pudiera utilizarlos para el reconocimiento. Usando una tableta gráfica , un humano identificaría las coordenadas de los rasgos faciales, como los centros de las pupilas, las esquinas interiores y exteriores de los ojos y el pico de las viudas en la línea del cabello. Las coordenadas se utilizaron para calcular 20 distancias individuales, incluido el ancho de la boca y de los ojos. Un humano podría procesar unas 40 imágenes por hora, creando una base de datos de estas distancias calculadas. Luego, una computadora compararía automáticamente las distancias de cada fotografía, calcularía la diferencia entre las distancias y devolvería los registros cerrados como una posible coincidencia. [15]

En 1970, Takeo Kanade demostró públicamente un sistema de comparación de rostros que localizaba rasgos anatómicos como el mentón y calculaba la relación de distancia entre los rasgos faciales sin intervención humana. Pruebas posteriores revelaron que el sistema no siempre podía identificar de forma fiable los rasgos faciales. No obstante, el interés en el tema creció y en 1977 Kanade publicó el primer libro detallado sobre tecnología de reconocimiento facial. [dieciséis]

En 1993, la Agencia de Proyectos de Investigación Avanzada de Defensa (DARPA) y el Laboratorio de Investigación del Ejército (ARL) establecieron el programa de tecnología de reconocimiento facial FERET para desarrollar "capacidades de reconocimiento facial automático" que pudieran emplearse en un entorno productivo de la vida real "para ayudar a la seguridad, personal de inteligencia y de aplicación de la ley en el desempeño de sus funciones”. Se evaluaron los sistemas de reconocimiento facial que se habían probado en laboratorios de investigación y las pruebas FERET encontraron que, si bien el rendimiento de los sistemas automatizados de reconocimiento facial existentes variaba, un puñado de métodos existentes podrían usarse de manera viable para reconocer rostros en imágenes fijas tomadas en un entorno controlado. [17] Las pruebas FERET generaron tres empresas estadounidenses que vendían sistemas automatizados de reconocimiento facial. Vision Corporation y Miros Inc fueron fundadas en 1994 por investigadores que utilizaron los resultados de las pruebas FERET como punto de venta. Viisage Technology fue fundada por un contratista de defensa de tarjetas de identificación en 1996 para explotar comercialmente los derechos del algoritmo de reconocimiento facial desarrollado por Alex Pentland en el MIT . [18]

Después de la prueba de proveedores de reconocimiento facial FERET de 1993, las oficinas del Departamento de Vehículos Motorizados (DMV) en Virginia Occidental y Nuevo México se convirtieron en las primeras oficinas del DMV en utilizar sistemas automatizados de reconocimiento facial para evitar que las personas obtengan múltiples licencias de conducir con nombres diferentes. Las licencias de conducir en los Estados Unidos eran en ese momento una forma comúnmente aceptada de identificación con fotografía . Las oficinas del DMV en todo Estados Unidos estaban experimentando una actualización tecnológica y estaban en proceso de establecer bases de datos de fotografías de identificación digitales. Esto permitió a las oficinas del DMV implementar sistemas de reconocimiento facial en el mercado para buscar fotografías de nuevas licencias de conducir en la base de datos existente del DMV. [19] Las oficinas del DMV se convirtieron en uno de los primeros mercados importantes para la tecnología de reconocimiento facial automatizado e introdujeron a los ciudadanos estadounidenses al reconocimiento facial como método estándar de identificación. [20] El aumento de la población carcelaria de EE. UU. en la década de 1990 impulsó a los estados de EE. UU. a establecer sistemas de identificación conectados y automatizados que incorporaban bases de datos biométricas digitales , en algunos casos esto incluía reconocimiento facial. En 1999, Minnesota incorporó el sistema de reconocimiento facial FaceIT de Visionics en un sistema de reserva de fotografías policiales que permitía a la policía, los jueces y los funcionarios judiciales rastrear a los delincuentes en todo el estado. [21]

Hasta la década de 1990, los sistemas de reconocimiento facial se desarrollaban principalmente mediante el uso de retratos fotográficos de rostros humanos. La investigación sobre el reconocimiento facial para localizar de manera confiable una cara en una imagen que contiene otros objetos ganó fuerza a principios de la década de 1990 con el análisis de componentes principales (PCA). El método PCA de detección de rostros también se conoce como Eigenface y fue desarrollado por Matthew Turk y Alex Pentland. [22] Turk y Pentland combinaron el enfoque conceptual del teorema de Karhunen-Loève y el análisis factorial para desarrollar un modelo lineal . Las caras propias se determinan en función de las características globales y ortogonales de los rostros humanos. Un rostro humano se calcula como una combinación ponderada de varias caras propias. Debido a que se utilizaron pocas caras propias para codificar rostros humanos de una población determinada, el método de detección de rostros PCA de Turk y Pentland redujo en gran medida la cantidad de datos que debían procesarse para detectar un rostro. Pentland en 1994 definió las características de Eigenface, incluidos ojos propios, bocas propias y narices propias, para avanzar en el uso de PCA en el reconocimiento facial. En 1997, el método PCA Eigenface de reconocimiento facial [23] se mejoró mediante el uso de análisis discriminante lineal (LDA) para producir Fisherfaces . [24] LDA Fisherfaces se utilizó predominantemente en el reconocimiento facial basado en funciones PCA. Mientras que las Eigenfaces también se utilizaron para la reconstrucción facial. En estos enfoques no se calcula ninguna estructura global del rostro que vincule los rasgos o partes del rostro. [25]

Los enfoques de reconocimiento facial puramente basados en características fueron superados a finales de la década de 1990 por el sistema de Bochum, que utilizó el filtro Gabor para registrar las características de la cara y calculó una cuadrícula de la estructura de la cara para vincular las características. [26] Christoph von der Malsburg y su equipo de investigación en la Universidad de Bochum desarrollaron Elastic Bunch Graph Matching a mediados de la década de 1990 para extraer un rostro de una imagen mediante segmentación de piel. [22] En 1997, el método de detección de rostros desarrollado por Malsburg superó a la mayoría de los demás sistemas de detección de rostros en el mercado. El llamado "sistema de Bochum" de detección de rostros se vendió comercialmente en el mercado como ZN-Face a operadores de aeropuertos y otros lugares concurridos. El software era "lo suficientemente robusto como para realizar identificaciones a partir de vistas de rostros no perfectas. A menudo, también puede detectar impedimentos para la identificación como bigotes, barbas, peinados cambiados y gafas, incluso gafas de sol". [27]

La detección de rostros en tiempo real en secuencias de vídeo se hizo posible en 2001 con el marco de detección de objetos para rostros de Viola-Jones . [28] Paul Viola y Michael Jones combinaron su método de detección de rostros con el enfoque de función similar a Haar para el reconocimiento de objetos en imágenes digitales para lanzar AdaBoost , el primer detector de rostros de vista frontal en tiempo real. [29] En 2015, el algoritmo Viola-Jones se había implementado utilizando pequeños detectores de baja potencia en dispositivos portátiles y sistemas integrados . Por lo tanto, el algoritmo Viola-Jones no sólo ha ampliado la aplicación práctica de los sistemas de reconocimiento facial sino que también se ha utilizado para admitir nuevas funciones en interfaces de usuario y teleconferencias . [30]

Ucrania está utilizando el software de reconocimiento facial Clearview AI , con sede en Estados Unidos, para identificar a los soldados rusos muertos. Ucrania ha realizado 8.600 búsquedas e identificado a las familias de 582 soldados rusos fallecidos. Posteriormente, la sección de voluntarios informáticos del ejército ucraniano que utiliza el software se pone en contacto con las familias de los soldados fallecidos para concienciar sobre las actividades rusas en Ucrania. El objetivo principal es desestabilizar al gobierno ruso. Puede verse como una forma de guerra psicológica . Alrededor de 340 funcionarios del gobierno ucraniano en cinco ministerios del gobierno están utilizando la tecnología. Se utiliza para atrapar espías que podrían intentar entrar en Ucrania. [31]

La base de datos de reconocimiento facial de Clearview AI solo está disponible para agencias gubernamentales que solo pueden usar la tecnología para ayudar en el curso de investigaciones policiales o en relación con la seguridad nacional. [32]

El software fue donado a Ucrania por Clearview AI. Se cree que Rusia lo está utilizando para encontrar activistas contra la guerra. Clearview AI se diseñó originalmente para las fuerzas del orden de EE. UU. Su uso en la guerra plantea nuevas preocupaciones éticas. A Stephen Hare, un experto en vigilancia radicado en Londres, le preocupa que esto pueda hacer que los ucranianos parezcan inhumanos: "¿Está funcionando realmente? ¿O está haciendo que [los rusos] digan: 'Miren a estos ucranianos crueles y sin ley, haciéndoles esto a nuestros muchachos'? " [33]

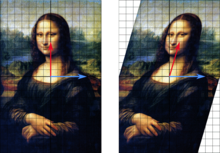

Si bien los humanos pueden reconocer rostros sin mucho esfuerzo, [34] el reconocimiento facial es un problema desafiante de reconocimiento de patrones en la informática . Los sistemas de reconocimiento facial intentan identificar un rostro humano, que es tridimensional y cambia de apariencia con la iluminación y la expresión facial, basándose en su imagen bidimensional. Para realizar esta tarea computacional, los sistemas de reconocimiento facial realizan cuatro pasos. La detección del primer rostro se utiliza para segmentar el rostro del fondo de la imagen. En el segundo paso, la imagen del rostro segmentado se alinea para tener en cuenta la pose del rostro , el tamaño de la imagen y las propiedades fotográficas, como la iluminación y la escala de grises . El propósito del proceso de alineación es permitir la localización precisa de los rasgos faciales en el tercer paso, la extracción de los rasgos faciales. Características como los ojos, la nariz y la boca se señalan y miden en la imagen para representar el rostro. El vector de características del rostro así establecido se compara entonces, en el cuarto paso, con una base de datos de rostros. [35]

Algunos algoritmos de reconocimiento facial identifican rasgos faciales extrayendo puntos de referencia o rasgos de una imagen del rostro del sujeto. Por ejemplo, un algoritmo puede analizar la posición relativa, el tamaño y/o la forma de los ojos, la nariz, los pómulos y la mandíbula. [36] Estas características se utilizan luego para buscar otras imágenes con características coincidentes. [37]

Otros algoritmos normalizan una galería de imágenes de rostros y luego comprimen los datos de los rostros, guardando solo los datos de la imagen que son útiles para el reconocimiento de rostros. Luego se compara una imagen de sonda con los datos del rostro. [38] Uno de los primeros sistemas exitosos [39] se basa en técnicas de coincidencia de plantillas [40] aplicadas a un conjunto de rasgos faciales destacados, proporcionando una especie de representación facial comprimida.

Los algoritmos de reconocimiento se pueden dividir en dos enfoques principales: geométrico, que analiza características distintivas, o fotométrico, que es un enfoque estadístico que destila una imagen en valores y compara los valores con plantillas para eliminar variaciones. Algunos clasifican estos algoritmos en dos categorías amplias: modelos holísticos y basados en características. El primero intenta reconocer el rostro en su totalidad mientras que el basado en características lo subdivide en componentes según características y analiza cada uno de ellos, así como su ubicación espacial con respecto a otras características. [41]

Los algoritmos de reconocimiento populares incluyen el análisis de componentes principales utilizando caras propias , el análisis discriminante lineal , la coincidencia de gráficos de grupos elásticos utilizando el algoritmo de Fisherface, el modelo oculto de Markov , el aprendizaje de subespacio multilineal utilizando la representación tensorial y la coincidencia de enlaces dinámicos motivados neuronalmente . [ cita necesaria ] [42] Los sistemas modernos de reconocimiento facial hacen un uso cada vez mayor de técnicas de aprendizaje automático, como el aprendizaje profundo . [43]

Para permitir la identificación humana a distancia (HID), las imágenes de rostros de baja resolución se mejoran mediante alucinaciones faciales . En las imágenes de CCTV, los rostros suelen ser muy pequeños. Pero debido a que los algoritmos de reconocimiento facial que identifican y trazan rasgos faciales requieren imágenes de alta resolución, se han desarrollado técnicas de mejora de la resolución para permitir que los sistemas de reconocimiento facial funcionen con imágenes capturadas en entornos con una alta relación señal-ruido . Los algoritmos de alucinación facial que se aplican a las imágenes antes de enviarlas al sistema de reconocimiento facial utilizan aprendizaje automático basado en ejemplos con sustitución de píxeles o índices de distribución del vecino más cercano que también pueden incorporar características faciales demográficas y relacionadas con la edad. El uso de técnicas de alucinación facial mejora el rendimiento de los algoritmos de reconocimiento facial de alta resolución y puede usarse para superar las limitaciones inherentes de los algoritmos de superresolución. Las técnicas de alucinación facial también se utilizan para pretratar imágenes en las que los rostros están disfrazados. Aquí se quita el disfraz, como las gafas de sol, y se aplica el algoritmo de alucinación facial a la imagen. Estos algoritmos de alucinación facial deben entrenarse en imágenes faciales similares con y sin disfraz. Para rellenar el área descubierta al quitar el disfraz, los algoritmos de alucinación facial deben mapear correctamente todo el estado del rostro, lo que puede no ser posible debido a la expresión facial momentánea capturada en la imagen de baja resolución. [44]

La técnica de reconocimiento facial tridimensional utiliza sensores 3D para capturar información sobre la forma de un rostro. Luego, esta información se utiliza para identificar rasgos distintivos en la superficie de una cara, como el contorno de las cuencas de los ojos, la nariz y el mentón. [45] Una ventaja del reconocimiento facial 3D es que no se ve afectado por los cambios en la iluminación como otras técnicas. También puede identificar una cara desde una variedad de ángulos de visión, incluida una vista de perfil. [45] [37] Los puntos de datos tridimensionales de un rostro mejoran enormemente la precisión del reconocimiento facial. La investigación del reconocimiento facial tridimensional es posible gracias al desarrollo de sensores sofisticados que proyectan luz estructurada sobre el rostro. [46] Las técnicas de comparación 3D son sensibles a las expresiones, por lo tanto, los investigadores de Technion aplicaron herramientas de geometría métrica para tratar las expresiones como isometrías . [47] Un nuevo método para capturar imágenes 3D de rostros utiliza tres cámaras de seguimiento que apuntan en diferentes ángulos; Una cámara apuntará al frente del sujeto, la segunda hacia un lado y la tercera en ángulo. Todas estas cámaras funcionarán juntas para poder rastrear el rostro de un sujeto en tiempo real y poder detectar y reconocer rostros. [48]

Una forma diferente de tomar datos de entrada para el reconocimiento facial es mediante el uso de cámaras térmicas ; mediante este procedimiento, las cámaras solo detectarán la forma de la cabeza e ignorarán los accesorios del sujeto, como gafas, sombreros o maquillaje. [49] A diferencia de las cámaras convencionales, las cámaras térmicas pueden capturar imágenes faciales incluso en condiciones de poca luz y de noche sin utilizar un flash ni exponer la posición de la cámara. [50] Sin embargo, las bases de datos para el reconocimiento facial son limitadas. Los esfuerzos para crear bases de datos de imágenes térmicas de rostros se remontan a 2004. [49] En 2016, existían varias bases de datos, incluidas la IIITD-PSE y la base de datos de rostros térmicos de Notre Dame. [51] Los sistemas actuales de reconocimiento térmico de rostros no son capaces de detectar de manera confiable un rostro en una imagen térmica que se ha tomado de un entorno exterior. [52]

En 2018, investigadores del Laboratorio de Investigación del Ejército de EE. UU. (ARL) desarrollaron una técnica que les permitiría comparar imágenes faciales obtenidas con una cámara térmica con aquellas de bases de datos capturadas con una cámara convencional. [53] Conocido como método de síntesis de espectro cruzado debido a cómo une el reconocimiento facial de dos modalidades de imágenes diferentes, este método sintetiza una sola imagen analizando múltiples regiones y detalles faciales. [54] Consiste en un modelo de regresión no lineal que mapea una imagen térmica específica en una imagen facial visible correspondiente y un problema de optimización que proyecta la proyección latente nuevamente en el espacio de la imagen. [50] Los científicos de ARL han observado que el enfoque funciona combinando información global (es decir, características de toda la cara) con información local (es decir, características relacionadas con los ojos, la nariz y la boca). [55] Según las pruebas de rendimiento realizadas en ARL, el modelo de síntesis de espectro cruzado de múltiples regiones demostró una mejora de rendimiento de aproximadamente el 30 % con respecto a los métodos de referencia y aproximadamente el 5 % con respecto a los métodos de última generación. [54]

Fundada en 2013, Looksery recaudó dinero para su aplicación de modificación facial en Kickstarter. Después de una exitosa financiación colectiva, Looksery se lanzó en octubre de 2014. La aplicación permite chatear por vídeo con otras personas a través de un filtro especial para rostros que modifica la apariencia de los usuarios. Las aplicaciones de aumento de imágenes que ya estaban en el mercado, como Facetune y Perfect365, se limitaban a imágenes estáticas, mientras que Looksery permitía la realidad aumentada a vídeos en vivo. A finales de 2015, SnapChat compró Looksery, que luego se convertiría en su función de lentes emblemática. [56] Las aplicaciones de filtro de Snapchat utilizan tecnología de detección de rostros y, en función de los rasgos faciales identificados en una imagen, se coloca una máscara de malla 3D sobre el rostro. [57] Una variedad de tecnologías intentan engañar al software de reconocimiento facial mediante el uso de máscaras de reconocimiento facial . [58]

DeepFace es un sistema de reconocimiento facial de aprendizaje profundo creado por un grupo de investigación de Facebook . Identifica rostros humanos en imágenes digitales. Emplea una red neuronal de nueve capas con más de 120 millones de pesos de conexión y fue entrenado en cuatro millones de imágenes cargadas por usuarios de Facebook. [59] [60] Se dice que el sistema tiene una precisión del 97%, en comparación con el 85% del sistema de identificación de próxima generación del FBI . [61]

El algoritmo de TikTok se ha considerado especialmente eficaz, pero muchos se preguntaron cuál era la programación exacta que hacía que la aplicación fuera tan eficaz a la hora de adivinar el contenido deseado por el usuario. [62] En junio de 2020, TikTok publicó una declaración sobre la página "Para ti" y cómo recomendaban videos a los usuarios, que no incluían reconocimiento facial. [63] Sin embargo, en febrero de 2021, TikTok acordó un acuerdo de 92 millones de dólares en una demanda estadounidense que alegaba que la aplicación había utilizado reconocimiento facial tanto en los vídeos de los usuarios como en su algoritmo para identificar la edad, el género y el origen étnico. [64]

El uso emergente del reconocimiento facial se encuentra en el uso de servicios de verificación de identidad . Muchas empresas y otros están trabajando ahora en el mercado para brindar estos servicios a bancos, ICO y otros negocios electrónicos. [65] El reconocimiento facial se ha aprovechado como una forma de autenticación biométrica para diversas plataformas y dispositivos informáticos; [37] Android 4.0 "Ice Cream Sandwich" agregó reconocimiento facial utilizando la cámara frontal de un teléfono inteligente como medio para desbloquear dispositivos, [66] [67] mientras que Microsoft introdujo el inicio de sesión con reconocimiento facial en su consola de videojuegos Xbox 360 a través de su accesorio Kinect. , [68] así como Windows 10 a través de su plataforma "Windows Hello" (que requiere una cámara con iluminación infrarroja). [69] En 2017, el teléfono inteligente iPhone X de Apple introdujo el reconocimiento facial en la línea de productos con su plataforma " Face ID ", que utiliza un sistema de iluminación infrarroja. [70]

Apple introdujo Face ID en el iPhone X como un sucesor de autenticación biométrica del Touch ID , un sistema basado en huellas dactilares . Face ID tiene un sensor de reconocimiento facial que consta de dos partes: un módulo "Romeo" que proyecta más de 30.000 puntos infrarrojos en el rostro del usuario y un módulo "Julieta" que lee el patrón. [71] El patrón se envía a un "Enclave seguro" local en la unidad central de procesamiento (CPU) del dispositivo para confirmar una coincidencia con la cara del propietario del teléfono. [72]

Apple no puede acceder al patrón facial. El sistema no funcionará con los ojos cerrados, en un esfuerzo por evitar el acceso no autorizado. [72] La tecnología aprende de los cambios en la apariencia del usuario y, por lo tanto, funciona con sombreros, bufandas, anteojos y muchas gafas de sol, barba y maquillaje. [73] También funciona en la oscuridad. Esto se hace mediante el uso de un "Iluminador de inundación", que es un flash infrarrojo dedicado que arroja luz infrarroja invisible sobre la cara del usuario para leer correctamente los 30.000 puntos faciales. [74]

Los algoritmos de reconocimiento facial pueden ayudar a diagnosticar algunas enfermedades utilizando rasgos específicos de la nariz, las mejillas y otras partes del rostro humano . [75] Basándose en conjuntos de datos desarrollados, el aprendizaje automático se ha utilizado para identificar anomalías genéticas basándose únicamente en las dimensiones faciales. [76] La FRT también se ha utilizado para verificar a los pacientes antes de los procedimientos quirúrgicos.

En marzo de 2022, según una publicación de Forbes, FDNA, una empresa de desarrollo de inteligencia artificial, afirmó que en el espacio de 10 años, han trabajado con genetistas para desarrollar una base de datos de alrededor de 5.000 enfermedades y 1.500 de ellas pueden detectarse con algoritmos de reconocimiento facial. . [77]

En una entrevista, el jefe de la Autoridad Nacional de Salud, Dr. RS Sharma, dijo que la tecnología de reconocimiento facial se utilizaría junto con Aadhaar para autenticar la identidad de las personas que buscan vacunas. [78] Diez organizaciones de derechos humanos y derechos digitales y más de 150 personas firmaron una declaración de la Internet Freedom Foundation que dio la alarma contra el despliegue de tecnología de reconocimiento facial en el proceso de campaña de vacunación del gobierno central. [79] La implementación de un sistema propenso a errores sin una legislación adecuada que contenga salvaguardias obligatorias privaría a los ciudadanos de servicios esenciales y vincular esta tecnología no probada con el lanzamiento de la vacunación en la India solo excluirá a las personas del sistema de administración de vacunas. [80]

En julio de 2021, un comunicado de prensa del Gobierno de Meghalaya declaró que se utilizaría tecnología de reconocimiento facial (FRT) para verificar la identidad de los pensionados y emitir un Certificado de Vida Digital utilizando la aplicación móvil "Verificación de Certificación de Vida del Pensionista". [81] El aviso, según el comunicado de prensa, pretende ofrecer a los pensionados "una interfaz segura, fácil y sin complicaciones para verificar su estado de vida ante las Autoridades de Desembolso de Pensiones desde la comodidad de sus hogares utilizando teléfonos inteligentes". El Sr. Jade Jeremiah Lyngdoh, estudiante de derecho, envió un aviso legal a las autoridades pertinentes destacando que "la aplicación se ha implementado sin ninguna legislación que regule el procesamiento de datos personales y, por lo tanto, carece de legalidad y el Gobierno no está facultado para procesar datos." [82]

La Fuerza Fronteriza de Australia y el Servicio de Aduanas de Nueva Zelanda han establecido un sistema automatizado de procesamiento fronterizo llamado SmartGate que utiliza reconocimiento facial, que compara el rostro del viajero con los datos del microchip del pasaporte electrónico . [83] [84] Todos los aeropuertos internacionales canadienses utilizan el reconocimiento facial como parte del programa de quiosco de inspección primaria que compara la cara de un viajero con su fotografía almacenada en el pasaporte electrónico . Este programa llegó por primera vez al Aeropuerto Internacional de Vancouver a principios de 2017 y se extendió a todos los aeropuertos internacionales restantes en 2018-2019. [85]

Las fuerzas policiales del Reino Unido han estado probando tecnología de reconocimiento facial en vivo en eventos públicos desde 2015. [86] En mayo de 2017, un hombre fue arrestado usando un sistema de reconocimiento facial automático (AFR) montado en una camioneta operada por la Policía de Gales del Sur. Ars Technica informó que "esta parece ser la primera vez que [AFR] conduce a un arresto". [87] Sin embargo, un informe de 2018 de Big Brother Watch encontró que estos sistemas tenían hasta un 98% de inexactitud. [86] El informe también reveló que dos fuerzas policiales del Reino Unido, la Policía de Gales del Sur y la Policía Metropolitana , estaban utilizando el reconocimiento facial en vivo en eventos públicos y en espacios públicos. [88] En septiembre de 2019, el uso del reconocimiento facial por parte de la policía de Gales del Sur fue declarado legal. [88] El reconocimiento facial en vivo se ha probado desde 2016 en las calles de Londres y la Policía Metropolitana lo utilizará de forma regular desde principios de 2020. [89] En agosto de 2020, el Tribunal de Apelaciones dictaminó que la forma en que el sistema de reconocimiento facial había sido utilizado por la Policía de Gales del Sur en 2017 y 2018 violó los derechos humanos. [90]

.jpg/440px-Facial_recognition_technology_at_gate_(44275734970).jpg)

El Departamento de Estado de EE. UU. opera uno de los sistemas de reconocimiento facial más grandes del mundo con una base de datos de 117 millones de adultos estadounidenses, con fotografías generalmente extraídas de fotografías de licencias de conducir. [91] Aunque todavía está lejos de estar terminado, se está utilizando en ciertas ciudades para dar pistas sobre quién estaba en la foto. El FBI utiliza las fotografías como herramienta de investigación, no para una identificación positiva. [92] A partir de 2016, [actualizar]el reconocimiento facial se utilizaba para identificar personas en fotografías tomadas por la policía en San Diego y Los Ángeles (no en video en tiempo real, y solo en fotos de reserva) [93] y su uso estaba planeado en Virginia Occidental. y Dallas . [94]

En los últimos años, Maryland ha utilizado el reconocimiento facial comparando los rostros de las personas con las fotografías de sus licencias de conducir. El sistema generó controversia cuando se utilizó en Baltimore para arrestar a manifestantes rebeldes después de la muerte de Freddie Gray bajo custodia policial. [95] Muchos otros estados están utilizando o desarrollando un sistema similar, sin embargo, algunos estados tienen leyes que prohíben su uso.

El FBI también ha instituido su programa de Identificación de Próxima Generación para incluir reconocimiento facial, así como datos biométricos más tradicionales como huellas dactilares y escaneos de iris , que pueden extraerse de bases de datos tanto penales como civiles. [96] La Oficina de Responsabilidad del Gobierno federal criticó al FBI por no abordar diversas preocupaciones relacionadas con la privacidad y la precisión. [97]

A partir de 2018, la Oficina de Aduanas y Protección Fronteriza de EE. UU. implementó "escáneres faciales biométricos" en los aeropuertos de EE. UU. Los pasajeros que tomen vuelos internacionales de salida pueden completar el proceso de facturación, seguridad y embarque después de capturar y verificar imágenes faciales al comparar sus fotografías de identificación almacenadas en la base de datos de CBP. Las imágenes capturadas por viajeros con ciudadanía estadounidense se eliminarán en un plazo de hasta 12 horas. La Administración de Seguridad del Transporte (TSA) había expresado su intención de adoptar en el futuro un programa similar para los viajes aéreos nacionales durante el proceso de control de seguridad. La Unión Estadounidense por las Libertades Civiles es una de las organizaciones que se oponen al programa, ya que considera que el programa se utilizará con fines de vigilancia. [98]

En 2019, los investigadores informaron que el Servicio de Inmigración y Control de Aduanas (ICE) utiliza software de reconocimiento facial en bases de datos de licencias de conducir estatales, incluso para algunos estados que otorgan licencias a inmigrantes indocumentados. [97]

En diciembre de 2022, 16 aeropuertos nacionales importantes de EE. UU. comenzaron a probar tecnología de reconocimiento facial en la que quioscos con cámaras verifican las fotografías de las identificaciones de los viajeros para asegurarse de que los pasajeros no sean impostores. [99]

En 2006, el gobierno chino inició el proyecto "Skynet" (天網)) para implementar vigilancia CCTV en todo el país y, hasta 2018, [actualizar]se han desplegado 20 millones de cámaras, muchas de las cuales son capaces de reconocimiento facial en tiempo real, en todo el país. el país para este proyecto. [100] Algunos funcionarios afirman que el actual sistema Skynet puede escanear a toda la población china en un segundo y a la población mundial en dos segundos. [101]

.jpg/440px-Entrance_faregates_at_waiting_room_10_of_Beijing_West_Railway_Station_(20190908184801).jpg)

En 2017, la policía de Qingdao pudo identificar a veinticinco sospechosos buscados utilizando equipos de reconocimiento facial en el Festival Internacional de la Cerveza de Qingdao, uno de los cuales había estado prófugo durante 10 años. [102] El equipo funciona grabando un videoclip de 15 segundos y tomando múltiples instantáneas del sujeto. Esos datos se comparan y analizan con imágenes de la base de datos del departamento de policía y en 20 minutos, el sujeto puede ser identificado con una precisión del 98,1%. [103]

En 2018, la policía china en Zhengzhou y Beijing utilizaba gafas inteligentes para tomar fotografías que se comparan con una base de datos gubernamental que utiliza reconocimiento facial para identificar sospechosos, recuperar una dirección y rastrear a las personas que se mueven más allá de sus áreas de origen. [104] [105]

A finales de 2017, [actualizar]China implementó tecnología de reconocimiento facial e inteligencia artificial en Xinjiang . Los periodistas que visitaron la región encontraron cámaras de vigilancia instaladas aproximadamente cada cien metros en varias ciudades, así como puntos de control de reconocimiento facial en áreas como gasolineras, centros comerciales y entradas a mezquitas. [106] [107] En mayo de 2019, Human Rights Watch informó haber encontrado el código Face++ en la Plataforma de Operaciones Conjuntas Integradas (IJOP), una aplicación de vigilancia policial utilizada para recopilar datos y rastrear a la comunidad uigur en Xinjiang . [108] Human Rights Watch publicó una corrección a su informe en junio de 2019 afirmando que la empresa china Megvii no parecía haber colaborado en IJOP y que el código Face++ de la aplicación no funcionaba. [109] En febrero de 2020, tras el brote de coronavirus , Megvii solicitó un préstamo bancario para optimizar el sistema de detección de temperatura corporal que había lanzado para ayudar a identificar a las personas con síntomas de una infección por coronavirus en multitudes. En la solicitud de préstamo, Megvii afirmó que necesitaba mejorar la precisión en la identificación de personas enmascaradas. [110]

Muchos lugares públicos en China cuentan con equipos de reconocimiento facial, incluidas estaciones de tren, aeropuertos, atracciones turísticas, exposiciones y edificios de oficinas. En octubre de 2019, un profesor de la Universidad de Ciencia y Tecnología de Zhejiang demandó al Hangzhou Safari Park por abusar de la información biométrica privada de los clientes. El parque safari utiliza tecnología de reconocimiento facial para verificar las identidades de los titulares de su Year Card. Se estima que 300 sitios turísticos en China han instalado sistemas de reconocimiento facial y los utilizan para admitir visitantes. Se informa que este caso es el primero sobre el uso de sistemas de reconocimiento facial en China. [111] En agosto de 2020, Radio Free Asia informó que en 2019 Geng Guanjun, un ciudadano de la ciudad de Taiyuan que había utilizado la aplicación WeChat de Tencent para reenviar un vídeo a un amigo en los Estados Unidos, fue posteriormente condenado por el cargo del delito. "buscar peleas y provocar problemas". Los documentos del Tribunal mostraron que la policía china utilizó un sistema de reconocimiento facial para identificar a Geng Guanjun como un "activista democrático en el extranjero" y que los departamentos de gestión de redes y propaganda de China monitorean directamente a los usuarios de WeChat. [112]

En 2019, manifestantes en Hong Kong destruyeron farolas inteligentes por temor a que pudieran contener cámaras y sistemas de reconocimiento facial utilizados para vigilancia por las autoridades chinas. [113] Grupos de derechos humanos han criticado al gobierno chino por utilizar tecnología de reconocimiento facial de inteligencia artificial en su represión contra uigures, [114] cristianos [115] y practicantes de Falun Gong. [116] [117]

Aunque la tecnología de reconocimiento facial (FRT) no es totalmente precisa, [118] la policía de la India la utiliza cada vez más con fines de identificación. Los sistemas FRT generan una puntuación de probabilidad de coincidencia, o una puntuación de confianza, entre el sospechoso que se va a identificar y la base de datos de delincuentes identificados que está disponible en la policía. El Sistema Nacional Automatizado de Reconocimiento Facial (AFRS) [119] ya está siendo desarrollado por la Oficina Nacional de Registros Criminales (NCRB), un organismo constituido bajo el Ministerio del Interior. El proyecto busca desarrollar e implementar una base de datos nacional de fotografías que se adaptaría a un sistema de tecnología de reconocimiento facial por parte de las agencias de seguridad centrales y estatales. La Internet Freedom Foundation ha manifestado su preocupación con respecto al proyecto. [120] La ONG ha destacado que la precisión de los sistemas FRT es "habitualmente exagerada y las cifras reales dejan mucho que desear. [120] La implementación de sistemas FRT tan defectuosos conduciría a altas tasas de falsos positivos y falsos negativos en este proceso de reconocimiento."

Según la decisión de la Corte Suprema de la India en el caso Justice KS Puttaswamy vs Union of India (22017 10 SCC 1), cualquier intrusión justificable por parte del Estado en el derecho de las personas a la privacidad, que está protegido como un derecho fundamental en virtud del artículo 21 de la Constitución, debe confirmar a ciertos umbrales, a saber: legalidad, necesidad, proporcionalidad y garantías procesales. [121] Según la Internet Freedom Foundation, la propuesta del Sistema Nacional Automatizado de Reconocimiento Facial (AFRS) no cumple con ninguno de estos umbrales, citando "ausencia de legalidad", "arbitrariedad manifiesta" y "ausencia de salvaguardias y responsabilidad". [122]

Si bien el proyecto AFRS a nivel nacional todavía está en proceso, los departamentos de policía de varios estados de la India ya están implementando sistemas de tecnología de reconocimiento facial, como: TSCOP + CCTNS en Telangana, [123] Punjab Artificial Intelligence System (PAIS) en Punjab, [ 124] Trinetra en Uttar Pradesh, [125] Sistema de Inteligencia Artificial de la Policía en Uttarakhand, [126] AFRS en Delhi, Sistema Automatizado de Identificación Biométrica Multimodal (AMBIS) en Maharashtra, FaceTagr en Tamil Nadu. La Red y Sistemas de Seguimiento de Delincuencia y Delincuencia (CCTNS), que es un proyecto en modo misión en el marco del Plan Nacional de Gobernanza Electrónica (NeGP), [127] se considera un sistema que conectaría las comisarías de policía de toda la India y les ayudaría a "hablar " [128] entre sí. El objetivo del proyecto es digitalizar toda la información relacionada con las FIR, incluidas las FIR registradas, así como los casos investigados, las hojas de cargos presentadas y los sospechosos y buscados en todas las comisarías. Esto constituirá una base de datos nacional sobre delitos y delincuentes en la India. CCTNS se está implementando sin una ley de protección de datos vigente. Se propone que CCTNS se integre con el AFRS, un depósito de todos los datos faciales relacionados con delitos y delitos que se pueden implementar para supuestamente identificar o verificar a una persona a partir de una variedad de entradas que van desde imágenes hasta videos. [129] Esto ha generado preocupaciones sobre la privacidad por parte de organizaciones de la sociedad civil y expertos en privacidad. Ambos proyectos han sido censurados como instrumentos de " vigilancia masiva " por parte del Estado. [130] En Rajasthan, 'RajCop', una aplicación policial se ha integrado recientemente con un módulo de reconocimiento facial que puede comparar el rostro de un sospechoso con una base de datos de personas conocidas en tiempo real. La policía de Rajasthan está trabajando actualmente para ampliar el alcance de este módulo haciendo obligatorio cargar fotografías de todas las personas arrestadas en la base de datos CCTNS, lo que "ayudará a desarrollar una rica base de datos de delincuentes conocidos". [131]

La policía de Rajasthan ha diseñado y utilizado cascos con cámara en situaciones de orden público para capturar la acción policial y las actividades de "los malhechores, que luego pueden servir como prueba durante la investigación de tales casos". [131] La aplicación PAIS (Sistema de Inteligencia Artificial de Punjab) emplea aprendizaje profundo, aprendizaje automático y reconocimiento facial para la identificación de delincuentes y ayudar al personal policial. [131] El estado de Telangana ha instalado 8 lakh de cámaras CCTV, [131] y su ciudad capital, Hyderabad, se está convirtiendo lentamente en una capital de vigilancia. [132]

Un falso positivo ocurre cuando la tecnología de reconocimiento facial identifica erróneamente a una persona como alguien que no es, es decir, arroja un resultado positivo incorrecto. A menudo resultan en discriminación y fortalecimiento de prejuicios existentes. Por ejemplo, en 2018, la policía de Delhi informó que su sistema FRT tenía una tasa de precisión del 2 %, que se redujo al 1 % en 2019. El sistema FRT ni siquiera logró distinguir con precisión entre diferentes sexos. [133]

El gobierno de Delhi, en colaboración con la Organización de Investigación Espacial de la India (ISRO), está desarrollando una nueva tecnología llamada Crime Mapping Analytics and Predictive System (CMAPS). El proyecto tiene como objetivo desplegar tecnología espacial para "controlar el crimen y mantener la ley y el orden". [131] El sistema estará conectado a una base de datos que contiene datos de delincuentes. [131] Está previsto implementar la tecnología para recopilar datos en tiempo real en la escena del crimen. [131]

En una respuesta de fecha 25 de noviembre de 2020 a una solicitud de Derecho a la Información presentada por la Internet Freedom Foundation en busca de información sobre el sistema de reconocimiento facial utilizado por la Policía de Delhi (con número de referencia DEPOL/R/E/20/07128), [134 ] la Oficina del Comisionado Adjunto de Policía y Oficial de Información Pública: Crime declaró que no pueden proporcionar la información prevista en la sección 8(d) de la Ley de Derecho a la Información de 2005. [135] Una solicitud de Derecho a la Información (RTI) de fecha de julio El 30 de enero de 2020 se presentó ante la Oficina del Comisionado de la Policía de Kolkata, en busca de información sobre la tecnología de reconocimiento facial que estaba utilizando el departamento. [136] La información solicitada fue denegada [137] afirmando que el departamento estaba exento de divulgación en virtud del artículo 24(4) de la Ley RTI.

En las elecciones presidenciales mexicanas de 2000 , el gobierno mexicano empleó software de reconocimiento facial para prevenir el fraude electoral . Algunas personas se habían registrado para votar con varios nombres diferentes, en un intento de realizar votos múltiples. Al comparar las nuevas imágenes de rostros con las que ya estaban en la base de datos de votantes, las autoridades pudieron reducir los registros duplicados. [138]

En Colombia los autobuses del transporte público están equipados con un sistema de reconocimiento facial de FaceFirst Inc para identificar a los pasajeros que son buscados por la Policía Nacional de Colombia . FaceFirst Inc también construyó el sistema de reconocimiento facial para el Aeropuerto Internacional de Tocumen en Panamá. El sistema de reconocimiento facial se despliega para identificar individuos entre los viajeros buscados por la Policía Nacional de Panamá o Interpol . [139] El Aeropuerto Internacional de Tocumen opera un sistema de vigilancia en todo el aeropuerto que utiliza cientos de cámaras de reconocimiento facial en vivo para identificar a las personas buscadas que pasan por el aeropuerto. El sistema de reconocimiento facial se instaló inicialmente como parte de un contrato de 11 millones de dólares e incluía un grupo informático de sesenta ordenadores, una red de cable de fibra óptica para los edificios del aeropuerto, así como la instalación de 150 cámaras de vigilancia en la terminal del aeropuerto y en alrededor de 30 puertas de aeropuerto . [140]

En la Copa Mundial de la FIFA Brasil 2014, la Policía Federal de Brasil utilizó gafas de reconocimiento facial . En los Juegos Olímpicos de Verano de 2016 en Río de Janeiro también se implementaron sistemas de reconocimiento facial "fabricados en China" . [139] La empresa Nuctech proporcionó 145 terminales de inspección para el Estadio Maracaná y 55 terminales para el Parque Olímpico de Deodoro . [141]

Las fuerzas policiales de al menos 21 países de la Unión Europea utilizan, o planean utilizar, sistemas de reconocimiento facial, ya sea con fines administrativos o penales. [142]

La policía griega firmó un contrato con Intracom-Telecom para el suministro de al menos 1.000 dispositivos equipados con un sistema de reconocimiento facial en vivo. La entrega se espera antes del verano de 2021. El valor total del contrato supera los 4 millones de euros, financiados en gran parte por el Fondo de Seguridad Interior de la Comisión Europea . [143]

La policía italiana adquirió un sistema de reconocimiento facial en 2017, el Sistema Automatico Riconoscimento Immagini (SARI). En noviembre de 2020, el Ministerio del Interior anunció planes para utilizarlo en tiempo real para identificar a personas sospechosas de solicitar asilo. [144]

Los Países Bajos han implementado tecnología de reconocimiento facial e inteligencia artificial desde 2016. [145] La base de datos de la policía holandesa contiene actualmente más de 2,2 millones de fotografías de 1,3 millones de ciudadanos holandeses. Esto representa alrededor del 8% de la población. En los Países Bajos, la policía no utiliza el reconocimiento facial en las cámaras CCTV municipales. [146]

En Sudáfrica, en 2016, la ciudad de Johannesburgo anunció que estaba implementando cámaras CCTV inteligentes con reconocimiento automático de matrículas y reconocimiento facial. [147]

La empresa estadounidense 3VR, ahora Identiv, es un ejemplo de proveedor que comenzó a ofrecer sistemas y servicios de reconocimiento facial a minoristas ya en 2007. [148] En 2012, la empresa anunció beneficios tales como "análisis de permanencia y colas para disminuir el número de clientes". tiempos de espera", "análisis de vigilancia facial para facilitar saludos personalizados a los clientes por parte de los empleados " y la capacidad de "[c]rear programas de fidelización combinando datos del punto de venta (POS) con reconocimiento facial". [149]

En 2018, el Consejo de Investigación de Prevención de Pérdidas de la Federación Nacional de Minoristas calificó la tecnología de reconocimiento facial como "una nueva herramienta prometedora" que vale la pena evaluar. [150]

En julio de 2020, la agencia de noticias Reuters informó que durante la década de 2010 la cadena de farmacias Rite Aid había implementado sistemas y componentes de videovigilancia de reconocimiento facial de FaceFirst, DeepCam LLC y otros proveedores en algunas tiendas minoristas de Estados Unidos. [150] Cathy Langley, vicepresidenta de protección de activos de Rite Aid, usó la frase "coincidencia de características" para referirse a los sistemas y dijo que el uso de los sistemas resultó en menos violencia y crimen organizado en las tiendas de la compañía, mientras que el ex vicepresidente de protección de activos Bob Oberosler enfatizó una mayor seguridad para el personal y una menor necesidad de participación de las organizaciones encargadas de hacer cumplir la ley . [150] En una declaración de 2020 a Reuters en respuesta al informe, Rite Aid dijo que había dejado de usar el software de reconocimiento facial y apagó las cámaras. [150]

Según el director Read Hayes del Consejo de Investigación de Prevención de Pérdidas de la Federación Nacional de Minoristas, el programa de vigilancia de Rite Aid fue el programa más grande o uno de los más grandes en el sector minorista. [150] The Home Depot , Menards , Walmart y 7-Eleven se encuentran entre otros minoristas estadounidenses que también participan en programas piloto a gran escala o implementaciones de tecnología de reconocimiento facial. [150]

De las tiendas Rite Aid examinadas por Reuters en 2020, aquellas en comunidades donde las personas de color constituían el grupo racial o étnico más grande tenían tres veces más probabilidades de tener la tecnología instalada, [150] lo que genera preocupaciones relacionadas con la importante historia de segregación racial. y perfilamiento racial en los Estados Unidos . Rite Aid dijo que la selección de ubicaciones se basó en "datos", basados en los historiales de robo de tiendas individuales, datos sobre delitos locales y nacionales y la infraestructura del sitio. [150]

En 2019, el reconocimiento facial para evitar robos se utilizó en el Star Casino de Sydney y también se implementó en las salas de juego de Nueva Zelanda. [151]

En junio de 2022, el grupo de consumidores CHOICE informó que el reconocimiento facial se utilizaba en Australia en Kmart, Bunnings y The Good Guys. Posteriormente, los Good Guys suspendieron la tecnología en espera de una impugnación legal por parte de CHOICE ante la Oficina del Comisionado de Información de Australia, mientras que Bunnings mantuvo la tecnología en uso y Kmart mantuvo su prueba de la tecnología. [152]

En el partido de campeonato de fútbol americano Super Bowl XXXV en enero de 2001, la policía de Tampa Bay, Florida, utilizó el software de reconocimiento facial Viisage para buscar posibles delincuentes y terroristas que asistieran al evento. Se identificaron potencialmente 19 personas con antecedentes penales menores. [153] [154]

Los sistemas de reconocimiento facial también han sido utilizados por el software de gestión de fotografías para identificar a los sujetos de las fotografías, permitiendo funciones como buscar imágenes por persona, así como sugerir fotografías para compartir con un contacto específico si se detecta su presencia en una foto. [155] [156] En 2008, los sistemas de reconocimiento facial se utilizaban habitualmente como control de acceso en los sistemas de seguridad . [157]

La celebridad de la música popular y country de Estados Unidos, Taylor Swift, empleó subrepticiamente tecnología de reconocimiento facial en un concierto en 2018. La cámara estaba incrustada en un quiosco cerca de una taquilla y escaneaba a los asistentes al concierto cuando ingresaban a las instalaciones en busca de acosadores conocidos . [158]

El 18 de agosto de 2019, The Times informó que el Manchester City , propiedad de los Emiratos Árabes Unidos, contrató a una empresa con sede en Texas, Blink Identity, para implementar sistemas de reconocimiento facial en un programa de conductores. El club ha previsto una única vía ultrarrápida para los aficionados en el estadio Etihad . [159] Sin embargo, grupos de derechos civiles advirtieron al club contra la introducción de esta tecnología, diciendo que correría el riesgo de "normalizar una herramienta de vigilancia masiva". La responsable de políticas y campañas de Liberty , Hannah Couchman, dijo que la medida del Manchester City es alarmante, ya que los aficionados se verán obligados a compartir información personal muy sensible con una empresa privada, donde podrán ser rastreados y monitoreados en su vida cotidiana. [160]

En 2019, los casinos de Australia y Nueva Zelanda implementaron el reconocimiento facial para evitar robos, y un representante del Star Casino de Sydney dijo que también brindarían "servicio al cliente", como darle la bienvenida a un cliente a un bar. [151]

En agosto de 2020, en medio de la pandemia de COVID-19 en Estados Unidos , los estadios de fútbol americano de Nueva York y Los Ángeles anunciaron la instalación del reconocimiento facial para los próximos partidos. El objetivo es hacer que el proceso de entrada sea lo más sencillo posible. [161] Disney's Magic Kingdom , cerca de Orlando, Florida , también anunció una prueba de tecnología de reconocimiento facial para crear una experiencia sin contacto durante la pandemia; La prueba estaba originalmente programada para realizarse entre el 23 de marzo y el 23 de abril de 2021, pero el plazo limitado se eliminó a fines de abril de 2021. [162][actualizar]

Las empresas de medios han comenzado a utilizar tecnología de reconocimiento facial para optimizar su seguimiento, organización y archivo de imágenes y vídeos. [163]

En 2006, el rendimiento de los últimos algoritmos de reconocimiento facial se evaluó en el Face Recognition Grand Challenge (FRGC) . En las pruebas se utilizaron imágenes faciales de alta resolución, escaneos faciales en 3D e imágenes del iris. Los resultados indicaron que los nuevos algoritmos son 10 veces más precisos que los algoritmos de reconocimiento facial de 2002 y 100 veces más precisos que los de 1995. Algunos de los algoritmos pudieron superar a los participantes humanos en el reconocimiento de rostros y pudieron identificar de forma única a gemelos idénticos. [45] [164]

Una ventaja clave de un sistema de reconocimiento facial es que puede realizar una identificación masiva, ya que no requiere la cooperación del sujeto de prueba para funcionar. Los sistemas correctamente diseñados instalados en aeropuertos, multicines y otros lugares públicos pueden identificar personas entre la multitud, sin que los transeúntes se den cuenta del sistema. [165] Sin embargo, en comparación con otras técnicas biométricas, el reconocimiento facial puede no ser el más confiable y eficiente. Las medidas de calidad son muy importantes en los sistemas de reconocimiento facial, ya que son posibles grandes grados de variaciones en las imágenes de los rostros. Factores como la iluminación, la expresión, la pose y el ruido durante la captura de rostros pueden afectar el rendimiento de los sistemas de reconocimiento facial. [165] Entre todos los sistemas biométricos, el reconocimiento facial tiene las tasas más altas de falsa aceptación y rechazo, [165] por lo que se han planteado dudas sobre la efectividad o el sesgo del software de reconocimiento facial en casos de seguridad ferroviaria y aeroportuaria, aplicación de la ley y vivienda y decisiones laborales. [166] [5]

Ralph Gross, investigador del Instituto de Robótica Carnegie Mellon en 2008, describe un obstáculo relacionado con el ángulo de visión de la cara: "El reconocimiento facial se ha vuelto bastante bueno en caras completamente frontales y con 20 grados de distancia, pero tan pronto como te acercas perfil, ha habido problemas." [45] Además de las variaciones de pose, las imágenes faciales de baja resolución también son muy difíciles de reconocer. Este es uno de los principales obstáculos del reconocimiento facial en los sistemas de vigilancia. [167] También se ha sugerido que la configuración de la cámara puede favorecer imágenes más nítidas de piel blanca que de otros tonos de piel. [5]

El reconocimiento facial es menos efectivo si las expresiones faciales varían. Una gran sonrisa puede hacer que el sistema sea menos eficaz. Por ejemplo: Canadá, en 2009, permitió sólo expresiones faciales neutrales en las fotografías de pasaporte. [168]

También hay inconstancia en los conjuntos de datos utilizados por los investigadores. Los investigadores pueden utilizar desde varios sujetos hasta decenas de sujetos y desde unos cientos de imágenes hasta miles de imágenes. Los conjuntos de datos pueden ser diversos e inclusivos o contener principalmente imágenes de hombres blancos. Es importante que los investigadores pongan a disposición de los demás los conjuntos de datos que utilizaron, o que tengan al menos un conjunto de datos estándar o representativo. [169]

Aunque se han afirmado altos grados de precisión para algunos sistemas de reconocimiento facial, estos resultados no son universales. La tasa de precisión consistentemente peor es para aquellos que tienen entre 18 y 30 años, negros y mujeres. [5]

Los sistemas de reconocimiento facial han sido criticados por defender y juzgar basándose en suposiciones sobre las personas de color [170] y también en una suposición binaria de género . [171] [172] [173] [174] [175] [176] [177] [178] [179] Al clasificar los rostros de individuos cisgénero en masculinos o femeninos, estos sistemas suelen ser bastante precisos, [171] sin embargo Por lo general, estaban confundidos o no podían determinar la identidad de género de las personas transgénero y no binarias . [171] Estos sistemas mantienen las normas de género , hasta tal punto que incluso cuando se les mostró una foto de un hombre cisgénero con cabello largo, los algoritmos se dividieron entre seguir la norma de género de los hombres con cabello corto y los rasgos faciales masculinos y se convirtieron en confundido. [171] [179] Esta confusión accidental de personas puede ser muy perjudicial para quienes no se identifican con el sexo asignado al nacer , al ignorar e invalidar su identidad de género. Esto también es perjudicial para las personas que no se adhieren a las normas de género tradicionales, porque invalida su expresión de género , independientemente de su identidad de género .

Los críticos de la tecnología se quejan de que el plan del distrito londinense de Newham , hasta 2004, [actualizar]nunca ha reconocido a un solo delincuente, a pesar de que varios delincuentes en la base de datos del sistema viven en el distrito y el sistema ha estado funcionando durante varios años. "Hasta donde la policía sabe, ni una sola vez el sistema automático de reconocimiento facial de Newham ha detectado un objetivo vivo". [154] [180] Esta información parece entrar en conflicto con las afirmaciones de que al sistema se le atribuyó una reducción del 34% en la delincuencia (de ahí que se implementara también en Birmingham). [181]

Un experimento realizado en 2002 por el departamento de policía local de Tampa , Florida, tuvo resultados igualmente decepcionantes. [154] Un sistema en el aeropuerto Logan de Boston se cerró en 2003 después de no lograr ninguna coincidencia durante un período de prueba de dos años. [182]

En 2014, Facebook declaró que en una prueba estandarizada de reconocimiento facial de dos opciones, su sistema en línea obtuvo una precisión del 97,25%, en comparación con el punto de referencia humano del 97,5%. [183]

A menudo se anuncia que los sistemas tienen una precisión cercana al 100%; esto es engañoso ya que los resultados no son universales [5] Los estudios a menudo utilizan muestras que son más pequeñas y menos diversas de lo que sería necesario para aplicaciones a gran escala. Debido a que el reconocimiento facial no es completamente preciso, crea una lista de posibles coincidencias. Luego, un operador humano debe examinar estas posibles coincidencias y los estudios muestran que los operadores seleccionan la coincidencia correcta de la lista sólo aproximadamente la mitad de las veces. Esto provoca el problema de apuntar al sospechoso equivocado. [92] [184]

Organizaciones de derechos civiles y defensores de la privacidad como Electronic Frontier Foundation , Big Brother Watch y ACLU expresan su preocupación de que la privacidad se esté viendo comprometida por el uso de tecnologías de vigilancia . [185] [86] [186] El reconocimiento facial se puede utilizar no solo para identificar a un individuo, sino también para descubrir otros datos personales asociados con un individuo, como otras fotografías que muestran al individuo, publicaciones de blogs, perfiles de redes sociales y comportamiento en Internet. y patrones de viaje. [187] Se han planteado preocupaciones sobre quién tendría acceso al conocimiento del paradero de una persona y de las personas que la acompañan en un momento dado. [188] Además, las personas tienen una capacidad limitada para evitar o frustrar el seguimiento del reconocimiento facial a menos que oculten sus rostros. Esto cambia fundamentalmente la dinámica de la privacidad diaria al permitir que cualquier especialista en marketing, agencia gubernamental o extraño al azar recopile en secreto las identidades y la información personal asociada de cualquier individuo capturado por el sistema de reconocimiento facial. [187] Es posible que los consumidores no comprendan o no sepan para qué se utilizan sus datos, lo que les niega la posibilidad de dar su consentimiento sobre cómo se comparte su información personal. [188]

En julio de 2015, la Oficina de Responsabilidad Gubernamental de los Estados Unidos realizó un informe para el miembro de mayor rango, Subcomité de Privacidad, Tecnología y Derecho, Comité del Poder Judicial, Senado de los Estados Unidos. El informe analiza los usos comerciales de la tecnología de reconocimiento facial, las cuestiones de privacidad y la ley federal aplicable. Afirma que anteriormente se discutieron cuestiones relacionadas con la tecnología de reconocimiento facial y representan la necesidad de actualizar las leyes de privacidad de los Estados Unidos para que la ley federal esté continuamente a la altura del impacto de las tecnologías avanzadas. El informe señaló que algunas organizaciones industriales, gubernamentales y privadas estaban en proceso de desarrollar, o han desarrollado, "directrices voluntarias de privacidad". Estas directrices variaron entre las partes interesadas , pero su objetivo general era obtener el consentimiento e informar a los ciudadanos sobre el uso previsto de la tecnología de reconocimiento facial. Según el informe, las directrices voluntarias sobre privacidad ayudaron a contrarrestar los problemas de privacidad que surgen cuando los ciudadanos desconocen cómo se utilizan sus datos personales. [188]

En 2016, la empresa rusa NtechLab provocó un escándalo de privacidad en los medios internacionales cuando lanzó el sistema de reconocimiento facial FindFace con la promesa de que los usuarios rusos podrían tomar fotografías de extraños en la calle y vincularlas a un perfil de la red social Vkontakte. (VK). [189] En diciembre de 2017, Facebook lanzó una nueva función que notifica a un usuario cuando alguien sube una foto que incluye lo que Facebook cree que es su cara, incluso si no está etiquetado. Facebook ha intentado enmarcar la nueva funcionalidad desde una perspectiva positiva, en medio de reacciones negativas anteriores. [190] El jefe de privacidad de Facebook, Rob Sherman, abordó esta nueva característica como una que brinda a las personas más control sobre sus fotos en línea. "Hemos pensado en esto como una característica realmente empoderadora", dice. "Puede que existan fotos que no conoces". [191] DeepFace de Facebook se ha convertido en objeto de varias demandas colectivas en virtud de la Ley de Privacidad de la Información Biométrica, con reclamaciones que alegan que Facebook está recopilando y almacenando datos de reconocimiento facial de sus usuarios sin obtener el consentimiento informado, en violación directa de la Ley de Privacidad de la Información Biométrica de 2008. Ley (BIPA). [192] El caso más reciente fue desestimado en enero de 2016 porque el tribunal carecía de competencia. [193] En los EE. UU., empresas de vigilancia como Clearview AI se basan en la Primera Enmienda de la Constitución de los Estados Unidos para extraer datos de cuentas de usuarios en plataformas de redes sociales en busca de datos que puedan usarse en el desarrollo de sistemas de reconocimiento facial. [194]

En 2019, el Financial Times informó por primera vez que se estaba utilizando software de reconocimiento facial en el área de King's Cross de Londres. [195] El desarrollo alrededor de la estación principal de King's Cross de Londres incluye tiendas, oficinas, la sede de Google en el Reino Unido y parte del St Martin's College. Según la Oficina del Comisionado de Información del Reino Unido : "Escanear los rostros de las personas mientras realizan legalmente su vida diaria, para identificarlas, es una amenaza potencial a la privacidad que debería preocuparnos a todos". [196] [197] La comisionada de Información del Reino Unido, Elizabeth Denham, inició una investigación sobre el uso del sistema de reconocimiento facial King's Cross, operado por la empresa Argent. En septiembre de 2019, Argent anunció que el software de reconocimiento facial ya no se utilizaría en King's Cross . Argent afirmó que el software se había implementado entre mayo de 2016 y marzo de 2018 en dos cámaras que cubrían una calle peatonal que atraviesa el centro del desarrollo. [198] En octubre de 2019, un informe de la vicealcaldesa de Londres, Sophie Linden, reveló que en un acuerdo secreto la Policía Metropolitana había pasado fotografías de siete personas a Argent para usarlas en su sistema de reconocimiento facial King's Cross. [199]

La policía de Gales del Sur probó el reconocimiento facial automatizado en múltiples ocasiones entre 2017 y 2019. El uso de la tecnología fue impugnado ante los tribunales por un particular, Edward Bridges, con el apoyo de la organización benéfica Liberty (caso conocido como R (Bridges) v Jefe de policía de la policía de Gales del Sur). El caso fue visto en el Tribunal de Apelaciones y se dictó sentencia en agosto de 2020. [200] El caso argumentó que el uso del Reconocimiento Facial era una violación de la privacidad sobre la base de que no había suficiente marco legal ni proporcionalidad en el uso del Reconocimiento Facial. Reconocimiento y que su uso violaba las Leyes de Protección de Datos de 1998 y 2018 . El caso se decidió a favor de Bridges y no se otorgó indemnización por daños y perjuicios. El caso se resolvió mediante una declaración de irregularidad. [200] En respuesta al caso, el gobierno británico ha intentado repetidamente aprobar un proyecto de ley que regule el uso del reconocimiento facial en espacios públicos. Los proyectos de ley propuestos han intentado nombrar un Comisionado con la capacidad de regular el uso del reconocimiento facial por parte de los servicios gubernamentales de manera similar al Comisionado de CCTV . Dicho proyecto de ley aún no ha entrado en vigor [correcto en septiembre de 2021 [actualizar]]. [124]

En enero de 2023, la fiscal general de Nueva York, Letitia James, solicitó más información sobre el uso de la tecnología de reconocimiento facial del Madison Square Garden Entertainment tras informes de que la firma la utilizó para impedir que los abogados involucrados en litigios contra la empresa ingresaran al Madison Square Garden . Señaló que tal medida podría ir en contra de las leyes de derechos humanos federales, estatales y locales. [201]

A partir de 2018, [actualizar]todavía se discute si la tecnología de reconocimiento facial funciona con menos precisión en personas de color. [202] Un estudio realizado por Joy Buolamwini (MIT Media Lab) y Timnit Gebru (Microsoft Research) encontró que la tasa de error para el reconocimiento de género para mujeres de color dentro de tres sistemas comerciales de reconocimiento facial oscilaba entre 23,8% y 36%, mientras que para mujeres de color más claro. en los hombres desollados estuvo entre 0,0 y 1,6%. Las tasas generales de precisión para identificar a los hombres (91,9%) fueron más altas que las de las mujeres (79,4%), y ninguno de los sistemas se adaptaba a una comprensión no binaria del género. [203] También demostró que los conjuntos de datos utilizados para entrenar modelos comerciales de reconocimiento facial no eran representativos de la población en general y estaban sesgados hacia los hombres de piel más clara. Sin embargo, otro estudio demostró que varios software comerciales de reconocimiento facial vendidos a oficinas de aplicación de la ley en todo el país tenían una tasa de falsas no coincidencias más baja para los negros que para los blancos. [204]

Los expertos temen que los sistemas de reconocimiento facial en realidad puedan estar perjudicando a los ciudadanos que la policía afirma que están tratando de proteger. [205] Se considera una biométrica imperfecta, y en un estudio realizado por la investigadora de la Universidad de Georgetown, Clare Garvie, concluyó que "no hay consenso en la comunidad científica de que proporcione una identificación positiva de alguien". [206] Se cree que con márgenes de error tan grandes en esta tecnología, tanto los defensores legales como las compañías de software de reconocimiento facial dicen que la tecnología solo debería proporcionar una parte del caso, sin evidencia que pueda conducir al arresto de un individuo. [206] La falta de regulaciones que exijan a las empresas de tecnología de reconocimiento facial cumplir con los requisitos de pruebas con prejuicios raciales puede ser un defecto importante en la adopción del uso en la aplicación de la ley. CyberExtruder, una empresa que se comercializa entre las fuerzas del orden, dijo que no habían realizado pruebas ni investigaciones sobre sesgos en su software. CyberExtruder notó que algunos colores de piel son más difíciles de reconocer para el software debido a las limitaciones actuales de la tecnología. "Así como las personas con piel muy oscura son difíciles de identificar con gran significado mediante el reconocimiento facial, las personas con piel muy pálida son iguales", dijo Blake Senftner, ingeniero de software senior en CyberExtruder. [206]

El Instituto Nacional de Estándares y Tecnología (NIST) de los Estados Unidos llevó a cabo pruebas exhaustivas de la verificación 1:1 del sistema FRT [207] y de la identificación 1:muchos. [207] También probó la diferente precisión de FRT en diferentes grupos demográficos. El estudio independiente concluyó que actualmente ningún sistema FRT tiene una precisión del 100%. [208]

En 2010, Perú aprobó la Ley de Protección de Datos Personales, que define la información biométrica que puede usarse para identificar a un individuo como datos sensibles. En 2012, Colombia aprobó una Ley de Protección de Datos integral que define los datos biométricos como información sensible. [139] De acuerdo con el artículo 9(1) del Reglamento General de Protección de Datos (GDPR) de la UE de 2016 , el procesamiento de datos biométricos con el propósito de "identificar de manera única a una persona física" es sensible y los datos de reconocimiento facial procesados de esta manera se vuelven sensibles. información personal. En respuesta a la incorporación del RGPD a la legislación de los estados miembros de la UE , los investigadores de la UE expresaron su preocupación de que si el RGPD les exigiera obtener el consentimiento individual para el procesamiento de sus datos de reconocimiento facial, una base de datos de rostros de la escala de MegaFace nunca podría ser establecido nuevamente. [209] En septiembre de 2019, la Autoridad Sueca de Protección de Datos (DPA) emitió su primera sanción financiera por una violación del Reglamento General de Protección de Datos (GDPR) de la UE contra una escuela que estaba utilizando la tecnología para reemplazar los lentos pases de lista durante las clases. . La DPA descubrió que la escuela obtuvo ilegalmente los datos biométricos de sus estudiantes sin completar una evaluación de impacto. Además, la escuela no informó a la DPA sobre el plan piloto. Se impuso una multa de 200.000 coronas suecas (19.000 euros/21.000 dólares). [ cita necesaria ]

En los Estados Unidos de América, varios estados de EE. UU. han aprobado leyes para proteger la privacidad de los datos biométricos. Los ejemplos incluyen la Ley de Privacidad de la Información Biométrica de Illinois (BIPA) y la Ley de Privacidad del Consumidor de California (CCPA). [210] En marzo de 2020, los residentes de California presentaron una demanda colectiva contra Clearview AI , alegando que la empresa había recopilado ilegalmente datos biométricos en línea y, con la ayuda de la tecnología de reconocimiento facial, había creado una base de datos de datos biométricos que se vendía a empresas y fuerzas policiales. En ese momento, Clearview AI ya enfrentaba dos demandas en virtud de BIPA [211] y una investigación por parte del Comisionado de Privacidad de Canadá por el cumplimiento de la Ley de Protección de Información Personal y Documentos Electrónicos (PIPEDA). [212]

En mayo de 2019, San Francisco, California, se convirtió en la primera ciudad importante de Estados Unidos en prohibir el uso de software de reconocimiento facial por parte de la policía y otras agencias gubernamentales locales. [213] El supervisor de San Francisco, Aaron Peskin , introdujo regulaciones que requerirán que las agencias obtengan la aprobación de la Junta de Supervisores de San Francisco para comprar tecnología de vigilancia . [214] Las regulaciones también exigen que las agencias divulguen públicamente el uso previsto de la nueva tecnología de vigilancia. [214] En junio de 2019, Somerville , Massachusetts, se convirtió en la primera ciudad de la costa este en prohibir el software de vigilancia facial para uso gubernamental, [215] específicamente en investigaciones policiales y vigilancia municipal. [216] En julio de 2019, Oakland, California, prohibió el uso de tecnología de reconocimiento facial por parte de los departamentos de la ciudad. [217]

La Unión Americana de Libertades Civiles ("ACLU") ha hecho campaña en todo Estados Unidos por la transparencia en la tecnología de vigilancia [216] y ha apoyado la prohibición del software de reconocimiento facial tanto en San Francisco como en Somerville. La ACLU trabaja para desafiar el secreto y la vigilancia con esta tecnología. [ cita necesaria ] [218]

Durante las protestas de George Floyd , el uso del reconocimiento facial por parte del gobierno municipal fue prohibido en Boston , Massachusetts. [219] A partir del 10 de junio de 2020, [actualizar]el uso municipal ha sido prohibido en: [11]

El Ayuntamiento de West Lafayette, Indiana, aprobó una ordenanza que prohíbe la tecnología de vigilancia por reconocimiento facial. [222]

El 27 de octubre de 2020, 22 grupos de derechos humanos pidieron a la Universidad de Miami que prohibiera la tecnología de reconocimiento facial. Esto se produjo después de que los estudiantes acusaran a la escuela de utilizar el software para identificar a los estudiantes manifestantes. Sin embargo, las acusaciones fueron desmentidas por la universidad. [223]

En julio de 2021 entrará en vigor una ley de reforma de la policía estatal en Massachusetts; una prohibición aprobada por la legislatura fue rechazada por el gobernador Charlie Baker . [224] En cambio, la ley exige una orden judicial, limitar el personal que puede realizar la búsqueda, registrar datos sobre cómo se utiliza la tecnología y crear una comisión para hacer recomendaciones sobre regulaciones futuras. [225]

Los informes de 2024 revelaron que algunos departamentos de policía, incluido el Departamento de Policía de San Francisco , habían eludido las prohibiciones de tecnología de reconocimiento facial que se habían promulgado en sus respectivas ciudades. [226]

En enero de 2020, la Unión Europea sugirió, pero luego rápidamente descartó, una propuesta de moratoria sobre el reconocimiento facial en espacios públicos. [227] [228]

La coalición europea " Reclaim Your Face " se lanzó en octubre de 2020. La coalición pide la prohibición del reconocimiento facial y lanzó una Iniciativa Ciudadana Europea en febrero de 2021. Más de 60 organizaciones piden a la Comisión Europea que regule estrictamente el uso de la vigilancia biométrica tecnologías. [229]

En los siglos XVIII y XIX, estaba muy extendida la creencia de que las expresiones faciales revelaban el valor moral o el verdadero estado interior de un ser humano y la fisonomía era una ciencia respetada en el mundo occidental. Desde principios del siglo XIX en adelante, la fotografía se utilizó en el análisis fisionómico de los rasgos faciales y la expresión facial para detectar locura y demencia . [230] En las décadas de 1960 y 1970, el estudio de las emociones humanas y sus expresiones fue reinventado por los psicólogos , que intentaron definir un rango normal de respuestas emocionales a los eventos. [231] La investigación sobre el reconocimiento automatizado de emociones se ha centrado desde la década de 1970 en las expresiones faciales y el habla , que se consideran las dos formas más importantes en las que los humanos comunican emociones a otros humanos. En la década de 1970 se estableció la categorización del Sistema de Codificación de Acción Facial (FACS) para la expresión física de las emociones. [232] Su desarrollador Paul Ekman sostiene que hay seis emociones que son universales para todos los seres humanos y que pueden codificarse en expresiones faciales. [233] La investigación sobre el reconocimiento automático de expresiones específicas de emociones se ha centrado en las últimas décadas en imágenes de vista frontal de rostros humanos. [234]