En teoría de probabilidad y estadística , el teorema de Bayes (alternativamente ley de Bayes o regla de Bayes ), llamado así en honor a Thomas Bayes , describe la probabilidad de un evento , basándose en el conocimiento previo de las condiciones que podrían estar relacionadas con el evento. [1] Por ejemplo, si se sabe que el riesgo de desarrollar problemas de salud aumenta con la edad, el teorema de Bayes permite evaluar con mayor precisión el riesgo para un individuo de una edad conocida condicionándolo en relación con su edad, en lugar de asumir que el individuo es típico de la población en su conjunto.

Una de las muchas aplicaciones del teorema de Bayes es la inferencia bayesiana , un enfoque particular de la inferencia estadística . Cuando se aplican, las probabilidades involucradas en el teorema pueden tener diferentes interpretaciones de probabilidad . Con la interpretación de probabilidad bayesiana , el teorema expresa cómo un grado de creencia, expresado como probabilidad, debería cambiar racionalmente para tener en cuenta la disponibilidad de evidencia relacionada. La inferencia bayesiana es fundamental para la estadística bayesiana . Se ha considerado que es "para la teoría de la probabilidad lo que el teorema de Pitágoras es para la geometría". [2]

Según la ley de Bayes, tanto la prevalencia de una enfermedad en una población determinada como la tasa de error de una prueba de enfermedades infecciosas deben tenerse en cuenta para evaluar correctamente el significado de un resultado positivo de la prueba y evitar la falacia de la tasa base .

El teorema de Bayes lleva el nombre del reverendo Thomas Bayes ( / b eɪ z / ), también estadístico y filósofo. Bayes utilizó la probabilidad condicional para proporcionar un algoritmo (su Proposición 9) que utiliza evidencia para calcular los límites de un parámetro desconocido. Su obra fue publicada en 1763 como Ensayo para resolver un problema en la doctrina de las posibilidades . Bayes estudió cómo calcular una distribución para el parámetro de probabilidad de una distribución binomial (en terminología moderna). A la muerte de Bayes, su familia transfirió sus documentos a un amigo, el ministro, filósofo y matemático Richard Price .

Durante dos años, Richard Price editó significativamente el manuscrito inédito, antes de enviárselo a un amigo que lo leyó en voz alta en la Royal Society el 23 de diciembre de 1763. [3] Price editó [4] La obra principal de Bayes, "Un ensayo para resolver un problema en la Doctrina de las Oportunidades" (1763), que apareció en Philosophical Transactions , [5] y contiene el teorema de Bayes. Price escribió una introducción al artículo que proporciona algunas de las bases filosóficas de la estadística bayesiana y eligió una de las dos soluciones ofrecidas por Bayes. En 1765, Price fue elegido miembro de la Royal Society en reconocimiento a su trabajo sobre el legado de Bayes. [6] [7] El 27 de abril, se leyó en la Royal Society y luego se publicó una carta enviada a su amigo Benjamín Franklin , en la que Price aplica este trabajo a la población y al cálculo de las 'rentas vitalicias'. [8]

Independientemente de Bayes, Pierre-Simon Laplace en 1774, y más tarde en su Théorie analytique des probabilités de 1812 , utilizó la probabilidad condicional para formular la relación entre una probabilidad posterior actualizada y una probabilidad anterior, dada la evidencia. Reprodujo y amplió los resultados de Bayes en 1774, aparentemente sin conocer el trabajo de Bayes. [nota 1] [9] La interpretación bayesiana de la probabilidad fue desarrollada principalmente por Laplace. [10]

Unos 200 años después, Sir Harold Jeffreys puso el algoritmo de Bayes y la formulación de Laplace sobre una base axiomática , escribiendo en un libro de 1973 que el teorema de Bayes "es para la teoría de la probabilidad lo que el teorema de Pitágoras es para la geometría". [2]

Stephen Stigler utilizó un argumento bayesiano para concluir que el teorema de Bayes fue descubierto por Nicholas Saunderson , un matemático inglés ciego, algún tiempo antes que Bayes; [11] [12] Sin embargo, esa interpretación ha sido cuestionada. [13] Martyn Hooper [14] y Sharon McGrayne [15] han argumentado que la contribución de Richard Price fue sustancial:

Según los estándares modernos, deberíamos referirnos a la regla de Bayes-Price. Price descubrió el trabajo de Bayes, reconoció su importancia, lo corrigió, contribuyó al artículo y le encontró un uso. La convención moderna de emplear únicamente el nombre de Bayes es injusta, pero está tan arraigada que cualquier otra cosa tiene poco sentido. [15]

El teorema de Bayes se expresa matemáticamente como la siguiente ecuación: [16]

donde y son eventos y .

El teorema de Bayes puede derivarse de la definición de probabilidad condicional :

donde es la probabilidad de que A y B sean verdaderos. Similarmente,

Resolviendo y sustituyendo en la expresión anterior se obtiene el teorema de Bayes:

Para dos variables aleatorias continuas X e Y , el teorema de Bayes puede derivarse de manera análoga de la definición de densidad condicional :

Por lo tanto,

Sea la distribución condicional de dado y sea la distribución de . La distribución conjunta es entonces . La distribución condicional de dado está entonces determinada por

La existencia y unicidad de la expectativa condicional necesaria es una consecuencia del teorema de Radon-Nikodym . Esto fue formulado por Kolmogorov en su famoso libro de 1933. Kolmogorov subraya la importancia de la probabilidad condicional escribiendo "Deseo llamar la atención sobre... y especialmente sobre la teoría de las probabilidades condicionales y las expectativas condicionales..." en el Prefacio. [17] El teorema de Bayes determina la distribución posterior a partir de la distribución anterior. El teorema de Bayes se puede generalizar para incluir distribuciones previas impropias, como la distribución uniforme en la recta real. [18] Los métodos modernos de Monte Carlo de la cadena de Markov han aumentado la importancia del teorema de Bayes, incluidos los casos con antecedentes inadecuados. [19]

La regla de Bayes y el cálculo de probabilidades condicionales proporcionan un método de solución para una serie de acertijos populares, como el problema de los tres prisioneros , el problema de Monty Hall , el problema de los dos niños y el problema de los dos sobres .

Supongamos que una prueba particular para determinar si alguien ha estado consumiendo cannabis tiene una sensibilidad del 90% , lo que significa que la tasa de verdaderos positivos (TPR) = 0,90. Por lo tanto, conduce a un 90% de resultados positivos verdaderos (identificación correcta del consumo de drogas) para los consumidores de cannabis.

La prueba también es 80% específica , lo que significa una tasa de verdaderos negativos (TNR) = 0,80. Por lo tanto, la prueba identifica correctamente el 80% de la falta de uso para los no usuarios, pero también genera un 20% de falsos positivos, o tasa de falsos positivos (FPR) = 0,20, para los no usuarios.

Suponiendo una prevalencia de 0,05 , es decir, el 5 % de las personas consumen cannabis, ¿cuál es la probabilidad de que una persona aleatoria que dé positivo sea realmente un consumidor de cannabis?

El valor predictivo positivo (VPP) de una prueba es la proporción de personas que realmente dan positivo entre todas las que dan positivo, y se puede calcular a partir de una muestra como:

Si se conocen la sensibilidad, la especificidad y la prevalencia, el VPP se puede calcular utilizando el teorema de Bayes. Significa "la probabilidad de que alguien sea un consumidor de cannabis dado que da positivo", que es lo que se entiende por PPV. Podemos escribir:

El hecho de que sea una aplicación directa de la Ley de Probabilidad Total . En este caso, dice que la probabilidad de que alguien dé positivo es la probabilidad de que un usuario dé positivo, multiplicada por la probabilidad de ser usuario, más la probabilidad de que un no usuario dé positivo, multiplicada por la probabilidad de ser no usuario. . Esto es cierto porque las clasificaciones de usuario y no usuario forman una partición de un conjunto , es decir, el conjunto de personas que se someten a la prueba de drogas. Esto, combinado con la definición de probabilidad condicional , da como resultado la afirmación anterior.

En otras palabras, incluso si alguien da positivo, la probabilidad de que sea un consumidor de cannabis es solo del 19%; esto se debe a que en este grupo, solo el 5% de las personas son consumidores, y la mayoría de los positivos son falsos positivos provenientes del 95% restante. .

Si se hicieran pruebas a 1.000 personas:

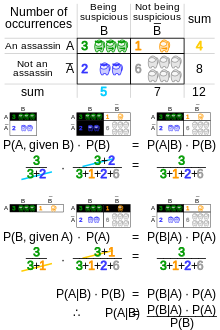

De este millar de personas se obtienen 235 resultados positivos, de los cuales sólo 45 son auténticos consumidores de drogas, alrededor del 19%. Consulte la Figura 1 para ver una ilustración que utiliza un cuadro de frecuencia y observe cuán pequeña es el área rosa de verdaderos positivos en comparación con el área azul de falsos positivos.

La importancia de la especificidad se puede ver al mostrar que incluso si la sensibilidad se eleva al 100% y la especificidad se mantiene en el 80%, la probabilidad de que alguien dé positivo sea realmente un consumidor de cannabis sólo aumenta del 19% al 21%, pero si la sensibilidad es Si se mantiene al 90% y la especificidad se aumenta al 95%, la probabilidad aumenta al 49%.

Incluso si el 100% de los pacientes con cáncer de páncreas tienen un determinado síntoma, cuando alguien tiene el mismo síntoma, no significa que esa persona tenga un 100% de posibilidades de padecer cáncer de páncreas. Suponiendo que la tasa de incidencia del cáncer de páncreas es de 1/100.000, mientras que 10/99.999 individuos sanos presentan los mismos síntomas en todo el mundo, la probabilidad de tener cáncer de páncreas dados los síntomas es sólo del 9,1%, y el otro 90,9% podrían ser "falsos positivos" ( es decir, decir falsamente que tiene cáncer; "positivo" es un término confuso cuando, como aquí, la prueba da malas noticias).

Según la tasa de incidencia, la siguiente tabla presenta las cifras correspondientes por cada 100.000 personas.

Que luego se puede utilizar para calcular la probabilidad de tener cáncer cuando se tienen los síntomas:

Una fábrica produce artículos utilizando tres máquinas (A, B y C) que representan el 20%, el 30% y el 50% de su producción, respectivamente. De los artículos producidos por la máquina A, el 5% son defectuosos; De manera similar, el 3% de los artículos de la máquina B y el 1% de los de la máquina C son defectuosos. Si un artículo seleccionado al azar es defectuoso, ¿cuál es la probabilidad de que haya sido producido por la máquina C?

Una vez más, se puede llegar a la respuesta sin utilizar la fórmula, aplicando las condiciones a un número hipotético de casos. Por ejemplo, si la fábrica produce 1000 artículos, la máquina A producirá 200, la máquina B 300 y la máquina C 500. La máquina A producirá 5% × 200 = 10 artículos defectuosos, la máquina B 3% × 300 = 9 , y Máquina C 1% × 500 = 5, para un total de 24. Por lo tanto, la probabilidad de que la máquina C produzca un artículo defectuoso seleccionado al azar es 5/24 (~20,83%).

Este problema también se puede resolver utilizando el teorema de Bayes: Sea X i el evento de que la i -ésima máquina haya creado un artículo elegido al azar (para i = A, B, C). Sea Y el evento de que un artículo elegido al azar sea defectuoso. Luego, se nos proporciona la siguiente información:

Si el artículo fue fabricado por la primera máquina, entonces la probabilidad de que esté defectuoso es 0,05; es decir, P ( Y | X A ) = 0,05. En general, tenemos

Para responder a la pregunta original, primero encontramos P (Y). Eso se puede hacer de la siguiente manera:

Por tanto, el 2,4% de la producción total es defectuosa.

Se nos da que Y ha ocurrido y queremos calcular la probabilidad condicional de X C. Según el teorema de Bayes,

Dado que el artículo es defectuoso, la probabilidad de que haya sido fabricado por la máquina C es 5/24. Aunque la máquina C produce la mitad de la producción total, produce una fracción mucho menor de los artículos defectuosos. Por lo tanto, saber que el artículo seleccionado era defectuoso nos permite reemplazar la probabilidad anterior P ( X C ) = 1/2 por la probabilidad posterior más pequeña P (X C | Y ) = 5/24.

La interpretación de la regla de Bayes depende de la interpretación de la probabilidad atribuida a los términos. Las dos interpretaciones predominantes se describen a continuación. La Figura 2 muestra una visualización geométrica.

En la interpretación bayesiana (o epistemológica) , la probabilidad mide un "grado de creencia". El teorema de Bayes vincula el grado de creencia en una proposición antes y después de dar cuenta de la evidencia. Por ejemplo, supongamos que se cree con un 50% de certeza que una moneda tiene el doble de probabilidades de salir cara que cruz. Si se lanza la moneda varias veces y se observan los resultados, ese grado de creencia probablemente aumentará o disminuirá, pero incluso podría permanecer igual, dependiendo de los resultados. Para la proposición A y la evidencia B ,

Para obtener más información sobre la aplicación del teorema de Bayes bajo la interpretación bayesiana de probabilidad, consulte Inferencia bayesiana .

En la interpretación frecuentista , la probabilidad mide una "proporción de resultados". Por ejemplo, supongamos que un experimento se realiza muchas veces. P ( A ) es la proporción de resultados con la propiedad A (la anterior) y P ( B ) es la proporción con la propiedad B . P ( B | A ) es la proporción de resultados con la propiedad B entre los resultados con la propiedad A , y P ( A | B ) es la proporción de aquellos con A entre aquellos con B (el posterior).

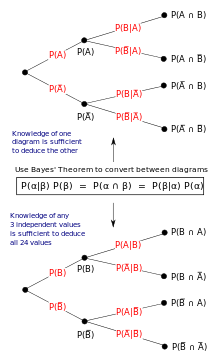

El papel del teorema de Bayes se visualiza mejor con diagramas de árbol como el de la Figura 3. Los dos diagramas dividen los mismos resultados entre A y B en órdenes opuestos, para obtener las probabilidades inversas. El teorema de Bayes vincula las diferentes particiones.

Un entomólogo detecta lo que, debido al patrón de su espalda, podría ser una rara subespecie de escarabajo . Un 98% de los miembros de la subespecie rara tienen el patrón, por lo que P (Patrón | Raro) = 98%. Sólo el 5% de los miembros de la subespecie común tienen el patrón. La rara subespecie representa el 0,1% de la población total. ¿Qué posibilidades hay de que el escarabajo que tiene el patrón sea raro? ¿Qué es P (Raro | Patrón)?

De la forma extendida del teorema de Bayes (dado que cualquier escarabajo es raro o común),

Para los eventos A y B , siempre que P ( B ) ≠ 0,

En muchas aplicaciones, por ejemplo en la inferencia bayesiana , el evento B está fijo en la discusión y deseamos considerar el impacto de haber sido observado en nuestra creencia en varios eventos posibles A. En tal situación, el denominador de la última expresión, la probabilidad de la evidencia dada B , es fijo; lo que queremos variar es A . El teorema de Bayes muestra entonces que las probabilidades posteriores son proporcionales al numerador, por lo que la última ecuación queda:

En palabras, el posterior es proporcional al anterior multiplicado por la probabilidad. [20]

Si los eventos A 1 , A 2 , ..., son mutuamente excluyentes y exhaustivos, es decir, es seguro que uno de ellos ocurrirá pero no pueden ocurrir dos juntos, podemos determinar la constante de proporcionalidad utilizando el hecho de que sus probabilidades deben sumar. a uno. Por ejemplo, para un evento dado A , el evento A en sí y su complemento ¬ A son exclusivos y exhaustivos. Denotando la constante de proporcionalidad por c tenemos

Sumando estas dos fórmulas deducimos que

o

Otra forma del teorema de Bayes para dos enunciados o hipótesis en competencia es:

Para una interpretación epistemológica:

Para la proposición A y la evidencia o antecedentes B , [21]

A menudo, para alguna partición { A j } del espacio muestral , el espacio de eventos se da en términos de P ( A j ) y P ( B | A j ). Entonces es útil calcular P ( B ) usando la ley de probabilidad total :

O (usando la regla de multiplicación para la probabilidad condicional), [22]

En el caso especial donde A es una variable binaria :

Considere un espacio muestral Ω generado por dos variables aleatorias X e Y con distribuciones de probabilidad conocidas. En principio, el teorema de Bayes se aplica a los eventos A = { X = x } y B = { Y = y }.

Sin embargo, los términos se vuelven 0 en los puntos donde cualquiera de las variables tiene una densidad de probabilidad finita . Para seguir siendo útil, el teorema de Bayes se puede formular en términos de las densidades relevantes (ver Derivación).

Si X es continua e Y es discreta,

donde cada uno es una función de densidad.

Si X es discreto e Y es continuo,

Si tanto X como Y son continuos,

Un espacio de eventos continuo a menudo se conceptualiza en términos de los términos del numerador. Entonces resulta útil eliminar el denominador utilizando la ley de probabilidad total . Para f Y ( y ), esto se convierte en una integral:

El teorema de Bayes en forma de probabilidades es:

dónde

Se llama factor de Bayes o razón de verosimilitud . Las probabilidades entre dos eventos son simplemente la razón de las probabilidades de los dos eventos. De este modo

Por lo tanto, la regla dice que las probabilidades posteriores son las probabilidades anteriores multiplicadas por el factor Bayes , o en otras palabras, la probabilidad posterior es proporcional a las probabilidades anteriores multiplicadas por la probabilidad.

En el caso especial de que y , se escribe , y se utiliza una abreviatura similar para el factor de Bayes y para las probabilidades condicionales. Las probabilidades son, por definición, las probabilidades a favor y en contra . La regla de Bayes puede entonces escribirse en forma abreviada

o, en palabras, las probabilidades posteriores son iguales a las probabilidades anteriores multiplicadas por la razón de verosimilitud para una información dada . En resumen, las probabilidades posteriores son iguales a las probabilidades anteriores multiplicadas por la razón de verosimilitud .

Por ejemplo, si una prueba médica tiene una sensibilidad del 90% y una especificidad del 91%, entonces el factor de Bayes positivo es . Ahora bien, si la prevalencia de esta enfermedad es del 9,09%, y si la tomamos como probabilidad previa, entonces la probabilidad previa es de aproximadamente 1:10. Entonces, después de recibir un resultado positivo de la prueba, las probabilidades posteriores de tener realmente la enfermedad se vuelven 1:1, lo que significa que la probabilidad posterior de tener la enfermedad es del 50%. Si se realiza una segunda prueba en serie y también resulta positiva, entonces las probabilidades posteriores de tener realmente la enfermedad se convierten en 10:1, lo que significa una probabilidad posterior de aproximadamente el 90,91%. El factor de Bayes negativo se puede calcular en 91%/(100%-90%)=9,1, por lo que si la segunda prueba resulta negativa, entonces las probabilidades posteriores de tener realmente la enfermedad son 1:9,1, lo que significa una probabilidad posterior de alrededor del 9,9%.

El ejemplo anterior también se puede entender con números más sólidos: supongamos que el paciente que realiza la prueba pertenece a un grupo de 1000 personas, donde 91 de ellas realmente tienen la enfermedad (prevalencia del 9,1%). Si todas estas 1.000 personas se someten a la prueba médica, 82 de los que padecen la enfermedad obtendrán un resultado positivo verdadero (sensibilidad del 90,1%), 9 de los que padecen la enfermedad obtendrán un resultado falso negativo ( tasa de falsos negativos del 9,9%), 827 de los que no tienen la enfermedad obtendrán un resultado negativo verdadero (especificidad del 91,0%) y 82 de los que no tienen la enfermedad obtendrán un resultado falso positivo (tasa de falsos positivos del 9,0%). Antes de realizar cualquier prueba, las probabilidades del paciente de tener la enfermedad son de 91:909. Después de recibir un resultado positivo, las probabilidades del paciente de tener la enfermedad son

lo cual es consistente con el hecho de que existen 82 verdaderos positivos y 82 falsos positivos en el grupo de 1000 personas.

Usando dos veces, se puede usar el teorema de Bayes para expresar también en términos de y sin negaciones:

cuando . De esto podemos leer la inferencia

En palabras: si ciertamente implica , inferimos que ciertamente implica . Donde , siendo ciertas las dos implicaciones, son enunciados equivalentes. En las fórmulas de probabilidad, la probabilidad condicional generaliza la implicación lógica , donde ahora más allá de asignar verdadero o falso, asignamos valores de probabilidad a los enunciados. La afirmación de es capturada por la certeza del condicional, la afirmación de . Al relacionar las direcciones de implicación, el teorema de Bayes representa una generalización de la ley de contraposición , que en la lógica proposicional clásica se puede expresar como:

En esta relación entre implicaciones, las posiciones de resp. voltearse.

La fórmula correspondiente en términos de cálculo de probabilidad es el teorema de Bayes, que en su forma ampliada que involucra la probabilidad previa / tasa base de solo , se expresa como: [23]

El teorema de Bayes representa un caso especial de derivación de opiniones condicionales invertidas en lógica subjetiva expresada como:

donde denota el operador para invertir opiniones condicionales. El argumento denota un par de opiniones condicionales binomiales dadas por la fuente , y el argumento denota la probabilidad previa (también conocida como tasa base ) de . Se denota el par de opiniones condicionales invertidas derivadas . La opinión condicional generaliza el condicional probabilístico , es decir, además de asignar una probabilidad la fuente puede asignar cualquier opinión subjetiva al enunciado condicional . Una opinión subjetiva binomial es la creencia en la verdad de una afirmación con grados de incertidumbre epistémica, expresada por la fuente . Cada opinión subjetiva tiene una probabilidad proyectada correspondiente . La aplicación del teorema de Bayes a las probabilidades proyectadas de opiniones es un homomorfismo , lo que significa que el teorema de Bayes se puede expresar en términos de probabilidades proyectadas de opiniones:

Por tanto, el teorema subjetivo de Bayes representa una generalización del teorema de Bayes. [24]

Una versión del teorema de Bayes para 3 eventos [25] resulta de la suma de un tercer evento , al cual todas las probabilidades están condicionadas:

Usando la regla de la cadena

Y, por otro lado

El resultado deseado se obtiene identificando ambas expresiones y resolviendo .

En genética, la regla de Bayes se puede utilizar para estimar la probabilidad de que un individuo tenga un genotipo específico. Muchas personas buscan aproximar sus posibilidades de verse afectadas por una enfermedad genética o su probabilidad de ser portador de un gen recesivo de interés. Se puede realizar un análisis bayesiano basándose en antecedentes familiares o pruebas genéticas , para predecir si un individuo desarrollará una enfermedad o la transmitirá a sus hijos. Las pruebas y predicciones genéticas son una práctica común entre las parejas que planean tener hijos pero les preocupa que ambos puedan ser portadores de una enfermedad, especialmente en comunidades con baja variación genética. [26]

El primer paso en el análisis bayesiano para genética es proponer hipótesis mutuamente excluyentes: para un alelo específico, un individuo es portador o no. A continuación, se calculan cuatro probabilidades: Probabilidad Previa (la probabilidad de que cada hipótesis considere información como historia familiar o predicciones basadas en la Herencia Mendeliana), Probabilidad Condicional (de un determinado resultado), Probabilidad Conjunta (producto de las dos primeras) y Probabilidad Posterior. Probabilidad (un producto ponderado calculado dividiendo la probabilidad conjunta de cada hipótesis por la suma de ambas probabilidades conjuntas). Este tipo de análisis se puede realizar basándose únicamente en los antecedentes familiares de una afección o en conjunto con pruebas genéticas. [ cita necesaria ]

Ejemplo de una tabla de análisis bayesiano para el riesgo de una mujer de padecer una enfermedad basándose en el conocimiento de que la enfermedad está presente en sus hermanos pero no en sus padres ni en ninguno de sus cuatro hijos. Basándose únicamente en el estado de los hermanos y padres del sujeto, es igualmente probable que sea portador que no portador (esta probabilidad se indica mediante la Hipótesis previa). Sin embargo, la probabilidad de que los cuatro hijos del sujeto no se vean afectados es 1/16 ( 1 ⁄ 2 · 1 ⁄ 2 · 1 ⁄ 2 · 1 ⁄ 2 ) si ella es portadora, aproximadamente 1 si no es portadora ( esta es la probabilidad condicional). La probabilidad conjunta concilia estas dos predicciones multiplicándolas. La última línea (la Probabilidad Posterior) se calcula dividiendo la Probabilidad Conjunta de cada hipótesis por la suma de ambas probabilidades conjuntas. [27]

Las pruebas genéticas parentales pueden detectar alrededor del 90% de los alelos de enfermedades conocidas en los padres que pueden llevar al estado de portador o afectado en su hijo. La fibrosis quística es una enfermedad hereditaria causada por una mutación autosómica recesiva en el gen CFTR, [28] ubicado en el brazo q del cromosoma 7. [29]

Análisis bayesiano de una paciente con antecedentes familiares de fibrosis quística (FQ), que dio negativo en la prueba de FQ, lo que demuestra cómo se utilizó este método para determinar su riesgo de tener un hijo con FQ:

Como la paciente no está afectada, es homocigótica para el alelo de tipo salvaje o heterocigótica. Para establecer probabilidades a priori se utiliza un cuadrado de Punnett, basado en el conocimiento de que ninguno de los padres estaba afectado por la enfermedad pero ambos podrían haber sido portadores:

Dado que el paciente no está afectado, sólo existen tres posibilidades. Dentro de estos tres, existen dos escenarios en los que el paciente porta el alelo mutante. Por tanto, las probabilidades anteriores son 2 ⁄ 3 y 1 ⁄ 3 .

A continuación, el paciente se somete a pruebas genéticas y las pruebas de fibrosis quística dan negativo. Esta prueba tiene una tasa de detección del 90%, por lo que las probabilidades condicionales de una prueba negativa son 1/10 y 1. Finalmente, las probabilidades conjunta y posterior se calculan como antes.

Después de realizar el mismo análisis en la pareja masculina del paciente (con un resultado negativo), las posibilidades de que su hijo esté afectado es igual al producto de las probabilidades posteriores respectivas de los padres de ser portadores por las posibilidades de que dos portadores produzcan un descendencia afectada ( 1 ⁄ 4 ).

El análisis bayesiano se puede realizar utilizando información fenotípica asociada con una condición genética y, cuando se combina con pruebas genéticas, este análisis se vuelve mucho más complicado. La fibrosis quística, por ejemplo, se puede identificar en un feto mediante una ecografía en busca de un intestino ecogénico, es decir, uno que parece más brillante de lo normal en una exploración. Esta no es una prueba infalible, ya que un feto perfectamente sano puede presentar un intestino ecogénico. Las pruebas genéticas de los padres son muy influyentes en este caso, donde una faceta fenotípica puede tener demasiada influencia en el cálculo de la probabilidad. En el caso de un feto con intestino ecogénico, de una madre que ha sido examinada y se sabe que es portadora de FQ, la probabilidad posterior de que el feto realmente tenga la enfermedad es muy alta (0,64). Sin embargo, una vez que el padre ha dado negativo en la prueba de FQ, la probabilidad posterior cae significativamente (a 0,16). [27]

El cálculo de los factores de riesgo es una herramienta poderosa en el asesoramiento genético y la planificación reproductiva, pero no puede tratarse como el único factor importante a considerar. Como se indicó anteriormente, las pruebas incompletas pueden generar una probabilidad falsamente alta de ser portador, y las pruebas pueden ser financieramente inaccesibles o inviables cuando uno de los padres no está presente.