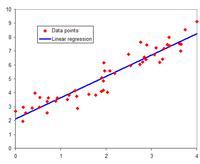

En el modelado estadístico , el análisis de regresión es un conjunto de procesos estadísticos para estimar las relaciones entre una variable dependiente (a menudo llamada variable de "resultado" o "respuesta", o "etiqueta" en el lenguaje del aprendizaje automático) y una o más variables independientes ( a menudo llamados 'predictores', 'covariables', 'variables explicativas' o 'características'). La forma más común de análisis de regresión es la regresión lineal , en la que se encuentra la línea (o una combinación lineal más compleja ) que se ajusta mejor a los datos según un criterio matemático específico. Por ejemplo, el método de mínimos cuadrados ordinarios calcula la línea única (o hiperplano ) que minimiza la suma de diferencias al cuadrado entre los datos verdaderos y esa línea (o hiperplano). Por razones matemáticas específicas (ver regresión lineal ), esto permite al investigador estimar la expectativa condicional (o valor promedio poblacional ) de la variable dependiente cuando las variables independientes toman un conjunto determinado de valores. Las formas menos comunes de regresión utilizan procedimientos ligeramente diferentes para estimar parámetros de ubicación alternativos (por ejemplo, regresión cuantil o análisis de condición necesaria [1] ) o estimar la expectativa condicional a través de una colección más amplia de modelos no lineales (por ejemplo, regresión no paramétrica ).

El análisis de regresión se utiliza principalmente para dos propósitos conceptualmente distintos. En primer lugar, el análisis de regresión se utiliza ampliamente para la predicción y el pronóstico , donde su uso tiene una superposición sustancial con el campo del aprendizaje automático . En segundo lugar, en algunas situaciones se puede utilizar el análisis de regresión para inferir relaciones causales entre las variables independientes y dependientes. Es importante destacar que las regresiones por sí solas sólo revelan relaciones entre una variable dependiente y un conjunto de variables independientes en un conjunto de datos fijo. Para utilizar regresiones para predecir o inferir relaciones causales, respectivamente, un investigador debe justificar cuidadosamente por qué las relaciones existentes tienen poder predictivo para un nuevo contexto o por qué una relación entre dos variables tiene una interpretación causal. Esto último es especialmente importante cuando los investigadores esperan estimar relaciones causales utilizando datos de observación . [2] [3]

La forma más antigua de regresión fue el método de mínimos cuadrados , publicado por Legendre en 1805, [4] y por Gauss en 1809. [5] Tanto Legendre como Gauss aplicaron el método al problema de determinar, a partir de observaciones astronómicas, la órbitas de cuerpos alrededor del Sol (principalmente cometas, pero más tarde también los planetas menores recién descubiertos). Gauss publicó un desarrollo adicional de la teoría de mínimos cuadrados en 1821, [6] incluida una versión del teorema de Gauss-Markov .

El término "regresión" fue acuñado por Francis Galton en el siglo XIX para describir un fenómeno biológico. El fenómeno fue que las alturas de los descendientes de ancestros altos tienden a retroceder hacia un promedio normal (un fenómeno también conocido como regresión hacia la media ). [7] [8] Para Galton, la regresión tenía sólo este significado biológico, [9] [10] pero su trabajo fue posteriormente ampliado por Udny Yule y Karl Pearson a un contexto estadístico más general. [11] [12] En el trabajo de Yule y Pearson, se supone que la distribución conjunta de la respuesta y las variables explicativas es gaussiana . Esta suposición fue debilitada por RA Fisher en sus trabajos de 1922 y 1925. [13] [14] [15] Fisher supuso que la distribución condicional de la variable de respuesta es gaussiana, pero la distribución conjunta no tiene por qué serlo. En este sentido, la suposición de Fisher se acerca más a la formulación de Gauss de 1821.

En las décadas de 1950 y 1960, los economistas utilizaban calculadoras de escritorio electromecánicas para calcular regresiones. Antes de 1970, a veces se necesitaban hasta 24 horas para recibir el resultado de una regresión. [dieciséis]

Los métodos de regresión siguen siendo un área de investigación activa. En las últimas décadas, se han desarrollado nuevos métodos para la regresión robusta , regresión que involucra respuestas correlacionadas como series de tiempo y curvas de crecimiento , regresión en la que el predictor (variable independiente) o las variables de respuesta son curvas, imágenes, gráficos u otros objetos de datos complejos. métodos de regresión que se adaptan a varios tipos de datos faltantes, regresión no paramétrica , métodos bayesianos para regresión, regresión en la que las variables predictivas se miden con error, regresión con más variables predictoras que observaciones e inferencia causal con regresión.

En la práctica, los investigadores primero seleccionan un modelo que les gustaría estimar y luego usan el método elegido (por ejemplo, mínimos cuadrados ordinarios ) para estimar los parámetros de ese modelo. Los modelos de regresión involucran los siguientes componentes:

En diversos campos de aplicación , se utilizan diferentes terminologías en lugar de variables dependientes e independientes .

La mayoría de los modelos de regresión proponen que es una función ( función de regresión ) de y , que representa un término de error aditivo que puede sustituir a determinantes no modelados o ruido estadístico aleatorio:

El objetivo de los investigadores es estimar la función que más se ajuste a los datos. Para realizar un análisis de regresión se debe especificar la forma de la función. A veces la forma de esta función se basa en el conocimiento sobre la relación entre y que no depende de los datos. Si no se dispone de dicho conocimiento, se elige una forma flexible o conveniente . Por ejemplo, se puede proponer una regresión univariada simple , sugiriendo que el investigador cree que es una aproximación razonable para el proceso estadístico que genera los datos.

Una vez que los investigadores determinan su modelo estadístico preferido , diferentes formas de análisis de regresión proporcionan herramientas para estimar los parámetros . Por ejemplo, mínimos cuadrados (incluida su variante más común, mínimos cuadrados ordinarios ) encuentra el valor de que minimiza la suma de errores al cuadrado . Un método de regresión determinado proporcionará en última instancia una estimación de , normalmente denotada para distinguir la estimación del valor verdadero (desconocido) del parámetro que generó los datos. Utilizando esta estimación, el investigador puede utilizar el valor ajustado para predecir o evaluar la precisión del modelo al explicar los datos. Si el investigador está intrínsecamente interesado en la estimación o en el valor predicho dependerá del contexto y sus objetivos. Como se describe en mínimos cuadrados ordinarios , los mínimos cuadrados se utilizan ampliamente porque la función estimada se aproxima a la expectativa condicional . [5] Sin embargo, las variantes alternativas (por ejemplo, desviaciones mínimas absolutas o regresión cuantil ) son útiles cuando los investigadores quieren modelar otras funciones .

Es importante señalar que debe haber datos suficientes para estimar un modelo de regresión. Por ejemplo, supongamos que un investigador tiene acceso a filas de datos con una variable dependiente y dos independientes: . Supongamos además que el investigador quiere estimar un modelo lineal bivariado mediante mínimos cuadrados : . Si el investigador solo tiene acceso a puntos de datos, entonces podría encontrar infinitas combinaciones que expliquen los datos igualmente bien: se puede elegir cualquier combinación que satisfaga , todas las cuales conducen a soluciones válidas que minimizan la suma de los residuos al cuadrado y, por lo tanto, son válidas . Para entender por qué hay infinitas opciones, tenga en cuenta que el sistema de ecuaciones debe resolverse para 3 incógnitas, lo que hace que el sistema esté subdeterminado . Alternativamente, se pueden visualizar infinitos planos tridimensionales que pasan por puntos fijos.

De manera más general, para estimar un modelo de mínimos cuadrados con distintos parámetros, se deben tener distintos puntos de datos. Si , entonces generalmente no existe un conjunto de parámetros que se ajusten perfectamente a los datos. La cantidad aparece a menudo en el análisis de regresión y se denomina grados de libertad en el modelo. Además, para estimar un modelo de mínimos cuadrados, las variables independientes deben ser linealmente independientes : no se debe poder reconstruir ninguna de las variables independientes sumando y multiplicando las variables independientes restantes. Como se analiza en mínimos cuadrados ordinarios , esta condición garantiza que sea una matriz invertible y, por lo tanto, que exista una solución única .

Por sí sola, una regresión es simplemente un cálculo utilizando los datos. Para interpretar el resultado de la regresión como una cantidad estadística significativa que mide las relaciones del mundo real, los investigadores a menudo se basan en una serie de supuestos clásicos . Estos supuestos suelen incluir:

Un puñado de condiciones son suficientes para que el estimador de mínimos cuadrados posea propiedades deseables: en particular, los supuestos de Gauss-Markov implican que las estimaciones de los parámetros serán insesgadas , consistentes y eficientes en la clase de estimadores lineales insesgados. Los profesionales han desarrollado una variedad de métodos para mantener algunas o todas estas propiedades deseables en entornos del mundo real, porque es poco probable que estos supuestos clásicos se cumplan exactamente. Por ejemplo, modelar errores en variables puede llevar a estimaciones razonables que las variables independientes se miden con errores. Los errores estándar consistentes con la heteroscedasticidad permiten que la varianza de cambie entre los valores de . Los errores correlacionados que existen dentro de subconjuntos de datos o que siguen patrones específicos se pueden manejar mediante errores estándar agrupados, regresión geográfica ponderada o errores estándar de Newey-West , entre otras técnicas. Cuando las filas de datos corresponden a ubicaciones en el espacio, la elección de cómo modelar dentro de unidades geográficas puede tener consecuencias importantes. [17] [18] El subcampo de la econometría se centra en gran medida en el desarrollo de técnicas que permitan a los investigadores sacar conclusiones razonables del mundo real en entornos del mundo real, donde los supuestos clásicos no se cumplen exactamente.

En la regresión lineal, la especificación del modelo es que la variable dependiente es una combinación lineal de los parámetros (pero no es necesario que sea lineal en las variables independientes ). Por ejemplo, en una regresión lineal simple para modelar puntos de datos hay una variable independiente: y dos parámetros, y :

En la regresión lineal múltiple, hay varias variables independientes o funciones de variables independientes.

Agregar un término a la regresión anterior da:

Esto sigue siendo una regresión lineal; aunque la expresión del lado derecho es cuadrática en la variable independiente , es lineal en los parámetros , y

En ambos casos, es un término de error y el subíndice indexa una observación particular.

Volviendo nuestra atención al caso de la línea recta: dada una muestra aleatoria de la población, estimamos los parámetros de la población y obtenemos el modelo de regresión lineal muestral:

El residual , es la diferencia entre el valor de la variable dependiente predicha por el modelo, y el valor verdadero de la variable dependiente ,. Un método de estimación son los mínimos cuadrados ordinarios . Este método obtiene estimaciones de parámetros que minimizan la suma de residuos al cuadrado , SSR :

La minimización de esta función da como resultado un conjunto de ecuaciones normales , un conjunto de ecuaciones lineales simultáneas en los parámetros, que se resuelven para producir los estimadores de parámetros .

En el caso de regresión simple, las fórmulas para las estimaciones de mínimos cuadrados son

donde es la media (promedio) de los valores y es la media de los valores.

Bajo el supuesto de que el término de error poblacional tiene una varianza constante, la estimación de esa varianza viene dada por:

Esto se denomina error cuadrático medio (MSE) de la regresión. El denominador es el tamaño de la muestra reducido por el número de parámetros del modelo estimados a partir de los mismos datos, para regresores o si se utiliza una intersección. [19] En este caso, el denominador es .

Los errores estándar de las estimaciones de los parámetros están dados por

Bajo el supuesto adicional de que el término de error de la población tiene una distribución normal, el investigador puede utilizar estos errores estándar estimados para crear intervalos de confianza y realizar pruebas de hipótesis sobre los parámetros de la población .

En el modelo de regresión múltiple más general, existen variables independientes:

¿Dónde está la -ésima observación de la -ésima variable independiente? Si la primera variable independiente toma el valor 1 para todos , entonces se llama intercepto de regresión .

Las estimaciones de los parámetros de mínimos cuadrados se obtienen a partir de ecuaciones normales. El residuo se puede escribir como

Las ecuaciones normales son

En notación matricial, las ecuaciones normales se escriben como

donde el elemento de es , el elemento del vector columna es y el elemento de es . Así es , es y es . La solucion es

Una vez que se ha construido un modelo de regresión, puede ser importante confirmar la bondad de ajuste del modelo y la significancia estadística de los parámetros estimados. Las comprobaciones de bondad de ajuste comúnmente utilizadas incluyen el R cuadrado , análisis del patrón de residuos y pruebas de hipótesis. La significancia estadística se puede verificar mediante una prueba F del ajuste general, seguida de pruebas t de parámetros individuales.

Las interpretaciones de estas pruebas de diagnóstico se basan en gran medida en los supuestos del modelo. Aunque el examen de los residuos se puede utilizar para invalidar un modelo, los resultados de una prueba t o una prueba F a veces son más difíciles de interpretar si se violan los supuestos del modelo. Por ejemplo, si el término de error no tiene una distribución normal, en muestras pequeñas los parámetros estimados no seguirán distribuciones normales y complicarán la inferencia. Sin embargo, con muestras relativamente grandes, se puede invocar un teorema del límite central de modo que la prueba de hipótesis pueda realizarse utilizando aproximaciones asintóticas.

Las variables dependientes limitadas , que son variables de respuesta que son variables categóricas o variables restringidas a caer solo en un cierto rango, a menudo surgen en econometría .

La variable de respuesta puede ser no continua ("limitada" a algún subconjunto de la línea real). Para variables binarias (cero o uno), si el análisis se realiza con regresión lineal de mínimos cuadrados, el modelo se denomina modelo de probabilidad lineal . Los modelos no lineales para variables dependientes binarias incluyen el modelo probit y logit . El modelo probit multivariado es un método estándar para estimar una relación conjunta entre varias variables dependientes binarias y algunas variables independientes. Para variables categóricas con más de dos valores existe el logit multinomial . Para variables ordinales con más de dos valores, existen los modelos logit ordenado y probit ordenado . Se pueden usar modelos de regresión censurados cuando la variable dependiente solo se observa algunas veces, y se pueden usar modelos de tipo corrección de Heckman cuando la muestra no se selecciona aleatoriamente de la población de interés. Una alternativa a tales procedimientos es la regresión lineal basada en correlación policórica (o correlaciones poliseriales) entre las variables categóricas. Dichos procedimientos difieren en los supuestos hechos sobre la distribución de las variables en la población. Si la variable es positiva con valores bajos y representa la repetición de la ocurrencia de un evento, entonces se pueden usar modelos de conteo como la regresión de Poisson o el modelo binomial negativo .

Cuando la función del modelo no es lineal en los parámetros, la suma de cuadrados debe minimizarse mediante un procedimiento iterativo. Esto introduce muchas complicaciones que se resumen en Diferencias entre mínimos cuadrados lineales y no lineales .

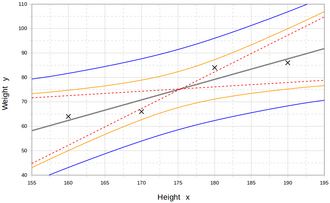

Los modelos de regresión predicen un valor de la variable Y dados valores conocidos de las variables X. La predicción dentro del rango de valores del conjunto de datos utilizado para el ajuste del modelo se conoce informalmente como interpolación . La predicción fuera de este rango de datos se conoce como extrapolación . La realización de la extrapolación depende en gran medida de los supuestos de regresión. Cuanto más se aleja la extrapolación de los datos, más espacio hay para que el modelo falle debido a diferencias entre los supuestos y los datos de la muestra o los valores verdaderos.

Un intervalo de predicción que represente la incertidumbre puede acompañar a la predicción puntual. Dichos intervalos tienden a expandirse rápidamente a medida que los valores de las variables independientes se mueven fuera del rango cubierto por los datos observados.

Por estas y otras razones, algunos tienden a decir que podría ser imprudente realizar una extrapolación. [21]

Sin embargo, esto no cubre el conjunto completo de errores de modelado que pueden cometerse: en particular, el supuesto de una forma particular para la relación entre Y y X. Un análisis de regresión realizado adecuadamente incluirá una evaluación de qué tan bien la forma asumida coincide con los datos observados, pero sólo puede hacerlo dentro del rango de valores de las variables independientes realmente disponibles. Esto significa que cualquier extrapolación depende particularmente de los supuestos que se hacen sobre la forma estructural de la relación de regresión. Si este conocimiento incluye el hecho de que la variable dependiente no puede salir de un cierto rango de valores, esto se puede utilizar para seleccionar el modelo, incluso si el conjunto de datos observado no tiene valores particularmente cercanos a esos límites. Las implicaciones de este paso de elegir una forma funcional apropiada para la regresión pueden ser grandes cuando se considera la extrapolación. Como mínimo, puede garantizar que cualquier extrapolación que surja de un modelo ajustado sea "realista" (o esté de acuerdo con lo que se sabe).

No existen métodos generalmente acordados para relacionar el número de observaciones con el número de variables independientes en el modelo. Un método conjeturado por Good y Hardin es , donde es el tamaño de la muestra, es el número de variables independientes y es el número de observaciones necesarias para alcanzar la precisión deseada si el modelo tuviera solo una variable independiente. [22] Por ejemplo, un investigador está construyendo un modelo de regresión lineal utilizando un conjunto de datos que contiene 1000 pacientes ( ). Si el investigador decide que se necesitan cinco observaciones para definir con precisión una línea recta ( ), entonces el número máximo de variables independientes que el modelo puede admitir es 4, porque

Aunque los parámetros de un modelo de regresión generalmente se estiman utilizando el método de mínimos cuadrados, otros métodos que se han utilizado incluyen:

Todos los principales paquetes de software estadístico realizan inferencias y análisis de regresión de mínimos cuadrados . En algunas aplicaciones de hojas de cálculo y en algunas calculadoras se pueden realizar regresiones lineales simples y regresiones múltiples utilizando mínimos cuadrados . Si bien muchos paquetes de software estadístico pueden realizar varios tipos de regresión robusta y no paramétrica, estos métodos están menos estandarizados. Diferentes paquetes de software implementan diferentes métodos y un método con un nombre determinado puede implementarse de manera diferente en diferentes paquetes. Se ha desarrollado un software de regresión especializado para su uso en campos como el análisis de encuestas y la neuroimagen.