En estadística , un modelo mixto es un modelo probabilístico para representar la presencia de subpoblaciones dentro de una población general, sin requerir que un conjunto de datos observados identifique la subpoblación a la que pertenece una observación individual. Formalmente, un modelo mixto corresponde a la distribución mixta que representa la distribución de probabilidad de las observaciones en la población general. Sin embargo, mientras que los problemas asociados con las "distribuciones de mezcla" se relacionan con derivar las propiedades de la población general a partir de las de las subpoblaciones, los "modelos de mezcla" se utilizan para hacer inferencias estadísticas sobre las propiedades de las subpoblaciones dadas sólo observaciones sobre la distribución. Población agrupada, sin información de identidad de subpoblación. Los modelos mixtos se utilizan para la agrupación, bajo el nombre de agrupación basada en modelos , y también para la estimación de densidad .

Los modelos de mezcla no deben confundirse con los modelos para datos compositivos , es decir, datos cuyos componentes están obligados a sumar un valor constante (1, 100%, etc.). Sin embargo, los modelos compositivos pueden considerarse modelos mixtos, en los que los miembros de la población se muestrean al azar. Por el contrario, los modelos mixtos pueden considerarse modelos compositivos, en los que el tamaño total de la población lectora se ha normalizado a 1.

Un modelo de mezcla de dimensión finita típico es un modelo jerárquico que consta de los siguientes componentes:

Además, en un entorno bayesiano , los pesos y parámetros de la mezcla serán en sí mismos variables aleatorias, y se colocarán distribuciones previas sobre las variables. En tal caso, los pesos generalmente se ven como un vector aleatorio K -dimensional extraído de una distribución de Dirichlet (la previa conjugada de la distribución categórica), y los parámetros se distribuirán de acuerdo con sus respectivas prioridades conjugadas.

Matemáticamente, un modelo de mezcla paramétrico básico se puede describir de la siguiente manera:

En una configuración bayesiana, todos los parámetros están asociados con variables aleatorias, de la siguiente manera:

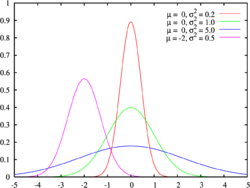

Esta caracterización utiliza F y H para describir distribuciones arbitrarias sobre observaciones y parámetros, respectivamente. Normalmente H será el conjugado anterior de F . Las dos opciones más comunes de F son gaussianas, también conocidas como " normales " (para observaciones de valores reales) y categóricas (para observaciones discretas). Otras posibilidades habituales para la distribución de los componentes de la mezcla son:

Un modelo típico de mezcla gaussiana no bayesiana se ve así:

Una versión bayesiana de un modelo de mezcla gaussiana es la siguiente:

Un modelo de mezcla bayesiana gaussiana se extiende comúnmente para ajustarse a un vector de parámetros desconocidos (indicados en negrita) o distribuciones normales multivariadas. En una distribución multivariada (es decir, una que modela un vector con N variables aleatorias), se puede modelar un vector de parámetros (como varias observaciones de una señal o parches dentro de una imagen) utilizando una distribución previa del modelo de mezcla gaussiana en el vector de estimaciones dado por

donde el i- ésimo componente del vector se caracteriza por distribuciones normales con pesos , medias y matrices de covarianza . Para incorporar este a priori en una estimación bayesiana, el a priori se multiplica por la distribución conocida de los datos condicionada a los parámetros a estimar. Con esta formulación, la distribución posterior es también un modelo de mezcla gaussiana de la forma

con nuevos parámetros y que se actualizan mediante el algoritmo EM . [2] Aunque las actualizaciones de parámetros basadas en EM están bien establecidas, proporcionar las estimaciones iniciales para estos parámetros es actualmente un área de investigación activa. Tenga en cuenta que esta formulación produce una solución de forma cerrada para la distribución posterior completa. Las estimaciones de la variable aleatoria se pueden obtener mediante uno de varios estimadores, como la media o el máximo de la distribución posterior.

Estas distribuciones son útiles para asumir formas de imágenes y grupos en forma de parches, por ejemplo. En el caso de la representación de imágenes, cada gaussiano puede inclinarse, expandirse y deformarse según las matrices de covarianza . Se ajusta una distribución gaussiana del conjunto a cada parche (normalmente de tamaño 8x8 píxeles) de la imagen. En particular, cualquier distribución de puntos alrededor de un grupo (ver k -medias ) puede recibir con precisión suficientes componentes gaussianos, pero apenas se necesitan más de K = 20 componentes para modelar con precisión una distribución de imagen o un grupo de datos determinado.

Un modelo de mezcla no bayesiano típico con observaciones categóricas se ve así:

Las variables aleatorias:

Un modelo típico de mezcla bayesiana con observaciones categóricas se ve así:

Las variables aleatorias:

Los rendimientos financieros a menudo se comportan de manera diferente en situaciones normales y durante tiempos de crisis. Un modelo mixto [3] para datos de retorno parece razonable. En ocasiones el modelo utilizado es un modelo de salto-difusión , o como una mezcla de dos distribuciones normales. Consulte Economía financiera § Desafíos y críticas y Gestión de riesgos financieros § Banca para obtener más contexto.

Supongamos que observamos los precios de N casas diferentes. Diferentes tipos de casas en diferentes vecindarios tendrán precios muy diferentes, pero el precio de un tipo particular de casa en un vecindario particular (por ejemplo, una casa de tres dormitorios en un vecindario moderadamente exclusivo) tenderá a agruparse bastante cerca de la media. Un posible modelo de tales precios sería asumir que los precios se describen con precisión mediante un modelo mixto con K componentes diferentes, cada uno distribuido como una distribución normal con media y varianza desconocidas, donde cada componente especifica una combinación particular de tipo de casa/vecindario. Ajustar este modelo a los precios observados, por ejemplo, utilizando el algoritmo de maximización de expectativas , tendería a agrupar los precios según el tipo de casa/barrio y revelaría la dispersión de los precios en cada tipo/barrio. (Tenga en cuenta que para valores como los precios o los ingresos que se garantiza que son positivos y que tienden a crecer exponencialmente , una distribución log-normal podría ser en realidad un mejor modelo que una distribución normal).

Supongamos que un documento está compuesto por N palabras diferentes de un vocabulario total de tamaño V , donde cada palabra corresponde a uno de K temas posibles. La distribución de tales palabras podría modelarse como una mezcla de K diferentes distribuciones categóricas de dimensión V. Un modelo de este tipo se denomina comúnmente modelo temático . Tenga en cuenta que la maximización de expectativas aplicada a dicho modelo normalmente no producirá resultados realistas, debido (entre otras cosas) al número excesivo de parámetros . Generalmente son necesarios algunos tipos de suposiciones adicionales para obtener buenos resultados. Normalmente se añaden al modelo dos tipos de componentes adicionales:

El siguiente ejemplo se basa en un ejemplo de Christopher M. Bishop , Pattern Recognition and Machine Learning . [4]

Imaginemos que nos dan una imagen en blanco y negro de N × N que se sabe que es un escaneo de un dígito escrito a mano entre 0 y 9, pero no sabemos qué dígito está escrito. Podemos crear un modelo mixto con diferentes componentes, donde cada componente es un vector de tamaño de distribuciones de Bernoulli (uno por píxel). Un modelo de este tipo se puede entrenar con el algoritmo de maximización de expectativas en un conjunto de dígitos escritos a mano sin etiquetar y agrupará efectivamente las imágenes según el dígito que se escribe. Luego, el mismo modelo podría usarse para reconocer el dígito de otra imagen simplemente manteniendo constantes los parámetros, calculando la probabilidad de la nueva imagen para cada dígito posible (un cálculo trivial) y devolviendo el dígito que generó la probabilidad más alta.

Los modelos mixtos se aplican en el problema de dirigir múltiples proyectiles a un objetivo (como en aplicaciones de defensa aérea, terrestre o marítima), donde las características físicas y/o estadísticas de los proyectiles difieren dentro de los múltiples proyectiles. Un ejemplo podrían ser disparos con múltiples tipos de municiones o disparos desde múltiples ubicaciones dirigidos a un objetivo. La combinación de tipos de proyectiles puede caracterizarse como un modelo de mezcla gaussiana. [5] Además, una medida bien conocida de precisión para un grupo de proyectiles es el error circular probable (CEP), que es el número R tal que, en promedio, la mitad del grupo de proyectiles cae dentro del círculo de radio R. sobre el punto objetivo. El modelo de mezcla se puede utilizar para determinar (o estimar) el valor R. El modelo de mezcla captura adecuadamente los diferentes tipos de proyectiles.

El ejemplo financiero anterior es una aplicación directa del modelo mixto, una situación en la que asumimos un mecanismo subyacente para que cada observación pertenezca a una de varias fuentes o categorías diferentes. Sin embargo, este mecanismo subyacente puede ser observable o no. En esta forma de mezcla, cada una de las fuentes se describe mediante una función de densidad de probabilidad de componente, y su peso de mezcla es la probabilidad de que una observación provenga de este componente.

En una aplicación indirecta del modelo de mezcla no asumimos tal mecanismo. El modelo mixto se utiliza simplemente por sus flexibilidades matemáticas. Por ejemplo, una mezcla de dos distribuciones normales con medias diferentes puede dar como resultado una densidad con dos modas , que no está modelada por distribuciones paramétricas estándar. Otro ejemplo lo da la posibilidad de utilizar distribuciones mixtas para modelar colas más gruesas que las gaussianas básicas, de modo que sea un candidato para modelar eventos más extremos. Cuando se combina con una coherencia dinámica, este enfoque se ha aplicado a la valoración de derivados financieros en presencia de la sonrisa de la volatilidad en el contexto de los modelos de volatilidad locales . Esto define nuestra aplicación.

La agrupación basada en modelos mixtos también se utiliza predominantemente para identificar el estado de la máquina en el mantenimiento predictivo . Los gráficos de densidad se utilizan para analizar la densidad de características de alta dimensión. Si se observan densidades de modelos múltiples, entonces se supone que un conjunto finito de densidades está formado por un conjunto finito de mezclas normales. Se utiliza un modelo de mezcla gaussiana multivariante para agrupar los datos de características en k números de grupos donde k representa cada estado de la máquina. El estado de la máquina puede ser un estado normal, un estado apagado o un estado defectuoso. [6] Cada grupo formado se puede diagnosticar mediante técnicas como el análisis espectral. En los últimos años, esto también se ha utilizado ampliamente en otras áreas, como la detección temprana de fallas. [7]

En el procesamiento de imágenes y la visión por computadora, los modelos tradicionales de segmentación de imágenes a menudo asignan a un píxel solo un patrón exclusivo. En la segmentación difusa o suave, cualquier patrón puede tener cierta "propiedad" sobre cualquier píxel. Si los patrones son gaussianos, la segmentación difusa naturalmente da como resultado mezclas gaussianas. Combinados con otras herramientas analíticas o geométricas (por ejemplo, transiciones de fase sobre límites difusos), estos modelos de mezcla espacialmente regularizados podrían conducir a métodos de segmentación más realistas y computacionalmente eficientes. [8]

Los modelos de mezcla probabilística, como los modelos de mezcla gaussiana (GMM), se utilizan para resolver problemas de registro de conjuntos de puntos en el procesamiento de imágenes y los campos de visión por computadora. Para el registro de conjuntos de puntos por pares , un conjunto de puntos se considera los centroides de los modelos de mezcla y el otro conjunto de puntos se considera puntos de datos (observaciones). Los métodos más modernos son, por ejemplo, la deriva puntual coherente (CPD) [9] y los modelos de mezcla de distribución t de Student (TMM). [10] El resultado de investigaciones recientes demuestra la superioridad de los modelos de mezcla híbrida [11] (por ejemplo, combinando la distribución t de Student y la distribución de Watson/ distribución de Bingham para modelar posiciones espaciales y orientaciones de ejes por separado) en comparación con CPD y TMM, en términos de inherentes. robustez, precisión y capacidad discriminativa.

La identificabilidad se refiere a la existencia de una caracterización única para cualquiera de los modelos de la clase (familia) que se está considerando. Es posible que los procedimientos de estimación no estén bien definidos y que la teoría asintótica no sea válida si un modelo no es identificable.

Sea J la clase de todas las distribuciones binomiales con n = 2 . Entonces una mezcla de dos miembros de J habría

y pag 2 = 1 - pag 0 - pag 1 . Claramente, dados p 0 y p 1 , no es posible determinar el modelo de mezcla anterior de forma única, ya que hay tres parámetros ( π , θ 1 , θ 2 ) que deben determinarse.

Considere una mezcla de distribuciones paramétricas de la misma clase. Dejar

ser la clase de todas las distribuciones de componentes. Entonces el casco convexo K de J define la clase de todas las mezclas finitas de distribuciones en J :

Se dice que K es identificable si todos sus miembros son únicos, es decir, dados dos miembros p y p′ en K , siendo mezclas de distribuciones k y distribuciones k′ respectivamente en J , tenemos p = p′ si y solo si, en primer lugar, k = k′ y en segundo lugar podemos reordenar las sumatorias de modo que a i = a i ′ y ƒ i = ƒ i ′ para todo i .

Los modelos de mezcla paramétrica se utilizan a menudo cuando conocemos la distribución Y y podemos tomar muestras de X , pero nos gustaría determinar los valores de a i y θ i . Estas situaciones pueden surgir en estudios en los que tomamos muestras de una población compuesta por varias subpoblaciones distintas.

Es común pensar en el modelado de mezclas de probabilidades como un problema de datos faltantes. Una forma de entender esto es asumir que los puntos de datos considerados tienen "pertenencia" a una de las distribuciones que estamos utilizando para modelar los datos. Cuando comenzamos, esta membresía es desconocida o falta. El trabajo de la estimación es diseñar parámetros apropiados para las funciones del modelo que elegimos, representando la conexión con los puntos de datos como su pertenencia a las distribuciones individuales del modelo.

Se han propuesto una variedad de enfoques para el problema de la descomposición de mezclas, muchos de los cuales se centran en métodos de máxima verosimilitud, como la maximización de expectativas (EM) o la estimación máxima a posteriori (MAP). Generalmente estos métodos consideran por separado las cuestiones de identificación del sistema y estimación de parámetros; Los métodos para determinar el número y la forma funcional de los componentes dentro de una mezcla se distinguen de los métodos para estimar los valores de los parámetros correspondientes. Algunas desviaciones notables son los métodos gráficos descritos en Tarter y Lock [12] y, más recientemente, técnicas de longitud mínima de mensaje (MML) como Figueiredo y Jain [13] y, hasta cierto punto, las rutinas de análisis de patrones de coincidencia de momentos sugeridas por McWilliam y Loh ( 2009). [14]

La maximización de expectativas (EM) es aparentemente la técnica más popular utilizada para determinar los parámetros de una mezcla con un número de componentes determinado a priori . Esta es una forma particular de implementar la estimación de máxima verosimilitud para este problema. EM es particularmente atractivo para mezclas normales finitas donde son posibles expresiones de forma cerrada, como en el siguiente algoritmo iterativo de Dempster et al. (1977) [15]

con las probabilidades posteriores

Por lo tanto, sobre la base de la estimación actual de los parámetros, la probabilidad condicional de que una observación dada x ( t ) se genere a partir del estado s se determina para cada t = 1,…, N ; siendo N el tamaño de la muestra. Luego, los parámetros se actualizan de modo que las ponderaciones de los nuevos componentes correspondan a la probabilidad condicional promedio y la media y covarianza de cada componente sea el promedio ponderado específico del componente de la media y la covarianza de toda la muestra.

Dempster [15] también demostró que cada iteración sucesiva de EM no disminuirá la probabilidad, una propiedad que no comparten otras técnicas de maximización basadas en gradientes. Además, EM naturalmente incorpora restricciones sobre el vector de probabilidad y, para tamaños de muestra suficientemente grandes, la precisión positiva de las iteraciones de covarianza. Esta es una ventaja clave ya que los métodos explícitamente restringidos incurren en costos computacionales adicionales para verificar y mantener los valores apropiados. Teóricamente, EM es un algoritmo de primer orden y, como tal, converge lentamente hacia una solución de punto fijo. Redner y Walker (1984) [ cita completa necesaria ] plantean este punto argumentando a favor de los métodos superlineales y de segundo orden de Newton y cuasi-Newton y reportando una lenta convergencia en EM sobre la base de sus pruebas empíricas. Admiten que la convergencia en probabilidad fue rápida incluso si la convergencia en los valores de los parámetros mismos no lo fue. Los méritos relativos de EM y otros algoritmos frente a la convergencia se han discutido en otra literatura. [dieciséis]

Otras objeciones comunes al uso de EM son que tiene una propensión a identificar máximos locales de forma espuria, además de mostrar sensibilidad a los valores iniciales. [17] [18] Se pueden abordar estos problemas evaluando EM en varios puntos iniciales en el espacio de parámetros, pero esto es computacionalmente costoso y otros enfoques, como el método EM de recocido de Udea y Nakano (1998) (en el que los componentes iniciales esencialmente se ven obligados a superponerse, proporcionando una base menos heterogénea para las conjeturas iniciales), puede ser preferible.

Figueiredo y Jain [13] señalan que la convergencia hacia valores de parámetros "sin sentido" obtenidos en la frontera (donde las condiciones de regularidad fallan, por ejemplo, Ghosh y Sen (1985)) se observa con frecuencia cuando el número de componentes del modelo excede el óptimo/verdadero. Sobre esta base, sugieren un enfoque unificado para la estimación e identificación en el que se elige que el n inicial exceda en gran medida el valor óptimo esperado. Su rutina de optimización se construye mediante un criterio de longitud mínima de mensaje (MML) que elimina efectivamente un componente candidato si no hay información suficiente para respaldarlo. De esta forma es posible sistematizar las reducciones de n y considerar la estimación y la identificación de forma conjunta.

Con estimaciones iniciales para los parámetros de nuestro modelo de mezcla, la "pertenencia parcial" de cada punto de datos en cada distribución constituyente se calcula calculando los valores esperados para las variables de pertenencia de cada punto de datos. Es decir, para cada punto de datos x j y distribución Y i , el valor de membresía y i , j es:

Con los valores esperados para la membresía del grupo, se vuelven a calcular las estimaciones de los complementos para los parámetros de distribución.

Los coeficientes de mezcla a i son las medias de los valores de membresía sobre los N puntos de datos.

Los parámetros del modelo de componentes θ i también se calculan mediante la maximización de expectativas utilizando puntos de datos x j que se han ponderado utilizando los valores de membresía. Por ejemplo, si θ es una media μ

Con nuevas estimaciones para a i y θ i ' s, se repite el paso de expectativa para volver a calcular los nuevos valores de membresía. Todo el procedimiento se repite hasta que los parámetros del modelo convergen.

Como alternativa al algoritmo EM, los parámetros del modelo de mezcla se pueden deducir mediante muestreo posterior como lo indica el teorema de Bayes . Esto todavía se considera un problema de datos incompletos en el que los datos faltantes son la pertenencia a puntos de datos. Se puede utilizar un procedimiento iterativo de dos pasos conocido como muestreo de Gibbs .

El ejemplo anterior de una mezcla de dos distribuciones gaussianas puede demostrar cómo funciona el método. Como antes, se hacen estimaciones iniciales de los parámetros para el modelo de mezcla. En lugar de calcular membresías parciales para cada distribución elemental, se extrae un valor de membresía para cada punto de datos de una distribución de Bernoulli (es decir, se asignará al primero o al segundo gaussiano). El parámetro de Bernoulli θ se determina para cada punto de datos sobre la base de una de las distribuciones constituyentes. [ vago ] Los sorteos de la distribución generan asociaciones de membresía para cada punto de datos. Luego se pueden usar estimadores complementarios como en el paso M de EM para generar un nuevo conjunto de parámetros del modelo de mezcla y repetir el paso de extracción binomial.

El método de coincidencia de momentos es una de las técnicas más antiguas para determinar los parámetros de la mezcla y se remonta al trabajo fundamental de Karl Pearson de 1894. En este enfoque, los parámetros de la mezcla se determinan de manera que la distribución compuesta tenga momentos que coincidan con un valor dado. En muchos casos, la extracción de soluciones a las ecuaciones de momentos puede presentar problemas algebraicos o computacionales no triviales. Además, el análisis numérico realizado por Day [19] ha indicado que dichos métodos pueden ser ineficientes en comparación con los EM. No obstante, ha habido un interés renovado en este método, por ejemplo, Craigmile y Titterington (1998) y Wang. [20]

McWilliam y Loh (2009) consideran la caracterización de una cópula de mezcla normal hipercuboidal en sistemas de grandes dimensiones para los cuales EM sería computacionalmente prohibitivo. Aquí se utiliza una rutina de análisis de patrones para generar dependencias de cola multivariadas consistentes con un conjunto de momentos univariados y (en cierto sentido) bivariados. Luego, el desempeño de este método se evalúa utilizando datos de rendimiento logarítmico de equidad con estadísticas de prueba de Kolmogorov-Smirnov que sugieren un buen ajuste descriptivo.

Algunos problemas en la estimación de modelos mixtos se pueden resolver utilizando métodos espectrales . En particular , resulta útil si los puntos de datos xi son puntos en el espacio real de alta dimensión y se sabe que las distribuciones ocultas son logcóncavas (como la distribución gaussiana o la distribución exponencial ).

Los métodos espectrales para aprender modelos mixtos se basan en el uso de la descomposición de valores singulares de una matriz que contiene puntos de datos. La idea es considerar los k vectores singulares superiores, donde k es el número de distribuciones que se aprenderán. La proyección de cada punto de datos a un subespacio lineal abarcado por esos vectores agrupa los puntos que se originan en la misma distribución muy juntos, mientras que los puntos de diferentes distribuciones permanecen alejados.

Una característica distintiva del método espectral es que nos permite demostrar que si las distribuciones satisfacen cierta condición de separación (por ejemplo, no demasiado cercanas), entonces la mezcla estimada será muy cercana a la verdadera con alta probabilidad.

Tarter y Lock [12] describen un enfoque gráfico para la identificación de mezclas en el que se aplica una función kernel a un gráfico de frecuencia empírico para reducir la varianza intracomponente. De esta manera se pueden identificar más fácilmente componentes que tienen diferentes medios. Si bien este método λ no requiere conocimiento previo del número o forma funcional de los componentes, su éxito depende de la elección de los parámetros del núcleo que, hasta cierto punto, implícitamente incorporan suposiciones sobre la estructura del componente.

Algunos de ellos probablemente incluso puedan aprender mezclas de distribuciones de colas pesadas, incluidas aquellas con varianza infinita (consulte los enlaces a los artículos a continuación). En este contexto, los métodos basados en EM no funcionarían, ya que el paso Expectativa divergiría debido a la presencia de valores atípicos .

Para simular una muestra de tamaño N que proviene de una mezcla de distribuciones F i , i =1 an , con probabilidades p i (suma = p i = 1):

En una configuración bayesiana , se pueden agregar niveles adicionales al modelo gráfico que define el modelo de mezcla. Por ejemplo, en el modelo de temas de asignación latente común de Dirichlet , las observaciones son conjuntos de palabras extraídas de D documentos diferentes y los componentes de la mezcla K representan temas que se comparten entre documentos. Cada documento tiene un conjunto diferente de pesos combinados, que especifican los temas que prevalecen en ese documento. Todos los conjuntos de pesos de mezcla comparten hiperparámetros comunes .

Una extensión muy común es conectar las variables latentes que definen las identidades de los componentes de la mezcla en una cadena de Markov , en lugar de asumir que son variables aleatorias independientes distribuidas de manera idéntica . El modelo resultante se denomina modelo oculto de Markov y es uno de los modelos jerárquicos secuenciales más comunes. Se han desarrollado numerosas extensiones de modelos ocultos de Markov; consulte el artículo resultante para obtener más información.

Las distribuciones de mezclas y el problema de la descomposición de las mezclas, es decir, la identificación de sus componentes constituyentes y sus parámetros, se han citado en la literatura ya en 1846 (Quetelet en McLachlan, [17] 2000), aunque se hace referencia común a la trabajo de Karl Pearson (1894) [21] como el primer autor que abordó explícitamente el problema de la descomposición al caracterizar atributos anormales de las proporciones de longitud de la frente a la longitud del cuerpo en poblaciones hembras de cangrejos de costa. La motivación para este trabajo fue proporcionada por el zoólogo Walter Frank Raphael Weldon, quien había especulado en 1893 (en Tarter y Lock [12] ) que la asimetría en el histograma de estas proporciones podría indicar una divergencia evolutiva. El enfoque de Pearson fue ajustar una mezcla univariante de dos normales a los datos eligiendo los cinco parámetros de la mezcla de manera que los momentos empíricos coincidieran con los del modelo.

Si bien su trabajo logró identificar dos subpoblaciones potencialmente distintas y demostrar la flexibilidad de las mezclas como herramienta de coincidencia de momentos, la formulación requirió la solución de un polinomio de noveno grado (nónico) que en ese momento planteaba un desafío computacional significativo.

Los trabajos posteriores se centraron en abordar estos problemas, pero no fue hasta la llegada de la computadora moderna y la popularización de las técnicas de parametrización de Máxima Verosimilitud (MLE) que la investigación realmente despegó. [22] Desde entonces ha habido una gran cantidad de investigaciones sobre el tema que abarcan áreas como la investigación pesquera , la agricultura , la botánica , la economía , la medicina , la genética , la psicología , la paleontología , la electroforesis , las finanzas , la geología y la zoología . [23]

{{cite conference}}: CS1 maint: numeric names: authors list (link)