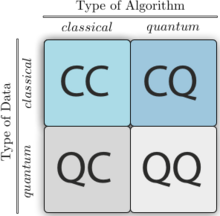

El aprendizaje automático cuántico es la integración de algoritmos cuánticos dentro de programas de aprendizaje automático . [1] [2] [3] [4] [5] [6] [7] [8]

El uso más común del término se refiere a algoritmos de aprendizaje automático para el análisis de datos clásicos ejecutados en una computadora cuántica , es decir, aprendizaje automático mejorado cuánticamente. [9] [10] [11] Mientras que los algoritmos de aprendizaje automático se utilizan para calcular inmensas cantidades de datos, el aprendizaje automático cuántico utiliza qubits y operaciones cuánticas o sistemas cuánticos especializados para mejorar la velocidad computacional y el almacenamiento de datos realizado por algoritmos en un programa. [12] Esto incluye métodos híbridos que involucran procesamiento clásico y cuántico, donde las subrutinas computacionalmente difíciles se subcontratan a un dispositivo cuántico. [13] [14] [15] Estas rutinas pueden ser de naturaleza más compleja y ejecutarse más rápido en una computadora cuántica. [7] Además, los algoritmos cuánticos se pueden utilizar para analizar estados cuánticos en lugar de datos clásicos. [16] [17]

Más allá de la computación cuántica, el término "aprendizaje automático cuántico" también se asocia con los métodos clásicos de aprendizaje automático aplicados a datos generados a partir de experimentos cuánticos (es decir, aprendizaje automático de sistemas cuánticos ), como el aprendizaje de las transiciones de fase de un sistema cuántico [18] [19] o la creación de nuevos experimentos cuánticos. [20] [21] [22]

El aprendizaje automático cuántico también se extiende a una rama de investigación que explora las similitudes metodológicas y estructurales entre ciertos sistemas físicos y sistemas de aprendizaje, en particular las redes neuronales. Por ejemplo, algunas técnicas matemáticas y numéricas de la física cuántica son aplicables al aprendizaje profundo clásico y viceversa. [23] [24] [25]

Además, los investigadores investigan nociones más abstractas de la teoría del aprendizaje con respecto a la información cuántica, a veces denominada "teoría del aprendizaje cuántico". [26] [27]

El aprendizaje automático mejorado cuánticamente se refiere a algoritmos cuánticos que resuelven tareas de aprendizaje automático, mejorando y a menudo acelerando las técnicas clásicas de aprendizaje automático. Estos algoritmos suelen requerir que se codifique el conjunto de datos clásicos dado en una computadora cuántica para que sea accesible para el procesamiento de información cuántica. Posteriormente, se aplican rutinas de procesamiento de información cuántica y el resultado del cálculo cuántico se lee midiendo el sistema cuántico. Por ejemplo, el resultado de la medición de un cúbit revela el resultado de una tarea de clasificación binaria. Si bien muchas propuestas de algoritmos de aprendizaje automático cuántico aún son puramente teóricas y requieren una computadora cuántica universal a gran escala para ser probadas, otras se han implementado en dispositivos cuánticos de pequeña escala o de propósito especial.

Las memorias asociativas (o memorias direccionables por contenido) son capaces de reconocer el contenido almacenado basándose en una medida de similitud, en lugar de direcciones fijas, como en las memorias de acceso aleatorio. Por ello, deben poder recuperar patrones tanto incompletos como corruptos, la tarea esencial del aprendizaje automático de reconocimiento de patrones.

Las memorias asociativas clásicas típicas almacenan p patrones en las interacciones (sinapsis) de una matriz de energía real y simétrica sobre una red de n neuronas artificiales. La codificación es tal que los patrones deseados son mínimos locales del funcional energético y la recuperación se realiza minimizando la energía total, a partir de una configuración inicial.

Lamentablemente, las memorias asociativas clásicas están severamente limitadas por el fenómeno de la diafonía . Cuando se almacenan demasiados patrones, aparecen recuerdos espurios que proliferan rápidamente, de modo que el paisaje energético se desordena y ya no es posible recuperarlos. El número de patrones almacenables suele estar limitado por una función lineal del número de neuronas .

Las memorias asociativas cuánticas [2] [3] [4] (en su realización más simple) almacenan patrones en una matriz unitaria U que actúa sobre el espacio de Hilbert de n qubits. La recuperación se realiza mediante la evolución unitaria de un estado inicial fijo a una superposición cuántica de los patrones deseados con una distribución de probabilidad máxima en el patrón más similar a una entrada. Por su propia naturaleza cuántica, el proceso de recuperación es, por tanto, probabilístico. Sin embargo, como las memorias asociativas cuánticas están libres de interferencias, nunca se generan memorias espurias. En consecuencia, tienen una capacidad superior a las clásicas. El número de parámetros en la matriz unitaria U es . Por tanto, se pueden tener memorias asociativas cuánticas eficientes y libres de memoria espuria para cualquier número polinómico de patrones.

Varios algoritmos cuánticos para el aprendizaje automático se basan en la idea de codificación de amplitud, es decir, asociar las amplitudes de un estado cuántico con las entradas y salidas de los cálculos. [30] [31] [32] Dado que un estado de qubits se describe mediante amplitudes complejas, esta codificación de información puede permitir una representación exponencialmente compacta. Intuitivamente, esto corresponde a asociar una distribución de probabilidad discreta sobre variables aleatorias binarias con un vector clásico. El objetivo de los algoritmos basados en la codificación de amplitud es formular algoritmos cuánticos cuyos recursos crezcan polinomialmente en el número de qubits , lo que equivale a una complejidad temporal logarítmica en el número de amplitudes y, por lo tanto, la dimensión de la entrada.

Muchos algoritmos de aprendizaje automático cuántico en esta categoría se basan en variaciones del algoritmo cuántico para sistemas lineales de ecuaciones [33] (coloquialmente llamado HHL, en honor a los autores del artículo) que, bajo condiciones específicas, realiza una inversión de matriz utilizando una cantidad de recursos físicos que crece solo logarítmicamente en las dimensiones de la matriz. Una de estas condiciones es que un hamiltoniano que corresponde a la matriz por entrada se puede simular de manera eficiente, lo que se sabe que es posible si la matriz es dispersa [34] o de rango bajo. [35] Como referencia, cualquier algoritmo clásico conocido para la inversión de matrices requiere una cantidad de operaciones que crece más que cuadráticamente en la dimensión de la matriz (por ejemplo, ), pero no están restringidas a matrices dispersas.

La inversión de matrices cuánticas se puede aplicar a métodos de aprendizaje automático en los que el entrenamiento se reduce a la solución de un sistema lineal de ecuaciones , por ejemplo, en la regresión lineal de mínimos cuadrados, [31] [32] la versión de mínimos cuadrados de las máquinas de vectores de soporte , [30] y los procesos gaussianos. [36]

Un obstáculo crucial para los métodos que simulan cálculos de álgebra lineal con las amplitudes de estados cuánticos es la preparación de estados, que a menudo requiere inicializar un sistema cuántico en un estado cuyas amplitudes reflejen las características de todo el conjunto de datos. Aunque se conocen métodos eficientes para la preparación de estados para casos específicos, [37] [38] este paso oculta fácilmente la complejidad de la tarea. [39] [40]

Los algoritmos cuánticos de calidad de datos (VQA) son uno de los algoritmos cuánticos más estudiados, ya que los investigadores esperan que todas las aplicaciones necesarias para la computadora cuántica utilicen los VQA y también los VQA parecen cumplir con la expectativa de obtener la supremacía cuántica. Los VQA son un enfoque cuántico-clásico mixto donde el procesador cuántico prepara los estados cuánticos y se realiza la medición y la optimización se realiza mediante una computadora clásica. Los VQA se consideran mejores para NISQ ya que los VQA son tolerantes al ruido en comparación con otros algoritmos y brindan superioridad cuántica con solo unos pocos cientos de qubits. Los investigadores han estudiado algoritmos basados en circuitos para resolver problemas de optimización y encontrar la energía del estado fundamental de sistemas complejos, que eran difíciles de resolver o requerían mucho tiempo para realizar el cálculo utilizando una computadora clásica. [41] [42]

Los circuitos cuánticos variacionales, también conocidos como circuitos cuánticos parametrizados (PQC), se basan en algoritmos cuánticos variacionales (VQA). Los VQC constan de tres partes: preparación de estados iniciales, circuito cuántico y medición. Los investigadores están estudiando ampliamente los VQC, ya que utilizan el poder de la computación cuántica para aprender en poco tiempo y también utilizan menos parámetros que sus contrapartes clásicas. Está demostrado teórica y numéricamente que podemos aproximar funciones no lineales, como las que se utilizan en redes neuronales, en circuitos cuánticos. Debido a la superioridad de los VQC, la red neuronal ha sido reemplazada por VQC en tareas de aprendizaje por refuerzo y algoritmos generativos. La naturaleza intrínseca de los dispositivos cuánticos hacia la decoherencia, el error de compuerta aleatorio y los errores de medición hicieron que tuvieran un alto potencial para limitar el entrenamiento de los circuitos de variación. Entrenar los VQC en los dispositivos clásicos antes de emplearlos en dispositivos cuánticos ayuda a superar el problema del ruido de decoherencia que se produjo a través del número de repeticiones para el entrenamiento. [43] [44] [45]

La reorganización de patrones es una de las tareas importantes del aprendizaje automático, la clasificación binaria es una de las herramientas o algoritmos para encontrar patrones. La clasificación binaria se utiliza en el aprendizaje supervisado y en el aprendizaje no supervisado . En el aprendizaje automático cuántico, los bits clásicos se convierten en qubits y se asignan al espacio de Hilbert; los datos de valores complejos se utilizan en un clasificador binario cuántico para aprovechar las ventajas del espacio de Hilbert. [46] [47] Al explotar las propiedades de la mecánica cuántica, como la superposición, el entrelazamiento y la interferencia, el clasificador binario cuántico produce el resultado preciso en un corto período de tiempo. [48]

Otro enfoque para mejorar el aprendizaje automático clásico con procesamiento de información cuántica utiliza métodos de amplificación de amplitud basados en el algoritmo de búsqueda de Grover , que ha demostrado resolver problemas de búsqueda no estructurada con una aceleración cuadrática en comparación con los algoritmos clásicos. Estas rutinas cuánticas se pueden emplear para algoritmos de aprendizaje que se traducen en una tarea de búsqueda no estructurada, como se puede hacer, por ejemplo, en el caso de los algoritmos de k-medianas [49] y de k-vecinos más cercanos [9] . Otras aplicaciones incluyen aceleraciones cuadráticas en el entrenamiento del perceptrón [50] y el cálculo de la atención [51] .

Un ejemplo de amplificación de amplitud que se utiliza en un algoritmo de aprendizaje automático es la minimización del algoritmo de búsqueda de Grover. En el que una subrutina utiliza el algoritmo de búsqueda de Grover para encontrar un elemento menor que algún elemento previamente definido. Esto se puede hacer con un oráculo que determina si un estado con un elemento correspondiente es menor que el predefinido. El algoritmo de Grover puede entonces encontrar un elemento tal que se cumpla nuestra condición. La minimización se inicializa con algún elemento aleatorio en nuestro conjunto de datos, y realiza iterativamente esta subrutina para encontrar el elemento mínimo en el conjunto de datos. Esta minimización se utiliza notablemente en k-medianas cuánticas, y tiene una velocidad de al menos en comparación con las versiones clásicas de k-medianas, donde es el número de puntos de datos y es el número de clústeres. [49]

La amplificación de amplitud se combina a menudo con los recorridos cuánticos para lograr la misma aceleración cuadrática. Se ha propuesto que los recorridos cuánticos mejoran el algoritmo PageRank de Google [52], así como el rendimiento de los agentes de aprendizaje de refuerzo en el marco de simulación proyectiva. [53]

El aprendizaje por refuerzo es una rama del aprendizaje automático distinta del aprendizaje supervisado y no supervisado, que también admite mejoras cuánticas. [54] [53] [55] En el aprendizaje por refuerzo mejorado cuánticamente, un agente cuántico interactúa con un entorno clásico o cuántico y ocasionalmente recibe recompensas por sus acciones, lo que le permite adaptar su comportamiento, es decir, aprender qué hacer para obtener más recompensas. En algunas situaciones, ya sea por la capacidad de procesamiento cuántico del agente, [53] o por la posibilidad de sondear el entorno en superposiciones , [29] se puede lograr una aceleración cuántica. Se han propuesto implementaciones de este tipo de protocolos para sistemas de iones atrapados [56] y circuitos superconductores . [57] Se ha demostrado experimentalmente una aceleración cuántica del tiempo de toma de decisiones internas del agente [53] en iones atrapados, [58] mientras que se ha logrado experimentalmente una aceleración cuántica del tiempo de aprendizaje en una interacción totalmente coherente («cuántica») entre el agente y el entorno en una configuración fotónica. [59]

El recocido cuántico es una técnica de optimización que se utiliza para determinar los mínimos y máximos locales de una función sobre un conjunto dado de funciones candidatas. Se trata de un método de discretización de una función con muchos mínimos o máximos locales para determinar los observables de la función. El proceso se puede distinguir del recocido simulado por el proceso de tunelización cuántica , mediante el cual las partículas atraviesan barreras cinéticas o potenciales desde un estado alto a un estado bajo. El recocido cuántico comienza con una superposición de todos los estados posibles de un sistema, ponderados de forma igual. A continuación, la ecuación de Schrödinger dependiente del tiempo guía la evolución temporal del sistema, lo que sirve para afectar la amplitud de cada estado a medida que aumenta el tiempo. Finalmente, se puede alcanzar el estado fundamental para obtener el hamiltoniano instantáneo del sistema.

A medida que avanza la profundidad del circuito cuántico en los dispositivos NISQ , aumenta el nivel de ruido, lo que plantea un desafío significativo para calcular con precisión los costos y gradientes en los modelos de entrenamiento. La tolerancia al ruido se mejorará mediante el uso del perceptrón cuántico y el algoritmo cuántico en el hardware cuántico actualmente accesible. [ cita requerida ]

Una conexión regular de componentes similares, conocidos como neuronas, forma la base de incluso las redes cerebrales más complejas. Normalmente, una neurona tiene dos operaciones: el producto interno y una función de activación . A diferencia de la función de activación, que normalmente es no lineal , el producto interno es un proceso lineal. Con la computación cuántica, los procesos lineales se pueden llevar a cabo fácilmente; además, debido a la simplicidad de implementación, la mayoría de las neuronas cuánticas prefieren la función umbral para las funciones de activación. [ cita requerida ]

El muestreo a partir de distribuciones de probabilidad de alta dimensión es el núcleo de un amplio espectro de técnicas computacionales con importantes aplicaciones en la ciencia, la ingeniería y la sociedad. Algunos ejemplos son el aprendizaje profundo , la programación probabilística y otras aplicaciones de aprendizaje automático e inteligencia artificial.

Un problema computacionalmente difícil, que es clave para algunas tareas relevantes de aprendizaje automático, es la estimación de promedios sobre modelos probabilísticos definidos en términos de una distribución de Boltzmann . El muestreo a partir de modelos probabilísticos genéricos es difícil: se espera que los algoritmos que dependen en gran medida del muestreo sigan siendo intratables sin importar cuán grandes y poderosos se vuelvan los recursos de computación clásica. Si bien los recocidos cuánticos, como los producidos por D-Wave Systems, fueron diseñados para problemas de optimización combinatoria desafiantes, recientemente se los ha reconocido como un candidato potencial para acelerar los cálculos que dependen del muestreo al explotar los efectos cuánticos. [60]

Algunos grupos de investigación han explorado recientemente el uso de hardware de recocido cuántico para entrenar máquinas de Boltzmann y redes neuronales profundas . [61] [62] [63] El enfoque estándar para entrenar máquinas de Boltzmann se basa en el cálculo de ciertos promedios que pueden estimarse mediante técnicas de muestreo estándar , como los algoritmos de Monte Carlo de cadena de Markov . Otra posibilidad es confiar en un proceso físico, como el recocido cuántico, que genera naturalmente muestras a partir de una distribución de Boltzmann. El objetivo es encontrar los parámetros de control óptimos que mejor representen la distribución empírica de un conjunto de datos dado.

El sistema D-Wave 2X alojado en el Centro de Investigación Ames de la NASA se ha utilizado recientemente para el aprendizaje de una clase especial de máquinas de Boltzmann restringidas que pueden servir como un bloque de construcción para arquitecturas de aprendizaje profundo. [62] Un trabajo complementario que apareció aproximadamente de manera simultánea mostró que el recocido cuántico se puede utilizar para el aprendizaje supervisado en tareas de clasificación. [61] El mismo dispositivo se utilizó más tarde para entrenar una máquina de Boltzmann completamente conectada para generar, reconstruir y clasificar dígitos escritos a mano de baja resolución y escala reducida, entre otros conjuntos de datos sintéticos. [64] En ambos casos, los modelos entrenados mediante recocido cuántico tuvieron un rendimiento similar o mejor en términos de calidad. La pregunta fundamental que impulsa este esfuerzo es si existe una aceleración cuántica en las aplicaciones de muestreo. La experiencia con el uso de recocidos cuánticos para la optimización combinatoria sugiere que la respuesta no es sencilla. El recocido inverso también se ha utilizado para resolver una máquina de Boltzmann restringida cuántica completamente conectada. [65]

Inspirado por el éxito de las máquinas de Boltzmann basadas en la distribución clásica de Boltzmann, recientemente se propuso un nuevo enfoque de aprendizaje automático basado en la distribución cuántica de Boltzmann de un hamiltoniano de Ising de campo transversal. [66] Debido a la naturaleza no conmutativa de la mecánica cuántica, el proceso de entrenamiento de la máquina cuántica de Boltzmann puede volverse no trivial. Este problema se eludió, hasta cierto punto, introduciendo límites en las probabilidades cuánticas, lo que permitió a los autores entrenar el modelo de manera eficiente mediante muestreo. Es posible que se haya entrenado un tipo específico de máquina cuántica de Boltzmann en D-Wave 2X utilizando una regla de aprendizaje análoga a la de las máquinas clásicas de Boltzmann. [64] [63] [67]

El recocido cuántico no es la única tecnología para el muestreo. En un escenario de preparación y medición, una computadora cuántica universal prepara un estado térmico, que luego se muestrea mediante mediciones. Esto puede reducir el tiempo requerido para entrenar una máquina de Boltzmann restringida profunda y proporcionar un marco más rico y completo para el aprendizaje profundo que la computación clásica. [68] Los mismos métodos cuánticos también permiten un entrenamiento eficiente de máquinas de Boltzmann completas y modelos multicapa completamente conectados y no tienen contrapartes clásicas bien conocidas. Basándose en un protocolo eficiente de preparación del estado térmico a partir de un estado arbitrario, las redes lógicas de Markov mejoradas cuánticamente explotan las simetrías y la estructura de localidad del modelo gráfico probabilístico generado por una plantilla lógica de primer orden . [69] [19] Esto proporciona una reducción exponencial en la complejidad computacional en la inferencia probabilística y, si bien el protocolo se basa en una computadora cuántica universal, bajo suposiciones moderadas se puede integrar en el hardware de recocido cuántico contemporáneo.

Los análogos cuánticos o generalizaciones de las redes neuronales clásicas a menudo se denominan redes neuronales cuánticas . El término es reivindicado por una amplia gama de enfoques, incluida la implementación y extensión de redes neuronales que utilizan fotones, circuitos variacionales en capas o modelos cuánticos de tipo Ising. Las redes neuronales cuánticas a menudo se definen como una expansión del modelo de Deutsch de una red computacional cuántica. [70] Dentro de este modelo, se implementan puertas no lineales e irreversibles, diferentes al operador hamiltoniano, para especular el conjunto de datos dado. [70] Estas puertas hacen que ciertas fases no se puedan observar y generan oscilaciones específicas. [70] Las redes neuronales cuánticas aplican los principios de la información cuántica y la computación cuántica a la neurocomputación clásica. [71] La investigación actual muestra que QNN puede aumentar exponencialmente la cantidad de potencia de cálculo y los grados de libertad de una computadora, que está limitada para una computadora clásica a su tamaño. [71] Una red neuronal cuántica tiene capacidades computacionales para disminuir la cantidad de pasos, qubits utilizados y tiempo de cálculo. [70] La función de onda de la mecánica cuántica es la neurona de las redes neuronales. Para probar las aplicaciones cuánticas en una red neuronal, se depositan moléculas de puntos cuánticos sobre un sustrato de GaAs o similar para registrar cómo se comunican entre sí. Cada punto cuántico puede considerarse una isla de actividad eléctrica y, cuando dichos puntos están lo suficientemente cerca (aproximadamente entre 10 y 20 nm), [72] los electrones pueden hacer un túnel debajo de las islas. Una distribución uniforme a lo largo del sustrato en grupos de dos crea dipolos y, en última instancia, dos estados de espín, arriba o abajo. Estos estados se conocen comúnmente como qubits, con los estados correspondientes de y en la notación de Dirac. [72]

Un diseño novedoso para vectores multidimensionales que utiliza circuitos como filtros de convolución [73] es QCNN. Se inspiró en las ventajas de las CNN [74] [75] y la potencia de QML. Se realizó utilizando una combinación de un circuito cuántico variacional (VQC) [76] y una red neuronal profunda [77] (DNN), aprovechando al máximo el poder del procesamiento extremadamente paralelo en una superposición de un estado cuántico con un número finito de qubits. La estrategia principal es llevar a cabo un proceso de optimización iterativo en los dispositivos NISQ [78] , sin el impacto negativo del ruido, que posiblemente se incorpore al parámetro del circuito, y sin la necesidad de corrección de errores cuánticos. [79]

El circuito cuántico debe manejar de manera efectiva la información espacial para que la QCNN funcione como CNN. El filtro convolucional es la técnica más básica para hacer uso de la información espacial. Uno o más filtros convolucionales cuánticos conforman una red neuronal convolucional cuántica (QCNN), y cada uno de estos filtros transforma los datos de entrada utilizando un circuito cuántico que puede crearse de manera organizada o aleatoria. Tres partes que conforman el filtro convolucional cuántico son: el codificador, el circuito cuántico parametrizado (PQC), [80] y la medición. El filtro convolucional cuántico puede verse como una extensión del filtro en la CNN tradicional porque fue diseñado con parámetros entrenables.

Las redes neuronales cuánticas aprovechan las estructuras jerárquicas [81] y, para cada capa posterior, el número de qubits de la capa anterior se reduce en un factor de dos. Para n qubits de entrada, estas estructuras tienen capas O(log(n)), lo que permite una profundidad de circuito reducida. Además, pueden evitar la "meseta estéril", uno de los problemas más importantes de los algoritmos basados en PQC, lo que garantiza la capacidad de entrenamiento [82] . A pesar de que el modelo QCNN no incluye la operación cuántica correspondiente, también se ofrece la idea fundamental de la capa de agrupación para asegurar la validez. En la arquitectura QCNN, la capa de agrupación se coloca normalmente entre capas convolucionales sucesivas. Su función es reducir el tamaño espacial de la representación al tiempo que se conservan las características cruciales, lo que le permite reducir el número de parámetros, agilizar la computación de la red y gestionar el sobreajuste. Dicho proceso se puede lograr aplicando una tomografía completa sobre el estado para reducirlo hasta un qubit y luego procesarlo en el metro. El tipo de unidad que se utiliza con más frecuencia en la capa de agrupamiento es el agrupamiento máximo, aunque también existen otros tipos. De manera similar a las redes neuronales de propagación hacia adelante convencionales , el último módulo es una capa completamente conectada con conexiones completas a todas las activaciones en la capa anterior. La invariancia traslacional, que requiere bloques idénticos de puertas cuánticas parametrizadas dentro de una capa, es una característica distintiva de la arquitectura QCNN. [83]

Las QNN disipativas (DQNN) se construyen a partir de capas de qubits acoplados por perceptrones llamados bloques de construcción, que tienen un diseño unitario arbitrario. A cada nodo en la capa de red de una DQNN se le da una colección distinta de qubits, y a cada qubit también se le da un perceptrón cuántico único unitario para caracterizarlo. [84] [85] La información de los estados de entrada se transporta a través de la red en un modo de avance, mapeo de transición de capa a capa en los qubits de las dos capas adyacentes, como lo indica el nombre. El término disipativo también se refiere al hecho de que la capa de salida está formada por los qubits auxiliares mientras que las capas de entrada se descartan mientras se traza la capa final. [86] Al realizar una amplia tarea de aprendizaje supervisado, las DQNN se utilizan para aprender una matriz unitaria que conecta los estados cuánticos de entrada y salida. Los datos de entrenamiento para esta tarea consisten en el estado cuántico y las etiquetas clásicas correspondientes.

Inspirada en la extremadamente exitosa red generativa antagónica clásica (GAN) , [87] se introduce la red generativa antagónica cuántica disipativa (DQGAN) para el aprendizaje no supervisado de los datos de entrenamiento no etiquetados. El generador y el discriminador son las dos DQNN que forman una única DQGAN. [85] El objetivo del generador es crear estados de entrenamiento falsos que el discriminador no puede diferenciar de los genuinos, mientras que el objetivo del discriminador es separar los estados de entrenamiento reales de los estados falsos creados por el generador. Las características relevantes del conjunto de entrenamiento son aprendidas por el generador mediante el entrenamiento alternativo y antagónico de las redes que ayudan en la producción de conjuntos que extienden el conjunto de entrenamiento. DQGAN tiene una arquitectura completamente cuántica y está entrenada en datos cuánticos.

Los modelos cuánticos ocultos de Markov [88] (HQMM) son una versión mejorada cuánticamente de los modelos ocultos de Markov clásicos (HMM), que se utilizan normalmente para modelar datos secuenciales en varios campos como la robótica y el procesamiento del lenguaje natural . A diferencia del enfoque adoptado por otros algoritmos de aprendizaje automático mejorados cuánticamente, los HQMM pueden verse como modelos inspirados en la mecánica cuántica que también pueden ejecutarse en computadoras clásicas. [89] Mientras que los HMM clásicos utilizan vectores de probabilidad para representar estados de "creencia" ocultos, los HQMM utilizan el análogo cuántico: matrices de densidad . Trabajos recientes han demostrado que estos modelos se pueden aprender con éxito maximizando la verosimilitud logarítmica de los datos dados a través de la optimización clásica, y hay alguna evidencia empírica de que estos modelos pueden modelar mejor los datos secuenciales en comparación con los HMM clásicos en la práctica, aunque se necesita más trabajo para determinar exactamente cuándo y cómo se derivan estos beneficios. [89] Además, dado que los HMM clásicos son un tipo particular de red de Bayes , un aspecto interesante de los HQMM es que las técnicas utilizadas muestran cómo podemos realizar inferencia bayesiana análoga a la cuántica , lo que debería permitir la construcción general de las versiones cuánticas de modelos gráficos probabilísticos . [89]

En el caso más general del aprendizaje automático cuántico, tanto el dispositivo de aprendizaje como el sistema en estudio, así como su interacción, son completamente cuánticos. En esta sección se ofrecen algunos ejemplos de resultados sobre este tema.

Una clase de problema que puede beneficiarse del enfoque completamente cuántico es el de "aprender" estados, procesos o mediciones cuánticas desconocidas, en el sentido de que uno puede reproducirlos posteriormente en otro sistema cuántico. Por ejemplo, uno puede desear aprender una medición que discrimine entre dos estados coherentes, dada no una descripción clásica de los estados a discriminar, sino en cambio un conjunto de sistemas cuánticos de ejemplo preparados en estos estados. El enfoque ingenuo sería extraer primero una descripción clásica de los estados y luego implementar una medición discriminante ideal basada en esta información. Esto solo requeriría aprendizaje clásico. Sin embargo, uno puede demostrar que un enfoque completamente cuántico es estrictamente superior en este caso. [90] (Esto también se relaciona con el trabajo sobre la coincidencia de patrones cuánticos. [91] ) El problema de aprender transformaciones unitarias se puede abordar de una manera similar. [92]

Más allá del problema específico de aprender estados y transformaciones, la tarea de agrupamiento también admite una versión completamente cuántica, en la que tanto el oráculo que devuelve la distancia entre los puntos de datos como el dispositivo de procesamiento de información que ejecuta el algoritmo son cuánticos. [93] Finalmente, en [29] se introdujo un marco general que abarca el aprendizaje supervisado, no supervisado y de refuerzo en el entorno completamente cuántico, donde también se demostró que la posibilidad de sondear el entorno en superposiciones permite una aceleración cuántica en el aprendizaje de refuerzo. Tal aceleración en el paradigma del aprendizaje de refuerzo se ha demostrado experimentalmente en una configuración fotónica. [59]

La necesidad de modelos que puedan ser entendidos por humanos surge en el aprendizaje automático cuántico en analogía con el aprendizaje automático clásico e impulsa el campo de investigación del aprendizaje automático cuántico explicable (o XQML [94] en analogía con XAI/XML ). Estos esfuerzos a menudo también se conocen como aprendizaje automático interpretable (IML, y por extensión IQML). [95] XQML/IQML puede considerarse como una dirección de investigación alternativa en lugar de encontrar una ventaja cuántica. [96] Por ejemplo, XQML se ha utilizado en el contexto de la detección y clasificación de malware móvil. [97] También se han propuesto valores cuánticos de Shapley para interpretar puertas dentro de un circuito basado en un enfoque de teoría de juegos. [94] Para este propósito, las puertas en lugar de las características actúan como jugadores en un juego de coalición con una función de valor que depende de las mediciones del circuito cuántico de interés. Además, también se ha propuesto una versión cuántica de la técnica clásica conocida como LIME (Explicaciones agnósticas del modelo interpretable lineal) [98] , conocida como Q-LIME. [99]

El término "aprendizaje automático cuántico" a veces se refiere al aprendizaje automático clásico realizado sobre datos de sistemas cuánticos. Un ejemplo básico de esto es la tomografía de estados cuánticos , donde se aprende un estado cuántico a partir de mediciones. Otras aplicaciones incluyen el aprendizaje de hamiltonianos [100] y la generación automática de experimentos cuánticos. [20]

La teoría del aprendizaje cuántico persigue un análisis matemático de las generalizaciones cuánticas de los modelos de aprendizaje clásicos y de las posibles aceleraciones u otras mejoras que pueden proporcionar. El marco es muy similar al de la teoría clásica del aprendizaje computacional , pero el alumno en este caso es un dispositivo de procesamiento de información cuántica, mientras que los datos pueden ser clásicos o cuánticos. La teoría del aprendizaje cuántico debe contrastarse con el aprendizaje automático mejorado cuánticamente discutido anteriormente, donde el objetivo era considerar problemas específicos y utilizar protocolos cuánticos para mejorar la complejidad temporal de los algoritmos clásicos para estos problemas. Aunque la teoría del aprendizaje cuántico aún está en desarrollo, se han obtenido resultados parciales en esta dirección. [101]

El punto de partida de la teoría del aprendizaje suele ser una clase de conceptos, un conjunto de conceptos posibles. Normalmente, un concepto es una función de algún dominio, como . Por ejemplo, la clase de conceptos podría ser el conjunto de fórmulas de forma normal disyuntiva (DNF) en n bits o el conjunto de circuitos booleanos de cierta profundidad constante. El objetivo del alumno es aprender (de forma exacta o aproximada) un concepto objetivo desconocido de esta clase de conceptos. El alumno puede estar interactuando activamente con el concepto objetivo o recibiendo muestras pasivas de él.

En el aprendizaje activo, un alumno puede realizar consultas de pertenencia al concepto objetivo c, preguntando por su valor c(x) en las entradas x elegidas por el alumno. El alumno luego tiene que reconstruir el concepto objetivo exacto, con alta probabilidad. En el modelo de aprendizaje cuántico exacto, el alumno puede realizar consultas de pertenencia en superposición cuántica. Si la complejidad del alumno se mide por la cantidad de consultas de pertenencia que realiza, entonces los alumnos cuánticos exactos pueden ser polinómicamente más eficientes que los alumnos clásicos para algunas clases de conceptos, pero no más. [102] Si la complejidad se mide por la cantidad de tiempo que utiliza el alumno, entonces hay clases de conceptos que pueden ser aprendidas eficientemente por los alumnos cuánticos pero no por los alumnos clásicos (bajo supuestos plausibles de teoría de la complejidad). [102]

Un modelo natural de aprendizaje pasivo es el aprendizaje probablemente aproximadamente correcto (PAC) de Valiant . Aquí el alumno recibe ejemplos aleatorios (x, c(x)), donde x se distribuye según alguna distribución desconocida D. El objetivo del alumno es generar una función de hipótesis h tal que h(x)=c(x) con alta probabilidad cuando x se extrae según D. El alumno tiene que ser capaz de producir dicha h "aproximadamente correcta" para cada D y cada concepto objetivo c en su clase de concepto. Podemos considerar reemplazar los ejemplos aleatorios por ejemplos cuánticos potencialmente más poderosos . En el modelo PAC (y el modelo agnóstico relacionado), esto no reduce significativamente el número de ejemplos necesarios: para cada clase de concepto, la complejidad de la muestra clásica y cuántica son las mismas hasta factores constantes. [103] Sin embargo, para aprender bajo alguna distribución fija D, los ejemplos cuánticos pueden ser muy útiles, por ejemplo para aprender DNF bajo la distribución uniforme. [104] Al considerar la complejidad temporal, existen clases de conceptos que pueden ser aprendidas mediante PAC de manera eficiente por aprendices cuánticos, incluso a partir de ejemplos clásicos, pero no por aprendices clásicos (de nuevo, bajo supuestos plausibles de teoría de la complejidad). [102]

Este tipo de aprendizaje pasivo es también el esquema más común en el aprendizaje supervisado: un algoritmo de aprendizaje normalmente toma los ejemplos de entrenamiento fijos, sin la capacidad de consultar la etiqueta de los ejemplos no etiquetados. Generar una hipótesis h es un paso de inducción. Clásicamente, un modelo inductivo se divide en una fase de entrenamiento y una fase de aplicación: los parámetros del modelo se estiman en la fase de entrenamiento y el modelo aprendido se aplica un número arbitrario de veces en la fase de aplicación. En el límite asintótico del número de aplicaciones, esta división de fases también está presente con los recursos cuánticos. [105]

Los primeros experimentos se llevaron a cabo utilizando la computadora cuántica adiabática D-Wave , por ejemplo, para detectar automóviles en imágenes digitales utilizando un impulso regularizado con una función objetivo no convexa en una demostración en 2009. [106] Muchos experimentos siguieron con la misma arquitectura, y las principales empresas tecnológicas han mostrado interés en el potencial del aprendizaje automático cuántico para futuras implementaciones tecnológicas. En 2013, Google Research, la NASA y la Asociación de Investigación Espacial de Universidades lanzaron el Laboratorio de Inteligencia Artificial Cuántica que explora el uso de la computadora cuántica adiabática D-Wave. [107] [108] Un ejemplo más reciente entrenó modelos generativos probabilísticos con conectividad por pares arbitraria, mostrando que su modelo es capaz de generar dígitos escritos a mano, así como reconstruir imágenes ruidosas de barras y rayas y dígitos escritos a mano. [64]

Utilizando una tecnología de recocido diferente basada en resonancia magnética nuclear (RMN), se implementó una red de Hopfield cuántica en 2009 que mapeó los datos de entrada y los datos memorizados a hamiltonianos, lo que permitió el uso de computación cuántica adiabática. [109] La tecnología de RMN también permite la computación cuántica universal, [ cita requerida ] y se utilizó para la primera implementación experimental de una máquina de vectores de soporte cuántico para distinguir los números escritos a mano "6" y "9" en una computadora cuántica de estado líquido en 2015. [110] Los datos de entrenamiento involucraron el preprocesamiento de la imagen que los mapea a vectores bidimensionales normalizados para representar las imágenes como los estados de un qubit. Las dos entradas del vector son la relación vertical y horizontal de la intensidad del píxel de la imagen. Una vez que los vectores se definen en el espacio de características , se implementó la máquina de vectores de soporte cuántico para clasificar el vector de entrada desconocido. La lectura evita la costosa tomografía cuántica al leer el estado final en términos de dirección (arriba/abajo) de la señal de RMN.

Las implementaciones fotónicas están atrayendo más atención, [111] en parte porque no requieren un enfriamiento extenso. En 2013, se demostró el reconocimiento simultáneo de dígitos y hablantes y la predicción caótica de series temporales a velocidades de datos superiores a 1 gigabyte por segundo. [112] Al utilizar fotónica no lineal para implementar un clasificador lineal totalmente óptico, un modelo de perceptrón fue capaz de aprender el límite de clasificación de manera iterativa a partir de datos de entrenamiento mediante una regla de retroalimentación. [113] Un componente básico de muchos algoritmos de aprendizaje es calcular la distancia entre dos vectores: esto se demostró experimentalmente por primera vez para hasta ocho dimensiones utilizando qubits entrelazados en una computadora cuántica fotónica en 2015. [114]

Recientemente, basándose en un enfoque neuromimético, se ha añadido un ingrediente novedoso al campo del aprendizaje automático cuántico, en forma de un llamado memristor cuántico, un modelo cuantizado del memristor clásico estándar . [115] Este dispositivo se puede construir por medio de una resistencia sintonizable, mediciones débiles en el sistema y un mecanismo clásico de retroalimentación. Se ha propuesto una implementación de un memristor cuántico en circuitos superconductores, [116] y se ha realizado un experimento con puntos cuánticos. [117] Un memristor cuántico implementaría interacciones no lineales en la dinámica cuántica que ayudarían a la búsqueda de una red neuronal cuántica completamente funcional.

Desde 2016, IBM ha lanzado una plataforma en línea basada en la nube para desarrolladores de software cuántico, llamada IBM Q Experience . Esta plataforma consta de varios procesadores cuánticos completamente operativos a los que se puede acceder a través de la API web de IBM. De esta manera, la empresa está alentando a los desarrolladores de software a buscar nuevos algoritmos a través de un entorno de desarrollo con capacidades cuánticas. Se están explorando nuevas arquitecturas de forma experimental, de hasta 32 cúbits, utilizando métodos de computación cuántica de iones atrapados y superconductores.

En octubre de 2019, se observó que la introducción de generadores de números aleatorios cuánticos (QRNG) a los modelos de aprendizaje automático, incluidas las redes neuronales y las redes neuronales convolucionales para la distribución de peso inicial aleatorio y los bosques aleatorios para los procesos de división, tuvieron un efecto profundo en su capacidad en comparación con el método clásico de generadores de números pseudoaleatorios (PRNG). [118] Sin embargo, en una publicación más reciente de 2021, estas afirmaciones no se pudieron reproducir para la inicialización del peso de la red neuronal y no se encontró ninguna ventaja significativa de usar QRNG sobre PRNG. [119] El trabajo también demostró que la generación de números aleatorios justos con una computadora cuántica de puerta es una tarea no trivial en dispositivos NISQ y, por lo tanto, los QRNG suelen ser mucho más difíciles de usar en la práctica que los PRNG.

Un artículo publicado en diciembre de 2018 informó sobre un experimento que utilizó un sistema de iones atrapados que demostró una aceleración cuántica del tiempo de deliberación de los agentes de aprendizaje de refuerzo que emplean hardware cuántico interno. [58]

En marzo de 2021, un equipo de investigadores de Austria, Países Bajos, EE. UU. y Alemania informaron sobre la demostración experimental de una aceleración cuántica del tiempo de aprendizaje de los agentes de aprendizaje de refuerzo que interactúan de forma totalmente cuántica con el entorno. [120] [59] Los grados de libertad relevantes tanto del agente como del entorno se realizaron en un procesador nanofotónico integrado compacto y totalmente ajustable.

Si bien el aprendizaje automático en sí mismo no es solo un campo de investigación, sino una industria económicamente significativa y de rápido crecimiento, y la computación cuántica es un campo bien establecido de investigación tanto teórica como experimental, el aprendizaje automático cuántico sigue siendo un campo de estudio puramente teórico. Los intentos de demostrar experimentalmente los conceptos del aprendizaje automático cuántico siguen siendo insuficientes. [ cita requerida ]

Muchos de los científicos líderes que publican extensamente en el campo del aprendizaje automático cuántico advierten sobre el gran revuelo en torno al tema y son muy comedidos cuando se les pregunta sobre sus usos prácticos en el futuro previsible. Sophia Chen [121] recopiló algunas de las declaraciones realizadas por científicos conocidos en el campo:

{{cite book}}: CS1 maint: multiple names: authors list (link)