El aprendizaje no supervisado es un método de aprendizaje automático en el que, a diferencia del aprendizaje supervisado , los algoritmos aprenden patrones exclusivamente a partir de datos sin etiquetar. [1] Dentro de este enfoque, un modelo de aprendizaje automático intenta encontrar similitudes, diferencias, patrones y estructuras en los datos por sí mismo. No se necesita intervención humana previa. [1]

Otros métodos en el espectro de supervisión son el aprendizaje por refuerzo, donde la máquina recibe solo una puntuación de rendimiento numérica como guía, [2] y la supervisión débil o semi, donde se etiqueta una pequeña porción de los datos, y la autosupervisión .

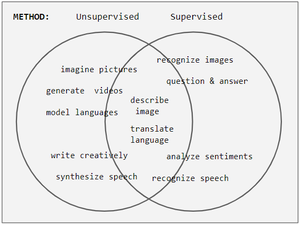

Las tareas de las redes neuronales a menudo se clasifican como discriminativas (reconocimiento) o generativas (imaginación). A menudo, pero no siempre, las tareas discriminativas utilizan métodos supervisados y las tareas generativas no supervisadas (consulte el diagrama de Venn ); sin embargo, la separación es muy confusa. Por ejemplo, el reconocimiento de objetos favorece el aprendizaje supervisado, pero el aprendizaje no supervisado también puede agrupar objetos. Además, a medida que avanza el progreso, algunas tareas emplean ambos métodos y otras pasan de uno a otro. Por ejemplo, el reconocimiento de imágenes comenzó siendo fuertemente supervisado, pero se volvió híbrido al emplear un entrenamiento previo no supervisado, y luego pasó nuevamente a la supervisión con la llegada de la deserción , ReLU y las tasas de aprendizaje adaptativo .

Durante la fase de aprendizaje, una red no supervisada intenta imitar los datos que se le proporcionan y utiliza el error en su salida imitada para corregirse (es decir, corregir sus pesos y sesgos). A veces, el error se expresa como una baja probabilidad de que se produzca una salida errónea, o puede expresarse como un estado inestable de alta energía en la red.

En contraste con el uso dominante de la retropropagación en los métodos supervisados , el aprendizaje no supervisado también emplea otros métodos que incluyen: regla de aprendizaje de Hopfield, regla de aprendizaje de Boltzmann, divergencia contrastiva , sueño de vigilia , inferencia variacional , máxima probabilidad , máxima A posteriori , muestreo de Gibbs y errores de reconstrucción de retropropagación. o reparametrizaciones de estado oculto. Consulte la siguiente tabla para obtener más detalles.

Una función de energía es una medida macroscópica del estado de activación de una red. En las máquinas Boltzmann desempeña el papel de función de coste. Esta analogía con la física está inspirada en el análisis de Ludwig Boltzmann de la energía macroscópica de un gas a partir de las probabilidades microscópicas del movimiento de partículas , donde k es la constante de Boltzmann y T es la temperatura. En la red RBM la relación es , [3] donde y varían en cada patrón de activación posible y . Para ser más precisos, donde hay un patrón de activación de todas las neuronas (visibles y ocultas). De ahí que algunas de las primeras redes neuronales lleven el nombre de Máquina de Boltzmann. Paul Smolensky la llama Armonía . Una red busca baja energía y alta armonía.

Esta tabla muestra diagramas de conexión de varias redes no supervisadas, cuyos detalles se darán en la sección Comparación de redes. Los círculos son neuronas y los bordes entre ellos son pesos de conexión. A medida que cambia el diseño de la red, se agregan funciones para habilitar nuevas capacidades o se eliminan para acelerar el aprendizaje. Por ejemplo, las neuronas cambian entre deterministas (Hopfield) y estocásticas (Boltzmann) para permitir una salida sólida, se eliminan pesos dentro de una capa (RBM) para acelerar el aprendizaje o se permite que las conexiones se vuelvan asimétricas (Helmholtz).

De las redes que llevan nombres de personas, sólo Hopfield trabajó directamente con redes neuronales. Boltzmann y Helmholtz fueron anteriores a las redes neuronales artificiales, pero su trabajo en física y fisiología inspiró los métodos analíticos que se utilizaron.

Aquí destacamos algunas características de redes seleccionadas. Los detalles de cada uno se dan en la tabla comparativa a continuación.

El ejemplo clásico de aprendizaje no supervisado en el estudio de las redes neuronales es el principio de Donald Hebb , es decir, las neuronas que se activan juntas se conectan entre sí. [6] En el aprendizaje hebbiano , la conexión se refuerza independientemente de un error, pero es función exclusivamente de la coincidencia entre los potenciales de acción entre las dos neuronas. [7] Una versión similar que modifica los pesos sinápticos tiene en cuenta el tiempo entre los potenciales de acción ( plasticidad dependiente del tiempo de pico o STDP). Se ha planteado la hipótesis de que el aprendizaje hebbiano es la base de una variedad de funciones cognitivas, como el reconocimiento de patrones y el aprendizaje experiencial.

Entre los modelos de redes neuronales , el mapa autoorganizado (SOM) y la teoría de la resonancia adaptativa (ART) se utilizan comúnmente en algoritmos de aprendizaje no supervisados. El SOM es una organización topográfica en la que las ubicaciones cercanas en el mapa representan entradas con propiedades similares. El modelo ART permite que el número de grupos varíe con el tamaño del problema y permite al usuario controlar el grado de similitud entre los miembros de los mismos grupos mediante una constante definida por el usuario llamada parámetro de vigilancia. Las redes ART se utilizan para muchas tareas de reconocimiento de patrones, como el reconocimiento automático de objetivos y el procesamiento de señales sísmicas. [8]

Dos de los principales métodos utilizados en el aprendizaje no supervisado son el análisis de componentes principales y de conglomerados . El análisis de conglomerados se utiliza en el aprendizaje no supervisado para agrupar o segmentar conjuntos de datos con atributos compartidos con el fin de extrapolar relaciones algorítmicas. [9] El análisis de conglomerados es una rama del aprendizaje automático que agrupa los datos que no han sido etiquetados , clasificados o categorizados. En lugar de responder a la retroalimentación, el análisis de conglomerados identifica puntos en común en los datos y reacciona en función de la presencia o ausencia de dichos puntos en común en cada nuevo dato. Este enfoque ayuda a detectar puntos de datos anómalos que no encajan en ninguno de los grupos.

Una aplicación central del aprendizaje no supervisado se encuentra en el campo de la estimación de densidad en estadística , [10] aunque el aprendizaje no supervisado abarca muchos otros dominios que implican resumir y explicar características de los datos. Se puede contrastar con el aprendizaje supervisado diciendo que mientras que el aprendizaje supervisado pretende inferir una distribución de probabilidad condicional condicionada a la etiqueta de los datos de entrada; El aprendizaje no supervisado pretende inferir una distribución de probabilidad a priori .

Algunos de los algoritmos más comunes utilizados en el aprendizaje no supervisado incluyen: (1) Agrupación, (2) Detección de anomalías, (3) Enfoques para aprender modelos de variables latentes. Cada enfoque utiliza varios métodos de la siguiente manera:

Uno de los enfoques estadísticos para el aprendizaje no supervisado es el método de los momentos . En el método de los momentos, los parámetros desconocidos (de interés) en el modelo están relacionados con los momentos de una o más variables aleatorias y, por tanto, estos parámetros desconocidos pueden estimarse dados los momentos. Los momentos generalmente se estiman empíricamente a partir de muestras. Los momentos básicos son momentos de primer y segundo orden. Para un vector aleatorio, el momento de primer orden es el vector medio y el momento de segundo orden es la matriz de covarianza (cuando la media es cero). Los momentos de orden superior generalmente se representan mediante tensores que son la generalización de matrices a órdenes superiores como matrices multidimensionales.

En particular, el método de los momentos ha demostrado ser eficaz para aprender los parámetros de los modelos de variables latentes . Los modelos de variables latentes son modelos estadísticos donde además de las variables observadas, también existe un conjunto de variables latentes que no se observan. Un ejemplo muy práctico de modelos de variables latentes en el aprendizaje automático es el modelado de temas , que es un modelo estadístico para generar las palabras (variables observadas) en el documento en función del tema (variable latente) del documento. En el modelado de temas, las palabras del documento se generan de acuerdo con diferentes parámetros estadísticos cuando se cambia el tema del documento. Se muestra que el método de momentos (técnicas de descomposición tensorial) recupera consistentemente los parámetros de una gran clase de modelos de variables latentes bajo algunos supuestos. [13]

El algoritmo de maximización de expectativas (EM) es también uno de los métodos más prácticos para aprender modelos de variables latentes. Sin embargo, puede quedarse atascado en los óptimos locales y no se garantiza que el algoritmo converja a los verdaderos parámetros desconocidos del modelo. En cambio, para el método de los momentos, la convergencia global está garantizada bajo algunas condiciones.