La regresión local o regresión polinomial local , [1] también conocida como regresión móvil , [2] es una generalización de la regresión polinomial y de la media móvil . [3] Sus métodos más comunes, desarrollados inicialmente para el suavizado de diagramas de dispersión , son LOESS ( suavización de diagramas de dispersión estimada localmente ) y LOWESS ( suavización de diagramas de dispersión ponderada localmente ), ambos pronunciados / ˈl oʊɛs / LOH -ess . Son dos métodos de regresión no paramétricos fuertemente relacionados que combinan modelos de regresión múltiple en un metamodelo basado en k -vecinos más cercanos . En algunos campos, LOESS se conoce y se denomina comúnmente filtro Savitzky-Golay [4] [5] (propuesto 15 años antes que LOESS).

Por lo tanto, LOESS y LOWESS se basan en métodos "clásicos" , como la regresión lineal y no lineal de mínimos cuadrados . Abordan situaciones en las que los procedimientos clásicos no funcionan bien o no se pueden aplicar de manera efectiva sin un trabajo excesivo. LOESS combina gran parte de la simplicidad de la regresión lineal de mínimos cuadrados con la flexibilidad de la regresión no lineal . Lo hace ajustando modelos simples a subconjuntos localizados de los datos para construir una función que describa la parte determinista de la variación en los datos, punto por punto. De hecho, uno de los principales atractivos de este método es que no se requiere que el analista de datos especifique una función global de ninguna forma para ajustar un modelo a los datos, solo para ajustar segmentos de los datos.

La contrapartida de estas características es un aumento de la capacidad computacional. Debido a que es tan intensivo en términos computacionales, LOESS habría sido prácticamente imposible de usar en la era en la que se estaba desarrollando la regresión de mínimos cuadrados. La mayoría de los demás métodos modernos para el modelado de procesos son similares a LOESS en este aspecto. Estos métodos han sido diseñados conscientemente para aprovechar al máximo nuestra capacidad computacional actual para lograr objetivos que no se logran fácilmente con los enfoques tradicionales.

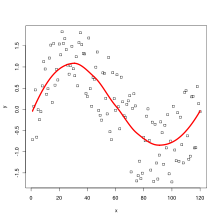

Una curva suave a través de un conjunto de puntos de datos obtenidos con esta técnica estadística se denomina curva loess , en particular cuando cada valor suavizado se obtiene mediante una regresión de mínimos cuadrados cuadráticos ponderados sobre el intervalo de valores de la variable de criterio del diagrama de dispersión del eje y . Cuando cada valor suavizado se obtiene mediante una regresión de mínimos cuadrados lineales ponderados sobre el intervalo, esto se conoce como curva loess ; sin embargo, algunas autoridades tratan a loess y loess como sinónimos. [6] [7]

En 1964, Savitsky y Golay propusieron un método equivalente a LOESS, que comúnmente se conoce como filtro Savitzky-Golay . William S. Cleveland redescubrió el método en 1979 y le dio un nombre distinto. El método fue desarrollado posteriormente por Cleveland y Susan J. Devlin (1988). LOWESS también se conoce como regresión polinómica ponderada localmente.

En cada punto del rango del conjunto de datos se ajusta un polinomio de bajo grado a un subconjunto de los datos, con valores de variable explicativa cerca del punto cuya respuesta se está estimando. El polinomio se ajusta utilizando mínimos cuadrados ponderados , dando más peso a los puntos cercanos al punto cuya respuesta se está estimando y menos peso a los puntos más alejados. El valor de la función de regresión para el punto se obtiene luego evaluando el polinomio local utilizando los valores de la variable explicativa para ese punto de datos. El ajuste LOESS se completa después de que se hayan calculado los valores de la función de regresión para cada uno de los puntos de datos. Muchos de los detalles de este método, como el grado del modelo polinomial y los pesos, son flexibles. A continuación se analizan brevemente el rango de opciones para cada parte del método y los valores predeterminados típicos.

Los subconjuntos de datos utilizados para cada ajuste de mínimos cuadrados ponderados en LOESS se determinan mediante un algoritmo de vecinos más próximos. Una entrada especificada por el usuario al procedimiento denominada "ancho de banda" o "parámetro de suavizado" determina qué cantidad de datos se utiliza para ajustar cada polinomio local. El parámetro de suavizado, , es la fracción del número total n de puntos de datos que se utilizan en cada ajuste local. El subconjunto de datos utilizado en cada ajuste de mínimos cuadrados ponderados comprende, por tanto, los puntos (redondeados al siguiente entero más grande) cuyos valores de las variables explicativas son los más cercanos al punto en el que se está estimando la respuesta. [7]

Dado que un polinomio de grado k requiere al menos k + 1 puntos para un ajuste, el parámetro de suavizado debe estar entre y 1, que denota el grado del polinomio local.

Se denomina parámetro de suavizado porque controla la flexibilidad de la función de regresión LOESS. Valores grandes de producen las funciones más suaves que oscilan menos en respuesta a las fluctuaciones de los datos. Cuanto más pequeño sea, más se ajustará la función de regresión a los datos. Sin embargo, no es recomendable utilizar un valor demasiado pequeño del parámetro de suavizado, ya que la función de regresión eventualmente comenzará a capturar el error aleatorio en los datos.

Los polinomios locales que se ajustan a cada subconjunto de los datos son casi siempre de primer o segundo grado; es decir, localmente lineales (en el sentido de línea recta) o localmente cuadráticos. El uso de un polinomio de grado cero convierte a LOESS en una media móvil ponderada . Los polinomios de grado superior funcionarían en teoría, pero producen modelos que no están realmente en el espíritu de LOESS. LOESS se basa en las ideas de que cualquier función puede aproximarse bien en un entorno pequeño mediante un polinomio de orden bajo y que los modelos simples pueden ajustarse a los datos fácilmente. Los polinomios de grado alto tenderían a sobreajustar los datos en cada subconjunto y son numéricamente inestables, lo que dificulta los cálculos precisos.

Como se mencionó anteriormente, la función de ponderación otorga el mayor peso a los puntos de datos más cercanos al punto de estimación y el menor peso a los puntos de datos que están más alejados. El uso de las ponderaciones se basa en la idea de que los puntos cercanos entre sí en el espacio de la variable explicativa tienen más probabilidades de estar relacionados entre sí de una manera simple que los puntos que están más separados. Siguiendo esta lógica, los puntos que probablemente sigan el modelo local son los que más influyen en las estimaciones de los parámetros del modelo local. Los puntos que tienen menos probabilidades de ajustarse realmente al modelo local tienen menos influencia en las estimaciones de los parámetros del modelo local .

La función de peso tradicional utilizada para LOESS es la función de peso tricubo .

donde d es la distancia de un punto de datos dado desde el punto de la curva que se está ajustando, escalada para estar en el rango de 0 a 1. [7]

Sin embargo, también se podría utilizar cualquier otra función de ponderación que satisfaga las propiedades enumeradas en Cleveland (1979). La ponderación de un punto específico en cualquier subconjunto localizado de datos se obtiene evaluando la función de ponderación en la distancia entre ese punto y el punto de estimación, después de escalar la distancia de modo que la distancia absoluta máxima sobre todos los puntos en el subconjunto de datos sea exactamente uno.

Considere la siguiente generalización del modelo de regresión lineal con una métrica en el espacio objetivo que depende de dos parámetros, . Suponga que la hipótesis lineal se basa en parámetros de entrada y que, como es habitual en estos casos, incorporamos el espacio de entrada en como , y considere la siguiente función de pérdida

Aquí, es una matriz real de coeficientes, y el subíndice i enumera los vectores de entrada y salida de un conjunto de entrenamiento. Dado que es una métrica, es una matriz simétrica, definida positiva y, como tal, hay otra matriz simétrica tal que . La función de pérdida anterior se puede reorganizar en una traza observando que . Al organizar los vectores y en las columnas de una matriz y una matriz respectivamente, la función de pérdida anterior se puede escribir como

donde es la matriz diagonal cuadrada cuyos elementos son s. Derivando con respecto a y haciendo el resultado igual a 0 se encuentra la ecuación matricial extrema

Suponiendo además que la matriz cuadrada no es singular, la función de pérdida alcanza su mínimo en

Una opción típica es el peso gaussiano.

Como se ha comentado anteriormente, la mayor ventaja que tiene LOESS sobre muchos otros métodos es que el proceso de ajuste de un modelo a los datos de muestra no comienza con la especificación de una función. En su lugar, el analista sólo tiene que proporcionar un valor de parámetro de suavizado y el grado del polinomio local. Además, LOESS es muy flexible, lo que lo hace ideal para modelar procesos complejos para los que no existen modelos teóricos. Estas dos ventajas, combinadas con la simplicidad del método, hacen de LOESS uno de los métodos de regresión modernos más atractivos para aplicaciones que se ajustan al marco general de la regresión de mínimos cuadrados pero que tienen una estructura determinista compleja.

Aunque es menos obvio que para algunos de los otros métodos relacionados con la regresión lineal de mínimos cuadrados, LOESS también acumula la mayoría de los beneficios que suelen compartir esos procedimientos. El más importante de ellos es la teoría para calcular incertidumbres para la predicción y la calibración. Muchas otras pruebas y procedimientos utilizados para la validación de modelos de mínimos cuadrados también se pueden extender a los modelos LOESS [ cita requerida ] .

LOESS hace un uso menos eficiente de los datos que otros métodos de mínimos cuadrados. Requiere conjuntos de datos bastante grandes y de muestras densas para producir buenos modelos. Esto se debe a que LOESS se basa en la estructura de datos local al realizar el ajuste local. Por lo tanto, LOESS proporciona un análisis de datos menos complejo a cambio de mayores costos experimentales. [7]

Otra desventaja de LOESS es el hecho de que no produce una función de regresión que se pueda representar fácilmente mediante una fórmula matemática. Esto puede dificultar la transferencia de los resultados de un análisis a otras personas. Para transferir la función de regresión a otra persona, necesitaría el conjunto de datos y el software para los cálculos LOESS. En la regresión no lineal , por otro lado, solo es necesario escribir una forma funcional para proporcionar estimaciones de los parámetros desconocidos y la incertidumbre estimada. Dependiendo de la aplicación, esto podría ser un inconveniente mayor o menor para el uso de LOESS. En particular, la forma simple de LOESS no se puede utilizar para el modelado mecanicista donde los parámetros ajustados especifican propiedades físicas particulares de un sistema.

Por último, como se ha comentado anteriormente, LOESS es un método computacionalmente intensivo (con excepción de los datos espaciados uniformemente, en cuyo caso la regresión se puede formular como un filtro de respuesta al impulso finito no causal ). LOESS también es propenso a los efectos de los valores atípicos en el conjunto de datos, al igual que otros métodos de mínimos cuadrados. Existe una versión iterativa y robusta de LOESS [Cleveland (1979)] que se puede utilizar para reducir la sensibilidad de LOESS a los valores atípicos , pero demasiados valores atípicos extremos pueden superar incluso al método robusto.

{{cite journal}}: Requiere citar revista |journal=( ayuda ){{cite journal}}: Requiere citar revista |journal=( ayuda )![]() Este artículo incorpora material de dominio público del Instituto Nacional de Estándares y Tecnología.

Este artículo incorpora material de dominio público del Instituto Nacional de Estándares y Tecnología.