En estadística, la regresión no lineal es una forma de análisis de regresión en la que los datos de observación se modelan mediante una función que es una combinación no lineal de los parámetros del modelo y depende de una o más variables independientes. Los datos se ajustan mediante un método de aproximaciones sucesivas (iteraciones).

En regresión no lineal, un modelo estadístico de la forma,

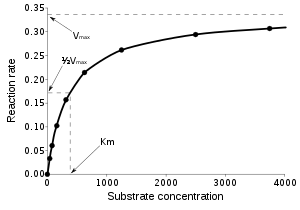

relaciona un vector de variables independientes , , y sus variables dependientes observadas asociadas , . La función no es lineal en los componentes del vector de parámetros , pero por lo demás es arbitraria. Por ejemplo, el modelo de Michaelis-Menten para la cinética enzimática tiene dos parámetros y una variable independiente, relacionados por : [a]

Esta función, que es una hipérbola rectangular, no es lineal porque no puede expresarse como una combinación lineal de las dos s.

Puede haber errores sistemáticos en las variables independientes, pero su tratamiento queda fuera del alcance del análisis de regresión. Si las variables independientes no están libres de errores, se trata de un modelo de errores en las variables , que también queda fuera de este alcance.

Otros ejemplos de funciones no lineales son las funciones exponenciales , las funciones logarítmicas , las funciones trigonométricas , las funciones de potencia , la función gaussiana y las distribuciones de Lorentz . Algunas funciones, como las funciones exponenciales o logarítmicas, se pueden transformar para que sean lineales. Cuando se transforman de esta manera, se puede realizar una regresión lineal estándar, pero debe aplicarse con precaución. Consulte Linealización§Transformación, a continuación, para obtener más detalles.

En general, no existe una expresión de forma cerrada para los parámetros de mejor ajuste, como ocurre en la regresión lineal . Por lo general, se aplican algoritmos de optimización numérica para determinar los parámetros de mejor ajuste. Nuevamente, a diferencia de la regresión lineal, puede haber muchos mínimos locales de la función a optimizar e incluso el mínimo global puede producir una estimación sesgada . En la práctica, se utilizan valores estimados de los parámetros, junto con el algoritmo de optimización, para intentar encontrar el mínimo global de una suma de cuadrados.

Para obtener detalles sobre el modelado de datos no lineales, consulte mínimos cuadrados y mínimos cuadrados no lineales .

La suposición subyacente a este procedimiento es que el modelo puede aproximarse mediante una función lineal, es decir, una serie de Taylor de primer orden :

donde son los elementos de la matriz jacobiana. De esto se deduce que los estimadores de mínimos cuadrados están dados por

Comparar mínimos cuadrados generalizados con una matriz de covarianza proporcional a la matriz unitaria. Las estadísticas de regresión no lineal se calculan y se utilizan como en las estadísticas de regresión lineal, pero utilizando J en lugar de X en las fórmulas.

Cuando la función en sí no se conoce analíticamente, pero necesita ser aproximada linealmente a partir de o más valores conocidos (donde es el número de estimadores), el mejor estimador se obtiene directamente del Ajuste de Plantilla Lineal como [1] (ver también mínimos cuadrados lineales ).

La aproximación lineal introduce sesgos en las estadísticas, por lo que se requiere más cautela de lo habitual al interpretar las estadísticas derivadas de un modelo no lineal.

A menudo se supone que la curva de mejor ajuste es la que minimiza la suma de los residuos al cuadrado . Este es el enfoque de mínimos cuadrados ordinarios (MCO). Sin embargo, en los casos en que la variable dependiente no tiene una varianza constante, o hay algunos valores atípicos, se puede minimizar una suma de residuos al cuadrado ponderados; consulte mínimos cuadrados ponderados . Cada ponderación idealmente debería ser igual al recíproco de la varianza de la observación, o al recíproco de la variable dependiente elevado a alguna potencia en el caso de valores atípicos [2] , pero las ponderaciones se pueden volver a calcular en cada iteración, en un algoritmo de mínimos cuadrados ponderados iterativamente.

Algunos problemas de regresión no lineal pueden trasladarse a un dominio lineal mediante una transformación adecuada de la formulación del modelo.

Por ejemplo, considere el problema de regresión no lineal

con parámetros a y b y con término de error multiplicativo U . Si tomamos el logaritmo de ambos lados, esto se convierte en

donde u = ln( U ), lo que sugiere la estimación de los parámetros desconocidos mediante una regresión lineal de ln( y ) sobre x , un cálculo que no requiere optimización iterativa. Sin embargo, el uso de una transformación no lineal requiere precaución. Las influencias de los valores de los datos cambiarán, al igual que la estructura de error del modelo y la interpretación de cualquier resultado inferencial. Estos pueden no ser efectos deseados. Por otro lado, dependiendo de cuál sea la mayor fuente de error, una transformación no lineal puede distribuir los errores de manera gaussiana, por lo que la elección de realizar una transformación no lineal debe estar informada por consideraciones de modelado.

Para la cinética de Michaelis-Menten , el gráfico lineal de Lineweaver-Burk

La ecuación de 1/ v frente a 1/[ S ] se ha utilizado mucho. Sin embargo, dado que es muy sensible a los errores de datos y está fuertemente sesgada hacia el ajuste de los datos en un rango particular de la variable independiente, [ S ], su uso se desaconseja enfáticamente.

Para las distribuciones de error que pertenecen a la familia exponencial , se puede utilizar una función de enlace para transformar los parámetros bajo el marco del modelo lineal generalizado .

La variable independiente o explicativa (por ejemplo, X) se puede dividir en clases o segmentos y se puede realizar una regresión lineal por segmento. La regresión segmentada con análisis de confianza puede arrojar como resultado que la variable dependiente o de respuesta (por ejemplo, Y) se comporta de manera diferente en los distintos segmentos. [3]

La figura muestra que la salinidad del suelo (X) inicialmente no ejerce influencia sobre el rendimiento (Y) del cultivo de mostaza, hasta que se alcanza un valor crítico o umbral ( punto de quiebre ), después del cual el rendimiento se ve afectado negativamente. [4]