En estadística , los mínimos cuadrados ordinarios ( OLS ) son un tipo de método de mínimos cuadrados lineales para elegir los parámetros desconocidos en un modelo de regresión lineal (con efectos fijos de nivel uno [ aclaración necesaria ] de una función lineal de un conjunto de variables explicativas ) mediante el principio de mínimos cuadrados : minimizar la suma de los cuadrados de las diferencias entre la variable dependiente observada (valores de la variable que se observa) en el conjunto de datos de entrada y la salida de la función (lineal) de la variable independiente .

Geométricamente, esto se ve como la suma de las distancias al cuadrado, paralelas al eje de la variable dependiente, entre cada punto de datos del conjunto y el punto correspondiente en la superficie de regresión: cuanto más pequeñas sean las diferencias, mejor se ajusta el modelo a los datos. . El estimador resultante se puede expresar mediante una fórmula simple, especialmente en el caso de una regresión lineal simple , en la que hay un único regresor en el lado derecho de la ecuación de regresión.

El estimador MCO es consistente para los efectos fijos de nivel uno cuando los regresores son exógenos y forma una colinealidad perfecta (condición de rango), consistente para la estimación de la varianza de los residuos cuando los regresores tienen cuartos momentos finitos [1] y, según el método de Gauss-Markov teorema : óptimo en la clase de estimadores lineales insesgados cuando los errores son homocedásticos y no correlacionados en serie . En estas condiciones, el método de MCO proporciona una estimación insesgada de media de varianza mínima cuando los errores tienen varianzas finitas . Bajo el supuesto adicional de que los errores se distribuyen normalmente con media cero, MCO es el estimador de máxima verosimilitud que supera a cualquier estimador insesgado no lineal.

Supongamos que los datos consisten en observaciones . Cada observación incluye una respuesta escalar y un vector de columna de parámetros (regresores), es decir, . En un modelo de regresión lineal , la variable de respuesta , es una función lineal de los regresores:

o en forma vectorial ,

donde , como se introdujo anteriormente, es un vector columna de la -ésima observación de todas las variables explicativas; es un vector de parámetros desconocidos; y el escalar representa variables aleatorias no observadas ( errores ) de la -ésima observación. Tiene en cuenta las influencias sobre las respuestas provenientes de fuentes distintas a las variables explicativas . Este modelo también se puede escribir en notación matricial como

donde y son vectores de las variables de respuesta y de los errores de las observaciones, y es una matriz de regresores, también llamada a veces matriz de diseño , cuya fila es y contiene las -ésimas observaciones de todas las variables explicativas.

Normalmente, se incluye un término constante en el conjunto de regresores , por ejemplo, tomando para todos . El coeficiente correspondiente a este regresor se llama intercepto . Sin la intersección, la línea ajustada se ve obligada a cruzar el origen cuando .

Los regresores no tienen que ser independientes para que la estimación sea consistente, pero la multicolinealidad hace que la estimación sea inconsistente. Como ejemplo concreto en el que los regresores no son independientes, podríamos sospechar que la respuesta depende linealmente tanto de un valor como de su cuadrado; en cuyo caso incluiríamos un regresor cuyo valor sea simplemente el cuadrado de otro regresor. En ese caso, el modelo sería cuadrático en el segundo regresor, pero aun así se considera un modelo lineal porque el modelo sigue siendo lineal en los parámetros ( ).

Considere un sistema sobredeterminado

de ecuaciones lineales en coeficientes desconocidos , , con . Esto se puede escribir en forma matricial como

dónde

(Nota: para un modelo lineal como el anterior, no todos los elementos contienen información sobre los puntos de datos. La primera columna se completa con unos. Solo las otras columnas contienen datos reales. Entonces, aquí es igual al número de regresores más uno) .

Un sistema de este tipo generalmente no tiene una solución exacta, por lo que el objetivo es encontrar los coeficientes que se ajusten "mejor" a las ecuaciones, en el sentido de resolver el problema de minimización cuadrática.

donde la función objetivo está dada por

Una justificación para elegir este criterio se proporciona en Propiedades a continuación. Este problema de minimización tiene solución única, siempre que las columnas de la matriz sean linealmente independientes , dada resolviendo las llamadas ecuaciones normales :

La matriz se conoce como matriz normal o matriz de Gram y la matriz se conoce como matriz de momento de regresor por regresores. [2] Finalmente, es el vector de coeficientes del hiperplano de mínimos cuadrados , expresado como

o

Supongamos que b es un valor "candidato" para el vector de parámetros β . La cantidad y i − x i T b , llamada residual para la i -ésima observación, mide la distancia vertical entre el punto de datos ( x i , y i ) y el hiperplano y = x T b , y así evalúa el grado de ajuste entre los datos reales y el modelo. La suma de cuadrados residuales ( SSR ) (también llamada suma de cuadrados de error ( ESS ) o suma de cuadrados residual ( RSS )) [3] es una medida del ajuste general del modelo:

donde T denota la transpuesta de la matriz , y las filas de X , que denotan los valores de todas las variables independientes asociadas con un valor particular de la variable dependiente, son X i = x i T. El valor de b que minimiza esta suma se llama estimador MCO para β . La función S ( b ) es cuadrática en b con hessiano definido positivo y, por lo tanto, esta función posee un mínimo global único en , que puede estar dado por la fórmula explícita: [4] [prueba]

El producto N = X T X es una matriz de Gram y su inversa, Q = N –1 , es la matriz cofactor de β , [5] [6] [7] estrechamente relacionada con su matriz de covarianza, C β . La matriz ( X T X ) –1 X T = Q X T se llama matriz pseudoinversa de Moore-Penrose de X. Esta formulación resalta el punto de que la estimación se puede llevar a cabo si, y sólo si, no existe una multicolinealidad perfecta entre las variables explicativas (lo que haría que la matriz de gramos no tuviera inversa).

Después de haber estimado β , los valores ajustados (o valores predichos ) de la regresión serán

donde P = X ( X T X ) −1 X T es la matriz de proyección sobre el espacio V atravesado por las columnas de X . Esta matriz P también se denomina a veces matriz de sombrero porque "pone un sombrero" a la variable y . Otra matriz, estrechamente relacionada con P es la matriz aniquiladora M = In − P ; esta es una matriz de proyección en el espacio ortogonal a V . Ambas matrices P y M son simétricas e idempotentes (lo que significa que P 2 = P y M 2 = M ) y se relacionan con la matriz de datos X a través de las identidades PX = X y MX = 0 . [8] La Matriz M crea los residuos de la regresión:

Usando estos residuos podemos estimar el valor de σ 2 usando el estadístico chi-cuadrado reducido :

El denominador, n − p , son los grados de libertad estadísticos . La primera cantidad, s 2 , es la estimación MCO para σ 2 , mientras que la segunda , es la estimación MLE para σ 2 . Los dos estimadores son bastante similares en muestras grandes; el primer estimador siempre es insesgado , mientras que el segundo estimador está sesgado pero tiene un error cuadrático medio menor . En la práctica, s 2 se utiliza con más frecuencia, ya que es más conveniente para la prueba de hipótesis. La raíz cuadrada de s 2 se llama error estándar de regresión , [9] error estándar de la regresión , [10] [11] o error estándar de la ecuación . [8]

Es común evaluar la bondad de ajuste de la regresión MCO comparando cuánto se puede reducir la variación inicial en la muestra al regresar a X. El coeficiente de determinación R 2 se define como una relación entre la varianza "explicada" y la varianza "total" de la variable dependiente y , en los casos en que la suma de cuadrados de la regresión es igual a la suma de cuadrados de los residuos: [12]

donde TSS es la suma total de cuadrados de la variable dependiente, y es una matriz de unos de n × n . ( es una matriz de centrado que equivale a la regresión sobre una constante; simplemente resta la media de una variable). Para que R 2 sea significativo, la matriz X de datos sobre regresores debe contener un vector columna de unos para representar la constante cuyo coeficiente es el intercepto de la regresión. En ese caso, R 2 siempre será un número entre 0 y 1, donde valores cercanos a 1 indican un buen grado de ajuste.

La varianza en la predicción de la variable independiente en función de la variable dependiente se da en el artículo Mínimos cuadrados polinomiales .

Si la matriz de datos X contiene sólo dos variables, una constante y un regresor escalar x i , entonces esto se denomina "modelo de regresión simple". Este caso se considera a menudo en las clases de estadística para principiantes, ya que proporciona fórmulas mucho más simples, incluso adecuadas para el cálculo manual. Los parámetros se denotan comúnmente como ( α , β ) :

Las estimaciones de mínimos cuadrados en este caso vienen dadas por fórmulas simples

En el apartado anterior se obtuvo el estimador de mínimos cuadrados como un valor que minimiza la suma de residuos al cuadrado del modelo. Sin embargo, también es posible derivar el mismo estimador a partir de otros enfoques. En todos los casos, la fórmula del estimador MCO sigue siendo la misma: ^ β = ( X T X ) −1 X T y ; la única diferencia está en cómo interpretamos este resultado.

Para los matemáticos, MCO es una solución aproximada a un sistema sobredeterminado de ecuaciones lineales Xβ ≈ y , donde β es la incógnita. Suponiendo que el sistema no se puede resolver exactamente (el número de ecuaciones n es mucho mayor que el número de incógnitas p ), buscamos una solución que pueda proporcionar la discrepancia más pequeña entre los lados derecho e izquierdo. En otras palabras, buscamos la solución que satisfaga

donde ‖ · ‖ es la norma estándar L 2 en el espacio euclidiano de n dimensiones R n . La cantidad predicha Xβ es simplemente una determinada combinación lineal de los vectores de regresores. Por lo tanto, el vector residual y − Xβ tendrá la longitud más pequeña cuando y se proyecte ortogonalmente sobre el subespacio lineal abarcado por las columnas de X. El estimador MCO en este caso se puede interpretar como los coeficientes de descomposición vectorial de ^ y = Py a lo largo de la base de X.

En otras palabras, las ecuaciones de gradiente mínimo se pueden escribir como:

Una interpretación geométrica de estas ecuaciones es que el vector de residuos es ortogonal al espacio columna de X , ya que el producto escalar es igual a cero para cualquier vector conforme, v . Esto significa que es el más corto de todos los vectores posibles , es decir, la varianza de los residuales es la mínima posible. Esto se ilustra a la derecha.

Introduciendo y una matriz K con el supuesto de que una matriz no es singular y K T X = 0 (cf. Proyecciones ortogonales ), el vector residual debe satisfacer la siguiente ecuación:

La ecuación y la solución de mínimos cuadrados lineales se describen a continuación:

Otra forma de verlo es considerar que la línea de regresión es un promedio ponderado de las líneas que pasan por la combinación de dos puntos cualesquiera en el conjunto de datos. [13] Aunque esta forma de cálculo es más costosa desde el punto de vista computacional, proporciona una mejor intuición en OLS.

El estimador MCO es idéntico al estimador de máxima verosimilitud (MLE) bajo el supuesto de normalidad para los términos de error. [14] [prueba] Este supuesto de normalidad tiene importancia histórica, ya que proporcionó la base para los primeros trabajos en análisis de regresión lineal de Yule y Pearson . [ cita necesaria ] A partir de las propiedades de MLE, podemos inferir que el estimador MCO es asintóticamente eficiente (en el sentido de alcanzar el límite de Cramér-Rao para la varianza) si se satisface el supuesto de normalidad. [15]

En el caso de iid , el estimador MCO también puede verse como un estimador GMM que surge de las condiciones de momento.

Estas condiciones de momento establecen que los regresores no deben estar correlacionados con los errores. Dado que x i es un p -vector, el número de condiciones de momento es igual a la dimensión del vector de parámetros β y, por tanto, el sistema se identifica exactamente. Este es el llamado caso clásico de GMM, cuando el estimador no depende de la elección de la matriz de ponderación.

Tenga en cuenta que el supuesto original de exogeneidad estricta E[ ε i | x i ] = 0 implica un conjunto de condiciones de momento mucho más rico que el indicado anteriormente. En particular, este supuesto implica que para cualquier función vectorial ƒ , se cumplirá la condición de momento E[ ƒ ( x i )· ε i ] = 0 . Sin embargo, se puede demostrar utilizando el teorema de Gauss-Markov que la elección óptima de la función ƒ es tomar ƒ ( x ) = x , lo que da como resultado la ecuación de momento publicada anteriormente.

Existen varios marcos diferentes en los que se puede formular el modelo de regresión lineal para que la técnica OLS sea aplicable. Cada una de estas configuraciones produce las mismas fórmulas y los mismos resultados. La única diferencia es la interpretación y los supuestos que deben imponerse para que el método dé resultados significativos. La elección del marco aplicable depende principalmente de la naturaleza de los datos disponibles y de la tarea de inferencia que debe realizarse.

Una de las líneas de diferencia en la interpretación es si se deben tratar los regresores como variables aleatorias o como constantes predefinidas. En el primer caso ( diseño aleatorio ) , los regresores x i son aleatorios y se muestrean junto con los y i de alguna población , como en un estudio observacional . Este enfoque permite un estudio más natural de las propiedades asintóticas de los estimadores. En la otra interpretación ( diseño fijo ), los regresores X se tratan como constantes conocidas establecidas por un diseño , y y se muestrea condicionalmente en función de los valores de X como en un experimento . Para fines prácticos, esta distinción a menudo no es importante, ya que la estimación y la inferencia se llevan a cabo condicionando X. Todos los resultados indicados en este artículo están dentro del marco de diseño aleatorio.

El modelo clásico se centra en la estimación e inferencia de "muestra finita", lo que significa que el número de observaciones n es fijo. Esto contrasta con los otros enfoques, que estudian el comportamiento asintótico de MCO y en los que se estudia el comportamiento en un gran número de muestras.

En algunas aplicaciones, especialmente con datos transversales , se impone una suposición adicional: que todas las observaciones son independientes y están distribuidas de manera idéntica. Esto significa que todas las observaciones se toman de una muestra aleatoria , lo que hace que todos los supuestos enumerados anteriormente sean más simples y fáciles de interpretar. Además, este marco permite establecer resultados asintóticos (como el tamaño de la muestra n → ∞ ), que se entienden como una posibilidad teórica de obtener nuevas observaciones independientes del proceso de generación de datos . La lista de supuestos en este caso es:

En primer lugar, bajo el estricto supuesto de exogeneidad, los estimadores MCO y s 2 son insesgados , lo que significa que sus valores esperados coinciden con los valores verdaderos de los parámetros: [22] [prueba]

Si la exogeneidad estricta no se cumple (como es el caso de muchos modelos de series temporales , donde se supone exogeneidad sólo con respecto a los shocks pasados pero no a los futuros), entonces estos estimadores estarán sesgados en muestras finitas.

La matriz de varianza-covarianza (o simplemente matriz de covarianza ) de es igual a [23]

En particular, el error estándar de cada coeficiente es igual a la raíz cuadrada del j -ésimo elemento diagonal de esta matriz. La estimación de este error estándar se obtiene reemplazando la cantidad desconocida σ 2 con su estimación s 2 . De este modo,

También se puede demostrar fácilmente que el estimador no está correlacionado con los residuos del modelo: [23]

El teorema de Gauss-Markov establece que bajo el supuesto de errores esféricos (es decir, los errores no deben estar correlacionados y ser homocedásticos ), el estimador es eficiente en la clase de estimadores lineales insesgados. Esto se llama el mejor estimador lineal insesgado (AZUL). La eficiencia debe entenderse como si tuviéramos que encontrar algún otro estimador que fuera lineal en y e insesgado, entonces [23]

en el sentido de que se trata de una matriz definida no negativa . Este teorema establece la optimización sólo en la clase de estimadores lineales insesgados, lo cual es bastante restrictivo. Dependiendo de la distribución de los términos de error ε , otros estimadores no lineales pueden proporcionar mejores resultados que MCO.

Todas las propiedades enumeradas hasta ahora son válidas independientemente de la distribución subyacente de los términos de error. Sin embargo, si está dispuesto a suponer que se cumple el supuesto de normalidad (es decir, que ε ~ N (0, σ 2 In ) ) , entonces se pueden establecer propiedades adicionales de los estimadores MCO.

El estimador tiene una distribución normal, con media y varianza como se indica anteriormente: [24]

Este estimador alcanza el límite de Cramér-Rao para el modelo y, por tanto, es óptimo en la clase de todos los estimadores insesgados. [15] Tenga en cuenta que, a diferencia del teorema de Gauss-Markov , este resultado establece la optimización entre estimadores lineales y no lineales, pero sólo en el caso de términos de error normalmente distribuidos.

El estimador s 2 será proporcional a la distribución chi-cuadrado : [25]

La varianza de este estimador es igual a 2 σ 4 /( n − p ) , que no alcanza el límite de Cramér-Rao de 2 σ 4 / n . Sin embargo se demostró que no existen estimadores insesgados de σ 2 con varianza menor que la del estimador s 2 . [26] Si estamos dispuestos a permitir estimadores sesgados y consideramos la clase de estimadores que son proporcionales a la suma de residuos cuadrados (SSR) del modelo, entonces el mejor estimador (en el sentido del error cuadrático medio ) en este La clase será ~ σ 2 = SSR / ( n − p + 2 ) , que incluso supera el límite de Cramér-Rao en el caso de que solo haya un regresor ( p = 1 ). [27]

Además, los estimadores y s 2 son independientes , [28] hecho que resulta útil a la hora de construir las pruebas t y F para la regresión.

Como se mencionó anteriormente, el estimador es lineal en y , lo que significa que representa una combinación lineal de las variables dependientes y i . Los pesos en esta combinación lineal son funciones de los regresores X y generalmente son desiguales. Las observaciones con ponderaciones altas se denominan influyentes porque tienen un efecto más pronunciado sobre el valor del estimador.

Para analizar qué observaciones son influyentes, eliminamos una j -ésima observación específica y consideramos cuánto van a cambiar las cantidades estimadas (de manera similar al método jackknife ). Se puede demostrar que el cambio en el estimador MCO para β será igual a [29]

donde h j = x j T ( X T X ) −1 x j es el j -ésimo elemento diagonal de la matriz hat P , y x j es el vector de regresores correspondientes a la j -ésima observación. De manera similar, el cambio en el valor previsto para la j -ésima observación resultante de omitir esa observación del conjunto de datos será igual a [29]

De las propiedades de la matriz hat, 0 ≤ h j ≤ 1 , y suman p , de modo que en promedio h j ≈ p/n . Estas cantidades h j se denominan apalancamientos y las observaciones con h j elevado se denominan puntos de apalancamiento . [30] Por lo general, las observaciones con un alto apalancamiento deberían examinarse más cuidadosamente, en caso de que sean erróneas, o atípicas, o de alguna otra manera atípicas del resto del conjunto de datos.

A veces, las variables y los parámetros correspondientes en la regresión se pueden dividir lógicamente en dos grupos, de modo que la regresión tome forma.

donde X 1 y X 2 tienen dimensiones n × p 1 , n × p 2 y β 1 , β 2 son vectores p 1 × 1 y p 2 × 1 , con p 1 + p 2 = p .

El teorema de Frisch-Waugh-Lovell establece que en esta regresión los residuos y la estimación de MCO serán numéricamente idénticos a los residuos y la estimación de MCO para β 2 en la siguiente regresión: [31]

donde M 1 es la matriz aniquiladora para los regresores X 1 .

El teorema se puede utilizar para establecer una serie de resultados teóricos. Por ejemplo, tener una regresión con una constante y otro regresor equivale a restar las medias de la variable dependiente y el regresor y luego ejecutar la regresión para las variables desmediadas pero sin el término constante.

Supongamos que se sabe que los coeficientes de la regresión satisfacen un sistema de ecuaciones lineales

donde Q es una matriz p × q de rango completo, y c es un vector q ×1 de constantes conocidas, donde q < p . En este caso la estimación de mínimos cuadrados equivale a minimizar la suma de los residuos cuadrados del modelo sujeto a la restricción A. El estimador de mínimos cuadrados restringidos (CLS) puede obtenerse mediante una fórmula explícita: [32]

Esta expresión para el estimador restringido es válida siempre que la matriz X T X sea invertible. Desde el principio de este artículo se supuso que esta matriz es de rango completo y se observó que cuando la condición de rango falla, β no será identificable. Sin embargo, puede suceder que al agregar la restricción A se haga identificable a β , en cuyo caso nos gustaría encontrar la fórmula para el estimador. El estimador es igual a [33]

donde R es una matriz p ×( p − q ) tal que la matriz [ QR ] no es singular y R T Q = 0 . Una matriz de este tipo siempre se puede encontrar, aunque generalmente no es única. La segunda fórmula coincide con la primera en el caso de que X T X sea invertible. [33]

Los estimadores de mínimos cuadrados son estimaciones puntuales de los parámetros β del modelo de regresión lineal . Sin embargo, en general también queremos saber qué tan cerca podrían estar esas estimaciones de los valores reales de los parámetros. En otras palabras, queremos construir las estimaciones de intervalo .

Como no hemos hecho ninguna suposición sobre la distribución del término de error ε i , es imposible inferir la distribución de los estimadores y . Sin embargo, podemos aplicar el teorema del límite central para derivar sus propiedades asintóticas cuando el tamaño de muestra n tiende a infinito. Si bien el tamaño de la muestra es necesariamente finito, se acostumbra suponer que n es "lo suficientemente grande" como para que la verdadera distribución del estimador MCO esté cerca de su límite asintótico.

Podemos demostrar que bajo los supuestos del modelo, el estimador de mínimos cuadrados para β es consistente (es decir, converge en probabilidad a β ) y asintóticamente normal: [prueba]

dónde

Utilizando esta distribución asintótica, se pueden construir intervalos de confianza bilaterales aproximados para el j -ésimo componente del vector como

donde q denota la función cuantil de la distribución normal estándar, y [·] jj es el j -ésimo elemento diagonal de una matriz.

De manera similar, el estimador de mínimos cuadrados para σ 2 también es consistente y asintóticamente normal (siempre que exista el cuarto momento de ε i ) con distribución limitante

Estas distribuciones asintóticas se pueden utilizar para predicción, probar hipótesis, construir otros estimadores, etc. Consideremos como ejemplo el problema de la predicción. Supongamos que hay algún punto dentro del dominio de distribución de los regresores y se quiere saber cuál habría sido la variable de respuesta en ese punto. La respuesta media es la cantidad , mientras que la respuesta prevista es . Claramente la respuesta predicha es una variable aleatoria, su distribución se puede derivar de la de :

lo que permite construir intervalos de confianza para la respuesta media :

Se utilizan especialmente dos pruebas de hipótesis. Primero, uno quiere saber si la ecuación de regresión estimada es mejor que simplemente predecir que todos los valores de la variable de respuesta son iguales a su media muestral (si no, se dice que no tiene poder explicativo). La hipótesis nula de que la regresión estimada no tiene valor explicativo se prueba mediante una prueba F. Si se encuentra que el valor F calculado es lo suficientemente grande como para exceder su valor crítico para el nivel de significancia elegido previamente, se rechaza la hipótesis nula y se acepta la hipótesis alternativa de que la regresión tiene poder explicativo. En caso contrario, se acepta la hipótesis nula de falta de poder explicativo.

En segundo lugar, para cada variable explicativa de interés, se quiere saber si su coeficiente estimado difiere significativamente de cero, es decir, si esta variable explicativa particular de hecho tiene poder explicativo para predecir la variable de respuesta. Aquí la hipótesis nula es que el coeficiente verdadero es cero. Esta hipótesis se prueba calculando el estadístico t del coeficiente , como la relación entre la estimación del coeficiente y su error estándar . Si el estadístico t es mayor que un valor predeterminado, se rechaza la hipótesis nula y se encuentra que la variable tiene poder explicativo, con su coeficiente significativamente diferente de cero. En caso contrario, se acepta la hipótesis nula de un valor cero del coeficiente verdadero.

Además, la prueba de Chow se utiliza para comprobar si dos submuestras tienen los mismos valores de coeficientes verdaderos subyacentes. La suma de los residuos cuadrados de las regresiones en cada uno de los subconjuntos y en el conjunto de datos combinado se compara calculando un estadístico F; si éste excede un valor crítico, se rechaza la hipótesis nula de que no hay diferencia entre los dos subconjuntos; en caso contrario, se acepta.

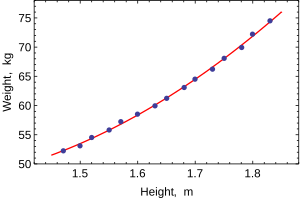

El siguiente conjunto de datos proporciona alturas y pesos promedio para mujeres estadounidenses de entre 30 y 39 años (fuente: The World Almanac and Book of Facts, 1975 ).

Cuando solo se modela una variable dependiente, un diagrama de dispersión sugerirá la forma y la fuerza de la relación entre la variable dependiente y los regresores. También podría revelar valores atípicos, heterocedasticidad y otros aspectos de los datos que pueden complicar la interpretación de un modelo de regresión ajustado. El diagrama de dispersión sugiere que la relación es fuerte y puede aproximarse como una función cuadrática. OLS puede manejar relaciones no lineales introduciendo el regresor HEIGHT 2 . El modelo de regresión se convierte entonces en un modelo lineal múltiple:

El resultado de los paquetes estadísticos más populares será similar a este:

En esta tabla:

El análisis de mínimos cuadrados ordinario a menudo incluye el uso de gráficos de diagnóstico diseñados para detectar desviaciones de los datos de la forma supuesta del modelo. Estas son algunas de las gráficas de diagnóstico comunes:

Una consideración importante al realizar inferencias estadísticas utilizando modelos de regresión es cómo se muestrearon los datos. En este ejemplo, los datos son promedios en lugar de mediciones de mujeres individuales. El ajuste del modelo es muy bueno, pero esto no implica que el peso de una mujer individual pueda predecirse con gran precisión basándose únicamente en su altura.

Este ejemplo también demuestra que los coeficientes determinados por estos cálculos son sensibles a cómo se preparan los datos. Las alturas se redondearon originalmente a la pulgada más cercana y se convirtieron y redondearon al centímetro más cercano. Dado que el factor de conversión es de una pulgada a 2,54 cm, esta no es una conversión exacta. Las pulgadas originales se pueden recuperar mediante Round(x/0.0254) y luego volver a convertirlas al sistema métrico sin redondear. Si se hace esto los resultados serán:

El uso de cualquiera de estas ecuaciones para predecir el peso de una mujer de 5' 6" (1,6764 m) da valores similares: 62,94 kg con redondeo versus 62,98 kg sin redondeo. Por lo tanto, una variación aparentemente pequeña en los datos tiene un efecto real en los coeficientes. pero un pequeño efecto sobre los resultados de la ecuación.

Si bien esto puede parecer inocuo en el medio del rango de datos, podría volverse significativo en los extremos o en el caso en que el modelo ajustado se utilice para proyectar fuera del rango de datos ( extrapolación ).

Esto resalta un error común: este ejemplo es un abuso de MCO que inherentemente requiere que los errores en la variable independiente (en este caso, altura) sean cero o al menos insignificantes. El redondeo inicial a la pulgada más cercana más cualquier error de medición real constituye un error finito y no despreciable. Como resultado, los parámetros ajustados no son las mejores estimaciones que se supone que son. Aunque no es totalmente espurio , el error en la estimación dependerá del tamaño relativo de los errores xey .

Podemos utilizar el mecanismo de mínimos cuadrados para calcular la ecuación de una órbita de dos cuerpos en coordenadas de base polar. La ecuación que normalmente se utiliza es ¿ dónde está el radio de la distancia a la que se encuentra el objeto de uno de los cuerpos? En la ecuación, los parámetros y se utilizan para determinar la trayectoria de la órbita. Hemos medido los siguientes datos.

Necesitamos encontrar la aproximación de mínimos cuadrados de y para los datos dados.

Primero necesitamos representar e y p en forma lineal. Entonces vamos a reescribir la ecuación como . Además, se podrían ajustar los ápsides expandiendo con un parámetro adicional como , que es lineal en ambos y en la función de base adicional , utilizada para extra . Usamos la forma original de dos parámetros para representar nuestros datos de observación como:

donde es y es y se construye siendo la primera columna el coeficiente de y la segunda columna el coeficiente de y son los valores para los respectivos so y

Al resolver obtenemos

y entonces