El análisis discriminante lineal ( LDA ), el análisis discriminante normal ( NDA ) o el análisis de función discriminante es una generalización del discriminante lineal de Fisher , un método utilizado en estadística y otros campos, para encontrar una combinación lineal de características que caracteriza o separa dos o más clases. de objetos o eventos. La combinación resultante se puede utilizar como clasificador lineal o, más comúnmente, para la reducción de dimensionalidad antes de una clasificación posterior .

LDA está estrechamente relacionado con el análisis de varianza (ANOVA) y el análisis de regresión , que también intentan expresar una variable dependiente como una combinación lineal de otras características o medidas. [2] [3] Sin embargo, ANOVA utiliza variables independientes categóricas y una variable dependiente continua , mientras que el análisis discriminante tiene variables independientes continuas y una variable dependiente categórica ( es decir, la etiqueta de clase). [4] La regresión logística y la regresión probit son más similares a LDA que ANOVA, ya que también explican una variable categórica mediante los valores de variables independientes continuas. Estos otros métodos son preferibles en aplicaciones donde no es razonable suponer que las variables independientes están distribuidas normalmente, lo cual es un supuesto fundamental del método LDA.

LDA también está estrechamente relacionado con el análisis de componentes principales (PCA) y el análisis factorial en el sentido de que ambos buscan combinaciones lineales de variables que expliquen mejor los datos. [5] LDA intenta explícitamente modelar la diferencia entre las clases de datos. El PCA, por el contrario, no tiene en cuenta ninguna diferencia de clase, y el análisis factorial construye las combinaciones de características basándose en diferencias más que en similitudes. El análisis discriminante también se diferencia del análisis factorial en que no es una técnica de interdependencia: se debe hacer una distinción entre variables independientes y variables dependientes (también llamadas variables de criterio).

LDA funciona cuando las mediciones realizadas sobre variables independientes para cada observación son cantidades continuas. Cuando se trata de variables independientes categóricas, la técnica equivalente es el análisis de correspondencia discriminante. [6] [7]

El análisis discriminante se utiliza cuando los grupos se conocen a priori (a diferencia del análisis de conglomerados ). Cada caso debe tener una puntuación en una o más medidas predictivas cuantitativas y una puntuación en una medida grupal. [8] En términos simples, el análisis de funciones discriminantes es clasificación: el acto de distribuir cosas en grupos, clases o categorías del mismo tipo.

El análisis discriminante dicotómico original fue desarrollado por Sir Ronald Fisher en 1936. [9] Es diferente de un ANOVA o MANOVA , que se utiliza para predecir una (ANOVA) o múltiples (MANOVA) variables dependientes continuas mediante una o más variables categóricas independientes. . El análisis de funciones discriminantes es útil para determinar si un conjunto de variables es eficaz para predecir la pertenencia a una categoría. [10]

Considere un conjunto de observaciones (también llamadas características, atributos, variables o medidas) para cada muestra de un objeto o evento con clase conocida . Este conjunto de muestras se denomina conjunto de entrenamiento . El problema de clasificación es entonces encontrar un buen predictor para la clase de cualquier muestra de la misma distribución (no necesariamente del conjunto de entrenamiento) dada solo una observación . [11] : 338

LDA aborda el problema asumiendo que las funciones de densidad de probabilidad condicional y son la distribución normal con parámetros de media y covarianza y , respectivamente. Bajo este supuesto, la solución óptima de Bayes es predecir puntos como de segunda clase si el logaritmo de los índices de probabilidad es mayor que algún umbral T, de modo que:

Sin más suposiciones, el clasificador resultante se denomina análisis discriminante cuadrático (QDA).

En cambio, LDA hace el supuesto adicional simplificador de homocedasticidad ( es decir, que las covarianzas de clase son idénticas, por lo tanto ) y que las covarianzas tienen rango completo. En este caso, se cancelan varios términos:

y el criterio de decisión anterior se convierte en un umbral en el producto escalar

para alguna constante de umbral c , donde

Esto significa que el criterio de que una entrada esté en una clase es puramente una función de esta combinación lineal de las observaciones conocidas.

A menudo es útil ver esta conclusión en términos geométricos: el criterio de que una entrada esté en una clase es puramente una función de proyección de un punto del espacio multidimensional sobre un vector (por lo tanto, solo consideramos su dirección). En otras palabras, la observación pertenece a si la correspondiente se encuentra en un determinado lado de un hiperplano perpendicular a . La ubicación del avión está definida por el umbral .

Los supuestos del análisis discriminante son los mismos que los de MANOVA. El análisis es bastante sensible a los valores atípicos y el tamaño del grupo más pequeño debe ser mayor que el número de variables predictoras. [8]

Se ha sugerido que el análisis discriminante es relativamente robusto ante violaciones leves de estos supuestos, [12] y también se ha demostrado que el análisis discriminante aún puede ser confiable cuando se utilizan variables dicotómicas (donde a menudo se viola la normalidad multivariada). [13]

El análisis discriminante funciona creando una o más combinaciones lineales de predictores, creando una nueva variable latente para cada función. Estas funciones se llaman funciones discriminantes. El número de funciones posibles es donde = número de grupos o (el número de predictores), lo que sea menor. La primera función creada maximiza las diferencias entre grupos en esa función. La segunda función maximiza las diferencias en esa función, pero tampoco debe estar correlacionada con la función anterior. Esto continúa con funciones posteriores con el requisito de que la nueva función no esté correlacionada con ninguna de las funciones anteriores.

Dado un grupo , con conjuntos de espacio muestral, existe una regla discriminante tal que si , entonces . Entonces, el análisis discriminante encuentra regiones "buenas" para minimizar el error de clasificación, lo que conduce a un alto porcentaje de clasificación correcta en la tabla de clasificación. [14]

A cada función se le asigna una puntuación discriminante [ se necesita aclaración ] para determinar qué tan bien predice la ubicación del grupo.

Un valor propio en el análisis discriminante es la raíz característica de cada función. [ aclaración necesaria ] Es una indicación de qué tan bien esa función diferencia los grupos, donde cuanto mayor es el valor propio, mejor se diferencia la función. [8] Sin embargo, esto debe interpretarse con cautela, ya que los valores propios no tienen límite superior. [10] [8] El valor propio se puede ver como una relación de SS entre y SS dentro como en ANOVA cuando la variable dependiente es la función discriminante y los grupos son los niveles de IV [ aclaración necesaria ] . [10] Esto significa que el valor propio más grande está asociado con la primera función, el segundo más grande con la segunda, etc.

Algunos sugieren el uso de valores propios como medidas del tamaño del efecto ; sin embargo, esto generalmente no se admite. [10] En cambio, la correlación canónica es la medida preferida del tamaño del efecto. Es similar al valor propio, pero es la raíz cuadrada de la relación entre SS entre y SS total . Es la correlación entre grupos y la función. [10] Otra medida popular del tamaño del efecto es el porcentaje de varianza [ aclaración necesaria ] para cada función. Esto se calcula mediante: ( λ x /Σλ i ) X 100 donde λ x es el valor propio de la función y Σ λ i es la suma de todos los valores propios. Esto nos dice qué tan fuerte es la predicción para esa función en particular en comparación con las demás. [10] El porcentaje clasificado correctamente también se puede analizar como tamaño del efecto. El valor kappa puede describir esto mientras se corrige por acuerdo aleatorio. [10] Kappa normaliza todas las categorías en lugar de estar sesgado por clases de desempeño significativamente bueno o pobre. [ se necesita aclaración ] [17]

El análisis discriminante canónico (CDA) encuentra ejes ( k − 1 coordenadas canónicas , siendo k el número de clases) que mejor separan las categorías. Estas funciones lineales no están correlacionadas y definen, de hecho, un espacio k − 1 óptimo a través de la nube de datos n -dimensional que mejor separa (las proyecciones en ese espacio de) los k grupos. Consulte “LDA multiclase” para obtener más detalles a continuación.

Los términos discriminante lineal de Fisher y LDA se usan a menudo indistintamente, aunque el artículo original de Fisher [2] en realidad describe un discriminante ligeramente diferente, que no asume algunos de los supuestos de LDA, como clases normalmente distribuidas o covarianzas de clases iguales .

Supongamos que dos clases de observaciones tienen medias y covarianzas . Entonces la combinación lineal de características tendrá medias y variaciones para . Fisher definió la separación entre estas dos distribuciones como la relación entre la varianza entre las clases y la varianza dentro de las clases:

Esta medida es, en cierto sentido, una medida de la relación señal-ruido para el etiquetado de clases. Se puede demostrar que la separación máxima ocurre cuando

Cuando se cumplen los supuestos de LDA, la ecuación anterior es equivalente a LDA.

Asegúrese de tener en cuenta que el vector es la normal al hiperplano discriminante . Por ejemplo, en un problema bidimensional, la recta que mejor divide los dos grupos es perpendicular a .

Generalmente, los puntos de datos a discriminar se proyectan en ; luego se elige el umbral que mejor separa los datos a partir del análisis de la distribución unidimensional. No existe una regla general para el umbral. Sin embargo, si las proyecciones de puntos de ambas clases exhiben aproximadamente las mismas distribuciones, una buena elección sería el hiperplano entre proyecciones de las dos medias, y . En este caso, el parámetro c en la condición de umbral se puede encontrar explícitamente:

El método de Otsu está relacionado con el discriminante lineal de Fisher y fue creado para binarizar el histograma de píxeles en una imagen en escala de grises seleccionando de manera óptima el umbral blanco/negro que minimiza la variación intraclase y maximiza la variación entre clases dentro/entre las escalas de grises asignadas a negro y Clases de píxeles blancos.

En el caso de que haya más de dos clases, el análisis utilizado en la derivación del discriminante de Fisher se puede ampliar para encontrar un subespacio que parezca contener toda la variabilidad de las clases. [18] Esta generalización se debe a CR Rao . [19] Supongamos que cada una de las clases C tiene una media y la misma covarianza . Entonces, la dispersión entre la variabilidad de las clases puede definirse mediante la covarianza muestral de las medias de las clases.

¿Dónde está la media de las clases? La separación de clases en una dirección en este caso vendrá dada por

Esto significa que cuando sea un vector propio de la separación será igual al valor propio correspondiente .

Si es diagonalizable, la variabilidad entre características estará contenida en el subespacio abarcado por los vectores propios correspondientes a los valores propios más grandes de C − 1 (ya que es de rango C − 1 como máximo). Estos vectores propios se utilizan principalmente en la reducción de características, como en PCA. Los vectores propios correspondientes a los valores propios más pequeños tenderán a ser muy sensibles a la elección exacta de los datos de entrenamiento y, a menudo, es necesario utilizar la regularización como se describe en la siguiente sección.

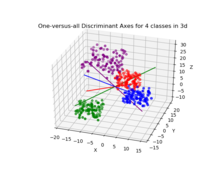

Si se requiere clasificación, en lugar de reducción de dimensiones , existen varias técnicas alternativas disponibles. Por ejemplo, las clases pueden dividirse y usarse un discriminante estándar de Fisher o LDA para clasificar cada partición. Un ejemplo común de esto es "uno contra el resto", donde los puntos de una clase se colocan en un grupo y todo lo demás en el otro, y luego se aplica LDA. Esto dará como resultado clasificadores C, cuyos resultados se combinan. Otro método común es la clasificación por pares, donde se crea un nuevo clasificador para cada par de clases (dando C ( C − 1)/2 clasificadores en total), con los clasificadores individuales combinados para producir una clasificación final.

La implementación típica de la técnica LDA requiere que todas las muestras estén disponibles con anticipación. Sin embargo, hay situaciones en las que todo el conjunto de datos no está disponible y los datos de entrada se observan como una secuencia. En este caso, es deseable que la extracción de características LDA tenga la capacidad de actualizar las características LDA calculadas observando las nuevas muestras sin ejecutar el algoritmo en todo el conjunto de datos. Por ejemplo, en muchas aplicaciones en tiempo real, como la robótica móvil o el reconocimiento facial en línea, es importante actualizar las características LDA extraídas tan pronto como haya nuevas observaciones disponibles. Una técnica de extracción de características LDA que puede actualizar las características LDA simplemente observando nuevas muestras es un algoritmo LDA incremental , y esta idea se ha estudiado ampliamente durante las últimas dos décadas. [20] Chatterjee y Roychowdhury propusieron un algoritmo LDA autoorganizado incremental para actualizar las características de LDA. [21] En otro trabajo, Demir y Ozmehmet propusieron algoritmos de aprendizaje local en línea para actualizar las características LDA de forma incremental utilizando la corrección de errores y las reglas de aprendizaje hebbianas. [22] Posteriormente, Aliyari et al. derivó algoritmos incrementales rápidos para actualizar las características de LDA mediante la observación de las nuevas muestras. [20]

En la práctica, se desconocen las medias y covarianzas de las clases. Sin embargo, pueden estimarse a partir del conjunto de entrenamiento. Se puede utilizar la estimación de máxima verosimilitud o la estimación máxima a posteriori en lugar del valor exacto en las ecuaciones anteriores. Aunque las estimaciones de la covarianza pueden considerarse óptimas en algún sentido, esto no significa que el discriminante resultante obtenido al sustituir estos valores sea óptimo en algún sentido, incluso si el supuesto de clases distribuidas normalmente es correcto.

Otra complicación al aplicar LDA y el discriminante de Fisher a datos reales ocurre cuando el número de mediciones de cada muestra (es decir, la dimensionalidad de cada vector de datos) excede el número de muestras en cada clase. [5] En este caso, las estimaciones de covarianza no tienen rango completo y, por lo tanto, no se pueden invertir. Hay varias maneras de abordar esto. Una es utilizar una pseudoinversa en lugar de la matriz inversa habitual en las fórmulas anteriores. Sin embargo, se puede lograr una mejor estabilidad numérica proyectando primero el problema en el subespacio abarcado por . [23] Otra estrategia para tratar con un tamaño de muestra pequeño es utilizar un estimador de contracción de la matriz de covarianza, que se puede expresar matemáticamente como

donde es la matriz de identidad y es la intensidad de contracción o parámetro de regularización . Esto conduce al marco del análisis discriminante regularizado [24] o análisis discriminante de contracción. [25]

Además, en muchos casos prácticos los discriminantes lineales no son adecuados. LDA y el discriminante de Fisher se pueden ampliar para su uso en clasificación no lineal mediante el truco del núcleo . Aquí, las observaciones originales se mapean efectivamente en un espacio no lineal de dimensiones superiores. La clasificación lineal en este espacio no lineal es entonces equivalente a la clasificación no lineal en el espacio original. El ejemplo más comúnmente utilizado de esto es el discriminante de Fisher del núcleo .

LDA se puede generalizar al análisis discriminante múltiple , donde c se convierte en una variable categórica con N estados posibles, en lugar de solo dos. De manera análoga, si las densidades condicionales de clase son normales con covarianzas compartidas, el estadístico suficiente para son los valores de N proyecciones, que son el subespacio abarcado por las N medias, proyectadas afines por la matriz de covarianza inversa. Estas proyecciones se pueden encontrar resolviendo un problema de valores propios generalizado , donde el numerador es la matriz de covarianza formada al tratar las medias como muestras y el denominador es la matriz de covarianza compartida. Consulte “LDA multiclase” más arriba para obtener más detalles.

Además de los ejemplos que se dan a continuación, LDA se aplica en posicionamiento y gestión de productos .

En la predicción de quiebras basada en ratios contables y otras variables financieras, el análisis discriminante lineal fue el primer método estadístico aplicado para explicar sistemáticamente qué empresas entraron en quiebra y qué empresas sobrevivieron. A pesar de las limitaciones, incluida la conocida no conformidad de los ratios contables con los supuestos de distribución normal de LDA, el modelo de 1968 de Edward Altman [26] sigue siendo un modelo líder en aplicaciones prácticas. [27] [28] [29]

En el reconocimiento facial computarizado , cada rostro está representado por una gran cantidad de valores de píxeles. El análisis discriminante lineal se utiliza principalmente aquí para reducir la cantidad de características a una cantidad más manejable antes de la clasificación. Cada una de las nuevas dimensiones es una combinación lineal de valores de píxeles, que forman una plantilla. Las combinaciones lineales obtenidas utilizando el discriminante lineal de Fisher se denominan caras de Fisher , mientras que las obtenidas mediante el análisis de componentes principales relacionados se denominan caras propias .

En marketing , el análisis discriminante alguna vez se utilizó a menudo para determinar los factores que distinguen diferentes tipos de clientes y/o productos sobre la base de encuestas u otras formas de datos recopilados. Ahora se utilizan con mayor frecuencia la regresión logística u otros métodos. El uso del análisis discriminante en marketing se puede describir mediante los siguientes pasos:

La principal aplicación del análisis discriminante en medicina es la evaluación del estado de gravedad de un paciente y el pronóstico del resultado de la enfermedad. Por ejemplo, durante el análisis retrospectivo, los pacientes se dividen en grupos según la gravedad de la enfermedad: forma leve, moderada y grave. Luego se estudian los resultados de los análisis clínicos y de laboratorio para revelar variables estadísticamente diferentes en los grupos estudiados. Utilizando estas variables, se construyen funciones discriminantes que ayudan a clasificar objetivamente la enfermedad en un futuro paciente en forma leve, moderada o grave.

En biología, se utilizan principios similares para clasificar y definir grupos de diferentes objetos biológicos, por ejemplo, para definir tipos de fagos de Salmonella enteritidis basándose en espectros infrarrojos de transformada de Fourier, [30] para detectar fuentes animales de Escherichia coli estudiando sus factores de virulencia [31] etc.

Este método se puede utilizar para separar las zonas de alteración [ se necesita aclaración ] . Por ejemplo, cuando se encuentran disponibles diferentes datos de varias zonas, el análisis discriminante puede encontrar el patrón dentro de los datos y clasificarlo de manera efectiva. [32]

El análisis de funciones discriminantes es muy similar a la regresión logística y ambos pueden usarse para responder las mismas preguntas de investigación. [10] La regresión logística no tiene tantos supuestos y restricciones como el análisis discriminante. Sin embargo, cuando se cumplen los supuestos del análisis discriminante, es más poderoso que la regresión logística. [33] A diferencia de la regresión logística, el análisis discriminante se puede utilizar con tamaños de muestra pequeños. Se ha demostrado que cuando los tamaños de muestra son iguales y se mantiene la homogeneidad de la varianza/covarianza, el análisis discriminante es más preciso. [8] A pesar de todas estas ventajas, la regresión logística se ha convertido, no obstante, en la opción común, ya que los supuestos del análisis discriminante rara vez se cumplen. [9] [8]

Las anomalías geométricas en dimensiones superiores conducen a la conocida maldición de la dimensionalidad . Sin embargo, la utilización adecuada de los fenómenos de concentración de medidas puede facilitar el cálculo. [34] Donoho y Tanner destacaron un caso importante de estos fenómenos de bendición de dimensionalidad : si una muestra es esencialmente de alta dimensión, entonces cada punto puede separarse del resto de la muestra mediante una desigualdad lineal, con alta probabilidad, incluso para exponencialmente. muestras grandes. [35] Estas desigualdades lineales se pueden seleccionar en la forma estándar (de Fisher) del discriminante lineal para una familia rica de distribución de probabilidad. [36] En particular, tales teoremas se prueban para distribuciones log-cóncavas, incluida la distribución normal multidimensional (la prueba se basa en las desigualdades de concentración para medidas log-cóncavas [37] ) y para medidas de productos en un cubo multidimensional (esto se prueba usando Desigualdad de concentración de Talagrand para espacios de probabilidad de productos). La separabilidad de datos mediante discriminantes lineales clásicos simplifica el problema de la corrección de errores para sistemas de inteligencia artificial en alta dimensión. [38]

{{cite book}}: CS1 maint: date and year (link)