En estadística , la homogeneidad y su opuesto, la heterogeneidad , surgen al describir las propiedades de un conjunto de datos o de varios conjuntos de datos. Se relacionan con la validez de la suposición, a menudo conveniente, de que las propiedades estadísticas de cualquier parte de un conjunto de datos general son las mismas que las de cualquier otra parte. En el metanálisis , que combina los datos de varios estudios, la homogeneidad mide las diferencias o similitudes entre los diversos estudios (véase también Heterogeneidad de estudios ).

La homogeneidad se puede estudiar con distintos grados de complejidad. Por ejemplo, las consideraciones de homocedasticidad examinan cuánto cambia la variabilidad de los valores de los datos a lo largo de un conjunto de datos. Sin embargo, las cuestiones de homogeneidad se aplican a todos los aspectos de las distribuciones estadísticas , incluido el parámetro de ubicación . Por lo tanto, un estudio más detallado examinaría los cambios en toda la distribución marginal . Un estudio de nivel intermedio podría pasar de examinar la variabilidad a estudiar los cambios en la asimetría . Además de estos, las cuestiones de homogeneidad también se aplican a las distribuciones conjuntas .

El concepto de homogeneidad se puede aplicar de muchas maneras diferentes y, para ciertos tipos de análisis estadístico, se utiliza para buscar otras propiedades que podrían necesitar ser tratadas como variables dentro de un conjunto de datos una vez que se han abordado algunos tipos iniciales de no homogeneidad.

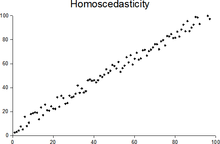

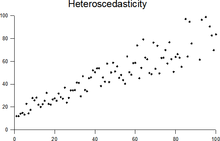

En estadística , una secuencia de variables aleatorias es homocedástica ( / ˌh oʊ m oʊ s k ə ˈ d æ s t ɪ k / ) si todas sus variables aleatorias tienen la misma varianza finita ; esto también se conoce como homogeneidad de varianza. La noción complementaria se llama heterocedasticidad, también conocida como heterogeneidad de varianza. Las grafías homocedasticidad y heterocedasticidad también se utilizan con frecuencia. “Scedasticidad” proviene de la palabra griega antigua “skedánnymi”, que significa “dispersar”. [1] [2] [3] Suponer que una variable es homocedástica cuando en realidad es heterocedástica ( / ˌ h ɛ t ər oʊ s k ə ˈ d æ s t ɪ k / ) da como resultado estimaciones puntuales imparciales pero ineficientes y estimaciones sesgadas de los errores estándar , y puede resultar en una sobreestimación de la bondad del ajuste medida por el coeficiente de Pearson .

La existencia de heterocedasticidad es una preocupación importante en el análisis de regresión y el análisis de varianza , ya que invalida las pruebas estadísticas de significancia que suponen que todos los errores de modelado tienen la misma varianza. Si bien el estimador de mínimos cuadrados ordinarios sigue siendo imparcial en presencia de heterocedasticidad, es ineficiente y la inferencia basada en el supuesto de homocedasticidad es engañosa. En ese caso, los mínimos cuadrados generalizados (GLS) se usaban con frecuencia en el pasado. [4] [5] Hoy en día, la práctica estándar en econometría es incluir errores estándar consistentes con la heterocedasticidad en lugar de usar GLS, ya que GLS puede exhibir un fuerte sesgo en muestras pequeñas si se desconoce la función cedástica real. [6]

Dado que la heterocedasticidad se refiere a las expectativas del segundo momento de los errores, su presencia se denomina especificación errónea de segundo orden. [7]

El econometrista Robert Engle recibió el Premio Nobel de Economía en 2003 por sus estudios sobre el análisis de regresión en presencia de heterocedasticidad, lo que condujo a su formulación de la técnica de modelado de heterocedasticidad condicional autorregresiva (ARCH). [8]Las diferencias en los valores típicos en el conjunto de datos se pueden abordar inicialmente mediante la construcción de un modelo de regresión que utilice ciertas variables explicativas para relacionar las variaciones en el valor típico con cantidades conocidas. Luego debería haber una etapa posterior de análisis para examinar si los errores en las predicciones de la regresión se comportan de la misma manera en todo el conjunto de datos. Por lo tanto, la cuestión pasa a ser la homogeneidad de la distribución de los residuos, a medida que cambian las variables explicativas. Véase análisis de regresión .

Las etapas iniciales del análisis de una serie temporal pueden implicar trazar valores en función del tiempo para examinar la homogeneidad de la serie de diversas maneras: estabilidad a lo largo del tiempo en oposición a una tendencia; estabilidad de fluctuaciones locales a lo largo del tiempo.

En hidrología , se analizan series de datos de varios sitios compuestos por valores anuales del caudal máximo anual de los ríos. Un modelo común es que las distribuciones de estos valores son las mismas para todos los sitios, salvo por un simple factor de escala, de modo que la ubicación y la escala están vinculadas de una manera sencilla. Puede entonces plantearse la cuestión de examinar la homogeneidad en los sitios de la distribución de los valores escalados.

En meteorología , los conjuntos de datos meteorológicos se adquieren a lo largo de muchos años de registros y, como parte de esto, las mediciones en ciertas estaciones pueden cesar ocasionalmente mientras que, aproximadamente al mismo tiempo, pueden comenzar las mediciones en ubicaciones cercanas. Entonces surgen preguntas sobre si, si los registros se combinan para formar un único conjunto más largo de registros, esos registros pueden considerarse homogéneos a lo largo del tiempo. Se puede encontrar un ejemplo de prueba de homogeneidad de datos de velocidad y dirección del viento en Romanić et al ., 2015. [9]

Las encuestas de población sencillas pueden partir de la idea de que las respuestas serán homogéneas en toda la población. Para evaluar la homogeneidad de la población, habría que observar si las respuestas de ciertas subpoblaciones identificables difieren de las de otras. Por ejemplo, los propietarios de automóviles pueden diferir de los que no lo tienen, o puede haber diferencias entre distintos grupos de edad.

Una prueba de homogeneidad, en el sentido de equivalencia exacta de distribuciones estadísticas, puede basarse en una estadística E. Una prueba de ubicación prueba la hipótesis más simple de que las distribuciones tienen el mismo parámetro de ubicación .