Una red neuronal es un grupo de unidades interconectadas llamadas neuronas que se envían señales entre sí. Las neuronas pueden ser células biológicas o modelos matemáticos . Si bien las neuronas individuales son simples, muchas de ellas juntas en una red pueden realizar tareas complejas. Existen dos tipos principales de redes neuronales.

En el contexto de la biología, una red neuronal es una población de neuronas biológicas conectadas químicamente entre sí mediante sinapsis . Una neurona determinada puede estar conectada a cientos de miles de sinapsis. [1] Cada neurona envía y recibe señales electroquímicas llamadas potenciales de acción a sus vecinas conectadas. Una neurona puede cumplir una función excitatoria , amplificando y propagando las señales que recibe, o una función inhibidora , suprimiendo las señales en su lugar. [1]

Las poblaciones de neuronas interconectadas que son más pequeñas que las redes neuronales se denominan circuitos neuronales . Las redes interconectadas muy grandes se denominan redes cerebrales de gran escala y muchas de ellas juntas forman cerebros y sistemas nerviosos .

Las señales generadas por las redes neuronales del cerebro eventualmente viajan a través del sistema nervioso y a través de las uniones neuromusculares hasta las células musculares , donde causan contracción y, por lo tanto, movimiento. [2]

En el aprendizaje automático, una red neuronal es un modelo matemático artificial que se utiliza para aproximar funciones no lineales. Si bien las primeras redes neuronales artificiales eran máquinas físicas, [3] hoy en día casi siempre se implementan en software .

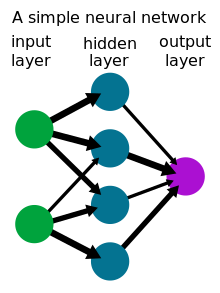

Las neuronas en una red neuronal artificial suelen estar organizadas en capas, y la información pasa de la primera capa (la capa de entrada) a través de una o más capas intermedias ( las capas ocultas ) hasta la capa final (la capa de salida). [4] La entrada de "señal" a cada neurona es un número, específicamente una combinación lineal de las salidas de las neuronas conectadas en la capa anterior. La señal que cada neurona emite se calcula a partir de este número, de acuerdo con su función de activación . El comportamiento de la red depende de las fortalezas (o pesos ) de las conexiones entre neuronas. Una red se entrena modificando estos pesos a través de la minimización de riesgos empíricos o la retropropagación para ajustarse a un conjunto de datos preexistente. [5]

Las redes neuronales se utilizan para resolver problemas en inteligencia artificial y, por lo tanto, han encontrado aplicaciones en muchas disciplinas, incluido el modelado predictivo , el control adaptativo , el reconocimiento facial , el reconocimiento de escritura a mano , los juegos en general y la IA generativa .

La base teórica de las redes neuronales contemporáneas fue propuesta independientemente por Alexander Bain en 1873 [6] y William James en 1890 [7]. Ambos postularon que el pensamiento humano surgió de interacciones entre grandes cantidades de neuronas dentro del cerebro. En 1949, Donald Hebb describió el aprendizaje hebbiano , la idea de que las redes neuronales pueden cambiar y aprender con el tiempo al fortalecer una sinapsis cada vez que una señal viaja a través de ella. [8]

Las redes neuronales artificiales se utilizaron originalmente para modelar redes neuronales biológicas a partir de la década de 1930 bajo el enfoque del conexionismo . Sin embargo, a partir de la invención del perceptrón , una red neuronal artificial simple, por Warren McCulloch y Walter Pitts en 1943, [9] seguida de la implementación de una en hardware por Frank Rosenblatt en 1957, [3] las redes neuronales artificiales comenzaron a usarse cada vez más para aplicaciones de aprendizaje automático y cada vez son más diferentes de sus contrapartes biológicas.