En visión por computadora y gráficos por computadora , la reconstrucción 3D es el proceso de capturar la forma y apariencia de objetos reales. Este proceso se puede lograr mediante métodos activos o pasivos. [1] Si se permite que el modelo cambie su forma con el tiempo, esto se conoce como reconstrucción no rígida o espacio-temporal . [2]

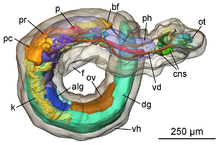

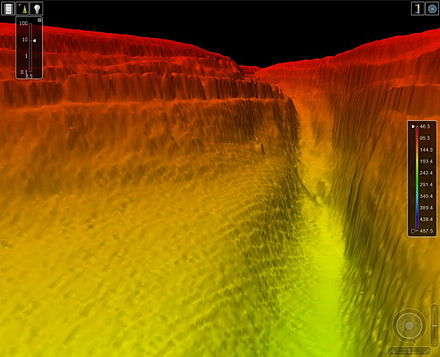

La investigación de la reconstrucción 3D siempre ha sido un objetivo difícil. Mediante el uso de la reconstrucción 3D se puede determinar el perfil 3D de cualquier objeto, así como conocer las coordenadas 3D de cualquier punto del perfil. La reconstrucción 3D de objetos es un problema generalmente científico y una tecnología central de una amplia variedad de campos, como el diseño geométrico asistido por computadora ( CAGD ), gráficos por computadora , animación por computadora , visión por computadora , imágenes médicas , ciencia computacional , realidad virtual , medios digitales. , etc. [3] Por ejemplo, la información sobre las lesiones de los pacientes se puede presentar en 3D en la computadora, lo que ofrece un enfoque nuevo y preciso en el diagnóstico y, por lo tanto, tiene un valor clínico vital. [4] Los modelos de elevación digitales se pueden reconstruir utilizando métodos como la altimetría láser aérea [5] o el radar de apertura sintética . [6]

Los métodos activos, es decir, métodos de datos de rango, dado el mapa de profundidad , reconstruyen el perfil 3D mediante un enfoque de aproximación numérica y construyen el objeto en un escenario basado en el modelo. Estos métodos interfieren activamente con el objeto reconstruido, ya sea mecánica o radiométricamente utilizando telémetros , para adquirir el mapa de profundidad, por ejemplo, luz estructurada , telémetro láser y otras técnicas de detección activa. Un ejemplo simple de un método mecánico usaría un medidor de profundidad para medir la distancia a un objeto giratorio colocado sobre una plataforma giratoria. Los métodos radiométricos más aplicables emiten radiación hacia el objeto y luego miden su parte reflejada. Los ejemplos van desde fuentes de luz en movimiento, luz visible coloreada, láseres de tiempo de vuelo [7] hasta microondas o ultrasonidos 3D . Consulte Escaneo 3D para obtener más detalles.

Los métodos pasivos de reconstrucción 3D no interfieren con el objeto reconstruido; solo utilizan un sensor para medir el resplandor reflejado o emitido por la superficie del objeto para inferir su estructura 3D a través de la comprensión de la imagen . [8] Normalmente, el sensor es un sensor de imagen en una cámara sensible a la luz visible y la entrada al método es un conjunto de imágenes digitales (una, dos o más) o vídeo. En este caso hablamos de reconstrucción basada en imágenes y el resultado es un modelo 3D . En comparación con los métodos activos, los métodos pasivos se pueden aplicar a una gama más amplia de situaciones. [9]

Los métodos de señales monoculares se refieren al uso de una o más imágenes desde un punto de vista (cámara) para proceder a la construcción 3D. Hace uso de características 2D (por ejemplo, siluetas, sombreado y textura) para medir la forma 3D, y es por eso que también se llama Shape-From-X, donde X puede ser siluetas , sombreado , textura, etc. La reconstrucción 3D a través de señales monoculares es simple. y rápido, y sólo se necesita una imagen digital adecuada, por lo que sólo una cámara es adecuada. Técnicamente evita la correspondencia estéreo , que es bastante compleja. [10]

Forma a partir del sombreado Debido al análisis de la información de sombra en la imagen, mediante el uso de la reflectancia lambertiana , se restaura la profundidad de la información normal de la superficie del objeto para reconstruir. [12]

Estéreo fotométrico Este método es más sofisticado que el método de forma de sombreado. Se utilizan imágenes tomadas en diferentes condiciones de iluminación para resolver la información de profundidad. Vale la pena mencionar que este enfoque requiere más de una imagen. [13]

Forma a partir de textura Supongamos que un objeto con una superficie lisa está cubierto por unidades de textura replicadas y su proyección de 3D a 2D provoca distorsión y perspectiva . La distorsión y la perspectiva medidas en imágenes 2D proporcionan la pista para resolver inversamente la profundidad de la información normal de la superficie del objeto. [14]

Soluciones basadas en aprendizaje automático El aprendizaje automático permite aprender la correspondencia entre las características sutiles en la entrada y el equivalente 3D respectivo. Las redes neuronales profundas han demostrado ser muy eficaces para la reconstrucción 3D a partir de una imagen de un solo color. [15] Esto funciona incluso para imágenes de entrada no fotorrealistas, como bocetos. [16] Gracias al alto nivel de precisión en las características 3D reconstruidas, se ha empleado un método basado en aprendizaje profundo para aplicaciones de ingeniería biomédica para reconstruir imágenes de TC a partir de rayos X. [17]

La visión estéreo obtiene la información geométrica tridimensional de un objeto a partir de múltiples imágenes basándose en la investigación del sistema visual humano . [18] Los resultados se presentan en forma de mapas de profundidad. Las imágenes de un objeto adquiridas por dos cámaras simultáneamente en diferentes ángulos de visión , o por una sola cámara en diferentes momentos y diferentes ángulos de visión, se utilizan para restaurar su información geométrica 3D y reconstruir su perfil y ubicación 3D. Esto es más directo que los métodos monoculares, como la forma a partir del sombreado.

El método de visión estéreo binocular requiere dos cámaras idénticas con ejes ópticos paralelos para observar un mismo objeto, adquiriendo dos imágenes desde diferentes puntos de vista. En términos de relaciones trigonométricas, la información de profundidad se puede calcular a partir de la disparidad. El método de visión estéreo binocular está bien desarrollado y contribuye de manera estable a una reconstrucción 3D favorable, lo que lleva a un mejor rendimiento en comparación con otras construcciones 3D. Desafortunadamente, requiere mucho cálculo y además su rendimiento es bastante pobre cuando la distancia de la línea de base es grande.

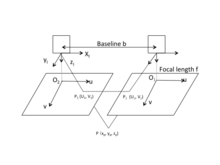

El enfoque de utilizar la visión estéreo binocular para adquirir información geométrica 3D de un objeto se basa en la disparidad visual . [19] La siguiente imagen proporciona un diagrama esquemático simple de visión estéreo binocular con visión horizontal, donde b es la línea de base entre los centros proyectivos de dos cámaras.

El origen del sistema de coordenadas de la cámara está en el centro óptico de la lente de la cámara, como se muestra en la figura. En realidad, el plano de imagen de la cámara está detrás del centro óptico de la lente de la cámara. Sin embargo, para simplificar el cálculo, las imágenes se dibujan delante del centro óptico de la lente mediante f. El eje u y el eje v del sistema de coordenadas de la imagen están en la misma dirección que el eje x y el eje y del sistema de coordenadas de la cámara, respectivamente. El origen del sistema de coordenadas de la imagen se encuentra en la intersección del plano de la imagen y el eje óptico. Supongamos un punto del mundo cuyos puntos de imagen correspondientes están y respectivamente en el plano de imagen izquierdo y derecho. Supongamos que dos cámaras están en el mismo plano, entonces las coordenadas y de y son idénticas, es decir, . Según relaciones trigonométricas ,

donde están las coordenadas de en el sistema de coordenadas de la cámara izquierda, es la distancia focal de la cámara. La disparidad visual se define como la diferencia en la ubicación del punto de imagen de un determinado punto del mundo adquirido por dos cámaras,

a partir del cual se pueden calcular las coordenadas de.

Por tanto, una vez conocidas las coordenadas de los puntos de la imagen, además de los parámetros de dos cámaras, se pueden determinar las coordenadas 3D del punto.

La reconstrucción 3D consta de las siguientes secciones:

La adquisición de imágenes digitales 2D es la fuente de información de la reconstrucción 3D. La reconstrucción 3D comúnmente utilizada se basa en dos o más imágenes, aunque en algunos casos puede emplear solo una imagen. Existen varios tipos de métodos para la adquisición de imágenes que dependen de las ocasiones y propósitos de la aplicación específica. No sólo se deben cumplir los requisitos de la aplicación, sino que también se deben considerar la disparidad visual, la iluminación, el rendimiento de la cámara y las características del escenario.

La calibración de la cámara en Binocular Stereo Vision se refiere a la determinación de la relación de mapeo entre los puntos de la imagen y las coordenadas espaciales en el escenario 3D. La calibración de la cámara es una parte básica y esencial en la reconstrucción 3D mediante Visión Estéreo Binocular.

El objetivo de la extracción de características es obtener las características de las imágenes, a través de las cuales se procesa la correspondencia estéreo. Como resultado, las características de las imágenes están estrechamente relacionadas con la elección de los métodos de comparación. No existe una teoría universalmente aplicable para la extracción de características, lo que lleva a una gran diversidad de correspondencias estéreo en la investigación de la visión estéreo binocular.

La correspondencia estéreo consiste en establecer la correspondencia entre factores primitivos en las imágenes, es decir, hacer coincidir y partir de dos imágenes. Se deben tener en cuenta ciertos factores de interferencia en el escenario, por ejemplo, iluminación, ruido, características físicas de la superficie, etc.

Según una correspondencia precisa, combinada con los parámetros de ubicación de la cámara, la información geométrica 3D se puede recuperar sin dificultades. Debido al hecho de que la precisión de la reconstrucción 3D depende de la precisión de la correspondencia, el error de los parámetros de ubicación de la cámara, etc., los procedimientos anteriores deben realizarse con cuidado para lograr una reconstrucción 3D relativamente precisa.

La rutina clínica de diagnóstico, el seguimiento del paciente, la cirugía asistida por computadora, la planificación quirúrgica, etc., se ven facilitados por modelos 3D precisos de la parte deseada de la anatomía humana. La principal motivación detrás de la reconstrucción 3D incluye

Aplicaciones:

La reconstrucción 3D tiene aplicaciones en muchos campos. Incluyen:

Planteamiento del problema:

La mayoría de los algoritmos disponibles para la reconstrucción 3D son extremadamente lentos y no se pueden utilizar en tiempo real. Aunque los algoritmos presentados aún están en pañales, tienen el potencial de realizar un cálculo rápido.

Enfoques existentes:

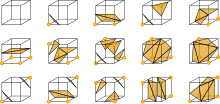

Delaunay y las formas alfa

Ambos métodos se han ampliado recientemente para reconstruir nubes de puntos con ruido. [34] En este método, la calidad de los puntos determina la viabilidad del método. Para una triangulación precisa, dado que estamos utilizando todo el conjunto de nubes de puntos, los puntos de la superficie con el error por encima del umbral se representarán explícitamente en la geometría reconstruida. [32]

Métodos de puesta a cero

La reconstrucción de la superficie se realiza utilizando una función de distancia que asigna a cada punto en el espacio una distancia con signo a la superficie S. Se utiliza un algoritmo de contorno para extraer un conjunto de ceros que se utiliza para obtener una representación poligonal del objeto. Así, el problema de reconstruir una superficie a partir de una nube de puntos desorganizada se reduce a la definición de la función f apropiada con valor cero para los puntos muestreados y valor diferente a cero para el resto. Un algoritmo llamado cubos de marcha estableció el uso de tales métodos. [35] Hay diferentes variantes para un algoritmo dado, algunas usan una función discreta f , mientras que otras usan una función de base radial poliarmónica para ajustar el conjunto de puntos inicial. [36] [37] También se han utilizado funciones como Mínimos Cuadrados en Movimiento, funciones básicas con soporte local, [38] basadas en la ecuación de Poisson. La pérdida de precisión de la geometría en áreas con curvatura extrema, es decir, esquinas y bordes, es uno de los principales problemas encontrados. Además, el pretratamiento de la información, mediante la aplicación de algún tipo de técnica de filtrado, también afecta a la definición de las esquinas al suavizarlas. Existen varios estudios relacionados con técnicas de posprocesamiento utilizadas en la reconstrucción para la detección y refinamiento de esquinas pero estos métodos aumentan la complejidad de la solución. [39]

Técnica de realidad virtual

La transparencia total del volumen del objeto se visualiza mediante la técnica de realidad virtual. Las imágenes se realizarán proyectando rayos a través de datos de volumen. A lo largo de cada rayo, es necesario calcular la opacidad y el color en cada vóxel. Luego, la información calculada a lo largo de cada rayo se agregará a un píxel en el plano de la imagen. Esta técnica nos ayuda a ver de forma integral toda una estructura compacta del objeto. Dado que la técnica requiere una enorme cantidad de cálculos, las computadoras requieren una configuración sólida que sea apropiada para datos de bajo contraste. Se pueden considerar dos métodos principales para la proyección de rayos:

Cuadrícula de vóxeles

En esta técnica de filtrado, el espacio de entrada se muestrea utilizando una cuadrícula de vóxeles 3D para reducir la cantidad de puntos. [40] Para cada vóxel , se elige un centroide como representante de todos los puntos. Hay dos enfoques, la selección del centroide del vóxel o seleccionar el centroide de los puntos que se encuentran dentro del vóxel. Obtener el promedio de puntos interno tiene un costo computacional mayor, pero ofrece mejores resultados. De este modo, se obtiene un subconjunto del espacio de entrada que representa aproximadamente la superficie subyacente. El método Voxel Grid presenta los mismos problemas que otras técnicas de filtrado: imposibilidad de definir el número final de puntos que representan la superficie, pérdida de información geométrica por la reducción de los puntos dentro de un vóxel y sensibilidad a espacios de entrada ruidosos.

{{cite book}}: Mantenimiento CS1: fecha y año ( enlace )