Un motor de búsqueda es un sistema de software que proporciona hipervínculos a páginas web y otra información relevante en la Web en respuesta a la consulta de un usuario . El usuario ingresa una consulta dentro de un navegador web o una aplicación móvil y los resultados de la búsqueda suelen ser una lista de hipervínculos, acompañados de resúmenes textuales e imágenes. Los usuarios también tienen la opción de limitar la búsqueda a un tipo específico de resultados, como imágenes, videos o noticias.

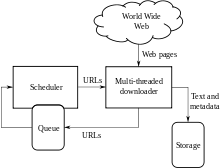

Para un proveedor de búsqueda, su motor es parte de un sistema informático distribuido que puede abarcar muchos centros de datos en todo el mundo. La velocidad y precisión de la respuesta de un motor a una consulta se basa en un sistema complejo de indexación que se actualiza continuamente mediante rastreadores web automatizados . Esto puede incluir la minería de datos de los archivos y bases de datos almacenados en servidores web , pero algunos contenidos no son accesibles para los rastreadores.

Desde los albores de la Web en la década de 1990, han existido muchos motores de búsqueda, pero Google Search se convirtió en el dominante en la década de 2000 y se ha mantenido así. Actualmente, tiene una participación de mercado global del 91 %. [1] [2] El negocio de los sitios web que mejoran su visibilidad en los resultados de búsqueda , conocido como marketing y optimización , se ha centrado en gran medida en Google.

En 1945, Vannevar Bush describió un sistema de recuperación de información que permitiría a un usuario acceder a una gran cantidad de información, todo en un solo escritorio. [3] Lo llamó memex . Describió el sistema en un artículo titulado " As We May Think " que se publicó en The Atlantic Monthly . [4] El memex tenía como objetivo brindarle al usuario la capacidad de superar la creciente dificultad de localizar información en índices centralizados de trabajo científico cada vez más numerosos. Vannevar Bush imaginó bibliotecas de investigación con anotaciones conectadas, que son similares a los hipervínculos modernos . [5]

El análisis de enlaces eventualmente se convirtió en un componente crucial de los motores de búsqueda a través de algoritmos como Hyper Search y PageRank . [6] [7]

Los primeros motores de búsqueda en Internet son anteriores al debut de la Web en diciembre de 1990: la búsqueda de usuarios WHOIS se remonta a 1982, [8] y la búsqueda de usuarios multired del Servicio de Información Knowbot se implementó por primera vez en 1989. [9] El primer motor de búsqueda bien documentado que buscaba archivos de contenido, es decir, archivos FTP , fue Archie , que debutó el 10 de septiembre de 1990. [10]

Antes de septiembre de 1993, la World Wide Web estaba indexada completamente a mano. Había una lista de servidores web editada por Tim Berners-Lee y alojada en el servidor web del CERN . Se conserva una instantánea de la lista de 1992, [11] pero a medida que se iban poniendo en línea más y más servidores web, la lista central ya no podía seguir el ritmo. En el sitio de NCSA , se anunciaban nuevos servidores bajo el título "¡Novedades!". [12]

La primera herramienta utilizada para buscar contenido (en lugar de usuarios) en Internet fue Archie . [13] El nombre significa "archivo" sin la "v". [14] Fue creado por Alan Emtage , [14] [15] [16] [17] estudiante de informática en la Universidad McGill en Montreal, Quebec , Canadá. El programa descargaba los listados de directorios de todos los archivos ubicados en sitios FTP ( Protocolo de transferencia de archivos ) públicos y anónimos, creando una base de datos de nombres de archivos en la que se podían realizar búsquedas; sin embargo, Archie Search Engine no indexaba los contenidos de estos sitios ya que la cantidad de datos era tan limitada que se podía buscar fácilmente de forma manual.

El auge de Gopher (creado en 1991 por Mark McCahill en la Universidad de Minnesota ) dio lugar a dos nuevos programas de búsqueda, Veronica y Jughead . Al igual que Archie, buscaban los nombres de archivos y títulos almacenados en los sistemas de índice de Gopher. Veronica (Very Easy Rodent-Oriented Net-wide Index to Computerized Archives) proporcionaba una búsqueda por palabra clave de la mayoría de los títulos de menú de Gopher en todos los listados de Gopher. Jughead (Jonzy's Universal Gopher Hierarchy Excavation And Display) era una herramienta para obtener información de menú de servidores Gopher específicos. Si bien el nombre del motor de búsqueda " Archie Search Engine " no era una referencia a la serie de cómics Archie , " Veronica " y " Jughead " son personajes de la serie, por lo que hacen referencia a su predecesor.

En el verano de 1993 no existía ningún motor de búsqueda para la web, aunque se mantenían a mano numerosos catálogos especializados. Oscar Nierstrasz, de la Universidad de Ginebra, escribió una serie de scripts en Perl que reflejaban periódicamente estas páginas y las reescribían en un formato estándar. Esto formó la base de W3Catalog , el primer motor de búsqueda primitivo de la web, lanzado el 2 de septiembre de 1993. [18]

En junio de 1993, Matthew Gray, entonces en el MIT , produjo lo que probablemente fue el primer robot web , el World Wide Web Wanderer basado en Perl , y lo utilizó para generar un índice llamado "Wandex". El propósito de Wanderer era medir el tamaño de la World Wide Web, lo que hizo hasta fines de 1995. El segundo motor de búsqueda de la web, Aliweb, apareció en noviembre de 1993. Aliweb no usaba un robot web , sino que dependía de que los administradores del sitio web le notificaran la existencia en cada sitio de un archivo de índice en un formato particular.

JumpStation (creada en diciembre de 1993 [19] por Jonathon Fletcher ) utilizaba un robot web para buscar páginas web y crear su índice, y utilizaba un formulario web como interfaz para su programa de consulta. Por lo tanto, fue la primera herramienta de descubrimiento de recursos de la WWW que combinaba las tres características esenciales de un motor de búsqueda web (rastreo, indexación y búsqueda), como se describe a continuación. Debido a los recursos limitados disponibles en la plataforma en la que se ejecutaba, su indexación y, por lo tanto, la búsqueda se limitaban a los títulos y encabezados encontrados en las páginas web que encontraba el rastreador.

Uno de los primeros motores de búsqueda basados en rastreadores "todo texto" fue WebCrawler , que salió al mercado en 1994. A diferencia de sus predecesores, permitía a los usuarios buscar cualquier palabra en cualquier página web , lo que se ha convertido en el estándar para todos los motores de búsqueda más importantes desde entonces. También fue el motor de búsqueda más conocido por el público. Además, en 1994, se lanzó Lycos (que comenzó en la Universidad Carnegie Mellon ) y se convirtió en un importante emprendimiento comercial.

El primer motor de búsqueda popular en la Web fue Yahoo! Search . [20] El primer producto de Yahoo !, fundado por Jerry Yang y David Filo en enero de 1994, fue un directorio web llamado Yahoo! Directory . En 1995, se agregó una función de búsqueda, que permitía a los usuarios buscar en Yahoo! Directory. [21] [22] Se convirtió en una de las formas más populares para que las personas encontraran páginas web de interés, pero su función de búsqueda operaba en su directorio web, en lugar de sus copias de texto completo de las páginas web.

Poco después, aparecieron varios motores de búsqueda que competían por ganar popularidad. Entre ellos, se encontraban Magellan , Excite , Infoseek , Inktomi , Northern Light y AltaVista . Los buscadores de información también podían navegar por el directorio en lugar de realizar una búsqueda basada en palabras clave.

En 1996, Robin Li desarrolló el algoritmo de puntuación de sitios RankDex para la clasificación de las páginas de resultados de los motores de búsqueda [23] [24] [25] y recibió una patente estadounidense para la tecnología. [26] Fue el primer motor de búsqueda que utilizó hipervínculos para medir la calidad de los sitios web que estaba indexando, [27] precediendo a la patente de algoritmo muy similar presentada por Google dos años después en 1998. [28] Larry Page hizo referencia al trabajo de Li en algunas de sus patentes estadounidenses para PageRank. [29] Li utilizó más tarde su tecnología Rankdex para el motor de búsqueda Baidu , que fue fundado por él en China y lanzado en 2000.

En 1996, Netscape quería ofrecer a un único motor de búsqueda un contrato exclusivo como motor de búsqueda destacado en el navegador web de Netscape. Hubo tanto interés que, en lugar de eso, Netscape llegó a acuerdos con cinco de los principales motores de búsqueda: por 5 millones de dólares al año, cada motor de búsqueda estaría en rotación en la página de motores de búsqueda de Netscape. Los cinco motores eran Yahoo!, Magellan, Lycos, Infoseek y Excite. [30] [31]

Google adoptó la idea de vender términos de búsqueda en 1998 de una pequeña empresa de motores de búsqueda llamada goto.com . Esta medida tuvo un efecto significativo en el negocio de los motores de búsqueda, que pasó de estar en dificultades a convertirse en uno de los negocios más rentables de Internet. [ cita requerida ]

Los motores de búsqueda también fueron conocidos como algunas de las estrellas más brillantes en el frenesí de inversión en Internet que se produjo a finales de los años 1990. [32] Varias empresas entraron en el mercado de forma espectacular, recibiendo ganancias récord durante sus ofertas públicas iniciales . Algunas han retirado su motor de búsqueda público y están comercializando ediciones exclusivas para empresas, como Northern Light. Muchas empresas de motores de búsqueda se vieron atrapadas en la burbuja punto-com , un auge del mercado impulsado por la especulación que alcanzó su punto máximo en marzo de 2000.

Alrededor del año 2000, el motor de búsqueda de Google saltó a la fama. [33] La compañía logró mejores resultados para muchas búsquedas con un algoritmo llamado PageRank , como se explicó en el artículo Anatomy of a Search Engine escrito por Sergey Brin y Larry Page , los posteriores fundadores de Google. [7] Este algoritmo iterativo clasifica las páginas web en función del número y PageRank de otros sitios web y páginas que enlazan allí, bajo la premisa de que las páginas buenas o deseables están enlazadas a más que otras. La patente de Larry Page para PageRank cita la patente anterior RankDex de Robin Li como una influencia. [29] [25] Google también mantuvo una interfaz minimalista para su motor de búsqueda. En contraste, muchos de sus competidores incorporaron un motor de búsqueda en un portal web . De hecho, el motor de búsqueda de Google se volvió tan popular que surgieron motores falsos como Mystery Seeker .

En el año 2000, Yahoo! ofrecía servicios de búsqueda basados en el motor de búsqueda de Inktomi. Yahoo! adquirió Inktomi en 2002 y Overture (que era propietaria de AlltheWeb y AltaVista) en 2003. Yahoo! cambió al motor de búsqueda de Google hasta 2004, cuando lanzó su propio motor de búsqueda basado en las tecnologías combinadas de sus adquisiciones.

Microsoft lanzó por primera vez MSN Search en el otoño de 1998 utilizando los resultados de búsqueda de Inktomi. A principios de 1999, el sitio comenzó a mostrar listados de Looksmart , combinados con resultados de Inktomi. Durante un breve período en 1999, MSN Search utilizó en su lugar los resultados de AltaVista. En 2004, Microsoft comenzó una transición hacia su propia tecnología de búsqueda, impulsada por su propio rastreador web (llamado msnbot ).

El motor de búsqueda renombrado de Microsoft, Bing , se lanzó el 1 de junio de 2009. El 29 de julio de 2009, Yahoo! y Microsoft finalizaron un acuerdo en el que Yahoo! Search sería impulsado por la tecnología Bing de Microsoft.

A partir de 2019, [actualizar]los rastreadores de motores de búsqueda activos incluyen los de Google, Sogou , Baidu, Bing, Gigablast , Mojeek , DuckDuckGo y Yandex .

Un motor de búsqueda mantiene los siguientes procesos casi en tiempo real: [34]

Los motores de búsqueda web obtienen su información rastreando la web de un sitio a otro. La "araña" busca el nombre de archivo estándar robots.txt , que está dirigido a ella. El archivo robots.txt contiene directivas para las arañas de búsqueda, indicándoles qué páginas rastrear y cuáles no. Después de buscar robots.txt y encontrarlo o no, la araña envía cierta información para que sea indexada dependiendo de muchos factores, como los títulos, el contenido de la página, JavaScript , hojas de estilo en cascada (CSS), encabezados o sus metadatos en metaetiquetas HTML . Después de una cierta cantidad de páginas rastreadas, una cierta cantidad de datos indexados o un tiempo de permanencia en el sitio web, la araña deja de rastrear y continúa. "Ningún rastreador web puede rastrear realmente toda la web accesible. Debido a la infinidad de sitios web, las trampas para arañas, el spam y otras exigencias de la web real, los rastreadores aplican en cambio una política de rastreo para determinar cuándo el rastreo de un sitio debe considerarse suficiente. Algunos sitios web se rastrean exhaustivamente, mientras que otros se rastrean solo parcialmente". [36]

La indexación consiste en asociar palabras y otros elementos definibles que se encuentran en las páginas web a sus nombres de dominio y campos basados en HTML . Las asociaciones se realizan en una base de datos pública, que se pone a disposición para las consultas de búsqueda web. Una consulta de un usuario puede ser una sola palabra, varias palabras o una frase. El índice ayuda a encontrar información relacionada con la consulta lo más rápido posible. [35] Algunas de las técnicas de indexación y almacenamiento en caché son secretos comerciales, mientras que el rastreo web es un proceso sencillo de visitar todos los sitios de forma sistemática.

Entre las visitas de la araña , la versión en caché de la página (parte o todo el contenido necesario para mostrarla) almacenada en la memoria de trabajo del motor de búsqueda se envía rápidamente a un consultante. Si una visita se retrasa, el motor de búsqueda puede actuar simplemente como un proxy web en su lugar. En este caso, la página puede diferir de los términos de búsqueda indexados. [35] La página almacenada en caché mantiene la apariencia de la versión cuyas palabras se indexaron previamente, por lo que una versión en caché de una página puede ser útil para el sitio web cuando se ha perdido la página real, pero este problema también se considera una forma leve de linkrot .

Por lo general, cuando un usuario ingresa una consulta en un motor de búsqueda, se trata de algunas palabras clave . [37] El índice ya tiene los nombres de los sitios que contienen las palabras clave, y estos se obtienen instantáneamente del índice. La carga de procesamiento real está en generar las páginas web que son la lista de resultados de búsqueda: cada página en toda la lista debe ponderarse de acuerdo con la información en los índices. [35] Luego, el elemento de resultado de búsqueda superior requiere la búsqueda, reconstrucción y marcado de los fragmentos que muestran el contexto de las palabras clave coincidentes. Estos son solo una parte del procesamiento que requiere cada página web de resultados de búsqueda, y las páginas posteriores (junto a la parte superior) requieren más de este posprocesamiento.

Más allá de las simples búsquedas de palabras clave, los motores de búsqueda ofrecen su propia interfaz gráfica de usuario (GUI ) u operadores controlados por comandos y parámetros de búsqueda para refinar los resultados de búsqueda. Estos proporcionan los controles necesarios para el usuario involucrado en el bucle de retroalimentación que los usuarios crean al filtrar y ponderar mientras refinan los resultados de búsqueda, dadas las páginas iniciales de los primeros resultados de búsqueda. Por ejemplo, desde 2007, el motor de búsqueda Google.com ha permitido filtrar por fecha haciendo clic en "Mostrar herramientas de búsqueda" en la columna más a la izquierda de la página de resultados de búsqueda inicial y luego seleccionando el rango de fechas deseado. [38] También es posible ponderar por fecha porque cada página tiene una hora de modificación. La mayoría de los motores de búsqueda admiten el uso de los operadores booleanos AND, OR y NOT para ayudar a los usuarios finales a refinar la consulta de búsqueda . Los operadores booleanos son para búsquedas literales que permiten al usuario refinar y ampliar los términos de la búsqueda. El motor busca las palabras o frases exactamente como se ingresaron. Algunos motores de búsqueda proporcionan una función avanzada llamada búsqueda de proximidad , que permite a los usuarios definir la distancia entre palabras clave. [35] También existe la búsqueda basada en conceptos , en la que la investigación implica el uso de análisis estadístico en páginas que contienen las palabras o frases que se buscan.

La utilidad de un motor de búsqueda depende de la relevancia del conjunto de resultados que devuelve. Si bien puede haber millones de páginas web que incluyan una palabra o frase en particular, algunas páginas pueden ser más relevantes, populares o autorizadas que otras. La mayoría de los motores de búsqueda emplean métodos para clasificar los resultados y proporcionar los "mejores" resultados primero. La forma en que un motor de búsqueda decide qué páginas son las mejores coincidencias y en qué orden deben mostrarse los resultados varía ampliamente de un motor a otro. [35] Los métodos también cambian con el tiempo a medida que cambia el uso de Internet y evolucionan nuevas técnicas. Hay dos tipos principales de motores de búsqueda que han evolucionado: uno es un sistema de palabras clave predefinidas y ordenadas jerárquicamente que los humanos han programado extensivamente. El otro es un sistema que genera un " índice invertido " al analizar los textos que localiza. Esta primera forma depende mucho más de la propia computadora para hacer la mayor parte del trabajo.

La mayoría de los motores de búsqueda web son empresas comerciales que se sustentan con los ingresos por publicidad y, por lo tanto, algunos de ellos permiten a los anunciantes que sus anuncios aparezcan en posiciones más altas en los resultados de búsqueda a cambio de una tarifa. Los motores de búsqueda que no aceptan dinero por sus resultados de búsqueda ganan dinero publicando anuncios relacionados con la búsqueda junto con los resultados habituales del motor de búsqueda. Los motores de búsqueda ganan dinero cada vez que alguien hace clic en uno de estos anuncios. [39]

La búsqueda local es el proceso que optimiza los esfuerzos de las empresas locales. Se centran en el cambio para asegurarse de que todas las búsquedas sean coherentes. Es importante porque muchas personas deciden a dónde piensan ir y qué comprar en función de sus búsquedas. [40]

A partir de enero de 2022, Google es, con diferencia, el motor de búsqueda más utilizado del mundo, con una cuota de mercado del 90,6%, y los otros motores de búsqueda más utilizados del mundo fueron Bing , Yahoo !, Baidu , Yandex y DuckDuckGo . [2] En 2024, el dominio de Google fue declarado un monopolio ilegal en un caso presentado por el Departamento de Justicia de Estados Unidos. [41][actualizar]

En Rusia, Yandex tiene una cuota de mercado del 62,6%, en comparación con el 28,3% de Google. Y Yandex es el segundo motor de búsqueda más utilizado en teléfonos inteligentes en Asia y Europa. [42] En China, Baidu es el motor de búsqueda más popular. [43] El portal de búsqueda local de Corea del Sur, Naver , se utiliza para el 62,8% de las búsquedas en línea en el país. [44] Yahoo! Japón y Yahoo! Taiwán son las vías más populares para las búsquedas en Internet en Japón y Taiwán, respectivamente. [45] China es uno de los pocos países donde Google no está entre los tres principales motores de búsqueda web por cuota de mercado. Google era anteriormente uno de los principales motores de búsqueda en China, pero se retiró después de un desacuerdo con el gobierno sobre la censura y un ciberataque. Pero Bing está entre los tres principales motores de búsqueda web con una cuota de mercado del 14,95%. Baidu está en la cima con una cuota de mercado del 49,1%. [46] [ cita requerida ]

La mayoría de los mercados de los países de la Unión Europea están dominados por Google, a excepción de la República Checa , donde Seznam es un fuerte competidor. [47]

El motor de búsqueda Qwant tiene su sede en París , Francia , de donde atrae a la mayoría de sus 50 millones de usuarios registrados mensualmente.

Aunque los motores de búsqueda están programados para clasificar los sitios web en función de una combinación de su popularidad y relevancia, los estudios empíricos indican diversos sesgos políticos, económicos y sociales en la información que proporcionan [48] [49] y las suposiciones subyacentes sobre la tecnología. [50] Estos sesgos pueden ser un resultado directo de procesos económicos y comerciales (por ejemplo, las empresas que se anuncian con un motor de búsqueda también pueden volverse más populares en sus resultados de búsqueda orgánicos ) y procesos políticos (por ejemplo, la eliminación de resultados de búsqueda para cumplir con las leyes locales). [51] Por ejemplo, Google no mostrará ciertos sitios web neonazis en Francia y Alemania, donde la negación del Holocausto es ilegal.

Los sesgos también pueden ser resultado de procesos sociales, ya que los algoritmos de los motores de búsqueda suelen estar diseñados para excluir puntos de vista no normativos en favor de resultados más "populares". [52] Los algoritmos de indexación de los principales motores de búsqueda se inclinan hacia la cobertura de sitios con sede en Estados Unidos, en lugar de sitios web de países no estadounidenses. [49]

El Google Bombing es un ejemplo de un intento de manipular los resultados de búsqueda por razones políticas, sociales o comerciales.

Varios investigadores han estudiado los cambios culturales provocados por los motores de búsqueda, [53] y la representación de ciertos temas controvertidos en sus resultados, como el terrorismo en Irlanda , [54] la negación del cambio climático , [55] y las teorías de la conspiración . [56]

Se ha expresado la preocupación de que los motores de búsqueda como Google y Bing proporcionen resultados personalizados en función del historial de actividad del usuario, lo que lleva a lo que Eli Pariser denominó cámaras de eco o burbujas de filtro en 2011. [57] El argumento es que los motores de búsqueda y las plataformas de redes sociales utilizan algoritmos para adivinar selectivamente qué información le gustaría ver a un usuario, basándose en información sobre el usuario (como la ubicación, el comportamiento de clic anterior y el historial de búsqueda). Como resultado, los sitios web tienden a mostrar solo información que concuerda con el punto de vista anterior del usuario. Según Eli Pariser, los usuarios tienen menos exposición a puntos de vista conflictivos y están aislados intelectualmente en su propia burbuja informativa. Desde que se identificó este problema, han surgido motores de búsqueda competitivos que buscan evitarlo al no rastrear o "burbujear" a los usuarios, como DuckDuckGo . Sin embargo, muchos académicos han cuestionado el punto de vista de Pariser, encontrando que hay poca evidencia de la burbuja de filtro. [58] [59] [60] Por el contrario, una serie de estudios que intentan verificar la existencia de burbujas de filtros han encontrado solo niveles menores de personalización en la búsqueda, [60] que la mayoría de las personas encuentran una variedad de puntos de vista cuando navegan en línea y que Google News tiende a promover los principales medios de comunicación establecidos. [61] [59]

El crecimiento global de Internet y los medios electrónicos en el mundo árabe y musulmán durante la última década ha animado a los seguidores islámicos en Oriente Medio y el subcontinente asiático a probar sus propios motores de búsqueda, sus propios portales de búsqueda filtrados que permitirían a los usuarios realizar búsquedas seguras . Más que los filtros de búsqueda seguros habituales , estos portales web islámicos clasifican los sitios web en " halal " o " haram ", según la interpretación de la ley Sharia . ImHalal se puso en línea en septiembre de 2011. Halalgoogling se puso en línea en julio de 2013. Estos utilizan filtros haram en las colecciones de Google y Bing (y otros). [62]

Mientras que la falta de inversión y el ritmo lento de las tecnologías en el mundo musulmán han obstaculizado el progreso y frustrado el éxito de un motor de búsqueda islámico, cuyo principal consumidor son los seguidores del Islam, proyectos como Muxlim (un sitio de estilo de vida musulmán) recibieron millones de dólares de inversores como Rite Internet Ventures, y también fracasaron. Otros motores de búsqueda orientados a la religión son Jewogle, la versión judía de Google, [63] y el motor de búsqueda cristiano SeekFind.org. SeekFind filtra los sitios que atacan o degradan su fe. [64]

El envío a un motor de búsqueda web es un proceso en el que un webmaster envía un sitio web directamente a un motor de búsqueda. Si bien el envío a un motor de búsqueda a veces se presenta como una forma de promocionar un sitio web, generalmente no es necesario porque los principales motores de búsqueda utilizan rastreadores web que eventualmente encontrarán la mayoría de los sitios web en Internet sin ayuda. Pueden enviar una página web a la vez o pueden enviar el sitio completo utilizando un mapa del sitio , pero normalmente solo es necesario enviar la página de inicio de un sitio web, ya que los motores de búsqueda pueden rastrear un sitio web bien diseñado. Hay dos razones restantes para enviar un sitio web o una página web a un motor de búsqueda: agregar un sitio web completamente nuevo sin esperar a que un motor de búsqueda lo descubra y tener el registro de un sitio web actualizado después de un rediseño sustancial.

Algunos programas de envío a motores de búsqueda no solo envían sitios web a varios motores de búsqueda, sino que también agregan enlaces a sitios web desde sus propias páginas. Esto podría resultar útil para aumentar la clasificación de un sitio web , porque los enlaces externos son uno de los factores más importantes que determinan la clasificación de un sitio web. Sin embargo, John Mueller de Google ha declarado que esto "puede generar una enorme cantidad de enlaces no naturales para su sitio" con un impacto negativo en la clasificación del sitio. [65]

En comparación con los motores de búsqueda, un sistema de marcadores sociales tiene varias ventajas sobre el software tradicional de clasificación y localización automatizada de recursos, como las arañas de los motores de búsqueda . Toda la clasificación basada en etiquetas de los recursos de Internet (como los sitios web) la realizan seres humanos, que entienden el contenido del recurso, a diferencia del software, que intenta determinar algorítmicamente el significado y la calidad de un recurso. Además, las personas pueden encontrar y marcar páginas web que aún no han sido detectadas o indexadas por las arañas web. [66] Además, un sistema de marcadores sociales puede clasificar un recurso en función de la cantidad de veces que los usuarios lo han marcado, lo que puede ser una métrica más útil para los usuarios finales que los sistemas que clasifican los recursos en función de la cantidad de enlaces externos que apuntan a él. Sin embargo, ambos tipos de clasificación son vulnerables al fraude (consulte Cómo engañar al sistema ) y ambos necesitan contramedidas técnicas para tratar de lidiar con esto.

El primer motor de búsqueda web fue Archie , creado en 1990 [67] por Alan Emtage , un estudiante de la Universidad McGill en Montreal. El autor originalmente quería llamar al programa "archivos", pero tuvo que acortarlo para cumplir con el estándar mundial Unix de asignar a los programas y archivos nombres cortos y crípticos como grep, cat, troff, sed, awk, perl, etc.

El método principal para almacenar y recuperar archivos era a través del Protocolo de Transferencia de Archivos (FTP). Este era (y sigue siendo) un sistema que especificaba una forma común para que las computadoras intercambiaran archivos a través de Internet. Funciona de la siguiente manera: un administrador decide que desea que los archivos estén disponibles desde su computadora. Configura un programa en su computadora, llamado servidor FTP. Cuando alguien en Internet desea recuperar un archivo de esta computadora, se conecta a ella a través de otro programa llamado cliente FTP. Cualquier programa cliente FTP puede conectarse con cualquier programa servidor FTP siempre que tanto el programa cliente como el servidor cumplan completamente con las especificaciones establecidas en el protocolo FTP.

En un principio, cualquiera que quisiera compartir un archivo tenía que configurar un servidor FTP para que el archivo estuviera disponible para otros. Más tarde, los sitios FTP "anónimos" se convirtieron en repositorios de archivos, lo que permitía a todos los usuarios publicarlos y recuperarlos.

Incluso con los sitios de archivo, muchos archivos importantes seguían estando dispersos en pequeños servidores FTP. Estos archivos sólo se podían encontrar mediante el equivalente en Internet del boca a boca: alguien publicaba un correo electrónico en una lista de mensajes o en un foro de discusión anunciando la disponibilidad de un archivo.

Archie cambió todo eso. Combinó un recopilador de datos basado en scripts, que obtenía listados de sitios de archivos FTP anónimos, con un comparador de expresiones regulares para recuperar nombres de archivos que coincidían con una consulta del usuario. (4) En otras palabras, el recopilador de Archie rastreaba sitios FTP en Internet e indexaba todos los archivos que encontraba. Su comparador de expresiones regulares proporcionaba a los usuarios acceso a su base de datos. [68]

En 1993, el grupo de Servicios de Sistemas Informáticos de la Universidad de Nevada desarrolló Veronica . [67] Fue creado como un tipo de dispositivo de búsqueda similar a Archie pero para archivos Gopher. Otro servicio de búsqueda Gopher, llamado Jughead, apareció un poco más tarde, probablemente con el único propósito de completar el triunvirato de tiras cómicas. Jughead es un acrónimo de Jonzy's Universal Gopher Hierarchy Excavation and Display, aunque, al igual que Veronica, es probablemente seguro asumir que el creador se basó en el acrónimo. La funcionalidad de Jughead era bastante idéntica a la de Veronica, aunque parece ser un poco más tosca. [68]

El World Wide Web Wanderer , desarrollado por Matthew Gray en 1993 [69] , fue el primer robot de la Web y fue diseñado para rastrear el crecimiento de la Web. Inicialmente, el Wanderer solo contaba servidores web, pero poco después de su introducción, comenzó a capturar URL a medida que avanzaba. La base de datos de URL capturadas se convirtió en Wandex, la primera base de datos web.

Wanderer, de Matthew Gray, generó una gran controversia en su momento, en parte porque las primeras versiones del software se extendieron por la red y causaron una notable degradación del rendimiento en toda la red. Esta degradación se produjo porque Wanderer accedía a la misma página cientos de veces al día. Wanderer pronto modificó sus métodos, pero la controversia sobre si los robots eran buenos o malos para Internet persistió.

En respuesta al Wanderer, Martijn Koster creó Archie-Like Indexing of the Web, o ALIWEB, en octubre de 1993. Como su nombre lo indica, ALIWEB era el equivalente HTTP de Archie y, por eso, sigue siendo único en muchos sentidos.

ALIWEB no tiene un robot de búsqueda web. En su lugar, los webmasters de los sitios participantes publican su propia información de índice para cada página que desean que aparezca en la lista. La ventaja de este método es que los usuarios pueden describir su propio sitio y un robot no tiene que andar por ahí consumiendo ancho de banda de la red. Las desventajas de ALIWEB son más problemáticas hoy en día. La principal desventaja es que se debe enviar un archivo de indexación especial. La mayoría de los usuarios no entienden cómo crear un archivo de este tipo y, por lo tanto, no envían sus páginas. Esto da lugar a una base de datos relativamente pequeña, lo que significa que los usuarios tienen menos probabilidades de buscar en ALIWEB que en uno de los grandes sitios basados en bots. Este dilema se ha compensado en cierta medida con la incorporación de otras bases de datos a la búsqueda de ALIWEB, pero aún no tiene el atractivo masivo de los motores de búsqueda como Yahoo! o Lycos. [68]

Excite , inicialmente llamado Architext, fue creado por seis estudiantes de Stanford en febrero de 1993. Su idea era utilizar el análisis estadístico de las relaciones entre palabras para proporcionar búsquedas más eficientes a través de la gran cantidad de información que hay en Internet. Su proyecto fue financiado en su totalidad a mediados de 1993. Una vez que se consiguió la financiación, lanzaron una versión de su software de búsqueda para que los webmasters lo utilizaran en sus propios sitios web. En ese momento, el software se llamaba Architext, pero ahora se conoce con el nombre de Excite for Web Servers. [68]

Excite fue el primer motor de búsqueda comercial serio que se lanzó en 1995. [70] Fue desarrollado en Stanford y fue adquirido por 6.500 millones de dólares por @Home. En 2001, Excite y @Home se declararon en quiebra e InfoSpace compró Excite por 10 millones de dólares.

Algunos de los primeros análisis de búsquedas web se realizaron en registros de búsqueda de Excite [71] [72]

En abril de 1994, dos candidatos a doctorado de la Universidad de Stanford, David Filo y Jerry Yang , crearon algunas páginas que se hicieron bastante populares. Llamaron a la colección de páginas Yahoo! Su explicación oficial para la elección del nombre fue que se consideraban un par de yahoos.

A medida que el número de enlaces aumentó y sus páginas comenzaron a recibir miles de visitas al día, el equipo creó formas de organizar mejor los datos. Para facilitar la recuperación de datos, Yahoo! (www.yahoo.com) se convirtió en un directorio con capacidad de búsqueda. La función de búsqueda era un simple motor de búsqueda de bases de datos. Debido a que las entradas de Yahoo! se ingresaban y categorizaban manualmente, Yahoo! no se clasificaba realmente como un motor de búsqueda. En cambio, generalmente se consideraba un directorio con capacidad de búsqueda. Desde entonces, Yahoo! ha automatizado algunos aspectos del proceso de recopilación y clasificación, desdibujando la distinción entre motor y directorio.

Wanderer sólo capturó URL, lo que dificultó la búsqueda de elementos que no estuvieran explícitamente descritos en su URL. Como las URL son bastante crípticas, esto no ayudó al usuario promedio. La búsqueda en Yahoo! o Galaxy fue mucho más efectiva porque contenían información descriptiva adicional sobre los sitios indexados.

En la Universidad Carnegie Mellon, durante julio de 1994, Michael Mauldin, en licencia de la CMU, desarrolló el motor de búsqueda Lycos .

Los motores de búsqueda de la Web son sitios web enriquecidos con la posibilidad de buscar el contenido almacenado en otros sitios. Existen diferencias en la forma en que funcionan los distintos motores de búsqueda, pero todos realizan tres tareas básicas. [73]

El proceso comienza cuando un usuario ingresa una declaración de consulta en el sistema a través de la interfaz proporcionada.

Básicamente, existen tres tipos de motores de búsqueda: aquellos que funcionan con robots (llamados crawlers , hormigas o arañas), aquellos que funcionan con envíos humanos y aquellos que son un híbrido de los dos.

Los motores de búsqueda basados en rastreadores son aquellos que utilizan agentes de software automatizados (llamados rastreadores) que visitan un sitio web, leen la información del sitio en sí, leen las metaetiquetas del sitio y también siguen los enlaces a los que se conecta el sitio, realizando también la indexación de todos los sitios web vinculados. El rastreador devuelve toda esa información a un depósito central, donde se indexan los datos. El rastreador volverá periódicamente a los sitios para comprobar si hay alguna información que haya cambiado. La frecuencia con la que esto sucede la determinan los administradores del motor de búsqueda.

Los motores de búsqueda controlados por humanos dependen de que los humanos envíen información que luego se indexa y cataloga. Solo la información enviada se incluye en el índice.

En ambos casos, cuando se realiza una consulta a un motor de búsqueda para localizar información, en realidad se está buscando en el índice que el motor de búsqueda ha creado, no en la Web. Estos índices son bases de datos gigantes de información que se recopilan, almacenan y, posteriormente, se buscan. Esto explica por qué, a veces, una búsqueda en un motor de búsqueda comercial, como Yahoo! o Google, devolverá resultados que, de hecho, son enlaces inactivos. Dado que los resultados de la búsqueda se basan en el índice, si este no se ha actualizado desde que una página Web dejó de ser válida, el motor de búsqueda trata la página como si todavía fuera un enlace activo, aunque ya no lo sea. Seguirá siendo así hasta que se actualice el índice.

Entonces, ¿por qué la misma búsqueda en distintos motores de búsqueda produce resultados diferentes? Parte de la respuesta a esa pregunta es que no todos los índices van a ser exactamente iguales. Depende de lo que encuentren las arañas o de lo que envíen los humanos. Pero lo que es más importante, no todos los motores de búsqueda utilizan el mismo algoritmo para buscar en los índices. El algoritmo es lo que utilizan los motores de búsqueda para determinar la relevancia de la información del índice con respecto a lo que el usuario está buscando.

Uno de los elementos que analiza el algoritmo de un motor de búsqueda es la frecuencia y la ubicación de las palabras clave en una página web. Las que tienen una frecuencia más alta suelen considerarse más relevantes. Pero la tecnología de los motores de búsqueda se está volviendo cada vez más sofisticada en su intento de desalentar lo que se conoce como relleno de palabras clave o spamdexing.

Otro elemento común que los algoritmos analizan es la forma en que las páginas se vinculan a otras páginas de la Web. Al analizar cómo se vinculan las páginas entre sí, un motor puede determinar de qué trata una página (si las palabras clave de las páginas vinculadas son similares a las palabras clave de la página original) y si esa página se considera "importante" y merece una mejora en el ranking. Así como la tecnología se está volviendo cada vez más sofisticada para ignorar el relleno de palabras clave, también se está volviendo más astuto para los webmasters que crean enlaces artificiales en sus sitios para construir un ranking artificial.

Los motores de búsqueda web modernos son sistemas de software muy complejos que emplean tecnología que ha evolucionado a lo largo de los años. Hay varias subcategorías de software de motores de búsqueda que se aplican por separado a necesidades de "navegación" específicas. Entre ellas se incluyen los motores de búsqueda web (por ejemplo, Google ), los motores de búsqueda de bases de datos o datos estructurados (por ejemplo, Dieselpoint ) y los motores de búsqueda mixtos o de búsqueda empresarial. Los motores de búsqueda más habituales, como Google y Yahoo !, utilizan cientos de miles de ordenadores para procesar billones de páginas web con el fin de devolver resultados bastante precisos. Debido a este alto volumen de consultas y procesamiento de texto, se requiere que el software se ejecute en un entorno muy disperso con un alto grado de superfluidad.

Otra categoría de motores de búsqueda son los motores de búsqueda científicos. Se trata de motores de búsqueda que buscan literatura científica. El ejemplo más conocido es Google Scholar. Los investigadores están trabajando para mejorar la tecnología de los motores de búsqueda haciéndoles comprender el elemento de contenido de los artículos, como por ejemplo, extrayendo construcciones teóricas o hallazgos clave de la investigación. [74]

{{cite web}}: Falta o está vacío |title=( ayuda )