Un sensor de imagen o generador de imágenes es un sensor que detecta y transmite información utilizada para formar una imagen . Lo hace convirtiendo la atenuación variable de las ondas de luz (a medida que atraviesan o se reflejan en los objetos) en señales , pequeñas ráfagas de corriente que transmiten la información. Las ondas pueden ser luz u otra radiación electromagnética . Los sensores de imagen se utilizan en dispositivos electrónicos de imágenes tanto de tipo analógico como digital , que incluyen cámaras digitales , módulos de cámara , teléfonos con cámara , dispositivos de mouse óptico , [1] [2] [3] equipos de imágenes médicas , equipos de visión nocturna como imágenes térmicas. Dispositivos, radares , sonares y otros. A medida que la tecnología cambia , las imágenes electrónicas y digitales tienden a reemplazar las imágenes químicas y analógicas.

Los dos tipos principales de sensores de imagen electrónicos son el dispositivo de carga acoplada (CCD) y el sensor de píxeles activos ( sensor CMOS ). Tanto los sensores CCD como CMOS se basan en tecnología de semiconductores de óxido metálico (MOS), los CCD se basan en condensadores MOS y los sensores CMOS se basan en amplificadores MOSFET (transistor de efecto de campo MOS) . Los sensores analógicos de radiación invisible tienden a utilizar tubos de vacío de diversos tipos, mientras que los sensores digitales incluyen detectores de panel plano .

Los dos tipos principales de sensores de imagen digital son el dispositivo de carga acoplada (CCD) y el sensor de píxeles activos (sensor CMOS), fabricados en tecnologías MOS complementarias (CMOS) o MOS tipo N ( NMOS o Live MOS ). Tanto los sensores CCD como CMOS se basan en la tecnología MOS , [4] siendo los condensadores MOS los componentes básicos de un CCD, [5] y los amplificadores MOSFET los componentes básicos de un sensor CMOS. [6] [7]

Las cámaras integradas en productos de consumo pequeños generalmente utilizan sensores CMOS, que suelen ser más baratos y tienen un menor consumo de energía en dispositivos que funcionan con baterías que los CCD. [8] Los sensores CCD se utilizan para cámaras de video de alta calidad para transmisiones, y los sensores CMOS dominan en fotografía fija y bienes de consumo, donde el costo general es una preocupación importante. Ambos tipos de sensores cumplen la misma tarea de capturar la luz y convertirla en señales eléctricas.

Cada celda de un sensor de imagen CCD es un dispositivo analógico. Cuando la luz incide en el chip, se mantiene como una pequeña carga eléctrica en cada fotosensor . Las cargas en la línea de píxeles más cercana a (uno o más) amplificadores de salida se amplifican y emiten, luego cada línea de píxeles desplaza sus cargas una línea más cerca de los amplificadores, llenando la línea vacía más cercana a los amplificadores. Luego, este proceso se repite hasta que se haya amplificado y emitido la carga de todas las líneas de píxeles. [9]

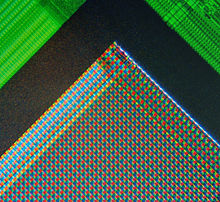

Un sensor de imagen CMOS tiene un amplificador para cada píxel en comparación con los pocos amplificadores de un CCD. Esto da como resultado un área menor para la captura de fotones que un CCD, pero este problema se ha superado mediante el uso de microlentes delante de cada fotodiodo, que enfocan la luz en el fotodiodo que, de otro modo, habría impactado en el amplificador y no habría sido detectada. [9] Algunos sensores de imágenes CMOS también utilizan iluminación trasera para aumentar la cantidad de fotones que golpean el fotodiodo. [10] Los sensores CMOS pueden implementarse potencialmente con menos componentes, utilizar menos energía y/o proporcionar una lectura más rápida que los sensores CCD. [11] También son menos vulnerables a las descargas de electricidad estática.

Otro diseño, una arquitectura híbrida CCD/CMOS (vendida con el nombre " sCMOS ") consta de circuitos integrados de lectura CMOS (ROIC) unidos a un sustrato de imágenes CCD, una tecnología que se desarrolló para matrices de observación infrarroja y se ha adaptado. a la tecnología de detección basada en silicio. [12] Otro enfoque es utilizar las dimensiones muy finas disponibles en la tecnología CMOS moderna para implementar una estructura similar a un CCD completamente en tecnología CMOS: tales estructuras se pueden lograr separando las puertas individuales de polisilicio por un espacio muy pequeño; Aunque sigue siendo un producto de la investigación, los sensores híbridos pueden aprovechar potencialmente los beneficios de los generadores de imágenes CCD y CMOS. [13]

Hay muchos parámetros que se pueden utilizar para evaluar el rendimiento de un sensor de imagen, incluido el rango dinámico , la relación señal-ruido y la sensibilidad con poca luz. Para sensores de tipos comparables, la relación señal-ruido y el rango dinámico mejoran a medida que aumenta el tamaño . Esto se debe a que en un tiempo de integración (exposición) determinado, más fotones golpean el píxel con un área mayor.

El tiempo de exposición de los sensores de imagen generalmente se controla mediante un obturador mecánico convencional , como en las cámaras de película, o mediante un obturador electrónico . El obturador electrónico puede ser "global", en cuyo caso la acumulación de fotoelectrones en toda el área del sensor de imagen comienza y se detiene simultáneamente, o "en movimiento", en cuyo caso el intervalo de exposición de cada fila precede inmediatamente a la lectura de esa fila, en un proceso que "en movimiento" a lo largo del marco de la imagen (normalmente de arriba a abajo en formato horizontal). El obturador electrónico global es menos común, ya que requiere circuitos de "almacenamiento" para mantener la carga desde el final del intervalo de exposición hasta que llega el proceso de lectura, generalmente unos milisegundos más tarde. [14]

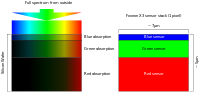

Existen varios tipos principales de sensores de imagen en color, que se diferencian por el tipo de mecanismo de separación de colores:

Los sensores especiales se utilizan en diversas aplicaciones como termografía , creación de imágenes multiespectrales , videolaringoscopios , cámaras gamma , conjuntos de sensores para rayos X y otros conjuntos de alta sensibilidad para astronomía . [20]

Si bien, en general, las cámaras digitales utilizan un sensor plano, Sony creó un prototipo de un sensor curvo en 2014 para reducir/eliminar la curvatura del campo Petzval que se produce con un sensor plano. El uso de un sensor curvo permite un diámetro cada vez más pequeño de la lente con elementos y componentes reducidos con mayor apertura y reducción de la caída de luz en el borde de la foto. [21]

Los primeros sensores analógicos para luz visible eran tubos de cámaras de vídeo . Se remontan a la década de 1930 y hasta la década de 1980 se desarrollaron varios tipos. A principios de la década de 1990, habían sido reemplazados por modernos sensores de imagen CCD de estado sólido . [22]

La base de los sensores de imagen de estado sólido modernos es la tecnología MOS, [23] [24] que se origina a partir de la invención del MOSFET por Mohamed M. Atalla y Dawon Kahng en Bell Labs en 1959. [25] Investigaciones posteriores sobre la tecnología MOS condujeron hasta el desarrollo de sensores de imagen semiconductores de estado sólido , incluido el dispositivo de carga acoplada (CCD) y, más tarde, el sensor de píxeles activos ( sensor CMOS ). [23] [24]

El sensor de píxeles pasivos (PPS) fue el precursor del sensor de píxeles activos (APS). [7] Un PPS consta de píxeles pasivos que se leen sin amplificación , y cada píxel consta de un fotodiodo y un interruptor MOSFET . [26] Es un tipo de matriz de fotodiodos , con píxeles que contienen una unión pn , un condensador integrado y MOSFET como transistores de selección . G. Weckler propuso una matriz de fotodiodos en 1968. [6] Esta fue la base del PPS. [7] Estos primeros conjuntos de fotodiodos eran complejos y poco prácticos, y requerían la fabricación de transistores de selección dentro de cada píxel, junto con circuitos multiplexores en el chip . El ruido de los conjuntos de fotodiodos también fue una limitación para el rendimiento, ya que la capacitancia del bus de lectura de fotodiodos resultó en un mayor nivel de ruido. El muestreo doble correlacionado (CDS) tampoco se podría utilizar con una matriz de fotodiodos sin memoria externa . [6] Sin embargo, en 1914 el Cónsul General Adjunto Carl R. Loop, informó al Departamento de Estado en un Informe Consular sobre el sistema Televista de Archibald M. Low que "Se afirma que el selenio en la pantalla transmisora puede ser reemplazado por cualquier material diamagnético". ". [27]

En junio de 2022, Samsung Electronics anunció que había creado un sensor de imagen de 200 millones de píxeles. El ISOCELL HP3 de 200MP tiene píxeles de 0,56 micrómetros y Samsung informó que los sensores anteriores tenían píxeles de 0,64 micrómetros, una disminución del 12% desde 2019. El nuevo sensor contiene 200 millones de píxeles en una lente de 1 por 1,4 pulgadas (25 por 36 mm). [28]

El dispositivo de carga acoplada (CCD) fue inventado por Willard S. Boyle y George E. Smith en los Laboratorios Bell en 1969. [29] Mientras investigaban la tecnología MOS, se dieron cuenta de que una carga eléctrica era la analogía de la burbuja magnética y que podría almacenarse en un pequeño condensador MOS . Como era bastante sencillo fabricar una serie de condensadores MOS seguidos, les conectaron un voltaje adecuado para que la carga pudiera pasar de uno al siguiente. [23] El CCD es un circuito semiconductor que posteriormente se utilizó en las primeras cámaras de vídeo digitales para retransmisiones televisivas . [30]

Los primeros sensores CCD sufrían un retraso del obturador . Esto se resolvió en gran medida con la invención del fotodiodo fijo (PPD). [7] Fue inventado por Nobukazu Teranishi , Hiromitsu Shiraki y Yasuo Ishihara en NEC en 1980. [7] [31] Era una estructura de fotodetector con bajo retraso, bajo ruido , alta eficiencia cuántica y baja corriente oscura . [7] En 1987, el PPD comenzó a incorporarse en la mayoría de los dispositivos CCD, convirtiéndose en un elemento fijo en las cámaras de vídeo electrónicas de consumo y luego en las cámaras fotográficas digitales . Desde entonces, el PPD se ha utilizado en casi todos los sensores CCD y luego en los sensores CMOS. [7]

El sensor de píxeles activos (APS) NMOS fue inventado por Olympus en Japón a mediados de la década de 1980. Esto fue posible gracias a los avances en la fabricación de dispositivos semiconductores MOS , en los que el escalado de MOSFET alcanzó niveles de micras más pequeñas y luego submicrónicas . [6] [32] El primer NMOS APS fue fabricado por el equipo de Tsutomu Nakamura en Olympus en 1985. [33] El sensor de píxeles activos CMOS (sensor CMOS) fue posteriormente mejorado por un grupo de científicos del Laboratorio de Propulsión a Chorro de la NASA en 1993. [7] En 2007, las ventas de sensores CMOS habían superado a las de sensores CCD . [34] En la década de 2010, los sensores CMOS desplazaron en gran medida a los sensores CCD en todas las nuevas aplicaciones.

La primera cámara digital comercial , la Cromemco Cyclops en 1975, utilizó un sensor de imagen MOS de 32×32. Era un chip de memoria RAM dinámica ( DRAM ) MOS modificado . [35]

Los sensores de imagen MOS se utilizan ampliamente en la tecnología de ratones ópticos . El primer ratón óptico, inventado por Richard F. Lyon en Xerox en 1980, utilizaba un chip sensor de circuito integrado NMOS de 5 μm . [2] [1] Desde el primer ratón óptico comercial, el IntelliMouse introducido en 1999, la mayoría de los dispositivos de ratón óptico utilizan sensores CMOS. [36]

En febrero de 2018, investigadores del Dartmouth College anunciaron una nueva tecnología de detección de imágenes que los investigadores llaman QIS, por Quanta Image Sensor. En lugar de píxeles, los chips QIS tienen lo que los investigadores llaman "jotas". Cada jota puede detectar una única partícula de luz, llamada fotón . [37]

La Cyclops fue la primera cámara digital.