El aprendizaje por refuerzo ( RL ) es un área interdisciplinaria de aprendizaje automático y control óptimo que se ocupa de cómo un agente inteligente debe tomar acciones en un entorno dinámico para maximizar la recompensa acumulativa . El aprendizaje por refuerzo es uno de los tres paradigmas básicos del aprendizaje automático , junto con el aprendizaje supervisado y el aprendizaje no supervisado .

El aprendizaje por refuerzo se diferencia del aprendizaje supervisado en que no necesita que se presenten pares de entrada/salida etiquetados y en que no necesita que se corrijan explícitamente acciones subóptimas. En cambio, la atención se centra en encontrar un equilibrio entre la exploración (de territorio inexplorado) y la explotación (del conocimiento actual) con el objetivo de maximizar la recompensa a largo plazo, cuya retroalimentación podría ser incompleta o retrasada. [1]

El entorno suele expresarse en forma de proceso de decisión de Markov (MDP), porque muchos algoritmos de aprendizaje por refuerzo para este contexto utilizan técnicas de programación dinámica . [2] La principal diferencia entre los métodos clásicos de programación dinámica y los algoritmos de aprendizaje por refuerzo es que estos últimos no asumen el conocimiento de un modelo matemático exacto del proceso de decisión de Markov y se dirigen a grandes procesos de decisión de Markov donde los métodos exactos se vuelven inviables. [3]

Debido a su generalidad, el aprendizaje por refuerzo se estudia en muchas disciplinas, como la teoría de juegos , la teoría del control , la investigación de operaciones , la teoría de la información , la optimización basada en simulación , los sistemas multiagente , la inteligencia de enjambre y la estadística . En la literatura de control e investigación de operaciones, el aprendizaje por refuerzo se denomina programación dinámica aproximada o programación neurodinámica. Los problemas de interés en el aprendizaje por refuerzo también se han estudiado en la teoría del control óptimo , que se ocupa principalmente de la existencia y caracterización de soluciones óptimas y algoritmos para su cálculo exacto, y menos del aprendizaje o la aproximación, particularmente en ausencia de un modelo matemático del medio ambiente.

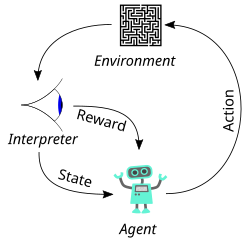

El aprendizaje por refuerzo básico se modela como un proceso de decisión de Markov :

El propósito del aprendizaje por refuerzo es que el agente aprenda una política óptima, o casi óptima, que maximice la "función de recompensa" u otra señal de refuerzo proporcionada por el usuario que se acumule a partir de las recompensas inmediatas. Esto es similar a procesos que parecen ocurrir en la psicología animal. Por ejemplo, los cerebros biológicos están programados para interpretar señales como el dolor y el hambre como refuerzos negativos, e interpretar el placer y la ingesta de alimentos como refuerzos positivos. En algunas circunstancias, los animales pueden aprender a adoptar comportamientos que optimicen estas recompensas. Esto sugiere que los animales son capaces de aprender por refuerzo. [4] [5]

Un agente básico de aprendizaje por refuerzo, la IA, interactúa con su entorno en pasos de tiempo discretos. En cada momento t , el agente recibe el estado actual y la recompensa . Luego elige una acción del conjunto de acciones disponibles, que posteriormente se envía al entorno. El entorno pasa a un nuevo estado y se determina la recompensa asociada con la transición . El objetivo de un agente de aprendizaje por refuerzo es aprender una política que maximice la recompensa acumulativa esperada.

Formular el problema como un proceso de decisión de Markov supone que el agente observa directamente el estado ambiental actual; en este caso se dice que el problema tiene total observabilidad . Si el agente sólo tiene acceso a un subconjunto de estados, o si los estados observados están corrompidos por el ruido, se dice que el agente tiene observabilidad parcial y formalmente el problema debe formularse como un proceso de decisión de Markov parcialmente observable . En ambos casos, se puede restringir el conjunto de acciones disponibles para el agente. Por ejemplo, el estado del saldo de una cuenta podría restringirse para que sea positivo; si el valor actual del estado es 3 y la transición de estado intenta reducir el valor en 4, no se permitirá la transición.

Cuando se compara el desempeño del agente con el de un agente que actúa de manera óptima, la diferencia en el desempeño da lugar a la noción de arrepentimiento . Para actuar de manera casi óptima, el agente debe razonar sobre las consecuencias a largo plazo de sus acciones (es decir, maximizar los ingresos futuros), aunque la recompensa inmediata asociada con esto podría ser negativa.

Por lo tanto, el aprendizaje por refuerzo es particularmente adecuado para problemas que incluyen una compensación de recompensa a largo plazo versus a corto plazo. Se ha aplicado con éxito a diversos problemas, incluida la operación de almacenamiento de energía, [6] control de robots, [7] despacho de generadores fotovoltaicos, [8] backgammon , damas , [9] Go ( AlphaGo ) y sistemas de conducción autónoma. [10]

Dos elementos hacen que el aprendizaje por refuerzo sea poderoso: el uso de muestras para optimizar el rendimiento y el uso de la aproximación de funciones para lidiar con entornos grandes. Gracias a estos dos componentes clave, el aprendizaje por refuerzo se puede utilizar en entornos grandes en las siguientes situaciones:

Los dos primeros de estos problemas podrían considerarse problemas de planificación (dado que existe algún tipo de modelo disponible), mientras que el último podría considerarse un problema genuino de aprendizaje. Sin embargo, el aprendizaje por refuerzo convierte ambos problemas de planificación en problemas de aprendizaje automático .

El equilibrio entre exploración y explotación se ha estudiado más a fondo a través del problema de los bandidos multiarmados y para los procesos de decisión de Markov en espacios de estados finitos en Burnetas y Katehakis (1997). [12]

El aprendizaje por refuerzo requiere mecanismos de exploración inteligentes; La selección aleatoria de acciones, sin referencia a una distribución de probabilidad estimada, muestra un desempeño deficiente. El caso de los (pequeños) procesos de decisión de Markov finitos se comprende relativamente bien. Sin embargo, debido a la falta de algoritmos que se adapten bien al número de estados (o que se adapten a problemas con espacios de estados infinitos), los métodos de exploración simples son los más prácticos.

Uno de esos métodos es -greedy, donde es un parámetro que controla la cantidad de exploración versus explotación. Con probabilidad , se elige la explotación y el agente elige la acción que cree que tiene el mejor efecto a largo plazo (los vínculos entre acciones se rompen uniformemente al azar). Alternativamente, con probabilidad , se elige la exploración y la acción se elige uniformemente al azar. Suele ser un parámetro fijo, pero se puede ajustar según un cronograma (haciendo que el agente explore cada vez menos) o de forma adaptativa según una heurística. [13]

Incluso si se ignora la cuestión de la exploración e incluso si el estado fuera observable (se asumirá de aquí en adelante), el problema sigue siendo utilizar la experiencia pasada para descubrir qué acciones conducen a mayores recompensas acumulativas.

La selección de acciones del agente se modela como un mapa llamado política :

El mapa de políticas proporciona la probabilidad de tomar medidas cuando se esté en el estado . [14] : 61 También hay políticas deterministas.

La función de valor de estado se define como el rendimiento descontado esperado que comienza con el estado , es decir , y sigue sucesivamente la política . Por lo tanto, en términos generales, la función de valor estima "qué tan bueno" es estar en un estado determinado. [14] : 60

donde la variable aleatoria denota el rendimiento descontado y se define como la suma de recompensas descontadas futuras:

donde está la recompensa por la transición de un estado a otro , es la tasa de descuento . es menor que 1, por lo que las recompensas en el futuro lejano tienen menos peso que las recompensas en el futuro inmediato.

El algoritmo debe encontrar una póliza con el máximo rendimiento descontado esperado. De la teoría de los procesos de decisión de Markov se sabe que, sin pérdida de generalidad, la búsqueda puede restringirse al conjunto de las llamadas políticas estacionarias . Una política es estacionaria si la distribución de acciones que devuelve depende únicamente del último estado visitado (del historial del agente de observación). La búsqueda puede restringirse aún más a políticas estacionarias deterministas . Una política estacionaria determinista selecciona de manera determinista acciones basadas en el estado actual. Dado que cualquier política de este tipo puede identificarse con un mapeo del conjunto de estados al conjunto de acciones, estas políticas pueden identificarse con dichos mapeos sin pérdida de generalidad.

El enfoque de fuerza bruta implica dos pasos:

Un problema con esto es que la cantidad de políticas puede ser grande o incluso infinita. Otra es que la varianza de los rendimientos puede ser grande, lo que requiere muchas muestras para estimar con precisión el rendimiento descontado de cada póliza.

Estos problemas pueden mejorarse si asumimos alguna estructura y permitimos que las muestras generadas a partir de una política influyan en las estimaciones realizadas para otras. Los dos enfoques principales para lograr esto son la estimación de la función de valor y la búsqueda directa de políticas.

Los enfoques de función de valor intentan encontrar una política que maximice el rendimiento descontado manteniendo un conjunto de estimaciones de los rendimientos descontados esperados para alguna política (generalmente la "actual" [dentro de la política] o la óptima [fuera de la política]).

Estos métodos se basan en la teoría de los procesos de decisión de Markov, donde la optimización se define en un sentido más fuerte que el anterior: una política es óptima si logra el mejor rendimiento descontado esperado desde cualquier estado inicial (es decir, las distribuciones iniciales no desempeñan ningún papel en la decisión). esta definición). Una vez más, siempre se puede encontrar una política óptima entre las políticas estacionarias.

Para definir la optimización de manera formal, defina el valor estatal de una política mediante

donde representa el rendimiento descontado asociado con el seguimiento desde el estado inicial . Definiendo como el máximo valor de estado posible de , donde se permite cambiar,

Una política que logra estos valores estatales óptimos en cada estado se llama óptima . Claramente, una política que es óptima en este sentido fuerte también lo es en el sentido de que maximiza el rendimiento descontado esperado , ya que , donde es un estado muestreado aleatoriamente de la distribución de estados iniciales (so ).

Aunque los valores de estado son suficientes para definir la optimización, es útil definir valores de acción. Dado un estado , una acción y una política , el valor de acción del par siguiente se define por

donde ahora representa el rendimiento con descuento aleatorio asociado con la primera acción en el estado y la siguiente a partir de entonces.

La teoría de los procesos de decisión de Markov establece que si es una política óptima, actuamos de manera óptima (tomamos la acción óptima) eligiendo la acción con el valor de acción más alto en cada estado . La función de valor de acción de dicha política óptima ( ) se denomina función de valor de acción óptima y comúnmente se denota por . En resumen, el conocimiento de la función óptima de acción-valor es suficiente por sí solo para saber cómo actuar de manera óptima.

Suponiendo un conocimiento completo del proceso de decisión de Markov, los dos enfoques básicos para calcular la función de valor de acción óptima son la iteración de valores y la iteración de políticas . Ambos algoritmos calculan una secuencia de funciones ( ) que convergen a . Calcular estas funciones implica calcular las expectativas en todo el espacio de estados, lo cual no es práctico para todos los procesos de decisión de Markov excepto para los más pequeños (finitos). En los métodos de aprendizaje por refuerzo, las expectativas se aproximan promediando muestras y utilizando técnicas de aproximación de funciones para hacer frente a la necesidad de representar funciones de valor en grandes espacios de estado-acción.

Los métodos de Monte Carlo se pueden utilizar en un algoritmo que imite la iteración de políticas. La iteración de políticas consta de dos pasos: evaluación de políticas y mejora de políticas .

Monte Carlo se utiliza en el paso de evaluación de políticas. En este paso, dada una política determinista estacionaria , el objetivo es calcular los valores de la función (o una buena aproximación a ellos) para todos los pares estado-acción . Supongamos (para simplificar) que el proceso de decisión de Markov es finito, que hay suficiente memoria disponible para acomodar los valores de acción y que el problema es episódico y que después de cada episodio comienza uno nuevo desde algún estado inicial aleatorio. Luego, la estimación del valor de un determinado par estado-acción se puede calcular promediando los rendimientos muestreados que se originaron a lo largo del tiempo. Con tiempo suficiente, este procedimiento puede construir una estimación precisa de la función de valor de acción . Esto finaliza la descripción del paso de evaluación de políticas.

En el paso de mejora de la política, la siguiente política se obtiene calculando una política codiciosa con respecto a : Dado un estado , esta nueva política devuelve una acción que maximiza . En la práctica, la evaluación perezosa puede diferir el cálculo de las acciones maximizadoras hasta el momento en que sean necesarias.

Los problemas con este procedimiento incluyen:

El primer problema se corrige permitiendo que el procedimiento cambie la política (en algunos o todos los estados) antes de que los valores se estabilicen. Esto también puede ser problemático ya que podría impedir la convergencia. La mayoría de los algoritmos actuales hacen esto, dando lugar a la clase de algoritmos de iteración de políticas generalizadas . Muchos métodos de crítica de actores pertenecen a esta categoría.

El segundo problema puede corregirse permitiendo que las trayectorias contribuyan a cualquier par estado-acción en ellas. Esto también puede ayudar hasta cierto punto con el tercer problema, aunque una mejor solución cuando los rendimientos tienen una alta varianza son los métodos de diferencia temporal (TD) de Sutton que se basan en la ecuación recursiva de Bellman . [15] [16] El cálculo en los métodos TD puede ser incremental (cuando después de cada transición se cambia la memoria y la transición se desecha), o por lotes (cuando las transiciones se agrupan y las estimaciones se calculan una vez en función del lote) . Los métodos por lotes, como el método de diferencia temporal de mínimos cuadrados, [17] pueden utilizar mejor la información de las muestras, mientras que los métodos incrementales son la única opción cuando los métodos por lotes no son factibles debido a su alta complejidad computacional o de memoria. Algunos métodos intentan combinar los dos enfoques. Los métodos basados en diferencias temporales también superan el cuarto problema.

Otro problema específico de TD proviene de su dependencia de la ecuación recursiva de Bellman. La mayoría de los métodos TD tienen un llamado parámetro que puede interpolar continuamente entre los métodos de Monte Carlo que no se basan en las ecuaciones de Bellman y los métodos TD básicos que se basan completamente en las ecuaciones de Bellman. Esto puede resultar eficaz para paliar este problema.

Para abordar el quinto problema, se utilizan métodos de aproximación de funciones . La aproximación de funciones lineales comienza con un mapeo que asigna un vector de dimensión finita a cada par estado-acción. Luego, los valores de acción de un par estado-acción se obtienen combinando linealmente los componentes de con algunos pesos :

Luego, los algoritmos ajustan los pesos, en lugar de ajustar los valores asociados con los pares individuales de estado-acción. Se han explorado métodos basados en ideas de estadísticas no paramétricas (que se puede ver que construyen sus propias características).

La iteración de valores también se puede utilizar como punto de partida, dando lugar al algoritmo Q-learning y sus múltiples variantes. [18] Incluyendo métodos de aprendizaje profundo de Q cuando se utiliza una red neuronal para representar Q, con varias aplicaciones en problemas de búsqueda estocástica. [19]

El problema con el uso de valores de acción es que pueden necesitar estimaciones muy precisas de los valores de acción en competencia que pueden ser difíciles de obtener cuando los rendimientos son ruidosos, aunque este problema se mitiga hasta cierto punto mediante métodos de diferencias temporales. El uso del llamado método de aproximación de funciones compatibles compromete la generalidad y la eficiencia.

Un método alternativo es buscar directamente en (algún subconjunto de) el espacio de políticas, en cuyo caso el problema se convierte en un caso de optimización estocástica . Los dos enfoques disponibles son los métodos basados en gradientes y los métodos sin gradientes.

Los métodos basados en gradiente ( métodos de gradiente de políticas ) comienzan con un mapeo desde un espacio (de parámetros) de dimensión finita al espacio de políticas: dado el vector de parámetros , denotemos la política asociada a . Al definir la función de rendimiento, en condiciones suaves esta función será diferenciable en función del vector de parámetros . Si se conociera el gradiente de , se podría utilizar el ascenso de gradiente . Dado que no se dispone de una expresión analítica para el gradiente, sólo está disponible una estimación ruidosa. Esta estimación se puede construir de muchas maneras, dando lugar a algoritmos como el método REINFORCE de Williams [20] (conocido como método de razón de verosimilitud en la literatura de optimización basada en simulación ). [21]

Una gran clase de métodos evita depender de la información del gradiente. Estos incluyen recocido simulado , búsqueda de entropía cruzada o métodos de computación evolutiva . Muchos métodos sin gradiente pueden lograr (en teoría y en el límite) un óptimo global.

Los métodos de búsqueda de políticas pueden converger lentamente ante datos poco fiables. Por ejemplo, esto sucede en problemas episódicos cuando las trayectorias son largas y la varianza de los rendimientos es grande. En este caso, podrían ser útiles los métodos basados en funciones de valor que se basan en diferencias temporales. En los últimos años, se han propuesto métodos actor-crítico que han funcionado bien en diversos problemas. [22]

Se han utilizado métodos de búsqueda de políticas en el contexto de la robótica . [23] Muchos métodos de búsqueda de políticas pueden quedarse atascados en óptimos locales (ya que se basan en la búsqueda local ).

Finalmente, todos los métodos anteriores se pueden combinar con algoritmos que primero aprenden un modelo del proceso de decisión de Markov , la probabilidad de cada estado siguiente dada una acción tomada a partir de un estado existente. Por ejemplo, el algoritmo Dyna [24] aprende un modelo a partir de la experiencia y lo utiliza para proporcionar más transiciones modeladas para una función de valor, además de las transiciones reales. En ocasiones, estos métodos pueden ampliarse al uso de modelos no paramétricos, como cuando las transiciones simplemente se almacenan y se "reproducen" [25] en el algoritmo de aprendizaje.

Los métodos basados en modelos pueden ser más intensivos desde el punto de vista computacional que los enfoques sin modelos, y su utilidad puede verse limitada por la medida en que se pueda aprender el proceso de decisión de Markov. [26]

Hay otras formas de utilizar modelos además de actualizar una función de valor. [27] Por ejemplo, en el control predictivo de modelos, el modelo se utiliza para actualizar el comportamiento directamente.

Se comprenden bien tanto el comportamiento asintótico como el de muestras finitas de la mayoría de los algoritmos. Se conocen algoritmos con un rendimiento en línea demostrablemente bueno (que abordan el problema de la exploración).

Burnetas y Katehakis (1997) ofrecen una exploración eficiente de los procesos de decisión de Markov. [12] También han aparecido límites de rendimiento de tiempo finito para muchos algoritmos, pero se espera que estos límites sean bastante flexibles y, por lo tanto, se necesita más trabajo para comprender mejor las ventajas y limitaciones relativas.

Para los algoritmos incrementales, se han resuelto los problemas de convergencia asintótica [ se necesita aclaración ] . Los algoritmos basados en diferencias temporales convergen bajo un conjunto de condiciones más amplio de lo que era posible anteriormente (por ejemplo, cuando se usan con una aproximación de funciones arbitraria y suave).

Los temas de investigación incluyen:

Las tareas de aprendizaje por refuerzo asociativo combinan facetas de tareas de autómatas de aprendizaje estocástico y tareas de clasificación de patrones de aprendizaje supervisados. En las tareas de aprendizaje por refuerzo asociativo, el sistema de aprendizaje interactúa en un circuito cerrado con su entorno. [44]

Este enfoque amplía el aprendizaje por refuerzo mediante el uso de una red neuronal profunda y sin diseñar explícitamente el espacio de estados. [45] El trabajo sobre el aprendizaje de juegos ATARI de Google DeepMind aumentó la atención al aprendizaje por refuerzo profundo o aprendizaje por refuerzo de un extremo a otro . [46]

El aprendizaje por refuerzo profundo adversario es un área activa de investigación en el aprendizaje por refuerzo que se centra en las vulnerabilidades de las políticas aprendidas. En esta área de investigación, algunos estudios mostraron inicialmente que las políticas de aprendizaje por refuerzo son susceptibles a manipulaciones adversas imperceptibles. [47] [48] [49] Si bien se han propuesto algunos métodos para superar estas susceptibilidades, en los estudios más recientes se ha demostrado que estas soluciones propuestas están lejos de proporcionar una representación precisa de las vulnerabilidades actuales de las políticas de aprendizaje por refuerzo profundo. [50]

Al introducir la inferencia difusa en el aprendizaje por refuerzo, [51] se hace posible aproximar la función de valor de estado-acción con reglas difusas en un espacio continuo. La forma SI - ENTONCES de reglas difusas hace que este enfoque sea adecuado para expresar los resultados en una forma cercana al lenguaje natural. La extensión de FRL con interpolación de reglas difusas [52] permite el uso de bases de reglas difusas dispersas de tamaño reducido para enfatizar las reglas cardinales (los valores de estado-acción más importantes).

En el aprendizaje por refuerzo inverso (IRL), no se proporciona ninguna función de recompensa. En cambio, la función de recompensa se infiere dado un comportamiento observado por parte de un experto. La idea es imitar el comportamiento observado, que a menudo es óptimo o cercano al óptimo. [53] Un paradigma IRL popular se denomina aprendizaje por refuerzo inverso de máxima entropía (MaxEnt IRL). [54] MaxEnt IRL estima los parámetros de un modelo lineal de la función de recompensa maximizando la entropía de la distribución de probabilidad de las trayectorias observadas sujetas a restricciones relacionadas con la coincidencia de recuentos de características esperadas. Recientemente se ha demostrado que MaxEnt IRL es un caso particular de un marco más general denominado aprendizaje por refuerzo inverso de utilidad aleatoria (RU-IRL). [55] RU-IRL se basa en la teoría de la utilidad aleatoria y los procesos de decisión de Markov. Mientras que los enfoques IRL anteriores suponen que el comportamiento aparentemente aleatorio de un agente observado se debe a que sigue una política aleatoria, RU-IRL supone que el agente observado sigue una política determinista, pero la aleatoriedad en el comportamiento observado se debe al hecho de que un observador sólo tiene Acceso parcial a las características que el agente observado utiliza en la toma de decisiones. La función de utilidad se modela como una variable aleatoria para dar cuenta de la ignorancia del observador con respecto a las características que el agente observado realmente considera en su función de utilidad.

El aprendizaje por refuerzo seguro (SRL) se puede definir como el proceso de aprendizaje de políticas que maximizan la expectativa de retorno en problemas en los que es importante garantizar un rendimiento razonable del sistema y/o respetar las restricciones de seguridad durante los procesos de aprendizaje y/o implementación. [56]

{{cite book}}: CS1 maint: location missing publisher (link){{cite book}}: CS1 maint: location missing publisher (link){{cite book}}: CS1 maint: multiple names: authors list (link)