La prueba t de Student es una prueba estadística que se utiliza para comprobar si la diferencia entre la respuesta de dos grupos es estadísticamente significativa o no. Es cualquier prueba de hipótesis estadística en la que el estadístico de prueba sigue una distribución t de Student bajo la hipótesis nula . Se aplica más comúnmente cuando la estadística de prueba seguiría una distribución normal si se conociera el valor de un término de escala en la estadística de prueba (normalmente, el término de escala es desconocido y, por lo tanto, es un parámetro molesto ). Cuando el término de escala se estima en función de los datos , el estadístico de prueba (bajo ciertas condiciones) sigue una distribución t de Student . La aplicación más común de la prueba t es probar si las medias de dos poblaciones son significativamente diferentes. En muchos casos, una prueba Z arrojará resultados muy similares a una prueba t, ya que esta última converge con la primera a medida que aumenta el tamaño del conjunto de datos.

El término " estadístico t " se abrevia de "estadístico de prueba de hipótesis". [1] En estadística, la distribución t fue derivada por primera vez como una distribución posterior en 1876 por Helmert [2] [3] [4] y Lüroth . [5] [6] [7] La distribución t también apareció en una forma más general como distribución de Pearson tipo IV en el artículo de Karl Pearson de 1895. [8] Sin embargo, la distribución t , también conocida como distribución t de Student , recibe su nombre de William Sealy Gosset , quien la publicó por primera vez en inglés en 1908 en la revista científica Biometrika utilizando el seudónimo "Student" [9] [10 ] porque su empleador prefería que el personal utilizara seudónimos al publicar artículos científicos. [11] Gosset trabajó en la cervecería Guinness en Dublín , Irlanda , y estaba interesado en los problemas de muestras pequeñas, por ejemplo, las propiedades químicas de la cebada con tamaños de muestra pequeños. De ahí que una segunda versión de la etimología del término Student sea que Guinness no quería que sus competidores supieran que estaban utilizando la prueba t para determinar la calidad de la materia prima. Aunque fue William Gosset en honor a quien se escribió el término "Student", en realidad fue gracias al trabajo de Ronald Fisher que la distribución se hizo conocida como "distribución de Student" [12] y "prueba t de Student ".

Gosset ideó la prueba t como una forma económica de controlar la calidad de la cerveza negra . El trabajo de la prueba t fue presentado y aceptado en la revista Biometrika y publicado en 1908. [9]

Guinness tenía la política de permitir al personal técnico licencia para estudiar (la llamada "licencia para estudiar"), que Gosset utilizó durante los dos primeros trimestres del año académico 1906-1907 en el Laboratorio Biométrico del profesor Karl Pearson en el University College de Londres . [13] La identidad de Gosset era entonces conocida por sus colegas estadísticos y por el editor en jefe Karl Pearson. [14]

La prueba t de Student para una muestra es una prueba de ubicación para determinar si la media de una población tiene un valor especificado en una hipótesis nula . Al probar la hipótesis nula de que la media poblacional es igual a un valor específico μ 0 , se utiliza el estadístico

donde es la media muestral, s es la desviación estándar muestral y n es el tamaño de la muestra. Los grados de libertad utilizados en esta prueba son n − 1 . Aunque no es necesario que la población original tenga una distribución normal, se supone que la distribución de la población de medias muestrales es normal.

Según el teorema del límite central , si las observaciones son independientes y el segundo momento existe, entonces será aproximadamente normal .

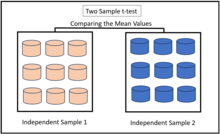

Una prueba de ubicación de dos muestras de la hipótesis nula tal que las medias de dos poblaciones son iguales. Todas estas pruebas suelen denominarse pruebas t de Student , aunque estrictamente hablando, ese nombre sólo debe usarse si también se supone que las varianzas de las dos poblaciones son iguales; la forma de prueba utilizada cuando se descarta este supuesto a veces se denomina prueba t de Welch . Estas pruebas a menudo se denominan pruebas t de muestras no apareadas o independientes , ya que normalmente se aplican cuando las unidades estadísticas subyacentes a las dos muestras que se comparan no se superponen. [15]

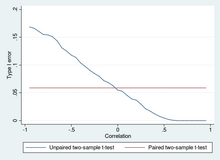

Las pruebas t de dos muestras para una diferencia de medias involucran muestras independientes (muestras no apareadas) o muestras apareadas . Las pruebas t pareadas son una forma de bloqueo y tienen mayor potencia (probabilidad de evitar un error tipo II, también conocido como falso negativo) que las pruebas no pareadas cuando las unidades pareadas son similares con respecto a los "factores de ruido" (ver factor de confusión ). que son independientes de la pertenencia a los dos grupos que se comparan. [16] En un contexto diferente, las pruebas t pareadas se pueden utilizar para reducir los efectos de los factores de confusión en un estudio observacional .

La prueba t de muestras independientes se utiliza cuando se obtienen dos conjuntos separados de muestras independientes y distribuidas de manera idéntica , y se compara una variable de cada una de las dos poblaciones. Por ejemplo, supongamos que estamos evaluando el efecto de un tratamiento médico e inscribimos a 100 sujetos en nuestro estudio, luego asignamos aleatoriamente 50 sujetos al grupo de tratamiento y 50 sujetos al grupo de control. En este caso, tenemos dos muestras independientes y usaríamos la forma no apareada de la prueba t .

Las pruebas t de muestras pareadas normalmente consisten en una muestra de pares emparejados de unidades similares , o un grupo de unidades que se ha probado dos veces (una prueba t de "medidas repetidas" ).

Un ejemplo típico de la prueba t de medidas repetidas sería cuando los sujetos son evaluados antes de un tratamiento, por ejemplo para la presión arterial alta, y los mismos sujetos son evaluados nuevamente después del tratamiento con un medicamento para reducir la presión arterial. Al comparar los números del mismo paciente antes y después del tratamiento, utilizamos efectivamente a cada paciente como su propio control. De esa manera, el rechazo correcto de la hipótesis nula (aquí: de que el tratamiento no produjo diferencias) puede volverse mucho más probable, con un poder estadístico aumentando simplemente porque ahora se ha eliminado la variación aleatoria entre pacientes. Sin embargo, un aumento del poder estadístico tiene un precio: se requieren más pruebas y cada sujeto debe ser evaluado dos veces. Como la mitad de la muestra ahora depende de la otra mitad, la versión pareada de la prueba t de Student sólo tienenorte/2− 1 grado de libertad ( siendo n el número total de observaciones). Los pares se convierten en unidades de prueba individuales y la muestra debe duplicarse para lograr el mismo número de grados de libertad. Normalmente, hay n − 1 grados de libertad ( siendo n el número total de observaciones). [17]

Una prueba t de muestras pareadas basada en una "muestra de pares pareados" resulta de una muestra no pareada que se utiliza posteriormente para formar una muestra pareada, mediante el uso de variables adicionales que se midieron junto con la variable de interés. [18] El emparejamiento se lleva a cabo identificando pares de valores que consisten en una observación de cada una de las dos muestras, donde el par es similar en términos de otras variables medidas. Este enfoque se utiliza a veces en estudios observacionales para reducir o eliminar los efectos de los factores de confusión.

Las pruebas t de muestras pareadas a menudo se denominan " pruebas t de muestras dependientes ".

[ dudoso ]

La mayoría de las estadísticas de prueba tienen la forma t = Z / s , donde Z y s son funciones de los datos.

Z puede ser sensible a la hipótesis alternativa (es decir, su magnitud tiende a ser mayor cuando la hipótesis alternativa es verdadera), mientras que s es un parámetro de escala que permitedeterminar la distribución de t .

Como ejemplo, en la prueba t de una muestra

donde es la media muestral de una muestra X 1 , X 2 , …, X n , de tamaño n , s es el error estándar de la media , es la estimación de la desviación estándar de la población y μ es la media poblacional .

Los supuestos que subyacen a una prueba t en la forma más simple anterior son los siguientes:

En la prueba t que compara las medias de dos muestras independientes, se deben cumplir los siguientes supuestos:

La mayoría de las pruebas t de dos muestras son robustas excepto para grandes desviaciones de los supuestos. [22]

Para mayor exactitud , la prueba t y la prueba Z requieren normalidad de las medias muestrales, y la prueba t requiere además que la varianza muestral siga una distribución χ 2 escalada , y que la media muestral y la varianza muestral sean estadísticamente independientes . La normalidad de los valores de datos individuales no es necesaria si se cumplen estas condiciones. Según el teorema del límite central , las medias muestrales de muestras moderadamente grandes suelen estar bien aproximadas mediante una distribución normal, incluso si los datos no están distribuidos normalmente. Sin embargo, el tamaño de muestra requerido para que las medias muestrales converjan a la normalidad depende de la asimetría de la distribución de los datos originales. La muestra puede variar de 30 a 100 o valores más altos dependiendo de la asimetría. [23] [24] F

Para datos no normales, la distribución de la varianza muestral puede desviarse sustancialmente de una distribución χ 2 .

Sin embargo, si el tamaño de la muestra es grande, el teorema de Slutsky implica que la distribución de la varianza muestral tiene poco efecto sobre la distribución del estadístico de prueba. Es decir, a medida que aumenta el tamaño de la muestra:

A continuación se proporcionan expresiones explícitas que se pueden utilizar para realizar varias pruebas t . En cada caso, se da la fórmula para un estadístico de prueba que sigue exactamente o se aproxima mucho a una distribución t bajo la hipótesis nula. Además, se dan los grados de libertad adecuados en cada caso. Cada una de estas estadísticas se puede utilizar para realizar una prueba de una o dos colas .

Una vez que se determinan el valor t y los grados de libertad, se puede encontrar un valor p usando una tabla de valores de la distribución t de Student . Si el valor p calculado está por debajo del umbral elegido para la significación estadística (normalmente el nivel 0,10, 0,05 o 0,01), entonces la hipótesis nula se rechaza a favor de la hipótesis alternativa.

Supongamos que uno se ajusta al modelo.

donde x es conocida, α y β son desconocidas, ε es una variable aleatoria distribuida normalmente con media 0 y varianza desconocida σ 2 , e Y es el resultado de interés. Queremos probar la hipótesis nula de que la pendiente β es igual a algún valor específico β 0 (a menudo tomado como 0, en cuyo caso la hipótesis nula es que xey no están correlacionados).

Dejar

Entonces

tiene una distribución t con n − 2 grados de libertad si la hipótesis nula es verdadera. El error estándar del coeficiente de pendiente :

se puede escribir en términos de los residuos. Dejar

Entonces la puntuación t está dada por

Otra forma de determinar la puntuación t es

donde r es el coeficiente de correlación de Pearson .

La puntuación t , intersección se puede determinar a partir de la puntuación t , pendiente :

donde s x 2 es la varianza muestral.

Dados dos grupos (1, 2), esta prueba sólo es aplicable cuando:

Las violaciones de estos supuestos se analizan a continuación.

El estadístico t para comprobar si las medias son diferentes se puede calcular de la siguiente manera:

dónde

Aquí sp es la desviación estándar agrupada para n = n 1 = n 2 , y s 2x1

y s 2x2

son los estimadores insesgados de la varianza poblacional. El denominador de t es el error estándar de la diferencia entre dos medias.

Para las pruebas de significancia, los grados de libertad para esta prueba son 2 n − 2 , donde n es el tamaño de la muestra.

Esta prueba se utiliza sólo cuando se puede suponer que las dos distribuciones tienen la misma varianza (cuando se viola este supuesto, ver más abajo). Las fórmulas anteriores son un caso especial de las fórmulas siguientes, se recuperan cuando ambas muestras son iguales en tamaño: n = n 1 = n 2 .

El estadístico t para comprobar si las medias son diferentes se puede calcular de la siguiente manera:

dónde

es la desviación estándar combinada de las dos muestras: se define de esta manera para que su cuadrado sea un estimador insesgado de la varianza común, sean o no las mismas medias poblacionales. En estas fórmulas, n i − 1 es el número de grados de libertad para cada grupo, y el tamaño total de la muestra menos dos (es decir, n 1 + n 2 − 2 ) es el número total de grados de libertad, que se utiliza en pruebas de significancia.

Esta prueba, también conocida como prueba t de Welch , se utiliza sólo cuando se supone que las dos varianzas de la población no son iguales (los dos tamaños de muestra pueden ser iguales o no) y, por lo tanto, deben estimarse por separado. El estadístico t para probar si las medias poblacionales son diferentes se calcula como

dónde

Aquí s i 2 es el estimador insesgado de la varianza de cada una de las dos muestras con n i = número de participantes en el grupo i ( i = 1 o 2). En este caso no se trata de una variación agrupada. Para su uso en pruebas de significancia, la distribución del estadístico de prueba se aproxima como una distribución t de Student ordinaria con los grados de libertad calculados usando

Esto se conoce como ecuación de Welch-Satterthwaite . La verdadera distribución del estadístico de prueba en realidad depende (ligeramente) de las dos varianzas poblacionales desconocidas (ver problema de Behrens-Fisher ).

La prueba [25] trata del famoso problema de Behrens-Fisher , es decir, comparar la diferencia entre las medias de dos poblaciones normalmente distribuidas cuando se supone que las varianzas de las dos poblaciones no son iguales, basándose en dos muestras independientes.

La prueba se desarrolla como una prueba exacta que permite tamaños de muestra desiguales y varianzas desiguales de dos poblaciones. La propiedad exacta sigue siendo válida incluso con tamaños de muestra pequeños, extremadamente pequeños y desequilibrados (p. ej. ).

La estadística para probar si las medias son diferentes se puede calcular de la siguiente manera:

Sean y los vectores de muestra iid ( ) de y por separado.

Sea una matriz ortogonal cuyos elementos de la primera fila son todos , de manera similar, sean las primeras n filas de una matriz ortogonal (cuyos elementos de la primera fila son todos ).

Entonces es un vector aleatorio normal de n dimensiones.

De la distribución anterior vemos que

Esta prueba se utiliza cuando las muestras son dependientes; es decir, cuando hay una sola muestra que ha sido analizada dos veces (medidas repetidas) o cuando hay dos muestras que han sido emparejadas o "emparejadas". Este es un ejemplo de una prueba de diferencias pareadas . El estadístico t se calcula como

donde y son el promedio y la desviación estándar de las diferencias entre todos los pares. Los pares son, por ejemplo, las puntuaciones previas y posteriores a la prueba de una persona o entre pares de personas agrupadas en grupos significativos (por ejemplo, extraídos de la misma familia o grupo de edad: consulte la tabla). La constante μ 0 es cero si queremos probar si el promedio de la diferencia es significativamente diferente. El grado de libertad utilizado es n − 1 , donde n representa el número de pares.

Sea A 1 un conjunto obtenido al extraer una muestra aleatoria de seis medidas:

y sea A 2 un segundo conjunto obtenido de manera similar:

Estos podrían ser, por ejemplo, los pesos de tornillos fabricados por dos máquinas diferentes.

Realizaremos pruebas de hipótesis nula de que las medias de las poblaciones de las que se tomaron las dos muestras son iguales.

La diferencia entre las dos medias muestrales, cada una denotada por Xi , que aparece en el numerador de todos los métodos de prueba de dos muestras discutidos anteriormente, es

Las desviaciones estándar muestrales para las dos muestras son aproximadamente 0,05 y 0,11, respectivamente. Para muestras tan pequeñas, una prueba de igualdad entre las dos varianzas poblacionales no sería muy poderosa. Dado que los tamaños de muestra son iguales, las dos formas de la prueba t de dos muestras funcionarán de manera similar en este ejemplo.

Si se sigue el enfoque para varianzas desiguales (discutido anteriormente), los resultados son

y los grados de libertad

El estadístico de prueba es aproximadamente 1,959, lo que da un valor p de prueba de dos colas de 0,09077.

Si se sigue el enfoque de varianzas iguales (discutido anteriormente), los resultados son

y los grados de libertad

El estadístico de prueba es aproximadamente igual a 1,959, lo que da un valor p de dos colas de 0,07857.

La prueba t proporciona una prueba exacta para la igualdad de las medias de dos poblaciones normales iid con varianzas desconocidas, pero iguales. ( La prueba t de Welch es una prueba casi exacta para el caso en el que los datos son normales pero las varianzas pueden diferir). Para muestras moderadamente grandes y una prueba de una cola, la prueba t es relativamente robusta para moderar las violaciones del supuesto de normalidad. [26] En muestras suficientemente grandes, la prueba t se acerca asintóticamente a la prueba z y se vuelve robusta incluso ante grandes desviaciones de la normalidad. [19]

Si los datos son sustancialmente anormales y el tamaño de la muestra es pequeño, la prueba t puede dar resultados engañosos. Consulte Prueba de ubicación para distribuciones de mezclas en escala gaussiana para conocer alguna teoría relacionada con una familia particular de distribuciones no normales.

Cuando el supuesto de normalidad no se cumple, una alternativa no paramétrica a la prueba t puede tener mejor poder estadístico . Sin embargo, cuando los datos no son normales y tienen diferentes varianzas entre los grupos, una prueba t puede tener un mejor control del error tipo 1 que algunas alternativas no paramétricas. [27] Además, los métodos no paramétricos, como la prueba U de Mann-Whitney que se analiza a continuación, normalmente no prueban la diferencia de medias, por lo que deben usarse con cuidado si una diferencia de medias es de interés científico primario. [19] Por ejemplo, la prueba U de Mann-Whitney mantendrá el error tipo 1 en el nivel alfa deseado si ambos grupos tienen la misma distribución. También tendrá poder para detectar una alternativa según la cual el grupo B tenga la misma distribución que A pero después de algún cambio en una constante (en cuyo caso, efectivamente, habría una diferencia en las medias de los dos grupos). Sin embargo, podría haber casos en los que los grupos A y B tengan distribuciones diferentes pero con las mismas medias (como dos distribuciones, una con asimetría positiva y la otra con asimetría negativa, pero desplazadas para tener las mismas medias). En tales casos, MW podría tener un poder superior al nivel alfa para rechazar la hipótesis nula, pero atribuir la interpretación de la diferencia de medias a tal resultado sería incorrecto.

En presencia de un valor atípico , la prueba t no es sólida. Por ejemplo, para dos muestras independientes cuando las distribuciones de datos son asimétricas (es decir, las distribuciones están sesgadas ) o las distribuciones tienen colas grandes, entonces la prueba de suma de rangos de Wilcoxon (también conocida como prueba U de Mann-Whitney ) puede tener tres a una potencia cuatro veces mayor que la prueba t . [26] [28] [29] La contraparte no paramétrica de la prueba t de muestras pareadas es la prueba de rangos con signo de Wilcoxon para muestras pareadas. Para una discusión sobre la elección entre la prueba t y alternativas no paramétricas, consulte Lumley, et al. (2002). [19]

El análisis de varianza unidireccional (ANOVA) generaliza la prueba t de dos muestras cuando los datos pertenecen a más de dos grupos.

Cuando en el diseño de dos muestras están presentes tanto observaciones pareadas como observaciones independientes, suponiendo que faltan datos completamente al azar (MCAR), las observaciones pareadas u observaciones independientes pueden descartarse para continuar con las pruebas estándar anteriores. Alternativamente, haciendo uso de todos los datos disponibles, suponiendo normalidad y MCAR, se podría utilizar la prueba t generalizada de muestras parcialmente superpuestas. [30]

Una generalización del estadístico t de Student , llamado estadístico t cuadrado de Hotelling , permite probar hipótesis sobre múltiples medidas (a menudo correlacionadas) dentro de la misma muestra. Por ejemplo, un investigador podría someter a varios sujetos a una prueba de personalidad que consta de múltiples escalas de personalidad (por ejemplo, el Inventario Multifásico de Personalidad de Minnesota ). Debido a que las medidas de este tipo generalmente están correlacionadas positivamente, no es aconsejable realizar pruebas t univariadas separadas para probar hipótesis, ya que descuidarían la covarianza entre medidas e inflarían la posibilidad de rechazar falsamente al menos una hipótesis ( error de tipo I ). En este caso, es preferible una prueba multivariada única para la prueba de hipótesis. Uno de ellos es el método de Fisher para combinar múltiples pruebas con alfa reducido para obtener una correlación positiva entre las pruebas. Otra es que el estadístico T 2 de Hotelling sigue una distribución T 2 . Sin embargo, en la práctica la distribución rara vez se utiliza, ya que los valores tabulados para T 2 son difíciles de encontrar. Generalmente, T 2 se convierte en un estadístico F.

Para una prueba multivariada de una muestra, la hipótesis es que el vector medio ( μ ) es igual a un vector dado ( μ 0 ). El estadístico de prueba es el t 2 de Hotelling :

donde n es el tamaño de la muestra, x es el vector de medias de las columnas y S es una matriz de covarianza de muestra de m × m .

Para una prueba multivariada de dos muestras, la hipótesis es que los vectores medios ( μ 1 , μ 2 ) de dos muestras son iguales. El estadístico de prueba es el t 2 de dos muestras de Hotelling :

La prueba t de dos muestras es un caso especial de regresión lineal simple , como se ilustra en el siguiente ejemplo.

Un ensayo clínico examina a 6 pacientes que reciben fármaco o placebo. Tres (3) pacientes reciben 0 unidades de fármaco (el grupo placebo). Tres (3) pacientes reciben 1 unidad de medicamento (el grupo de tratamiento activo). Al final del tratamiento, los investigadores miden el cambio desde el inicio en la cantidad de palabras que cada paciente puede recordar en una prueba de memoria.

A continuación se muestra una tabla con los valores de dosis de fármaco y recuerdo de palabras de los pacientes.

Los datos y el código se proporcionan para el análisis utilizando el lenguaje de programación R con las funciones t.testy lmpara la prueba t y la regresión lineal. Aquí están los mismos datos (ficticios) generados anteriormente en R.

> palabra.recuerdo.datos = marco.de datos ( droga.dosis = c ( 0 , 0 , 0 , 1 , 1 , 1 ), palabra.recuerdo = c ( 1 , 2 , 3 , 5 , 6 , 7 )) Realice la prueba t. Observe que se requiere el supuesto de varianza igual, var.equal=T, para que el análisis sea exactamente equivalente a una regresión lineal simple.

> con ( palabra.recordar.datos , t.prueba ( palabra.recordar ~ droga.dosis , var.equal = T )) Al ejecutar el código R se obtienen los siguientes resultados.

Realice una regresión lineal de los mismos datos. Los cálculos se pueden realizar utilizando la función R lm()para un modelo lineal.

> word.recall.data.lm = lm ( word.recall ~ droga.dosis , datos = word.recall.data ) > resumen ( word.recall.data.lm ) La regresión lineal proporciona una tabla de coeficientes y valores p.

La tabla de coeficientes da los siguientes resultados.

Los coeficientes de la regresión lineal especifican la pendiente y la intersección de la línea que une las medias de dos grupos, como se ilustra en el gráfico. La intersección es 2 y la pendiente es 4.

Compare el resultado de la regresión lineal con el resultado de la prueba t.

Este ejemplo muestra que, para el caso especial de una regresión lineal simple donde hay una única variable x que tiene valores 0 y 1, la prueba t da los mismos resultados que la regresión lineal. La relación también se puede mostrar algebraicamente.

Reconocer esta relación entre la prueba t y la regresión lineal facilita el uso de la regresión lineal múltiple y el análisis de varianza multidireccional . Estas alternativas a las pruebas t permiten la inclusión de variables explicativas adicionales asociadas con la respuesta. La inclusión de variables explicativas adicionales mediante regresión o anova reduce la varianza que de otro modo no se explicaría y, por lo general, produce un mayor poder para detectar diferencias que las pruebas t de dos muestras.

Muchos programas de hojas de cálculo y paquetes de estadísticas, como QtiPlot , LibreOffice Calc , Microsoft Excel , SAS , SPSS , Stata , DAP , gretl , R , Python , PSPP , Wolfram Mathematica , MATLAB y Minitab , incluyen implementaciones de la prueba t de Student .