Un modelo de Markov oculto ( HMM ) es un modelo de Markov en el que las observaciones dependen de un proceso de Markov latente (u "oculto") (denominado ). Un HMM requiere que haya un proceso observable cuyos resultados dependan de los resultados de una manera conocida. Dado que no se puede observar directamente, el objetivo es aprender sobre el estado de mediante la observación. Por definición, al ser un modelo de Markov, un HMM tiene el requisito adicional de que el resultado de at debe estar "influido" exclusivamente por el resultado de at y que el Los resultados de y en deben ser condicionalmente independientes de en un momento dado . La estimación de los parámetros en un HMM se puede realizar utilizando la máxima verosimilitud . Para HMM de cadena lineal, se puede utilizar el algoritmo de Baum-Welch para estimar los parámetros.

Los modelos ocultos de Markov son conocidos por sus aplicaciones a la termodinámica , la mecánica estadística , la física , la química , la economía , las finanzas , el procesamiento de señales , la teoría de la información y el reconocimiento de patrones , como el habla , [1] la escritura a mano , el reconocimiento de gestos , [2] parte de- etiquetado del habla , seguimiento de partituras musicales, [3] descargas parciales [4] y bioinformática . [5] [6]

Sean y sean procesos estocásticos en tiempo discreto y . El par es un modelo de Markov oculto si

Sean y sean procesos estocásticos de tiempo continuo. El par es un modelo de Markov oculto si

Los estados del proceso (resp. se denominan estados ocultos y (resp. se denomina probabilidad de emisión o probabilidad de salida) .

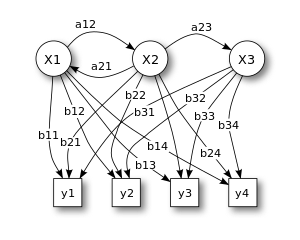

En su forma discreta, un proceso de Markov oculto se puede visualizar como una generalización del problema de la urna con reemplazo (donde cada elemento de la urna se devuelve a la urna original antes del siguiente paso). [7] Consideremos este ejemplo: en una habitación que no es visible para un observador hay un genio. La habitación contiene urnas X1, X2, X3,... cada una de las cuales contiene una mezcla conocida de bolas, y cada bola tiene una etiqueta única y1, y2, y3,.... El genio elige una urna en esa habitación y saca una bola al azar de esa urna. Luego coloca la bola en una cinta transportadora, donde el observador puede observar la secuencia de las bolas pero no la secuencia de las urnas de las que fueron extraídas. El genio tiene algún procedimiento para elegir urnas; la elección de la urna para la n -ésima bola depende sólo de un número aleatorio y de la elección de la urna para la ( n − 1) -ésima bola. La elección de la urna no depende directamente de las urnas elegidas antes de esta única urna anterior; por lo tanto, a esto se le llama proceso de Markov . Puede describirse en la parte superior de la Figura 1.

El proceso de Markov en sí no se puede observar, sólo la secuencia de bolas etiquetadas, por lo que esta disposición se denomina "proceso de Markov oculto". Esto se ilustra en la parte inferior del diagrama que se muestra en la Figura 1, donde se puede ver que las bolas y1, y2, y3, y4 se pueden dibujar en cada estado. Incluso si el observador conoce la composición de las urnas y acaba de observar una secuencia de tres bolas, por ejemplo, y1, y2 e y3 en la cinta transportadora, todavía no puede estar seguro de qué urna ( es decir , en qué estado) ha dibujado el genio. la tercera bola de. Sin embargo, el observador puede deducir otra información, como la probabilidad de que la tercera bola proviniera de cada una de las urnas.

Consideremos a dos amigos, Alice y Bob, que viven muy separados el uno del otro y hablan diariamente por teléfono sobre lo que hicieron ese día. A Bob solo le interesan tres actividades: caminar por el parque, ir de compras y limpiar su apartamento. La elección de qué hacer está determinada exclusivamente por el clima de un día determinado. Alice no tiene información definitiva sobre el clima, pero conoce las tendencias generales. Basándose en lo que Bob le dice que hizo cada día, Alice intenta adivinar cómo debía haber estado el clima.

Alice cree que el clima opera como una cadena de Markov discreta . Hay dos estados, "Lluvioso" y "Soleado", pero ella no puede observarlos directamente, es decir, están ocultos para ella. Cada día, existe una cierta probabilidad de que Bob realice una de las siguientes actividades, dependiendo del clima: "caminar", "comprar" o "limpiar". Dado que Bob le cuenta a Alice sobre sus actividades, esas son las observaciones . Todo el sistema es el de un modelo oculto de Markov (HMM).

Alice conoce las tendencias climáticas generales en el área y lo que a Bob le gusta hacer en promedio. En otras palabras, se conocen los parámetros del HMM. Se pueden representar de la siguiente manera en Python :

estados = ( "lluvioso" , "soleado" )observaciones = ( "caminar" , "comprar" , "limpiar" )start_probability = { "Lluvioso" : 0,6 , "Soleado" : 0,4 }Transition_probability = { "Lluvioso" : { "Lluvioso" : 0.7 , "Soleado" : 0.3 }, "Soleado" : { "Lluvioso" : 0.4 , "Soleado" : 0.6 }, }probabilidad_emisión = { "lluvioso" : { "caminar" : 0,1 , "comprar" : 0,4 , "limpio" : 0,5 }, "soleado" : { "caminar" : 0,6 , "comprar" : 0,3 , "limpio" : 0,1 } , }En este fragmento de código, start_probabilityrepresenta la creencia de Alice sobre en qué estado se encuentra el HMM cuando Bob la llama por primera vez (todo lo que sabe es que tiende a llover en promedio). La distribución de probabilidad particular utilizada aquí no es la de equilibrio, que es (dadas las probabilidades de transición) aproximadamente {'Rainy': 0.57, 'Sunny': 0.43}. Representa transition_probabilityel cambio del clima en la cadena de Markov subyacente. En este ejemplo, hay sólo un 30% de posibilidades de que mañana haga sol si hoy llueve. Representa emission_probabilityla probabilidad de que Bob realice una determinada actividad cada día. Si llueve, hay un 50% de posibilidades de que esté limpiando su apartamento; si hace sol, hay un 60% de posibilidades de que esté afuera dando un paseo.

Un ejemplo similar se detalla con más detalle en la página del algoritmo de Viterbi .

El siguiente diagrama muestra la arquitectura general de un HMM instanciado. Cada forma ovalada representa una variable aleatoria que puede adoptar cualquiera de varios valores. La variable aleatoria x ( t ) es el estado oculto en el momento t (con el modelo del diagrama anterior, x ( t ) ∈ { x 1 , x 2 , x 3 }). La variable aleatoria y ( t ) es la observación en el momento t (con y ( t ) ∈ { y 1 , y 2 , y 3 , y 4 }). Las flechas en el diagrama (a menudo llamado diagrama de trellis ) indican dependencias condicionales.

Del diagrama se desprende claramente que la distribución de probabilidad condicional de la variable oculta x ( t ) en el momento t , dados los valores de la variable oculta x en todo momento, depende sólo del valor de la variable oculta x ( t − 1). ); los valores en el momento t − 2 y antes no tienen influencia. Esto se llama propiedad de Markov . De manera similar, el valor de la variable observada y ( t ) solo depende del valor de la variable oculta x ( t ) (ambas en el tiempo t ).

En el tipo estándar de modelo oculto de Markov considerado aquí, el espacio de estados de las variables ocultas es discreto, mientras que las observaciones mismas pueden ser discretas (normalmente generadas a partir de una distribución categórica ) o continuas (normalmente a partir de una distribución gaussiana ). Los parámetros de un modelo oculto de Markov son de dos tipos, probabilidades de transición y probabilidades de emisión (también conocidas como probabilidades de salida ). Las probabilidades de transición controlan la forma en que se elige el estado oculto en el momento t dado el estado oculto en el momento .

Se supone que el espacio de estados oculto consta de uno de N valores posibles, modelado como una distribución categórica. (Consulte la sección siguiente sobre extensiones para conocer otras posibilidades). Esto significa que para cada uno de los N estados posibles en los que puede estar una variable oculta en el momento t , existe una probabilidad de transición de este estado a cada uno de los N estados posibles de la variable oculta en el momento t. variable oculta en el momento , para un total de probabilidades de transición. Tenga en cuenta que el conjunto de probabilidades de transición para las transiciones desde cualquier estado dado debe sumar 1. Por lo tanto, la matriz de probabilidades de transición es una matriz de Markov . Debido a que cualquier probabilidad de transición se puede determinar una vez que se conocen las demás, existe un total de parámetros de transición.

Además, para cada uno de los N estados posibles, existe un conjunto de probabilidades de emisión que rigen la distribución de la variable observada en un momento particular dado el estado de la variable oculta en ese momento. El tamaño de este conjunto depende de la naturaleza de la variable observada. Por ejemplo, si la variable observada es discreta con M valores posibles, regidos por una distribución categórica , habrá parámetros separados, para un total de parámetros de emisión en todos los estados ocultos. Por otro lado, si la variable observada es un vector M -dimensional distribuido según una distribución gaussiana multivariada arbitraria , habrá M parámetros que controlarán las medias y parámetros que controlarán la matriz de covarianza , para un total de parámetros de emisión. (En tal caso, a menos que el valor de M sea pequeño, puede ser más práctico restringir la naturaleza de las covarianzas entre elementos individuales del vector de observación, por ejemplo, asumiendo que los elementos son independientes entre sí, o de manera menos restrictiva, son independientes de todos menos de un número fijo de elementos adyacentes.)

Varios problemas de inferencia están asociados con los modelos ocultos de Markov, como se describe a continuación.

La tarea es calcular de la mejor manera, dados los parámetros del modelo, la probabilidad de una secuencia de salida particular. Esto requiere la suma de todas las secuencias de estados posibles:

La probabilidad de observar una secuencia.

de longitud L está dada por

donde la suma recorre todas las posibles secuencias de nodos ocultos

Aplicando el principio de programación dinámica , este problema también se puede manejar de manera eficiente utilizando el algoritmo directo .

Varias tareas relacionadas preguntan sobre la probabilidad de una o más de las variables latentes, dados los parámetros del modelo y una secuencia de observaciones.

La tarea es calcular, dados los parámetros del modelo y una secuencia de observaciones, la distribución sobre estados ocultos de la última variable latente al final de la secuencia, es decir, calcular . Esta tarea se utiliza cuando la secuencia de variables latentes se considera los estados subyacentes por los que avanza un proceso en una secuencia de puntos en el tiempo, con las observaciones correspondientes en cada punto. Entonces, es natural preguntarse sobre el estado del proceso al final.

Este problema se puede manejar de manera eficiente utilizando el algoritmo directo . Un ejemplo es cuando el algoritmo se aplica a una red oculta de Markov para determinar .

Esto es similar al filtrado, pero pregunta sobre la distribución de una variable latente en algún lugar en el medio de una secuencia, es decir, calcular para algunos . Desde la perspectiva descrita anteriormente, esto puede considerarse como la distribución de probabilidad sobre estados ocultos para un momento k en el pasado, en relación con el tiempo t .

El algoritmo de avance-retroceso es un buen método para calcular los valores suavizados de todas las variables de estado ocultas.

La tarea, a diferencia de las dos anteriores, pregunta sobre la probabilidad conjunta de toda la secuencia de estados ocultos que generaron una secuencia particular de observaciones (ver ilustración a la derecha). Esta tarea es generalmente aplicable cuando los HMM se aplican a tipos de problemas diferentes de aquellos para los cuales son aplicables las tareas de filtrado y suavizado. Un ejemplo es el etiquetado de partes del discurso , donde los estados ocultos representan las partes subyacentes del discurso correspondientes a una secuencia observada de palabras. En este caso, lo que interesa es la secuencia completa de partes de la oración, en lugar de simplemente la parte de la oración de una sola palabra, como lo calcularía el filtrado o el suavizado.

Esta tarea requiere encontrar un máximo sobre todas las secuencias de estados posibles y puede resolverse de manera eficiente mediante el algoritmo de Viterbi .

Para algunos de los problemas anteriores, también puede resultar interesante preguntar sobre la significancia estadística . ¿Cuál es la probabilidad de que una secuencia extraída de alguna distribución nula tenga una probabilidad HMM (en el caso del algoritmo directo) o una probabilidad máxima de secuencia de estados (en el caso del algoritmo de Viterbi) al menos tan grande como la de una secuencia en particular? secuencia de salida? [8] Cuando se utiliza un HMM para evaluar la relevancia de una hipótesis para una secuencia de salida particular, la significancia estadística indica la tasa de falsos positivos asociada con no rechazar la hipótesis para la secuencia de salida.

La tarea de aprendizaje de parámetros en los HMM es encontrar, dada una secuencia de salida o un conjunto de dichas secuencias, el mejor conjunto de probabilidades de emisión y transición de estado. La tarea suele ser derivar la estimación de máxima verosimilitud de los parámetros del HMM dado el conjunto de secuencias de salida. No se conoce ningún algoritmo manejable que resuelva este problema exactamente, pero se puede derivar eficientemente una máxima verosimilitud local utilizando el algoritmo de Baum-Welch o el algoritmo de Baldi-Chauvin. El algoritmo de Baum-Welch es un caso especial del algoritmo de maximización de expectativas .

Si los HMM se utilizan para la predicción de series temporales, se ha demostrado que los métodos de inferencia bayesianos más sofisticados, como el muestreo de Monte Carlo de la cadena de Markov (MCMC), son favorables a la búsqueda de un único modelo de máxima verosimilitud, tanto en términos de precisión como de estabilidad. [9] Dado que MCMC impone una carga computacional significativa, en los casos en que la escalabilidad computacional también es de interés, se puede recurrir alternativamente a aproximaciones variacionales a la inferencia bayesiana, por ejemplo [10] De hecho, la inferencia variacional aproximada ofrece una eficiencia computacional comparable a la maximización de expectativas, mientras que produciendo un perfil de precisión sólo ligeramente inferior a la inferencia bayesiana exacta de tipo MCMC.

Los HMM se pueden aplicar en muchos campos donde el objetivo es recuperar una secuencia de datos que no es inmediatamente observable (pero otros datos que dependen de la secuencia sí lo son). Las aplicaciones incluyen:

Los modelos ocultos de Markov fueron descritos en una serie de artículos estadísticos de Leonard E. Baum y otros autores en la segunda mitad de la década de 1960. [29] [30] [31] [32] [33] Una de las primeras aplicaciones de los HMM fue el reconocimiento de voz , a partir de mediados de la década de 1970. [34] [35] [36] [37]

En la segunda mitad de la década de 1980, los HMM comenzaron a aplicarse al análisis de secuencias biológicas, [38] en particular del ADN . Desde entonces, se han vuelto omnipresentes en el campo de la bioinformática . [39]

En los modelos ocultos de Markov considerados anteriormente, el espacio de estados de las variables ocultas es discreto, mientras que las observaciones mismas pueden ser discretas (normalmente generadas a partir de una distribución categórica ) o continuas (normalmente a partir de una distribución gaussiana ). Los modelos ocultos de Markov también se pueden generalizar para permitir espacios de estados continuos. Ejemplos de tales modelos son aquellos en los que el proceso de Markov sobre variables ocultas es un sistema dinámico lineal , con una relación lineal entre variables relacionadas y donde todas las variables ocultas y observadas siguen una distribución gaussiana . En casos simples, como el sistema dinámico lineal que acabamos de mencionar, la inferencia exacta es manejable (en este caso, usando el filtro de Kalman ); sin embargo, en general, la inferencia exacta en HMM con variables latentes continuas no es factible y se deben utilizar métodos aproximados, como el filtro de Kalman extendido o el filtro de partículas .

Hoy en día, la inferencia en modelos ocultos de Markov se realiza en entornos no paramétricos , donde la estructura de dependencia permite la identificabilidad del modelo [40] y los límites de capacidad de aprendizaje aún están bajo exploración. [41]

Los modelos ocultos de Markov son modelos generativos , en los que se modela la distribución conjunta de observaciones y estados ocultos, o de manera equivalente, tanto la distribución previa de estados ocultos (las probabilidades de transición ) como la distribución condicional de observaciones de estados dados (las probabilidades de emisión ). Los algoritmos anteriores suponen implícitamente una distribución previa uniforme sobre las probabilidades de transición. Sin embargo, también es posible crear modelos de Markov ocultos con otros tipos de distribuciones previas. Un candidato obvio, dada la distribución categórica de las probabilidades de transición, es la distribución de Dirichlet , que es la distribución previa conjugada de la distribución categórica. Normalmente, se elige una distribución simétrica de Dirichlet, lo que refleja ignorancia sobre qué estados son inherentemente más probables que otros. El único parámetro de esta distribución (denominado parámetro de concentración ) controla la densidad relativa o escasez de la matriz de transición resultante. Una elección de 1 produce una distribución uniforme. Los valores mayores que 1 producen una matriz densa, en la que las probabilidades de transición entre pares de estados probablemente sean casi iguales. Los valores inferiores a 1 dan como resultado una matriz dispersa en la que, para cada estado de origen dado, sólo un pequeño número de estados de destino tienen probabilidades de transición no despreciables. También es posible utilizar una distribución de Dirichlet previa de dos niveles, en la que una distribución de Dirichlet (la distribución superior) gobierna los parámetros de otra distribución de Dirichlet (la distribución inferior), que a su vez gobierna las probabilidades de transición. La distribución superior gobierna la distribución general de los estados, determinando la probabilidad de que ocurra cada estado; su parámetro de concentración determina la densidad o escasez de estados. Una distribución previa de dos niveles de este tipo, donde ambos parámetros de concentración se configuran para producir distribuciones dispersas, podría ser útil, por ejemplo, en el etiquetado de partes del discurso no supervisado , donde algunas partes del discurso ocurren mucho más comúnmente que otras; Los algoritmos de aprendizaje que asumen una distribución previa uniforme generalmente funcionan mal en esta tarea. Los parámetros de modelos de este tipo, con distribuciones previas no uniformes, se pueden aprender utilizando el muestreo de Gibbs o versiones extendidas del algoritmo de maximización de expectativas .

Una extensión de los modelos ocultos de Markov descritos anteriormente con antecedentes de Dirichlet utiliza un proceso de Dirichlet en lugar de una distribución de Dirichlet. Este tipo de modelo permite un número desconocido y potencialmente infinito de estados. Es común utilizar un proceso de Dirichlet de dos niveles, similar al modelo descrito anteriormente con dos niveles de distribuciones de Dirichlet. Este modelo se denomina modelo jerárquico de Markov oculto del proceso de Dirichlet , o HDP-HMM para abreviar. Originalmente se describió con el nombre de "Modelo Infinito Oculto de Markov" [42] y se formalizó aún más en "Procesos Jerárquicos de Dirichlet". [43]

Un tipo diferente de extensión utiliza un modelo discriminativo en lugar del modelo generativo de los HMM estándar. Este tipo de modelo modela directamente la distribución condicional de los estados ocultos dadas las observaciones, en lugar de modelar la distribución conjunta. Un ejemplo de este modelo es el llamado modelo de Markov de máxima entropía (MEMM), que modela la distribución condicional de los estados mediante regresión logística (también conocido como " modelo de máxima entropía "). La ventaja de este tipo de modelo es que se pueden modelar características arbitrarias (es decir, funciones) de las observaciones, lo que permite inyectar en el modelo conocimiento específico del dominio del problema en cuestión. Los modelos de este tipo no se limitan a modelar dependencias directas entre un estado oculto y su observación asociada; más bien, en el proceso utilizado para determinar el valor de un estado oculto se pueden incluir características de observaciones cercanas, de combinaciones de la observación asociada y observaciones cercanas, o de hecho de observaciones arbitrarias a cualquier distancia de un estado oculto determinado. Además, no es necesario que estas características sean estadísticamente independientes entre sí, como sería el caso si se utilizaran en un modelo generativo. Finalmente, se pueden utilizar características arbitrarias sobre pares de estados ocultos adyacentes en lugar de simples probabilidades de transición. Las desventajas de tales modelos son: (1) Los tipos de distribuciones previas que se pueden colocar en estados ocultos son muy limitados; (2) No es posible predecir la probabilidad de ver una observación arbitraria. Esta segunda limitación no suele ser un problema en la práctica, ya que muchos usos comunes de los HMM no requieren tales probabilidades predictivas.

Una variante del modelo discriminativo descrito anteriormente es el campo aleatorio condicional de cadena lineal . Esto utiliza un modelo gráfico no dirigido (también conocido como campo aleatorio de Markov ) en lugar de los modelos gráficos dirigidos de MEMM y modelos similares. La ventaja de este tipo de modelo es que no sufre el llamado problema de sesgo de etiqueta de los MEMM y, por lo tanto, puede realizar predicciones más precisas. La desventaja es que el entrenamiento puede ser más lento que el de MEMM.

Otra variante más es el modelo factorial oculto de Markov , que permite condicionar una sola observación a las correspondientes variables ocultas de un conjunto de cadenas de Markov independientes, en lugar de una sola cadena de Markov. Es equivalente a un único HMM, con estados (suponiendo que haya estados para cada cadena) y, por lo tanto, aprender en un modelo de este tipo es difícil: para una secuencia de longitud , un algoritmo de Viterbi sencillo tiene complejidad . Para encontrar una solución exacta, se podría utilizar un algoritmo de árbol de unión, pero resulta complejo . En la práctica, podrían utilizarse técnicas aproximadas, como los enfoques variacionales. [44]

Todos los modelos anteriores se pueden ampliar para permitir dependencias más distantes entre estados ocultos, por ejemplo, permitir que un estado determinado dependa de los dos o tres estados anteriores en lugar de un solo estado anterior; es decir, las probabilidades de transición se amplían para abarcar conjuntos de tres o cuatro estados adyacentes (o, en general, estados adyacentes). La desventaja de tales modelos es que los algoritmos de programación dinámica para entrenarlos tienen un tiempo de ejecución, para estados adyacentes y observaciones totales (es decir, una cadena de longitud de Markov). Esta extensión ha sido ampliamente utilizada en bioinformática , en el modelado de secuencias de ADN .

Otra extensión reciente es el modelo triplete de Markov , [45] en el que se agrega un proceso subyacente auxiliar para modelar algunas especificidades de los datos. Se han propuesto muchas variantes de este modelo. También cabe mencionar el interesante vínculo que se ha establecido entre la teoría de la evidencia y los modelos tripletes de Markov [46] y que permite fusionar datos en el contexto markoviano [47] y modelar datos no estacionarios. [48] [49] Tenga en cuenta que en la literatura reciente también se han propuesto estrategias alternativas de fusión de datos de múltiples flujos, por ejemplo, [50]

Finalmente, en 2012 se sugirió una lógica diferente para abordar el problema de modelar datos no estacionarios mediante modelos ocultos de Markov. [51] Consiste en emplear una pequeña red neuronal recurrente (RNN), específicamente una red de reservorio, [52] para capturar la evolución de la dinámica temporal en los datos observados. Esta información, codificada en forma de un vector de alta dimensión, se utiliza como variable condicionante de las probabilidades de transición de estado del HMM. Bajo tal configuración, eventualmente obtenemos un HMM no estacionario cuyas probabilidades de transición evolucionan con el tiempo de una manera que se infiere de los datos mismos, en contraposición a algún modelo ad-hoc poco realista de evolución temporal.

En 2023, se introdujeron dos algoritmos innovadores para el modelo oculto de Markov. Estos algoritmos permiten el cálculo de la distribución posterior del HMM sin la necesidad de modelar explícitamente la distribución conjunta, utilizando únicamente las distribuciones condicionales. [53] [54] A diferencia de los métodos tradicionales como los algoritmos Forward-Backward y Viterbi, que requieren conocimiento de la ley conjunta del HMM y su aprendizaje puede ser intensivo desde el punto de vista computacional, los algoritmos Discriminativo Forward-Backward y Discriminativo Viterbi evitan la necesidad de la ley de la observación. [55] [56] Este avance permite que el HMM se aplique como un modelo discriminativo, ofreciendo un enfoque más eficiente y versátil para aprovechar los modelos ocultos de Markov en diversas aplicaciones.

El modelo adecuado en el contexto de datos longitudinales se denomina modelo latente de Markov. [57] La versión básica de este modelo se ha ampliado para incluir covariables individuales, efectos aleatorios y modelar estructuras de datos más complejas, como datos multinivel. En [58] se proporciona una descripción completa de los modelos latentes de Markov, con especial atención a los supuestos del modelo y a su uso práctico.

Dada una matriz de transición de Markov y una distribución invariante de los estados, podemos imponer una medida de probabilidad al conjunto de subdesplazamientos. Por ejemplo, considere la cadena de Markov dada a la izquierda de los estados , con distribución invariante . Si "olvidamos" la distinción entre , proyectamos este espacio de subdesplazamientos en otro espacio de subdesplazamientos en , y esta proyección también proyecta la medida de probabilidad hasta una medida de probabilidad en los subdesplazamientos en .

Lo curioso es que la medida de probabilidad de los subturnos de no es creada por una cadena de Markov de , ni siquiera de órdenes múltiples. Intuitivamente, esto se debe a que si uno observa una secuencia larga de , entonces estaría cada vez más seguro de que , lo que significa que la parte observable del sistema puede verse afectada infinitamente por algo en el pasado. [59] [60]

Por el contrario, existe un espacio de subdesplazamientos en 6 símbolos, proyectados a subdesplazamientos en 2 símbolos, de modo que cualquier medida de Markov en el subdesplazamiento más pequeño tiene una medida de preimagen que no es Markov de ningún orden (Ejemplo 2.6 [60] ).