La semántica distribucional [1] es un área de investigación que desarrolla y estudia teorías y métodos para cuantificar y categorizar similitudes semánticas entre elementos lingüísticos en función de sus propiedades distribucionales en grandes muestras de datos lingüísticos. La idea básica de la semántica distribucional se puede resumir en la denominada hipótesis distribucional : los elementos lingüísticos con distribuciones similares tienen significados similares.

La hipótesis distribucional en lingüística se deriva de la teoría semántica del uso del lenguaje, es decir, las palabras que se usan y aparecen en los mismos contextos tienden a tener significados similares. [2]

La idea subyacente de que "una palabra se caracteriza por la compañía que mantiene" fue popularizada por Firth en la década de 1950. [3]

La hipótesis distributiva es la base de la semántica estadística . Aunque la hipótesis distributiva se originó en la lingüística, [4] ahora está recibiendo atención en la ciencia cognitiva, especialmente en lo que respecta al contexto del uso de las palabras. [5]

En los últimos años, la hipótesis distribucional ha proporcionado la base para la teoría de la generalización basada en la similitud en el aprendizaje de idiomas: la idea de que los niños pueden descubrir cómo usar palabras que rara vez han encontrado antes generalizando sobre su uso a partir de distribuciones de palabras similares. [6] [7]

La hipótesis distribucional sugiere que cuanto más similares sean semánticamente dos palabras, más similares distributivamente serán a su vez y, por lo tanto, más tenderán a aparecer en contextos lingüísticos similares.

El hecho de que esta sugerencia sea válida o no tiene implicancias significativas tanto para el problema de escasez de datos en el modelado computacional [8] como para la cuestión de cómo los niños son capaces de aprender el lenguaje tan rápidamente dado un input relativamente pobre (esto también se conoce como el problema de la pobreza del estímulo ).

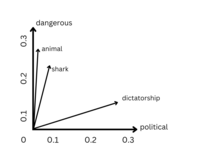

La semántica distribucional favorece el uso del álgebra lineal como herramienta computacional y marco de representación. El enfoque básico es recolectar información distribucional en vectores de alta dimensión y definir la similitud distribucional/semántica en términos de similitud vectorial. [9] Se pueden extraer diferentes tipos de similitudes según el tipo de información distribucional que se use para recolectar los vectores: las similitudes temáticas se pueden extraer al completar los vectores con información sobre en qué regiones del texto aparecen los elementos lingüísticos; las similitudes paradigmáticas se pueden extraer al completar los vectores con información sobre con qué otros elementos lingüísticos aparecen los elementos. Nótese que el último tipo de vectores también se puede usar para extraer similitudes sintagmáticas al observar los componentes individuales del vector.

La idea básica de una correlación entre la similitud distributiva y semántica se puede operacionalizar de muchas maneras diferentes. Existe una rica variedad de modelos computacionales que implementan la semántica distributiva, incluido el análisis semántico latente (LSA), [10] [11] el hiperespacio análogo al lenguaje (HAL), los modelos basados en sintaxis o dependencias, [12] la indexación aleatoria , el plegado semántico [13] y varias variantes del modelo de tópicos . [14]

Los modelos semánticos distribucionales difieren principalmente con respecto a los siguientes parámetros:

Los modelos semánticos distributivos que utilizan elementos lingüísticos como contexto también se han denominado modelos de espacio de palabras o de espacio vectorial . [16] [17]

Aunque la semántica distribucional se ha aplicado típicamente a elementos léxicos (palabras y términos de varias palabras) con un éxito considerable, sobre todo debido a su aplicabilidad como capa de entrada para modelos de aprendizaje profundo inspirados en las neuronas, la semántica léxica , es decir, el significado de las palabras, solo transportará parte de la semántica de un enunciado completo. El significado de una cláusula, por ejemplo, "Los tigres aman a los conejos" , solo se puede entender parcialmente al examinar el significado de los tres elementos léxicos que la componen. La semántica distribucional se puede extender directamente para cubrir elementos lingüísticos más grandes, como construcciones, con y sin elementos no instanciados, pero algunas de las suposiciones básicas del modelo deben ajustarse un poco. La gramática de construcción y su formulación del continuo léxico-sintáctico ofrece un enfoque para incluir construcciones más elaboradas en un modelo semántico distribucional y se han implementado algunos experimentos utilizando el enfoque de indexación aleatoria. [18]

Los modelos semánticos distribucionales compositivos extienden los modelos semánticos distributivos mediante funciones semánticas explícitas que utilizan reglas basadas en la sintaxis para combinar la semántica de las unidades léxicas participantes en un modelo compositivo para caracterizar la semántica de frases u oraciones completas. Este trabajo fue propuesto originalmente por Stephen Clark, Bob Coecke y Mehrnoosh Sadrzadeh de la Universidad de Oxford en su artículo de 2008, "A Compositional Distributional Model of Meaning" (Un modelo distribucional compositivo del significado). [19] Se han explorado diferentes enfoques de la composición (incluidos los modelos neuronales) y se están debatiendo en talleres establecidos como SemEval . [20]

Los modelos semánticos distribucionales se han aplicado con éxito a las siguientes tareas: