La teoría de la resonancia adaptativa ( ART ) es una teoría desarrollada por Stephen Grossberg y Gail Carpenter sobre aspectos de cómo el cerebro procesa la información . Describe una serie de modelos de redes neuronales artificiales que utilizan métodos de aprendizaje supervisados y no supervisados y abordan problemas como el reconocimiento y la predicción de patrones.

La intuición principal detrás del modelo ART es que la identificación y el reconocimiento de objetos generalmente ocurren como resultado de la interacción de las expectativas del observador "de arriba hacia abajo" con la información sensorial "de abajo hacia arriba" . El modelo postula que las expectativas "de arriba hacia abajo" toman la forma de una plantilla de memoria o prototipo que luego se compara con las características reales de un objeto detectadas por los sentidos. Esta comparación da lugar a una medida de pertenencia a una categoría. Siempre que esta diferencia entre sensación y expectativa no exceda un umbral establecido llamado "parámetro de vigilancia", el objeto detectado se considerará miembro de la clase esperada. El sistema ofrece así una solución al problema de la "plasticidad/estabilidad", es decir, el problema de adquirir nuevos conocimientos sin alterar los conocimientos existentes, lo que también se denomina aprendizaje incremental .

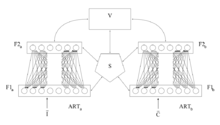

El sistema ART básico es un modelo de aprendizaje no supervisado . Normalmente consta de un campo de comparación y un campo de reconocimiento compuesto por neuronas , un parámetro de vigilancia (umbral de reconocimiento) y un módulo de reinicio .

Existen dos métodos básicos para entrenar redes neuronales basadas en ART: lento y rápido. En el método de aprendizaje lento, el grado de entrenamiento de los pesos de la neurona de reconocimiento hacia el vector de entrada se calcula en valores continuos con ecuaciones diferenciales y, por lo tanto, depende del período de tiempo que se presenta el vector de entrada. Con un aprendizaje rápido, se utilizan ecuaciones algebraicas para calcular el grado de ajustes de peso que se deben realizar y se utilizan valores binarios. Si bien el aprendizaje rápido es efectivo y eficiente para una variedad de tareas, el método de aprendizaje lento es biológicamente más plausible y puede usarse con redes de tiempo continuo (es decir, cuando el vector de entrada puede variar continuamente).

ART 1 [1] [2] es la variedad más simple de redes ART y acepta solo entradas binarias. ART 2 [3] amplía las capacidades de la red para admitir entradas continuas. ART 2-A [4] es una forma simplificada de ART-2 con un tiempo de ejecución drásticamente acelerado y con resultados cualitativos que rara vez son inferiores a la implementación completa de ART-2. ART 3 [5] se basa en ART-2 al simular la regulación rudimentaria de neurotransmisores de la actividad sináptica mediante la incorporación de concentraciones simuladas de iones de sodio (Na+) y calcio (Ca2+) en las ecuaciones del sistema, lo que resulta en un medio fisiológicamente más realista de inhibir parcialmente categorías que desencadenar restablecimientos de discrepancia.

ARTMAP [6], también conocido como ART predictivo , combina dos unidades ART-1 o ART-2 ligeramente modificadas en una estructura de aprendizaje supervisado donde la primera unidad toma los datos de entrada y la segunda unidad toma los datos de salida correctos, luego se usa para hacer el Ajuste mínimo posible del parámetro de vigilancia en la primera unidad para realizar la clasificación correcta.

Fuzzy ART [7] implementa lógica difusa en el reconocimiento de patrones de ART, mejorando así la generalización. Una característica opcional (y muy útil) del ART difuso es la codificación complementaria, un medio para incorporar la ausencia de características en las clasificaciones de patrones, lo que contribuye en gran medida a prevenir la proliferación de categorías ineficiente e innecesaria. Las medidas de similitud aplicadas se basan en la norma L1 . Se sabe que Fuzzy ART es muy sensible al ruido.

Fuzzy ARTMAP [8] es simplemente ARTMAP que utiliza unidades ART difusas, lo que da como resultado un aumento correspondiente en la eficacia.

Simplified Fuzzy ARTMAP (SFAM) [9] constituye una variante fuertemente simplificada de difusa ARTMAP dedicada a tareas de clasificación .

ART gaussiano [10] y ARTMAP gaussiano [10] utilizan funciones de activación gaussianas y cálculos basados en la teoría de la probabilidad. Por tanto, tienen cierta similitud con los modelos de mezcla gaussiana . En comparación con el ART difuso y el ARTMAP difuso, son menos sensibles al ruido. Pero la estabilidad de las representaciones aprendidas se reduce, lo que puede conducir a una proliferación de categorías en tareas de aprendizaje abiertas.

Fusion ART y redes relacionadas [11] [12] [13] extienden ART y ARTMAP a múltiples canales de patrones. Apoyan varios paradigmas de aprendizaje, incluido el aprendizaje no supervisado, el aprendizaje supervisado y el aprendizaje por refuerzo.

TopoART [14] combina ART difuso con redes de aprendizaje de topología como el gas neuronal en crecimiento . Además, añade un mecanismo de reducción de ruido. Existen varias redes neuronales derivadas que extienden TopoART a paradigmas de aprendizaje adicionales.

Hypersphere ART [15] y Hypersphere ARTMAP [15] están estrechamente relacionados con ART difuso y ARTMAP difuso, respectivamente. Pero como utilizan un tipo diferente de representación de categorías (es decir, hiperesferas), no requieren que su entrada esté normalizada al intervalo [0, 1]. Aplican medidas de similitud basadas en la norma L2 .

LAPART [16] Las redes neuronales de la teoría de resonancia adaptativa con cebado lateral (LAPART) combinan dos algoritmos Fuzzy ART para crear un mecanismo para hacer predicciones basadas en asociaciones aprendidas. El acoplamiento de los dos Fuzzy ART tiene una estabilidad única que permite que el sistema converja rápidamente hacia una solución clara. Además, puede realizar inferencias lógicas y aprendizaje supervisado similar al ARTMAP difuso.

Se ha observado que los resultados de Fuzzy ART y ART 1 (es decir, las categorías aprendidas) dependen críticamente del orden en que se procesan los datos de entrenamiento. El efecto se puede reducir hasta cierto punto utilizando una tasa de aprendizaje más lenta, pero está presente independientemente del tamaño del conjunto de datos de entrada. Por lo tanto, las estimaciones difusas de ART y ART 1 no poseen la propiedad estadística de coherencia . [17] Este problema puede considerarse como un efecto secundario de los respectivos mecanismos que garantizan el aprendizaje estable en ambas redes.

Las redes ART más avanzadas, como TopoART e Hypersphere TopoART, que resumen categorías en grupos, pueden resolver este problema ya que las formas de los grupos no dependen del orden de creación de las categorías asociadas. (cf. Fig. 3(g, h) y Fig. 4 de [18] )

Wasserman, Philip D. (1989), Computación neuronal: teoría y práctica, Nueva York: Van Nostrand Reinhold, ISBN 0-442-20743-3