En el modelado matemático, el sobreajuste es "la producción de un análisis que corresponde demasiado cercana o exactamente a un conjunto particular de datos y, por lo tanto, puede no ajustarse a datos adicionales ni predecir observaciones futuras de manera confiable". [1] Un modelo sobreajustado es un modelo matemático que contiene más parámetros de los que los datos pueden justificar. [2] En un sentido matemático, estos parámetros representan el grado de un polinomio . La esencia del sobreajuste es haber extraído, sin saberlo, parte de la variación residual (es decir, el ruido ) como si esa variación representara la estructura subyacente del modelo. [3] : 45

El desajuste ocurre cuando un modelo matemático no puede capturar adecuadamente la estructura subyacente de los datos. Un modelo insuficientemente ajustado es un modelo en el que faltan algunos parámetros o términos que aparecerían en un modelo correctamente especificado. [2] Se produciría un desajuste, por ejemplo, al ajustar un modelo lineal a datos no lineales. Un modelo de este tipo tenderá a tener un rendimiento predictivo deficiente.

La posibilidad de sobreajuste existe porque el criterio utilizado para seleccionar el modelo no es el mismo que el criterio utilizado para juzgar la idoneidad de un modelo. Por ejemplo, un modelo podría seleccionarse maximizando su rendimiento en algún conjunto de datos de entrenamiento y, sin embargo, su idoneidad podría estar determinada por su capacidad para funcionar bien con datos invisibles; El sobreajuste ocurre cuando un modelo comienza a "memorizar" datos de entrenamiento en lugar de "aprender" a generalizar a partir de una tendencia.

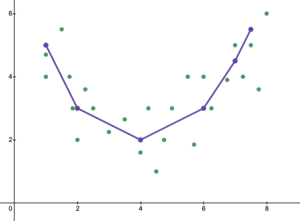

Como ejemplo extremo, si el número de parámetros es igual o mayor que el número de observaciones, entonces un modelo puede predecir perfectamente los datos de entrenamiento simplemente memorizando los datos en su totalidad. (Para ver una ilustración, consulte la Figura 2.) Sin embargo, un modelo de este tipo normalmente fallará gravemente al hacer predicciones.

El sobreajuste está directamente relacionado con el error de aproximación de la clase de función seleccionada y el error de optimización del procedimiento de optimización. Es probable que una clase de función que sea demasiado grande, en un sentido adecuado, en relación con el tamaño del conjunto de datos, se sobreajuste. [4] Incluso cuando el modelo ajustado no tiene un número excesivo de parámetros, es de esperar que la relación ajustada parezca funcionar peor en un nuevo conjunto de datos que en el conjunto de datos utilizado para el ajuste (un fenómeno a veces conocido como contracción) . ). [2] En particular, el valor del coeficiente de determinación se reducirá en relación con los datos originales.

Para disminuir la posibilidad o la cantidad de sobreajuste, hay varias técnicas disponibles (p. ej., comparación de modelos , validación cruzada , regularización , detención temprana , poda , antecedentes bayesianos o abandono ). La base de algunas técnicas es (1) penalizar explícitamente los modelos demasiado complejos o (2) probar la capacidad del modelo para generalizar evaluando su desempeño en un conjunto de datos que no se utilizan para el entrenamiento, que se supone que se aproxima a los datos típicos no vistos que encontrará un modelo.

En estadística, se extrae una inferencia a partir de un modelo estadístico , que ha sido seleccionado mediante algún procedimiento. Burnham y Anderson, en su muy citado texto sobre selección de modelos, sostienen que para evitar el sobreajuste, debemos adherirnos al " Principio de parsimonia ". [3] Los autores también afirman lo siguiente. [3] : 32–33

Los modelos sobreajustados... a menudo están libres de sesgo en los estimadores de parámetros, pero tienen varianzas de muestreo estimadas (y reales) que son innecesariamente grandes (la precisión de los estimadores es pobre, en relación con lo que se podría haber logrado con un modelo más parsimonioso). . Se tienden a identificar efectos falsos del tratamiento y se incluyen variables falsas en modelos sobreajustados. ... Un modelo de mejor aproximación se logra equilibrando adecuadamente los errores de subajuste y sobreajuste.

Es más probable que el sobreajuste sea una preocupación seria cuando hay poca teoría disponible para guiar el análisis, en parte porque entonces tiende a haber una gran cantidad de modelos para seleccionar. El libro Model Selection and Model Averaging (2008) lo expresa de esta manera. [5]

Dado un conjunto de datos, puedes incluir miles de modelos con solo presionar un botón, pero ¿cómo eliges el mejor? Con tantos modelos candidatos, el sobreajuste es un peligro real. ¿El mono que escribió Hamlet es realmente un buen escritor?

En el análisis de regresión , el sobreajuste ocurre con frecuencia. [6] Como ejemplo extremo, si hay p variables en una regresión lineal con p puntos de datos, la línea ajustada puede pasar exactamente por cada punto. [7] Para los modelos de regresión logística o de riesgos proporcionales de Cox , existe una variedad de reglas generales (por ejemplo, 5–9, [8] 10 [9] y 10–15 [10] ; la pauta de 10 observaciones por variable independiente es conocida como la " regla del uno entre diez "). En el proceso de selección del modelo de regresión, el error cuadrático medio de la función de regresión aleatoria se puede dividir en ruido aleatorio, sesgo de aproximación y varianza en la estimación de la función de regresión. El equilibrio entre sesgo y varianza se utiliza a menudo para superar los modelos de sobreajuste.

Con un gran conjunto de variables explicativas que en realidad no tienen relación con la variable dependiente que se predice, en general se considerará falsamente que algunas variables son estadísticamente significativas y, por lo tanto, el investigador puede retenerlas en el modelo, sobreajustando así el modelo. Esto se conoce como la paradoja de Freedman .

Por lo general, un algoritmo de aprendizaje se entrena utilizando algún conjunto de "datos de entrenamiento": situaciones ejemplares para las cuales se conoce el resultado deseado. El objetivo es que el algoritmo también funcione bien en la predicción de la salida cuando se le proporcionen "datos de validación" que no se encontraron durante su entrenamiento.

El sobreajuste es el uso de modelos o procedimientos que violan la navaja de Occam , por ejemplo al incluir más parámetros ajustables de los que en última instancia son óptimos, o al utilizar un enfoque más complicado de lo que en última instancia es óptimo. Como ejemplo en el que hay demasiados parámetros ajustables, considere un conjunto de datos donde los datos de entrenamiento para y se pueden predecir adecuadamente mediante una función lineal de dos variables independientes. Una función de este tipo requiere sólo tres parámetros (la intersección y dos pendientes). Reemplazar esta función simple con una función cuadrática nueva y más compleja, o con una función lineal nueva y más compleja sobre más de dos variables independientes, conlleva un riesgo: la navaja de Occam implica que cualquier función compleja dada es a priori menos probable que cualquier función simple dada. función. Si se selecciona la función nueva y más complicada en lugar de la función simple, y si no hubo una ganancia lo suficientemente grande en el ajuste de los datos de entrenamiento para compensar el aumento de la complejidad, entonces la nueva función compleja "sobreajusta" los datos y la función compleja sobreajustada probablemente funcione peor que la función más simple en datos de validación fuera del conjunto de datos de entrenamiento, aunque la función compleja se desempeñó igual, o tal vez incluso mejor, en el conjunto de datos de entrenamiento. [11]

Al comparar diferentes tipos de modelos, la complejidad no se puede medir únicamente contando cuántos parámetros existen en cada modelo; También se debe considerar la expresividad de cada parámetro. Por ejemplo, no es trivial comparar directamente la complejidad de una red neuronal (que puede rastrear relaciones curvilíneas) con m parámetros con un modelo de regresión con n parámetros. [11]

El sobreajuste es especialmente probable en los casos en los que el aprendizaje se realizó durante demasiado tiempo o donde los ejemplos de entrenamiento son raros, lo que hace que el alumno se ajuste a características aleatorias muy específicas de los datos de entrenamiento que no tienen una relación causal con la función objetivo . En este proceso de sobreajuste, el rendimiento de los ejemplos de entrenamiento sigue aumentando, mientras que el rendimiento de los datos invisibles empeora.

Como ejemplo sencillo, consideremos una base de datos de compras minoristas que incluye el artículo comprado, el comprador y la fecha y hora de la compra. Es fácil construir un modelo que se ajuste perfectamente al conjunto de entrenamiento utilizando la fecha y hora de compra para predecir los otros atributos, pero este modelo no se generalizará en absoluto a nuevos datos porque esos tiempos pasados nunca volverán a ocurrir.

Generalmente, se dice que un algoritmo de aprendizaje se sobreajusta en relación con uno más simple si es más preciso al ajustar datos conocidos (retrospectiva) pero menos preciso al predecir datos nuevos (previsión). Se puede entender intuitivamente el sobreajuste por el hecho de que la información de toda experiencia pasada se puede dividir en dos grupos: información relevante para el futuro e información irrelevante ("ruido"). En igualdad de condiciones, cuanto más difícil es predecir un criterio (es decir, cuanto mayor es su incertidumbre), más ruido existe en la información pasada que debe ignorarse. El problema es determinar qué parte ignorar. Un algoritmo de aprendizaje que puede reducir el riesgo de ruido de ajuste se denomina " robusto ".

La consecuencia más obvia del sobreajuste es un rendimiento deficiente en el conjunto de datos de validación. Otras consecuencias negativas incluyen:

La función óptima normalmente necesita verificación en conjuntos de datos más grandes o completamente nuevos. Sin embargo, existen métodos como el árbol de expansión mínimo o el tiempo de vida de la correlación que aplica la dependencia entre los coeficientes de correlación y las series de tiempo (ancho de ventana). Siempre que el ancho de la ventana es lo suficientemente grande, los coeficientes de correlación son estables y ya no dependen del tamaño del ancho de la ventana. Por lo tanto, se puede crear una matriz de correlación calculando un coeficiente de correlación entre las variables investigadas. Esta matriz se puede representar topológicamente como una red compleja donde se visualizan influencias directas e indirectas entre variables. La regularización de abandono también puede mejorar la solidez y, por lo tanto, reducir el sobreajuste al eliminar probabilísticamente las entradas a una capa.

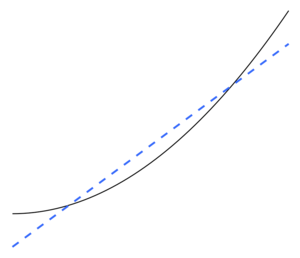

El subajuste es lo opuesto al sobreajuste, lo que significa que el modelo estadístico o el algoritmo de aprendizaje automático es demasiado simplista para capturar con precisión los patrones en los datos. Una señal de desajuste es que se detecta un alto sesgo y una baja varianza en el modelo o algoritmo actual utilizado (lo inverso del sobreajuste: bajo sesgo y alta varianza ). Esto se puede deducir del equilibrio entre sesgo y varianza , que es el método para analizar un modelo o algoritmo en busca de error de sesgo, error de varianza y error irreducible. Con un sesgo alto y una varianza baja, el resultado del modelo es que representará de manera inexacta los puntos de datos y, por lo tanto, no podrá predecir de manera suficiente los resultados de datos futuros (consulte Error de generalización ). Como se muestra en la Figura 5, la línea lineal no pudo representar todos los puntos de datos dados debido a que la línea no se parece a la curvatura de los puntos. Esperaríamos ver una línea en forma de parábola como se muestra en la Figura 6 y la Figura 1. Si usáramos la Figura 5 para el análisis, obtendríamos resultados predictivos falsos contrarios a los resultados si analizáramos la Figura 6.

Burnham y Anderson afirman lo siguiente. [3] : 32

... un modelo insuficientemente ajustado ignoraría alguna estructura importante replicable (es decir, conceptualmente replicable en la mayoría de las otras muestras) en los datos y, por lo tanto, no identificaría efectos que realmente estuvieran respaldados por los datos. En este caso, el sesgo en los estimadores de parámetros suele ser sustancial y la varianza muestral se subestima; ambos factores dan como resultado una cobertura deficiente del intervalo de confianza. Los modelos insuficientemente ajustados tienden a pasar por alto efectos importantes del tratamiento en entornos experimentales.

Hay varias formas de abordar el desajuste:

El sobreajuste benigno describe el fenómeno de un modelo estadístico que parece generalizarse bien a datos no vistos, incluso cuando se ha ajustado perfectamente a datos de entrenamiento ruidosos (es decir, obtiene una precisión predictiva perfecta en el conjunto de entrenamiento). El fenómeno es de particular interés en las redes neuronales profundas , pero se estudia desde una perspectiva teórica en el contexto de modelos mucho más simples, como la regresión lineal . En particular, se ha demostrado que la sobreparametrización es esencial para un sobreajuste benigno en este entorno. En otras palabras, el número de direcciones en el espacio de parámetros que no son importantes para la predicción debe exceder significativamente el tamaño de la muestra. [dieciséis]