En estadística , la transformación de datos es la aplicación de una función matemática determinista a cada punto de un conjunto de datos , es decir, cada punto de datos z i se reemplaza con el valor transformado y i = f ( z i ), donde f es una función. Las transformaciones generalmente se aplican para que los datos parezcan cumplir más estrechamente con los supuestos de un procedimiento de inferencia estadística que se va a aplicar, o para mejorar la interpretabilidad o apariencia de los gráficos .

Casi siempre, la función que se utiliza para transformar los datos es invertible y generalmente es continua . La transformación generalmente se aplica a una colección de medidas comparables. Por ejemplo, si trabajamos con datos sobre los ingresos de las personas en alguna unidad monetaria , sería común transformar el valor del ingreso de cada persona mediante la función logarítmica .

La orientación sobre cómo se deben transformar los datos, o si se debe aplicar una transformación, debe provenir del análisis estadístico particular que se va a realizar. Por ejemplo, una forma sencilla de construir un intervalo de confianza aproximado del 95% para la media poblacional es tomar la media muestral más o menos dos unidades de error estándar . Sin embargo, el factor constante 2 utilizado aquí es particular de la distribución normal y solo es aplicable si la media muestral varía aproximadamente normalmente. El teorema del límite central establece que en muchas situaciones, la media muestral varía normalmente si el tamaño de la muestra es razonablemente grande. Sin embargo, si la población está sustancialmente sesgada y el tamaño de la muestra es, como mucho, moderado, la aproximación proporcionada por el teorema del límite central puede ser deficiente y el intervalo de confianza resultante probablemente tendrá una probabilidad de cobertura incorrecta . Por lo tanto, cuando hay evidencia de una asimetría sustancial en los datos, es común transformarlos a una distribución simétrica [1] antes de construir un intervalo de confianza. Si se desea, el intervalo de confianza para los cuantiles (como la mediana) se puede transformar nuevamente a la escala original utilizando la transformación inversa de la que se aplicó a los datos. [2] [3]

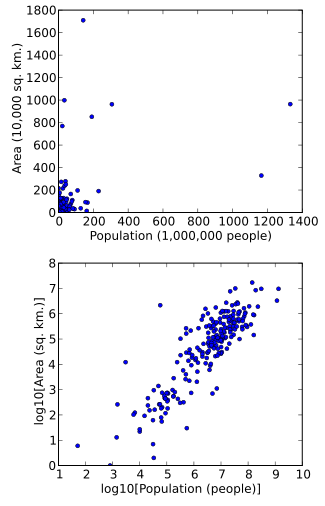

Los datos también se pueden transformar para que sean más fáciles de visualizar. Por ejemplo, supongamos que tenemos un diagrama de dispersión en el que los puntos son los países del mundo y los valores de los datos que se representan son la superficie terrestre y la población de cada país. Si el gráfico se realiza utilizando datos no transformados (por ejemplo, kilómetros cuadrados para el área y el número de personas para la población), la mayoría de los países se trazarían en grupos reducidos de puntos en la esquina inferior izquierda del gráfico. Los pocos países con áreas y/o poblaciones muy grandes estarían dispersos en la mayor parte del área del gráfico. Simplemente reescalar las unidades (por ejemplo, a miles de kilómetros cuadrados o a millones de personas) no cambiará esto. Sin embargo, después de transformaciones logarítmicas tanto del área como de la población, los puntos se distribuirán de manera más uniforme en el gráfico.

Otra razón para aplicar la transformación de datos es mejorar la interpretabilidad, incluso si no se va a realizar ningún análisis estadístico o visualización formal. Por ejemplo, supongamos que comparamos automóviles en términos de economía de combustible. Estos datos suelen presentarse como "kilómetros por litro" o "millas por galón". Sin embargo, si el objetivo es evaluar cuánto combustible adicional consumiría una persona en un año al conducir un automóvil en comparación con otro, es más natural trabajar con los datos transformados aplicando la función recíproca , obteniéndose litros por kilómetro o galones. por milla.

La transformación de datos se puede utilizar como medida correctiva para hacer que los datos sean adecuados para el modelado con regresión lineal si los datos originales violan uno o más supuestos de regresión lineal. [4] Por ejemplo, los modelos de regresión lineal más simples suponen una relación lineal entre el valor esperado de Y (la variable de respuesta que se va a predecir) y cada variable independiente (cuando las otras variables independientes se mantienen fijas). Si la linealidad no se cumple, ni siquiera aproximadamente, a veces es posible transformar las variables independientes o dependientes en el modelo de regresión para mejorar la linealidad. [5] Por ejemplo, la suma de funciones cuadráticas de las variables independientes originales puede conducir a una relación lineal con el valor esperado de Y, lo que da como resultado un modelo de regresión polinómica , un caso especial de regresión lineal.

Otro supuesto de la regresión lineal es la homocedasticidad , es decir, la varianza de los errores debe ser la misma independientemente de los valores de los predictores. Si se viola este supuesto (es decir, si los datos son heterocedásticos ), puede ser posible encontrar una transformación de Y sola, o transformaciones tanto de X (las variables predictoras ) como de Y , de manera que el supuesto de homocedasticidad (además de la linealidad supuesto) es válido para las variables transformadas [5] y, por lo tanto, se puede aplicar la regresión lineal a estas.

Otra aplicación más de la transformación de datos es abordar el problema de la falta de normalidad en términos de error. La normalidad univariada no es necesaria para que las estimaciones de mínimos cuadrados de los parámetros de regresión sean significativas (consulte el teorema de Gauss-Markov ). Sin embargo, los intervalos de confianza y las pruebas de hipótesis tendrán mejores propiedades estadísticas si las variables exhiben normalidad multivariada . Las transformaciones que estabilizan la varianza de los términos de error (es decir, aquellas que abordan la heteroscedaticidad) a menudo también ayudan a que los términos de error sean aproximadamente normales. [5] [6]

Ecuación:

Ecuación:

Ecuación:

Ecuación:

Los modelos lineales generalizados (GLM) proporcionan una generalización flexible de la regresión lineal ordinaria que permite variables de respuesta que tienen modelos de distribución de errores distintos de una distribución normal. Los GLM permiten que el modelo lineal se relacione con la variable de respuesta a través de una función de enlace y permiten que la magnitud de la varianza de cada medición sea función de su valor predicho. [8] [9]

La transformación de logaritmo y la transformación de raíz cuadrada se usan comúnmente para datos positivos, y la transformación inversa multiplicativa ( transformación recíproca ) se puede usar para datos distintos de cero. La transformación de potencia es una familia de transformaciones parametrizadas por un valor no negativo λ que incluye las transformaciones de logaritmo, raíz cuadrada e inversa multiplicativa como casos especiales. Para abordar la transformación de datos de manera sistemática, es posible utilizar técnicas de estimación estadística para estimar el parámetro λ en la transformación de potencia, identificando así la transformación que es aproximadamente la más apropiada en un entorno determinado. Dado que la familia de transformación de poder también incluye la transformación de identidad, este enfoque también puede indicar si sería mejor analizar los datos sin una transformación. En el análisis de regresión, este enfoque se conoce como transformación de Box-Cox .

La transformación recíproca, algunas transformaciones de potencia, como la transformación de Yeo-Johnson , y algunas otras transformaciones, como la aplicación del seno hiperbólico inverso , se pueden aplicar de manera significativa a datos que incluyen valores tanto positivos como negativos [10] (la transformación de potencia es invertible sobre todos los números reales si λ es un número entero impar). Sin embargo, cuando se observan valores tanto negativos como positivos, a veces es común comenzar sumando una constante a todos los valores, produciendo un conjunto de datos no negativos al que se puede aplicar cualquier transformación de potencia. [3]

Una situación común en la que se aplica una transformación de datos es cuando un valor de interés abarca varios órdenes de magnitud . Muchos fenómenos físicos y sociales exhiben ese comportamiento: ingresos, poblaciones de especies, tamaños de galaxias y volúmenes de lluvia, por nombrar algunos. Las transformadas de potencia, y en particular el logaritmo, a menudo se pueden utilizar para inducir simetría en dichos datos. A menudo se prefiere el logaritmo porque es fácil interpretar su resultado en términos de "cambios de veces".

El logaritmo también tiene un efecto útil sobre las razones. Si comparamos cantidades positivas X e Y usando la razón X / Y , entonces si X < Y , la razón está en el intervalo (0,1), mientras que si X > Y , la razón está en la media línea (1 ,∞), donde la proporción de 1 corresponde a la igualdad. En un análisis donde X e Y se tratan simétricamente, la relación logarítmica log( X / Y ) es cero en el caso de igualdad, y tiene la propiedad de que si X es K veces mayor que Y , la relación logarítmica es la equidistante de cero como en la situación donde Y es K veces mayor que X (las relaciones logarítmicas son log( K ) y −log( K ) en estas dos situaciones).

Si los valores están naturalmente restringidos a estar en el rango de 0 a 1, sin incluir los puntos finales, entonces una transformación logit puede ser apropiada: esto produce valores en el rango (−∞,∞).

1. No siempre es necesario o deseable transformar un conjunto de datos para que se parezca a una distribución normal. Sin embargo, si se desea simetría o normalidad, a menudo se pueden inducir mediante una de las transformaciones de potencia.

2. Una función de potencia lingüística se distribuye según la ley de Zipf-Mandelbrot . La distribución es extremadamente puntiaguda y leptocúrtica , esta es la razón por la que los investigadores tuvieron que dar la espalda a las estadísticas para resolver, por ejemplo, problemas de atribución de autoría . Sin embargo, el uso de la estadística gaussiana es perfectamente posible aplicando la transformación de datos. [11]

3. Para evaluar si se ha alcanzado la normalidad después de la transformación, se podrá utilizar cualquiera de las pruebas de normalidad estándar. Un enfoque gráfico suele ser más informativo que una prueba estadística formal y, por lo tanto, se utiliza comúnmente un gráfico de cuantiles normales para evaluar el ajuste de un conjunto de datos a una población normal. Alternativamente, también se han propuesto reglas generales basadas en la asimetría y la curtosis de la muestra. [12] [13]

Si observamos un conjunto de n valores X 1 , ..., X n sin vínculos (es decir, hay n valores distintos), podemos reemplazar X i con el valor transformado Y i = k , donde k se define de manera que X i es el k ésimo más grande entre todos los valores de X. Esto se llama transformación de rango , [14] y crea datos con un ajuste perfecto a una distribución uniforme . Este enfoque tiene un análogo poblacional .

Usando la transformada integral de probabilidad , si X es cualquier variable aleatoria y F es la función de distribución acumulativa de X , entonces, siempre que F sea invertible, la variable aleatoria U = F ( X ) sigue una distribución uniforme en el intervalo unitario [0 ,1].

De una distribución uniforme, podemos transformarnos a cualquier distribución con una función de distribución acumulativa invertible. Si G es una función de distribución acumulativa invertible y U es una variable aleatoria distribuida uniformemente, entonces la variable aleatoria G −1 ( U ) tiene G como función de distribución acumulativa.

Juntando los dos, si X es cualquier variable aleatoria, F es la función de distribución acumulativa invertible de X y G es una función de distribución acumulativa invertible, entonces la variable aleatoria G −1 ( F ( X )) tiene G como su función de distribución acumulativa .

Muchos tipos de datos estadísticos exhiben una " relación de varianza sobre la media", lo que significa que la variabilidad es diferente para valores de datos con diferentes valores esperados . Por ejemplo, al comparar diferentes poblaciones del mundo, la varianza del ingreso tiende a aumentar con el ingreso medio. Si consideramos una serie de unidades de área pequeñas (por ejemplo, condados de Estados Unidos) y obtenemos la media y la varianza de los ingresos dentro de cada condado, es común que los condados con ingresos medios más altos también tengan variaciones más altas.

Una transformación estabilizadora de la varianza tiene como objetivo eliminar una relación de varianza sobre la media, de modo que la varianza se vuelva constante en relación con la media. Ejemplos de transformaciones estabilizadoras de la varianza son la transformación de Fisher para el coeficiente de correlación muestral, la transformación de raíz cuadrada o transformada de Anscombe para datos de Poisson (datos de conteo), la transformación de Box-Cox para análisis de regresión y la transformación de raíz cuadrada arcoseno o transformación angular para proporciones ( datos binomiales ). Si bien se usa comúnmente para el análisis estadístico de datos proporcionales, la transformación de raíz cuadrada arcoseno no se recomienda porque la regresión logística o una transformación logit son más apropiadas para proporciones binomiales o no binomiales, respectivamente, especialmente debido a la disminución del error tipo II . [15] [3]

Las funciones univariadas se pueden aplicar puntualmente a datos multivariados para modificar sus distribuciones marginales. También es posible modificar algunos atributos de una distribución multivariada utilizando una transformación construida apropiadamente. Por ejemplo, cuando se trabaja con series temporales y otros tipos de datos secuenciales, es común diferenciar los datos para mejorar la estacionariedad . Si los datos generados por un vector aleatorio X se observan como vectores X i de observaciones con matriz de covarianza Σ, se puede utilizar una transformación lineal para descorrelacionar los datos. Para ello se utiliza la descomposición de Cholesky para expresar Σ = A A' . Entonces el vector transformado Y i = A −1 X i tiene la matriz identidad como matriz de covarianza.

{{cite book}}: CS1 maint: location missing publisher (link)