La exactitud y la precisión son dos medidas de error de observación .La precisión es qué tan cerca están un conjunto determinado de mediciones ( observaciones o lecturas) de su valor real , mientras que la precisión es qué tan cerca están las mediciones entre sí.

En otras palabras, la precisión es una descripción de errores aleatorios , una medida de variabilidad estadística . La precisión tiene dos definiciones:

En la primera definición, más común, de "exactitud" anterior, el concepto es independiente de "precisión", por lo que se puede decir que un conjunto particular de datos es exacto, preciso, ambos o ninguno.

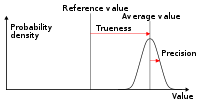

En términos más simples, dada una muestra estadística o un conjunto de puntos de datos de mediciones repetidas de la misma cantidad, se puede decir que la muestra o el conjunto es exacto si su promedio está cerca del valor real de la cantidad que se está midiendo, mientras que el conjunto puede Se puede decir que son precisos si su desviación estándar es relativamente pequeña.

En los campos de la ciencia y la ingeniería , la precisión de un sistema de medición es el grado de cercanía de las mediciones de una cantidad al valor verdadero de esa cantidad . [2] La precisión de un sistema de medición, relacionada con la reproducibilidad y la repetibilidad , es el grado en que mediciones repetidas bajo condiciones sin cambios muestran los mismos resultados . [2] [3] Aunque las dos palabras precisión y exactitud pueden ser sinónimas en el uso coloquial , se contrastan deliberadamente en el contexto del método científico .

El campo de la estadística , donde la interpretación de las mediciones juega un papel central, prefiere utilizar los términos sesgo y variabilidad en lugar de exactitud y precisión: sesgo es la cantidad de inexactitud y variabilidad es la cantidad de imprecisión.

Un sistema de medición puede ser exacto pero no preciso, preciso pero no exacto, ninguno de los dos o ambos. Por ejemplo, si un experimento contiene un error sistemático , aumentar el tamaño de la muestra generalmente aumenta la precisión pero no mejora la exactitud. El resultado sería una serie consistente pero inexacta de resultados del experimento defectuoso. Eliminar el error sistemático mejora la precisión pero no cambia la precisión.

Un sistema de medición se considera válido si es exacto y preciso . Los términos relacionados incluyen sesgo (efectos no aleatorios o dirigidos causados por un factor o factores no relacionados con la variable independiente ) y error (variabilidad aleatoria).

La terminología también se aplica a mediciones indirectas, es decir, valores obtenidos mediante un procedimiento computacional a partir de datos observados.

Además de la exactitud y la precisión, las mediciones también pueden tener una resolución de medición , que es el cambio más pequeño en la cantidad física subyacente que produce una respuesta en la medición.

En análisis numérico , precisión es también la cercanía de un cálculo al valor verdadero; mientras que la precisión es la resolución de la representación, generalmente definida por el número de dígitos decimales o binarios.

En términos militares, la precisión se refiere principalmente a la precisión del fuego ( justesse de tir ), la precisión del fuego expresada por la cercanía de un grupo de disparos en el centro del objetivo y alrededor de él. [4]

En instrumentación industrial, la precisión es la tolerancia de medición o transmisión del instrumento y define los límites de los errores cometidos cuando el instrumento se utiliza en condiciones normales de funcionamiento. [5]

Lo ideal es que un dispositivo de medición sea exacto y preciso, con mediciones todas cercanas y estrechamente agrupadas alrededor del valor real. La exactitud y precisión de un proceso de medición generalmente se establecen midiendo repetidamente algún estándar de referencia rastreable . Dichos estándares están definidos en el Sistema Internacional de Unidades (abreviado SI del francés: Système international d'unités ) y son mantenidos por organizaciones de estándares nacionales como el Instituto Nacional de Estándares y Tecnología de los Estados Unidos.

Esto también se aplica cuando las mediciones se repiten y se promedian. En ese caso, el término error estándar se aplica correctamente: la precisión del promedio es igual a la desviación estándar conocida del proceso dividida por la raíz cuadrada del número de mediciones promediadas. Además, el teorema del límite central muestra que la distribución de probabilidad de las mediciones promediadas estará más cerca de una distribución normal que la de las mediciones individuales.

En cuanto a la precisión podemos distinguir:

Una convención común en ciencia e ingeniería es expresar la exactitud y/o precisión implícitamente mediante cifras significativas . Cuando no se indique explícitamente, se entenderá que el margen de error es la mitad del valor del último lugar significativo. Por ejemplo, un registro de 843,6 m, o 843,0 m, o 800,0 m implicaría un margen de 0,05 m (el último lugar significativo son las décimas), mientras que un registro de 843 m implicaría un margen de error de 0,5 m ( los últimos dígitos significativos son las unidades).

Una lectura de 8.000 m, con ceros finales y sin punto decimal, es ambigua; los ceros finales pueden o no considerarse cifras significativas. Para evitar esta ambigüedad, el número podría representarse en notación científica: 8,0 × 10 3 m indica que el primer cero es significativo (de ahí un margen de 50 m), mientras que 8,000 × 10 3 m indica que los tres ceros son significativos, dando una margen de 0,5 m. De manera similar, se puede utilizar un múltiplo de la unidad de medida básica: 8,0 km equivale a 8,0 × 10 3 m. Indica un margen de 0,05 km (50 m). Sin embargo, confiar en esta convención puede dar lugar a errores de precisión falsos al aceptar datos de fuentes que no la obedecen. Por ejemplo, una fuente que informa un número como 153.753 con una precisión de +/- 5.000 parece tener una precisión de +/- 0,5. Según la convención, se habría redondeado a 150.000.

Alternativamente, en un contexto científico, si se desea indicar el margen de error con mayor precisión, se puede utilizar una notación como 7,54398(23) × 10 −10 m , es decir, un rango de entre 7,54375 y 7,54421 × 10 −10 metro.

La precisión incluye:

En ingeniería, la precisión a menudo se toma como tres veces la desviación estándar de las mediciones tomadas, lo que representa el rango dentro del cual pueden ocurrir el 99,73% de las mediciones. [6] Por ejemplo, un ergonomista que mide el cuerpo humano puede estar seguro de que el 99,73% de sus mediciones extraídas se encuentran dentro de ± 0,7 cm (si utiliza el sistema de procesamiento GRYPHON) o ± 13 cm (si utiliza datos no procesados). [7]

Un cambio en el significado de estos términos apareció con la publicación de la serie de normas ISO 5725 en 1994, que también se refleja en la edición de 2008 del Vocabulario Internacional de Metrología (VIM) del BIPM, puntos 2.13 y 2.14. [2]

Según ISO 5725-1, [1] el término general "precisión" se utiliza para describir la cercanía de una medición al valor real. Cuando el término se aplica a conjuntos de mediciones del mismo mensurando , involucra un componente de error aleatorio y un componente de error sistemático. En este caso, la veracidad es la cercanía de la media de un conjunto de resultados de medición al valor real (verdadero) y la precisión es la cercanía del acuerdo entre un conjunto de resultados.

ISO 5725-1 y VIM también evitan el uso del término " sesgo ", previamente especificado en BS 5497-1, [8] porque tiene diferentes connotaciones fuera de los campos de la ciencia y la ingeniería, como en la medicina y el derecho.

La precisión también se utiliza como medida estadística de qué tan bien una prueba de clasificación binaria identifica o excluye correctamente una condición. Es decir, la precisión es la proporción de predicciones correctas (tanto positivas como negativas ) entre el número total de casos examinados. [9] Como tal, compara estimaciones de probabilidad previa y posterior a la prueba . Para aclarar el contexto mediante la semántica, a menudo se lo denomina "precisión de Rand" o " índice de Rand ". [10] [11] [12] Es un parámetro de la prueba. La fórmula para cuantificar la precisión binaria es:

En este contexto, los conceptos de veracidad y precisión definidos por la norma ISO 5725-1 no son aplicables. Una razón es que no existe un único “valor verdadero” de una cantidad, sino dos posibles valores verdaderos para cada caso, mientras que la precisión es un promedio de todos los casos y, por lo tanto, toma en cuenta ambos valores. Sin embargo, el término precisión se utiliza en este contexto para referirse a una métrica diferente que se origina en el campo de la recuperación de información (ver más abajo).

Cuando se calcula la precisión en la clasificación multiclase, la precisión es simplemente la fracción de clasificaciones correctas: [13]

La precisión también se denomina precisión de primer nivel para distinguirla de la precisión de cinco primeros, común en la evaluación de redes neuronales convolucionales . Para evaluar la precisión de los cinco primeros, el clasificador debe proporcionar probabilidades relativas para cada clase. Cuando se clasifican, una clasificación se considera correcta si la clasificación correcta se encuentra dentro de las 5 predicciones principales realizadas por la red. La precisión del Top 5 se popularizó gracias al desafío ImageNet . Por lo general, es mayor que la precisión del top 1, ya que cualquier predicción correcta en las posiciones 2.ª a 5.ª no mejorará la puntuación del top 1, pero sí mejorará la puntuación del top 5.

En psicometría y psicofísica , el término precisión se utiliza indistintamente con validez y error constante . La precisión es sinónimo de confiabilidad y error variable . La validez de un instrumento de medición o prueba psicológica se establece mediante experimentación o correlación con la conducta. La confiabilidad se establece con una variedad de técnicas estadísticas, clásicamente a través de una prueba de consistencia interna como el alfa de Cronbach para garantizar que conjuntos de preguntas relacionadas tengan respuestas relacionadas, y luego la comparación de esas preguntas relacionadas entre la población de referencia y la población objetivo. [ cita necesaria ]

En simulación lógica , un error común en la evaluación de modelos precisos es comparar un modelo de simulación lógica con un modelo de simulación de circuito de transistores . Esta es una comparación de diferencias en precisión, no exactitud. La precisión se mide con respecto al detalle y la exactitud se mide con respecto a la realidad. [14] [15]

Los sistemas de recuperación de información, como las bases de datos y los motores de búsqueda web , se evalúan mediante muchas métricas diferentes , algunas de las cuales se derivan de la matriz de confusión , que divide los resultados en verdaderos positivos (documentos recuperados correctamente), verdaderos negativos (documentos no recuperados correctamente), falsos positivos (documentos recuperados incorrectamente) y falsos negativos (documentos no recuperados incorrectamente). Las métricas comúnmente utilizadas incluyen las nociones de precisión y recuperación . En este contexto, la precisión se define como la fracción de documentos recuperados que son relevantes para la consulta (verdaderos positivos divididos por verdaderos + falsos positivos), utilizando un conjunto de resultados relevantes de verdad seleccionados por humanos. La recuperación se define como la fracción de documentos relevantes recuperados en comparación con el número total de documentos relevantes (verdaderos positivos divididos por verdaderos positivos + falsos negativos). Con menos frecuencia, se utiliza la métrica de precisión, que se define como el número total de clasificaciones correctas (verdaderos positivos más verdaderos negativos) dividido por el número total de documentos.

Ninguna de estas métricas tiene en cuenta la clasificación de los resultados. La clasificación es muy importante para los motores de búsqueda web porque los lectores rara vez pasan de la primera página de resultados y hay demasiados documentos en la web para clasificarlos manualmente para determinar si deben incluirse o excluirse de una búsqueda determinada. Agregar un límite en un número particular de resultados tiene en cuenta la clasificación hasta cierto punto. La precisión de la medida en k , por ejemplo, es una medida de precisión que analiza solo los diez primeros resultados de búsqueda (k=10). Las métricas más sofisticadas, como la ganancia acumulada descontada , tienen en cuenta cada clasificación individual y se utilizan más comúnmente cuando esto es importante.

En los sistemas cognitivos, la exactitud y la precisión se utilizan para caracterizar y medir los resultados de un proceso cognitivo realizado por entidades biológicas o artificiales donde un proceso cognitivo es una transformación de datos, información, conocimiento o sabiduría a una forma de mayor valor. ( Pirámide DIKW ) A veces, un proceso cognitivo produce exactamente el resultado previsto o deseado, pero a veces produce resultados muy alejados de lo previsto o deseado. Además, las repeticiones de un proceso cognitivo no siempre producen el mismo resultado. La precisión cognitiva (C A ) es la propensión de un proceso cognitivo a producir el resultado previsto o deseado. La precisión cognitiva (CP ) es la propensión de un proceso cognitivo a producir sólo el resultado previsto o deseado. [16] [17] [18] Para medir la cognición aumentada en conjuntos humanos/engranajes, donde uno o más humanos trabajan en colaboración con uno o más sistemas cognitivos (engranajes), los aumentos en la exactitud cognitiva y la precisión cognitiva ayudan a medir el grado de cognición cognitiva. aumento .

{{cite web}}: Mantenimiento CS1: copia archivada como título ( enlace )